1.本技术涉及终端技术领域,尤其涉及音频的处理方法及电子设备。

背景技术:

2.如今视频的拍摄和制作已经成为我们日常生活和娱乐中不可或缺的一环。在视频的拍摄以及播放场景中,用户对视频画面的观感以及视频音频的听感的要求日渐提高。现如今,在视觉方面,立体视觉技术已经趋于成熟,可以令视频的画面具有立体感。但是,视频的听感却无法配合视觉的观感去营造出同步的空间感受,影响了用户的体验感。

3.因此,如何配合视频画面的立体感为用户营造音频的立体感,是亟待解决的问题。

技术实现要素:

4.本技术的目的在于提供一种音频的处理方法、图形用户界面(graphic user interface,gui)及电子设备。电子设备可根据视频中图像界面信息对视频的音频进行渲染,使视频的音画表现力得到同步。在视频的图像界面发生变化时,视频的音频也会相应的根据图像界面进行调整。这样,视频的画面和声音可以同步地为用户带来立体感受,提供更好的用户体验感。

5.上述目标和其他目标将通过独立权利要求中的特征来达成。进一步的实现方式在从属权利要求、说明书和附图中体现。

6.第一方面,提供一种音频的处理方法,所述方法包括:显示第一界面,所述第一界面包括第一控件;检测到对所述第一控件的第一操作;响应于所述第一操作,在第一时刻t1开始拍摄,显示第二界面,所述第二界面包括第一显示区域和第二显示区域;经过第一时长t1,在第二时刻t2,电子设备在第一显示区域显示第一摄像头实时采集的第一画面,在第二显示区域显示第二摄像头实时采集的第二画面;在所述第二时刻t2,麦克风采集第一声音,所述第一声音为在所述第一时刻所述电子设备所处的实时环境的声音;检测到对第三控件的第二操作;响应于所述第二操作,停止拍摄,保存第一视频,所述第一视频包括所述第一画面和所述第二画面;显示第三界面,所述第三界面包括第三控件;检测到对所述第三控件的第三操作,播放所述第一视频;在所述第一视频的所述第一时长处,播放所述第一画面、所述第二画面和第二声音,所述第二声音是根据第一画面和第二画面的画面权重对所述第一声音进行处理后得到的。

7.实施第一方面提供的方法,可以在双景录像视频的播放过程中,使得用户所听声音和所见画面之间具备同步的立体感。

8.结合第一方面,在一种可能的实现方式中,所述电子设备以上下分屏的形式显示所述第一显示区域和所述第二显示区域,所述第一显示区域的面积为第一面积,所述第二显示区域的面积为第二面积;所述第一画面的画面权重为所述第一面积与总面积的比值,所述第二画面的画面权重为所述第二面积与所述总面积的比值,所述总面积为所述第一面积和所述第二面积的面积之和。

9.结合第一方面,在一种可能的实现方式中,所述第一显示区域以悬浮窗的形式显示于所述第二显示区域上;所述第一显示区域的面积为第一面积,所述电子设备的显示屏的面积为第三面积;所述第一画面的画面权重为所述第一面积与所述第三面积的比值,所述第二画面的画面权重为整数1与所述第一画面的权重的差值。

10.结合第一方面,在一种可能的实现方式中,所述第一声音包括第一子声音和第二子声音,所述第一子声音为所述第一画面的声音,所述第二子声音为所述第二画面的声音,所述根据第一画面和第二画面的画面权重对所述第一声音进行处理包括:根据第一画面和第二画面的画面权重对所述第一子声音和第二子声音进行混音;在所述第一画面的画面权重大于所述第二画面的权重的情况下,采用第一混音比例,使所述第一子声音的响度大于所述第二子声音的响度;在所述第一画面的画面权重小于所述第二画面的权重的情况下,采用第二混音比例,使所述第一子声音的响度小于所述第二子声音的响度;在所述第一画面的画面权重等于所述第二画面的权重的情况下,采用第三混音比例,使所述第一子声音的响度等于所述第二子声音的响度。

11.在本实现方式中,用于所述第一音频包含的两个声音可以配合两个显示区域之间的大小,调整混音时的比例,为用户营造出面积大的显示区域中传出来的声音也更大的,面积小的显示区域中传出来的声音也更小的听觉感受。

12.结合第一方面,在一种可能的实现方式中,所述检测到对第三控件的第二操作之前,所述方法还包括:所述电子设备保存所述第一声音;根据第一画面和第二画面的画面权重对所述第一声音进行处理包括:所述电子设备根据第一画面和第二画面的画面权重对所述第一声音进行处理,得到所述第二声音;所述电子设备保存所述第二声音,并将所述第一声音删除。

13.在本实现方式中,先对未处理的音频进行保存,在保存后在进行处理,可以在录制音频过程中减少处理器的占用,提高音频录制过程的流畅度。

14.结合第一方面,在一种可能的实现方式中,所述第一声音包括第一子声音和第二子声音,所述第一子声音为所述第一画面的声音,所述第二子声音为所述第二画面的声音,所述根据第一画面和第二画面的画面权重对所述第一声音进行处理包括:所述电子设备根据所述第一摄像头的第一视场角和所述第二摄像头的第二视场角,分别对所述第一声音进行滤波,得到所述第一子声音和所述第二子声音;所述电子设备根据所述第一画面和所述第二画面的画面权重,调整所述第一子声音和所述第二子声音的响度之后,将所述第一子声音和第二子声音进行混音,得到所述第二声音。

15.可理解的,在对双景录像模式录制的视频文件进行播放时,所述电子设备将在显示屏中显示两个画面,这两个画面在录制时是来自两个不同的摄像头的。在观看该视频文件时,两个画面的大小和视角的防线和范围可能是不一样的。比如说,所述第一画面中,呈现的是所述电子设备的前置摄像头拍摄的用户的人脸图像;所述第二画面中,呈现的是所述电子设备局的后置摄像拍摄的风景图像。此外,用户可以通过调节所述前置摄像头和所述后置摄头的焦距倍数,来改变所述人脸图像和所述风景图像在所述第一画面和所述第二画面中所呈现的视角,当焦距倍数变小时,图像的大小在画面中的就会按比例缩小,用户在视觉上会感觉自己离画面中事物的距离更远了,但是视角范围变大;当焦距倍数变大时,则图像的大小在画面中的就会按比例方法,用户在视觉上会感觉自己离画面中事物的距离更

近了,但是视角范围变小。

16.声音不仅有大小之分,声音也具备方向性,且这种方向性是可以被人类感知的。因此,在本技术实施例中,为了配合两个面积画面大小和两个画面所呈现给用户的视角范围带给用户的观感,本方法中,通过结合两个画面的视角范围,电子设备对在所述第一画面视角方向上采集的音频进行过增强,得到一个和所述第一画面的视角方向对应的声音;并对在所述第二画面的视角方向上采集的音频进行过增强,得到一个和所述第一画面的视角方向对应的声音,在根据所述第一显示区域和所述第二显示区域的面积,调整这两个声音融合的比例,得到与所述第一画面对应的第一子声音以及与所述第二画面对应的第二子声音。将所述第一子声音和所述第二子声音混合后,得到最后用输出的音频(即所述第二声音)。

17.结合第一方面,在一种可能的实现方式中,所述第一声音包括第一子声音和第二子声音,所述第一子声音为所述第一画面的声音,所述第二子声音为所述第二画面的声音,所述根据第一画面和第二画面的画面权重对所述第一声音进行处理包括:所述电子设备根据所述第一摄像头的第一视场角和所述第二摄像头的第二视场角,分别对所述第一声音进行滤波,得到所述第一子声音和所述第二子声音;所述电子设备获取所述第一显示区域相对于所述第二显示区域的第一方位信息;所述电子设备根据所述第一方位信息对所述第一子声音进行方位虚拟,得到第一左方位声音和第一右方位声音;所述电子设备根据所述第一画面和所述第二画面的画面权重,调整所述第一左方位声音、第一右方位声音以及所述第二子声音的响度之后,将所述第一子声音和第二子声音进行混音,得到所述第二声音。

18.在实际拍摄时,第一显示区域的画面应为所述电子设备的正前方或者正后方。但是由于在画中画模式下,所述第一显示区域包含在所述第二区域中,且所述第一显示区域的方位是可调整的。因此,第一显示区域在第二显示区域中的位置在视觉上可能为偏左和偏右。在本实现方式中,所述电子设备将对所述第一方位信息对所述第一方位声音进行方位虚拟,使用户对所述第一子声音的感知方向能和所述第一显示区域的方位相契合。

19.结合第一方面,在一种可能的实现方式中,所述第一声音包括第一子声音和第二子声音,所述第一子声音为所述第一画面的声音,所述第二子声音为所述第二画面的声音,所述根据第一画面和第二画面的画面权重对所述第一声音进行处理包括:所述电子设备根据所述第一摄像头的第一视场角和所述第二摄像头的第二视场角,分别对所述第一声音进行滤波,得到所述第一子声音和所述第二子声音;所述第一子声音包括第一左声道声音和第一右声道声音,所述第一左声道声音由所述电子设备根据所述第一视场角的左半角对所述第一声音进行滤波得到;所述第一右声道声音由所述电子设备根据所述第一视场角的右半角对所述第一声音进行滤波得到;所述第二方向声音包括第二左声道声音和第二右声道声音,所述第二左声道声音由所述电子设备根据所述第二视场角的左半角对所述第一声音进行滤波得到;所述第二右声道声音由所述电子设备根据所述第二视场角的右半角对所述第一声音进行滤波得到。

20.所述电子设备根据所述第一画面和所述第二画面的画面权重,调整所述第一左声道声音、所述第一右声道声音、所述第二左声道声音以及所述第二右声道声音的响度之后,将所述第一子声音和第二子声音进行混音,得到所述第二声音。

21.在本实现方式中,所述电子设备在结合画面的视场所述初始音频进行增强的过程

中,可以将视场角按左右两个方向进行区分,对每个画面均得到区分左声道和右声道的两个声音,能使最后的得到的用于输出的音频更具立体感。

22.结合第一方面,在一种可能的实现方式中,所述第一声音包括第一子声音和第二子声音,所述第一子声音为所述第一画面的声音,所述第二子声音为所述第二画面的声音,所述检测到对第三控件的第二操作之前,所述方法还包括:在第三时刻t3,响应于切换摄像头的操作,所述电子设备将所述第一显示区域显示的画面由所述第一摄像头拍摄的画面切换为第三摄像头拍摄的画面;在第四时刻t4,所述电子设备在第一显示区域显示所述第三摄像头拍摄的第三画面,所述第四时刻t4在所述第三时刻t3之后;所述电子设备根据所述第三摄像头的第三视场角和所述第一摄像头的第一视场角,分别对所述第一声音进行滤波,得到历史声音和目标声音;在所述第三时刻t3和所述第四时刻t4的时间内,所述电子设备根据将所述第三时刻t3和所述第四时刻t4之间的时间间隔,动态调整所述历史声音和所述目标声音的混音比例,并基于所述混音比例将所述历史声音和所述目标声音混音,得到所述第一子声音。

23.所述电子设备切换所述第一显示区域对应的摄像头时,该第一显示区域中画面的视场角也随之改变,电子设备基于该画面对音频进行滤波所得的音频信号也会改变。但是,由于电子设备进行镜头切换时在往往需要一定的处理时间,而电子设备基于镜头切换音频的调整短在极短的时间内就能完成。这样,画面的观感和音频的听感可能会有不平衡性。因此,在本实现方式中,所述电子设备可以在切换摄像头的过程中,动态调整前后两个画面所得的声音在第三音频中的比例,将声音方向的转变更为缓慢地发生,使所述音频的切换能够平滑进行。

24.第二方面,本技术实施例提供一种电子设备,所述电子设备包括:一个或多个处理器和存储器;所述存储器与所述一个或多个处理器耦合,所述存储器用于存储计算机程序代码,所述计算机程序代码包括计算机指令,所述一个或多个处理器调用所述计算机指令以使得所述电子设备执行第一方面或第一方面的任意可能的实现方式中的方法。

25.第三方面,提供一种芯片系统,所述芯片系统应用于电子设备,所述芯片系统包括一个或多个处理器,所述处理器用于调用计算机指令以使得所述电子设备执行如第一方面中任一可能的实现方式,或如第二方面中任一可能的实现方式。

26.第四方面,一种包含指令的计算机程序产品,其特征在于,当上述计算机程序产品在电子设备上运行时,使得上述电子设备执行如第一方面中任一可能的实现方式,或如第二方面中任一可能的实现方式。

27.第五方面,提供一种计算机可读存储介质,包括指令,其特征在于,当上述指令在电子设备上运行时,使得上述电子设备执行如第一方面中任一可能的实现方式,或如第二方面中任一可能的实现方式。

附图说明

28.图1a为本技术实施例提供的一种摄像头和视场角之间对应关系的示意图;

29.图1b为本技术实施例提供的一种电子设备前/后置摄像头的视场角范围的示意图;

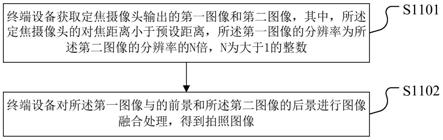

30.图2a为本技术实施例提供的一种双景录像下的一种录制界面图;

31.图2b为本技术实施例提供的一种电子设备播放双景录像模式下所录音频的示意图;

32.图3为本技术实施例提供的电子设备100的结构示意图;

33.图4为本技术实施例提供的一些人机交互界面示意图;

34.图5为本技术实施例提供的一些人机交互界面示意图;

35.图6为本技术实施例提供的一些人机交互界面示意图;

36.图7a为本技术实施例提供的一种录制界面的示意图;

37.图7b为本技术实施例提供的另一种录制界面的示意图;

38.图7c为本技术实施例提供的又一种录制界面的示意图;

39.图8a为本技术实施例提供的一种电子设备结合画面的视场角对音频信号进行过滤的一种场景示意图;

40.图8b为本技术实施例提供的另一种电子设备结合画面的视场角对音频信号进行过滤的一种场景示意图;

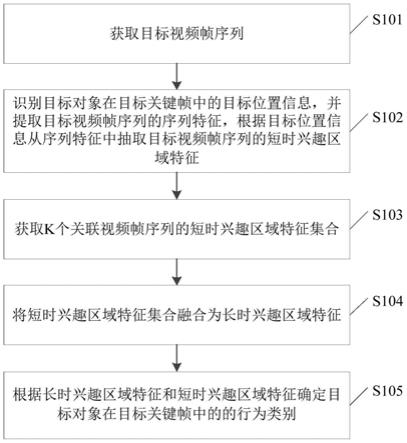

41.图9为本技术实施例提供的一种音频的处理方法的流程图;

42.图10为本技术实施例提供的另一种音频的处理方法的流程图;

43.图11为本技术实施例提供的又一种音频的处理方法的流程图;

44.图12为本技术实施例提供的又一种音频的处理方法的流程图;

45.图13为本技术实施例提供的一种平滑切换音频的方法的流程图。

具体实施方式

46.本技术以下实施例中所使用的术语只是为了描述特定实施例的目的,而并非旨在作为对本技术的限制。如在本技术的说明书和所附权利要求书中所使用的那样,单数表达形式“一个”、“一种”、“所述”、“上述”、“该”和“这一”旨在也包括复数表达形式,除非其上下文中明确地有相反指示。还应当理解,本技术中使用的术语“和/或”是指并包含一个或多个所列出项目的任何或所有可能组合。

47.由于本技术实施例涉及神经网络的应用,为了便于理解,下面先对本技术实施例涉及的相关术语及神经网络等相关概念进行介绍。

48.(1)双景录像模式

49.双景录像模式是指,电子设备中的多个摄像头,例如前置摄像头和后置摄像头,可以同时录制两路视频。在双景录像模式下,在录像预览或者录像过程中或者在对已录制视频的播放过程中,显示屏可以在同一界面上同时显示来自这两个摄像头的两幅图像。这两幅图像可以在同一界面上拼接显示,或者以画中画的方式显示。双景录像包括但不限于以下几种常用的录像模式:

50.1.上下分屏

51.即将设备的显示屏分为上下两个显示界面,上下两个显示界面不交叠。上显示界面和下显示界面的面积可以相同,也可以不同。

52.2.画中画

53.即将设备的显示屏分为一大一小的两个显示界面,较小的显示界面包含于较大的显示界面中。其中,较大的显示区域一般铺满设备的屏幕,较小显示区域中的图像可以覆盖

于较大的显示区域中的图像之上。在一些情况中,较小的显示区域还支持进行缩放,其在设备屏幕中的位置还可以变换。关于该显示方式,后续实施例会详细说明。

54.另外,在双景录像模式下,这两个摄像头的两幅图像拍摄的多幅图像可以保存为图库(又可称为相册)中的多个视频,或者这多个视频拼接成的合成视频。

55.其中,“录像”也可以称为“录制视频”。在本技术以下实施例中,“录像”和“录制视频”表示相同的含义。

[0056]“双景录像模式”只是本技术实施例所使用的一些名称,其代表的含义在本技术实施例中已经记载,其名称并不能对本实施例构成任何限制。

[0057]

(2)焦距和视场角:焦距是从镜头的中心点到焦平面上所形成的清晰影像之间的距离,光学系统中衡量光的聚集或发散的度量方式。焦距的大小决定着视角的大小,焦距数值小,视场角大,所观察到的范围也大;焦距数值大,视场角小,观察范围小。根据焦距能否调节,可分为定焦镜头和变焦镜头两大类。当对同一距离远的同一个被摄目标拍摄时,镜头焦距长的所成的像大,镜头焦距短的所成的像小。在光学仪器中,以光学仪器的镜头为顶点,以被测目标的物象可通过镜头的最大范围的两条边缘构成的夹角,称为视场角。视场角的大小决定了光学仪器的视野范围,视场角越大,视野就越大,光学倍率就越小。通俗地说,目标物体超过这个角就不会被收在镜头里。焦距与视场角成反比,即焦距越大,视场角越小,反之视场角越大。以图1a为例,摄像头在拍摄的过程中可以对相机的焦距进行调节,其提供了1

×

(图中未给出)、2

×

、3

×

、4

×

、5

×

以及6

×

六个档位的焦距档位。不难理解,当焦距为1

×

的时候,摄像头所能拍摄的视场角为最大的,即摄像头正前方的180

°

。当对焦距进行调节后为2

×

后,如图1a所示,其视场角已经变为84

°

了;如果继续将焦距调整为6

×

,如图1a所示,其视场角则只剩下正前方30

°

了。

[0058]

(3)视场角范围大小和正负

[0059]

图1b为本技术实施例提供的一种电子设备前/后置摄像头的视场角范围的示意图。如图1b所示,为方便读者理解,图1b所呈现的为电子设备直立放置时的俯视图,电子设备可以视作点p。则opo’为电子设备所在的平面。其中opo’左侧表示电子设备前置摄像头所在的一侧,opo’右侧表示电子设备100后置摄像头所在的一侧。在图1b中,opo’左侧的阴影部分表示电子设备前置摄像头所能获取到的最大的视场角范围,opo’右侧的空白部分表示电子设备后置摄像头所能获取到的最大视场角范围。图1b中示出的视场角示意图仅为了方便说明,在实际的场景中也为表现为其他形式。

[0060]

在本技术以下的实施例中,以电子设备所在的平面opo’为界限,规定:opo’左侧的视场角为正,opo’右侧的视场角为负,以此将空间中0

°

至于360

°

的视角分为0

°

至 180

°

以及

‑

180

°

至0

°

两个象限。也就是说,在本技术以下实施例中,电子设备的前置摄像头的视场角均为正值,后置摄像头的视场角均为负值。在图1b中,各点与点p的连线表示在某焦距下,摄像头视场角的边界。例如,假设电子设备的后置摄像头在焦距为3

×

时视场角为90

°

,则在图1b中,即为∠bpb’=

‑

90

°

,射线bp和射线b’p即为后置摄像头在3

×

焦距下视场角的边界。假设电子设备的前置摄像头在焦距为6

×

时视场角为30

°

,则在图1b中,即为∠fpf’= 30

°

,射线fp和射线f’p即为前置摄像头在6

×

焦距下视场角的边界。

[0061]

应理解,在电子设备出厂时,电子设备相机所提供的焦距与其对应的视场角之间的对应关系是固定的。也就是说,在用户对摄像头的焦距进行选择后,电子设备即能获取该

摄像头在该焦距下的对应的视场角的角度值,该角度值可以反映视场角的大小和方向。

[0062]

(4)声源分离:即跟踪目标语音并抑制或者消除干扰语音。在复杂的声学环境下,麦克风采集的语音信号包含目标语音信号以及其他的干扰信号。例如,在日常生活中演讲者通过麦克风说话时,除了目标说话人的语音信号之外,还经常会伴随者其他说话人的语音,比如在室外、街道等场景,干扰人的信号会严重影响目标人语音的识别性能,这个时候就需要通过声源分离来跟踪目标语音并抑制或者消除干扰语音。

[0063]

(5)凸优化(convex,cvx)波束训练:cvx是matlab的一个工具箱,是用于构建和解决约束凸规划(dcp)的建模系统。cvx波束训练可以利用matlab选择不同的阵列形式,利用凸优化的方法进行波束形成。

[0064]

(6)延时求和波束形成算法(delay and sum beamforming,dsb):用于对不同麦克风信号之间的相对延迟进行补偿,然后叠加延时后的信号形成一个单一的输出,使波束指向某一空间方向。

[0065]

(7)画面权重

[0066]

双景录像模式下,在既定的界面形式下,可以计算出单个取景框与电子设备显示屏之间的面积之比,作为该单个取景框在该界面形式下的画面权重。

[0067]

在一些实施例中,双景录像模式下两个取景框拼接后形成的区域布满显示屏的显示区域,此时两个取景框的画面权重之和的值为1。例如图5中(c)所示,通过计算可以得出,取景框701的画面权重为1248/2340,取景框702的画面权重为1092/2340,二者占比之和为1。同理,在一些实施例中,当双景录像模式下两个取景框拼接后形成的区域未布满显示屏的显示区域时,此时两个取景框的画面权重之和可能小于1。

[0068]

不限于上述计算画面权重比例的方式,本技术实施例也可以采用其他的方式计算两个取景框的画面权重,只要该给方式计算得到的两个画面权重能够表征两个取景框的面积的大小关系即可。例如,在一些实施例中,可以将单个取景框的面积与两个取景框面积之和的比例作为该单个取景框的画面权重,这样可以确保两个取景框的画面权重比例之和为1,也更便于计算。

[0069]

例如,在一些实施例中,两个取景框的画面权重的计算方式还可以为:

[0070]

w1=α

×

s1/(s1 s2)

[0071]

w2=1

‑

w1

[0072]

其中,w1表示两个取景框中面积较小的取景框的画面权重,s1为该取景框的面积;w2表示两个取景框中面积较大的取景框的画面权重,s2为该取景框的面积。α为校正系数,是在电子设备出厂时已经设定好的定值,其取值范围为[1,(s1 s2)/s1]。这样,可以防止两个取景框面积差距太大而导致面积较小的取景框的画面权重的值过小。

[0073]

(8)声源方位虚拟技术:人有两个耳朵,却能定位来自三维空间的声音,这得力于人耳对声音信号的分析系统。因为声音信号从音源到达人耳(鼓膜前)的过程中可能会有反射、叠加等过程,因此,从空间任意一点传到人耳的信号都可以用一个滤波系统来描述,音源经滤波器处理得到的就是两耳鼓膜前的声音信号。这个传输系统是一个黑盒子,我们不必关心声音是如何传递到双耳的,而只需关心音源和双耳信号的差别。如果我们得到这组描述空间信息的滤波器(也可称为传递函数),就能还原来自空间这个方位的声音信号(如通过双声道耳机)。如果我们有空间所有方位到双耳的滤波器组,就能得到一个滤波矩阵,

从而还原来自整个空间方位的声音信号,这就是声源方位虚拟技术的作用。

[0074]

(9)头部反应传送函数(head

‑

response transfer function,hrtf):hrtf是一种声音定位的处理技术,可以看成是一个特定位置的声音传输到左右耳的频率响应。由于声音会从耳廓、或肩膀反射到人耳内部,于是当我们用两个音箱模拟声音定位时,可以利用特定的运算方式,来计算不同方向或位置声音所产生的大小和音调等,进而制造出立体空间声音定位的效果。

[0075]

(10)cipic_hrir数据:hrtf是一个特定位置的声音传输到左右耳的频率响应,hrtf对应的时域响应叫hrir。要使音源具备hrtf的特性,只需要将音源与hrir数据做卷积运算即可。cipic_hrir数据就是美国加利福尼亚大学戴维斯分校cipic hrtf数据库提供的一组hrir数据。

[0076]

(11)卷积:卷积是分析数学中一种重要的运算。假设f(x),g(x)是r1上的两个可积函数,作积分:可以证明,关于几乎所有的实数x,上述积分是存在的。这样,随着x的不同取值,这个积分就定义了一个新函数h(x),称为函数f与g的卷积,记为h(x)=(f*g)(x)。

[0077]

(12)声音重混:把多种来源的声音,整合至一个立体音轨或单音音轨中。常见的混音算法有直接加和法以及平均调整权重法等。

[0078]

(13)快速傅立叶变换算法(fast fourier transformation,fft):fft是离散傅立叶变换的快速算法,可以将一个信号由时域变换到频域。

[0079]

(14)快速傅里叶逆变换算法(inverse fast fourier transform,ifft):ifft是与fft对应的快速傅立叶反变换的算法,可以将一个信号频域由变换到时域。

[0080]

如今视频的拍摄和制作已经成为我们日常生活和娱乐中不可或缺的一环。各种各样的摄影设备以及拍摄模式称为各电子厂商的研发热点。“双景录像”是一种新兴的录像方式,在录制时,设备可以同时调用两个镜头进行视频录制,同时呈现例如特写和全景、前置摄像和后置摄像这样这两种不同的视野下的图景,做出不同的画面组合,在视觉上形成的巨大反差。

[0081]

图2a示例性的给出了电子设备在双景录像下的一种拍摄界面。如图2a所示,电子设备200同时调用了前置摄像头和后置摄像头进行拍摄。此时,拍摄界面20中被分隔线203分为显示区域201和显示区域202两个显示区域,其中:

[0082]

显示区域201显示的为电子设备200的前置摄像头摄取到的图像,其图像为正在录像的用户的人脸。显示区域202显示的为电子设备200的后置摄像头摄取到的图像,其图像为用户前方的风景图。在双景录像模式下,两种具备明显视觉差异的画面可以被同时呈现在一个画面中。

[0083]

应理解,在电子拍摄视频时,电子设备除了会通过摄像头等图像采集设备录取场景的画面信息之外,还会通过如麦克风等音频采集设备录取环境中的音频信息。

[0084]

在一种实施方式中,双景录像的音频信息可以按照普通录音录像的模式录制和输出音频。图2b为本技术实施例提供的一种电子设备播放双景录像模式下所录音频的示意图。如图2b所示,电子设备将麦克风采集到的空间中全方位的音频信号进行必要的渲染和过滤操作,例如改变音色、去噪等,最后将通过扬声器播放。

[0085]

图2b中,电子设备仅仅对的音频进行了简单的渲染和过滤,可能会让音频的听感

变的更加清晰一些。但是双景录像视频的录制和播放涉及两个画面,画面与画面之间存在大小和方位的关系,且这种关系在录制的过程中是可以发生变化的。因此,图2b所提供的这种单一的音频录播方式不能很好的契合双景录像在画面上给用户的视觉差异。这样,用户在听觉上不能充分感知双景录像模式下不同画面之间的差异性,用户体验较差。

[0086]

基于上述问题,本技术实施例提供了一种音频的处理方法和电子设备,该电子设备的双景录像模式包含多个样式的分屏录像方式。在分屏录像时,当用户更改分屏录像的方式、对两个屏幕的大小进行缩放或对两个屏幕的画面进行切换时,该电子设备可以根据图像界面信息(例如两个显示区域录制时的焦距、两个显示区域的相对位置和面积大小等)对采集的音频进行相应的处理,使用户在听觉和视觉上有同步的立体感。

[0087]

首先,介绍本技术实施例提供的电子设备。

[0088]

该电子设备以是手机、平板电脑、可穿戴设备、车载设备、增强现实(augmented reality,ar)/虚拟现实(virtual reality,vr)设备、笔记本电脑、超级移动个人计算机(ultra

‑

mobile personal computer,umpc)、上网本、个人数字助理(personaldigital assistant,pda)或专门的照相机(例如单反相机、卡片式相机)等,本技术对该电子设备的具体类型不作任何限制。

[0089]

图3示例性示出了该电子设备的结构。

[0090]

如图3所示,电子设备100可具有多个摄像头193,例如前置摄像头、广角摄像头、超广角摄像头、长焦摄像头等。此外,电子设备100还可包括处理器110,外部存储器接口120,内部存储器121,通用串行总线(universal serial bus,usb)接口130,充电管理模块140,电源管理模块141,电池142,天线1,天线2,移动通信模块150,无线通信模块160,音频模块170,扬声器170a,受话器170b,麦克风170c,耳机接口170d,传感器模块180,按键190,马达191,指示器192,显示屏194,以及用户标识模块(subscriber identification module,sim)卡接口195等。

[0091]

其中传感器模块180可以包括压力传感器180a,陀螺仪传感器180b,气压传感器180c,磁传感器180d,加速度传感器180e,距离传感器180f,接近光传感器180g,指纹传感器180h,温度传感器180j,触摸传感器180k,环境光传感器180l,骨传导传感器180m等。

[0092]

可以理解的是,本技术实施例示意的结构并不构成对电子设备100的具体限定。在本技术另一些实施例中,电子设备100可以包括比图示更多或更少的部件,或者组合某些部件,或者拆分某些部件,或者不同的部件布置。图示的部件可以以硬件,软件或软件和硬件的组合实现。

[0093]

处理器110可以包括一个或多个处理单元,例如:处理器110可以包括应用处理器(application processor,ap),调制解调处理器,图形处理器(graphics processingunit,gpu),图像信号处理器(image signal processor,isp),控制器,存储器,视频编解码器,数字信号处理器(digital signal processor,dsp),基带处理器,和/或神经网络处理器(neural

‑

network processing unit,npu)等。其中,不同的处理单元可以是独立的器件,也可以集成在一个或多个处理器中。

[0094]

在一些实施例中,控制器或gpu等处理器110,可以用于在双景录像场景下,将两个摄像头193同时采集到的多帧图像,通过拼接或局部叠加等方式合成显示于取景框中的预览图像,以便电子设备100可以同时显示这两个摄像头193采集到的图像。

[0095]

在另一些实施例中,控制器或gpu等处理器110,还可以用于在双景录像拍摄场景下,对每个摄像头193采集到的图像进行防抖处理后,再将多个摄像头193对应的防抖处理后的图像进行合成。

[0096]

其中,控制器可以是电子设备100的神经中枢和指挥中心。控制器可以根据指令操作码和时序信号,产生操作控制信号,完成取指令和执行指令的控制。

[0097]

处理器110中还可以设置存储器,用于存储指令和数据。在一些实施例中,处理器110中的存储器为高速缓冲存储器。该存储器可以保存处理器110刚用过或循环使用的指令或数据。如果处理器110需要再次使用该指令或数据,可从存储器中直接调用。避免了重复存取,减少了处理器110的等待时间,因而提高了系统的效率。

[0098]

在一些实施例中,处理器110可以包括一个或多个接口。接口可以包括集成电路(inter

‑

integrated circuit,i2c)接口,集成电路内置音频(inter

‑

integrated circuitsound,i2s)接口,脉冲编码调制(pulse code modulation,pcm)接口,通用异步收发传输器(universal asynchronous receiver/transmitter,uart)接口,移动产业处理器接口(mobile industry processor interface,mipi),通用输入输出(general

‑

purposeinput/output,gpio)接口,用户标识模块(subscriber identity module,sim)接口,和/或通用串行总线(universal serial bus,usb)接口等。

[0099]

i2c接口是一种双向同步串行总线,包括一根串行数据线(serial data line,sda)和一根串行时钟线(derail clock line,scl)。在一些实施例中,处理器110可以包含多组i2c总线。处理器110可以通过不同的i2c总线接口分别耦合触摸传感器180k,充电器,闪光灯,摄像头193等。例如:处理器110可以通过i2c接口耦合触摸传感器180k,使处理器110与触摸传感器180k通过i2c总线接口通信,实现电子设备100的触摸功能。

[0100]

i2s接口可以用于音频通信。在一些实施例中,处理器110可以包含多组i2s总线。处理器110可以通过i2s总线与音频模块170耦合,实现处理器110与音频模块170之间的通信。在一些实施例中,音频模块170可以通过i2s接口向无线通信模块160传递音频信号,实现通过蓝牙耳机接听电话的功能。

[0101]

pcm接口也可以用于音频通信,将模拟信号抽样,量化和编码。在一些实施例中,音频模块170与无线通信模块160可以通过pcm总线接口耦合。在一些实施例中,音频模块170也可以通过pcm接口向无线通信模块160传递音频信号,实现通过蓝牙耳机接听电话的功能。所述i2s接口和所述pcm接口都可以用于音频通信。

[0102]

uart接口是一种通用串行数据总线,用于异步通信。该总线可以为双向通信总线。它将要传输的数据在串行通信与并行通信之间转换。在一些实施例中,uart接口通常被用于连接处理器110与无线通信模块160。例如:处理器110通过uart接口与无线通信模块160中的蓝牙模块通信,实现蓝牙功能。在一些实施例中,音频模块170可以通过uart接口向无线通信模块160传递音频信号,实现通过蓝牙耳机播放音乐的功能。

[0103]

mipi接口可以被用于连接处理器110与显示屏194,摄像头193等外围器件。mipi接口包括摄像头串行接口(camera serial interface,csi),显示屏串行接口(display serial interface,dsi)等。在一些实施例中,处理器110和摄像头193通过csi接口通信,实现电子设备100的拍摄功能。处理器110和显示屏194通过dsi接口通信,实现电子设备100的显示功能。

[0104]

gpio接口可以通过软件配置。gpio接口可以被配置为控制信号,也可被配置为数据信号。在一些实施例中,gpio接口可以用于连接处理器110与摄像头193,显示屏194,无线通信模块160,音频模块170,传感器模块180等。gpio接口还可以被配置为i2c接口,i2s接口,uart接口,mipi接口等。

[0105]

usb接口130是符合usb标准规范的接口,具体可以是mini usb接口,micro usb接口,usb type c接口等。usb接口130可以用于连接充电器为电子设备100充电,也可以用于电子设备100与外围设备之间传输数据。也可以用于连接耳机,通过耳机播放音频。该接口还可以用于连接其他电子设备,例如ar设备等。

[0106]

可以理解的是,本技术实施例示意的各模块间的接口连接关系,只是示意性说明,并不构成对电子设备100的结构限定。在本技术另一些实施例中,电子设备100也可以采用上述实施例中不同的接口连接方式,或多种接口连接方式的组合。

[0107]

充电管理模块140用于从充电器接收充电输入。其中,充电器可以是无线充电器,也可以是有线充电器。在一些有线充电的实施例中,充电管理模块140可以通过usb接口130接收有线充电器的充电输入。在一些无线充电的实施例中,充电管理模块140可以通过电子设备100的无线充电线圈接收无线充电输入。充电管理模块140为电池142充电的同时,还可以通过电源管理模块141为电子设备供电。

[0108]

电源管理模块141用于连接电池142,充电管理模块140与处理器110。电源管理模块141接收电池142和/或充电管理模块140的输入,为处理器110,内部存储器121,外部存储器,显示屏194,摄像头193,和无线通信模块160等供电。电源管理模块141还可以用于监测电池容量,电池循环次数,电池健康状态(漏电,阻抗)等参数。在其他一些实施例中,电源管理模块141也可以设置于处理器110中。在另一些实施例中,电源管理模块141和充电管理模块140也可以设置于同一个器件中。

[0109]

电子设备100的无线通信功能可以通过天线1,天线2,移动通信模块150,无线通信模块160,调制解调处理器以及基带处理器等实现。

[0110]

天线1和天线2用于发射和接收电磁波信号。电子设备100中的每个天线可用于覆盖单个或多个通信频带。不同的天线还可以复用,以提高天线的利用率。例如:可以将天线1复用为无线局域网的分集天线。在另外一些实施例中,天线可以和调谐开关结合使用。

[0111]

移动通信模块150可以提供应用在电子设备100上的包括2g/3g/4g/5g等无线通信的解决方案。移动通信模块150可以包括至少一个滤波器,开关,功率放大器,低噪声放大器(low noise amplifier,lna)等。移动通信模块150可以由天线1接收电磁波,并对接收的电磁波进行滤波,放大等处理,传送至调制解调处理器进行解调。移动通信模块150还可以对经调制解调处理器调制后的信号放大,经天线1转为电磁波辐射出去。

[0112]

无线通信模块160可以提供应用在电子设备100上的包括无线局域网(wirelesslocal area networks,wlan)(如无线保真(wireless fidelity,wi

‑

fi)网络),蓝牙(bluetooth,bt),全球导航卫星系统(global navigation satellite system,gnss),调频(frequency modulation,fm),近距离无线通信技术(near field communication,nfc),红外技术(infrared,ir)等无线通信的解决方案。无线通信模块160可以是集成至少一个通信处理模块的一个或多个器件。无线通信模块160经由天线2接收电磁波,将电磁波信号调频以及滤波处理,将处理后的信号发送到处理器110。无线通信模块160还可以从处

理器110接收待发送的信号,对其进行调频,放大,经天线2转为电磁波辐射出去。

[0113]

在一些实施例中,电子设备100的天线1和移动通信模块150耦合,天线2和无线通信模块160耦合,使得电子设备100可以通过无线通信技术与网络以及其他设备通信。无线通信技术可以包括全球移动通讯系统(global system for mobile communications,gsm),通用分组无线服务(general packet radio service,gprs),码分多址接入(codedivision multiple access,cdma),宽带码分多址(wideband code division multipleaccess,wcdma),时分码分多址(time

‑

division code division multiple access,td

‑

scdma),长期演进(long term evolution,lte),bt,gnss,wlan,nfc,fm,和/或ir技术等。gnss可以包括全球卫星定位系统(global positioning system,gps),全球导航卫星系统(global navigation satellite system,glonass),北斗卫星导航系统(beidounavigation satellite system,bds),准天顶卫星系统(quasi

‑

zenith satellitesystem,qzss)和/或星基增强系统(satellite based augmentation systems,sbas)。

[0114]

电子设备100通过gpu,显示屏194,以及应用处理器等实现显示功能。gpu为图像处理的微处理器,连接显示屏194和应用处理器。gpu用于执行数学和几何计算,用于图形渲染。处理器110可包括一个或多个gpu,其执行程序指令以生成或改变显示信息。

[0115]

显示屏194用于显示图像,视频等。显示屏194包括显示面板。显示面板可以采用液晶显示屏(liquid crystal display,lcd),有机发光二极管(organic light

‑

emitting diode,oled),有源矩阵有机发光二极体或主动矩阵有机发光二极体(active

‑

matrix organic light emitting diode的,amoled),柔性发光二极管(flex light

‑

emitting diode,fled),miniled,microled,micro

‑

oled,量子点发光二极管(quantum dot light emitting diodes,qled)等。在一些实施例中,电子设备100可以包括1个或n个显示屏194,n为大于1的正整数。

[0116]

电子设备100可以通过isp,摄像头193,视频编解码器,gpu,显示屏194以及应用处理器等实现拍摄功能。

[0117]

isp用于处理摄像头193反馈的数据。例如,拍照时,打开快门,光线通过镜头被传递到摄像头感光元件上,光信号转换为电信号,摄像头感光元件将所述电信号传递给isp处理,转化为肉眼可见的图像。isp还可以对图像的噪点,亮度,肤色进行算法优化。isp还可以对拍摄场景的曝光,色温等参数优化。在一些实施例中,isp可以设置在摄像头193中。

[0118]

摄像头193用于捕获静态图像或视频。物体通过镜头生成光学图像投射到感光元件。感光元件可以是电荷耦合器件(charge coupled device,ccd)或互补金属氧化物半导体(complementary metal

‑

oxide

‑

semiconductor,cmos)光电晶体管。感光元件把光信号转换成电信号,之后将电信号传递给isp转换成数字图像信号。isp将数字图像信号输出到dsp加工处理。dsp将数字图像信号转换成标准的rgb,yuv等格式的图像信号。在一些实施例中,电子设备100可以包括1个或n个摄像头193,n为大于1的正整数。

[0119]

数字信号处理器用于处理数字信号,除了可以处理数字图像信号,还可以处理其他数字信号。例如,当电子设备100在频点选择时,数字信号处理器用于对频点能量进行傅里叶变换等。

[0120]

视频编解码器用于对数字视频压缩或解压缩。电子设备100可以支持一种或多种

视频编解码器。这样,电子设备100可以播放或录制多种编码格式的视频,例如:动态图像专家组(moving picture experts group,mpeg)1,mpeg2,mpeg3,mpeg4等。

[0121]

npu为神经网络(neural

‑

network,nn)计算处理器,通过借鉴生物神经网络结构,例如借鉴人脑神经元之间传递模式,对输入信息快速处理,还可以不断的自学习。通过npu可以实现电子设备100的智能认知等应用,例如:图像识别,人脸识别,语音识别,文本理解等。通过npu还可以实现本技术实施例提供的决策模型。

[0122]

外部存储器接口120可以用于连接外部存储卡,例如micro sd卡,实现扩展电子设备100的存储能力。外部存储卡通过外部存储器接口120与处理器110通信,实现数据存储功能。例如将音乐,视频等文件保存在外部存储卡中。

[0123]

内部存储器121可以用于存储计算机可执行程序代码,可执行程序代码包括指令。处理器110通过运行存储在内部存储器121的指令,从而执行电子设备100的各种功能应用以及数据处理。内部存储器121可以包括存储程序区和存储数据区。其中,存储程序区可存储操作系统,至少一个功能所需的应用程序(比如声音播放功能,图像播放功能等)等。存储数据区可存储电子设备100使用过程中所创建的数据(比如音频数据,电话本等)等。此外,内部存储器121可以包括高速随机存取存储器,还可以包括非易失性存储器,例如至少一个磁盘存储器件,闪存器件,通用闪存存储器(universal flash storage,ufs)等。

[0124]

电子设备100可以通过音频模块170,扬声器170a,受话器170b,麦克风170c,耳机接口170d,以及应用处理器等实现音频功能。例如音乐播放,录音等。音频模块170用于将数字音频信息转换成模拟音频信号输出,也用于将模拟音频输入转换为数字音频信号。音频模块170还可以用于对音频信号编码和解码。在一些实施例中,音频模块170可以设置于处理器110中,或将音频模块170的部分功能模块设置于处理器110中。

[0125]

扬声器170a,也称“喇叭”,用于将音频电信号转换为声音信号。电子设备100可以通过扬声器170a收听音乐,收听视频中的声音或收听免提通话。本技术实施例中,扬声器170a的数量可以为一个,也可以为两个或者超过两个。在本技术实施例提供的音频处理方法中,当电子设备100的扬声器170a的数量超过两个时,可以支持播放双声道的音频。此外,当电子设备100的扬声器170a的数量为两个时(这里将两个扬声器分别称为170a

‑

1和170a

‑

2),扬声器170a

‑

1和170a

‑

2可以分别设置于电子设备100的上方和下方。应注意,这里提到的“上方”和“下方”是基于电子设备被正立放置时的“上方”和“下方”。

[0126]

受话器170b,也称“听筒”,用于将音频电信号转换成声音信号。当电子设备100接听电话或语音信息时,可以通过将受话器170b靠近人耳接听语音。

[0127]

麦克风170c,也称“话筒”,“传声器”,用于将声音信号转换为电信号。当拨打电话或发送语音信息时,用户可以通过人嘴靠近麦克风170c发声,将声音信号输入到麦克风170c。电子设备100可以设置至少一个麦克风170c。在另一些实施例中,电子设备100可以设置两个麦克风170c,除了采集声音信号,还可以实现降噪功能。在另一些实施例中,电子设备100还可以设置三个,四个或更多麦克风170c,实现采集声音信号,降噪,还可以识别声音来源,实现定向录音功能等。

[0128]

耳机接口170d用于连接有线耳机。耳机接口170d可以是usb接口130,也可以是3.5mm的开放移动电子设备平台(open mobile terminal platform,omtp)标准接口,美国蜂窝电信工业协会(cellular telecommunications industry association of the usa,

ctia)标准接口。

[0129]

压力传感器180a用于感受压力信号,可以将压力信号转换成电信号。在一些实施例中,压力传感器180a可以设置于显示屏194。压力传感器180a的种类很多,如电阻式压力传感器,电感式压力传感器,电容式压力传感器等。电容式压力传感器可以是包括至少两个具有导电材料的平行板。当有力作用于压力传感器180a,电极之间的电容改变。电子设备100根据电容的变化确定压力的强度。当有触摸操作作用于显示屏194,电子设备100根据压力传感器180a检测触摸操作强度。电子设备100也可以根据压力传感器180a的检测信号计算触摸的位置。

[0130]

陀螺仪传感器180b可以用于确定电子设备100的运动姿态。在一些实施例中,可以通过陀螺仪传感器180b确定电子设备100围绕三个轴(即,x,y和z轴)的角速度。陀螺仪传感器180b可以用于拍摄防抖。示例性的,当按下快门,陀螺仪传感器180b检测电子设备100抖动的角度,根据角度计算出镜头模组需要补偿的距离,让镜头通过反向运动抵消电子设备100的抖动,实现防抖。陀螺仪传感器180b还可以用于导航,体感游戏场景。

[0131]

气压传感器180c用于测量气压。在一些实施例中,电子设备100通过气压传感器180c测得的气压值计算海拔高度,辅助定位和导航。

[0132]

磁传感器180d包括霍尔传感器。电子设备100可以利用磁传感器180d检测翻盖皮套的开合。在一些实施例中,当电子设备100是翻盖机时,电子设备100可以根据磁传感器180d检测翻盖的开合。进而根据检测到的皮套的开合状态或翻盖的开合状态,设置翻盖自动解锁等特性。

[0133]

加速度传感器180e可检测电子设备100在各个方向上(一般为三轴)加速度的大小。当电子设备100静止时可检测出重力的大小及方向。还可以用于识别电子设备姿态,应用于横竖屏切换,计步器等应用。

[0134]

距离传感器180f,用于测量距离。电子设备100可以通过红外或激光测量距离。在一些实施例中,拍摄场景,电子设备100可以利用距离传感器180f测距以实现快速对焦。

[0135]

接近光传感器180g可以包括例如发光二极管(led)和光检测器,例如光电二极管。发光二极管可以是红外发光二极管。电子设备100通过发光二极管向外发射红外光。电子设备100使用光电二极管检测来自附近物体的红外反射光。当检测到充分的反射光时,可以确定电子设备100附近有物体。当检测到不充分的反射光时,电子设备100可以确定电子设备100附近没有物体。电子设备100可以利用接近光传感器180g检测用户手持电子设备100贴近耳朵通话,以便自动熄灭屏幕达到省电的目的。接近光传感器180g也可用于皮套模式,口袋模式自动解锁与锁屏。

[0136]

环境光传感器180l用于感知环境光亮度。电子设备100可以根据感知的环境光亮度自适应调节显示屏194亮度。环境光传感器180l也可用于拍照时自动调节白平衡。环境光传感器180l还可以与接近光传感器180g配合,检测电子设备100是否在口袋里,以防误触。

[0137]

指纹传感器180h用于采集指纹。电子设备100可以利用采集的指纹特性实现指纹解锁,访问应用锁,指纹拍照,指纹接听来电等。

[0138]

温度传感器180j用于检测温度。在一些实施例中,电子设备100利用温度传感器180j检测的温度,执行温度处理策略。例如,当温度传感器180j上报的温度超过阈值,电子设备100执行降低位于温度传感器180j附近的处理器的性能,以便降低功耗实施热保护。在

另一些实施例中,当温度低于另一阈值时,电子设备100对电池142加热,以避免低温导致电子设备100异常关机。在其他一些实施例中,当温度低于又一阈值时,电子设备100对电池142的输出电压执行升压,以避免低温导致的异常关机。

[0139]

触摸传感器180k,也称“触控面板”。触摸传感器180k可以设置于显示屏194,由触摸传感器180k与显示屏194组成触摸屏,也称“触控屏”。触摸传感器180k用于检测作用于其上或附近的触摸操作。触摸传感器可以将检测到的触摸操作传递给应用处理器,以确定触摸事件类型。可以通过显示屏194提供与触摸操作相关的视觉输出。在另一些实施例中,触摸传感器180k也可以设置于电子设备100的表面,与显示屏194所处的位置不同。

[0140]

骨传导传感器180m可以获取振动信号。在一些实施例中,骨传导传感器180m可以获取人体声部振动骨块的振动信号。骨传导传感器180m也可以接触人体脉搏,接收血压跳动信号。在一些实施例中,骨传导传感器180m也可以设置于耳机中,结合成骨传导耳机。音频模块170可以基于骨传导传感器180m获取的声部振动骨块的振动信号,解析出语音信号,实现语音功能。应用处理器可以基于骨传导传感器180m获取的血压跳动信号解析心率信息,实现心率检测功能。

[0141]

按键190包括开机键,音量键等。按键190可以是机械按键。也可以是触摸式按键。电子设备100可以接收按键输入,产生与电子设备100的用户设置以及功能控制有关的键信号输入。

[0142]

马达191可以产生振动提示。马达191可以用于来电振动提示,也可以用于触摸振动反馈。例如,作用于不同应用(例如拍照,音频播放等)的触摸操作,可以对应不同的振动反馈效果。作用于显示屏194不同区域的触摸操作,马达191也可对应不同的振动反馈效果。不同的应用场景(例如:时间提醒,接收信息,闹钟,游戏等)也可以对应不同的振动反馈效果。触摸振动反馈效果还可以支持自定义。

[0143]

指示器192可以是指示灯,可以用于指示充电状态,电量变化,也可以用于指示消息,未接来电,通知等。

[0144]

sim卡接口195用于连接sim卡。sim卡可以通过插入sim卡接口195,或从sim卡接口195拔出,实现和电子设备100的接触和分离。电子设备100可以支持一个或多个sim卡接口。sim卡接口195可以支持nano sim卡,micro sim卡,sim卡等。同一个sim卡接口195可以同时插入多张卡。多张卡的类型可以相同,也可以不同。sim卡接口195也可以兼容不同类型的sim卡。sim卡接口195也可以兼容外部存储卡。电子设备100通过sim卡和网络交互,实现通话以及数据通信等功能。在一些实施例中,电子设备100采用esim,即:嵌入式sim卡。esim卡可以嵌在电子设备100中,不能和电子设备100分离。

[0145]

电子设备100可以通过isp,摄像头193,视频编解码器,gpu,显示屏194以及应用处理器等实现拍摄功能。

[0146]

isp用于处理摄像头193反馈的数据。例如,拍照时,打开快门,光线通过镜头被传递到摄像头感光元件上,光信号转换为电信号,摄像头感光元件将电信号传递给isp处理,转化为肉眼可见的图像。isp还可以对图像的噪点,亮度,肤色进行算法优化。isp还可以对拍摄场景的曝光,色温等参数优化。不限于集成于处理器110中,isp也可以设置在摄像头193中。

[0147]

在本技术实施例中,摄像头193的数量可以为m个,m≥2,m为正整数。电子设备100

在双景录像中开启的摄像头的数量可以为n,n≤m,n为正整数。

[0148]

摄像头193包括镜头和感光元件(又可称为图像传感器),用于捕获静态图像或视频。物体通过镜头生成光学图像投射到感光元件。感光元件可以是电荷耦合器件(charge coupled device,ccd)或互补金属氧化物半导体(complementary metal

‑

oxide

‑

semiconductor,cmos)光电晶体管。感光元件把光信号转换成电信号,之后将电信号传递给isp转换成数字图像信号,如标准的rgb,yuv等格式的图像信号。

[0149]

摄像头193的硬件配置以及物理位置可以不同,因此,不同摄像头采集到的图像的大小、范围、内容或清晰度等可能不同。

[0150]

摄像头193的出图尺寸可以不同,也可以相同。摄像头的出图尺寸是指该摄像头采集到的图像的长度与宽度。该图像的长度和宽度均可以用像素数来衡量。摄像头的出图尺寸也可以被叫做图像大小、图像尺寸、像素尺寸或图像分辨率。常见的摄像头的出图比例可包括:4:3、16:9或3:2等等。出图比例是指摄像头所采集图像在长度上和宽度上的像素数的大致比例。

[0151]

摄像头193可以对应同一焦段,也可以对应不同的焦段。该焦段可以包括但不限于:焦长小于预设值1(例如20mm)的第一焦段;焦长大于或者等于预设值1,且小于或者等于预设值2(例如50mm)的第二焦段;焦长大于预设值2的第三焦段。对应于第一焦段的摄像头可以被称为超广角摄像头,对应第二焦段的摄像头可以被称为广角摄像头,对应于第三焦段的摄像头可以被称为长焦摄像头。摄像头对应的焦段越大,该摄像头的视场角(field of view,fov)越小。视场角是指光学系统所能够成像的角度范围。

[0152]

摄像头193可以设置于电子设备的两面。和电子设备的显示屏194位于同一平面的摄像头可以被称为前置摄像头,位于电子设备的后盖所在平面的摄像头可以被称为后置摄像头。前置摄像头可用于采集面对显示屏194的拍摄者自己的图像,后置摄像头可用于采集拍摄者所面对的拍摄对象(如人物、风景等)的图像。

[0153]

在一些实施例中,摄像头193可以用于采集深度数据。例如,摄像头193可以具有(time of flight,tof)3d感测模块或结构光(structured light)3d感测模块,用于获取深度信息。用于采集深度数据的摄像头可以为前置摄像头,也可为后置摄像头。

[0154]

视频编解码器用于对数字图像压缩或解压缩。电子设备100可以支持一种或多种图像编解码器。这样,电子设备100可以打开或保存多种编码格式的图片或视频。

[0155]

电子设备100可以通过gpu,显示屏194,以及应用处理器等实现显示功能。gpu为图像处理的微处理器,连接显示屏194和应用处理器。gpu用于执行数学和几何计算,用于图形渲染。处理器110可包括一个或多个gpu,其执行程序指令以生成或改变显示信息。

[0156]

显示屏194用于显示图像,视频等。显示屏194包括显示面板。显示面板可以采用液晶显示屏(liquid crystal display,lcd),有机发光二极管(organic light

‑

emittingdiode,oled),有源矩阵有机发光二极体或主动矩阵有机发光二极体(active

‑

matrixorganic light emitting diode的,amoled),柔性发光二极管(flex light

‑

emittingdiode,fled),miniled,microled,micro

‑

oled,量子点发光二极管(quantum dot lightemitting diodes,qled)等。在一些实施例中,电子设备100可以包括一个或多个显示屏194。

[0157]

在一些实施例中,在双景录像模式下,显示屏194可以通过拼接或画中画等方式对

来自两个摄像头193双路图像进行显示,以使得来自该两个摄像头193的双路图像可以同时呈现给用户。

[0158]

在一些实施例中,在双景录像模式下,处理器110(例如控制器或gpu)可以对来自两个摄像头193的多帧图像进行合成。例如,将来自两个摄像头193的两路视频流合并为一路视频流,处理器110中的视频编码器可以对合成的一路视频流数据进行编码,从而生成一个视频文件。这样,该视频文件中的每一帧图像可以包含来自两个摄像头193的两个图像。在播放该视频文件的某一帧图像时,显示屏194可以显示来自两个摄像头193的双路图像,以为用户展示同一时刻或同一场景下,不同范围、不同清晰度或不同细节信息的两个图像画面。

[0159]

在一些实施例中,在双景录像模式下,处理器110可以分别对来自不同摄像头193的图像帧进行关联,以便在播放已拍摄的图片或视频时,显示屏194可以将相关联的图像帧同时显示在取景框中。该种情况下,不同摄像头193同时录制的视频可以分别存储为不同的视频,不同摄像头193同时录制的图片可以分别存储为不同的图片。

[0160]

在一些实施例中,在双景录像模式下,两个摄像头193可以采用相同的帧率分别采集图像,即两个摄像头193在相同时间内采集到的图像帧的数量相同。来自不同摄像头193的视频可以分别存储为不同的视频文件,该不同视频文件之间相互关联。该视频文件中按照采集图像帧的先后顺序来存储图像帧,该不同视频文件中包括相同数量的图像帧。在播放已录制的视频时,显示屏194可以根据预设的或用户指示的布局方式,按照相关联的视频文件中包括的图像帧的先后顺序进行显示,从而将不同视频文件中同一顺序对应的多帧图像显示在同一界面上。

[0161]

在一些实施例中,在双景录像模式下,两个摄像头193可以采用相同的帧率分别采集图像,即两个摄像头193在相同时间内采集到的图像帧的数量相同。处理器110可以分别为来自不同摄像头193的每一帧图像打上时间戳,以便在播放已录制的视频时,显示屏194可以根据时间戳,同时将来自两个摄像头193的多帧图像显示在同一界面上。

[0162]

为使用方便,电子设备通常在用户的手持模式下进行拍摄,而用户手持模式下通常会使得拍摄获得的画面发生抖动。在一些实施例中,在双景录像模式下,处理器110可以分别对不同摄像头193采集到图像帧分别进行防抖处理。而后,显示屏194再根据防抖处理后的图像进行显示。

[0163]

下面介绍本技术实施例提供的用户界面。

[0164]

首先,介绍开启双景录像模式所涉及的用户界面。

[0165]

如图4中的(a)所示,图4中(a)示例性示出了电子设备100上的用于应用程序菜单的示例性用户界面40。如图4中(a)所示,电子设备100可以配置有多个摄像头193,这多个摄像头193可包括前置摄像头和后置摄像头。其中,前置摄像头也可以是多个,例如前置摄像头193

‑

1、前置摄像头193

‑

2。如图4中(a)所示,前置摄像头193

‑

1、前置摄像头193

‑

2中可设置于电子设备100的顶端,170a为位于电子设备100顶部的扬声器。可以知道,在一些实施例中,如图4中(b)所示,电子设备100的背面也可以配置有后置摄像头193,以及照明器197。后置摄像头193也可以是多个,例如后置的摄像头193

‑

3、193

‑

4、193

‑

5以及193

‑

5。

[0166]

如图4中的(a)所示,主屏幕界面40包括日历小工具(widget)401、天气小工具402、应用程序图标403、状态栏404以及导航栏405。其中:

[0167]

日历小工具401可用于指示当前时间,例如日期、星期几、时分信息等。

[0168]

天气小工具402可用于指示天气类型,例如多云转晴、小雨等,还可以用于指示气温等信息,还可以用于指示地点。

[0169]

应用程序图标403可以包含例如(wechat)的图标、(twitter)的图标、(twitter)的图标、(facebook)的图标、(sina weibo)的图标、(tencent qq)的图标、(youtube)的图标、图库(gallery)的图标和相机(camera)的图标1031等,还可以包含其他应用的图标,本技术实施例对此不作限定。任一个应用的图标可用于响应用户的操作,例如触摸操作,使得电子设备100启动图标对应的应用。

[0170]

状态栏404中可以包括运营商的名称(例如中国移动)、时间、wi

‑

fi图标、信号强度和当前剩余电量。

[0171]

导航栏405可以包括:返回按键4051、主界面(home screen)按键4052、呼出任务历史按键4053等系统导航键。其中,主屏幕界面40为电子设备100在任何一个用户界面检测到作用于主界面按键4052的用户操作后显示的界面。当检测到用户点击返回按键4051时,电子设备100可显示当前用户界面的上一个用户界面。当检测到用户点击主界面按键4052时,电子设备100可显示主屏幕界面40。当检测到用户点击呼出任务历史按键4053时,电子设备100可显示第一用户最近打开过的任务。各导航键的命名还可以为其他,比如,4051可以叫back button,4052可以叫home button,4053可以叫menu button,本技术对此不做限制。导航栏405中的各导航键不限于虚拟按键,也可以实现为物理按键。

[0172]

可以理解的是,图4中的(a)仅仅示例性示出了电子设备100上的用户界面,不应构成对本技术实施例的限定。

[0173]

图5中的(a)至(b)示例性地给出了电子设备100响应于检测到的用户操作进入“双景录像模式”的过程。

[0174]

示例性地,电子设备可以检测到作用于如图4中(a)所示的相机的图标4031的触控操作(如在图标4031上的点击操作),并响应于该操作启动相机应用程序,电子设备100可显示用户界面50。“相机”是智能手机、平板电脑等电子设备上的一款图像拍摄的应用程序,本技术对该应用程序的名称不做限制。也即是说,用户可以点击图标4031来打开“相机”的用户界面50。不限于此,用户还可以在其他应用程序中打开用户界面50,例如用户在中点击拍摄控件来打开用户界面50。是一款社交类应用程序,可支持用户向他人分享所拍摄的照片等。

[0175]

图5中的(a)示例性示出了智能手机等电子设备上的“相机”应用程序的一个用户界面50。用户界面50还可以包含缩略图控件501、拍摄控件502、摄像头切换控件503、取景框505、调焦控件506a、设置控件506b和闪光灯开关506c。其中:

[0176]

缩略图控件501,用于供用户查看已拍摄的图片和视频。

[0177]

拍摄控件502,用于响应于用户的操作,使得电子设备100拍摄图片或者视频。在本实施例以及本技术的其他实施例中,使得电子设备100开始拍摄视频的时刻可以称为t1时刻。

[0178]

摄像头切换控件503,用于将采集图像的摄像头在前置摄像头和后置摄像头之间切换。

[0179]

取景框505,用于对所采集图片进行实时预览显示,其中分界线5051即为取景框505的下边界,电子设备100屏幕上边界即为取景框505的上边界。

[0180]

调焦控件506a,用于对摄像头进行调焦。

[0181]

在本技术实施例以及后续实施例中,摄像头调焦方式不限于通过触摸调焦控件实现,用户也可以通过作用于取景框的双指缩放操作实现。变焦倍数随着双指缩放手势的变化而变化。当该双指缩放手势为双指放大手势时,该手势的幅度越大,该对应摄像头的变焦倍数越大。当该双指缩放手势为双指缩小手势时,该手势的幅度越大,该对应摄像头的变焦倍数越小。

[0182]

设置控件506b,用于设置采集图像时的各类参数。

[0183]

闪光灯开关506c,用于开启/关闭闪光灯。

[0184]

功能栏504,包括夜景拍摄控件504a、人像拍摄控件504b、拍照控件504c、短视频拍摄控件504d、录像控件504e以及更多拍摄选项控件504f。控件504a

‑

504e中,任一个拍摄选项控件可用于响应用户的操作,例如触摸操作,使得电子设备100启动图标对应的拍摄模式。

[0185]

更多拍摄选项控件504f,可以响应于该用户操作,即作用在更多拍摄选项控件504f上的触摸操作,电子设备100可显示用户界面60。相机应用界面60还可以包含多种用于选择拍摄模式的控件,例如慢动作模式控件,全景拍摄控件、黑白模式控件以及双景录像控件601等,还可以包含其他拍摄模式的控件,本技术实施例对此不作限定。

[0186]

如图5中(b)所示,双景录像控件601,响应于该用户操作,即作用在双景录像控件601上的触摸操作,相机进入双景录像模式。在一些实施例中,双景录像控件601可以包含于界面50中,也可以包含于相机应用的其他用户界面中,本技术实施例不做限定。

[0187]

在一些实施例中,电子设备100可以在启动“相机”后默认自动进入“双景录像模式”。在另一些实施例中,电子设备100启动“相机”后,若未进入“双景录像模式”,则可以响应于检测到的用户操作进入“双景录像模式”。不限于此,电子设备100还可以通过其他方式进入“双景录像模式”,例如电子设备100还可以根据用户的语音指令进入“双景录像模式”等,本技术实施例对此不作限制。

[0188]

图5中的(c)至(d)示例性地给出了上下分屏模式下改变录制界面形式的场景。

[0189]

进入双景录像模式后,电子设备100可以使用两个摄像头采集图像,并在显示屏中显示预览界面。如图5中的(c)所示的用户界面70,刚开始进入双景录像模式时,电子设备100将默认自动选择上下分屏的录像方式。在一些实施例中,进入双景录像模式时,默认的分屏方式也可以是其他方式,例如画中画模式,本技术实施例不做限定。用户界面70还可以包括:

[0190]

上取景框701,用于对第一摄像头所采集图像进行实时预览显示。其中,其中分隔线706即为上取景框701的下边界,电子设备100屏幕上边界即为取景框505的上边界。取景框701中可包括:摄像头切换控件701b,用于将采集图像的摄像头在前置摄像头和后置摄像头之间切换。示例性地,用户可以点击摄像头切换控件701b,将取景框701对应的摄像头由前置摄像头193

‑

1更改为后置的摄像头193

‑

3。

[0191]

在一些实施中,前置摄像头对应的取景框中也可以不包含调焦控件701a。也就是说,在本实施例以及后续实施例中,电子设备100进行前置取景时,前置摄像画面可以不支

持调焦,前置摄像时焦距固定为广角、长焦或者其他焦距;前置摄像画面也可以像后置摄像一样支持调焦,并且在界面中包含用于调焦的调焦控件。

[0192]

下取景框702,用于对第二摄像头所采集图像进行实时预览显示。其中,其中分隔线706即为下取景框701的上边界,电子设备100屏幕下边界即为取景框505的下边界。取景框701中可包括:调焦控件702a,用于对第二摄像头进行调焦。摄像头切换控件702b,用于将采集图像的摄像头在前置摄像头和后置摄像头之间切换。

[0193]

缩略图控件703,用于供用户查看已拍摄的图片和视频。

[0194]

拍摄控件704,用于响应于用户的操作,使得电子设备100拍摄视频。在本实施例以及本技术的其他实施例中,使得电子设备100开始拍摄视频的时刻可以称为第一时刻t1。在本实施例以及本技术的其他实施例中,电子设备100在双景录像模式下拍摄视频的某一时刻可以称为第二时刻t2。其中,第一时刻t1和第二时刻t2之间的时长可以称为第一时长t1。当第一时长t1为0时,t1时刻即为t2时刻。

[0195]

滤镜控件705,用于设置拍摄图像时的滤镜。

[0196]

闪光灯开关706,用于开启/关闭闪光灯。

[0197]

分隔线706,用于分割上取景框701和下取景框702。

[0198]

应理解,如图5中(c)所示,电子设备的屏幕被上下分为上取景框701和下取景框702,上取景框701对应显示来自前置的摄像头193

‑

1的图像,下取景框702对应显示来自后置摄像头193

‑

3的图像。上取景框701中的图像为面对电子设备100的显示屏的拍摄者自己的图像,下取景框702中的图像为拍摄者所面对的拍摄对象(如人物、风景等)的图像。

[0199]

当电子设备100采用如图5中(c)所示的用户界面录制音频后,在该音频播放时,由于上取景框701和下取景框702的面积一样大,用户能感觉到,上取景框701中被拍摄对象的周围环境的声音(也就是电子设备前置摄像头那侧,以下称为声音1)和下取景框702被拍摄对象的周围环境的声音(也就是电子设备后置摄像头那侧,以下称为声音2)的响度一样大。可选的,还可以使,上取景框701中被拍摄对象的周围环境的声音(也就是声音1)在电子设备的上部发出,下取景框702被拍摄对象的周围环境的声音(也就是声音2)在电子设备的下部发出。但是实际上电子设备的扬声器(例如顶部扬声器或/和底部扬声器或/和背部扬声器)均会播放出上取景框701中被拍摄对象的周围环境的声音,也均会播放出下取景框702被拍摄对象的周围环境的声音,也就是电子设备的扬声器均会播放声音1和声音2。且这样,增强立体声的感觉,让用户感觉上面的取景框的声音在上面发出,下面取景框的声音在下面发出,增强体验感和趣味性。

[0200]

在一些实施例中,电子设备100可响应于用户对分隔线706的触摸操作,例如滑动操作,对上取景框701和下取景框702的面积进行调节。示例性的,如图5中(c)所示,响应于该用户操作,即作用在分隔线709上的上滑动操作,上取景框701的面积减小,下取景框702的面积变大,最终呈现效果可参考如图5中(d)所示的用户界面71。当电子设备100采用如图5中(d)所示的用户界面录制音频后,且由于上取景框701叫和下取景框702的面积更小,则在该音频播放时,与图5中(c)中的声音不同在于,声音1的响度小声音2的响度;可选的,还可以给用户的感觉仍然是声音1在电子设备的上部发出,声音2在电子设备的下部发出,具体描述参见图5中(c)的描述,不再赘述。

[0201]

当然,用户还可以通过作用在分隔线709上的下滑动操作,使上取景框701的面积

变大,下取景框702的面积变小,在这种界面下所录制的音频在播放时,相比于在对分隔线709进行滑动之前的界面下录制的音频,声音1的响度变大,声音2的响度则变小。

[0202]

画面调换控件708,用于调换上取景框701和下取景框702所采集的图像。

[0203]

示例性的,如图5中(d)所示,响应于该用户操作,即作用在画面调换控件718上的触摸操作,电子设备100将上取景框711中的画面和下取景框712中的画面进行交换,最终呈现效果可参考图6中(a)所示的用户界面72。图6中(a)的声音效果参见图5中(d)的描述,在此不再赘述。不限于图5中(c)至(d)所示的通过控件708将两个画面进行调换,用户还可以通过其他操作对两个取景框的图像进行调换。例如用户可以通过作用在上取景框711中的下滑操作,或者作用在下取景框712中的上滑操作来实现两个取景框的图像的调换。

[0204]

分屏选项控件709,用于响应于用户的操作,使电子设备100对双景录像模式的分屏方式进行切换。

[0205]

应理解,上下分屏模式下,用户还能通过调焦、切换前/后置镜头以及改变分屏方式来对录制界面进行改变,具体可参考后续实施例的描述。

[0206]

接下来结合图6中(a)至(f)对电子设备100进入“画中画”模式以及在“画中画”模式下调整录制界面样式的方式进行说明。需要注意的是,图6中(a)至(f)示出的实施例中,电子设备100的姿态未发生改变。也就是说,用户在调整电子设备的录制界面样式时,并未移动该电子设备100,图6中(a)至(f)中录制界面的变换与电子设备的姿态变化无关。

[0207]

图6中(a)至(c)示例性的展示了用户切换双景录像模式下分屏方式的场景。

[0208]

如图6中(a)所示,响应于该用户操作,即作用在分屏选项控件709上的触摸操作,电子设备100显示分屏选项框710。如图6中(b)所示,分屏选项框710可以包含多种分屏选项控件,例如上下分屏控件701a(规则分屏),上下分屏控件701b(不规则分屏)、画中画控件710c(小取景框形状为方形)和画中画控件710d(小取景框形状为圆形)。在一些实施例中,分屏选项框710还可以包含其他分屏选项的控件,本技术实施例对此不作限定。任一个分屏选项控件可用于响应于用户的操作,例如触摸操作,使得电子设备100启动该控件对应的分屏录像模式。

[0209]

分屏方式的切换不限于图6中(b)所示的通过分屏选项框进行切换,用户还可以通过其他方式进行分屏方式的切换,本技术实施例不做限定。例如,电子设备100可以在响应用户对图6中(a)的分屏选项控件729上的触摸操作后,直接切换到与当前分屏方式不同的另一种分屏方式;当用户再次触摸图6中(a)的分屏选项控件729后,电子设备100再次切换到另一种分屏方式。

[0210]

如图6中(b)所示,响应于该用户操作,即作用在画中画控件730c上的触摸操作,电子设备100启动画中画分屏方式的双景录像模式,并显示如图6中(c)所示的用户界面80。如图6中的(c)所示,用户界面80还可以包含摄像头切换控件801、取景框802以及例如拍摄控件、滤镜控件等其他控件(具体参考前述对图5中(c)的说明,这里不再赘述),其中:

[0211]

主取景框801(也称作主画面区域),用于对第一摄像头所采集图像进行实时预览显示。其中,主取景框801中可包括:调焦控件801a,用于对第一摄像头进行调焦。用于将采集图像的摄像头在前置摄像头和后置摄像头之间切换,摄像头切换控件801b,用于将采集图像的摄像头在前置摄像头和后置摄像头之间切换。示例性地,用户可以点击摄像头切换控件801b,将取景框801对应的摄像头由前置摄像头193

‑

1更改为后置的摄像头193

‑

3。子取

景框802(也称作子画面区域),用于对第二摄像头所采集图像进行实时预览显示。其中,子取景框802中可包括:调焦控件802a,用于对第二摄像头进行调焦。摄像头切换控件802b,用于将采集图像的摄像头在前置摄像头和后置摄像头之间切换。示例性地,用户可以点击摄像头切换控件802b,将取景框802对应的摄像头由后置摄像头193

‑

3更改为前置的摄像头193

‑

1。为了便于说明,如图6中(c)所示,调焦控件802a以及摄像头切换控件802b呈现于主取景框801中。在一些实施例中,调焦控件802a以及摄像头切换控件802b呈现子取景框801中,具体可参考图6中(g)。在一些实施中,子取景框中也可以不包含调焦控件,具体可参考图6中(h)。

[0212]

当电子设备100采用如图6中(c)所示的用户界面录制音频后,在该音频播放时,由于子取景框802在主取景框801的左上角,且面积较小,用户能感觉到,子取景框802被拍摄对象的周围环境的声音(也就是电子设备前置摄像头那侧,以下称为声音1)的响度相对于主取景框801被拍摄对象的周围环境的声音(也就是电子设备后置摄像头那侧,以下称为声音2)的响度较小。可选的,还可以使,主取景框801被拍摄对象的周围环境的声音(也就是电子设备后置摄像头那侧,以下称为声音2)在用户周围发出没有方向性,但子取景框802被拍摄对象的周围环境的声音(也就是电子设备前置摄像头那侧,以下称为声音1)在电子设备的左上角发出(用户以图6中(c)所示的方向握持手机)。但是实际上电子设备的扬声器(例如顶部扬声器或/和底部扬声器或/和背部扬声器)均会播放出子取景框802中被拍摄对象的周围环境的声音,也均会播放出主取景框801被拍摄对象的周围环境的声音,也就是电子设备的扬声器均会播放声音1和声音2。且这样,增强立体声的感觉,让用户感觉声音也呈现出画中画的效果,增强体验感和趣味性。在一些实施例中,用户还能感觉到上述声音1是从自己左侧传来的。

[0213]

应理解,主取景框801和子取景框802的画面同样可通过作用在画面调换控件上的触摸操作进行交换,在交换后所得的界面下录制的音频在播放时也会相应改变(可参考前述对图5中(d)和图6中(a)的说明,这里不再赘述)。

[0214]

应理解,如图6中(c)所示,电子设备的屏幕被分为主取景框801和子取景框802。主取景框801对应显示来自后置摄像头193

‑

3的图像,子取景框802对应显示来自前置的摄像头193

‑

1的图像。主取景框801中的图像为拍摄者所面对的拍摄对象(如人物、风景等)的图像,子取景框802中的图像为面对电子设备100的显示屏的拍摄者自己的图像。

[0215]

在刚开始进入画中画模式的双景录像模式时,取景框802默认的面积和方位不限于图6中(c)所示的样式。在一些实施例中,取景框802的面积可以比图6中(c)所示出的更大或更小,其相对于取景框801的方位也可以为电子设备100的屏幕的右上角或者其他方位,本技术实施例对此不作限定。

[0216]

图6中(c)至(f)示例性的展示了在“画中画”模式下调整录制界面样式的场景。

[0217]

在一些实施例中,电子设备100可以响应于检测到的用户操作,对取景框802的面积和方位进行调节。

[0218]

示例性的,参考图6中(c),电子设备100可以响应于作用在取景框802上的滑动操作,对取景框802在屏幕中的方位进行变化。取景框802变化后的方位可参考图6中(d)所示,取景框802的方位由电子设备100的屏幕的左上方变化为右下方。这样,声音1和声音2的响度不变,但是感觉到声音1从电子设备的左上移动到了右下方向。

[0219]

示例性的,参考图6中(d),响应于作用在取景框812上的双指放大操作,电子设备100将取景框802的面积放大,放大后的取景框可参考图6中(e)所示的取景框822。同理,电子设备100还可以响应于作用在取景框812上的双指缩小操作,将取景框802的面积缩小。

[0220]

相比在图6中(d)所示的界面下录制的音频而言,当电子设备100采用如图6中(e)所示的用户界面录制音频在播放时,则声音1的响度将变大。此外,电子设备还可以响应于检测到的用户操作,对摄像头的焦距进行调整。如图6中(e)所示,响应于作用在调焦控件822a上的滑动操作,电子设备将增大该取景框822对应的摄像头的焦距,由2

×

调整至3

×

。调整后的用户界面可参考图6中(f)所示,取景框822中的图像所呈现的视野范围由图6中(e)(取景框822)变化为图6中(f)(取景框832),但取景框822中的图像相比图6中(e)所示的取景框832中的图像要大一些。

[0221]

基于前述内容介绍的电子设备100以及前述用户界面相关的实施例,接下来介绍电子设备100在执行本技术实施例提供的音频的处理方法时,在不同的用户界面(即双景录像时的录制界面)下,对音频信号进行过滤的一些场景。

[0222]

首先,先介绍本技术实施例中电子设备100提供的一些焦距倍数与视场角大小之间的对应关系,请参考下列表1。

[0223]

表1

[0224]

焦距1

×2×3×4×5×6×

视场角180

°

120

°

90

°

60

°

45

°

30

°

[0225]

应理解,表1中的视场角的数值仅表示视场角的范围,并未体现视场角的方向性。具体的,结合表1和前述规定,当前置摄像头的焦距为1

×

时,其视场角为180

°

,当后置摄像头的焦距为1

×

时,其视场角为

‑

180

°

,以此类推。

[0226]

其次,表1仅示例性地示出了电子设备100中相机所能提供的焦距倍数,不限于表1中包含的焦距倍数,电子设备100中的相机还可以为用户提供其他更多的焦距倍数的选项,例如7

×

、8

×

等,本技术实施例不做限定。

[0227]

此外,电子设备100中每个焦距倍数与视场角大小之间的对应关系可以不限于表1中示出的对应关系。例如在一些实施例中,1

×

的焦距倍数对应的视场角可以为170

°

,2

×

的焦距倍数对应的视场角可以为160

°

,本技术实施例对此不做限定。但是,需注意,无论焦距倍数和视场角大小之间的对应关系如何,这种对应关系是在电子设备100在生产出厂时就被固定下来的。也就是说,在电子设备100进行拍摄时,电子设备100可以根据拍摄使用的摄像头的前/后置信息和焦距倍数获取到此时的视场角的大小和范围。

[0228]

图7a示例性示出了电子设备100在上下分屏且同时采用前、后置摄像头进行双景录像的录制界面。

[0229]

参考图7a,图7a示出的录制界面90可以包括多个控件,例如拍摄控件904、滤镜控件905及一些其他的控件。电子设备100可以响应于用户对这些控件的触摸操作,对录制画面进行切换,具体可以参照前述对图5的相关描述,这里不再赘述。

[0230]

在图7a示出的录制界面90中,电子设备100的前置摄像头只提供1

×

的固定焦距倍数,即前置摄像头的视场角固定为 180

°

;电子设备的100的后置摄像头可提供1

×

至6

×

六个不同焦距倍数,用户可以通过触摸调焦控件902a切换后置摄像头的焦距倍数,以此来调整取景框902中的画面的视场角范围。用户还可以通过摄像头切换控件901b,用于将上取景

框901采集图像的摄像头在前置摄像头和后置摄像头之间切换;同理,用户还可以通过摄像头切换控件902b,用于将下取景框902采集图像的摄像头在前置摄像头和后置摄像头之间切换。示例性地,用户可以点击摄像头切换控件901b,将取景框901对应的摄像头由前置摄像头193

‑

1更改为后置的摄像头193

‑

3。在一些实施例中,前置摄像头的焦距也支持切换,并且在录制界面中也包含用于对其进行调焦的调焦控件。具体可参考图7b所示出的录制界面91中的控件911a,即可用于对前置摄像头的焦距进行切换。

[0231]

如图7a所示,电子设备100正采用焦距倍数为固定1

×

的前置摄像头和焦距倍数为3

×

的后摄像头在上下分屏模式下进行双景录像。此时,上取景框901呈现的画面(以下称为画面1)为前置摄像头(例如193

‑

1)所拍摄的画面,其为用户自己的人脸;下取景框902呈现的画面(以下称为画面2)为后置摄像头(例如193

‑

3)所拍摄的画面,其为电子设备100前方的风景图像。则由上述表1可知,此时前置摄像头的视场角为 180

°

,后置摄像头的视场角为

‑

90

°

。

[0232]

图7b示出了电子设备100在画中画分屏方式下且同时采用前、后置摄像头进行双景录像的录制界面。

[0233]

参考图7b,图7b示出的录制界面91可以包括多个控件,电子设备100可以响应于用户对这些控件的触摸操作,对录制画面进行切换,具体可以参照前述对图5的相关描述,这里不再赘述。

[0234]

在图7b所示出的录制界面91中,电子设备100正采用焦距倍数为6

×

的前置摄像头和焦距倍数为2

×

的后摄像头在画中画模式下进行双景录像。此时,取景框911呈现的画面(以下称为主画面)为焦距倍数为2

×

的后置摄像头(例如193

‑

4)所拍摄的画面,其为电子设备100前方的风景;取景框912呈现的画面(以下称为子画面)为焦距倍数为6

×

的前置摄像头(例如193

‑

2)所拍摄的画面,其为用户自己的人脸。则由上述表1可知,此时主画面对应的视场角为

‑

90

°

,子画面对应的视场角为 30

°

。

[0235]

本技术实施例中,电子设备100对环境中的音频信号进行采集时,仍然会对空间中全方位(及空间中360

°

)的音频信号进行采集。但为了使所录制的音频能配合两个画面呈现给用户的视角范围,在采集到全方位角度传递来的音频信号后,电子设备100可以结合两个画面各自的视场角,对收取到的音频信号进行同角度的过滤,得到分别在两个视场角的方向上被增强的音频信号。

[0236]

参考图8a,图8a为本技术实施例提供的电子设备结合画面的视场角对音频信号进行过滤的一种场景示意图。

[0237]

在图8a中,所呈现的为电子设备100被直立放置时的俯视图,电子设备可以视作点p。opo’为电子设备所在的平面,qq’为该平面的法线。其中opo’左侧表示电子设备前置摄像头所在的一侧,opo’右侧表示电子设备100后置摄像头所在的一侧。不难看出,opo’左侧的阴影部分表示电子设备100前置摄像头在焦距为1

×

下所能获取到的视场角范围(0

°

至 180

°

),opo’右侧的空白部分表示电子设备100后置摄像头焦距为1

×

下所能获取到的视场角范围(

‑

180

°

至0

°

)。∠opo’(右侧)、∠apa’、∠bpb’和∠cpc’分别为电子设备100的后置摄像头在1

×

、2

×

、3

×

和6

×

时对应的视场角,∠opo’(右侧)、∠dpd’、∠epe’、∠fpf’分别为电子设备100的前置摄像头在1

×

、2

×

、3

×

和6

×

时对应的视场角,其每个角的数值可以参考前述表1得出,这里不再赘述。

[0238]

结合前述对图7a说明可知,在录制界面为90的情况下,电子设备100的前置摄像头(即画面1对应的摄像头)的视场角的大小和方向与图8a中∠opo’(左侧)一致,大小为 180

°

,视场角的边界为po和po’所在的射线。电子设备100的后置摄像头(即画面2对应的摄像头)的视场角的大小和方向与图8a中∠bpb’一致,大小为

‑

90

°

,视场角的边界为pb和pb’所在的射线。因此,当用户采用如图7a所示的录制界面进行双景录像时,电子设备100将根据上述画面1的视场角∠opo’(左侧),对∠opo’(左侧)之外的角度方向上采集到的音频信号进行抑制,得到与∠opo’(左侧)同角度方向的音频信号1;并根据上述画面2的视场角∠bpb’,对∠bpb’之外的角度方向上采集到的音频信号进行抑制,得到与∠bpb’同角度方向的音频信号2。举例说明,上述画面1中包含有声源a,画面1之外的场景中有声源a’,上述画面2中包含有声源b,画面1之外的场景中存在声源b’;在进行上述滤波过程后,通过画面1的视场角所得的声音信号在听觉会让人感觉到主要是声源a在发声,且能让用户感知到该声音

‘

有与画面1在屏幕上呈现的方位相对应的方位性的效果;通过画面2的视场角所得的声音信号在听觉会让人感觉到主要是声源b在发声,且能让用户感知到该声音有与画面2在屏幕上呈现的方位相对应的方位性的效果。

[0239]

应理解,当用户对录制界面进行更改时,录制界面中的两个视场角的角度方向可能也会发生相应的改变,此时,电子设备100对音频信号进行过滤时所选取的角度方向也会相应的改变。

[0240]

结合对图7b说明可知,在录制界面为91的情况下,电子设备100的前置摄像头(即子画面对应的摄像头)的视场角的大小和方向与图8a中∠fpf’(左侧)一致,大小为 30

°

,视场角的边界为pf和pf’所在的射线。电子设备100的后置摄像头(即主画面对应的摄像头)的视场角的大小和方向与图8a中∠apa’一致,大小为

‑

120

°

,视场角的边界为pa和pa’所在的射线。因此,当用户采用如图8a所示的录制界面进行双景录像时,电子设备100将根据上述子画面的视场角∠fpf’,对∠fpf’之外的角度方向上采集到的音频信号进行抑制,得到与∠fpf’同角度方向的音频信号3;并根据上述主画面的视场角∠apa’,对∠apa’之外的角度方向上采集到的音频信号进行抑制,得到与∠apa’同角度方向的音频信号4(图8a中未画出)。

[0241]

可理解的,根据双屏录像中两个取景摄像头在前/后置以及焦距倍数等不同情况进行组合,双景录像时的录制界面可以有多种,例如:

[0242]

图7c所示出的录制界面92中,电子设备100正采用一个3

×

焦距的前置摄像头和一个6

×

焦距的前置的摄像头进行双景录像时,则该3

×

焦距的前置摄像头在图8a中对应的视场角为∠epe’,该6

×

焦距的前置摄像头在图8a中对应的视场角为∠fpf’。

[0243]

当电子设备100采用一个1

×

的后置摄像头和一个2

×

焦距的后置的摄像头进行双景录像时,则该1

×

焦距的后置摄像头在图8a中对应的视场角为∠opo’(右侧),该2

×

焦距的后置摄像头在图8a中对应的视场角为∠bpb’。

[0244]

当然,电子设备100还可以采用其他不同的摄像头和焦距组合进行双景录像。当电子设备100采用不同的摄像头和焦距组合录像时,其对音频信号进行过滤时所选取的角度方向会相应的改变,过滤所得到的两个音频信号也会不同,这里不再一一列举。

[0245]

在一些实施例中,为能使音频具备更好的双声道立体感,在对音频信号进行过滤时,电子设备100可以选择特定的滤波方法(例如cvx波束训练方法),基于每个画面的视场

角向左右两个角度方向进行滤波,接下来结合图8b进行说明。

[0246]

图8b为本技术实施例提供的电子设备结合画面的视场角,通过cvx波束训练方法对音频信号进行过滤的另一种场景示意图。如图8b所示,电子设备100所呈现的为电子设备100被直立放置时的俯视图,电子设备可以视作点p。图8b中的平面opo’、qq’、∠opo’(右侧)、∠apa’、∠bpb’和∠cpc’∠opo’(右侧)、∠dpd’、∠epe’、∠fpf’的具体含义可以参考前述对图7b中的说明,这里不再赘述。

[0247]

在图8b中,电子设备100正图采用如图7a所示的录制界面90进行双景录像。结合前述对图7a的说明可知,在录制界面为90的情况下,画面1的视场角为图8b中的∠opo’(左侧),边界为po和po’所在的射线。画面2的视场角为∠bpb’,视场角的边界为pb和pb’所在的射线。由图8b可知,电子设备100所在平面的法线qq’为∠opo’(左侧)以及∠bpb’的角平分线,则法线qq’将∠opo’(左侧)分为∠opq’以及∠o’pq’,将∠bpb’分为∠bpq以及∠b’pq。这里规定,对于电子设备100而言,法线qq’上方为电子设备100的左侧,法线qq’下方为电子设备100的右侧。

[0248]

在双景录像的过程中,电子设备100可以将根据上述画面1的视场角∠opo’(左侧),分别对∠opq’以及∠o’pq’之外的角度方向上采集到的音频信号进行抑制,得到与∠opq’同角度方向的左声道音频信号11,以及与∠o’pq’同角度方向的右声道音频信号21;并根据画面2的视场角∠bpb’,分别对∠bpq以及∠b’pq之外的角度方向上采集到的音频信号进行抑制,得到与∠bpq同角度方向的左声道音频信号21,以及与∠b’pq同角度方向的右声道音频信号22。这样,在对上述得到的四个音频信号进行混音后输出时,输出的音频能为用户营造更为立体的听感。

[0249]

当然,图8b所示出的对音频信号进行过滤的方法也适用于其他录制界面。对于既定的录制界面,只需根据每个录制界面中两个画面的视场角进行左右的划分,得到四个区分了左右侧的视场角,再根据四个视场角的角度方向分别进行音频过滤,即可得到四个具备左右声道差异的音频信号。这里不再对每个录制场界面下电子设备100对音频的过滤场景进行一一描述。

[0250]

此外,图8a和图8b中所示出的音频信号的形状仅用于对音频信号进行区分,并不代表音频信号在空间中传播时实际的波形。

[0251]

图9为本技术实施例提供的一种音频的处理方法的流程图。该方法结合双景录像中两个画面的视场角,将视场角作为dsb算法的输入,基于dsb算法分别对音频进行过滤,再进行音频重混,得到的音频可以和画面具有同步的立体感。如图9所示,本技术实施例提供的方法可以包括:

[0252]

s101、电子设备开启双景录像模式。

[0253]

示例性地,电子设备可以检测到作用于如图4中(a)所示的相机的图标4031的触控操作(如在图标4031上的点击操作),并响应于该操作启动相机应用程序。

[0254]

之后,电子设备检测到选择“双景录像模式”的用户操作后,开启双景录像模式。示例性地,该用户操作可以是图5中(b)所示的在双景录像模式选项601上的触控操作(例如点击操作)。该用户操作也可以是语音指令等其他类型的用户操作。

[0255]

不限于用户选择,电子设备100可以在启动相机应用程序后默认选定“双景录像模式”。

[0256]

s102、电子设备根据用户对录制界面的调整显示相应的录制界面。

[0257]

在开始录像之前,电子设备可以检测到用户对双景录像模式下的界面样式的设置,参考上述图5、图6、图7a、图7b以及图7c中所示的相关用户界面,对录制界面的调整包括但不限于以下情况:

[0258]

①

切换双景录像模式的分屏方式

[0259]

示例性地,电子设备可以检测到作用于如图6中(a)所示分屏选项控件709上的触摸操作(如在控件709上的点击操作),并响应于该操作对分屏方式进行切换。

[0260]

②

对取景框的面积进行缩放

[0261]

示例性地,电子设备可以检测到作用于如图6中(d)所示取景框802上的双指放大操作,并响应于该操作对取景框的802进行放大;或者检测到作用于如图5中(c)所示的分隔线706上的滑动操作,并响应于该操作对取景框701进行缩小,同时对取景框702进行放大。

[0262]

③

摄像头的焦距的调整

[0263]

示例性地,电子设备可以检测到作用于如图5中(d)(中调焦控件802a上的双指滑动操作,并响应于该操作增大该取景框802对应的摄像头的焦距,由2

×

调整至3

×

。

[0264]

上述焦距的调整可以是对后置摄像头的焦距的调整,也可以是对前置摄像头的调整。当双景了录像时采用的两个摄像头分别为前置摄像头和后置摄像头时,该焦距的调整还可以是同时对前置摄像头和后置摄像的焦距进行调整。

[0265]

④

前/后置摄像头的切换

[0266]

示例性地,电子设备可以检测到作用于如图7a中控件901b上的点击操作,并响应于该操作对图7a中取景框901对应的摄像头由前置摄像头切换为后置摄像头,切换后的用户界面可以参考图7c示出的录制界面92。

[0267]

⑤

两个取景框取景画面的对调

[0268]

示例性地,电子设备可以检测到作用于如图5中(d)所示的画面调换控件708上的点击操作,并响应于该操作将取景框的701和取景框702的画面内容进行对调。

[0269]

应理解,两个取景框取景画面的切换实际上是将两个取景框对应的摄像头进行对调。因此,在对调两个取景框对应的摄像头的前/后置和焦距信息也随之全部切换。

[0270]

s103、电子设备采集音频。

[0271]

电子设备检测到指示开始录制视频的用户操作,例如在图5中(c)所示的控件704上的点击操作,电子设备中的音频采集装置(例如麦克风)采集环境中的音频信号。

[0272]

具体的,以麦克风为例,电子设备可具备m个麦克风,m>1,m为正整数。在双景录像模式下,这m个麦克风可以同时采集环境中的音频信号,得到m路的音频信号。

[0273]

需要进行说明的,采集音频信号,也就是采集到的声音作为电子设备的输入音源,该音源的采集可以是根据麦克风的性能进行确定的,可选的,可以是全方位的360

°

空间环境的声音,也可以是其他的,例如定向的空间的声音,本技术不进行限定。在本实施例以及其它实施例中,上述m路音频信号也可以称为实时环境的声音。

[0274]

需注意,在电子设备出厂时,电子设备上的麦克风在电子设备中的位置已经固定,在电子设备后续的使用过程中,麦克风在电子设备中的位置并不会发生变化。也就是说,当m>1时,电子设备中每个麦克风之间的相对位置是固定的,因此,每个麦克风与另往外(m

‑

1)个麦克风的间距也是固定的。

[0275]

s104、电子设备录制图像。

[0276]

电子设备检测到指示开始录制视频的用户操作,例如在图5中(c)所示的控件704上的点击操作,电子设备开始同时采用两个摄像头进行图像的采集和拍摄。

[0277]

具体的,电子设备可具有n个摄像头,n≥2,n为正整数。这n个摄像头可以为前置摄像头和后置摄像头的组合。这n个摄像头也可以为广角摄像头、超广角摄像头、长焦摄像头或前置摄像头中任意焦距的摄像头的组合。本技术对这n个摄像头的摄像头组合方式不作限制。在录制时,电子设备将根据用户在s102中对摄像头的选择(例如前/后置摄像头的选择和摄像头焦距的选择),在屏幕中采用两个取景框分别呈现两个摄像头所采集到的两路图像。

[0278]

电子设备的显示屏可以通过拼接(可参考前述说明中的上下分屏)或画中画等方式对来自2个摄像头的两路图像进行显示,使来自该两个摄像头的两路图像可以同时呈现给用户。

[0279]

接下来结合图7a所示出的录制界面90对本技术实施例中步骤s105

‑

s107进行说明。

[0280]

s105、电子设备获取画面的视场角。

[0281]

参考图7a所示的录制界面90。电子设备正采用焦距倍数为固定1

×

的前置摄像头和焦距倍数为3

×

的后摄像头在上下分屏模式下进行双景录像。此时,上取景框901呈现的画面(以下称为第一画面)为前置摄像头所拍摄的画面,其为用户自己的人脸;下取景框902呈现的画面(以下称为第二画面)为后置摄像头所拍摄的画面,其为电子设备100前方的风景图像。

[0282]

则由上述表1可知,该第一画面视场角大小为180

°

,该第二画面的视场角大小为90

°

。

[0283]

s106、电子设备计算画面权重。

[0284]

参考前述对“画面权重”的概念的相关说明,接下来结合图7a所示的录制界面对上下分分屏界面下两个显示区域的画面权重的计算方式进行详细说明。在图7a所示的录制界面90中,电子设备显示屏的长为d0,宽为(d1 d2),且上述第一画面的宽为d1,所述第一画面的显示区域的宽为d1,第二画面的显示区域的宽为d2。则电子设备可计算得到两个画面的画面权重w1以及w2分别为:

[0285]

w1=d1/(d1 d2)

[0286]

w2=d2/(d1 d2)

[0287]

其中,w1为第一画面的画面权重,w2为第二画面的画面权重。

[0288]

s107、电子设备基于dsb算法对音频进行过滤。

[0289]

为了能够使双景录像的画面和音频具有同步的立体感,电子设备将利用在s105中所得的画面的视场角信息,对s103中音频采集装置采集的音频进行过滤,得到两个画面对应的波束。该过程可采用盲源分离算法或波束形成算法等算法实现,本技术实施例不做限定。

[0290]

接下来以波束形成算法为例对音频过滤的过程进行进一步说明。

[0291]

假设电子设备中设有m个麦克风,其中m大于1。在双景录像过程中,该m个麦克风将采集到m路音频信号。电子设备可以基于fft算法,将该m路音频信号由时域信号转化为到频

域信号后,再根据双景录像中两个摄像头的前/后置信息以及焦距(即视场角信息),对该m路音频信号进行滤波,滤波所采用的计算公式为:

[0292][0293]

其中i=1,2,3

……

m,x

i

(ω)表示电子设备中第i(i≤m)个麦克风采集到的音频信号,w

i

(ω)可以通过dsb算法、cvx波训练方法等方法得出,其表示第i个麦克风在音频信号的频率为ω时波束形成器的权值向量。应理解,无论何种算法实现对音频的过滤,w

i

(ω)都是该算法中与滤波方向强相关的一个必要的参数。

[0294]

本实施例基于dsb算法得到w

i

(ω)。应理解,在通过dsb算法得到w

i

(ω)时,dsb算法的输入包括该第i个麦克风与其他(m

‑

1)个麦克风的间距、摄像头的前/后置信息以及焦距。因此,利用w

i

(ω)进行滤波时,可以在一定程度使第i个麦克风采集的音频信号在一个特定的方向得到增强,该特定的方向大致为该摄像头的前/后置信息以及焦距所对应的视场角的范围和方向,而视场角的范围和方向决定了取景框所呈现的画面内容。这样,可以将画面的方位感与听觉的方位感进行同步。

[0295]

同样以图7a示出的录制界面90为例进行说明。在步骤s105中,已经计算出了两个画面的视场角信息,其中第一画面视场角为 180

°

,该第二画面的视场角为

‑

90

°

。基于这两个视场角,电子设备可以通过上述dsb算法计算得到第一画面和第二画面进行滤波时所需的权值向量和并根据这两个权值向量对采集的音频进行过滤,得到第一画面和第二画面对应的波束y1(ω),y2(tω),其可以表示为:

[0296][0297][0298]

结合前述对图7a和图8a的相关描述可知,波束y1(ω)即为图8a中的音频信号1,波束y2(ω)即为图8a中的音频信号2。需注意,这里得出的波束y1(ω)和波束y2(ω)均没有进行左声道和右声道的区分。

[0299]

s108、电子设备对声源进行重混。

[0300]

在得到两个画面相应的波束和画面权重后,电子设备将结合两个画面的画面权重对两个波束进行混音。

[0301]

同样以图7a示出的录制界面90为例进行说明,为了让音频能通过双声道输出,电子设备可以将上述波束y1(ω)和波束y2(ω)在进行双声道虚拟:

[0302]

y1l(ω)=y1(ω)

[0303]

y1r(ω)=y1(ω)

[0304]

y2l(ω)=y2(ω)

[0305]

y2r(ω)=y2(ω)

[0306]

在重混后,最终电子设备在录制界面90下输出的音频的具体方式可表示为:

[0307]

outl(ω)=y2l(ω)

×

w2 y1l(ω)

×

w1

[0308]

outr(ω)=y2r(ω)

×

w2 y1r(ω)

×

w1

[0309]

不难看出,在本实施例中,outl(ω),outr(ω)虽然可以在公式上区别为左声道的音频和右声道的音频,但这两个音频数据其实是一样的,在播放时实际上听感可能也是一

样的。

[0310]

s109、电子设备判断界面是否发生变化。

[0311]

在双景录像过程中,电子设备实时检测录制界面是否发生变化。且电子设备可以响应于检测到的用户操作,对录制界面进行变化。应理解,当录制界面发生变化时,电子设备在双景录像模式下两个画面的画面权重、前/后置信息以及焦距信息都可能发生变化。

[0312]

因此,当电子设备的录制界面变化时,若此时电子设备并未终止或者结束双景录像模式,则电子设备将重新执行步骤s103至s104,及时根据变化后的录制界面更新步骤s105

‑

s108中的涉及到的一些参数,根据更新后的录制界面中的两个画面的视角和面积进行音频的过滤和重混。

[0313]

上述录制界面的变化的方式可以参考上述图5、图6中的所示的相关用户界面所示出的变化方式,也可以参阅步骤s102中对用户界面样式的进行设置的

①

至

⑥

这六种场景,这里不再赘述。

[0314]

s110、电子设备保存处理后的音频。

[0315]

当用户录制完毕后,电子设备可以响应于用户的操作,停止或关闭双景录像模式。示例性地,电子设备检测到指示停止录制视频的用户操作,例如在图5中(c)所示的控件704上的又一次的点击操作,电子设备停止对音频的采集和处理。该用户操作也可以是语音指令等其他类型的用户操作。

[0316]

之后,电子设备可以将基于ifft算法,将步骤s108中得到的音频信号outl(ω),outr(ω)转化为时域信号outl(t),outr(t)连同录制的视频一起保存在本地存储器中。

[0317]

这里假设电子设备支持双声道输出,则在播放上述音频信号outl(t),outr(t)时,outl(t),outr(t)可以分别通过电子设备上的两个扬声器输出。但由于这两个音频信号其实本质上并差别,用户左右耳收听到的音频可能差别很微小。此外,当两个显示区域的面积大小相差无几或者相等时(在图5中(c)所示),用户在收听该音频时会感觉两个画面中的声音响度大致相等。

[0318]

在一些实施例中,电子设备在执行完步骤s103和步骤s104之后,可以先将录制所得的视频文件和初始音频保存在存储器中。之后即使录制界面变化,电子设备也可以先保存该界面下录制的初始音频。应理解,这时候得到的音频还没有经过步骤s105

‑

步骤s108的处理。在整个录制过程结束后,电子设备再将结合上述视频文件,获取录制界面发生变化的时刻以及该录制界面的视场角信息,来对上述初始音频进行步骤s105

‑

步骤s108所示的处理,得到最后用于输出的目标音频;可选的,将目标音频和上述视频文件进行合成得到录制文件保存下来,以供用户后续播放。可选的,电子设备在保存该目标音频之后,可以将上述初始音频删除,节约设备的存储空间,也可以均保存下来,以供用户后续使用。

[0319]

应理解,不限于图7a示出的录制界面90,本实施例提供的音频处理的方法也同样适用于对图5、图6以及图7b和图7c中示出的录制界面以及其他录制界面下的所录制的音频进行处理。例如图7b中,录制界面91为画中画模式的双景录像模式,电子设备同样能获取到该录制界面91下两个画面的前/后置信息、焦距信息和画面权重,并使用本实施例提供的音频的处理方法对在录制界面91下录制的音频进行过滤和融合。这里不再一一举例说明。

[0320]

图10为本技术实施例提供的另一种音频的处理方法的流程图。该方法在能在图9的基础上,对画中画模式的双景录像模式的音频进行方位虚拟,能配合两个画面之间的方

位感的使音频立体感进一步增强。

[0321]

在对本实施例的具体流程进行说明之前,先说明本方法中的声源方位虚拟进行简单的额说明。在画中画的双景录像模式下,可以将两个画面中面积较大的画面称为主画面,将面积较小的画面称为子画面。由于子画面在视觉上和主画面的具体位置在视觉上有左右上面的偏差感,例如子画面是位于主画面的偏左一侧还是偏右一侧。为了使这种左右的偏差感能够被同步到音频中,则可采用实施例中的方位虚拟技术实现。

[0322]

不难理解,上下分屏的双景录像模式下,两个画面相对位置并不会产生这种左右方位的偏差感。因此,方位虚拟技术仅适用于两个画面在相对位置上由这种偏差感的录制界面。也就是说,双景录像模式下采用上下分屏的录制界面进行录制时,若使用本实施例的方法对音频进行处理,其最终所得的音频与使用前述图9中的方法进行处理得到的音频在本质上无差异。因此,接下来将结合图7b所示出的录制界面91对本技术实施例的方法流程进行说明。

[0323]

如图10所示,本技术实施例提供的方法可以包括:

[0324]

s201、电子设备开启双景录像模式。

[0325]

s202、电子设备根据用户对录制界面的调整显示相应的录制界面。

[0326]

s203、电子设备采集音频。

[0327]

s204、电子设备录制图像。

[0328]

其中,所述步骤s201

‑

步骤s204的具体实现方式可参见上述图9所对应实施例中对步骤s101

‑

步骤s104的描述,这里将不再进行赘述。

[0329]

s205、电子设备获取画面的视场角。

[0330]

参考图7b所示的录制界面91。如图7b所示出的录制界面91,用户正采用焦距倍数为6

×

的前置摄像头和焦距倍数为2

×

的后摄像头在画中画模式下进行双景录像。此时,取景框911呈现的画面(以下称为主画面)为焦距倍数为2

×

的后置摄像头所拍摄的画面,其为电子设备100前方的风景;取景框912呈现的画面(以下称为子画面)为焦距倍数为6

×

的前置摄像头所拍摄的画面,其为用户自己的人脸。则由上述表1可知,此时主画面对应的视场角为

‑

90

°

,子画面对应的视场角为 30

°

。

[0331]

s206、电子设备计算画面权重。

[0332]

参考前述对“画面权重”的概念的相关说明,在图7b所示的录制界面91中,主画面的显示区域长为dl,宽为dw,所述子画面的显示区域的宽为d1,宽为dw。则电子设备可计算得到两个画面的画面权重wm以及ws分别为:

[0333]

ws=α(d1

×

dw)/(dl

×

dw)

[0334]

wm=1

‑

ws

[0335]

其中,

“×”

表示乘法运算ws为子画面的画面权重,wm为主画面的画面权重,α为校正系数,是在电子设备出厂时已经设定好的定值,其取值范围为[1,(dl

×

dw)/(d1

×

dw)],这样,可以防止两个画面面积差距太大而导致面积较小的取景框的画面权重的值过小。

[0336]

s207、电子设备计算子画面的方位信息。

[0337]

接着以在图7b所示的录制界面91为例进行说明。

[0338]

在图7b中所示的画中画模式下的录制界面为例,将主画面中心点o为原点,在手机屏幕所在的平面上做平面直角坐标系。其中,小画面中心点f的横纵坐标值为(a,b)。樱花足

以,a,b均为带有正负符号的数值。规定,y轴左侧的点横坐标为负值,y轴右侧的点横坐标为正值。x轴下侧的点纵坐标为负值,x轴上侧的点纵坐标为正值。

[0339]

由上述说明可知,主画面的长为dl,宽为dw,单位与坐标轴单位统一。则子画面相对于主画面的方位可由方位角z和俯仰角e表示,其中:

[0340]

z=a/(dw/2)

×

90

°

[0341]

e=b/(dl/2)

×

90

°

[0342]

s208、电子设备基于dsb算法对音频进行过滤。

[0343]

步骤s208中,电子设备采集音频以及对音频进行频域转化的具体方式可以参考前述对图9中步骤s107的相关描述,这里不再赘述。

[0344]

在采集到环境中的音频信号后,电子设备将根据两个画面的视场角信息分别对该音频信号进行滤波,得到两个画面相对应的音频信号。

[0345]

同样以图7b示出的录制界面91为例进行说明。参考前述对步骤s205的说明可知,录制界面91中,主画面对应的视场角为

‑

90

°

,子画面对应的视场角为 30

°

。基于这两个视场角,电子设备可以通过上述dsb算法计算得到第一画面和第二画面进行滤波时所需的权值向量和并根据这两个权值向量对采集的音频进行过滤,得到第一画面和第二画面对应的波束ys(ω),ym(ω),其可以表示为:

[0346][0347][0348]

结合前述对图7b和图8a的相关描述可知,波束ys(ω)即为图8a中与∠fpf’同角度方向的音频信号3;波束ym(ω)即为图8a中与∠apa’同角度方向的音频信号4(图8a中未画出)。需注意,这里得出的波束ys(ω)和波束ym(ω)均没有进行左声道和右声道的区分。

[0349]

s209、电子设备对子画面的声源进行方位虚拟。

[0350]

在本技术实施例中,声源方位虚拟可以采用调整混音比例或hrtf滤波等方法实现。本技术实施例示例性的给出了以hrtf滤波的方法对本实施例中子画面的音频进行方位虚拟的过程。hrtf滤波方法所需的数据库可选择如美国加利福尼亚大学戴维斯分校cipic hrtf数据库,北大hrtf数据库等。另外,该数据库也可通过hrtf建模计算得到。本技术实施例对此不做限定。

[0351]

本实施例采用开源的cipic数据库,并根据方位角z和俯仰角e选择用于卷积的数据,选择的方法为:

[0352]

zimut=z/90

×

12 13

[0353]

elevation=e/90

×

16 9

[0354]

相应的,用于卷积的cipic_hrir为:

[0355]

data_l=hrir_l(zimut,elevation,:)

[0356]

data_r=hrir_r(zimut,elevation,:)

[0357]

在对子画面的音频进行方位虚拟时,只需结合上述cipic_hrir数据对ys(ω)进行卷积,即可得到具备虚拟方位听感的音频输出ysl(ω)和ysr(ω),其中卷积用“*”表示:

[0358]

ysl(ω)=ys(ω)*hrir_l(zimut,elevation,:)

[0359]

ysr(ω)=ys(ω)*hrir_r(zimut,elevation,:)

[0360]

主画面进行双声道虚拟:

[0361]

yml(ω)=ym(ω)

[0362]

ymr(ω)=ym(ω)

[0363]

需注意,这里得出的yml(ω)、ymr(ω)与ym(ω)之间并无差异,也就是说,在本实施例中,在画中画的双景录像模式下,从步骤s201

‑

步骤s209电子设备对于主画面的音频的处理过程和图9中步骤s101

‑

步骤s107的处理方式无差别。在重混后,主画面对应的音频在左声道的输出和右声道的输出实际上是一样的。

[0364]

但是本实施例与图9所示方法的不同之处在于,本实施例对子画面的音频信号进行方位虚拟,由于步骤s209对于子画面得到的ysl(t)为偏向左声道的音频信号,输出的ysr(t)为偏向右声道的音频信号;在重混后,主画面对应的音频在左声道的输出和右声道的输出是不一样的。

[0365]

s210、电子设备对声源进行重混。

[0366]

在得到两个画面相应的波束和画面权重后,电子设备将结合两个画面的画面权重对两个波束进行混音。

[0367]

在重混后,最终电子设备在录制界面90下输出的音频的具体方式可表示为:

[0368]

outl(ω)=yml(ω)

×

wm ysl(ω)

×

ws

[0369]

outr(ω)=ymr(ω)

×

wm ysr(ω)

×

ws

[0370]

不难看出,在本实施例中,虽然在混音时,yml(ω)

×

wm和ymr(ω)

×

wm其实是一样的,但是ysl(ω)

×

ws和ysr(ω)

×

ws是有差别的。

[0371]

在播放上述音频信号outl(t),outr(t)时,outl(t),outr(t)可以分别通过电子设备上的两个扬声器输出。,在通过双声道输出分别outl(t),outr(t)时,由于图7b所示的录制界面91中,子画面是位于主画面的偏左一侧,则用户的双耳对outl(ω),outr(ω)进行收听时,用户会感觉到子画面中传出的声音是从用户的左侧传来的。此外,由于子画面的面积小于主画面的面积,用户在收听该音频时会感觉到主画面中声音的响度较子画面中的声音响度更大。

[0372]

s211、电子设备判断界面是否发生变化。

[0373]

s212、电子设备保存处理后的音频。

[0374]

其中,所述步骤s211

‑

步骤s212的具体实现方式可参见上述图9所对应实施例中对步骤s101

‑

步骤s104的描述,这里将不再进行赘述。

[0375]

应理解,不限于图7b示出的录制界面90,本实施例提供的音频处理的方法也同样适用于对图5、图6以及图7a和图7c中示出的录制界面以及其他录制界面下的所录制的音频进行处理。在上下分屏的双景录像模式下,电子设备同样能获取到该录制界面中两个画面的前/后置信息、焦距信息和画面权重,并使用本实施例提供的音频的处理方法对在录制界面91下录制的音频进行过滤和融合。这里不再一一举例说明。只不过,在上下分屏的双景录像模式时,由于上下分屏的录制界面中,两个显示区域的相对方位并无左右之分,则电子设备在的对音频的处理过程中,无需执行步骤s210。也就是说,在采用图10示出的方法对上下分屏的录制界面下采集的音频进行处理时,其具体的处理流程可以变为图9中示出的处理流程。

[0376]

图11为本技术实施例提供的又一种音频的处理方法的流程图。该方法基于cvx波

束训练的方法对采集的音频信号进行滤波,能够利用两个画面的视场角信息对音频信号的滤波方向进行更具体的选择,使每个画面得到的波束都能具有左声道和右声道的区别。能进一步增强音频的立体感。如图11所示,本技术实施例提供的方法可以包括:

[0377]

s301、电子设备开启双景录像模式。

[0378]

s302、电子设备根据用户对录制界面的调整显示相应的录制界面。

[0379]

s303、电子设备采集音频。

[0380]

s304、电子设备录制图像。

[0381]

其中,所述步骤s301

‑

步骤s304的具体实现方式可参见上述图9所对应实施例中对步骤s101

‑

步骤s104的描述,这里将不再进行赘述。

[0382]

s305、电子设备获取画面的视场角。

[0383]

参考图7a所示的录制界面90。电子设备正采用焦距倍数为固定1

×

的前置摄像头和焦距倍数为3

×

的后摄像头在上下分屏模式下进行双景录像。此时,上取景框901呈现的画面(以下称为第一画面)为前置摄像头所拍摄的画面,其为用户自己的人脸;下取景框902呈现的画面(以下称为第二画面)为后置摄像头所拍摄的画面,其为电子设备100前方的风景图像。则由上述表1可知,此时该第一画面视场角为 180

°

,该第二画面的视场角为

‑

90

°

。

[0384]

为了在步骤307中对音频进行波束训练时,能够基于画面的视场角信息得到该与画面对应的具备左右声道区别的两个波束,在本实施例中,电子设备在获取到第一画面和第二画面的视场角后,将对该视场角进行划分。

[0385]

结合前述对图8b的说明可知,在图8b中,∠opo’(左侧)即为上述第一画面的视场角,∠bpb’即为上述第一画面的视场角。电子设备100所在平面的法线qq’为∠opo’(左侧)以及∠bpb’的角平分线,则法线qq’将∠opo’(左侧)分为∠opq’(以下称为左视场角1)以及∠o’pq’(以下称为右视场角1),将∠bpb’分为∠bpq(以下称为左视场角2)以及∠b’pq(以下称为右视场角2)。即,上述第一画面的视场角可划分为左视场角1和右视场角1;上述第二画面的视场角可划分为左视场角2和右视场角2。

[0386]

s306、电子设备计算画面权重。

[0387]

步骤s306的具体实现方式可参见上述图9所对应实施例中对步骤s106的描述,两个画面的画面权重w1以及w2分别为:

[0388]

w1=d1/(d1 d2)

[0389]

w2=d2/(d1 d2)

[0390]

其中,w1为第一画面的画面权重,w2为第二画面的画面权重。

[0391]

s307、电子设备基于cvx波束训练方法对音频进行过滤。

[0392]

接下来以波束形成算法为例对声源分离的过程进行进一步说明。

[0393]

由前述对图9中步骤s107的说明可知,滤波所采用的计算公式为:

[0394][0395]

其中i=1,2,3

……

m,x

i

(ω)表示电子设备中第i(i≤m)个麦克风采集到的音频信号,w

i

(ω)通过cvx波束训练方法得到,其表示第i个麦克风在音频信号的频率为ω时波束形成器的权值向量。应理解,无论何种算法实现对音频的过滤,w

i

(ω)都是该算法中与滤波方向强相关的一个必要的参数。

[0396]

本实施例基于cvx波束训练方法得到w

i

(ω)。在本实施例中,cvx波束训练方法得

到w

i

(ω)时,其输入包括该第i个麦克风与其他(m

‑

1)个麦克风的间距、视场角的角度(即滤波方向)。且不同于dsb算法,cvx波束训练方法在计算w

i

(ω)的过程中,输入的滤波方向是可以灵活变化的。而在步骤s105中,已经计算出了两个画面的视场角信息。因此,在本技术实施例中,可以将某个画面的视场角按照左右进行划分后作为该方法的输入,得到两个不同的权值向量w

il

(ω)和w

ir

(ω)右,在后续通过波束形成算法进行滤波时,可得到与该画面对应的两个波束,这两个波束就具备了左声道和右声道上的差异。

[0397]

在采集到环境中的音频信号后,电子设备将根据两个画面的视场角信息分别对该音频信号进行滤波,得到两个画面相对应的音频信号。

[0398]

接下来以图7a所示的录制界面90进行说明。结合前述对步骤s305的说明可知,图7a所示的录制界面90为上下分屏模式。在录制界面90中两个画面的视场角被分为左视场角1和右视场角1、左视场角2和右视场角2。

[0399]

电子设备可以将左视场角1和右视场角1作为输入,计算得到第一画面进行滤波时所需的权值向量,和并根据这两个权值向量对采集的音频进行过滤,得到第一画面对应的左声道波束以及右声道波束可以表示为:

[0400][0401][0402]

同理,电子设备可以将左视场角2和右视场角2作为输入,计算得到第一画面进行滤波时所需的权值向量,和并根据这两个权值向量对采集的音频进行过滤,得到第二画面对应的左声道波束以及右声道波束可以表示为:

[0403][0404][0405]

结合前述对图7a和图8b的相关描述可知,波束即为图8b中的左声道音频信号11,波束即为图8a中的右声道音频信号12;即为图8b中的左声道音频信号21,即为图8b中的右声道音频信号22。

[0406]

s308、电子设备对声源进行重混。

[0407]

在得到两个画面相应的波束和画面权重后,电子设备将结合两个画面的画面权重对两个波束进行混音。

[0408]

同样以图7a示出的录制界面90为例进行说明,在重混后,最终电子设备在录制界面90下输出的音频的具体方式可表示为:

[0409][0410][0411]

这里假设电子设备支持双声道输出,则在播放上述时域信号outl(t),outr(t)时,outl(t),outr(t)可以分别通过电子设备上的两个扬声器输出。在滤波时音频信号即区分了左右方向,因此,用户左右耳收听到的音频可能差别更为明显。此外,当两个显示区域的

面积大小相差无几或者相等时(在图5中(c)所示),用户在收听该音频时会感觉两个画面中的声音响度大致相等。不难看出,在本实施例中,outl(ω),outr(ω)用户输出时,用户可以更好的感知音频在左右声道上的差异,使声音更具立体感。

[0412]

s309、电子设备判断界面是否发生变化。

[0413]

s310、电子设备保存处理后的音频。

[0414]

其中,所述步骤s309

‑

步骤s310的具体实现方式可参见上述图9所对应实施例中对步骤s109

‑

步骤s110的描述,这里将不再进行赘述。

[0415]

应理解,不限于图7a示出的录制界面90,本实施例提供的音频处理的方法也同样适用于对图5、图6以及图7b和图7c中示出的录制界面以及其他录制界面下的音频。

[0416]

例如,图7b中示出的录制界面91,在画中画的双景录制模式下,电子设备同样能获取到该录制界面下两个画面的前/后置信息、焦距信息和画面权重(具体可以参阅图10中对步骤s205

‑

步骤s207的说明),再参考步骤s305

‑

步骤s308的方式对音频进行过滤和融合。这里不再一一举例说明。

[0417]

图12为本技术实施例提供的另一种音频的处理方法的流程图。该方法在能在图11的基础上,对画中画模式的双景录像模式的音频进行方位虚拟,能配合两个画面之间的方位感的使音频立体感进一步增强。

[0418]

结合前述对图10的描述,双景录像模式下采用上下分屏的录制界面进行录制时,若使用本实施例的方法对音频进行处理,其具体的处理流程和所得音频与使用前述图11中所示方法的处理流程和所得音频在本质上无差异。因此,接下来结合图7b所示的录制界面91对本方法的具体步骤进行说明。

[0419]

如图12所示,本技术实施例提供的方法可以包括:

[0420]

s401、电子设备开启双景录像模式。

[0421]

s402、电子设备根据用户对录制界面的调整显示相应的录制界面。

[0422]

s403、电子设备采集音频。

[0423]

s404、电子设备录制图像。

[0424]

其中,所述步骤s401

‑

步骤s404的具体实现方式可参见上述图9所对应实施例中对步骤s101

‑

步骤s104的描述,这里将不再进行赘述。

[0425]

s405、电子设备获取画面视场角。

[0426]

参考图7b所示的录制界面91。如图7b所示出的录制界面91,用户正采用焦距倍数为6

×

的前置摄像头和焦距倍数为2

×

的后摄像头在画中画模式下进行双景录像。此时,取景框911呈现的画面(以下称为主画面)为焦距倍数为2

×

的后置摄像头所拍摄的画面,其为电子设备100前方的风景;取景框912呈现的画面(以下称为子画面)为焦距倍数为6

×

的前置摄像头所拍摄的画面,其为用户自己的人脸。则由上述表1可知,此时主画面对应的视场角为大小90

°

,子画面对应的视场角为大小为30

°

。

[0427]

为了在步骤407中对音频进行rvx波束训练时,能够基于画面的视场角信息得到该与画面对应的具备左右声道区别的两个波束,在本实施例中,电子设备在获取到主画面的视场角后,将对主画面的视场角进行划分。结合前述对图8b的说明可知,∠fpf’即为上述子画面的视场角(以下称,视场角3),∠apa’即为上述主画面的视场角(以下称为视场角4)。电子设备100所在平面的法线qq’为∠apa’的角平分线,则法线qq’将∠apa’分为∠apq(以下

称为左视场角4)以及∠a’pq(以下称为右视场角4)。而由于子画面的面积相对较小,且后续需结合子画面和主画面的相对位置,对子画面经过rvx波束训练所得到音频信号再进行方位虚拟,因此,在对音频进行rvx波束训练时,子画面无需进行左右声道波束的区分,电子设备也就无需对子画面的视场角进行划分了。

[0428]

s406、电子设备计算画面权重。

[0429]

s407、电子设备计算子画面的方位信息。

[0430]

其中,所述步骤s406

‑

步骤s407的具体实现方式可参见上述图9所对应实施例中对步骤s206

‑

步骤s207的描述,这里将不再进行赘述。

[0431]

具体的,在步骤s406中,电子设备可计算得到两个画面的画面权重wm以及ws分别为:

[0432]

ws=α

×

d1

×

dw/(dl

×

dw)

[0433]

wm=1

‑

ws

[0434]

其中,ws为子画面的画面权重,wm为主画面的画面权重,α为校正系数,是在电子设备出厂时已经设定好的定值,其取值范围为[1,(dl

×

dw)/(d1

×

dw)],这样,可以防止两个画面面积差距太大而导致面积较小的取景框的画面权重的值过小。

[0435]

在步骤s406中,电子设备可计算得出,子画面相对于主画面的方位角z和俯仰角e为:

[0436]

z=a/(dw/2)

×

90

°

[0437]

e=b/(dl/2)

×

90

°

[0438]

s408、电子设备基于cvx波束训练方法对音频进行过滤。

[0439]

步骤s408中,电子设备采集音频以及对音频进行频域转化的具体方式可以参考前述对图9中步骤s107的相关描述,这里不再赘述。

[0440]

在采集到环境中的音频信号后,电子设备将根据两个画面的视场角信息分别对该音频信号进行滤波,得到两个画面相对应的音频信号。

[0441]

同样以图7b示出的录制界面91为例进行说明。参考前述对步骤s405的说明可知,图7b所示录制界面91中,子画面的视场角为视场角3,主画面的视场角4被分为左视场角4和右视场角4。

[0442]

电子设备视场角3作为输入,计算得到子画面进行滤波时所需的权值向量,并根据该权值向量对采集的音频进行过滤,得到子画面对应的波束可以表示为:

[0443][0444]

同理,电子设备可以将左视场角4和右视场角4作为输入,计算得到主画面进行滤波时所需的权值向量,和并根据这两个权值向量对采集的音频进行过滤,得到主画面对应的左声道波束以及右声道波束可以表示为:

[0445][0446]

[0447]

结合前述对图7b和图8b的相关描述可知,波束即为图8b中与∠fpf’同角度方向的音频信号31(图8b中未画出);波束即为图8b中与∠bpq同角度方向的左声道音频信号41(图8b中未画出),波束即为图8b中与∠b’pq同角度方向的右声道音频信号42(图8b中未画出)。

[0448]

s409、电子设备对子画面的声源进行方位虚拟。

[0449]

可参考对图10中步骤s409的说明。本实施例采用开源的cipic数据库,并根据方位角z和俯仰角e选择用于卷积的数据,选择的方法为:

[0450]

zimut=z/90

×

12 13

[0451]

elevation=e/90

×

16 9

[0452]

相应的,用于卷积的cipic_hrir为:

[0453]

data_l=hrir_k(zimut,elevation,:)

[0454]

data_r=hrir_r(zimut,elevati0n,:)

[0455]

在对子画面的音频进行方位虚拟时,只需结合上述cipic_hrir数据对进行卷积,其中卷积用“*”表示:

[0456][0457][0458]

主画面进行双声道虚拟:

[0459][0460][0461]

s410、电子设备对声源进行重混。

[0462]

在得到两个画面相应的波束和画面权重后,电子设备将结合两个画面的画面权重对两个波束进行混音。

[0463]

在重混后,最终电子设备在录制界面90下输出的音频的具体方式可表示为:

[0464]

outl(ω)=yml(ω)

×

wm ysl(ω)

×

ws

[0465]

outr(ω)=ymr(ω)

×

wm ysr(ω)

×

ws

[0466]

在播放上述音频信号outl(t),outr(t)时,outl(t),outr(t)可以分别通过电子设备上的两个扬声器输出。在通过双声道输出分别outl(t),outr(t)时,由于图7b所示的录制界面91中,子画面是位于主画面的偏左一侧,则用户的双耳对outl(ω),outr(ω)进行收听时,用户会感觉到子画面中传出的声音是从用户的左侧传来的。且在滤波时音频信号即区分了左右方向,因此,用户左右耳收听到的音频可能差别更为明显,音频的立体感更强。此外,由于子画面的面积小于主画面的面积,用户在收听该音频时会感觉到主画面中声音的响度较子画面中的声音响度更大。

[0467]

s411、电子设备判断界面是否发生变化。

[0468]

s412、电子设备保存处理后的音频。

[0469]

其中,所述步骤s211

‑

步骤s212的具体实现方式可参见上述图9所对应实施例中对步骤s101

‑

步骤s104的描述,这里将不再进行赘述。

[0470]

应理解,不限于图7b示出的录制界面90,本实施例提供的音频处理的方法也同样适用于对图5、图6以及图7a和图7c中示出的录制界面以及其他录制界面下的所录制的音频进行处理。在上下分屏的双景录像模式下,电子设备同样能获取到该录制界面中两个画面的前/后置信息、焦距信息和画面权重,并使用本实施例提供的音频的处理方法对在录制界面91下录制的音频进行过滤和融合。这里不再一一举例说明。只不过但是,若在步骤s411中,电子设备的检测到录制界面发生变化,且变化后的录制界面不再是画中画模式的录制界面,比如变化为在上下分屏的双景录像模式时,由于上下分屏的录制界面中,两个显示区域的相对方位并无左右之分,则电子设备在后续的对音频的处理过程中,无需执行步骤s410。也就是说,在采用图12示出的方法对上下分屏的录制界面下采集的音频进行处理时,其具体的处理流程可以变为图11中示出的处理流程。

[0471]

可选的,电子设备中处理器可以是在开始录制音视频时,执行如图9/图10/图11/图12所示出的音频处理方法。即在图5示出的用户界面中响应于控件704的用户操作之后,电子设备中处理器默认执行图9/图10/图11/图12所示出的音频处理方法。

[0472]

可选的,电子设备中处理器还可以是在录制音视频结束,将录制得到音视频信号存储进存储器时,执行图9/图10/图11/图12所示出的音频处理方法。电子设备中处理器在结束录制音视频,将录制得到音视频信号存储进存储器时执行图9/图10/图11/图12所示出的音频处理方法,可以在录制音频过程中减少处理器的占用,提高音频录制过程的流畅度。这样,在需要保存录制得到音频信号时才对音频信号执行图9/图10/图11/图12所示出的音频处理方法,从而可以节省处理器资源。

[0473]

参考图9、图10、图11以及图12示出的音频的处理方法,以及前述对用户界面实施例的说明中可知,双景录像的过程中用户可以对录制界面进行调整,具体的调整方式可以参考前述对图9中步骤s102的说明。对于其中一些调整方式,电子设备可以基于用户的操作平滑处理,例如调整摄像头的焦距以及对取景框的面积进行缩放(包括上下分屏模式下调整两个取景框分隔线的位置,以及现在画中画模式下调整子取景框的大小)、将画面位置进行拖动、或者调整摄像头的焦距时,用户往往能感觉到画面是在缓慢的变化的。但是,当用户将某个取景框对应的摄像头进行切换时,电子设备往往需要一定的处理时间。例如,用户在将某个取景框对应的摄像头从前置摄像头切换为后置摄像头时,或者对调两个取景框之间的画面时,用户往往感觉到画面是突变的。

[0474]

在图9、图10、图11以及图12示出的音频的处理方法中,当电子设备切换某个取景框对应的摄像头时,该取景框中画面的视场角也随之改变,电子设备基于该画面对音频进行滤波所得的音频信号也会改变。但是,由于电子设备进行镜头切换时在往往需要一定的处理时间,而电子设备基于镜头切换音频的调整短在极短的时间内就能完成。这样,画面的观感和音频的听感可能会有不平衡性。

[0475]

针对此类调整录制界面的场景,本技术实施例提供了一种平滑切换音频的方法,该方法的应用场景不限于双景摄像模式,也可以是单景摄像(普通摄像)模式。如图13所示,该方法可以包括:

[0476]

s501、电子设备将取景框的摄像头由历史摄像头切换为目标摄像头。

[0477]

由历史摄像头切换为目标摄像头的具体场景包括但不限于将该取景框对应的摄像头从前置摄像头切换为后置摄像头时、对调两个取景框之间的画面。

[0478]

示例性地,电子设备可以检测到作用于如图7a中控件901b上的点击操作,并响应于该操作对图7a中取景框901对应的摄像头由前置摄像头切换为后置摄像头,切换后的用户界面可以参考图7c示出的录制界面92。

[0479]

示例性地,电子设备可以检测到作用于如图5中(d)所示的画面调换控件708上的点击操作,并响应于该操作将取景框的701和取景框702的画面内容进行切换。

[0480]

s502、电子设备获取历史音频信号和目标音频信号。

[0481]

该历史音频信号为电子设备基于历史摄像头的画面(视场角)对音频进行过滤得到的音频信号,示例性的,该历史音频信号为电子设备检测到切换摄像头的操作的前一刻,基于该画面过滤所得到音频信号,例如为用户点击前后置摄像头切换按钮(例如911b、912b、画面调换控件708)或者双击子取景框802的时刻的音频信号。

[0482]

以下用ya(ω)表示;该目标音频信号为电子设备基于目标摄像头的画面(视场角)对音频进行过滤得到的音频信号yb(ω)。

[0483]

示例性的,当电子设备响应于用户对图7a中控件901b上的点击操作,将图7a中取景框901对应的摄像头由前置摄像头切换为后置摄像头,且切换后的用户界面为图7c示出的录制界面92时,上述历史信号ya(ω)即为图8a中所示的音频信号1,上述目标信号yb(ω)即为图8a中所示的音频信号3。

[0484]

s502、电子设备根据历史摄像头切换为目标摄像头的时长动态调整历史音频信号和目标音频信号的混音比例。

[0485]

将历史信号yb(ω)在混音时所占的比例用β表示,则目标信号ya(ω)在混音时所占的比例即为(1

‑

β),则β的一种动态调整的方法可表示为:

[0486]

β=(t/t1‑

t)/(t/t1)

[0487]

其中,t为电子设备将历史摄像头切换为目标摄像头的所需时长,单位为ms,其具体数值由电子设备的性能决定。可选的,t的数值就是摄像头进行切换所用的时长,例如,由前置摄像头切换后置;t1为电子设备对音频处理的帧长,其表示电子设备在采集或者处理音频信号时,处理音频信号的帧计数;对不同的电子设备而言,t和t1与电子设备的性能有关,不同的电子设备可能有不同的t和t1,但对于固定的电子设备而言,t和t1均为定值。t为帧计数,t的取值范围为[0,t/t1‑

1]。在电子设备触发将历史摄像头切换为目标摄像头的动作后,t第一帧记为0,之后累加,一直到t/t1‑

1。

[0488]

s502、电子设备根据混音比例将历史音频信号和目标音频信号重混。

[0489]

在历史摄像头切换为目标摄像头的过程中,电子设备每一个帧下计算得到的混音比例,将上述历史音频信号和目标音频信号重混,得到用于后续其他操作的音频。重混方式可表示为:

[0490]

yc(ω)=β

×

ya(ω) (1

‑

β)yb(ω)

[0491]

其中,yc(ω)即为重混后的音频信号。

[0492]

由该重混公式可知,在摄像头切换过程中的,目标信号yb(ω)在混音时所占比例会越来越大,历史信号ya(ω)所占比例会越来越小。当摄像头切换完成之后,目标信号yb(ω)占比为1,历史信号ya(ω)占比为0。这样,音频就能配合画面的变换进行平滑切换,让用户感觉到声音的方向也是随着画面的切换平缓地发生变化的。

[0493]

本技术实施例还提供了一种电子设备,该电子设备包括:一个或多个处理器和存

储器;其中,存储器与所述一个或多个处理器耦合,该存储器用于存储计算机程序代码,该计算机程序代码包括计算机指令,该一个或多个处理器调用该计算机指令以使得所述电子设备执行前述实施例中所示的方法。

[0494]

上述实施例中所用,根据上下文,术语“当...时”可以被解释为意思是“如果...”或“在...后”或“响应于确定...”或“响应于检测到...”。类似地,根据上下文,短语“在确定...时”或“如果检测到(所陈述的条件或事件)”可以被解释为意思是“如果确定...”或“响应于确定...”或“在检测到(所陈述的条件或事件)时”或“响应于检测到(所陈述的条件或事件)”。

[0495]

在上述实施例中,可以全部或部分地通过软件、硬件、固件或者其任意组合来实现。当使用软件实现时,可以全部或部分地以计算机程序产品的形式实现。所述计算机程序产品包括一个或多个计算机指令。在计算机上加载和执行所述计算机程序指令时,全部或部分地产生按照本技术实施例所述的流程或功能。所述计算机可以是通用计算机、专用计算机、计算机网络、或者其他可编程装置。所述计算机指令可以存储在计算机可读存储介质中,或者从一个计算机可读存储介质向另一个计算机可读存储介质传输,例如,所述计算机指令可以从一个网站站点、计算机、服务器或数据中心通过有线(例如同轴电缆、光纤、数字用户线)或无线(例如红外、无线、微波等)方式向另一个网站站点、计算机、服务器或数据中心进行传输。所述计算机可读存储介质可以是计算机能够存取的任何可用介质或者是包含一个或多个可用介质集成的服务器、数据中心等数据存储设备。所述可用介质可以是磁性介质,(例如,软盘、硬盘、磁带)、光介质(例如dvd)、或者半导体介质(例如固态硬盘)等。

[0496]

本领域普通技术人员可以理解实现上述实施例方法中的全部或部分流程,该流程可以由计算机程序来指令相关的硬件完成,该程序可存储于计算机可读取存储介质中,该程序在执行时,可包括如上述各方法实施例的流程。而前述的存储介质包括:rom或随机存储记忆体ram、磁碟或者光盘等各种可存储程序代码的介质。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。