一种复杂环境纯色牛背识别方法及系统与流程

- 国知局

- 2024-07-31 23:26:27

本发明涉及生物识别领域,具体涉及一种复杂环境纯色牛背识别方法及系统。

背景技术:

1、在规模化养牛场,要实现个体化、自动化、信息化的日常精细化管理,实现每头牛健康状况的跟踪和奶、肉制品的可追溯性,关键在于对个体牛的识别,纯色牛个体识别是其中的关键。

2、传统的纯色牛个体识别可以通过物理方法或嵌入微芯片的方式对身体某一部位进行标记,通过射频id的方式对纯色牛个体加以区分。但这种方式不能防止欺诈行为,包括复制标记和盗窃设备,还会对牛本身造成伤害,因此利用非接触方式进行纯色牛个体识别的方法开始兴起。

3、由于近几年人工智能技术的高速发展,在非接触式纯色牛背识别方面也涌现了许多基于深度学习的新方法,在模型设计上基于卷积神经网络(convolutional neuralnetworks,cnn)的纯色牛背识别技术日趋成熟,如基于增量识别的纯色牛背识别算法,运用cnn提取的特征构造稀疏表示分类模型,计算各类别的残差,依据残差最小原则进行纯色牛个体识别的方法,或是去除vgg(visual geometry group)网络的冗余参数,在不影响识别率的前提下减少了网络参数,为纯色牛的识别技术提供了一种新的思路。还有一种基于vgg-16网络建立了纯色牛背特征提取模型的方法,采用欧氏距离计算纯色牛身特征间的相似度,采用softmax loss和中心损失作为模型训练的损失函数,增大了模型提取特征的类间距离,减小了类内距离,提高了纯色牛的识别性能。卷积神经网络因其强大的特征表达能力在纯色牛背识别领域取得了一些成果,但由于其局部感受野的局限性,提取纯色牛背特征时,往往忽略了纯色牛背图像的全局上下文信息,并不能很好地表征纯色牛背。

4、在感受野方面,研究员们也开始在识别前着重解决感受野的局限性。如视觉transformer(vision-transformer,vit)模型,利用transformer全局感受野的特性得到了比cnn更好的性能。经过我们测试,vit只使用全局特征,忽视了局部特征之间的联系。swintransformer将vit的全局特征直接加到每一块局部特征中,融合了局部特征和全局特征之间的信息,但在使用msak矩阵对移位后的局部特征之间进行相关性学习时,受到背景图像块和非目标纯色牛背图像块干扰无法准确学习目标纯色牛背的局部特征及局部特征之间的联系,降低了算法模型对纯色牛背局部特征的区分度。

技术实现思路

1、针对在复杂牛场环境下由于牛群遮挡以及牛的活动状态和姿态多样性等问题引起的纯色牛背识别困难的难题。

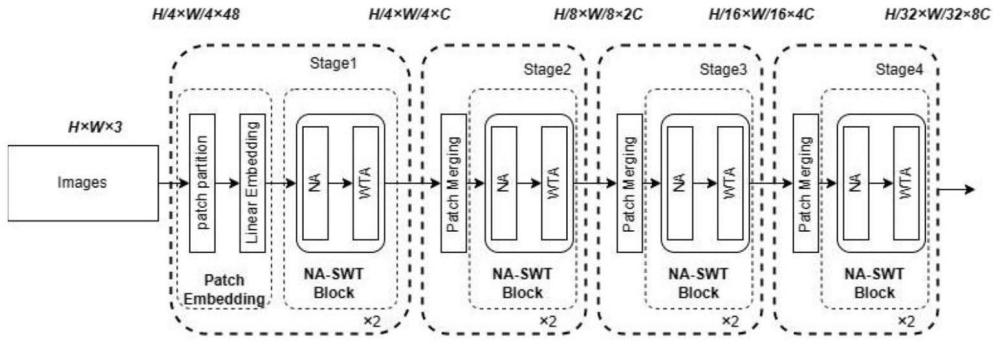

2、本发明提出一种复杂环境纯色牛背识别方法。本发明在swin transformer模型的基础上对复杂环境设计了全新的特征融合方式。提出na领域注意力,将每个查询标记的接受领域限制在相应标记周围的一个固定大小的邻域,以一种平衡平移不变性和等值性的方式来控制感受野自主调控关注纯色牛背图像的注意域范围,屏蔽了大量图像边缘区域的其他非目标纯色牛特征和背景干扰特征,获得更为精准的目标纯色牛背的高语义层次全局特征和表征纯色牛背细节的轮廓等局部特征;通过swin transformer的窗口注意力机制将经过领域注意力调控后的注意域分为局部子窗口,更准确的检测筛选出纯色牛背部纹理等局部特征,移位窗口注意力机制对局部子窗口进行移位操作后进行mask自注意力计算,mask矩阵依靠na邻域注意力调控后更加精准的注意域实现了纯色牛背局部特征之间的准确信息交互,后续的窗口复位操作充分融合纯色牛背全局特征和局部特征,提升不同纯色牛背之间的特征区分度。为解决在复杂牛场环境下的牛身份识别困难的问题,

3、本发明解决问题所采用的技术方案为:

4、s1、采集纯色牛背数据:

5、在不同的光照条件下和同一拍摄高度下,采集牛背视频时针对正背、左侧背、右侧背、以及反牛背等不同的牛背姿态,在同一高度下拍摄30s视频,截取牛背图像,进行分类、编号和筛选,并将牛背图像数据划分为训练集和测试集;

6、s2、构建基于na-swin transformer的复杂环境纯色牛背识别模型;

7、s2-1.在第一个stage中首先将输入的纯色牛背图像分为n个大小相同的图像块并使用swin transformer的linear embedding模块将每个图像块转换成维度为d的特征向量

8、s2-2.使用na邻域注意力特有的类局部归纳偏差将关注的特征区域集中到更为精准的纯色牛背局部特征范围,并屏蔽其他非目标纯色牛背的局部特征和背景干扰特征,即将n个特征向量进行归纳去除部分干扰特征向量,最后留下m个特征向量利用邻域注意力自身的全局性从m个特征向量提取出表征纯色牛背高语义层次的全局特征egol1;

9、s2-3.对由m个特征向量和全局特征egol1组成的特征图,进行平均池化avgpool得到分类向量xcls,所述分类向量xcls用于表征纯色牛背图像的全局特征egol2;

10、s2-4.使用swin transformer的window attention窗口局部注意力计算机制,将m个特征向量和全局特征egol1组成的特征图分成互不重叠的windows块,每个windows块内部单独做自注意力计算,利用局部感受野提取每个windows块中的纯色牛背局部特征

11、s2-5.使用swin transformer的shifted window attention移位窗口注意力计算机制中的shifted window策略来建立windows块之间的纯色牛背局部特征信息交互,通过mask矩阵进行自注意力计算,学习纯色牛背局部特征之间相关性的同时进一步屏蔽干扰特征,最后reverse恢复原windows块的位置实现纯色牛背局部特征和全局特征egol2的信息交互,得到最终包含纯色牛背特征之间相关性的输出特征s=na-swintransformerlayer(e);所述的e为纯色牛背局部特征和全局特征egol2;

12、s2-6.最后将纯色牛背全局特征egol2、纯色牛背局部特征和包含纯色牛背特征之间相关性的输出特征s输入mlp中进行分类;

13、s3、使用所述步骤s1中所述的训练集,构建损失函数,对所述步骤s2中基于na-swin transformer对复杂环境纯色牛背进行数据处理模型进行训练,当总损失下降到不大于0.01时结束训练,得到训练好的纯色牛背数据处理模型;

14、s4、将步骤s1中所述的测试集中的数据输入训练好的纯色牛背数据处理方法中,提取纯色牛背图像特征并进行识别比对。

15、作为优选,所述s3中的损失函数包括:三元组损失ltriplet和交叉熵损失lsoftmax。

16、作为优选,所述s2-2中,所述na邻域注意力引入了类似于卷积的局部归纳偏差。当邻域大小最小时(即邻域大小为1个像素),na只关注自身周围的1个像素邻域(创建一个3×3方形窗口)。当邻域大小超过或等于特征图的大小,邻域注意力等同于自注意力即拥有全局性。

17、作为优选,所述s2-4中的window attention(后统称w-msa)在进行特征图窗口化后,引入相对位置编码机制,首先输入张量形状为[num_windows*b,window_size*window_size,c],经过self.qkv全连接层后进行reshape,得到形状为[3,num_windows*b,num_heads,window_size*window_size,c//num_heads],并分配给q、k、v。对q乘以一个scale缩放系数,然后与k(为了满足矩阵乘要求,需要将最后两个维度调换)进行相乘。得到形状为[num_windows*b,num_heads,window_size*window_size,window_size*window_size]的attn张量之前针对位置编码设置了个形状为(2*window_size-1*2*window_size-1,numheads)的可学习变量。用计算得到的相对编码位置索引选取得到形状为(window_size*window_size,window_size*window_size,num_heads)的编码,再permute(2,0,1)后加到attn张量上。

18、其中num_windows为窗口化特征图数量,window_size为窗口化特征图大小,num_heads为注意力头数量,c为通道数,q、k、v代表着窗口中进行的自注意力计算后映射的向量。

19、作为优选,s2-5中的shifted window attention(后统称sw-msa)使用了移动窗口(cyclic-shift)策略:对大小为2m×2m的特征图进行window partition划分windows(窗口)大小,中间大小为m×m的windows视为1组patchs,边缘部分的windows各为1组patchs,9组patchs设置不同id。cyclic shift将左上的5个patchs移动到右下位置,使8个较小的patchs新组合成3个大小为m×m的windows,此时共有4个大小为m×m的windows,如图5所示,以此实现不同位置的纯色牛只局部特征的信息交互。每个m×m大小的windows中id不同的patchs通过mask矩阵进行自注意力计算,学习纯色牛局部特征之间相关性的同时进一步屏蔽干扰特征,最后reverse恢复原windows位置实现纯色牛局部特征和全局特征的信息交互。

20、作为优选,所述s4中,基于余弦距离进行所述识别比对;

21、余弦距离计算公式如下:

22、

23、余弦距离越大说明两个纯色牛背特征的相似度越高,反之,则两个由模型提取到的纯色牛背特征的相似度越低;

24、基于余弦距离进行识别比对的过程包括以下步骤:

25、将测试集纯色牛背图像提取到的经过6、4、2等分后组合归一化后的特征进行1∶1不同类比对,获得模型比对阈值t;

26、再将测试集中的图像进行同类比对,当同类提取到的组合特征的比对值大于t时即视为比对成功;反之,则认为比对失败。

27、一种复杂环境纯色牛背识别系统,包括数据采集模块、模型构建模块、模型训练模块、测试模块。

28、数据采集模块,用于采集纯色牛背数据,采集牛背视频时针对正背、左侧背、右侧背、以及反牛背的牛背姿态,在同一高度下拍摄30s视频,截取牛背图像,进行分类、编号和筛选,并将牛背图像数据划分为训练集和测试集;

29、模型构建模块,基于na-swin transformer对复杂环境纯色牛背图像进行数据处理,构建基于na-swin transformer的复杂环境纯色牛背识别模型;

30、模型训练模块,基于数据采集模块中的训练集构建损失函数,对数据处理模块中基于na-swin transformer对复杂环境纯色牛背进行数据处理的模型进行训练,当总损失下降到不大于0.01时结束训练,得到训练好的纯色牛背数据处理模型;

31、测试模块,将数据采集模块中测试集的数据输入训练好的纯色牛背数据处理模型中,提取纯色牛背图像特征并进行识别比对。

32、本发明有益效果如下:

33、本发明使用卷积神经网络(convolutionai neural networks,cnn)提取纯色牛背特征时,但由于其局部感受野的局限性,提取纯色牛背特征时,往往忽略了纯色牛背图像的全局上下文信息,只能提取到纯色牛背图像的局部特征信息。视觉transformer(vision-transformer,vit)模型的全局感受野特性能有效改善cnn局部感受野的问题,但vit识别模型没有考虑到各局部特征之间的相关性,这样简单暴力的划分局部特征,当出现大范围遮挡以及多姿态情况,在和模板匹配时,对应部分的比对值就会较大,整体的比对值就会大于阈值造成识别失败。swin transformer将vit的全局特征直接加到每一块局部特征中,融合了局部特征和全局特征之间的信息,但在使用msak矩阵对移位后的局部特征之间进行相关性学习时,受到背景图像块和非目标纯色牛背图像块干扰无法准确学习目标纯色牛背的局部特征及局部特征之间的联系,降低了算法模型对纯色牛背局部特征的区分度。相较于原始的swin transformer模型,我们在每个stage交替进行w-msa和sw-msa前加入na邻域注意力机制,自主调控关注纯色牛背图像的注意域范围,在获得精准的目标纯色牛背高语义层次全局特征和纯色牛背轮廓纹理等局部特征的同时屏蔽了其他非目标纯色牛背特征和干扰背景特征,弥补了swin transformer进行局部特征相关性学习时易受干扰的缺陷。

34、本发明加入可学习的msak矩阵使模型进一步抑制不含纯色牛背信息的图像块,学习到更加鲁棒的纯色牛背特征;最后将平均池化得到的纯色牛背全局特征和局部感受野提取的纯色牛背局部特征,以及shifted window策略得到的包含特征之间相关性的输出特征输入到mlp中进行分类,精准得出正确的预测结果。

35、本发明提出了一种基于na-swin transformer的复杂环境纯色牛背识别算法,能有效解决在复杂环境下的纯色牛身份识别问题,在复杂场景下的1:1比对识别能获得优异的识别性能。

本文地址:https://www.jishuxx.com/zhuanli/20240730/197568.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表