一种基于时间空间关联建模的多源传感器融合识别方法

- 国知局

- 2024-08-05 12:06:40

本发明涉及智能驾驶汽车领域,尤其是涉及一种基于时间空间关联建模的多源传感器融合识别方法。

背景技术:

1、智能汽车有着降低事故发生频率的能力而被受关注。但是,由于智能汽车被要求运行在开放且复杂的驾驶环境中,如何提高智能汽车在高纬且数量众多的交通场景中的适应性成为挑中。其中,设计智能汽车的细腻感知模型以洞察场景中要素的细微差距来提高识别精度是提高智能汽车安全性的首要手段之一。

2、现有的感知算法主要分为单一传感器识别和多源传感器识别方法两类。由于,不同的传感器类别有着差异化的特性,多源传感器识别方法的适应性显著高于单一传感器识别方法,且成为目前主流智能汽车识别手段。例如:摄像头和激光雷达各自具有不同的优势和局限性。摄像头对于颜色、纹理和形状等视觉信息感知较为敏感,但在光照不良或者低纹理环境下表现可能不佳;而激光雷达则能够提供精确的距离和高度信息,但对于光线和天气条件有较好的稳定性。融合它们可以在不同情况下提供更全面、鲁棒的感知能力。

3、尽管多源传感器取得了较好的成绩,但是应对边缘场景依旧存在问题。比如,在良好的天气下,在高速路上行驶着一辆白色的卡车。在这个工况下,现有的算法尽管做了融合,但是过分相信摄像头信息。而此时,由于白色卡车被蓝天覆盖,被识别为了白云,导致了智能汽车并为进行减速,造成了交通事故的放生。这类识别精度问题源于对多源传感器信息融合的粗糙处理,过分依赖于某一类传感器的信息,尽管他们在大多数情况下是正确的。

技术实现思路

1、本发明的目的是为了提供一种基于时间空间关联建模的多源传感器融合识别方法,从多个观察维度进行传感器的深度融合,提高识别精度,保证智能汽车在边缘场景中行驶安全性。

2、本发明的目的可以通过以下技术方案来实现:

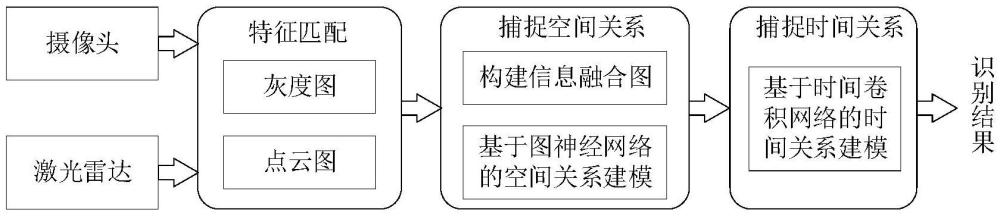

3、一种基于时间空间关联建模的多源传感器融合识别方法,包括以下步骤:

4、s1,获取不同类型的传感器采集的多源信息并进行预处理;

5、s2,根据预处理后的多源传感器信息构建信息融合图;

6、s3,基于信息融合图分别进行基于图卷积神经网络的空间关系建模和基于时间卷积网络的时间关系建模,构建融合网络以深度融合多源传感器信息,输出识别结果。

7、所述传感器包括摄像头和激光雷达,采集的多源信息包括由摄像头采集的图像信息和激光雷达采集的点云信息,所述点云信息包括位置信息和速度信息。

8、所述信息融合图由节点u和连接节点的边e构成,即g=(u,e),其中,节点由摄像头提供的像素点的灰度值以及激光雷达提供的像素点与智能汽车的相对距离、像素点的速度构成,即u=[ug,up,uv],ug,up,uv分别对应像素点灰度值,像素点与智能汽车的相对距离以及像素点的速度;边通过像素点之间在像素坐标下的欧几里得度量表达,具体的计算公式如下:

9、

10、式中,eij表示在像素坐标系中,第i个像素点与第j个像素点的连接边;cix和ciy表示第i个像素点在像素坐标系中的坐标;cjx和cjy表示第j个像素点在像素坐标系中的坐标;eij为边矩阵e的元素,其中e是一个n×n的方阵,表达两个像素点之间的连接关系,n表示一张灰度图的边拥有的像素点的个数。

11、所述s3中,通过像素点之间的连接关系进行空间关系建模,捕捉单帧之间的关联性;通过包含空间信息的隐含状态变化进行时间关系建模,捕捉帧间变化特征。

12、所述基于图卷积神经网络的空间关系建模具体为:

13、基于信息融合图g,通过a=e+i计算邻接矩阵,其中,u为单位矩阵,e为信息融合图的边矩阵;

14、通过dmm=∑amn计算度量矩阵元素dmm,构成度量矩阵d,d为一个对角阵;

15、通过如下公式进行图卷积神经网络的迭代:

16、

17、式中w为待学习的网络常数,lg表示图卷积迭代次数,z为迭代元素,即z0=u。

18、所述基于时间卷积网络的时间关系建模具体为:

19、

20、式中m为时间卷积网络中迭代的元素,其中即图卷积神经网络的输出;conv(·)为卷积计算公式;lt表示时间卷积迭代次数。

21、所述融合网络的输出包括待识别物体的类型及其运动状态,网络的损失函数通过softmax层输出的最大概率物体与真实物体的标注的差异性表达。

22、所述s1包括以下步骤:

23、s11,摄像头和激光雷达的外部校准

24、对摄像头和激光雷达进行外部校准,将二者的坐标系进行对齐;

25、s12,图像灰度图与激光点云获取

26、获取摄像头采集的图像并进行灰度化处理;获取激光雷达采集的激光点云数据,所述激光点云数据包括位置信息和速度信息;

27、s13,将激光点云投影到灰度图像中,使得点云与图像中的像素点对应;

28、s14,对投影后的激光点云与灰度图像进行特征匹配,以消除信息匹配误差。

29、所述将激光点云投影到灰度图像中的公式为:

30、

31、

32、式中fx和fy分别表示激光点云投影到图像中的像素坐标;x,y和z是激光雷达安装位置相对于摄像头安装位置的三维坐标;fx和fy表示摄像头的焦距;cx和cy表示灰度图像的中心坐标。

33、所述特征匹配包括以下步骤:

34、特征提取:采用特征提取算法从图像点云中提取特征点,所述特征点包括角点、边缘;

35、特征描述:对提取的特征点进行描述,生成特征描述子;

36、激光雷达点云的特征提取:对激光雷达点云进行特征提取;

37、特征匹配:利用特征点或特征描述子在图像和激光雷达点云之间进行匹配;

38、误差剔除:剔除特征匹配误差超过预设值的特征点对。

39、与现有技术相比,本发明具有以下有益效果:

40、本发明根据摄像头和激光雷达获取的多源传感器信息,对相似物体形状的物体通过空间维度信息分析以有效的辅助判断,有效的关注全局信息,避免因过度关注边缘而导致的识别精度下降,以及,对被运动物体搭乘的货物通过时间维度信息分析,有效的捕捉到帧间变化特征,以避免物体的运动状态识别错误,从而通过深度融合多源传感器信息以从多维角度观察实物,提高识别精度,有效的降低智能汽车识别算法的失误率,提高智能汽车在开放环境下的适应性。

技术特征:1.一种基于时间空间关联建模的多源传感器融合识别方法,其特征在于,包括以下步骤:

2.根据权利要求1所述的一种基于时间空间关联建模的多源传感器融合识别方法,其特征在于,所述传感器包括摄像头和激光雷达,采集的多源信息包括由摄像头采集的图像信息和激光雷达采集的点云信息,所述点云信息包括位置信息和速度信息。

3.根据权利要求2所述的一种基于时间空间关联建模的多源传感器融合识别方法,其特征在于,所述信息融合图由节点u和连接节点的边e构成,即g=(u,e),其中,节点由摄像头提供的像素点的灰度值以及激光雷达提供的像素点与智能汽车的相对距离、像素点的速度构成,即u=[ug,up,uv],ug,up,uv分别对应像素点灰度值,像素点与智能汽车的相对距离以及像素点的速度;边通过像素点之间在像素坐标下的欧几里得度量表达,具体的计算公式如下:

4.根据权利要求1所述的一种基于时间空间关联建模的多源传感器融合识别方法,其特征在于,所述s3中,通过像素点之间的连接关系进行空间关系建模,捕捉单帧之间的关联性;通过包含空间信息的隐含状态变化进行时间关系建模,捕捉帧间变化特征。

5.根据权利要求4所述的一种基于时间空间关联建模的多源传感器融合识别方法,其特征在于,所述基于图卷积神经网络的空间关系建模具体为:

6.根据权利要求5所述的一种基于时间空间关联建模的多源传感器融合识别方法,其特征在于,所述基于时间卷积网络的时间关系建模具体为:

7.根据权利要求1所述的一种基于时间空间关联建模的多源传感器融合识别方法,其特征在于,所述融合网络的输出包括待识别物体的类型及其运动状态,网络的损失函数通过softmax层输出的最大概率物体与真实物体的标注的差异性表达。

8.根据权利要求2所述的一种基于时间空间关联建模的多源传感器融合识别方法,其特征在于,所述s1包括以下步骤:

9.根据权利要求8所述的一种基于时间空间关联建模的多源传感器融合识别方法,其特征在于,所述将激光点云投影到灰度图像中的公式为:

10.根据权利要求8所述的一种基于时间空间关联建模的多源传感器融合识别方法,其特征在于,所述特征匹配包括以下步骤:

技术总结本发明涉及一种基于时间空间关联建模的多源传感器融合识别方法,包括以下步骤:获取不同类型的传感器采集的多源信息并进行预处理;根据预处理后的多源传感器信息构建信息融合图;基于信息融合图分别进行基于图卷积神经网络的空间关系建模和基于时间卷积网络的时间关系建模,构建融合网络以深度融合多源传感器信息,输出识别结果。与现有技术相比,本发明具有深度融合了物体类别信息和物体运动特征信息,能够显著提高智能汽车对物体的识别精度等优点。技术研发人员:陈虹,孟强,张琳受保护的技术使用者:同济大学技术研发日:技术公布日:2024/8/1本文地址:https://www.jishuxx.com/zhuanli/20240802/261113.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表