一种基于穿戴式智能设备的手势交互方法及系统与流程

- 国知局

- 2024-09-11 14:15:16

本技术涉及设备交互的,尤其是涉及一种基于穿戴式智能设备的手势交互方法及系统。

背景技术:

1、随着人们对智能设备使用需求的提高,越来越多的企业推出了穿戴式的智能设备,然而,穿戴式设备受制于体积、穿戴方式的限制,难以像手持设备那么方便进行触控/按键操作,因此,穿戴式设备需要依赖其他方式进行交互;目前,市场上已有能够进行手势交互的智能设备,例如具有手势交互功能的ar/vr/mr眼镜,用户可以通过手势交互实现对虚拟物体的抓取、移动或启动/关闭等功能,然而,此类手势交互功能主要用于游戏场景或智能家居控制等封闭安全的场景,无需进行快速控制;由于目前越来越多的车辆为了降低成本或保持设计美观,取消了许多按键,将空调、音量调节等功能集成于车载智能终端内,一些不常用功能甚至被设置于多级菜单项下,因而存在操作不便的问题,现有的手势交互方法若用于对驾驶场景中提供增强信息的智能设备进行控制,则存在交互效率较低的问题。

技术实现思路

1、为了提高手势交互功能的交互效率,本技术提供一种基于穿戴式智能设备的手势交互方法及系统。

2、本技术的发明目的一采用如下技术方案实现:

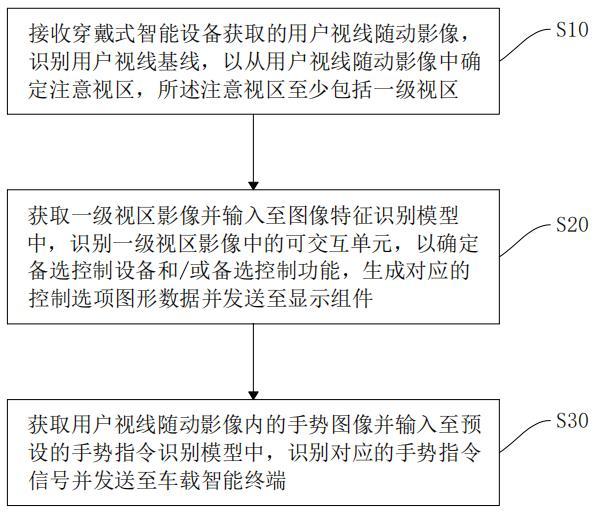

3、一种基于穿戴式智能设备的手势交互方法,包括:

4、接收穿戴式智能设备获取的用户视线随动影像,识别用户视线基线,以从用户视线随动影像中确定注意视区,所述注意视区至少包括一级视区;

5、获取一级视区影像并输入至图像特征识别模型中,识别一级视区影像中的可交互单元,以确定备选控制设备和/或备选控制功能,生成对应的控制选项图形数据并发送至显示组件;

6、获取用户视线随动影像内的手势图像并输入至预设的手势指令识别模型中,识别对应的手势指令信号并发送至车载智能终端;

7、所述用户视线基线为用户视线焦点所在射线;所述注意视区为以用户视线基线在用户视线随动影像中交点为中心设置的图像区域;可交互单元包括可控制设备和可控制按钮。

8、通过采用上述技术方案,当用户处于驾驶车辆的场景时,不宜花费较长时间进行车辆非核心驾驶功能的控制,因此,接收由穿戴式智能设备获取的用户视线随动影像,以便收集用户视线观察范围内的视觉信息,进一步识别用户视线焦点所在射线,以便根据用户注意力集中的视线区域定义为注意视区;将一级视区内的一级视区影像输入至图像特征识别模型中,以便识别其中的可交互单元,进而判断用户可能需要控制的设备/功能,基于用户可能需要控制的设备/功能生成对应的控制选项图形数据并发送至显示组件,以便用户获知可选的控制功能;获取用户视线随动影像内的手势图像并通过手势指令识别模型进行识别,进而获知用户输入的手势指令信号,将手势指令信号发送至车载智能终端,以对车辆的非核心驾驶功能的控制,从而实现了用户望向欲控制设备或其按钮即可建立穿戴式智能设备与欲控制设备的关联,进而控制对应设备的效果,提高了手势交互功能的交互效率。

9、本技术在一较佳示例中:所述注意视区还包括驾驶关键视区;

10、所述接收穿戴式智能设备获取的用户视线随动影像,识别用户视线基线,以从用户视线随动影像中确定注意视区之后,包括:

11、获取行驶状态信息和道路状态信息并输入至行驶安全性分析模型,以评估视野偏离允许时间;

12、获取驾驶关键视区影像并输入至图像特征识别模型中,识别驾驶关键视区影像中的安全标记点位是否齐全,当安全标记点位不齐全时开始视野偏离计时;

13、当视野偏离计时达到视野偏离允许时间时,生成视偏提示指令;

14、所述行驶状态信息包括车辆的实时速度信息和实时方向信息;所述道路状态信息包括车道信息、路面类型信息和道路封闭性信息;所述安全标记点为设置在车辆前窗框的若干点位。

15、通过采用上述技术方案,注意视区还包括驾驶关键视区,用于后续评估用户驾驶过程中视线方向是否处于正确方向,获取车辆的实时速度信息和实时方向信息,以便分析车辆当前的行驶安全性状态,进一步获取车道信息、路面类型信息和道路封闭性信息,以便分析当前道路的安全性状态,将行驶状态信息和道路状态信息输入至行驶安全性分析模型,从而综合评估当前车辆行驶的安全性,进而确定视野偏离允许时间;获取驾驶关键视区影像并输入至行驶安全性分析模型中,以识别车辆前窗框的若干个安全标记点位是否均出现在驾驶关键视区影像中,当驾驶关键视区影像中缺失安全标记点位时,开始进行视野偏离计时,以评估用户视线偏离车辆前方的时间;当视野偏离计时达到视野偏离允许时间时,生成视偏提示指令,以便后续提示用户将视线转移至车辆前方,以防因观察不周导致交通事故发生。

16、本技术在一较佳示例中:所述识别用户视线基线,以从用户视线随动影像中确定注意视区之前,还包括:

17、接收视线基线设定信号,依次生成若干标准视线偏移图像数据并发送至显示组件;

18、获取若干标准视线偏移图像展示时对应的眼动追踪图像并存储至视线分析数据库;

19、所述视线分析数据库为用户视线基线识别算法的训练集。

20、通过采用上述技术方案,当需要设定新用户的用户视线基线识别算法时,接收视线基线设定信号,依次生成若干个标准视线偏移图像数据并发送至显示组件,以便显示组件依次显示标准视线偏移图像,引导用户将视线偏移至若干个标准角度;获取用户将视线偏移至若干个标准角度时对应的眼动追踪图像并存储至视线分析数据库中,以便用于训练用户视线基线识别算法,以便后续根据用户眼动图像识别用户视线基线的方向。

21、本技术在一较佳示例中:所述识别用户视线基线,以从用户视线随动影像中确定注意视区,还包括:

22、接收穿戴式智能设备获取的用户眼动追踪图像,通过用户视线基线识别算法处理所述用户眼动追踪图像,以确定用户视线基线;

23、以用户视线基线与用户视线随动影像的交点为中心点,基于预设的注意半径初始值确定注意视区。

24、通过采用上述技术方案,接收由穿戴式智能设备获取到的用户眼动追踪图像,通过预训练的用户视线基线识别算法对用户眼动追踪图像进行处理,进而确定用户视线基线的方向;基于已知的用户视线基线方向确定用户视线基线与用户视线随动影像的交点并确定为注意视区的中心点,基于中心点和预设的注意半径初始值确定注意视区,从而提高了注意视区位置的灵活性,由于人体眼球转动的效率和精准度都大大高于头部转动,因此,基于用户视线基线确定注意视区以识别可交互单元,无需用户频繁转动头部,进一步提高了手势交互功能的交互效率。

25、本技术在一较佳示例中:所述以用户视线基线与用户视线随动影像的交点为中心点,基于预设的注意半径初始值确定注意视区,包括:

26、实时获取环境疲劳因素信息,基于预设的驾驶关键半径默认值和环境疲劳因素信息计算驾驶关键半径初始值;

27、基于驾驶关键半径初始值、历史环境疲劳因素信息和累积驾驶时间,计算当前驾驶关键半径值;

28、基于当前驾驶关键半径值、用户视线基线与用户视线随动影像的交点,确定驾驶关键视区;

29、其中,当前驾驶关键半径值的计算公式为:

30、

31、所述环境疲劳因素信息是指环境中可能对驾驶员疲劳造成影响的环境因素的信息;r1为当前驾驶关键半径值,r0为驾驶关键半径默认值,kx为初始环境疲劳影响系数,i为驾驶时段,t为累积驾驶时间,ky为时段环境疲劳影响系数,kj为各环境疲劳因素的影响系数赋值,kj≤1。

32、通过采用上述技术方案,实时获取环境中可能对驾驶员疲劳造成影响的环境因素的信息,以便根据获取的环境疲劳因素信息和预设的驾驶关键半径默认值计算驾驶关键半径初始值,以便确定驾驶关键视区的初始范围;基于驾驶关键半径初始值、历史的环境疲劳因素信息和累积驾驶时间,评估驾驶员的疲劳累积情况,进而计算当前驾驶关键半径值,其中,驾驶关键半径值与驾驶员的疲劳累积情况负相关,即驾驶员疲劳程度越高时,则需要使其更集中注意观察车辆前方;根据当前驾驶关键半径值从用户视线随动影像中确定驾驶关键视区,以便约束驾驶员在驾驶车辆时的视线朝向。

33、本技术的发明目的二采用如下技术方案实现:

34、一种基于穿戴式智能设备的手势交互系统,应用于上述任一项所述基于穿戴式智能设备的手势交互方法,包括:

35、注意视区确定模块,用于接收穿戴式智能设备获取的用户视线随动影像,识别用户视线基线,以从用户视线随动影像中确定注意视区,所述注意视区至少包括一级视区;

36、交互单元选择模块,用于获取一级视区影像并输入至图像特征识别模型中,识别一级视区影像中的可交互单元,以确定备选控制设备和/或备选控制功能,生成对应的控制选项图形数据并发送至显示组件;

37、手势指令信号发送模块,用于获取用户视线随动影像内的手势图像并输入至预设的手势指令识别模型中,识别对应的手势指令信号并发送至车载智能终端。

38、本技术在一较佳示例中:所述注意视区确定模块包括:

39、视野偏离允许时间评估子模块,用于获取行驶状态信息和道路状态信息并输入至行驶安全性分析模型,以评估视野偏离允许时间;

40、视野偏离计时子模块,用于获取驾驶关键视区影像并输入至图像特征识别模型中,识别驾驶关键视区影像中的安全标记点位是否齐全,当安全标记点位不齐全时开始视野偏离计时;

41、视偏提示指令生成子模块,用于当视野偏离计时达到视野偏离允许时间时,生成视偏提示指令。

42、本技术在一较佳示例中:所述注意视区确定模块包括:

43、视线基线设定子模块,用于接收视线基线设定信号,依次生成若干标准视线偏移图像数据并发送至显示组件;

44、视线分析数据获取子模块,用于获取若干标准视线偏移图像展示时对应的眼动追踪图像并存储至视线分析数据库。

45、本技术的发明目的三采用如下技术方案实现:

46、一种计算机设备,包括存储器、处理器以及存储在所述存储器中并可在所述处理器上运行的计算机程序,所述处理器执行所述计算机程序时实现上述基于穿戴式智能设备的手势交互方法的步骤。

47、本技术的发明目的四采用如下技术方案实现:

48、一种计算机可读存储介质,所述计算机可读存储介质存储有计算机程序,所述计算机程序被处理器执行时实现上述基于穿戴式智能设备的手势交互方法的步骤。

49、综上所述,本技术包括以下至少一种有益技术效果:

50、1.当用户处于驾驶车辆的场景时,不宜花费较长时间进行车辆非核心驾驶功能的控制,因此,接收由穿戴式智能设备获取的用户视线随动影像,以便收集用户视线观察范围内的视觉信息,进一步识别用户视线焦点所在射线,以便根据用户注意力集中的视线区域定义为注意视区;将一级视区内的一级视区影像输入至图像特征识别模型中,以便识别其中的可交互单元,进而判断用户可能需要控制的设备/功能,基于用户可能需要控制的设备/功能生成对应的控制选项图形数据并发送至显示组件,以便用户获知可选的控制功能;获取用户视线随动影像内的手势图像并通过手势指令识别模型进行识别,进而获知用户输入的手势指令信号,将手势指令信号发送至车载智能终端,以对车辆的非核心驾驶功能的控制,从而实现了用户望向欲控制设备或其按钮即可建立穿戴式智能设备与欲控制设备的关联,进而控制对应设备的效果,提高了手势交互功能的交互效率。

51、2.注意视区还包括驾驶关键视区,用于后续评估用户驾驶过程中视线方向是否处于正确方向,获取车辆的实时速度信息和实时方向信息,以便分析车辆当前的行驶安全性状态,进一步获取车道信息、路面类型信息和道路封闭性信息,以便分析当前道路的安全性状态,将行驶状态信息和道路状态信息输入至行驶安全性分析模型,从而综合评估当前车辆行驶的安全性,进而确定视野偏离允许时间;获取驾驶关键视区影像并输入至行驶安全性分析模型中,以识别车辆前窗框的若干个安全标记点位是否均出现在驾驶关键视区影像中,当驾驶关键视区影像中缺失安全标记点位时,开始进行视野偏离计时,以评估用户视线偏离车辆前方的时间;当视野偏离计时达到视野偏离允许时间时,生成视偏提示指令,以便后续提示用户将视线转移至车辆前方,以防因观察不周导致交通事故发生。

52、3.当需要设定新用户的用户视线基线识别算法时,接收视线基线设定信号,依次生成若干个标准视线偏移图像数据并发送至显示组件,以便显示组件依次显示标准视线偏移图像,引导用户将视线偏移至若干个标准角度;获取用户将视线偏移至若干个标准角度时对应的眼动追踪图像并存储至视线分析数据库中,以便用于训练用户视线基线识别算法,以便后续根据用户眼动图像识别用户视线基线的方向。

本文地址:https://www.jishuxx.com/zhuanli/20240911/289810.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表