一种基于相机感知解耦和不确定性建模的人物再识别方法

- 国知局

- 2024-09-11 14:44:59

本发明属于机器人视觉感知和人机交互领域,具体涉及一种相机感知解耦和不确定性建模的无监督领域适应的人物再识别方法。

背景技术:

1、人物再识别(re-id)是机器人视觉感知和人机交互领域的重要问题。由于机器人可能配备有多个角度的相机,拍摄的照片时间、环境与角度各不相同,需要将不同照片的信息相互整合并提取关键信息。机器人人物再识别技术是从机器人多个相机拍摄的画廊图像集合中匹配到查询人物图像。人物再识别技术在公共安全、人机交互与智能助理等领域有着广泛的应用,并且作为机器人视觉感知与处理的重要环节,性能直接关乎着机器人视觉功能是否能很好地运行。近年来,人物再识别技术已经成功应用于广泛的现实世界场景。

2、传统的人物再识别方法主要包括:手工设计的特征提取、度量学习方法、统计建模方法等,随着深度学习的兴起,基于深度神经网络的人物再识别方法受到越来越多的研究学者关注并取得了显著的进展。这些方法使用深度神经网络(deep neural network,dnn)等深度学习模型来提取人物图像的特征,并通过训练大规模的数据集来学习人物的表征。可以将基于深度学习的人物再识别方法大致分为四类,即:基于卷积神经网络的方法、基于循环神经网络的方法、基于注意力机制的方法、基于生成对抗网络的方法。卷积神经网络方法使用预训练的卷积神经网络(convolutional neural networks,cnn)模型,将图像输入网络中进行特征提取并用全连接层或降维方法(如主成分分析)来获得最终的特征表示。基于循环神经网络的方法是使用循环神经网络(recurrent neural networks,rnn)来对人物图像进行建模比如:长短期记忆网络(long short-term memory,lstm)或门控循环单元(gated recurrent unit,gru)来捕捉人物图像的时序信息,该方法可以获取更丰富的特征表示。注意力机制方法通过引入注意力机制来对人物图像的不同区域进行加权,以突出重要的区域最终提高识别的准确性。生成对抗网络的方法是通过训练一个生成器网络和一个判别器网络,前者可以生成具有更好鲁棒性的特征表示,后者则可以更好地评估生成的特征与真实特征之间的差异。然而,上面提到的这些方法主要依赖于手动标记的数据集并且具有较差的泛化性能,限制在现实场景中的应用。为了解决这些问题,越来越多的研究人员自然地将注意力转向无监督域自适应(unsupervised domain adaptation,uda)的人物再识别工作上。已有的uda re-id方法又可以大致分为三类,即中层特征对齐、域风格转移和基于聚类的方法。其中,基于聚类的uda re-id效果最好,通常包括三步,第一步:在标记的源数据集上进行预训练,第二步:通过聚类生成目标数据集的伪标签,第三步:以有监督的方式与目标数据集进行微调。但不同的相机和区域分布,以及需要处理带有噪音的样本都给这一问题带来了新的挑战。使模型提取独立于相机的特征,并对噪声标签具有鲁棒性是重要的研究方向。

技术实现思路

1、本发明着重针对复杂场景中两个重要的挑战:(1)摄像头变换:由于摄像头的差异,包括摄像头属性、摄像头视角和环境信息,具有相同身份的图像可能被归类为不同的类别(拍摄同一个人物却被错误识别为不同的人);(2)域偏移:由于源域和目标域之间存在域差异(带有明确人物标签的照片与缺乏标签的照片的背景环境完全不同),此时简单的进行聚类分配的通常包含错误的标签,会严重误导模型的特征学习和照片中人物识别的正确率,因此我们提出了一种基于相机感知的风格解耦和不确定性建模模型(camera-styleseparation and uncertainty estimation,csue)的无监督领域适应的人物再识别方法。

2、本发明采用的技术方案如下:

3、一种基于相机感知解耦和不确定性建模的人物再识别方法,其步骤包括:

4、1)构建csue模型,所述csue模型包括特征提取模块、相机感知解耦模块、不确定性建模模块、协同教学模块;将机器人所带相机拍摄的照片进行标注,得到一样本并存入源数据集;将所述源数据集中机器人所带相机拍摄的照片的邻居分解为两类和代表由同一相机在不同时刻所拍摄照片组成的集合,代表同一时刻由不同相机在不同角度拍摄的照片所组成的集合;

5、2)利用有标记的源数据集预训练所述csue模型;其中,

6、所述特征提取模块包括两个具有相同架构但不同随机种子的第一协同网络net1和第二协同网络net2;第一轮训练时,对于所述源数据集中机器人所带相机拍摄的一照片,将其分别输入第一协同网络net1和第二协同网络net2得到输出f1、f2,然后将分别输入所述相机感知解耦模块、不确定性建模模块;记录第一协同网络net1、第二协同网络net2在每次迭代训练时的参数取值;后续每一轮训练时,根据第一协同网络net1已完成的各迭代训练时的参数平均值建立第一时间平均网络根据第二协同网络net2已完成的各迭代训练时的参数平均值建立第二时间平均网络对于所述源数据集中机器人所带相机拍摄的一照片将其分别输入到第一协同网络net1、第二协同网络net2、第一时间平均网络和第二时间平均网络得到对应的输出f1、f2和然后将分别输入所述相机感知解耦模块、不确定性建模模块,将输入所述不确定性建模模块;

7、所述相机感知解耦模块包含一存储库m,用于存储所述特征提取模块输出的特征,并以动量的方式更新所述存储库m中的特征,以及计算相机解耦损失lcam所需的信息并将其发送给所述协同教学模块;

8、所述不确定性建模模块,用于对所述特征提取模块输出的特征进行聚类,将每一聚类中的聚类中心特征存储到存储库w,并以动量的方式更新所述存储库w中的聚类中心特征,以及计算识别损失luid、软标签标记损失lusid、三重态损耗lutri和软三重态损失lustri所需的信息并将其发送给所述协同教学模块;

9、所述协同教学模块根据收到的信息计算损失函数l=λ1luid+λ2lusid+λ3lutri+λ4lustri+λ5lcam;然后根据损失函数值优化所述csue模型;λ1,λ2,λ3,λ4,λ5相应的权重因子;

10、3)将机器人拍摄的无标识照片输入预训练后的所述csue模型,得到所述无标识照片的识别结果。

11、进一步的,所述相机感知解耦模块更新特征的方法为:其中,μ∈[0,1]表示控制更新速度的参数,m[i]表示的更新特征;计算与中的照片共享相同身份的概率α是缩放系数,m[j]表示的更新特征,m[k]表示中的照片的更新特征,为所述特征提取模块从照片提取输出的特征;相机解耦损失pi,k为与共享相同身份的概率,wi,j,wi,k是权重系数。

12、进一步的,所述不确定性建模模块计算识别损失luid、软标签标记损失lusid、三重态损耗lutri和软三重态损失lustri所需的信息的方法为:

13、31)计算第j类的平均特征信息w[j]与样本的特征之间的相似性si,得到计算第j类的平均特征信息w[j]与样本的特征之间的相似性sj,得到

14、32)计算sj与之间的差异ui作为样本的不确定性值;

15、33)计算

16、其中,yi为xi标注的标签,xi代表正在处理的样本,p1(yi|xi)代表将xi输入协同网络net1的输出结果通过聚类方法所得聚类结果作为xi的伪标签情况下输出正确标签yi的概率,p2(yi|xi)代表将xi输入协同网络net2的输出结果通过聚类方法所得聚类结果作为xi的伪标签情况下输出正确标签yi的概率;代表将xi输入时间平均网络的输出结果通过聚类方法所得聚类结果作为xi的伪标签情况下输出正确标签yi的概率;代表将xi输入时间平均网络的输出结果通过聚类方法所得聚类结果作为xi的伪标签情况下输出正确标签yi的概率;nt为源数据集中的照片总数;

17、34)针对每一样本,选择与该样本距离最近的k个样本作为锚样本p,将每一锚样本p和其他样本a之间的不确定度优化距离因子设置为其中,dap表示由net1提取的两个样本a,p的特征之间的欧几里得距离,ua代表样本a的不确定性值,up代表锚样本p的不确定性值;eap为由net2提取的两个样本a,p的特征之间的欧几里得距离;表示由提取的两个样本a,p的特征之间的欧几里得距离,表示由提取的两个样本a,p的特征之间的欧几里得距离,dan表示由net1提取的两个样本a,n的特征之间的欧几里得距离,un代表样本n的不确定性值;ean表示由net2提取的两个样本a,n的特征之间的欧几里得距离;表示由提取的两个样本a,n的特征之间的欧几里得距离;表示由提取的两个样本a,n的特征之间的欧几里得距离;

18、34)计算

19、

20、进一步的,

21、进一步的,使用kullback–leibler散度测量sj与之间的差异

22、一种服务器,其特征在于,包括存储器和处理器,所述存储器存储计算机程序,所述计算机程序被配置为由所述处理器执行,所述计算机程序包括用于执行上述方法中各步骤的指令。

23、一种计算机可读存储介质,其上存储有计算机程序,其特征在于,所述计算机程序被处理器执行时实现上述方法的步骤。

24、本发明主要内容包括:

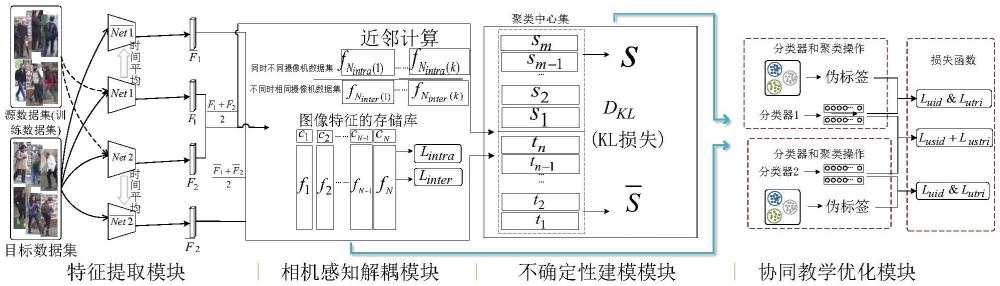

25、1)构建由特征提取模块、相机感知解耦模块、不确定性建模模块、协同教学模块四个部分构成的csue模型;

26、2)利用有标记的源数据集来预训练csue模型包括:特征提取模块,相机感知解耦模块、不确定性建模模块,模型的损失函数利用协同教学模块构建;

27、3)利用已经预训练好csue模型的特征提取模块为想要处理机器人所拍摄的照片中没有标识的数据进行特征提取用于生成伪标签,实现对机器人拍摄的照片特征提取与目标物体的初步标记;

28、4)基于协同教学优化方法,利用已经预训练好csue模型的相机感知解耦(cs)模块、不确定性建模(ue)模块对目标域的伪标签进行微调,完成机器人拍摄的照片中物体的最终标记。

29、进一步地,步骤1)中提到的csue模型如附图1所示。我们提出的csue模型是无监督的方法,步骤2)对应模型基于源数据集的训练过程,步骤3),4)对应模型基于目标数据集的实验过程。

30、进一步地,步骤2)中具体而言,是将带有标签的源数据集分别通过特征提取模块、相机感知解耦(cs)模块、不确定性建模(ue)模块的处理,最后借助模块的输出构造损失函数,以获得预训练的csue模型,具体的训练过程将在下文详细阐述。

31、进一步地,步骤4)中含有的相机感知解耦(cs)模块、不确定性建模(ue)模块是本发明的重要创新点,前者有助于促使网络提取更多独立于相机风格的判别特征,后者探索了基于不确定性驱动的伪标签优化方法,以进一步提升模型的能力。

32、与现有技术相比,本发明的积极效果为:

33、本发明将相机感知解耦和不确定性估计算法应用到人物再识别的问题中,通过预训练并输出伪标签然后再微调标签进一步提高模型输出效果的方法,利用标签的不确定性有助于细化伪标签。特别是在微调部分:通过对特征学习的相机感知约束的设计,网络挖掘出了更多独立于相机的辨别特征;通过充分利用标签的不确定性,模型最终高效的细化了伪标签。值得一提的是,提出的csue模型不会给推理带来额外负担,并且可以灵活地使用现有的网络架构。

本文地址:https://www.jishuxx.com/zhuanli/20240911/292021.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。