大模型部署方法及其装置

- 国知局

- 2024-09-11 15:10:43

本发明涉及人工智能,具体涉及机器学习、在线学习和大语言模型,更具体地,涉及大模型部署方法及其装置。

背景技术:

1、大语言模型(也即大模型)在近年来取得许多进展,许多不同类型的大模型有较好的体现。然而,这种进步也带来了资源消耗增加和训练推理过程中延迟增加的代价,这为大语言模型的实际部署带来挑战。对于不同的用户提问,如何选择一个合适的大模型进行回答是一个需要考虑的问题。

2、在实现本发明构思的过程中,发明人发现目前在问答场景中,缺乏一种比较通用的大模型部署策略,既能基于用户输入的问题快速反馈符合用户需求的答案,还能使问答交互过程中消耗较少的资源。

技术实现思路

1、有鉴于此,本发明提供了一种大模型部署方法及其装置。

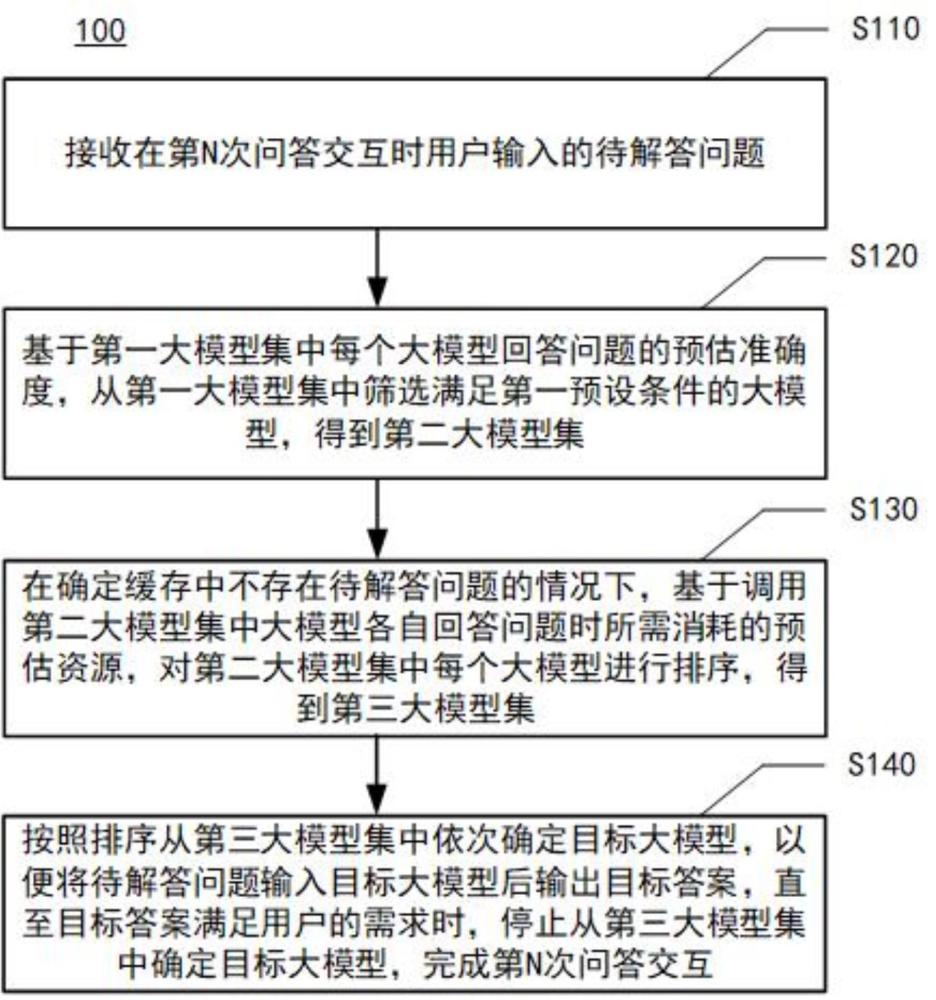

2、本发明的一个方面提供了一种大模型部署方法,包括:接收在第n次问答交互时用户输入的待解答问题;基于第一大模型集中每个大模型回答问题的预估准确度,从第一大模型集中筛选k个大模型,得到第二大模型集,其中,第一大模型集是在第n-1次问答交互中确定的,预估准确度是基于前n-1次问答交互中第一大模型集中每个大模型被调用的次数和被调用后回答问题的答案确定的,k为正整数,且k小于第一大模型集中大模型的个数;在确定缓存中不存在待解答问题,或在确定缓存中存在待解答问题且与待解答问题对应的答案不满足用户需求的情况下,基于调用第二大模型集中大模型各自回答问题时所需消耗的预估资源,对第二大模型集中每个大模型进行排序,得到第三大模型集,其中,缓存中存储有m个已解答问题和与m个已解答问题中每个已解答问题对应的已解答答案,n和m均为大于或者等于1的正整数,预估资源是基于前n-1次问答交互中调用第二大模型集中每个大模型回答问题时的消耗预估得到的;以及按照排序从第三大模型集中依次确定目标大模型,以便将待解答问题输入目标大模型后输出目标答案,直至目标答案满足用户的需求或第三大模型集中k个大模型输出的目标答案均不满足用户的需求时,停止从第三大模型集中确定目标大模型,完成第n次问答交互。

3、根据本发明的实施例,排序包括升序排序,k≥2;按照排序从第三大模型集中依此确定目标大模型,以便将待解答问题输入目标大模型后输出目标答案,直至目标答案满足用户的需求或第三大模型集中k个大模型输出的目标答案均不满足用户的需求时,停止从第三大模型集中确定目标大模型,包括:将升序排序后位于第三大模型集中的第一位大模型,确定为第一目标大模型,以便将待解答问题输入第一目标大模型后输出第一目标答案;将第一目标答案发送至用户,以便用户基于第一目标答案返回第一反馈结果;在确定第一反馈结果表征第一目标答案不满足用户的需求的情况下,将升序排序后位于第三大模型集中的第二位大模型,确定为第二目标大模型,以便将待解答问题输入第二目标大模型后输出第二目标答案,其中,第一目标大模型和第二目标大模型不同;将第二目标答案发送至用户,以便用户基于第二目标答案返回第二反馈结果;在确定第二反馈结果表征第二目标答案满足用户的需求的情况下,停止从第三大模型集中确定目标大模型,完成第n次问答交互;以及在确定第三大模型集中k个大模型均被调用,且k个大模型输出的目标答案均不满足用户的需求的情况下,停止从第三大模型集中确定目标大模型,完成第n次问答交互。

4、根据本发明的实施例,大模型部署方法还包括:针对第二大模型集中每个大模型:分别统计前n-1次问答交互中调用大模型回答问题时的消耗和大模型被调用的次数;以及基于前n-1次问答交互中调用大模型回答问题时的消耗和大模型被调用的次数,确定调用大模型回答问题时所需消耗的预估资源。

5、根据本发明的实施例,基于前n-1次问答交互中调用大模型回答问题时的消耗和大模型被调用的次数,确定调用大模型回答问题时所需消耗的预估资源,包括:根据前n-1次问答交互中调用大模型回答问题时的消耗和大模型被调用的次数的比值,确定平均预估资源;基于预设回答问题的次数、大模型被调用的次数和预设参数,确定用于对平均预估资源进行修正的修正资源;以及根据平均预估资源和修正资源的差值,确定调用大模型回答问题时所需消耗的预估资源。

6、根据本发明的实施例,大模型部署方法还包括:在确定完成第n次问答交互的情况下,基于调用目标大模型回答未解答问题时的消耗,更新前n-1次问答交互中调用目标大模型回答问题时的消耗;更新前n-1次问答交互中调用目标大模型的次数;以及基于更新后的前n-1次问答交互中调用目标大模型回答问题时的消耗和更新后的前n-1次问答交互中调用目标大模型的次数,更新调用目标大模型回答问题时所需消耗的预估资源。

7、根据本发明的实施例,大模型部署方法还包括:针对第一大模型集中每个大模型:分别统计前n-1次问答交互中大模型被调用的次数和大模型被调用后回答问题的答案满足用户需求的次数;以及基于大模型被调用后回答问题的答案满足用户需求的次数和大模型被调用的次数,确定大模型回答问题的预估准确度。

8、根据本发明的实施例,大模型部署方法还包括:在确定完成第n次问答交互的情况下,基于目标答案,更新前n-1次问答交互中目标大模型被调用后回答问题的答案满足用户需求的次数;更新前n-1次问答交互中调用目标大模型的次数;以及基于更新后的前n-1次问答交互中目标大模型被调用后回答问题的答案满足用户需求的次数和更新后的前n-1次问答交互中调用目标大模型的次数,更新目标大模型回答问题的预估准确度。

9、根据本发明的实施例,基于第一大模型集中每个大模型回答问题的预估准确度,从第一大模型集中筛选k个大模型,得到第二大模型集,包括:根据第一大模型集中每个大模型回答问题的预估准确度,对第一大模型集中每个大模型进行降序排序,得到排序结果;以及根据排序结果,从第一大模型集中筛选前k个大模型,得到第二大模型集。

10、根据本发明的实施例,大模型部署方法还包括:采集在历史时间段内产生的p个已解答问题和与p个已解答问题中每个已解答问题对应的已解答答案;确定p个已解答问题中每个已解答问题在历史时间段内产生的概率;从p个已解答问题中筛选概率满足预设条件的m个已解答问题,并将m个已解答问题和与m个已解答问题中每个已解答问题对应的已解答答案存储于缓存中,其中,p≥m,且p为正整数;在确定完成第n次问答交互的情况下,基于目标答案和待解答问题,更新缓存。

11、本发明的另一个方面提供了一种大模型部署装置,包括:接收模块,用于接收在第n次问答交互时用户输入的待解答问题;筛选模块,用于基于第一大模型集中每个大模型回答问题的预估准确度,从第一大模型集中筛选k个大模型,得到第二大模型集,其中,第一大模型集是在第n-1次问答交互中确定的,预估准确度是基于前n-1次问答交互中第一大模型集中每个大模型被调用的次数和被调用后回答问题的答案确定的,k为正整数,且k小于第一大模型集中大模型的个数;排序模块,用于在确定缓存中不存在待解答问题,或在确定缓存中存在待解答问题且与待解答问题对应的答案不满足用户需求的情况下,基于调用第二大模型集中大模型各自回答问题时所需消耗的预估资源,对第二大模型集中每个大模型进行排序,得到第三大模型集,其中,缓存中存储有m个已解答问题和与m个已解答问题中每个已解答问题对应的已解答答案,n和m均为正整数,预估资源是基于前n-1次问答交互中调用第二大模型集中每个大模型回答问题时的消耗预估得到的;以及确定模块,用于按照排序从第三大模型集中依次确定目标大模型,以便将待解答问题输入目标大模型后输出目标答案,直至目标答案满足用户的需求或第三大模型集中k个大模型输出的目标答案均不满足用户的需求时,停止从第三大模型集中确定目标大模型,完成第n次问答交互。

12、根据本发明的实施例,在确定缓存中不存在用户输入的待解答问题的情况下,或在确定缓存中存在待解答问题且与待解答问题对应的答案不满足用户需求的情况下,基于大模型回答问题的准确度,筛选满足条件的大模型集,再基于调用大模型回答问题时所需消耗的资源,对大模型集中的大模型进行排序,从排序后的大模型集中依次确定目标大模型,利用目标大模型对用户输入的待解答问题进行回答。通过缓存机制能够实现只有在缓存中不存在用户输入的待解答问题,或缓存中虽然存在用户输入的待解答问题,但与该待解答问题对应的答案不能满足用户需求时,才需要确定目标大模型,能够借助缓存降低调用大模型回答问题时所需消耗的资源,并能够快速反馈符合用户需求的答案。此外,通过大模型策略选择机制,既考虑大模型回答问题的准确度的问题,还考虑回答问题时所需消耗的资源的问题,由此确定的目标大模型能够准确回答问题,在回答问题时还消耗较少的资源。通过将缓存机制和大模型策略选择机制相结合的大模型部署策略,能够提升用户体验,解决既能基于用户输入的问题快速反馈符合用户需求的答案,还能使问答交互过程中消耗较少的资源的需求问题。

本文地址:https://www.jishuxx.com/zhuanli/20240911/293456.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表