1.本发明属于人工智能技术领域,尤其涉及一种人脸识别安全系统。

背景技术:

2.近年来,人脸识别技术得到长足的发展,一方面是相关支持硬件的运算能力逐步增强,并且云概念在内的相关技术体系也日趋成熟;另一方面则是该领域的算法和产品层出不穷,从客观上成为了推动人脸识别技术伸入应用的重要力量。

3.对于安全领域而言,人脸识别技术有这毋庸置疑的积极价值,具体而言,体现在准确性、高效性以及非接触三个发面,对于准确性方面,理论上,人脸具有独特的属性,无法替代,因此如果能够实现精确识别,必然可以实现更为精确有效的出入管理,这种以人脸本质特征作为工作依据的技术,可以不受外界如光线、色彩、聚焦影响,表现的稳定可靠;其次就是高效性方面,人脸识别技术从物理层面只需要摄像头以及相关通讯设备,软件算法也日趋成熟,因此能够对人脸展开有效识别,实操中,人脸识别主要采取获取、跟组、定位及捕捉几个方面,并且利用三维建模实现对图像的预处理,预处理后的图片清晰、自然,识别率高,通过普通的笔记本即可识别,若采用高性能的服务器,其性能表现更优越;对于非接触而言,无论从卫生角度还是便捷角度看,人脸识别技术都有着得天独厚的优势,一方面不用担心病毒的接触性传染,另一方面因为其隐蔽性为公安部门的侦查工作提供有利的线索。

4.摄像头所拍摄的图像灰度值会受到拍摄状态的光照影响,以人脸这一对象目标为例,随着拍摄环境的光照强度变化,人脸颜色也会发生变化,使得图像中人脸识别更加复杂,因此在对图像进行人脸识别之前需要对人脸图像进行光照补偿处理,现有一般以三原色进行补偿,但只采用三原色进行补偿后色彩的均衡度,还是有所欠缺;

5.现有技术存在原始人脸图像受光照影响的影响,从而导致色彩的均衡度不平衡,进而影响的人脸识别准确度和匹配精度问题。

技术实现要素:

6.本发明提供一种人脸识别安全系统,以解决上述背景技术中提出现有技术存在原始人脸图像受光照影响的影响,从而导致色彩的均衡度不平衡,进而影响的人脸识别准确度和匹配精度问题。

7.本发明所解决的技术问题采用以下技术方案来实现:一种人脸识别安全系统,包括:

8.人脸定位模块:用于将背景图像经预处理后形成人脸轮廓信息,判断人脸轮廓信息中是否存在人脸模型;

9.若存在人脸模型,则基于人脸模型确定人脸轮廓在背景图像中的相对位置,并基于其相对位置确定其轮廓区域;

10.若不存在人脸模型,则无需人脸识别;

11.人脸跟踪模块:用于基于轮廓区域信息,将轮廓区域内的人脸图像从背景图像分

离后形成人脸图像数据;

12.人脸匹配模块:用于基于人脸图像数据,将人脸图像数据与标准人脸数据匹配形成人脸标准图像,通过面部特征提取与比对方法,确定最相似的人脸图像相应人员的身份信息。

13.所述预处理包括:基于获取的原始背景图像,依次通过平均灰度值模型、颜色分量一次模型、颜色分量二次模型的色彩优化,形成优化背景图像;

14.所述平均灰度值模型包括:

[0015][0016]

所述ag为原始背景图像中灰度均值;

[0017]

所述ared为原始背景图像中红色分量均值;

[0018]

所述ayellow为原始背景图像中黄色分量均值;

[0019]

所述agreen为原始背景图像中绿色分量均值;

[0020]

所述ablue为原始背景图像中蓝色分量均值;

[0021]

所述颜色分量一次模型包括:

[0022][0023][0024][0025][0026]

所述t(r)

′

为一次色彩优化后的红色分量的背景图像;

[0027]

所述t(r)为红色分量的原始背景图像;

[0028]

所述t(y)

′

为一次色彩优化后的黄色分量的背景图像;

[0029]

所述t(y)为黄色分量的原始背景图像;

[0030]

所述t(g)

′

为一次色彩优化后的绿色分量的背景图像;

[0031]

所述t(g)为绿色分量的原始背景图像;

[0032]

所述t(b)

′

为一次色彩优化后的蓝色分量的背景图像;

[0033]

所述t(b)为蓝色分量的原始背景图像;

[0034]

若t(r)

′

》255,则t(r)

″

=maxt(r);

[0035]

若t(y)

′

》255,则t(y)

″

=maxt(y);

[0036]

若t(g)

′

》255,则t(g)

″

=maxt(g);

[0037]

若t(b)

′

》255,则t(b)

″

=maxt(b);

[0038]

所述t(r)

″

为二次色彩优化后的红色分量的背景图像;

[0039]

所述t(y)

″

为二次色彩优化后的红色分量的背景图像;

[0040]

所述t(g)

″

为二次色彩优化后的红色分量的背景图像;

[0041]

所述t(b)

″

为二次色彩优化后的红色分量的背景图像;

[0042]

所述maxt(r)、maxt(y)、maxt(g)、maxt(b)分别为图像色彩的峰值。

[0043]

进一步:

[0044]

所述面部特征提取与比对方法包括:

[0045]

提取原始图像特征:提取人脸标准图像内的面部信息特征形成原始面部特征模型;

[0046]

提取目标图像特征:提取已知身份的人脸特征信息库的人脸目标图像内的面部信息特征形成对应的目标面部特征模型;

[0047]

比对遴选人脸图像:将原始面部特征模型与目标面部特征模型通过模式匹配遴选方法优选出与面部特征模型最相似的人脸图像。

[0048]

更进一步:

[0049]

所述模式匹配遴选方法包括:

[0050]

人脸相似度匹配:基于原始面部特征模型与目标面部特征模型,通过人脸相似度匹配模型生成匹配相似度参数;

[0051]

人脸相似度匹配模型:

[0052][0053]

所述sim为人脸相似度参数;

[0054]

所述vi为原始面部特征与目标面部特征参数相似量;

[0055]

所述vj为原始面部特征特征量;

[0056]

所述vh为目标面部特征特征量;

[0057]

所述n为比对特征总特征量;

[0058]

人脸相似度判定:基于匹配相似度参数,通过标准比对模型,判定人脸相似度程度,并将当前目标面部特征模型确定为最相似的人脸图像;

[0059]

标准比对模型:

[0060]

sim>k(k>0)

‑‑‑

match

[0061]

sim<k(k>0)

‑‑‑

mismatch;

[0062]

所述k为相似度阈值;

[0063]

若人脸相似度大于相似度阈值,则判定人脸相似度程度为匹配;

[0064]

若人脸相似度小于相似度阈值,则判定人脸相似度程度为不匹配;

[0065]

更进一步:

[0066]

所述人脸相似度判定还包括:

[0067]

确定匹配时间:通过人脸匹配时间模型,确定匹配为最相似的人脸图像的所需匹配时间;

[0068]

人脸匹配时间模型:

[0069][0070]

所述tmat为人脸匹配时间;

[0071]

匹配精度判定:基于最相似的人脸图像的所需匹配时间,通过时间判定模型,判定

人脸图像匹配精度;

[0072]

时间判定模型:

[0073]

tmat<tk‑‑‑

high precision;

[0074]

所述tk为匹配时间阈值;

[0075]

若人脸匹配时间小于匹配时间阈值,则确定最相似的人脸图像的所需匹配为高精度匹配。

[0076]

进一步:

[0077]

所述人脸识别安全系统还包括情绪评估模块,包括:

[0078]

网格形成子模块:用于将背景图像分离后的人脸图像分割为网格图像,将网格图像的每个网格形成网格像素矩阵;

[0079]

特征提取子模块:用于将背景图像分离后的人脸图像选择若干特征点,以特征点为中心以4厘米为半径形成包含不超过2个特征点的表情变化特征区域;

[0080]

平面模型子模块:用于基于每个表情变化特征区域包含的相应的网格像素矩阵,通过平面向量归类模型和平面方向归类模型分别形成由平面向量集合和平面方向集合组成的平面表情组合;

[0081]

三维模型子模块:用于基于平面向量集合和平面方向集合,通过三维向量组归类模型和三维方向组归类模型分别形成由三维向量组集合和三维方向组集合的三维表情组合;

[0082]

评估对比模块:用于基于三维表情组合,将表情变化特征区域通过权值分配处理形成各特征区域情绪评估综合分值,将各特征区域情绪评估综合分值与标准三维区域情绪模型库进行比对,确定被测者当前情绪状态。

[0083]

更进一步:

[0084]

所述平面向量归类模型:

[0085]

x方向向量模型:

[0086][0087]

所述dx为任一x方向向量;

[0088]

所述x

t1

为任一x方向t1时刻起点坐标;

[0089]

所述x

t2

为任一x方向t2时刻终点坐标;

[0090]

x方向模型:

[0091]

qx=arctan(x

t1

/x

t2

);

[0092]

所述qx为任一x方向度;

[0093]

所述x

t1

为任一x方向t1时刻起点方向;

[0094]

所述x

t2

为任一x方向t2时刻终点方向;

[0095]

更进一步:

[0096]

y方向向量模型:

[0097][0098]

所述dy为任一y方向向量;

[0099]

所述y

t1

为任一y方向t1时刻起点坐标;

[0100]

所述y

t2

为任一y方向t2时刻终点坐标;

[0101]

所述平面方向归类模型:

[0102]

y方向模型:

[0103]

qy=arctan(y

t1

/y

t2

);

[0104]

所述qy为任一y方向度;

[0105]

所述y

t1

为任一y方向t1时刻起点方向;

[0106]

所述y

t2

为任一y方向t2时刻终点方向;

[0107]

更进一步:

[0108]

所述三维向量组归类模型:

[0109][0110][0111]

所述dxyz为任一xyz方向组向量;

[0112]

所述dx为任一x方向组向量;

[0113]

所述dy为任一y方向组向量;

[0114]

所述dz为任一z方向组向量;

[0115]

所述三维方向组归类模型:

[0116][0117]

所述qxyz为任一xyz方向组方向度;

[0118]

更进一步:

[0119]

所述权值分配处理包括:

[0120]

若三维向量组集合的当前表情变化特征区域的三维向量组变化范围大于向量组变化平均变化阈值,则判定当前表情变化特征区域确定是三维向量变化区域;

[0121]

若三维向量组集合的当前表情变化特征区域的三维方向组变化范围大于方向组变化平均变化阈值,则判定当前表情变化特征区域确定是三维方向变化区域;

[0122]

若当前表情变化特征区域是三维向量变化区域,且是三维方向变化区域,则判定当前表情变化特征区域是表情变化高权值特征区域,并根据其变化幅度赋予其子特征区域相应的高表情变化权值,且将各子特征区域的高表情变化权值通过高变化权值拟合模型形成表情变化高权值特征值;

[0123]

否则,判定当前表情变化特征区域是表情变化高权值特征区域,并赋予其子特征区域相应的固定的低表情变化权值,且将各子特征区域的低表情变化权值通过低变化权值拟合模型形成表情变化低权值特征值;

[0124]

将表情变化高权值特征值和表情变化低权值特征值通过评估综合分值拟合模型形成相应的特征区域情绪评估综合分值。

[0125]

将各特征区域情绪评估综合分值与标准三维区域情绪模型库的进行比对,确定被测者当前情绪状态。

[0126]

更进一步:

[0127]

所述高变化权值拟合模型:

[0128][0129]

所述ahi为表情变化高权值特征值;

[0130]

所述ahscalej为任一子特征区域的高表情变化权值;

[0131]

所述低变化权值拟合模型:

[0132]

ali=alscalej×

n;

[0133]

所述ali为表情变化高权值特征值;

[0134]

所述alscalej为任一子特征区域的高表情变化权值;

[0135]

所述评估综合分值拟合模型:

[0136]

aalli=ahi ali;

[0137]

所述aalli任一特征区域的高表情变化权值。

[0138]

本发明的有益效果为:

[0139]

本专利采用人脸定位模块、人脸跟踪模块、人脸匹配模块的应用,还包括所述预处理包括:基于获取的原始背景图像,依次通过平均灰度值模型、颜色分量一次模型、颜色分量二次模型的色彩优化,形成优化背景图像,由于首先,人脸定位模块的应用是人脸识别的第一步,是指在输入图像中确定所有人脸(如果存在)的位置、大小和姿态的过程,根据特征的色彩性质可以将其分为基于肤色特征的方法和基于灰度的特征方法,本案基于灰度特征进行检测,捕获原始图像中的人脸轮廓并建立模型,为人脸跟踪提供定位支持;人脸跟踪模块的应用,该应用基于人脸定位,由于在静止图像中定位了人脸轮廓,这是可以基于该人脸轮廓在视频序列中进行延伸,其跟踪过程往往是在起始帧中检测人脸并记录其位置和大小的轮廓,然后根据该定位预测当前视频图像中每一帧的搜索区域,并在搜索区域内进行检测,如此重复以上步骤,实现人脸的持续跟踪;人脸匹配模块,对特征人脸图像进行匹配,需要对原始图像中的人脸模型与人脸数据库中,从而找到匹配结果,在匹配的过程中,需要进行面部特征提取方法和面部特征比对方法,也就是说将提取到的原始人脸图像的面部特征与数据库中存在的备案的标准面部特征进行比对分析,根据计算的特征相似度与相似度衡量标准进行比较,从而完成人脸匹配,其次,在人脸定位、人脸跟踪、人脸匹配中存在相应的图像边缘检测算法、图像分割算法、模式匹配与模式识别算法三个算法,图像边缘检测算法:就是在图像上灰度变化较大较明显的地方,对图像各像素点进行求微分或二阶微分来定位边缘像素点,由灰度变化的特点,可将边缘类型分为阶梯状、脉冲状和屋顶状,对于阶梯状,图像边缘对应一阶微分图像的峰值和二阶微分图像的零交叉处,对于脉冲状和屋顶状边缘,边缘点对应一阶导数的零交叉和二阶导数的峰值;图像分割算法:在对处理后的图像数据进行分析之前,图像分割是最重要的步骤之一,其主要采用阈值分割法,该分割法是一种基于区域的图像分割技术,原理是过设定不同的特征阈值,把图像像素点分为若干类,这种方法也可以看成是动态抠图技术;模式匹配与模式识别:其特点就是原始图像的关键特征与数据库中存在的备案的标准关键特征进行比对分析,从而确定匹配程度和确定人脸图像中人的身份,同时基于上述图像识别技术,在人脸定位还进行了预处理操作,本方案中的预处理操作包括:平均灰度值模型、颜色分量一次模型、颜色分量二次模型,其中平均灰度值模型,对原始图像进行均值化处理,传统的预处理采用r、g、b三原色处理,这种处理的

图像虽然的色彩对比度和亮度方面较好,但其色彩均衡度的表现并不理想,由于其色彩均衡度的欠缺,直接影响后续灰度阈值的确定,从而影响人脸轮廓的精度,因此,本案采用四元色(即r、y、g、b)代替三元色进行优化,基于四元色的优化比三元色的优化,灰度变化更明显,更适合基于灰度值变化特征进行边缘检测,如:就是对红、黄、绿和蓝色进行均值处理,同理,本方案在基于四元色的均值化的基础上,进行颜色分量一次模型变换和颜色分量二次模型变换,第一次优化是将分别将四元色的原图分别进行色彩变换,该变换的核心就是在四张元色原图上分别乘以分量均值,从而提高该色彩原图的色彩均衡度,如就是将红色元图上增量红色分量,其他黄、绿和蓝元图依照此规律,再接下来就是第二次优化,第二次优化是在第一颜色分量基础上,如果超出可是范围进行再次优化,如该元色的最高比例值为255,但出现258就超出的元图的色彩尺度,因此必须对其进行纠正,本方案采取的纠正策略就是将超出部分拉回到其最高值,这样处理的好处在于节省运算的成本,若在大数据运算中,除法的运算将产生大量的浮点运算,这样的运算在大数据处理下,是不和适宜的,如若t(r)

′

》255,则t(r)

″

=maxt(r);通过对人脸定位应用、人脸跟踪应用、人脸匹配应用,实现了对人脸的识别与身份认证,通过预处理中的平均灰度值模型应用、颜色分量一次模型应用、颜色分量二次模型应用,对人脸中每一个像素的四个颜色分量分别进行重构,实现了对原始图像进行自适应的光照亮度补偿,从而减少环境干扰因素对任亮识别的影响和干扰。

附图说明

[0140]

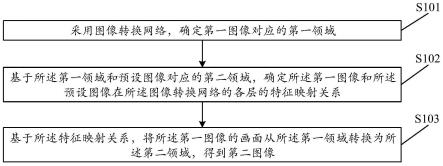

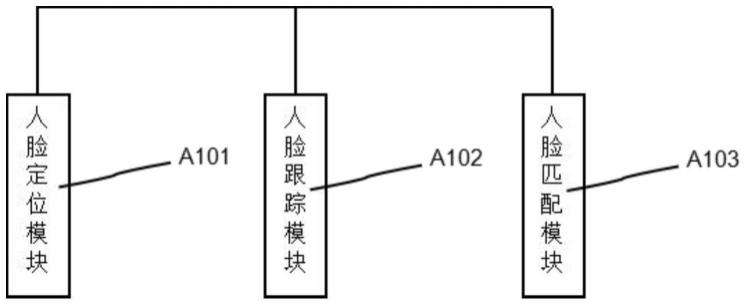

图1是本发明一种人脸识别安全系统的模块结构图;

[0141]

图2是本发明一种人脸识别安全系统的系统流程图;

[0142]

图3是本发明一种人脸识别安全系统的预处理流程图;

[0143]

图4是本发明一种人脸识别安全系统的面部特征提取与比对方法的基本流程图;

[0144]

图5是本发明一种人脸识别安全系统的面部特征提取与比对方法的具体流程图;

[0145]

图6是本发明一种人脸识别安全系统的模式匹配遴选方法的方法流程图;

[0146]

图7是本发明一种人脸识别安全系统的人脸相似度判定的方法流程图;

[0147]

图8是本发明一种人脸识别安全系统的情绪评估模块的模块结构图;

[0148]

图9是本发明一种人脸识别安全系统的情绪评估模块的模块流程图;

[0149]

图10是本发明一种人脸识别安全系统的权值分配处理的方法流程图;

具体实施方式

[0150]

以下结合附图对本发明做进一步描述:

[0151]

图中:

[0152]

a101-人脸定位模块;a102-人脸跟踪模块;a103-人脸匹配模块;

[0153]

a201-网格形成子模块;a202-特征提取子模块;a203-平面模型子模块;a204-三维模型子模块;a205-评估对比模块;

[0154]

s101-将背景图像经预处理后形成人脸轮廓信息,判断人脸轮廓信息中是否存在

人脸模型;

[0155]

s102-若存在人脸模型;

[0156]

s103-基于人脸模型确定人脸轮廓在背景图像中的相对位置,并基于其相对位置确定其轮廓区域;

[0157]

s104-无需人脸识别;

[0158]

s105-基于轮廓区域信息,将轮廓区域内的人脸图像从背景图像分离后形成人脸图像数据;

[0159]

s106-基于人脸图像数据,将人脸图像数据与标准人脸数据匹配形成人脸标准图像,通过面部特征提取与比对方法,确定最相似的人脸图像相应人员的身份信息;

[0160]

s201-基于获取的原始背景图像;

[0161]

s202-依次通过平均灰度值模型、颜色分量一次模型、颜色分量二次模型的色彩优化;

[0162]

s203-形成优化背景图像;

[0163]

s301-提取原始图像特征;

[0164]

s302-提取目标图像特征;

[0165]

s303-比对遴选人脸图像;

[0166]

s401-提取人脸标准图像内的面部信息特征形成原始面部特征模型;

[0167]

s402-提取已知身份的人脸特征信息库的人脸目标图像内的面部信息特征形成对应的目标面部特征模型;

[0168]

s403-将原始面部特征模型与目标面部特征模型通过模式匹配遴选方法优选出与面部特征模型最相似的人脸图像;

[0169]

s501-人脸相似度匹配:基于原始面部特征模型与目标面部特征模型,通过人脸相似度匹配模型生成匹配相似度参数;

[0170]

s502-人脸相似度判定:基于匹配相似度参数,通过标准比对模型,判定人脸相似度程度,并将当前目标面部特征模型确定为最相似的人脸图像;

[0171]

s601-确定匹配时间:通过人脸匹配时间模型,确定匹配为最相似的人脸图像的所需匹配时间;

[0172]

s602-匹配精度判定:基于最相似的人脸图像的所需匹配时间,通过时间判定模型,判定人脸图像匹配精度;

[0173]

s603-若人脸匹配时间小于匹配时间阈值,则确定最相似的人脸图像的所需匹配为高精度匹配;

[0174]

s701-将背景图像分离后的人脸图像分割为网格图像,将网格图像的每个网格形成网格像素矩阵;

[0175]

s702-将背景图像分离后的人脸图像选择若干特征点,以特征点为中心以4厘米为半径形成包含不超过2个特征点的表情变化特征区域;

[0176]

s703-基于每个表情变化特征区域包含的相应的网格像素矩阵,通过平面向量归类模型和平面方向归类模型分别形成由平面向量集合和平面方向集合组成的平面表情组合;

[0177]

s704-基于平面向量集合和平面方向集合,通过三维向量组归类模型和三维方向

组归类模型分别形成由三维向量组集合和三维方向组集合的三维表情组合;

[0178]

s705-基于三维表情组合,将表情变化特征区域通过权值分配处理形成各特征区域情绪评估综合分值,将各特征区域情绪评估综合分值与标准三维区域情绪模型库进行比对,确定被测者当前情绪状态;

[0179]

s801-若三维向量组集合的当前表情变化特征区域的三维向量组变化范围大于向量组变化平均变化阈值,则判定当前表情变化特征区域确定是三维向量变化区域;

[0180]

s802-若三维向量组集合的当前表情变化特征区域的三维方向组变化范围大于方向组变化平均变化阈值,则判定当前表情变化特征区域确定是三维方向变化区域;

[0181]

s803-若当前表情变化特征区域是三维向量变化区域,且是三维方向变化区域;

[0182]

s804-则判定当前表情变化特征区域是表情变化高权值特征区域,并根据其变化幅度赋予其子特征区域相应的高表情变化权值,且将各子特征区域的高表情变化权值通过高变化权值拟合模型形成表情变化高权值特征值;

[0183]

s805-判定当前表情变化特征区域是表情变化高权值特征区域,并赋予其子特征区域相应的固定的低表情变化权值,且将各子特征区域的低表情变化权值通过低变化权值拟合模型形成表情变化低权值特征值;

[0184]

s806-将表情变化高权值特征值和表情变化低权值特征值通过评估综合分值拟合模型形成相应的特征区域情绪评估综合分值;

[0185]

s807-将各特征区域情绪评估综合分值与标准三维区域情绪模型库的进行比对,确定被测者当前情绪状态;

[0186]

实施例:

[0187]

实施例一:如图1、2所示,一种人脸识别安全系统,包括:

[0188]

人脸定位模块a101:用于将背景图像经预处理后形成人脸轮廓信息,判断人脸轮廓信息中是否存在人脸模型s101;

[0189]

若存在人脸模型s102,则基于人脸模型确定人脸轮廓在背景图像中的相对位置,并基于其相对位置确定其轮廓区域s103;

[0190]

若不存在人脸模型,则无需人脸识别s104;

[0191]

人脸跟踪模块a102:用于基于轮廓区域信息,将轮廓区域内的人脸图像从背景图像分离后形成人脸图像数据s105;

[0192]

人脸匹配模块a103:用于基于人脸图像数据,将人脸图像数据与标准人脸数据匹配形成人脸标准图像,通过面部特征提取与比对方法,确定最相似的人脸图像相应人员的身份信息s106。

[0193]

如图3所示,所述预处理包括:基于获取的原始背景图像s201,依次通过平均灰度值模型、颜色分量一次模型、颜色分量二次模型的色彩优化s202,形成优化背景图像s203;

[0194]

所述平均灰度值模型包括:

[0195][0196]

所述ag为原始背景图像中灰度均值;

[0197]

所述ared为原始背景图像中红色分量均值;

[0198]

所述ayellow为原始背景图像中黄色分量均值;

[0199]

所述agreen为原始背景图像中绿色分量均值;

[0200]

所述ablue为原始背景图像中蓝色分量均值;

[0201]

所述颜色分量一次模型包括:

[0202][0203][0204][0205][0206]

所述t(r)

′

为一次色彩优化后的红色分量的背景图像;

[0207]

所述t(r)为红色分量的原始背景图像;

[0208]

所述t(y)

′

为一次色彩优化后的黄色分量的背景图像;

[0209]

所述t(y)为黄色分量的原始背景图像;

[0210]

所述t(g)

′

为一次色彩优化后的绿色分量的背景图像;

[0211]

所述t(g)为绿色分量的原始背景图像;

[0212]

所述t(b)

′

为一次色彩优化后的蓝色分量的背景图像;

[0213]

所述t(b)为蓝色分量的原始背景图像;

[0214]

所述颜色分量二次模型包括:

[0215]

若t(r)

′

》255,则t(r)

″

=maxt(r);

[0216]

若t(y)

′

》255,则t(y)

″

=maxt(y);

[0217]

若t(g)

′

》255,则t(g)

″

=maxt(g);

[0218]

若t(b)

′

》255,则t(b)

″

=maxt(b);

[0219]

所述t(r)

″

为二次色彩优化后的红色分量的背景图像;

[0220]

所述t(y)

″

为二次色彩优化后的红色分量的背景图像;

[0221]

所述t(g)

″

为二次色彩优化后的红色分量的背景图像;

[0222]

所述t(b)

″

为二次色彩优化后的红色分量的背景图像;

[0223]

所述maxt(r)、maxt(y)、maxt(g)、maxt(b)分别为图像色彩的峰值。

[0224]

采用人脸定位模块、人脸跟踪模块、人脸匹配模块的应用,还包括所述预处理包括:基于获取的原始背景图像,依次通过平均灰度值模型、颜色分量一次模型、颜色分量二次模型的色彩优化,形成优化背景图像,由于首先,人脸定位模块的应用是人脸识别的第一步,是指在输入图像中确定所有人脸(如果存在)的位置、大小和姿态的过程,根据特征的色彩性质可以将其分为基于肤色特征的方法和基于灰度的特征方法,本案基于灰度特征进行检测,捕获原始图像中的人脸轮廓并建立模型,为人脸跟踪提供定位支持;人脸跟踪模块的应用,该应用基于人脸定位,由于在静止图像中定位了人脸轮廓,这是可以基于该人脸轮廓在视频序列中进行延伸,其跟踪过程往往是在起始帧中检测人脸并记录其位置和大小的轮廓,然后根据该定位预测当前视频图像中每一帧的搜索区域,并在搜索区域内进行检测,如此重复以上步骤,实现人脸的持续跟踪;人脸匹配模块,对特征人脸图像进行匹配,需要对

原始图像中的人脸模型与人脸数据库中,从而找到匹配结果,在匹配的过程中,需要进行面部特征提取方法和面部特征比对方法,也就是说将提取到的原始人脸图像的面部特征与数据库中存在的备案的标准面部特征进行比对分析,根据计算的特征相似度与相似度衡量标准进行比较,从而完成人脸匹配,其次,在人脸定位、人脸跟踪、人脸匹配中存在相应的图像边缘检测算法、图像分割算法、模式匹配与模式识别算法三个算法,图像边缘检测算法:就是在图像上灰度变化较大较明显的地方,对图像各像素点进行求微分或二阶微分来定位边缘像素点,由灰度变化的特点,可将边缘类型分为阶梯状、脉冲状和屋顶状,对于阶梯状,图像边缘对应一阶微分图像的峰值和二阶微分图像的零交叉处,对于脉冲状和屋顶状边缘,边缘点对应一阶导数的零交叉和二阶导数的峰值;图像分割算法:在对处理后的图像数据进行分析之前,图像分割是最重要的步骤之一,其主要采用阈值分割法,该分割法是一种基于区域的图像分割技术,原理是过设定不同的特征阈值,把图像像素点分为若干类,这种方法也可以看成是动态抠图技术;模式匹配与模式识别:其特点就是原始图像的关键特征与数据库中存在的备案的标准关键特征进行比对分析,从而确定匹配程度和确定人脸图像中人的身份,同时基于上述图像识别技术,在人脸定位还进行了预处理操作,本方案中的预处理操作包括:平均灰度值模型、颜色分量一次模型、颜色分量二次模型,其中平均灰度值模型,对原始图像进行均值化处理,传统的预处理采用r、g、b三原色处理,这种处理的图像虽然的色彩对比度和亮度方面较好,但其色彩均衡度的表现并不理想,由于其色彩均衡度的欠缺,直接影响后续灰度阈值的确定,从而影响人脸轮廓的精度,因此,本案采用四元色(即r、y、g、b)代替三元色进行优化,基于四元色的优化比三元色的优化,灰度变化更明显,更适合基于灰度值变化特征进行边缘检测,如:就是对红、黄、绿和蓝色进行均值处理,同理,本方案在基于四元色的均值化的基础上,进行颜色分量一次模型变换和颜色分量二次模型变换,第一次优化是将分别将四元色的原图分别进行色彩变换,该变换的核心就是在四张元色原图上分别乘以分量均值,从而提高该色彩原图的色彩均衡度,如就是将红色元图上增量红色分量,其他黄、绿和蓝元图依照此规律,再接下来就是第二次优化,第二次优化是在第一颜色分量基础上,如果超出可是范围进行再次优化,如该元色的最高比例值为255,但出现258就超出的元图的色彩尺度,因此必须对其进行纠正,本方案采取的纠正策略就是将超出部分拉回到其最高值,这样处理的好处在于节省运算的成本,若在大数据运算中,除法的运算将产生大量的浮点运算,这样的运算在大数据处理下,是不和适宜的,如若t(r)

′

》255,则t(r)

″

=maxt(r);通过对人脸定位应用、人脸跟踪应用、人脸匹配应用,实现了对人脸的识别与身份认证,通过预处理中的平均灰度值模型应用、颜色分量一次模型应用、颜色分量二次模型应用,对人脸中每一个像素的四个颜色分量分别进行重构,实现了对原始图像进行自适应的光照亮度补偿,从而减少环境干扰因素对任亮识别的影响和干扰。

[0225]

如图4、5所示,所述面部特征提取与比对方法包括:

[0226]

提取原始图像特征s301:提取人脸标准图像内的面部信息特征形成原始面部特征模型s401;

[0227]

提取目标图像特征s302:提取已知身份的人脸特征信息库的人脸目标图像内的面

部信息特征形成对应的目标面部特征模型s402;

[0228]

比对遴选人脸图像s303:将原始面部特征模型与目标面部特征模型通过模式匹配遴选方法优选出与面部特征模型最相似的人脸图像s403。

[0229]

采用所述面部特征提取与比对方法包括:提取原始图像特征:提取人脸标准图像内的面部信息特征形成原始面部特征模型;提取目标图像特征:提取已知身份的人脸特征信息库的人脸目标图像内的面部信息特征形成对应的目标面部特征模型;比对遴选人脸图像:将原始面部特征模型与目标面部特征模型通过模式匹配遴选方法优选出与面部特征模型最相似的人脸图像,由于面部特征提取与比对,就是对原始人脸特征与目标人脸特征进行的对比,这样就需要提取原始人脸特征和目标人脸特征,然后将原始人脸特征和目标人脸特征进行对比,根据人脸相似度匹配模型进行相似度计算,根据相似度计算的结果判定人脸相似度匹配程度,最终识别人员的身份。

[0230]

如图6所示,所述模式匹配遴选方法包括:

[0231]

人脸相似度匹配:基于原始面部特征模型与目标面部特征模型,通过人脸相似度匹配模型生成匹配相似度参数s501;

[0232]

人脸相似度匹配模型:

[0233][0234]

所述sim为人脸相似度参数;

[0235]

所述vi为原始面部特征与目标面部特征参数相似量;

[0236]

所述vj为原始面部特征特征量;

[0237]

所述vh为目标面部特征特征量;

[0238]

所述n为比对特征总特征量;

[0239]

人脸相似度判定:基于匹配相似度参数,通过标准比对模型,判定人脸相似度程度,并将当前目标面部特征模型确定为最相似的人脸图像s502;

[0240]

标准比对模型:

[0241]

sim>k(k>0)

‑‑‑

match

[0242]

sim<k(k>0)

‑‑‑

mismatch;

[0243]

所述k为相似度阈值;

[0244]

若人脸相似度大于相似度阈值,则判定人脸相似度程度为匹配;

[0245]

若人脸相似度小于相似度阈值,则判定人脸相似度程度为不匹配;

[0246]

采用人脸相似度匹配模型(即)进行相似度计算,通过标准比对模型(即进行相似度判断,最终得出结论(即若人脸相似度大于相似度阈值,则判定人脸相似度程度为匹配;若人脸相似度小于相似度阈值,则判定人脸相似度程度为不匹配;),其中在人脸相似度匹配模型vi就是相似点的拟合数量,关于相似点的判断实际就是数据对比和判定的过程,通过该过程可以获取相似点数量(即vi),通过相似点数量、原始面部特征特征量、目标面部特征特征量、比对特征总特征量的多点拟

合,从而得出相似度参数,获取了相似度参数就可以和阈值k进行比较,最终得出是否具有相似性的判定。

[0247]

如图7所示,所述人脸相似度判定还包括:

[0248]

确定匹配时间:通过人脸匹配时间模型,确定匹配为最相似的人脸图像的所需匹配时间s601;

[0249]

人脸匹配时间模型:

[0250][0251]

所述tmat为人脸匹配时间;

[0252]

匹配精度判定:基于最相似的人脸图像的所需匹配时间,通过时间判定模型,判定人脸图像匹配精度s602;

[0253]

时间判定模型:

[0254]

tmat<tk‑‑‑

high precision;

[0255]

所述tk为匹配时间阈值;

[0256]

若人脸匹配时间小于匹配时间阈值,则确定最相似的人脸图像的所需匹配为高精度匹配s603。

[0257]

采用所述人脸相似度判定还包括:确定匹配时间:通过人脸匹配时间模型,确定匹配为最相似的人脸图像的所需匹配时间,匹配精度判定:基于最相似的人脸图像的所需匹配时间,通过时间判定模型,判定人脸图像匹配精度,其中包括两个模型,一个为人脸匹配时间模型(即),另一个为时间判定模型(即tmat<tk‑‑‑

high precision),由于人脸匹配的时间在匹配的过程中非常重要的参数,假设一个成熟的比较算法,他的比对时间应该是一个相对固定的均值,匹配时间过长,反映的是匹配的复杂度高,造成复杂度高的原因,有可能是原图不清晰、算法问题,但最主要的比对相似度不高,基于这种比较相似度不高的情况,就存在很大的比对风险,这种比对风险就是造成误判断的情况,因此通过,本方案设置了一个比较阈值tk,当超过该比较阈值tk,就要存在比较风险,从而进行规避风险的算法,通过匹配时间的判定,能更好的确定匹配的辨识度,从而提高匹配的精度。

[0258]

如图8、9所示,所述人脸识别安全系统还包括情绪评估模块,包括:

[0259]

网格形成子模块a201:用于将背景图像分离后的人脸图像分割为网格图像,将网格图像的每个网格形成网格像素矩阵s701;

[0260]

特征提取子模块a202:用于将背景图像分离后的人脸图像选择若干特征点,以特征点为中心以4厘米为半径形成包含不超过2个特征点的表情变化特征区域s702;

[0261]

平面模型子模块a203:用于基于每个表情变化特征区域包含的相应的网格像素矩阵,通过平面向量归类模型和平面方向归类模型分别形成由平面向量集合和平面方向集合组成的平面表情组合s703;

[0262]

三维模型子模块a204:用于基于平面向量集合和平面方向集合,通过三维向量组归类模型和三维方向组归类模型分别形成由三维向量组集合和三维方向组集合的三维表

情组合s704;

[0263]

评估对比模块a205:用于基于三维表情组合,将表情变化特征区域通过权值分配处理形成各特征区域情绪评估综合分值,将各特征区域情绪评估综合分值与标准三维区域情绪模型库进行比对,确定被测者当前情绪状态s705。

[0264]

采用所述人脸识别安全系统还包括情绪评估模块,包括:网格形成子模块:用于将背景图像分离后的人脸图像分割为网格图像,将网格图像的每个网格形成网格像素矩阵;特征提取子模块:用于将背景图像分离后的人脸图像选择若干特征点,以特征点为中心以4厘米为半径形成包含不超过2个特征点的表情变化特征区域;平面模型子模块:用于基于每个表情变化特征区域包含的相应的网格像素矩阵,通过平面向量归类模型和平面方向归类模型分别形成由平面向量集合和平面方向集合组成的平面表情组合;三维模型子模块:用于基于平面向量集合和平面方向集合,通过三维向量组归类模型和三维方向组归类模型分别形成由三维向量组集合和三维方向组集合的三维表情组合;评估对比模块:用于基于三维表情组合,将表情变化特征区域通过权值分配处理形成各特征区域情绪评估综合分值,将各特征区域情绪评估综合分值与标准三维区域情绪模型库进行比对,确定被测者当前情绪状态,由于本方案不仅对人脸进行判定,同时还对该人脸信息和参数进行进一步的识别,通过识别人脸的表情,可以确定该人脸的心理活动和当时状态,从而进一步提高安全性,本方案在表情识别的过程中,共包括网格形成子模块、特征提取子模块、平面模型子模块、三维模型子模块、评估对比模块,其中,网格形成应用:像分成网格结构,网格间具有若干网格点,其中,包括mxm个小网格,每个小网格包含nxn个像素点,最终形成一个网格像素矩阵,网格像素矩阵中就是包含像素的数据;特征提取应用:将具有网格的图像人工标注若干个特征点,根据这些特征点为中心,形成特征区域,如眼睛特征区、鼻子特征区、嘴巴特征区,形成一个多特征多维度的立体结构;平面模型应用:就是建立一个进行平面模型建立,该平面模型中包括两个子模型(即平面向量和平面方向),因为一个立体模型是由若干横向和纵向的平面模型组成的,因此,为构造立体模型做好了应用的准备;三维模型应用:是平面模型的集合,借助这个三维集合可以进行评估对比;评估比对应用:包括权值分配、权值计算、以及评估的过程,综上所述,本方案进行抽象性的归类,共包括平面静态特征提取、三维序列静态特征提取以及情绪评估综合,最终通过分类表情分数的对比,识别被试者当时的情绪状态和表情。

[0265]

所述平面向量归类模型:

[0266]

x方向向量模型:

[0267][0268]

所述dx为任一x方向向量;

[0269]

所述x

t1

为任一x方向t1时刻起点坐标;

[0270]

所述x

t2

为任一x方向t2时刻终点坐标;

[0271]

x方向模型:

[0272]

qx=arctan(x

t1

/x

t2

);

[0273]

所述qx为任一x方向度;

[0274]

所述x

t1

为任一x方向t1时刻起点方向;

[0275]

所述x

t2

为任一x方向t2时刻终点方向;

[0276]

采用平面模型包括两个重要参数,一个是x方向向量模型(即),另一个是x方向模型(即qx=arctan(x

t1

/x

t2

)),其中第一个x方向向量的计算通过两点之间的距离,从而建立向量空间模型,再计算x方向就是x方向向量的两条边,进而通过正切函数,求出其角度,该向量和方向可以放在笛卡尔坐标系中,同样可以在二维矩阵中形成其中的一个元素。

[0277]

y方向向量模型:

[0278][0279]

所述dy为任一y方向向量;

[0280]

所述y

t1

为任一y方向t1时刻起点坐标;

[0281]

所述y

t2

为任一y方向t2时刻终点坐标;

[0282]

所述平面方向归类模型:

[0283]

y方向模型:

[0284]

qy=arctan(y

t1

/y

t2

);

[0285]

所述qy为任一y方向度;

[0286]

所述y

t1

为任一y方向t1时刻起点方向;

[0287]

所述y

t2

为任一y方向t2时刻终点方向;

[0288]

采用平面模型包括两个重要参数,一个是y方向向量模型(即),另一个是y方向模型(即qy=arctan(y

t1

/y

t2

)),与上述说明同理,其中第一个y方向向量的计算通过两点之间的距离,从而建立向量空间模型,再计算y方向就是y方向向量的两条边,进而通过正切函数,求出其角度,该向量和方向可以放在笛卡尔坐标系中,同样可以在二维矩阵中形成其中的一个元素。

[0289]

所述三维向量组归类模型:

[0290][0291][0292]

所述dxyz为任一xyz方向组向量;

[0293]

所述dx为任一x方向组向量;

[0294]

所述dy为任一y方向组向量;

[0295]

所述dz为任一z方向组向量;

[0296]

所述三维方向组归类模型:

[0297][0298]

所述qxyz为任一xyz方向组方向度;

[0299]

采用三维向量组归类模型,同理,三维向量、方向模型也包括平面向量、方向模型,其中一个是xyz方向组向量(即)和xyz方向组方向度(即

),在该模型中,除了包含平面模型(xy)外,还包括z方向参数,其中dz取腰线长度(即),这样就可以确定其三维的特征,根据三维的向量和三维的角度的矩阵,可以进行评估对比,换句话说,就是为评估对比做好了数据准备。

[0300]

如图10所示,所述权值分配处理包括:

[0301]

若三维向量组集合的当前表情变化特征区域的三维向量组变化范围大于向量组变化平均变化阈值,则判定当前表情变化特征区域确定是三维向量变化区域s801;

[0302]

若三维向量组集合的当前表情变化特征区域的三维方向组变化范围大于方向组变化平均变化阈值,则判定当前表情变化特征区域确定是三维方向变化区域s802;

[0303]

若当前表情变化特征区域是三维向量变化区域,且是三维方向变化区域s803,则判定当前表情变化特征区域是表情变化高权值特征区域,并根据其变化幅度赋予其子特征区域相应的高表情变化权值,且将各子特征区域的高表情变化权值通过高变化权值拟合模型形成表情变化高权值特征值s804;

[0304]

否则,判定当前表情变化特征区域是表情变化高权值特征区域,并赋予其子特征区域相应的固定的低表情变化权值,且将各子特征区域的低表情变化权值通过低变化权值拟合模型形成表情变化低权值特征值s805;

[0305]

将表情变化高权值特征值和表情变化低权值特征值通过评估综合分值拟合模型形成相应的特征区域情绪评估综合分值s806。

[0306]

将各特征区域情绪评估综合分值与标准三维区域情绪模型库的进行比对,确定被测者当前情绪状态s807。

[0307]

采用所述权值分配处理包括:若三维向量组集合的当前表情变化特征区域的三维向量组变化范围大于向量组变化平均变化阈值,则判定当前表情变化特征区域确定是三维向量变化区域;若三维向量组集合的当前表情变化特征区域的三维方向组变化范围大于方向组变化平均变化阈值,则判定当前表情变化特征区域确定是三维方向变化区域;若当前表情变化特征区域是三维向量变化区域,且是三维方向变化区域,则判定当前表情变化特征区域是表情变化高权值特征区域,并根据其变化幅度赋予其子特征区域相应的高表情变化权值,且将各子特征区域的高表情变化权值通过高变化权值拟合模型形成表情变化高权值特征值;否则,判定当前表情变化特征区域是表情变化高权值特征区域,并赋予其子特征区域相应的固定的低表情变化权值,且将各子特征区域的低表情变化权值通过低变化权值拟合模型形成表情变化低权值特征值;将表情变化高权值特征值和表情变化低权值特征值通过评估综合分值拟合模型形成相应的特征区域情绪评估综合分值。将各特征区域情绪评估综合分值与标准三维区域情绪模型库的进行比对,确定被测者当前情绪状态,由于本方案的实质特征可以归纳为确定权值区域(因为上述过程中对图像进行了特征分区)、对权值区域的子区域、分布权值分配、对权值区域评分,将各权值区域评分查表,根据相似程度判断人脸的表情,通过上述权值分配处理的子流程,为表情对标的实现提供了模型基础。

[0308]

所述高变化权值拟合模型:

[0309]

[0310]

所述ahi为表情变化高权值特征值;

[0311]

所述ahscalej为任一子特征区域的高表情变化权值;

[0312]

所述低变化权值拟合模型:

[0313]

ali=alscalej×

n;

[0314]

所述ali为表情变化高权值特征值;

[0315]

所述alscalej为任一子特征区域的高表情变化权值;

[0316]

所述评估综合分值拟合模型:

[0317]

aalli=ahi ali;

[0318]

所述aalli任一特征区域的高表情变化权值。

[0319]

采用高变化权值拟合模型(即),这个模型就是将高权值区域进行拟合,最终得到表情高权重样本,接下来采用低变化权值拟合模型(即ali=alscalej×

n),虽然低权重贡献率并不高,但其参与模拟过程可以得到一个完整的方案,为将来的扩展提供了准备,同时,评估综合分值拟合模型(即aalli=ahi ali),可以得到该特征区域的分值,用这个特征区域的分值可以进行比较,从而确定被测者的表情。

[0320]

工作原理:

[0321]

本专利通过采用人脸定位模块、人脸跟踪模块、人脸匹配模块的应用,还包括所述预处理包括:基于获取的原始背景图像,依次通过平均灰度值模型、颜色分量一次模型、颜色分量二次模型的色彩优化,形成优化背景图像;

[0322]

(1)由于首先,人脸定位模块的应用是人脸识别的第一步,是指在输入图像中确定所有人脸(如果存在)的位置、大小和姿态的过程,根据特征的色彩性质可以将其分为基于肤色特征的方法和基于灰度的特征方法,本案基于灰度特征进行检测,捕获原始图像中的人脸轮廓并建立模型,为人脸跟踪提供定位支持;人脸跟踪模块的应用,该应用基于人脸定位,由于在静止图像中定位了人脸轮廓,这是可以基于该人脸轮廓在视频序列中进行延伸,其跟踪过程往往是在起始帧中检测人脸并记录其位置和大小的轮廓,然后根据该定位预测当前视频图像中每一帧的搜索区域,并在搜索区域内进行检测,如此重复以上步骤,实现人脸的持续跟踪;人脸匹配模块,对特征人脸图像进行匹配,需要对原始图像中的人脸模型与人脸数据库中,从而找到匹配结果,在匹配的过程中,需要进行面部特征提取方法和面部特征比对方法,也就是说将提取到的原始人脸图像的面部特征与数据库中存在的备案的标准面部特征进行比对分析,根据计算的特征相似度与相似度衡量标准进行比较,从而完成人脸匹配;

[0323]

(2)其次,在人脸定位、人脸跟踪、人脸匹配中存在相应的图像边缘检测算法、图像分割算法、模式匹配与模式识别算法三个算法,图像边缘检测算法:就是在图像上灰度变化较大较明显的地方,对图像各像素点进行求微分或二阶微分来定位边缘像素点,由灰度变化的特点,可将边缘类型分为阶梯状、脉冲状和屋顶状,对于阶梯状,图像边缘对应一阶微分图像的峰值和二阶微分图像的零交叉处,对于脉冲状和屋顶状边缘,边缘点对应一阶导数的零交叉和二阶导数的峰值;图像分割算法:在对处理后的图像数据进行分析之前,图像分割是最重要的步骤之一,其主要采用阈值分割法,该分割法是一种基于区域的图像分割技术,原理是过设定不同的特征阈值,把图像像素点分为若干类,这种方法也可以看成是动

态抠图技术;模式匹配与模式识别:其特点就是原始图像的关键特征与数据库中存在的备案的标准关键特征进行比对分析,从而确定匹配程度和确定人脸图像中人的身份,同时基于上述图像识别技术,在人脸定位还进行了预处理操作;

[0324]

(3)本方案中的预处理操作包括:平均灰度值模型、颜色分量一次模型、颜色分量二次模型,其中平均灰度值模型,对原始图像进行均值化处理,传统的预处理采用r、g、b三原色处理,这种处理的图像虽然的色彩对比度和亮度方面较好,但其色彩均衡度的表现并不理想,由于其色彩均衡度的欠缺,直接影响后续灰度阈值的确定,从而影响人脸轮廓的精度,因此,本案采用四元色(即r、y、g、b)代替三元色进行优化,基于四元色的优化比三元色的优化,灰度变化更明显,更适合基于灰度值变化特征进行边缘检测,如:就是对红、黄、绿和蓝色进行均值处理,同理,本方案在基于四元色的均值化的基础上,进行颜色分量一次模型变换和颜色分量二次模型变换,第一次优化是将分别将四元色的原图分别进行色彩变换,该变换的核心就是在四张元色原图上分别乘以分量均值,从而提高该色彩原图的色彩均衡度,如就是将红色元图上增量红色分量,其他黄、绿和蓝元图依照此规律,再接下来就是第二次优化,第二次优化是在第一颜色分量基础上,如果超出可是范围进行再次优化,如该元色的最高比例值为255,但出现258就超出的元图的色彩尺度,因此必须对其进行纠正,本方案采取的纠正策略就是将超出部分拉回到其最高值,这样处理的好处在于节省运算的成本,若在大数据运算中,除法的运算将产生大量的浮点运算,这样的运算在大数据处理下,是不和适宜的,如若t(r)

′

》255,则t(r)

″

=maxt(r);通过对人脸定位应用、人脸跟踪应用、人脸匹配应用,实现了对人脸的识别与身份认证,通过预处理中的平均灰度值模型应用、颜色分量一次模型应用、颜色分量二次模型应用,对人脸中每一个像素的四个颜色分量分别进行重构,实现了对原始图像进行自适应的光照亮度补偿,从而减少环境干扰因素对任亮识别的影响和干扰;

[0325]

本发明解决了现有技术存在原始人脸图像受光照影响的影响,从而导致色彩的均衡度不平衡,进而影响的人脸识别准确度和匹配精度问题,具有实现了对原始图像进行自适应的光照亮度补偿,从而减少环境干扰因素对任亮识别的影响和干扰的有益技术效果。

[0326]

利用本发明的技术方案,或本领域的技术人员在本发明技术方案的启发下,设计出类似的技术方案,而达到上述技术效果的,均是落入本发明的保护范围。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。