1.本技术涉及人工智能技术领域,具体地涉及一种用于确定炼化工艺流程特征提取的合理性的方法及装置。

背景技术:

2.近年来,基于数据驱动的过程建模已得到日益广泛的研究应用,数据驱动建模无需深究工业过程的复杂机理,通过机器学习算法对历史数据学习,即可实现生产过程的故障诊断、参数预警和生产优化。然而加氢裂化等炼油工艺流程涉及进料、反应、分离、分馏等多种工艺单元,物化机理复杂,且过程数据呈高维、大时滞、非线性等特点,对有效开展特征工程进而实施机器学习建模带来挑战。

3.2006年hinton等提出深度学习(deep learning)概念并构建了深度置信网络(deep belief nets,dbn),采用逐层贪婪无监督预训练多个堆叠受限玻尔兹曼机,实现逐层提取特征表示,并结合有监督微调最终对目标变量进行预测。另一种深度学习框架自动编码器(auto-encoder,ae)遵循与dbn相同的无监督预训练-有监督微调的求参范式,采用梯度下降法(gradient descent,gd)求解网络参数,近年获得更为广泛的研究应用。yuan等基于ae类深度学习算法进行流程工业建模研究,取得了系列成果。值得注意的是,作为无监督深度学习算法,dbn、dae等提取的特征,既包含有利于目标预测的有效特征,也包含无效特征甚至噪声,这需要在预训练阶段施加额外正则化来强化有效特征的鉴别与提取,或在微调阶段实施有监督训练,使提取的全部特征拟合于最优表示。2012年alexnet模型在imagenet图像识别大赛大获成功标志着以卷积神经网络(convolutional neural network,cnn)为代表的有监督深度学习进入工业应用阶段。cnn作为计算机视觉中深度学习的主流技术,以卷积核学习局部空间感受野,从而高效提取图片局部像素间的特征关系,同时实现了不同层间的稀疏连接和同一层间的权重共享。另一方面,cnn通过池化汇聚(pooling)实现中间层特征的降维采样,提高了特征提取鲁棒性,使得cnn在保持较低参数计算量的前提下实现了高鲁棒特征的端到端提取,cnn具有的种种优势已使其成为当前深度学习用于流程工业建模的重要算法。wang等对cnn卷积核形状、卷积方式进行了系列研究,并在甲醇合成工业装置上进行了验证。geng等用交叉特征工程(cross feature,cf)提升数据样本的特征维度,提出的交叉特征卷积网络(cf-cnn)成功用于石脑油裂解制乙烯过程的能效和碳排放分析优化。

4.以上cnn的过程建模研究大多从样本数据着手,通过调整样本数据结构或采样预处理得到不同尺度水平的样本数据,以实现多尺度特征的提取。然而,在cnn对工艺流程的多尺度卷积研究和工艺流程知识融合方面还存在不足。因此,现有技术存在无法通过多尺度卷积网络和工艺流程知识融合来实现对工艺流程的特征提取的问题。

技术实现要素:

5.本技术实施例的目的是提供一种用于确定炼化工艺流程特征提取的合理性的方

法及装置,用以解决现有技术中无法通过多尺度卷积网络和工艺流程知识融合来实现对工艺流程的特征提取的问题。

6.为了实现上述目的,本技术第一方面提供一种用于确定炼化工艺流程特征提取的合理性的方法,该方法包括:

7.获取工业历史样本数据;

8.根据工业历史样本数据构建全流程矩阵,以得到训练集和测试集;

9.根据训练集训练多尺度卷积神经网络模型,以得到训练后的多尺度卷积神经网络模型;

10.将测试集输入至训练后的多尺度卷积神经网络模型,以得到中间特征图;

11.通过混合高斯模型和t分布-随机邻居嵌入流形学习,根据测试集和中间特征图,确定多尺度卷积神经网络模型的特征提取的合理性。

12.在本技术实施例中,根据工业历史样本数据构建全流程矩阵,以得到训练集和测试集包括:

13.根据工业历史数据得到初始全流程矩阵;

14.对初始全流程矩阵进行随机重排混洗,以得到混洗后的全流程矩阵;

15.对混洗后的全流程矩阵进行处理,以得到训练集和测试集。

16.在本技术实施例中,对混洗后的全流程矩阵进行处理,以得到训练集和测试集包括:

17.对混洗后的全流程矩阵的数据进行离群点剔除处理,以得到离群点剔除处理后的数据;

18.对离群点剔除处理后的数据进行数据归一化,以得到样本数据;

19.根据组合特征构建方法对样本数据进行处理,以得到处理后的样本数据;

20.根据数据集分割方法将处理后的样本数据分为训练集和测试集。

21.在本技术实施例中,对混洗后的全流程矩阵的数据进行离群点剔除处理,以得到离群点剔除处理后的数据包括:

22.将混洗后的全流程矩阵的数据中涉及停工、非正常生产工况的历史数据剔除。

23.在本技术实施例中,对离群点剔除处理后的数据进行数据归一化满足公式(1):

[0024][0025]

其中,j表示第j维特征列,χj为第j维特征的样本数据,为第j维特征的样本均值,χ

j,max

为第j维特征最大值,χ

j,min

为第j维特征最小值。

[0026]

在本技术实施例中,根据组合特征构建方法对样本数据进行处理,以得到处理后的样本数据包括:

[0027]

获取样本数据不同维度的原始样本特征;

[0028]

对不同维度的原始样本特征进行工艺计算,以得到最终特征;

[0029]

根据最终特征得到处理后的样本数据。

[0030]

在本技术实施例中,根据数据集分割方法将处理后的样本数据分为训练集和测试集包括:

[0031]

对样本数据进行工况分析,以得到不同的工况数据集;

[0032]

将工况数据集划分为训练集和测试集。

[0033]

在本技术实施例中,多尺度卷积神经网络模型中的同一层神经网络通过不同尺寸的卷积核和不同膨胀率的膨胀卷积核进行膨胀卷积。

[0034]

在本技术实施例中,通过混合高斯模型和t分布-随机邻居嵌入流形学习,根据测试集和中间特征图确定多尺度卷积神经网络模型的特征提取的合理性包括:

[0035]

根据混合高斯模型对测试集中的预测变量进行聚类,以获得相应混合高斯模型标签;

[0036]

将混合高斯模型标签分别与测试集、中间特征图进行拼接,以得到待降维数据;

[0037]

根据t分布-随机邻居嵌入对待降维数据进行降维可视化,以得到二维特征团簇;

[0038]

根据二维特征团簇确定多尺度卷积神经网络模型的特征提取的合理性。

[0039]

本技术第二方面提供一种用于确定炼化工艺流程特征提取的合理性的装置,其特征在于,包括:

[0040]

存储器,被配置成存储指令;以及

[0041]

处理器,被配置成从存储器调用指令以及在执行指令时能够实现上述中任一项用于确定炼化工艺流程特征提取的合理性的方法。

[0042]

通过上述技术方案,先获取工业历史样本数据,再根据工业历史样本数据构建全流程矩阵,以得到训练集和测试集;根据训练集训练多尺度卷积神经网络模型,以得到训练后的多尺度卷积神经网络模型;进一步将测试集输入至训练后的多尺度卷积神经网络模型,以得到中间特征图;最后通过混合高斯模型和t分布-随机邻居嵌入流形学习,根据测试集和中间特征图,确定多尺度卷积神经网络模型的特征提取的合理性。本技术通过多尺度卷积神经网络对炼化工艺流程进行特征提取,并基于混合高斯模型和t分布-随机邻居嵌入流行学习对对尺度卷积神经网络所提取的特征进行合理性评估,从而验证了多尺度卷积神经网络对炼化工艺流程特征提取的有效性,有利于解决现有技术中存在的无法通过多尺度卷积网络和工艺流程知识融合来实现对工艺流程的特征提取的问题。

[0043]

本技术实施例的其它特征和优点将在随后的具体实施方式部分予以详细说明。

附图说明

[0044]

附图是用来提供对本技术实施例的进一步理解,并且构成说明书的一部分,与下面的具体实施方式一起用于解释本技术实施例,但并不构成对本技术实施例的限制。在附图中:

[0045]

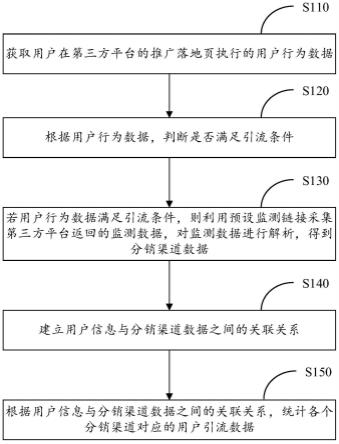

图1为根据本技术实施例的一种用于确定炼化工艺流程特征提取的合理性的方法的流程示意图;

[0046]

图2为根据本技术实施例的gmm-t-sne特征评价框架的示意图;

[0047]

图3为根据本技术实施例的一种确定加氢裂化工艺流程特征提取的合理性的方法的流程示意图;

[0048]

图4为根据本技术一具体实施例的基于加氢裂化工艺流程知识的矩阵设计示意图;

[0049]

图5为根据本技术一具体实施例的数据增强示意图;

[0050]

图6(a)~图6(d)为根据本技术一具体实施例的gmm聚类分析的示意图;

[0051]

图7(a)~图7(h)为根据本技术一具体实施例的加氢裂化工艺变量预测的示意图;

[0052]

图8(a)~图8(j)为根据本技术一具体实施例的ifm的t-sne可视化的示意图;

[0053]

图9为根据本技术实施例的一种用于确定炼化工艺流程特征提取的合理性的装置的结构框图。

具体实施方式

[0054]

为使本技术实施例的目的、技术方案和优点更加清楚,下面将结合本技术实施例中的附图,对本技术实施例中的技术方案进行清楚、完整地描述,应当理解的是,此处所描述的具体实施方式仅用于说明和解释本技术实施例,并不用于限制本技术实施例。基于本技术中的实施例,本领域普通技术人员在没有做出创造性劳动的前提下所获得的所有其他实施例,都属于本技术保护的范围。

[0055]

需要说明,若本技术实施例中有涉及方向性指示(诸如上、下、左、右、前、后

……

),则该方向性指示仅用于解释在某一特定姿态(如附图所示)下各部件之间的相对位置关系、运动情况等,如果该特定姿态发生改变时,则该方向性指示也相应地随之改变。

[0056]

另外,若本技术实施例中有涉及“第一”、“第二”等的描述,则该“第一”、“第二”等的描述仅用于描述目的,而不能理解为指示或暗示其相对重要性或者隐含指明所指示的技术特征的数量。由此,限定有“第一”、“第二”的特征可以明示或者隐含地包括至少一个该特征。另外,各个实施例之间的技术方案可以相互结合,但是必须是以本领域普通技术人员能够实现为基础,当技术方案的结合出现相互矛盾或无法实现时应当认为这种技术方案的结合不存在,也不在本技术要求的保护范围之内。

[0057]

图1为根据本技术实施例的一种用于确定炼化工艺流程特征提取的合理性的方法的流程示意图。如图1所示,本技术实施例提供一种用于确定炼化工艺流程特征提取的合理性的方法,该方法可以包括下列步骤:

[0058]

步骤101、获取工业历史样本数据;

[0059]

步骤102、根据工业历史样本数据构建全流程矩阵,以得到训练集和测试集;

[0060]

步骤103、根据训练集训练多尺度卷积神经网络模型,以得到训练后的多尺度卷积神经网络模型;

[0061]

步骤104、将测试集输入至训练后的多尺度卷积神经网络模型,以得到中间特征图;

[0062]

步骤105、通过混合高斯模型和t分布-随机邻居嵌入流形学习,根据测试集和中间特征图,确定多尺度卷积神经网络模型的特征提取的合理性。

[0063]

在本技术实施例中,先获取炼化工艺流程的工业历史样本数据。不同的炼化工艺流程的复杂度并不相同,整个炼化工艺流程可以由多个局部子流程构成,且各局部子流程自建可能存在工艺耦合关系,因此,在获取工业历史样本数据时,要涵盖炼化工艺流程各局部子流程的操作单元的数据。根据获取的工业历史样本数据构建全流程矩阵,并将全流程矩阵划分为训练集和测试集。先根据处理器获取的工业历史样本数据构建初始全流程矩阵,再对构建的初始全流程矩阵中的样本数据进行混洗,对混洗后的全流程矩阵依次进行离群点剔除、数据归一化、组合特征构建处理,进一步对处理后的全流程矩阵进行数据集分割,以得到训练集和测试集。

[0064]

接着,基于训练集构建有监督训练任务,对多尺度卷积神经网络模型进行训练,从而得到训练后的多尺度卷积神经网络模型。其中,多尺度卷积神经网络模型基于inception结构块的多尺度卷积提出,并将根据炼化工艺流程的特点设计的工艺全流程矩阵作为知识融合的载体,然后基于新颖的extended-inception卷积结构块建立多尺度卷积网络以完成mscnn算法构建。考虑到基于inception结构块的多尺度卷积可显著提升单卷积层的特征提取能力,有助于提取局部工艺流程之间各变量的特征关系,本技术对inception结构块进行了扩展(extended-inception),将膨胀卷积引入多尺度卷积神经网络,有利于提升多尺度卷积神经网络特征提取的能力。

[0065]

接着,将测试集输入至训练后的多尺度卷积神经网络模型,以得到中间特征图。在一个示例中,通过训练后的多尺度卷积神经网络对测试集进行目标变量预测,并输出中间特征图(ifm),以便充分提取局部-全局工艺流程的特征关系,从而实现对预测变量的准确预测。最后,通过混合高斯模型和t分布-随机邻居嵌入流形学习,根据测试集和中间特征图,确定多尺度卷积神经网络模型的特征提取的合理性。在一个示例中,可以通过混合高斯模型(gmm)对测试集的目标变量(labels)进行聚类,以得到相应的gmm labels;然后将gmm labels分别与测试集、ifm拼接,以形成待降维数据;进一步地,基于t分布-随机邻居嵌入(t-sne)对待降维数据进行降维可视化,并以此为基础评价多尺度卷积神经网络提取特征的合理性。

[0066]

通过上述技术方案,先获取工业历史样本数据,再根据工业历史样本数据构建全流程矩阵,以得到训练集和测试集;根据训练集训练多尺度卷积神经网络模型,以得到训练后的多尺度卷积神经网络模型;进一步将测试集输入至训练后的多尺度卷积神经网络模型,以得到中间特征图;最后通过混合高斯模型和t分布-随机邻居嵌入流形学习,根据测试集和中间特征图,确定多尺度卷积神经网络模型的特征提取的合理性。本技术通过多尺度卷积神经网络对炼化工艺流程进行特征提取,并基于混合高斯模型和t分布-随机邻居嵌入流行学习对对尺度卷积神经网络所提取的特征进行合理性评估,从而验证了多尺度卷积神经网络对炼化工艺流程特征提取的有效性,有利于解决现有技术中存在的无法通过多尺度卷积网络和工艺流程知识融合来实现对工艺流程的特征提取的问题。

[0067]

在本技术实施例中,步骤102、根据工业历史样本数据构建全流程矩阵,以得到训练集和测试集可以包括:

[0068]

根据工业历史样本数据得到初始全流程矩阵;

[0069]

对初始全流程矩阵进行随机重排混洗,以得到混洗后的全流程矩阵;

[0070]

对混洗后的全流程矩阵进行处理,以得到训练集和测试集。

[0071]

具体地,处理器根据获取到的工业历史样本数据构建初始全流程矩阵。为了提高初始全流程矩阵中数据排列的丰富性,可以对初始全流程矩阵进行随机重排混洗,进而得到混洗后的全流程矩阵,实现全流程矩阵的样本数据的扩充,同时达到数据增强的目的。进一步地,对混洗后的全流程矩阵进行处理,将混洗后的全流程矩阵依次进行离群点剔除处理、数据归一化处理以及组合特征构建处理,最终得到处理之后的全流程矩阵,并将处理后的全流程矩阵中的样本数据根据数据集分割的方法分为训练集和测试集。

[0072]

以加氢裂化工艺流程为例,加氢裂化工艺流程复杂度高,各局部流程内、局部流程间均存在工艺耦合关系,以加氢裂化工艺局部子流程为行,以每个子流程所含工艺变量为

列,共选取工业历史样本数据中126个关键工艺变量,以构建9

×

14初始全流程矩阵,接着对初始全流程矩阵实施行方向的随机重排技巧,通过“行混洗”提高子流程排列的丰富性,同时达到样本增强的目的,接着对混洗后的全流程矩阵进行处理,最后根据数据集分割的方法,按照80%:20%的比例将处理后的全流程矩阵中的样本数据分割为训练集和测试集。通过行随机重排混洗处理,有利于提高样本数据的丰富性,达到数据增强的目的。

[0073]

在本技术实施例中,对混洗后的全流程矩阵进行处理,以得到训练集和测试集可以包括:

[0074]

对混洗后的全流程矩阵的数据进行离群点剔除处理,以得到离群点剔除处理后的数据;

[0075]

对离群点剔除处理后的数据进行数据归一化,以得到样本数据;

[0076]

根据组合特征构建方法对样本数据进行处理,以得到处理后的样本数据;

[0077]

根据数据集分割方法将处理后的样本数据分为训练集和测试集。

[0078]

具体地,经过混洗之后,全流程矩阵中的样本数据被成倍扩充,数据强度增强的同时,也提高了数据复杂度,因此,需要对混洗后的全流程矩阵进行处理,进一步得到训练集和测试集。先通过离群点剔除的方式过滤掉全流程矩阵中涉及停工、非正常生产工况的数据,再进行数据归一化处理。在一个示例中,可以将全流程矩阵中的样本数据归一化至(-1,1)区间。接着对进行数据归一化处理之后的全流程矩阵通过组合特征构建方法进行处理,最后将处理后的全流程矩阵根据数据集分割方法划分为训练集和测试集。

[0079]

在本技术实施例中,对混洗后的全流程矩阵的数据进行离群点剔除处理,以得到离群点剔除处理后的数据可以包括:

[0080]

将混洗后的全流程矩阵的数据中涉及停工、非正常生产工况的历史数据剔除。

[0081]

在本技术实施例中,对离群点剔除处理后的数据进行数据归一化可以满足公式(1):

[0082][0083]

其中,j表示第j维特征列,χj为第j维特征的样本数据,为第j维特征的样本均值,χ

j,max

为第j维特征最大值,χ

j,min

为第j维特征最小值。

[0084]

在本技术实施例中,根据组合特征构建方法对样本数据进行处理,以得到处理后的样本数据可以包括:

[0085]

获取样本数据不同维度的原始样本特征;

[0086]

对不同维度的原始样本特征进行工艺计算,以得到最终特征;

[0087]

根据最终特征得到处理后的样本数据。

[0088]

具体地,在经过数据归一化处理之后,获取样本数据不同维度的原始样本特征,再对不同维度的原始样本特征基于炼化工艺流程知识进行工艺计算,进而得到新的工艺特征变量,将新的工艺特征变量作为最终特征,得到处理后的样本数据。在一个示例中,以加氢裂化工艺流程为例,将样本数据不同维度的原始样本特征基于加氢裂化工艺知识进行工艺计算,得到新的工艺特征变量作为最终特征;其中,具体工艺计算特征可以包括但不限于催化柴油掺炼比、液时空速、回流比。

[0089]

在本技术实施例中,根据数据集分割方法将处理后的样本数据分为训练集和测试

集可以包括:

[0090]

对样本数据进行工况分析,以得到不同的工况数据集;

[0091]

将工况数据集划分为训练集和测试集。

[0092]

具体地,对处理后的全流程矩阵的样本数据进行工况分析,将同一工况下的样本数据划分到同一数据集合,进而得到多个不同的工况数据集,接着按照设定条件将工况数据集划分为训练集和测试集。在一个示例中,可以分别从不同种工况数据集种各抽取70%数据量作为训练集,剩余作为测试集。

[0093]

在本技术实施例中,多尺度卷积神经网络模型中的同一层神经网络可以通过不同尺寸的卷积核和不同膨胀率的膨胀卷积核进行膨胀卷积。

[0094]

具体地,基于extended-inception结构块提出了多尺度卷积神经网络,在对炼化工艺流程变量间的特征关系进行多尺度学习提取时,对于全流程矩阵的同一层可以通过不同尺寸的卷积核和不同膨胀率的膨胀卷积核进行膨胀卷积。例如,可以对全流程矩阵在同一卷积层进行3

×

3卷积、5

×

5卷积及4

×

4膨胀卷积。此外,在卷积计算前针对不同尺寸卷积核,对输入样本矩阵进行全0填充,以输出相同的输出特征图尺寸,从而实现相同尺寸的输出特征图在通道维度上叠加以作为下一层的输入。通过将多尺度卷积核封装为类似inception结构块,有利于提高模型训练及推理的效率。

[0095]

图2为根据本技术实施例的gmm-t-sne特征评价框架的示意图。在本技术实施例中,步骤105、通过混合高斯模型和t分布-随机邻居嵌入流形学习,根据测试集和中间特征图确定多尺度卷积神经网络模型的特征提取的合理性可以包括:

[0096]

根据混合高斯模型对测试集中的预测变量进行聚类,以获得相应混合高斯模型标签;

[0097]

将混合高斯模型标签分别与测试集、中间特征图进行拼接,以得到待降维数据;

[0098]

根据t分布-随机邻居嵌入对待降维数据进行降维可视化,以得到二维特征团簇;

[0099]

根据二维特征团簇确定多尺度卷积神经网络模型的特征提取的合理性。

[0100]

具体地,本技术结合运用混合高斯模型和结合运用混合高斯模型(gmm)和t分布-随机邻居嵌入(t-sne)流形学习,提出了一种新颖的特征评价框架gmm-t-sne。首先基于混合高斯模型对测试集中的预测变量(labels)进行聚类打标签,获得相应的gmm labels,再将gmm labels分别与测试集以及得到的中间特征图进行拼接处理,以形成待降维数据;接着运用t分布-随机邻居嵌入对待降维数据进行降维可视化,以得到二维特征团簇;其中,可以对多尺度卷积神经网络全连接层中的任何一层进行降维可视化。最后根据二维特征团簇确定多尺度卷积神经网络模型的特征提取的合理性。若获得的二维特征团簇与对应预测变量的gmm聚类工况(即gmm labels)分布一致,表现为同一个二维团簇中仅含有某种相同的gmm label,则表明mscnn学习到了合理的判别特征,有助于预测对应的目标变量。即验证了运用多尺度卷积神经网络对炼化工艺流程特征提取的合理性。

[0101]

在本技术的一个具体实施例中,以对加氢裂化工艺流程特征提取合理性评价为例。

[0102]

某石化企业煤柴油加氢裂化装置以直馏柴油(straight-run diesel)、催化柴油(fcc diesel)和重整氢气(make-up h2)为原料,采用双剂串联、一次通过加氢工艺,生产化工石脑油、航空煤油和高品质柴油,具体工艺流程如下:柴油按比例进料并与氢气混合,经

预热后首先进入加氢精制反应器(r101)完成硫、氮、金属等杂质脱除,然后进入裂化反应器(r102)通过加氢裂化反应将柴油分子选择性裂解为轻质烃类。反应器流出物经高低压分离器进行初步产物分离后,进入分馏流程。硫化氢汽提塔(c201)将产物中酸性气和c4轻烃一并拔出,进而通过吸收脱吸塔(c205)和石脑油稳定塔(c206)分别得到酸性气和液化气(lpg),经拔除轻烃的c201塔釜物流进入主分馏塔(c202)进行主产品分离,其中塔顶馏出粗石脑油并经石脑油分馏塔(c204)得到轻、重石脑油,c202侧线馏出煤油组分经汽提塔(c203)汽提后得到航空煤油,c202底抽出高品质柴油产品。因此,加氢裂化工艺流程高度复杂,各局部流程内、局部流程间均存在工艺耦合。

[0103]

图3为根据本技术实施例的一种确定加氢裂化工艺流程特征提取的合理性的方法的流程示意图。如图3所示,在本具体实施例中,确定加氢裂化工艺流程特征提取的合理性的方法包括以下步骤。

[0104]

步骤401、处理加氢裂化工艺流程的样本数据。

[0105]

图4为根据本技术一具体实施例的基于加氢裂化工艺流程知识的矩阵设计示意图。选取加氢裂化工艺流程历史样本数据中的126个维度工艺变量作为初始输入的样本数据,分别以加氢精制催化剂温度、新氢耗量作为预测变量。从装置历史运行时间段2019年6月至2020年9月共采集4360组数据,按照图4所示将采集到的4360组数据重塑得到9

×

14初始工艺全流程矩阵。由于全流程矩阵充分容纳了加氢裂化各局部子流程的单元操作,蕴含了加氢工艺流程从进料到产品馏出线所有关键变量的空间关系,适于通过卷积操作进行特征学习提取,从而最终实现工艺流程知识与深度学习的融合。

[0106]

考虑到图4所示的初始全流程矩阵,不相邻行(局部子流程)存在远距离工艺耦合关系,例如进料组成影响产物分布,同时产物分布也反映加氢裂化床层温度等,为进一步提取各局部子流程间的远距离特征关系,将得到的初始全流程矩阵进行随机混洗,以得到混洗后的全流程矩阵。

[0107]

图5为根据本技术一具体实施例的数据增强示意图。如图5所示,原始样本容量为4360,按照图5逐一对初始全流程矩阵实施2轮随机行重排操作后,样本容量扩充至13080,实现3倍数据增强。具体地,126个维度的数据在加氢裂化工艺流程的分布如表1所示。

[0108]

表1 数据样本在加氢工艺子流程块中的分布

[0109][0110][0111]

接着,对混洗后的全流程矩阵中的样本数据进行离群点剔除处理,即剔除混洗后的全流程矩阵的样本数据中涉及停工、非正常生产工况的数据;再将经离群点剔除处理后的数据先后进行数据归一化及组合特征构建处理,最后根据数据集分割的方法划分出训练集和测试集,具体按照80%:20%的比例分割为训练集和测试集。

[0112]

步骤402、基于mscnn对加氢裂化工艺流程进行特征提取。

[0113]

首先,对mscnn模型进行参数配置,此外,本具体实施例同时设置了基于cnn和bpnn模型的对照组,mscnn模型以及对照组cnn模型和bpnn模型的参数配置如表2所示。mscnn与传统cnn均为6层(layer 1~layer 6),其中前两层为卷积层(conv,表2中已注明卷积核数量和尺寸),卷积输出特征图通过第3层打平(flatten)成一维向量并经过第4、5层全连接层(dense,表2中已注明神经元数量),最终由第6层输出回归预测结果。与传统cnn不同的是mscnn第1层采用extended-inception结构块实现多尺度卷积,共有5

×

5、7

×

7、4

×

4、3

×

3 4种不同尺寸的卷积核,且第4类3

×

3卷积核采用膨胀卷积(dr=2)进一步增强多尺度特征提取能力。作为对照,bpnn也提供了相同总层数的dense层(conv层用dense层代替),其中后3层网络结构与mscnn、cnn保持一致,前2层对应mscnn、cnn的卷积层,各含有128个神经元,bpnn不含打平(flatten)。

[0114]

表2 mscnn模型参数配置

[0115][0116][0117]

接着,基于tensorflow深度学习框架建立各模型并进行训练,训练配置采用以下参数:默认学习率(learning rate)为0.001,采用relu非线性激活函数(activation function),回归类训练指标(evaluation metric)采用均方误差(mse),选取性能优异的adam优化器(optimizer)对模型进行梯度下降求参。测试集上模型评估指标采用均方根误差(rmse)和判定系数(r2),rmse的求取满足公式(2),r2的求取满足公式(3)。

[0118][0119][0120]

其中,n为测试集容量,yi为预测变量的真实值,为模型预测值,为真实值的均值,rmse表示模型预测值与真实值的平均偏差,rmse值越小模型预测越准确。r2表示模型对预测变量的整体方差所能给出的解释程度,r2值越大表示模型拟合程度越高。

[0121]

图6(a)~图6(d)为根据本技术一具体实施例的gmm聚类分析的示意图。基于gmm对加氢精制催化剂温度(hct)和新氢耗量(h2fr)进行聚类,并应用bic准则对gmm高斯组分数k进行选择,结果如图6(a)~图6(d)所示,其中图6(a)和图6(c)条形图中每个gmm高斯组分数k值对应的四个矩形从左至右分别为spherical、tied、diag、full,表示不同高斯协方差类型,受实际样本分布不同而影响gmm最终聚类结果。由图6(a)和图6(c)可知,选取k=4时,除tied

[0122]

协方差类型外,spherical、diag、full均达到一致的最低bic得分。图6(b)和图6(d)为k取4时gmm分别对hct和h2fr样本数据的概率分布拟合,左轴表示真实样本的频率分

布,右轴表示gmm概率密度函数(pdf),图6(b)和图6(d)表明4个高斯组分的gmm对hct和h2fr概率分布拟合良好,与实际分布频率(real frequency)一致,其中分别表示每个高斯组分的均值和标准差。

[0123]

图7(a)~图7(h)为根据本技术一具体实施例的加氢裂化工艺变量预测的示意图。基于mscnn在测试集上对hct和h2fr进行预测并与cnn、bpnn进行对比,结果如图7(a)~图7(d),其中,线m为各模型预测值,线n为真实值,线e为预测值和真实值的绝对误差。其中图7(a)~图7(d)为hct预测值和真实值以及模型预测的绝对误差(absolute error,ae),图7(a)为基于mscnn-shuffled模型对hct进行预测,rmse=0.75,r2=0.96;图7(b)为基于mscnn模型对hct进行预测,rmse=1.06,r2=0.92;图7(c)为基于cnn模型对hct进行预测,rmse=1.44,r2=0.86;图7(d)为基于bpnn模型对hct进行预测,rmse=1.65,r2=0.81。图7(e)~图7(h)为相应h2fr预测结果,图7(e)为基于mscnn-shuffled模型对h2fr进行预测,rmse=1053.0,r2=0.99;图7(f)为基于mscnn模型对h2fr进行预测,rmse=1476.0,r2=0.98;图7(g)为基于cnn模型对h2fr进行预测,rmse=1857.0,r2=0.97;图7(h)为基于bpnn模型对h2fr进行预测,rmse=2588.0,r2=0.94。shuffled表示训练集经过随机行重排。由图7(a)和图7(e)可得mscnn-shuffled对hct预测rmse达到最小0.75,r2达到最大0.96,对h2fr预测rmse达到最小1053,r2达到最大0.99,预测结果均达到最优。图7(b)和图7(f)中mscnn对hct和h2fr预测rmse分别为1.06和1476,r2分别为0.92和0.98,均达到次优。与此相比,图7(a)~图7(h)中cnn和bpnn的预测结果相对较差,均不及mscnn-shuffled和mscnn,表明基于知识融合的mscnn算法充分提取了加氢裂化各局部工艺流程间不同尺度的特征关系,显著提升了模型预测性能。

[0124]

步骤403、基于gmm-t-sne特征评价框架进行特征合理性评价。

[0125]

图8(a)~图8(j)为根据本技术一具体实施例的ifm的t-sne可视化的示意图。各模型对hct和h2fr预测的同时输出ifm,将ifm与预测目标hct和h2fr各自的4种不同gmm labels对应拼接,且gmm labels分别用不同的形状圈出,最后按照图2流程应用t-sne对ifm降维至二维(维度1、维度2)。为获得良好可视化效果,经实验将t-sne算法的困惑度(perplexity)参数取为100,最终可视化结果如图8(a)~图8(j)所示。

[0126]

不同模型对hct和h2fr预测时的特征可视化结果分别为图8(a)~图8(e)和图8(f)~图8(j),为对比不同模型算法所提取特征的合理性,图8(a)和图8(f)分别展示了hct和h2fr原始样本矩阵的降维结果作为空白对照,图8(b)为基于bpnn模型对hct进行预测,图8(c)为基于cnn模型对hct进行预测,图8(d)为基于mscnn模型对hct进行预测,图8(e)为基于mscnn-shuffled模型对hct进行预测,图8(g)为基于bpnn模型对h2fr进行预测,图8(h)为基于cnn模型对h2fr进行预测,图8(i)为基于mscnn模型对h2fr进行预测,图8(j)为基于mscnn-shuffled模型对h2fr进行预测。由空白对照图8(a)可知,原始样本经t-sne降维所获得的二维团簇分布不能与hct的4种gmm labels分布一一对应,而是同一种hct的gmm label出现在多个团簇里,而且在同一个团簇也含有不同hct的gmm label,这表明原始样本的数据形态不利于对hct的预测。图8(f)h2fr的空白对照也表现为相同结果。基于知识融合的mscnn算法通过多尺度卷积充分提取了加氢裂化工艺流程局部-全局空间域的特征关系,通过对图8(d)这些特征的t-sne二维团簇观察,可见hct的同一种gmm label下的特征组成独立团簇,不同gmm label下的特征分属不同团簇,这表明经mscnn提取的特征与预测目标hct密切相

关,且特征的分布与hct的gmm labels分布一致,可显著提升对hct的预测精度。图8(e)mscnn-shuffled训练集经过数据增强,提取了更为丰富的特征关系,故特征分布与hct的gmm labels分布达到最优一致,表明mscnn-shuffled所提取的特征最为合理。图8(c)所示cnn未采用多尺度卷积,特征提取能力不足,从而分布一致性较差,而图8(b)bpnn为全连接网络,所提取的特征仅来自对原始样本的全局非线性转换,由特征分布可见其合理性弱于mscnn和cnn,仅比原始样本的略好。图8(g)~图8(j)所示h2fr的特征评价结果与hct相同。

[0127]

图9为根据本技术实施例的一种用于确定炼化工艺流程特征提取的合理性的装置的结构框图。如图9所示,本技术实施例提供一种用于确定炼化工艺流程特征提取的合理性的装置,可以包括:

[0128]

存储器910,被配置成存储指令;以及

[0129]

处理器920,被配置成从存储器调用指令以及在执行指令时能够实现上述中任一项用于确定炼化工艺流程特征提取的合理性的方法。

[0130]

具体地,在本技术实施例中,处理器920可以被配置成:

[0131]

获取工业历史样本数据;

[0132]

根据工业历史样本数据构建全流程矩阵,以得到训练集和测试集;

[0133]

根据训练集训练多尺度卷积神经网络模型,以得到训练后的多尺度卷积神经网络模型;

[0134]

将测试集输入至训练后的多尺度卷积神经网络模型,以得到中间特征图;

[0135]

通过混合高斯模型和t分布-随机邻居嵌入流形学习,根据测试集和中间特征图,确定多尺度卷积神经网络模型的特征提取的合理性。

[0136]

进一步地,处理器920还可以被配置成:

[0137]

根据工业历史样本数据构建全流程矩阵,以得到训练集和测试集包括:

[0138]

根据工业历史样本数据得到初始全流程矩阵;

[0139]

对初始全流程矩阵进行随机重排混洗,以得到混洗后的全流程矩阵;

[0140]

对混洗后的全流程矩阵进行处理,以得到训练集和测试集。

[0141]

进一步地,处理器920还可以被配置成:

[0142]

对混洗后的全流程矩阵进行处理,以得到训练集和测试集包括:

[0143]

对混洗后的全流程矩阵的数据进行离群点剔除处理,以得到离群点剔除处理后的数据;

[0144]

对离群点剔除处理后的数据进行数据归一化,以得到样本数据;

[0145]

根据组合特征构建方法对样本数据进行处理,以得到处理后的样本数据;

[0146]

根据数据集分割方法将处理后的样本数据分为训练集和测试集。

[0147]

进一步地,处理器920还可以被配置成:

[0148]

对混洗后的全流程矩阵的数据进行离群点剔除处理,以得到离群点剔除处理后的数据包括:

[0149]

将混洗后的全流程矩阵的数据中涉及停工、非正常生产工况的历史数据剔除。

[0150]

进一步地,处理器920还可以被配置成:

[0151]

对离群点剔除处理后的数据进行数据归一化满足公式(1):

[0152][0153]

其中,j表示第j维特征列,χj为第j维特征的样本数据,为第j维特征的样本均值,χ

j,max

为第j维特征最大值,χ

j,min

为第j维特征最小值。

[0154]

进一步地,处理器920还可以被配置成:

[0155]

根据组合特征构建方法对样本数据进行处理,以得到处理后的样本数据包括:

[0156]

获取样本数据不同维度的原始样本特征;

[0157]

对不同维度的原始样本特征进行工艺计算,以得到最终特征;

[0158]

根据最终特征得到处理后的样本数据。

[0159]

进一步地,处理器920还可以被配置成:

[0160]

根据数据集分割方法将处理后的样本数据分为训练集和测试集包括:

[0161]

对样本数据进行工况分析,以得到不同的工况数据集;

[0162]

将工况数据集划分为训练集和测试集。

[0163]

在本技术实施例中,多尺度卷积神经网络模型中的同一层神经网络通过不同尺寸的卷积核和不同膨胀率的膨胀卷积核进行膨胀卷积。

[0164]

进一步地,处理器920还可以被配置成:

[0165]

通过混合高斯模型和t分布-随机邻居嵌入流形学习,根据测试集和中间特征图确定多尺度卷积神经网络模型的特征提取的合理性包括:

[0166]

根据混合高斯模型对测试集中的预测变量进行聚类,以获得相应混合高斯模型标签;

[0167]

将混合高斯模型标签分别与测试集、中间特征图进行拼接,以得到待降维数据;

[0168]

根据t分布-随机邻居嵌入对待降维数据进行降维可视化,以得到二维特征团簇;

[0169]

根据二维特征团簇确定多尺度卷积神经网络模型的特征提取的合理性。

[0170]

通过上述技术方案,先获取工业历史样本数据,再根据工业历史样本数据构建全流程矩阵,以得到训练集和测试集;根据训练集训练多尺度卷积神经网络模型,以得到训练后的多尺度卷积神经网络模型;进一步将测试集输入至训练后的多尺度卷积神经网络模型,以得到中间特征图;最后通过混合高斯模型和t分布-随机邻居嵌入流形学习,根据测试集和中间特征图,确定多尺度卷积神经网络模型的特征提取的合理性。本技术通过多尺度卷积神经网络对炼化工艺流程进行特征提取,并基于混合高斯模型和t分布-随机邻居嵌入流行学习对对尺度卷积神经网络所提取的特征进行合理性评估,从而验证了多尺度卷积神经网络对炼化工艺流程特征提取的有效性,有利于解决现有技术中存在的无法通过多尺度卷积网络和工艺流程知识融合来实现对工艺流程的特征提取的问题。

[0171]

本领域内的技术人员应明白,本技术的实施例可提供为方法、系统、或计算机程序产品。因此,本技术可采用完全硬件实施例、完全软件实施例、或结合软件和硬件方面的实施例的形式。而且,本技术可采用在一个或多个其中包含有计算机可用程序代码的计算机可用存储介质(包括但不限于磁盘存储器、cd-rom、光学存储器等)上实施的计算机程序产品的形式。

[0172]

本技术是参照根据本技术实施例的方法、设备(系统)、和计算机程序产品的流程图和/或方框图来描述的。应理解可由计算机程序指令实现流程图和/或方框图中的每一流

程和/或方框、以及流程图和/或方框图中的流程和/或方框的结合。可提供这些计算机程序指令到通用计算机、专用计算机、嵌入式处理机或其他可编程数据处理设备的处理器以产生一个机器,使得通过计算机或其他可编程数据处理设备的处理器执行的指令产生用于实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能的装置。

[0173]

这些计算机程序指令也可存储在能引导计算机或其他可编程数据处理设备以特定方式工作的计算机可读存储器中,使得存储在该计算机可读存储器中的指令产生包括指令装置的制造品,该指令装置实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能。

[0174]

这些计算机程序指令也可装载到计算机或其他可编程数据处理设备上,使得在计算机或其他可编程设备上执行一系列操作步骤以产生计算机实现的处理,从而在计算机或其他可编程设备上执行的指令提供用于实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能的步骤。

[0175]

在一个典型的配置中,计算设备包括一个或多个处理器(cpu)、输入/输出接口、网络接口和内存。

[0176]

存储器可能包括计算机可读介质中的非永久性存储器,随机存取存储器(ram)和/或非易失性内存等形式,如只读存储器(rom)或闪存(flash ram)。存储器是计算机可读介质的示例。

[0177]

计算机可读介质包括永久性和非永久性、可移动和非可移动媒体可以由任何方法或技术来实现信息存储。信息可以是计算机可读指令、数据结构、程序的模块或其他数据。计算机的存储介质的例子包括,但不限于相变内存(pram)、静态随机存取存储器(sram)、动态随机存取存储器(dram)、其他类型的随机存取存储器(ram)、只读存储器(rom)、电可擦除可编程只读存储器(eeprom)、快闪记忆体或其他内存技术、只读光盘只读存储器(cd-rom)、数字多功能光盘(dvd)或其他光学存储、磁盒式磁带,磁带磁盘存储或其他磁性存储设备或任何其他非传输介质,可用于存储可以被计算设备访问的信息。按照本文中的界定,计算机可读介质不包括暂存电脑可读媒体(transitory media),如调制的数据信号和载波。

[0178]

还需要说明的是,术语“包括”、“包含”或者其任何其他变体意在涵盖非排他性的包含,从而使得包括一系列要素的过程、方法、商品或者设备不仅包括那些要素,而且还包括没有明确列出的其他要素,或者是还包括为这种过程、方法、商品或者设备所固有的要素。在没有更多限制的情况下,由语句“包括一个

……”

限定的要素,并不排除在包括要素的过程、方法、商品或者设备中还存在另外的相同要素。

[0179]

以上仅为本技术的实施例而已,并不用于限制本技术。对于本领域技术人员来说,本技术可以有各种更改和变化。凡在本技术的精神和原理之内所作的任何修改、等同替换、改进等,均应包含在本技术的权利要求范围之内。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。