1.本技术涉及互联网技术领域,尤其涉及一种视频生成方法、计算机设备及计算机可读存储介质。

背景技术:

2.随着虚拟现实、人工智能、5g等技术等发展,元宇宙的概念越来越接近可实现落地的阶段。虚拟人物是构成元宇宙中重要的基础元素。虚拟人物不仅可以应用于歌手活动、短视频创作、直播场景,还可以应用于k歌平台中,在用户唱歌时自动地生成虚拟人物跳舞视频,可以提升用户体验。

3.目前为了生成虚拟人物,需要由真实人类来演绎,这个真实人类被称作“中之人”。通过设备对“中之人”进行面部捕捉和动作捕捉,虚拟人物就有了表情、动作。然而这种动作捕捉的方式,需要人穿着动作捕捉服装,在专用设备前进行动作采集。因此,目前生成虚拟人物不仅需要极高的成本,而且需要花费很多时间。

技术实现要素:

4.本技术实施例提供了一种视频生成方法、装置、计算机设备及存储介质,可以高效地生成虚拟人物,并且降低生成虚拟人物的成本。

5.第一方面,本技术实施例提供了一种视频生成方法,所述方法包括:

6.获取歌曲音频数据和所述歌曲音频数据对应的歌词信息;

7.基于所述歌曲音频数据对应的歌词信息,对所述歌曲音频数据进行分段处理,得到n个音频片段数据;

8.从姿态参数库中确定所述n个音频片段数据中的每个音频片段数据对应的姿态参数序列;

9.根据人体形状参数和所述每个音频片段数据对应的姿态参数序列,生成所述歌曲音频数据对应的舞蹈视频数据。

10.在一种可能的实施方式中,所述姿态参数库中包括与姿态参数序列对应的视频特征向量;所述从姿态参数库中确定所述n个音频片段数据中的每个音频片段数据对应的姿态参数序列,包括:

11.分别对所述n个音频片段数据进行特征提取处理,得到所述n个音频片段数据对应的n个视频特征向量;

12.从所述姿态参数库中确定与所述n个音频特征向量相匹配的n个视频特征向量;

13.从所述姿态参数库中获取所述n个视频特征向量对应的姿态参数序列,所述n个视频特征向量对应的姿态参数序列为所述n个音频片段数据对应的姿态参数序列。

14.在一种可能的实施方式中,从所述姿态参数库中确定与所述n个音频特征向量相匹配的n个视频特征向量,包括:

15.分别将所述n个音频特征向量输入音视频匹配模型,得到n个目标音频特征向量,

所述目标音频特征向量与所述姿态参数库中的视频特征向量处于同一维度空间;

16.从所述姿态参数库中获取与所述n个目标音频特征向量之间欧式距离最小的n个视频特征向量。

17.在一种可能的实施方式中,所述根据人体形状参数和所述每个音频片段数据对应的姿态参数序列,生成所述歌曲音频数据对应的舞蹈视频数据,包括:

18.根据所述人体形状参数,确定虚拟人模型;

19.将所述n个音频片段数据对应的姿态参数序列按照时序进行拼接,得到所述歌曲音频数据对应的姿态参数序列;

20.控制所述虚拟人模型执行所述歌曲音频数据对应的姿态参数序列,以生成所述歌曲音频数据对应的舞蹈视频数据。

21.在一种可能的实施方式中,所述歌曲音频数据对应的歌词信息包括k句歌词和k句歌词的时间信息;所述基于所述歌曲音频数据对应的歌词信息,对所述歌曲音频数据进行分段处理,得到n个音频片段数据,包括:

22.确定所述歌曲音频数据对应的歌词相似矩阵,所述歌词相似矩阵具有k行和k列,所述歌词相似矩阵的第i行和第j列的值为所述k句歌词中第i句歌词与第j句歌词的相似度,其中i和j均为大于0,且小于或等于k的整数;

23.根据所述歌词相似矩阵和所述k句歌词的时间信息,确定分段时间戳序列;

24.基于所述分段时间戳序列,对所述歌词音频数据进行切分,得到n个音频片段数据。

25.在一种可能的实施方式中,所述根据所述歌词相似矩阵和所述k句歌词的时间信息,确定分段时间戳序列,包括:

26.基于所述歌词相似矩阵,对所述k句歌词进行划分,得到多个歌词片段,所述歌词片段包括一句或多句歌词;

27.根据所述多个歌词片段与所述k句歌词的时间信息,确定分段时间戳序列。

28.在一种可能的实施方式中,所述基于所述歌词相似矩阵,对所述k句歌词进行划分,得到多个歌词片段,包括:

29.基于所述歌词相似矩阵和相似阈值,从所述歌词相似矩阵中确定出一条或多条相似路径,所述相似路径由所述歌词相似矩阵中的一个或多个连续位置的值组成的,所述相似路径包括的值大于所述相似阈值;

30.根据一条或多条所述相似路径,对所述k句歌词进行划分,得到多个歌词片段。

31.在一种可能的实施方式中,所述方法还包括:

32.获取视频数据集,所述视频数据集包括多个视频数据;

33.对所述视频数据集中的多个视频数据分别进行分段处理,得到多个片段视频数据;

34.分别将所述多个片段视频数据输入姿态参数提取模型,得到所述多个视频数据分别对应的姿态参数序列;

35.将所述姿态参数序列存入所述姿态参数库。

36.第二方面,本技术提供了一种视频生成装置,所述装置包括:

37.获取单元,用于获取歌曲音频数据和所述歌曲音频数据对应的歌词信息;

38.处理单元,用于基于所述歌曲音频数据对应的歌词信息,对所述歌曲音频数据进行分段处理,得到n个音频片段数据;

39.所述处理单元,还用于从姿态参数库中确定所述n个音频片段数据中的每个音频片段数据对应的姿态参数序列;

40.所述处理单元,还用于根据人体形状参数和所述每个音频片段数据对应的姿态参数序列,生成所述歌曲音频数据对应的舞蹈视频数据。

41.在一种可能的实施方式中,所述姿态参数库中包括与姿态参数序列对应的视频特征向量;所述处理单元,还用于分别对所述n个音频片段数据进行特征提取处理,得到所述n个音频片段数据对应的n个视频特征向量;

42.所述处理单元,还用于从所述姿态参数库中确定与所述n个音频特征向量相匹配的n个视频特征向量;

43.所述处理单元,还用于从所述姿态参数库中获取所述n个视频特征向量对应的姿态参数序列,所述n个视频特征向量对应的姿态参数序列为所述n个音频片段数据对应的姿态参数序列。

44.在一种可能的实施方式中,所述处理单元,还用于分别将所述n个音频特征向量输入音视频匹配模型,得到n个目标音频特征向量,所述目标音频特征向量与所述姿态参数库中的视频特征向量处于同一维度空间;

45.所述处理单元,还用于从所述姿态参数库中获取与所述n个目标音频特征向量之间欧式距离最小的n个视频特征向量。

46.在一种可能的实施方式中,所述处理单元,还用于根据所述人体形状参数,确定虚拟人模型;

47.所述处理单元,还用于将所述n个音频片段数据对应的姿态参数序列按照时序进行拼接,得到所述歌曲音频数据对应的姿态参数序列;

48.所述处理单元,还用于控制所述虚拟人模型执行所述歌曲音频数据对应的姿态参数序列,以生成所述歌曲音频数据对应的舞蹈视频数据。

49.在一种可能的实施方式中,所述歌曲音频数据对应的歌词信息包括k句歌词和k句歌词的时间信息;所述处理单元,还用于确定所述歌曲音频数据对应的歌词相似矩阵,所述歌词相似矩阵具有k行和k列,所述歌词相似矩阵的第i行和第j列的值为所述k句歌词中第i句歌词与第j句歌词的相似度,其中i和j均为大于0,且小于或等于k的整数;

50.所述处理单元,还用于根据所述歌词相似矩阵和所述k句歌词的时间信息,确定分段时间戳序列;

51.所述处理单元,还用于基于所述分段时间戳序列,对所述歌词音频数据进行切分,得到n个音频片段数据。

52.在一种可能的实施方式中,所述处理单元,还用于基于所述歌词相似矩阵,对所述k句歌词进行划分,得到多个歌词片段,所述歌词片段包括一句或多句歌词;

53.所述处理单元,还用于根据所述多个歌词片段与所述k句歌词的时间信息,确定分段时间戳序列。

54.在一种可能的实施方式中,所述处理单元,还用于基于所述歌词相似矩阵和相似阈值,从所述歌词相似矩阵中确定出一条或多条相似路径,所述相似路径由所述歌词相似

矩阵中的一个或多个连续位置的值组成的,所述相似路径包括的值大于所述相似阈值;

55.所述处理单元,还用于根据一条或多条所述相似路径,对所述k句歌词进行划分,得到多个歌词片段。

56.在一种可能的实施方式中,所述获取单元,还用于获取视频数据集,所述视频数据集包括多个视频数据;

57.所述处理单元,还用于对所述视频数据集中的多个视频数据分别进行分段处理,得到多个片段视频数据;

58.所述处理单元,还用于分别将所述多个片段视频数据输入姿态参数提取模型,得到所述多个视频数据分别对应的姿态参数序列;

59.所述处理单元,还用于将所述姿态参数序列存入所述姿态参数库。

60.本技术提供了一种计算机设备,该计算机设备包括:处理器、存储器以及网络接口;处理器与存储器、网络接口相连,其中,网络接口用于提供网络通信功能,存储器用于存储程序代码,处理器用于调用程序代码,以执行第一方面所描述的方法。

61.本技术提供了一种计算机可读存储介质,该计算机可读存储介质存储有计算机程序,计算机程序包括程序指令,程序指令当被处理器执行时,执行第一方面所述的方法。

62.本技术实施例通过基于获取到的歌曲音频数据对应的歌词信息,将获取的歌曲音频数据进行分段,得到多个音频片段数据。然后将该多个音频分别在姿态参数中找到对应的姿态参数序列。最后根据人体形状参数和每个音频对应的姿态参数序列,生成歌曲音频数据对应的舞蹈视频数据。通过上述方法,可以高效地生成虚拟人物,并且降低生成虚拟人物的成本。

附图说明

63.为了更清楚地说明本技术实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本技术的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

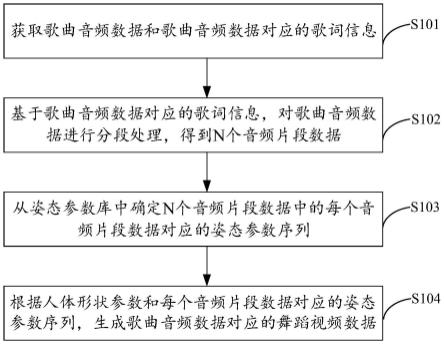

64.图1是本技术实施例提供的视频生成方法的流程示意图;

65.图2是本技术实施例提供的一实施例示意图;

66.图3是本技术实施例提供的另一实施例示意图;

67.图4是本技术实施例提供的又一实施例示意图;

68.图5是本技术实施例提供的视频生成装置的结构示意图;

69.图6是本技术实施例提供的一种计算机设备的结构示意图。

具体实施方式

70.下面将结合本技术实施例中的附图,对本技术实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本技术一部分实施例,而不是全部的实施例。基于本技术中的实施例,本领域普通技术人员在没有作出创造性劳动前提下所获得的所有其他实施例,都属于本技术保护的范围。

71.为了更好的理解本技术实施例,下面先对本技术实施例涉及的一些专业术语进行

介绍:

72.人体形状参数:又称为形状参数(shape parameters),一组形状参数有着多个维度的数值去描述一个人的形状,每一个维度的值都可以解释为人体形状的某个指标,比如高矮,胖瘦等。例如,一组形状参数有10个维度的数值去描述一个人的形状。

73.姿态参数(pose parameters):一组姿态参数有着多个维度的数字,去描述某个时刻人体的动作姿态。例如,一组姿态参数有24*3个维度去描述某个时刻人体的动作姿态,其中的24表示的是24个定义好的人体关节点,其中的3并不是如同识别问题里面定义的(x,y,z)空间位置坐标(location),而是指的是该节点针对于其父节点的旋转角度的轴角式表达(axis-angle representation)。

74.本技术实施例提供的视频生成方法可以是终端设备执行,包括但不限于:智能手机、平板电脑、笔记本电脑等设备。

75.或者,可以是芯片或者芯片系统执行,该芯片或者芯片系统可以自动生成歌曲音频数据对应的舞蹈视频数据,该芯片可以内嵌在终端设备中。

76.或者,可以是服务器执行,包括但不限于:独立的物理服务器、多个物理服务器构成的服务器集群或者分布式系统、提供云服务、云数据库、云计算、云函数、云存储、网络服务、云通信、中间件服务、域名服务、安全服务、内容分发网络(content delivery network,cdn)、以及大数据和人工智能平台等基础云计算服务的云服务器。

77.或者,可以是其他设备执行,本技术在此不做限定。

78.参见图1,为本技术实施例提供的一种视频生成方法的流程示意图。该视频生成方法包括s101~s104。其中:

79.s101、获取歌曲音频数据和歌曲音频数据对应的歌词信息。

80.其中,歌曲音频数据可以是用户演唱的歌曲,也可以是用户从网络上下载的音频数据,还可以是终端设备的麦克风实时获取的音频数据,在此不做限制。该歌曲音频数据可以是一首完整的歌曲,也可以是歌曲中的某一个片段,还可以是多首不同的歌词拼接得到的音频。

81.s102、基于歌曲音频数据对应的歌词信息,对歌曲音频数据进行分段处理,得到n个音频片段数据。

82.可选的,可基于歌曲音频数据对应的歌词信息,对歌曲音频数据进行分段处理,将该歌曲音频数据按照主歌、副歌切分为n个音频片段数据。也就是说,对歌曲音频数据进行分段处理后,主歌部分与副歌分布分在了不同的片段。

83.在一种可能的实施例中,歌曲音频数据对应的歌词信息包括k句歌词和k句歌词的时间信息;基于歌曲音频数据对应的歌词信息,对歌曲音频数据进行分段处理,得到n个音频片段数据,具体为:确定歌曲音频数据对应的歌词相似矩阵,歌词相似矩阵具有k行和k列,歌词相似矩阵的第i行和第j列的值为k句歌词中第i句歌词与第j句歌词的相似度,其中i和j均为大于0,且小于或等于k的整数;根据歌词相似矩阵和k句歌词的时间信息,确定分段时间戳序列;基于分段时间戳序列,对歌词音频数据进行切分,得到n个音频片段数据。

84.其中,k句歌词的时间信息可以是歌词中每句歌词在歌曲音频数据中对应的起始时间和持续时间。例如,某一歌曲音频数据对应的歌词信息为:[143455,3361]第一句歌词、[146816,6464]第二句歌词、[153512,3239]第三句歌词。

[0085]

其中,歌词相似矩阵具有k行和k列,该歌词相似矩阵的第i行和第j列的值为k句歌词中第i句歌词与第j句歌词的相似度。也就是说,k句歌词中的任一句歌词均需要与k句歌词中的每一句歌词进行相似度比较。

[0086]

示例性的,歌曲音频数据对应的歌词信息包括三句歌词。该歌词相似矩阵的第1行第1列(1,1)对应的值为1,则第1句歌词与第1句歌词的相似度为1。该歌词相似矩阵的第1行第2列(1,2)对应的值为0.4,则第1句歌词与第2句歌词的相似度为0.4。该歌词相似矩阵的第1行第3列(1,3)对应的值为0.5,则第1句歌词与第3句歌词的相似度为0.5。

[0087]

该歌词相似矩阵的第2行第1列(2,1)对应的值为0.4,则第2句歌词与第1句歌词的相似度为0.4。该歌词相似矩阵的第2行第2列(2,2)对应的值为1,则第2句歌词与第2句歌词的相似度为1。该歌词相似矩阵的第2行第3列(2,3)对应的值为0.5,则第2句歌词与第3句歌词的相似度为0.5。

[0088]

该歌词相似矩阵的第3行第1列(3,1)对应的值为0.5,则第3句歌词与第1句歌词的相似度为0.5。该歌词相似矩阵的第3行第2列(3,2)对应的值为0.5,则第3句歌词与第2句歌词的相似度为0.5。该歌词相似矩阵的第3行第3列(3,3)对应的值为1,则第3句歌词与第3句歌词的相似度为1。

[0089]

通常来说一首歌曲的副歌部分的歌词的文本相似度比较高。例如一首歌词包括30句歌词,其中第4句-第7句以及第20句-第23句为副歌对应的歌词,那么通常来说第4句-第7句歌词和20句-第23句歌词的相似度极高。因此,可以先根据歌词与歌词的相似度确定出副歌部分,再将副歌之外的其他部分确定为主歌部分,从而实现准确地将歌曲音频数据按照副歌部分与主歌部分进行划分。

[0090]

其中,分段时间戳序列由多个分段时间戳组成,该分段时间戳为在歌曲音频数据中分段的时间位置。

[0091]

示例性的,歌曲音频数据的时长为100000毫秒。根据歌曲相似矩阵和k句歌词的时间信息,确定分段时间戳序列为[40000,60000,80000]。根据该分段时间戳序列将该歌曲音频数据划分为四个音频片段数据:第0毫秒-第40000毫秒为第一个音频片段数据,第40000毫秒-第60000毫秒为第二个音频片段数据,第60000毫秒-第80000毫秒为第三个音频片段数据,第80000毫秒-第100000毫秒为第四个音频片段数据。

[0092]

在一种可能的实施例中,根据歌词相似矩阵和k句歌词的时间信息,确定分段时间戳序列,具体为:基于歌词相似矩阵,对k句歌词进行划分,得到多个歌词片段,歌词片段包括一句或多句歌词;根据多个歌词片段与k句歌词的时间信息,确定分段时间戳序列。

[0093]

其中,歌词片段包括一句歌词或者多句连续的歌词。分段时间戳序列包括多个分段时间戳,该分段时间戳可以是任一歌词片段中首句歌词的开始时间,也可以是任一歌词片段的前一个歌词片段中尾句歌词的结束时间,还可以是两个连续的歌词片段之间的时间间隔中的任意时间。

[0094]

示例性的,k句歌词包含5句歌词:[10000,6000]歌词1、[20000,8000]歌词2、[40000,6000]歌词3、[50000,7000]歌词4以及[60000,6000]歌词5。基于歌词相似矩阵,对该五句歌词进行划分后,得到两个歌词片段:歌词片段1(包含歌词1和歌词2)和歌词片段2(包含歌词3、歌词4以及歌词5)。其中,根据得到的两个歌词片段可见,是从歌词2与歌词3之间对五句歌词进行了切分,从而将该五句歌词划分为两部分。其中歌词2的结束时间为:

20000 8000=28000毫秒,歌词3的开始时间为40000毫秒。所以分段时间戳可以是第28000毫秒,该分段时间戳也可以是第40000毫秒,该分段时间戳还可以是从第28000毫秒至第40000毫秒中的任意时间位置(如第30000毫秒)。

[0095]

通过根据歌词片段与k句歌词的时间信息确定分段时间戳序列,可以确保同一歌词片段的歌词可以被划分在同一音频片段数据中,从而实现精准的将歌曲音频数据按照主歌和副歌划分为多段。

[0096]

在一种可能的实施例中,基于歌词相似矩阵,对k句歌词进行划分,得到多个歌词片段,具体为:基于歌词相似矩阵和相似阈值,从歌词相似矩阵中确定出一条或多条相似路径,相似路径由歌词相似矩阵中的一个或多个连续位置的值组成的,相似路径包括的值大于相似阈值;根据一条或多条相似路径,对k句歌词进行划分,得到多个歌词片段。

[0097]

其中,相似阈值可以是预设的,也可以是根据歌词相似矩阵得到的。在一种可能的实施例中,根据歌词相似矩阵得到相似阈值的过程可以是:将歌词相似矩阵中第三大的值作为相似阈值,示例性的,歌词相似矩阵中的值最大为1,歌词相似矩阵中的值第二大为0.9,歌词相似矩阵中的值第三大为0.8。将0.8作为相似阈值。可选的,还可以根据歌词相似矩阵中各个值的中位值与预设增值确定相似阈值。示例性的,歌词相似矩阵中的值的中位值为0.5,预设增值为0.3,则相似阈值为0.5 0.3=0.8。需要说明的是,相似阈值除了可以是上述方式得到的,还可以以其他方式获得,在此不做限制。

[0098]

其中,相似路径由歌词相似矩阵中的一个或多个连续的值组成的,组成相似路径的多个连续的值通常来说是歌词相似矩阵中一条斜线上的值。

[0099]

示例性的,首先通过比较文本相似度得到歌曲音频数据对应的歌词相似矩阵,可参见图2所示,图2中歌词相似矩阵201的横坐标和纵坐标表示歌曲音频数据对应的歌词信息中的歌词下标,如纵坐标中的“40”可以理解为歌曲音频数据对应的歌词信息中的第40句歌词。图2中202的刻度代表不同颜色对应的相似度值,其中202中的刻度1.0对应黑色,也就是说黑色对应的相似度值为1(完全相同),其中202中的刻度0.0对应白色,也就是说白色对应的相似度值为0(完全不同)。从而,歌词相似矩阵201中各个灰度值不同的方块代表的是该方块的横坐标对应的歌词和该方块的纵坐标对应的歌词之间的相似度。也就是说,歌词相似矩阵201中任一方块的坐标为(x1,y2)时,该方块的灰度值对应的相似度值就是第x1句歌词和第y2句歌词对应的相似度值。例如歌词相似矩阵201中存在一个方块203,该方块对应的坐标为(40,40),该方块203为黑色的方块,也就是说第40句歌词和第40句歌词是完全相同的。由此可见,由于对角线上的方块都是歌词与自身进行的比较,所以对角线上的方块都为黑色(相似度值均为1)。由图2中歌词相似矩阵201所示,除了对角线以外,矩阵中明显存在其他相似度极高的片段(歌词相似矩阵201中除了对角线以外的四条黑色的斜线中方块对应的句子)。

[0100]

首先将歌词相似矩阵201中小于相似阈值的方块置零,只保留大于相似阈值的方块,即歌词相似矩阵201包含对角线以及四条斜线。再将歌词相似矩阵201中的对角线置零,即歌词相似矩阵201包含四条斜线。然后从这四条斜线中确定出相似度值最大的斜线204与斜线205,并将斜线204与斜线205确定为相似路径。确定出斜线204与斜线205后,再将已确定的相似路径上的方块置零,即剩余斜线206和斜线207。然后再确定斜线206和斜线207为相似路径。当歌词相似矩阵201中的相似路径大于4条时,以此类推,直至找到歌词相似矩阵

201中所有的相似路径。

[0101]

再根据相似路径,对歌词进行划分,得到多个歌词片段。例如,针对图2中的相似路径204,该相似路径204是由五个方块组成,这五个方块的坐标分别为:[7,29]、[8,30]、[9,31]、[10,32]、[11,33]。其中,[7,29]的方块代表第7句歌词与第29句歌词是相同的(第7句歌词与第29句歌词的相似度值大于相似阈值),其他4个方块类似。因此,该相似路径204代表第7句歌词~第11句歌词组成的片段与第29句歌词~第33句歌词组成的片段是相同的。因此,可以将第7句歌词~第11句歌词分在同一歌词片段中,将第29句歌词~第33句歌词分在另一歌词片段中。基于其他相似路径确定歌词片段同理,在此不赘述。

[0102]

根据相似路径对k句歌词进行划分,可以准确的将相似度高的歌词划分进同一歌词片段,使得后续对歌曲音频数据的划分更加准确。

[0103]

由于一首歌曲中有平缓的部分和相对激昂的部分,所以一首歌曲对应的舞蹈应该也具有平缓的部分和相对激昂的部分。将歌曲音频数据进行分段,再由后续确定每一段对应的姿态参数序列,就可以实现在歌曲平淡的时候对应的舞蹈也是平淡的,歌曲激昂的时候对应的舞蹈也是激昂的。

[0104]

s103、从姿态参数库中确定n个音频片段数据中的每个音频片段数据对应的姿态参数序列。

[0105]

其中,姿态参数序列为多个姿态参数按照时序排列后得到的,该姿态参数序列用于表示一段时间内虚拟人物的一个或多个动作。姿态参数库包括多段姿态参数序列。

[0106]

在一种可能的实施例中,姿态参数库的构建具体为:获取视频数据集,视频数据集包括多个视频数据;对视频数据集中的多个视频数据分别进行分段处理,得到多个片段视频数据;分别将多个片段视频数据输入姿态参数提取模型,得到多个视频数据分别对应的姿态参数序列;将姿态参数序列存入姿态参数库。

[0107]

其中,视频数据集包括的多个视频数据包含背景音乐以及歌词信息。对视频数据集中的每个视频数据分别根据其对应的歌词信息进行分段处理,得到多个片段视频数据。该分段处理可以参见上述s102中提及的对歌曲音频数据进行分段处理的描述,s102是通过歌词信息对歌曲音频数据进行分段处理,在这里是通过视频数据包含的歌词信息对视频数据进行分段处理。同样也是根据视频数据包含的歌词信息的相似度,得到视频数据对应的分段时间戳序列,从而根据该分段时间戳序列对视频数据进行分段处理。

[0108]

可选的,该姿态提取模型包括卷积神经网络(convolutional neural networks,cnn)、时序编码器(该时序编码器由双向门控制循环单元(bidirectional gated recurrent units,gru)组成的)、动作判别器(motion discriminatior)、人体参数回归器(generator)。在训练该姿态提取模型的过程中,首先,对样本片段视频数据进行等间距采样,得到若干张图片。然后通过上述卷积神经网络、人体参数回归器以及时序编码器预测人体模型参数,该人体模型参数包括人体形状参数和姿态参数。然后通过动作判别器预测该人体模型参数的真假标签。如果动作判别器预测该人体模型参数为真标签,则表示该姿态提取模型提取到的人体模型参数与照片中真实的人的形状动作极其接近,进而表明该特征提取模型训练完成。

[0109]

需要说明的是,为了方便描述,上述是针对多个带有歌词信息的视频数据中的任一带有歌词信息的视频数据进行的描述。该流程可以是对多个带有歌词信息的视频数据同

时进行的,也可以是依次进行的。在此本技术不做限制。

[0110]

通过将视频数据进行分段后,进行姿态提取处理,得到姿态参数序列,将该姿态参数序列存入姿态参数库。可以使得构建的姿态参数库内的姿态参数序列十分准确,从而使得后续可以精准地匹配歌曲音频数据对应的姿态参数。

[0111]

在一种可能的实施例中,姿态参数库中包括与姿态参数序列对应的视频特征向量;从姿态参数库中确定n个音频片段数据中的每个音频片段数据对应的姿态参数序列,具体为:分别对n个音频片段数据进行特征提取处理,得到n个音频片段数据对应的n个音频特征向量;从姿态参数库中确定与n个音频特征向量相匹配的n个视频特征向量;从姿态参数库中获取n个视频特征向量对应的姿态参数序列,n个视频特征向量对应的姿态参数序列为n个音频片段数据对应的姿态参数序列。

[0112]

姿态参数库中包括与姿态参数序列对应的视频特征向量。例如,可以收集多个带有歌词信息的视频数据。然后通过分段处理,将视频数据分段为多个片段视频数据。其中,该分段处理可以是上述s102中所描述的分段处理,根据视频数据对应的歌词信息对该视频数据进行分段,得到多段片段视频数据。对片段视频数据进行特征提取处理。通过特征提取处理对该片段视频数据进行特征提取得到该片段视频数据对应的视频特征向量。最后将该视频特征向量存入姿态参数库。

[0113]

由于无法直接进行音频片段数据与姿态参数系列的匹配,但是歌曲音频数据与视频数据的匹配是可以进行的,所以首先将音频片段数据对应的音频特征向量与视频特征向量进行匹配,得到该音频片段数据对应的视频特征向量,从而根据视频特征向量确定出该音频片段数据对应的姿态参数序列。

[0114]

其中,对n个音频片段数据进行特征提取处理可以是按照预设好的采样率和采样时长,对每个音频片段数据进行取样,然后使用谐波冲击源分离(harmonic percussive source separation,hpss)得到增强的音频特征,然后基于傅立叶变换和特征提取方法(如梅尔倒谱系数)提取每个音频片段数据对应的音频特征向量。

[0115]

其中,特征提取处理操作可以具体为是:针对片段视频数据进行等间距采样,得到若干张图片,然后逐帧进行特征提取,得到该片段视频数据对应的视频特征向量。

[0116]

在一种可能的实施例中,从姿态参数库中确定与n个音频特征向量相匹配的n个视频特征向量包括:分别将n个音频特征向量输入音视频匹配模型,得到n个目标音频特征向量,目标音频特征向量与姿态参数库中的视频特征向量处于同一维度空间;从姿态参数库中获取与n个目标音频特征向量之间欧式距离最小的n个视频特征向量。

[0117]

其中,目标音频特征向量与姿态参数库中的视频特征向量处于同一维度空间,且该目标音频特征向量与音频特征向量维度不同。将该音频特征向量输入音视频匹配模型中进行处理后,可以得到该音频特征向量对应的目标音频特征向量,从而后续能够利用该目标音频特征向量为该音频特征向量匹配到合适的视频特征向量。也就是说,音视频匹配模型能够将音频特征向量映射到与姿态参数库中的视频特征向量相同的空间维度。

[0118]

示例性的,n个音频特征向量中的一个音频特征向量a为128维,姿态参数库中的视频特征向量为512维。将该音频特征向量a输入音视频匹配模型中后,由音视频匹配模型对该128维的音频特征向量a进行处理后输出一个521维的目标音频特征向量。

[0119]

在一种可能的实施例中,从姿态参数库中获取与n个目标音频特征向量之间欧式

距离最小的n个特征向量,包括:将n个目标音频特征向量中的任一目标音频特征向量依次与姿态参数库中的视频特征向量计算欧式距离;将欧式距离最小的视频特征向量作为该任一目标音频特征向量对应的视频特征向量。

[0120]

其中,欧式距离的大小代表两个向量的相似度高低,如果两个向量的欧式距离小,则代表两个向量之间的相似度高;如果两个向量的欧式距离大,则代表两个向量之间的相似度低。欧式距离的计算公式如下:

[0121][0122]

其中,d(x,y)代表欧式距离,x代表向量x(x1,x2,x3,

…

xn),y代表向量y(y,y2,y3,

…

yn),n代表x向量和y向量的长度。

[0123]

s104、根据人体形状参数和每个音频片段数据对应的姿态参数序列,生成歌曲音频数据对应的舞蹈视频数据。

[0124]

其中,人体形状参数可以是用户自定义选择的,也可以是系统默认设置的人体形状参数,还可以是根据歌曲类型自动确定的。该人体形状参数决定了虚拟人物的外观(如高矮胖瘦)。姿态参数序列中的姿态参数决定了虚拟人物在某一时刻对应的姿态,该姿态参数通过将虚拟人物的关节点进行旋转,达到在某一时刻虚拟人物实现某动作的目的。如图3所示,图3中301表示某一时刻的姿态参数对应的动作,根据该姿态参数对虚拟人物的各个关节点进行旋转得到摆出该动作的虚拟人物,如图3中的302所示。

[0125]

可选的,人体形状参数是用户自定义选择的时,用户可以在预设的人体形状参数库中进行选择,确定最后虚拟人物的人体形状参数。例如,人体形状参数库中包含身高形状参数库,用户可以在头部形状参数库中选择虚拟人物是高个子。再例如,人体形状参数库中包含身材形状参数库,用户可以在身材形状参数库中选择虚拟人物身材为苗条。最后根据用户选择出来的各个形状参数(如高个子、苗条),作为虚拟人物的人体形状参数。

[0126]

可选的,人体形状参数是根据歌曲类型确定的时,存在一个人体形状参数与歌曲类型的映射表。根据歌曲的类型,从该映射表中确定出虚拟人物的人体形状参数。例如,歌曲的类型为儿歌时,在映射表中对应的人物形象为小朋友。

[0127]

在一种可能的实施例中,根据人体形状参数和每个音频片段数据对应的姿态参数序列,生成歌曲音频数据对应的舞蹈视频数据,具体为:根据人体形状参数,确定虚拟人模型;将n个音频片段数据对应的姿态参数序列按照时序进行拼接,得到歌曲音频数据对应的姿态参数序列;控制所述虚拟人模型执行所述歌曲音频数据对应的姿态参数序列,以生成所述歌曲音频数据对应的舞蹈视频数据。

[0128]

其中,根据人体形状参数确定虚拟人模型就是根据人体形状参数确定虚拟人物的外表。其中,将姿态参数序列按照时序进行拼接可以是根据n段音频片段数据在歌曲音频片段的时间位置,对n个音频片段数据对应的姿态参数序列进行拼接。例如,有三段音频片段数据:音频片段数据1、音频片段数据2、音频片段数据3。这三段音频片段数据对应的姿态参数序列分别为:姿态参数序列1、姿态参数序列2、姿态参数序列3。其中,音频片段数据1位于歌曲音频数据的第2分钟、音频片段数据2位于歌曲音频数据的第1分钟、音频片段数据3位于歌曲音频数据的第3分钟,则根据该三段音频片段数据在歌曲音频片段的时间位置,对三

个姿态参数序列进行拼接的顺序为:姿态参数序列2、姿态参数序列1、姿态参数序列3。

[0129]

示例性的,如图4所示,根据人体形状参数确定出图4中401所标记的虚拟人模型,然后根据图4中402标记的姿态参数,确定出在该时刻虚拟人物的姿态403。

[0130]

参见图5,图5是本技术实施例提供的视频生成装置的结构示意图。本技术实施例提供的视频生成装置包括:获取单元501和处理单元502。

[0131]

获取单元501,用于获取歌曲音频数据和歌曲音频数据对应的歌词信息;

[0132]

处理单元502,用于基于歌曲音频数据对应的歌词信息,对歌曲音频数据进行分段处理,得到n个音频片段数据;

[0133]

处理单元502,还用于从姿态参数库中确定n个音频片段数据中的每个音频片段数据对应的姿态参数序列;

[0134]

处理单元502,还用于根据人体形状参数和每个音频片段数据对应的姿态参数序列,生成歌曲音频数据对应的舞蹈视频数据。

[0135]

在另一种实现中,姿态参数库中包括与姿态参数序列对应的视频特征向量;处理单元,还用于分别对n个音频片段数据进行特征提取处理,得到n个音频片段数据对应的n个音频特征向量;

[0136]

处理单元502,还用于从姿态参数库中确定与n个音频特征向量相匹配的n个视频特征向量;

[0137]

处理单元502,还用于从姿态参数库中获取n个视频特征向量对应的姿态参数序列,n个视频特征向量对应的姿态参数序列为n个音频片段数据对应的姿态参数序列。

[0138]

在另一种实现中,处理单元502,还用于分别将n个音频特征向量输入音视频匹配模型,得到n个目标音频特征向量,目标音频特征向量与姿态参数库中的视频特征向量处于同一维度空间;

[0139]

处理单元502,还用于从姿态参数库中获取与n个目标音频特征向量之间欧式距离最小的n个视频特征向量。

[0140]

在另一种实现中,处理单元502,还用于根据人体形状参数,确定虚拟人模型;

[0141]

处理单元502,还用于将n个音频片段数据对应的姿态参数序列按照时序进行拼接,得到歌曲音频数据对应的姿态参数序列;

[0142]

处理单元502,还用于控制虚拟人模型执行歌曲音频数据对应的姿态参数序列,以生成歌曲音频数据对应的舞蹈视频数据。

[0143]

在另一种实现中,歌曲音频数据对应的歌词信息包括k句歌词和k句歌词的时间信息;处理单元502,还用于确定歌曲音频数据对应的歌词相似矩阵,歌词相似矩阵具有k行和k列,歌词相似矩阵的第i行和第j列的值为k句歌词中第i句歌词与第j句歌词的相似度,其中i和j均为大于0,且小于或等于k的整数;

[0144]

处理单元502,还用于根据歌词相似矩阵和k句歌词的时间信息,确定分段时间戳序列;

[0145]

处理单元502,还用于基于分段时间戳序列,对歌词音频数据进行切分,得到n个音频片段数据。

[0146]

在另一种实现中,处理单元502,还用于基于歌词相似矩阵,对k句歌词进行划分,得到多个歌词片段,歌词片段包括一句或多句歌词;

[0147]

处理单元502,还用于根据多个歌词片段与k句歌词的时间信息,确定分段时间戳序列。

[0148]

在另一种实现中,处理单元502,还用于基于歌词相似矩阵和相似阈值,从歌词相似矩阵中确定出一条或多条相似路径,相似路径由歌词相似矩阵中的一个或多个连续位置的值组成的,相似路径包括的值大于相似阈值;

[0149]

处理单元502,还用于根据一条或多条相似路径,对k句歌词进行划分,得到多个歌词片段。

[0150]

在另一种实现中,获取单元501,还用于获取视频数据集,视频数据集包括多个视频数据;

[0151]

处理单元502,还用于对视频数据集中的多个视频数据分别进行分段处理,得到多个片段视频数据;

[0152]

处理单元502,还用于分别将多个片段视频数据输入姿态参数提取模型,得到多个视频数据分别对应的姿态参数序列;

[0153]

处理单元502,还用于将姿态参数序列存入姿态参数库。

[0154]

可以理解的是,本技术实施例提供的视频生成装置的各功能单元的功能可根据上述方法实施例中的方法具体实现,其具体实现过程可以参照上述方法实施例中的相关描述,此处不再赘述。

[0155]

在其它可行的实施例中,本技术实施例提供的视频生成装置也可以采用软硬件结合的方式实现,作为示例,本技术实施例提供的视频生成装置可以是采用硬件译码处理器形式的处理器,其被编程以执行本技术实施例提供的视频生成方法,例如,硬件译码处理器形式的处理器可以采用一个或多个应用专用集成电路(asic,application specific integrated circuit)、dsp、可编程逻辑器件(pld,programmable logic device)、复杂可编程逻辑器件(cpld,complex programmable logic device)、现场可编程门阵列(fpga,field-programmable gate array)或其他电子元件。

[0156]

请参见图6,是本技术实施例提供的一种计算机设备的结构示意图,该计算机设备60可以包括处理器601、存储器602、网络接口603和至少一个通信总线604。其中,处理器601用于调度计算机程序,可以包括中央处理器、控制器、微处理器;存储器602用于存储计算机程序,可以包括高速随机存取存储器ram,非易失性存储器,例如磁盘存储器件、闪存器件;网络接口603可选的可以包括标准的有线接口、无线接口(如wi-fi接口),提供数据通信功能,通信总线604负责连接各个通信元件。该计算机设备60还可以包括音频接口,该音频接口用于收录音频,该音频接口可选的可以包括麦克风。存储器602用于存储计算机程序,该计算机程序包括程序指令,处理器601用于执行存储器602存储的程序指令,以执行上述实施例中步骤s101至步骤s104中描述的过程,执行如下操作:

[0157]

在一种实现中,获取歌曲音频数据和歌曲音频数据对应的歌词信息;

[0158]

基于歌曲音频数据对应的歌词信息,对歌曲音频数据进行分段处理,得到n个音频片段数据;

[0159]

从姿态参数库中确定n个音频片段数据中的每个音频片段数据对应的姿态参数序列;

[0160]

根据人体形状参数和每个音频片段数据对应的姿态参数序列,生成歌曲音频数据

对应的舞蹈视频数据。

[0161]

具体实现中,上述计算机设备可通过其内置的各个功能模块执行如上述图1中各个步骤所提供的实现方式,具体可参见上述各个步骤所提供的实现方式,在此不再赘述。

[0162]

本技术实施例还提供一种计算机可读存储介质,该计算机可读存储介质存储有计算机程序,该计算机程序包括程序指令,该程序指令被处理器执行时实现图1中各个步骤所提供的视频生成方法,具体可参见上述各个步骤所提供的实现方式,在此不再赘述。

[0163]

上述计算机可读存储介质可以是前述任一实施例提供的推荐模型训练装置或者上述终端设备的内部存储单元,例如电子设备的硬盘或内存。该计算机可读存储介质也可以是该电子设备的外部存储设备,例如该电子设备上配备的插接式硬盘,智能存储卡(smart media card,smc),安全数字(secure digital,sd)卡,闪存卡(flash card)等。进一步地,该计算机可读存储介质还可以既包括该电子设备的内部存储单元也包括外部存储设备。该计算机可读存储介质用于存储该计算机程序以及该电子设备所需的其他程序和数据。该计算机可读存储介质还可以用于暂时地存储已经输出或者将要输出的数据。

[0164]

本技术的权利要求书和说明书及附图中的术语“第一”、“第二”、“第三”、“第四”等是用于区别不同对象,而不是用于描述特定顺序。此外,术语“包括”和“具有”以及它们任何变形,意图在于覆盖不排他的包含。例如包含了一系列步骤或单元的过程、方法、系统、产品或设备没有限定于已列出的步骤或单元,而是可选地还包括没有列出的步骤或单元,或可选地还包括对于这些过程、方法、产品或设备固有的其它步骤或单元。

[0165]

在本技术的具体实施方式中,涉及到用户信息(如歌曲音频数据等)相关的数据,当本技术以上实施例运用到具体产品或技术中时,需要获得用户许可或者同意,且相关数据的收集、使用和处理需要遵守相关国家和地区的相关法律法规和标准。

[0166]

在本文中提及“实施例”意味着,结合实施例描述的特定特征、结构或特性可以包含在本技术的至少一个实施例中。在说明书中的各个位置展示该短语并不一定均是指相同的实施例,也不是与其它实施例互斥的独立的或备选的实施例。本领域技术人员显式地和隐式地理解的是,本文所描述的实施例可以与其它实施例相结合。在本技术说明书和所附权利要求书中使用的术语“和/或”是指相关联列出的项中的一个或多个的任何组合以及所有可能组合,并且包括这些组合。本领域普通技术人员可以意识到,结合本文中所公开的实施例描述的各示例的单元及算法步骤,能够以电子硬件、计算机软件或者二者的结合来实现,为了清楚地说明硬件和软件的可互换性,在上述说明中已经按照功能一般性地描述了各示例的组成及步骤。这些功能究竟以硬件还是软件方式来执行,取决于技术方案的特定应用和设计约束条件。专业技术人员可以对每个特定的应用来使用不同方法来实现所描述的功能,但是这种实现不应认为超出本技术的范围。

[0167]

本技术实施例提供的方法及相关装置是参照本技术实施例提供的方法流程图和/或结构示意图来描述的,具体可由计算机程序指令实现方法流程图和/或结构示意图的每一流程和/或方框、以及流程图和/或方框图中的流程和/或方框的结合。这些计算机程序指令可提供到通用计算机、专用计算机、嵌入式处理机或其他可编程数据处理设备的处理器以产生一个机器,使得通过计算机或其他可编程数据处理设备的处理器执行的指令产生用于实现在流程图一个流程或多个流程和/或结构示意图一个方框或多个方框中指定的功能的装置。这些计算机程序指令也可存储在能引导计算机或其他可编程数据处理设备以特定

方式工作的计算机可读存储器中,使得存储在该计算机可读存储器中的指令产生包括指令装置的制造品,该指令装置实现在流程图一个流程或多个流程和/或结构示意图一个方框或多个方框中指定的功能。这些计算机程序指令也可装载到计算机或其他可编程数据处理设备上,使得在计算机或其他可编程设备上执行一系列操作步骤以产生计算机实现的处理,从而在计算机或其他可编程设备上执行的指令提供用于实现在流程图一个流程或多个流程和/或结构示意一个方框或多个方框中指定的功能的步骤。

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。