一种基于去噪概率扩散模型的语音增强加速方法

- 国知局

- 2024-06-21 11:49:33

本发明属于机器学习中的神经网络,涉及一种语音增强方法,尤其涉及一种基于去噪扩散概率模型的语音增强加速方法。

背景技术:

1、语音增强的主要目的是提升在不规律背景噪声下的语音信号的听觉感知质量,即去除语音信号的背景噪声并还原出干净的语音。由于语音增强在语音识别,语音合成以及语音信号传输等各个应用中都发挥了重要影响,随着扩散模型的不断发展与其在计算机视觉领域的成功运用与普及,利用去噪概率扩散模型的语音增强最近引起了越来越多的关注。

2、传统的利用去噪概率扩散模型的语音增强任务中,通常可以分为两类:(1)显著式条件引导:该方法通过利用直接的条件信息对扩散过程进行指导,利用设计条件分类器或在反向过程中直接引入条件信息实现进行显式的去噪概率扩散模型语音增强任务;(2)隐藏式条件引导:该方法通过设计特定的深度神经网络(dnn)结构,通过特定的深度神经网络训练框架实现去噪概率扩散模型的语音增强。

3、但是,现有的去噪概率扩散模型语音增强方法普遍存在的问题是时间开销较大,需要在推理过程中利用多个时间步迭代才可能能够合成较高质量的语音样本,这直接导致了语音合成的计算开销较大,从而阻碍的利用去噪概率扩散模型的语音增强在真实场景下的运用。

技术实现思路

1、本发明的目的是针对现有技术存在的上述技术问题,提供一种基于扩散模型的语音增强加速方法,引入浅层扩散策略,在反向过程的中间步骤启动推理过程而不利用完整的反向扩散轨迹,显著减少推断时的时间开销,以实现快速且高质量的语音增强。

2、本发明的思路为,构造一个基于去噪概率扩散模型(denoising diffusionprobabiblistic model,ddpm)的框架来实现语音增强(speechenhancement)任务以及其高效率增强的需求。首先替换深度神经网络的训练目标,直接学习噪声语音与干净语音之间的映射关系,在此基础上,得以引入浅层扩散策略(shallowdiffusion),用于在中间步骤执行反向推断任务以实现加速,使得在扩散模型的前向过程的中间步骤能够获得足够的先验知识(priorknowledge);同时,考虑到噪声语音与干净语音之间概率分布的差异情况,动态的选择前向过程的时间步骤,从而帮助减小分布差异;其次,提出一种新颖的噪声预测器(noisypredictor)模块,对需要语音增强的噪声语音进行初步预测与降噪,以获得更好的语音增强估计。最后,将噪声预测器提供的更好的估计重用于去噪扩散概率模型中,将多步采样步骤化简为两步采样,以进一步加速采样,同时帮助减少采样步骤中的误差,获得更好的语音增强估计。

3、基于上述发明思路,本发明提出了一种基于去噪扩散概率模型的语音增强加速方法,包括以下步骤:

4、s1依据浅层扩散策略,选择加入高斯噪声的时间步骤,进而向待增强语音加入高斯噪声,并利用第一噪声预测器对加入高斯噪声的待增强语音进行初步去噪,得到初步去噪语音;

5、s2依据给定的时间步骤,向初步去噪语音加入高斯噪声,并利用第二噪声预测器对加入高斯噪声的初步去噪语音进行进一步去噪,得到增强后的语音。

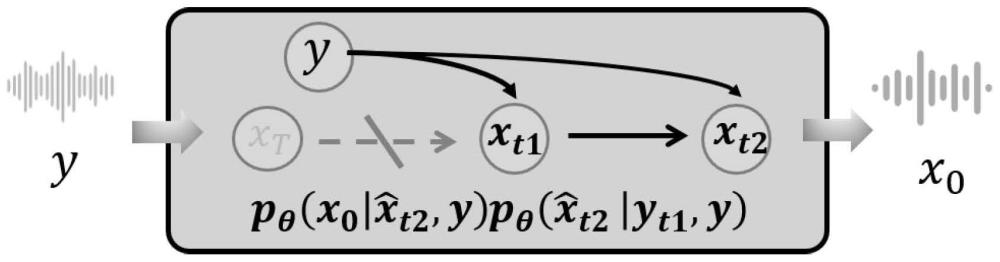

6、上述基于去噪扩散概率模型的语音增强加速方法,满足以下条件概率公式:

7、

8、式中,表示第一噪声预测器满足的条件概率分布,y表示待增强语音,表示加入高斯噪声的待增强语音,表示加入高斯噪声的初步去噪语音,∈表示高斯噪声;表示第一噪声预测器预测得到的初步去噪语音;表示第二噪声预测器满足的条件概率分布。

9、上述基于去噪扩散概率模型的语音增强加速方法,第一噪声预测器和第二噪声预测器使用的是深度神经网络;所述深度神经网络可以为带有残差模块的u型网络、带有时间编码的u型网络或transfomer架构的深度神经网络等。对于给定的噪声语音y与干净语音x,在模型的训练阶段利用深度神经网络学习带有不同强度的高斯噪声的语音与干净语音之间的映射关系。上述第一噪声预测器和第二噪声预测器使用的深度神经网络定义为fθ(xt,y,t),其中,fθ表示深度神经网络,θ代表深度神经网络中可学习到的参数,xt表示含有时间步骤t时刻高斯噪声的语音,y是需要进行语音增强的语音;以xt,y,t为深度神经网络的输入,得到预测的干净语音。

10、上述深度神经网络训练过程中,训练集中样本数据包括干净语音和相应的噪声语音。将训练集中的干净语音x0加入高斯噪声,得到加入高斯噪声的干净语音xt,并服从其中t∈1,2,…,t,t为去噪扩散概率模型的超参数,在本发明中被设置为50,且α0>α1>…>αt,也是去噪扩散概率模型的参数之一,这里设置其服从指数分布,最小值为0.035。每一个不同时间步骤t代表不同大小的高斯噪声。随着时间步骤t的增大,语音中所含的高斯噪声越多。根据去噪扩散概率模型训练的相关知识,当时间步骤t=t时,加入高斯噪声的语音最终也会转化为高斯噪声,由此可得xt~n(0,i)。

11、因此,上述深度神经网络训练过程中,以高斯噪声的干净语音xt、干净语音x0和相应的噪声语音y为输入,以预测的干净语音为输出。定义深度神经网络在训练时的均方差损失函数如下:

12、

13、通过不断的训练将的值降到最小,得到具有去噪能力的深度神经网络。

14、上述基于去噪扩散概率模型的语音增强加速方法,利用浅层扩散策略向待增强语音加入高斯噪声。在去噪扩散概率模型的前向过程时为待增强的语音加入高斯噪声,从而得到带有一定信息的先验分布。

15、依据浅层扩散策略的定义选择时间步骤t。在推理阶段中,完整的推理过程所需要调用深度神经网络的次数,即为时间步骤的t=50次。由于采用完整的推理过程所需要的时间步骤较多。可以通过选择时间步骤t<t减少时间步骤来得到干净的语音,满足如下的条件概率公式:

16、

17、这里的t为去噪扩散概率模型中的参数,在实验中设置为35。y为待增强的语音,x0为通过增强后得到的语音,xt为加入时间步骤为t的高斯噪声的语音。

18、利用去噪扩散概率模型的前向过程使数据分布相同。待增强的语音与干净的语音在数据分布上不同,但在二者加入足够的高斯噪声后,最终均会变化为标准正态分布,此时二者的分布相同。因此利用去噪扩散概率模型的前向过程对待增强的语音加入高斯噪声,使得其满足前面所提出条件概率公式中的先验部分,即加入高斯噪声后待增强语音的分布与高斯噪声后的干净语音的分布相同且均不为标准正态分布,满足由此得到具有原本的语音的一部分信息的先验分布。

19、通过第一噪声预测器处理带有信息的先验分布,进而得到更接近干净语音所能得到的分布。利用已训练好的深度神经网络作为第一噪声预测器,使得带增强语音与干净语音之间的分布最小化。并定义第一噪声预测器优化的分布为其中,为加入了高斯噪声且时间步骤为t1的待增强语音;y为待增强的语音;t1为浅层扩散策略给定的时间步骤,也即向待增强语音加入高斯噪声,至待增强语音满足先验分布的时间步骤;为神经网络在得到上述三个参数后,便能够最小化待增强语音与干净语音之间的分布,输出预测的初步去噪语音。

20、上述基于去噪扩散概率模型的语音增强加速方法,步骤s2中,利用第二噪声预测器对噪声预测器预测的语音一步去噪。第一噪声预测器得到的语音作为中间产物,还需要经过去噪扩散概率模型进行语音增强。因此本发明将第一噪声预测器进行优化后的语音加入了给定时间步骤为t2高斯噪声。相应的,对去噪扩散模型的反向过程设置时间步骤为t2来进行去噪。此外,为了更进一步的加速去噪扩散概率模型的语音增强速度,将总次数为t2次的去噪转换为一步去噪,即将上述条件概率公式转换为:

21、

22、其中,后验部分由多次去噪的分布的累计乘法变为了一步去噪,时间步骤t2我们可以预先设定为15。通过上述公式,就能通过待去噪语音得到预测的干净语音。

23、因此,本发明主要利用去噪扩散概率模型对带有噪声的语音进行语音增强,通过引入浅层扩散策略,自适应时间步长启动推理过程来加速采样。此外,本发明还提出专用的噪声预测器来指导时间步骤的自适应选择,解决扩散模型效率低下问题,同时通过减少扩散模型推理过程中的迭代步骤来提高生成样本的质量。

24、与现有技术相比,本发明提供的基于去噪扩散概率模型的语音增强加速方法具有以下

25、有益效果:

26、(1)本发明基于去噪扩散概率模型的语音增强加速方法,提升了传统的基于去噪扩散概率模型的语音增强效率及质量,不需要数十次调用深度神经网络,仅需要调用两次深度神经网络就能够很好的完成语音增强的任务;

27、(2)本发明基于去噪扩散概率模型的语音增强加速方法,利用浅层扩散策略将待处理的语音加入一定的高斯噪声,从而最小化待处理的语音与干净语音在分布上的差异,且无需将上述两个分布转化为标准正态分布,从而减少时间步骤,提升了模型的效率以及语音质量;

28、(3)本发明基于去噪扩散概率模型的语音增强加速方法,利用对训练目标的转换,将噪声预测器所需要的神经网络替换为训练去噪扩散模型时的神经网络,同时将多步去噪的任务转换为一步去噪,从而大幅加快语音增强的速度。

本文地址:https://www.jishuxx.com/zhuanli/20240618/23787.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表