一种模型生成方法、音频处理方法、装置、设备和介质与流程

- 国知局

- 2024-06-21 10:39:51

本技术属于音频处理,具体涉及一种模型生成方法、音频处理方法、装置、设备和介质。

背景技术:

1、随着计算机行业的快速发展,人工智能成为了目前关注度最高的发展方向。其中,语音识别技术就是能够让机器通过识别和理解过程把语音信号转变为相应的文本或命令的技术。语音识别技术主要包括特征提取技术、模式匹配准则及模型训练技术三个方面。

2、相关技术中,可以通过人工神经网络进行语音识别和语音生成。在语音生成的相关技术中,可以通过基于码本映射的方法进行语音生成。基于码本映射的方法可以是,将源语音和目标语音分别分为很多个段落,这些段落即可称之为码本。生成语音时,将源语音的音色部分直接替换为目标目标说话人的音色部分,这样生成的语音就完全由目标语音中的段落组成,但是具有目标说话人的音色特征。

3、但是这种方法生成的语音风格变化较少,导致生成语音的丰富度较差。

技术实现思路

1、本技术旨在提供一种模型生成方法、装置、电子设备及存储介质,以解决现有技术中生成语音的丰富度较差的问题。

2、为了解决上述技术问题,本技术是这样实现的:

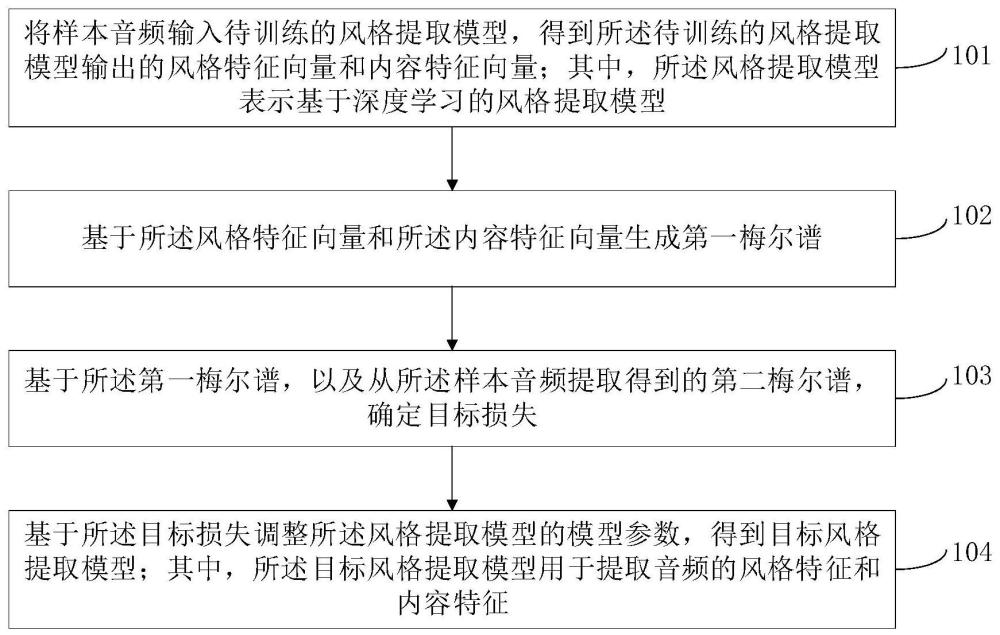

3、一种模型生成方法,所述方法包括:

4、将样本音频输入待训练的风格提取模型,得到所述待训练的风格提取模型输出的风格特征和内容特征;其中,所述风格提取模型表示基于深度学习的风格提取神经网络模型;

5、基于所述风格特征和所述内容特征生成第一梅尔谱;

6、基于所述第一梅尔谱,以及从所述样本音频提取得到的第二梅尔谱,确定目标损失;

7、基于所述目标损失调整所述风格提取模型的模型参数,得到目标风格提取模型;其中,所述目标风格提取模型用于提取音频的风格特征和内容特征。

8、可选地,所述风格提取模型包括特征提取量化网络和风格特征提取网络,所述将样本音频输入待训练的风格提取模型,得到所述待训练的风格提取模型输出的风格特征和内容特征,包括:

9、将样本音频输入所述特征提取量化网络,得到所述特征提取量化网络输出的量化特征;

10、将所述量化特征输入所述风格特征提取网络,得到所述风格特征提取网络输出的风格特征;

11、将所述音频特征进行特征融合,得到内容特征。

12、可选地,所述特征提取量化网络包括特征提取层和特征量化层,所述将样本音频输入所述特征提取量化网络,得到所述特征提取量化网络输出的量化特征,包括;

13、将样本音频输入所述特征提取层,得到所述特征提取层输出的音频特征;

14、将所述音频特征输入特征量化层,得到所述特征量化层输出的量化特征;其中,所述特征量化层用于对所述音频特征进行数字化采样处理。

15、可选地,所述将所述量化特征输入所述风格特征提取网络,得到所述风格特征提取网络输出的风格特征,包括:

16、确定所述风格特征提取网络的第一维度数;

17、基于所述第一维度数,对所述量化特征进行维度变形,得到异化特征;其中,所述异化特征的维度数为第一维度数;

18、确定所述异化特征的各个维度的权重值;

19、对所述权重值进行组合,得到所述风格特征。

20、可选地,所述目标损失包括梅尔谱均方差、梅尔谱协方差、梅尔谱方差中的至少一个。

21、一种音频处理方法,其特征在于,所述方法包括:

22、获取第一音频;

23、将所述第一音频输入目标风格提取模型,得到所述目标风格提取模型输出的第一风格特征和第一内容特征;所述目标风格提取模型用于提取音频的目标风格特征;

24、将所述第一风格特征和第一内容特征输入音色转换模型,得到所述音色转换模型输出的目标音频;其中,所述音色转换模型用于将所述第一风格特征和所述第一内容特征进行融合。

25、可选地,所述音色转换模型包括归化编码器和声码器,所述将所述第一风格特征和第一内容特征输入音色转换模型,得到所述音色转换模型输出的目标音频,包括:

26、将所述第一风格特征和所述第一内容特征输入所述归化编码器,得到所述归化编码器输出的第三梅尔谱;所述归化编码器表示基于深度学习的梅尔谱生成神经网络模型;

27、将所述第三梅尔谱输入所述声码器,得到所述声码器输出的的目标音频;其中,所述目标音频具有所述声码器对应的预设音色。

28、可选地,所述将所述第一风格特征和第一内容特征输入音色转换模型,得到所述音色转换模型输出的目标音频,包括;

29、确定所述第一风格特征与预设风格特征集合中的各个预设风格特征的相似度;

30、基于所述相似度最大的预设风格特征确定所述目标音频的音频风格。

31、一种模型生成装置,所述装置包括:

32、输入模块,用于将样本音频输入待训练的风格提取模型,得到所述待训练的风格提取模型输出的风格特征和内容特征;其中,所述风格提取模型表示基于深度学习的风格提取神经网络模型;

33、生成模块,用于基于所述风格特征和所述内容特征生成第一梅尔谱;

34、确定模块,用于基于所述第一梅尔谱,以及从所述样本音频提取得到的第二梅尔谱,确定目标损失;

35、调整模块,用于基于所述目标损失调整所述风格提取模型的模型参数,得到目标风格提取模型;其中,所述目标风格提取模型用于提取音频的风格特征和内容特征。

36、可选地,所述风格提取模型包括特征提取量化网络和风格特征提取网络,所述输入模块,包括:

37、第一输入子模块,用于将样本音频输入所述特征提取量化网络,得到所述特征提取量化网络输出的量化特征;

38、第二输入子模块,用于将所述量化特征输入所述风格特征提取网络,得到所述风格特征提取网络输出的风格特征;

39、融合子模块,用于将所述音频特征进行特征融合,得到内容特征。

40、可选地,所述特征提取量化网络包括特征提取层和特征量化层,所述第一输入子模块,包括;

41、第一输入单元,用于将样本音频输入所述特征提取层,得到所述特征提取层输出的音频特征;

42、第二输入单元,用于将所述音频特征输入特征量化层,得到所述特征量化层输出的量化特征;其中,所述特征量化层用于对所述音频特征进行数字化采样处理。

43、可选地,所述第二输入子模块,包括:

44、第一确定单元,用于确定所述风格特征提取网络的第一维度数;

45、变形单元,用于基于所述第一维度数,对所述量化特征进行维度变形,得到异化特征;其中,所述异化特征的维度数为第一维度数;

46、第二确定单元,用于确定所述异化特征的各个维度的权重值;

47、组合单元,用于对所述权重值进行组合,得到所述风格特征。

48、可选地,所述目标损失包括梅尔谱均方差、梅尔谱协方差、梅尔谱方差中的至少一个。

49、一种音频处理装置,其特征在于,所述装置包括:

50、获取模块,用于获取第一音频;

51、音频输入模块,用于将所述第一音频输入目标风格提取模型,得到所述目标风格提取模型输出的第一风格特征和第一内容特征;所述目标风格提取模型用于提取音频的目标风格特征;

52、音频生成模块,用于将所述第一风格特征和第一内容特征输入音色转换模型,得到所述音色转换模型输出的目标音频;其中,所述音色转换模型用于将所述第一风格特征和所述第一内容特征进行融合。

53、可选地,所述音色转换模型包括归化编码器和声码器,所述音频生成模块,包括:

54、归化子模块,用于将所述第一风格特征和所述第一内容特征输入所述归化编码器,得到所述归化编码器输出的第三梅尔谱;所述归化编码器表示基于深度学习的梅尔谱生成神经网络模型;

55、生成子模块,用于将所述第三梅尔谱输入所述声码器,得到所述声码器输出的的目标音频;其中,所述目标音频具有所述声码器对应的预设音色。

56、可选地,所述音频生成模块,包括;

57、相似度子模块,用于确定所述第一风格特征与预设风格特征集合中的各个预设风格特征的相似度;

58、风格确定子模块,用于基于所述相似度最大的预设风格特征确定所述目标音频的音频风格。

59、一种电子设备,所述电子设备包括处理器和存储器,所述存储器中存储有至少一条指令、至少一段程序、代码集或指令集,所述至少一条指令、所述至少一段程序、所述代码集或指令集由所述处理器加载并执行以实现上述任意一项所述的模型生成方法,和/或,上述任意一项所述的音频处理方法。

60、一种计算机可读存储介质,所述存储介质中存储有至少一条指令或者至少一段程序,所述至少一条指令或者所述至少一段程序由处理器加载并执行以实现上述任意一项所述的模型生成方法,和/或,上述任意一项所述的音频处理方法。

61、本技术相比于现有技术,通过将样本音频输入待训练的风格提取模型,得到待训练的风格提取模型输出的风格特征和内容特征;其中,风格提取模型表示基于深度学习的风格提取神经网络模型;基于风格特征和内容特征生成第一梅尔谱;基于第一梅尔谱,以及从样本音频提取得到的第二梅尔谱,确定目标损失;基于目标损失调整风格提取模型的模型参数,得到目标风格提取模型;其中,目标风格提取模型用于提取音频的风格特征和内容特征,能够准确获取各种音频的风格特征,从而使生成的语音具有多种风格,提高了生成语音的丰富度。

62、上述说明仅是本技术技术方案的概述,为了能够更清楚了解本技术的技术手段,而可依照说明书的内容予以实施,并且为了让本技术的上述和其它目的、特征和优点能够更明显易懂,以下特举本技术的具体实施方式。

本文地址:https://www.jishuxx.com/zhuanli/20240618/21052.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表