一种语音识别方法及装置、电子设备和存储介质与流程

- 国知局

- 2024-06-21 10:44:00

本公开涉及计算机,尤其涉及一种语音识别方法及装置、电子设备和存储介质。

背景技术:

1、随着深度学习的发展,各种基于深度神经网络的端到端语音识别方法逐渐兴起。其中,基于循环神经网络转化器(recurrent neural network transducer,rnn-t)的模型,由于其天然支持流式处理,并具有较高的识别准确度而备受关注。相关技术中,一般使用rnn-t损失函数实现输入语音和识别文本的长度对齐,并对rnn-t模型进行约束训练。然而,rnn-t损失函数会导致对训练资源的高需求,并导致rnn-t模型中的预测网络没有很好的发挥语言模型的作用,影响了模型的训练效率以及识别精度。

技术实现思路

1、本公开提出了一种语音识别方法及装置、电子设备和存储介质的技术方案。

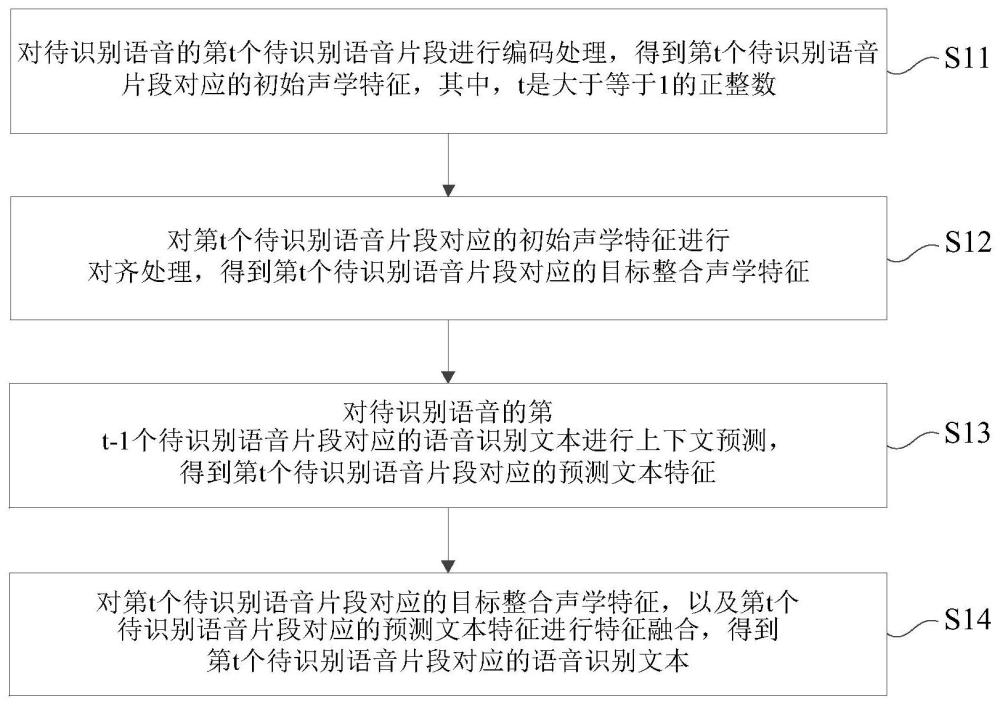

2、根据本公开的一方面,提供了一种语音识别方法,包括:对待识别语音的第t个待识别语音片段进行特征提取,得到所述第t个待识别语音片段对应的初始声学特征,其中,t是大于等于1的正整数;对所述第t个待识别语音片段对应的初始声学特征进行对齐处理,得到所述第t个待识别语音片段对应的目标整合声学特征;对所述待识别语音的第t-1个待识别语音片段对应的语音识别文本进行上下文预测,得到所述第t个待识别语音片段对应的预测文本特征;对所述第t个待识别语音片段对应的目标整合声学特征,以及所述第t个待识别语音片段对应的预测文本特征进行特征融合,得到所述第t个待识别语音片段对应的语音识别文本。

3、在一种可能的实现方式中,所述对所述第t个待识别语音片段对应的初始声学特征进行对齐处理,得到所述第t个待识别语音片段对应的目标整合声学特征,包括:基于cif机制,对所述第t个待识别语音片段对应的初始声学特征进行对齐处理,得到所述第t个待识别语音片段对应的初始整合声学特征;基于漏斗注意力机制,对所述第t个待识别语音片段对应的初始整合声学特征进行特征补充处理,得到所述第t个待识别语音片段对应的目标整合声学特征。

4、在一种可能的实现方式中,所述基于漏斗注意力机制,对所述第t个待识别语音片段对应的初始整合声学特征进行特征补充处理,得到所述第t个待识别语音片段对应的目标整合声学特征,包括:将所述第t个待识别语音片段对应的初始整合声学特征确定为查询向量;将所述第t个待识别语音片段对应的初始声学特征确定为键值向量;根据所述查询向量和所述键值向量,基于漏斗注意力机制,确定所述t个待识别语音片段对应的补充声学特征;将所述第t个待识别语音片段对应的初始整合声学特征和所述t个待识别语音片段对应的补充声学特征进行合并,得到所述第t个待识别语音片段对应的目标整合声学特征。

5、在一种可能的实现方式中,所述方法还包括:对所述第t个待识别语音片段对应的目标整合声学特征进行增强上下文处理,得到所述第t个待识别语音片段对应的更新后的目标整合声学特征。

6、在一种可能的实现方式中,所述对所述第t个待识别语音片段对应的目标整合声学特征,以及所述第t个待识别语音片段对应的预测文本特征进行特征融合,得到所述第t个待识别语音片段对应的语音识别文本,包括:基于门控机制,对所述第t个待识别语音片段对应的目标整合声学特征,以及所述第t个待识别语音片段对应的预测文本特征进行特征融合,得到第一融合特征;对所述第t个待识别语音片段对应的目标整合声学特征,以及所述第一融合特征进行双线性池化处理,得到第二融合特征;根据所述第二融合特征、所述第t个待识别语音片段对应的目标整合声学特征,以及所述第t个待识别语音片段对应的预测文本特征,得到目标融合特征;根据所述目标融合特征,确定所述第t个待识别语音片段对应的语音识别文本。

7、在一种可能的实现方式中,所述语音识别方法基于语音识别模型执行;所述语音识别模型的训练样本包括:所述第t个待识别语音片段对应的真实文本;所述方法还包括:根据所述第t个待识别语音片段对应的语音识别文本、所述第t个待识别语音片段对应的初始声学特征、所述第t个待识别语音片段对应的预测文本特征、对所述第t个待识别语音片段对应的初始声学特征进行对齐处理过程中的聚合权重的数量,以及所述第t个待识别语音片段对应的真实文本,确定所述语音识别模型对应的整体损失;根据所述整体损失,调整所述语音识别模型的网络参数。

8、在一种可能的实现方式中,所述根据所述第t个待识别语音片段对应的语音识别文本、所述第t个待识别语音片段对应的初始声学特征、所述第t个待识别语音片段对应的预测文本特征、对所述第t个待识别语音片段对应的初始声学特征进行对齐处理过程中的聚合权重的数量,以及所述第t个待识别语音片段对应的真实文本,确定所述语音识别模型对应的整体损失,包括:根据所述第t个待识别语音片段对应的语音识别文本,以及所述第t个待识别语音片段对应的真实文本,利用交叉熵损失函数,确定第一预测损失;根据所述第t个待识别语音片段对应的预测文本特征,以及所述第t个待识别语音片段对应的真实文本,利用所述交叉熵损失函数,确定第二预测损失;根据对所述第t个待识别语音片段对应的初始声学特征进行对齐处理过程中的聚合权重的数量,以及所述第t个待识别语音片段对应的真实文本的字符数量,利用数量损失函数,确定第三预测损失;根据所述第t个待识别语音片段对应的初始声学特征,以及所述第t个待识别语音片段对应的真实文本,利用ctc损失函数,确定第四预测损失;根据所述第一预测损失、所述第二预测损失、所述第三预测损失、所述第四预测损失,确定所述整体损失。

9、在一种可能的实现方式中,所述根据所述第一预测损失、所述第二预测损失、所述第三预测损失、所述第四预测损失,确定所述语音识别模型对应的整体损失,包括:根据所述第一预测损失对应的权重、所述第二预测损失对应的权重、所述第三预测损失对应的权重、所述第四预测损失对应的权重,对所述第一预测损失、所述第二预测损失、所述第三预测损失、所述第四预测损失进行加权求和,确定所述整体损失。

10、根据本公开的一方面,提供了一种语音识别装置,包括:编码器、预测网络、对齐模块、联合网络;所述编码器,用于对待识别语音的第t个待识别语音片段进行特征提取,得到所述第t个待识别语音片段对应的初始声学特征,其中,t是大于等于1的正整数;所述对齐模块,用于对所述第t个待识别语音片段对应的初始声学特征进行对齐处理,得到所述第t个待识别语音片段对应的目标整合声学特征;所述预测网络,用于对所述待识别语音的第t-1个待识别语音片段对应的语音识别文本进行上下文预测,得到所述第t个待识别语音片段对应的预测文本特征;所述联合网络,用于对所述第t个待识别语音片段对应的目标整合声学特征,以及所述第t个待识别语音片段对应的预测文本特征进行特征融合,得到所述第t个待识别语音片段对应的语音识别文本。

11、根据本公开的一方面,提供了一种电子设备,包括:处理器;用于存储处理器可执行指令的存储器;其中,所述处理器被配置为调用所述存储器存储的指令,以执行上述方法。

12、根据本公开的一方面,提供了一种计算机可读存储介质,其上存储有计算机程序指令,所述计算机程序指令被处理器执行时实现上述方法。

13、在本公开实施例中,对待识别语音的第t个待识别语音片段进行特征提取,得到第t个待识别语音片段对应的初始声学特征;对第t个待识别语音片段对应的初始声学特征进行对齐处理,得到第t个待识别语音片段对应的目标整合声学特征,从而在特征融合之前提前实现了第t个待识别语音片段和其对应的文本之间的长度对齐;对待识别语音的第t-1个待识别语音片段对应的语音识别文本进行上下文预测,得到第t个待识别语音片段对应的预测文本特征,进而,对第t个待识别语音片段对应的目标整合声学特征,以及第t个待识别语音片段对应的预测文本特征这两种模态特征进行特征融合,有效得到第t个待识别语音片段对应的识别准确率较高的语音识别文本。

14、应当理解的是,以上的一般描述和后文的细节描述仅是示例性和解释性的,而非限制本公开。根据下面参考附图对示例性实施例的详细说明,本公开的其它特征及方面将变得清楚。

本文地址:https://www.jishuxx.com/zhuanli/20240618/21406.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表