基于语音韵律的语音合成模型训练方法及语音合成系统与流程

- 国知局

- 2024-06-21 11:40:10

本技术涉及语音合成,尤其涉及一种基于语音韵律的语音合成模型训练方法及语音合成系统。

背景技术:

1、语音合成技术是通过语音合成模型将给定的文本合成人物语音的技术。但是,想要得到高质量的人物语音,需要使用大量的样本数据来训练语音合成模型。

2、在实际的训练过程中,往往难以获取大量的样本数据,为此,只能使用少量的样本数据训练语音合成模型。但是,由于自然语音的表现力较为丰富,人物语音在音色和韵律上的变化较大,而由少量的样本数据训练得到的语音合成模型生成的人物语音与实际的人物语音存在一定的差距。

3、为了缩小语音合成模型生成的人物语音与实际的人物语音的差距,可以通过使用少量样本数据训练语音合成模型时,采用预训练与模型微调的方式来减少合成的人物语音与实际的人物语音之间的差距,即先在一个大量音频数据的数据集上做语音合成模型预训练,之后再用少量的样本数据去对语音合成模型做微调。但是,在少量样本数据的情况下,依然存在合成的人物语音与真实的人物语音的韵律相似度较低的问题。

技术实现思路

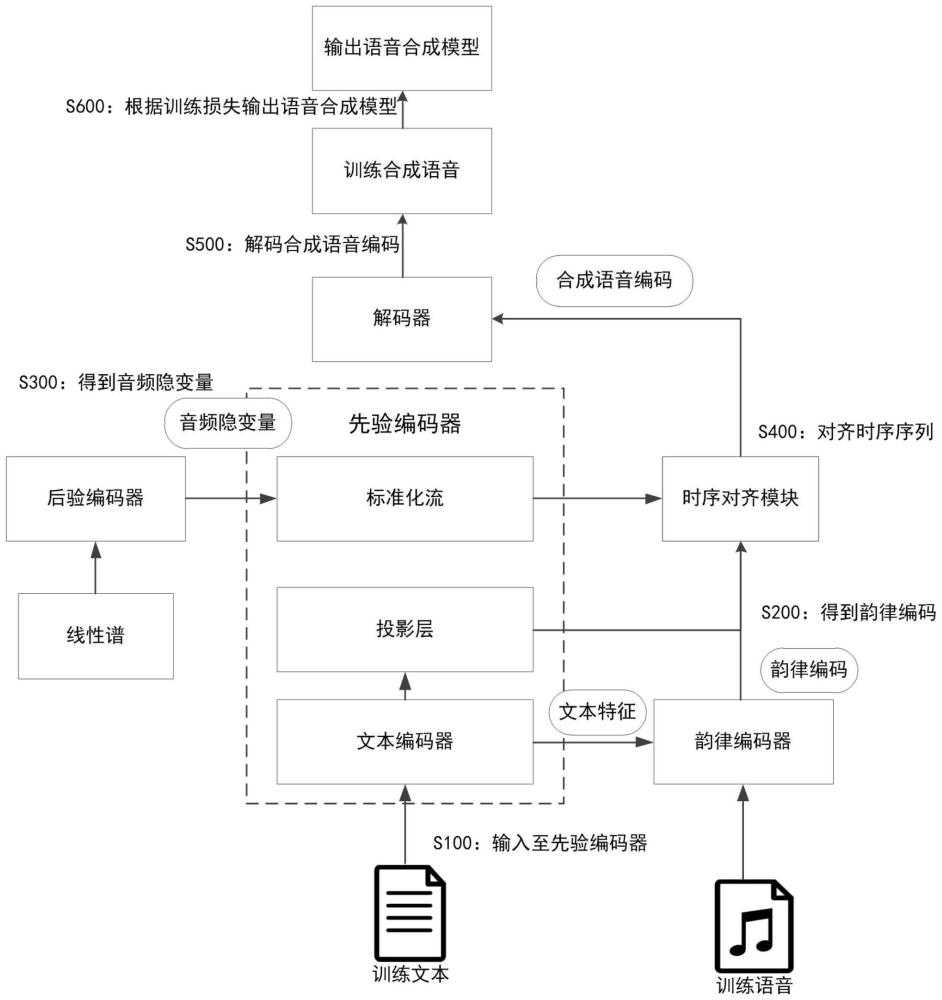

1、为了缓解在样本数据不足的情况下,合成的人物语音与真实的人物语音的韵律相似度较低的问题。第一方面,本技术的部分实施例提供一种基于语音韵律的语音合成模型训练方法,所述训练方法用于训练语音合成模型,所述语音合成模型包括先验编码器、后验编码器、时序对齐模块、解码器和韵律编码器,所述方法包括:

2、将训练文本输入至所述先验编码器,得到文本特征编码;

3、将所述文本特征编码和训练语音输入至所述韵律编码器,得到韵律编码;

4、将所述训练语音对应的线性谱输入至所述后验编码器中,得到音频隐变量;

5、通过所述时序对齐模块对齐所述训练文本、所述韵律编码和所述音频隐变量的时序序列,得到合成语音编码;

6、通过所述解码器解码所述合成语音编码得到训练合成语音;

7、计算所述训练合成语音的训练损失,如果所述训练损失小于或等于训练损失阈值,则根据待训练模型的当前参数输出语音合成模型,如果所述训练损失大于训练损失阈值则对所述待训练模型执行迭代训练,所述待训练模型为未训练收敛的语音合成模型。

8、在一些实施例中,所述韵律编码器包括韵律卷积层和池化层;将所述文本特征编码和训练语音输入至所述韵律编码器的步骤,包括:

9、将所述文本特征编码输入所述韵律卷积层,以通过所述韵律卷积层压缩所述文本特征编码,得到词级隐藏特征;

10、将所述训练语音输入所述韵律卷积层,以通过所述韵律卷积层对所述训练语音执行词级韵律量化,得到韵律属性特征;

11、通过所述池化层对所述词级隐藏特征和所述韵律属性特征执行特征降维,得到韵律编码。

12、在一些实施例中,将所述训练语音输入所述韵律卷积层的步骤,包括:

13、获取训练语音中频率分量的频率值;

14、将所述频率值大于频率阈值的频率分量筛除;

15、将训练语音中剩余的频率分量输入所述韵律卷积层。

16、在一些实施例中,所述语音合成模型还包括风格编码器,将所述文本特征编码和训练语音输入至所述韵律编码器的步骤后,所述方法还包括:

17、将所述训练语音输入所述风格编码器,得到风格向量;

18、将所述韵律编码和所述风格向量执行时序对齐,得到结合后的韵律编码。

19、在一些实施例中,所述先验编码器包括标准化流,将所述训练文本、所述韵律编码和所述音频隐变量输入至所述时序对齐模块的步骤前,还包括:

20、获取所述训练文本的第一先验分布值、所述韵律编码的第二先验分布值和所述音频隐变量的第三先验分布值;

21、将所述第一先验分布值、所述第二先验分布值和所述第三先验分布值输入所述标准化流,得到第一先验复杂度、第二先验复杂度和第三先验复杂度。

22、在一些实施例中,将所述训练文本、所述韵律编码和所述音频隐变量输入至所述时序对齐模块的步骤,包括:

23、获取时序对齐模块的模板语音序列;

24、按照所述模板语音序列对齐所述训练文本、所述韵律编码和所述音频隐变量;

25、将对齐后的所述训练文本、所述韵律编码和所述音频隐变量执行编码,得到合成语音编码。

26、在一些实施例中,所述训练损失包括频谱损失、离散度损失和解码器损失,计算所述训练合成语音的训练损失的步骤,包括:

27、获取所述训练语音的频谱精度,以及,获取训练合成语音的频谱精度;

28、按照下式,根据训练语音的频谱精度和训练合成语音的频谱精度计算所述频谱损失:

29、

30、其中,lrecon为频谱损失,xmel为训练语音的频谱精度,为训练合成语音的频谱精度。

31、在一些实施例中,计算所述训练合成语音的训练损失的步骤,包括:

32、根据所述音频隐变量计算后验分布结果;

33、获取所述合成语音编码的对齐信息;

34、根据所述对齐信息和所述音频隐变量计算先验分布结果;

35、按照下式,根据所述后验分布结果和所述先验分布结果计算所述离散度损失:

36、

37、其中,lkl为离散度损失,z为音频隐变量,为后验分布结果,logpθ(z|ctext,a)为先验分布结果,ctext为预设文本,a为对齐信息。

38、在一些实施例中,所述解码器包括鉴别器,计算所述训练合成语音的训练损失的步骤,包括:

39、将所述训练合成语音输入所述鉴别器,得到鉴别特征;

40、按照下式计算训练生成器的特征匹配损失:

41、

42、其中,lfm(g)为训练生成器的特征匹配损失,e为数学期望的表达形式,x为训练频谱的真实波形,z为音频隐变量,t为鉴别器网络的层数,dl获得nl个特征的鉴别器的第l层的特征,g(z)表示输入隐变量之后解码器的生成特征,所述解码器损失由所述训练生成器的特征匹配损失与对抗训练的最小二乘损失函数计算得到。

43、第二方面,本技术的部分实施例提供一种语音合成系统,所述语音合成系统包括语音合模型,所述语音合模型根据第一方面所述的基于语音韵律的语音合成模型训练方法训练获得,所述语音合模型包括先验编码器、后验编码器、时序对齐模块、解码器和韵律编码器,其中,所述先验编码器被配置提取输入的目标文本的目标特征编码;

44、所述韵律编码器被配置为根据目标特征编码和输入的目标频谱生成目标韵律编码;

45、所述后验编码器被配置为根据输入的目标线性谱生成目标隐变量;

46、所述时序对齐模块被配置为对所述目标文本、所述目标韵律编码和所述目标隐变量执行时序对齐,得到目标合成语音编码;

47、所述解码器被配置为解码所述目标合成语音编码,得到目标合成语音。

48、由以上技术方案可知,本技术提供一种基于语音韵律的语音合成模型训练方法及语音合成系统,所述方法用于训练语音合成模型,语音合成模型包括先验编码器、后验编码器、时序对齐模块、解码器和韵律编码器,通过将训练文本输入先验编码器,得到文本特征编码,再将文本特征编码和训练语音输入韵律编码器,得到韵律编码,然后将训练语音对应的线性谱输入后验编码器中,得到音频隐变量,并通过时序对齐模块对齐训练文本、韵律编码和音频隐变量的时序序列,得到合成语音编码,通过解码器解码合成语音编码,得到训练合成语音,再计算训练合成语音的训练损失,以判断语音合成模型的收敛程度。本技术通过训练文本和训练语音获得韵律编码,并通过时序对齐将韵律编码融入合成语音编码中,使训练得到的语音合成模型所生成的合成语音能贴合人物语音的韵律特征,在语音样本不足的情况下,提高合成语音的韵律相似度。

本文地址:https://www.jishuxx.com/zhuanli/20240618/22788.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表