说话人定位方法、装置、电子设备及存储介质与流程

- 国知局

- 2024-06-21 11:40:09

本技术涉及计算机,尤其涉及一种说话人定位方法、装置、电子设备及存储介质。

背景技术:

1、随着社会的发展进步和科技创新,多媒体技术也呈现出突飞猛进的发展。集计算机技术、通信技术以及电视技术为一体的多媒体技术已经与人们的日常生活密不可分。其中,视频影视作品作为常见的多媒体形式,具有很好的娱乐性和传播性。对于多角色的视频影视作品,需要区分视频影视作品中各个对话所属的角色,使得不同角色的演播人能够快速准确地录制自己的台词部分。

2、然而,目前通常通过人工方式识别视频影视作品中各句台词所属的角色,不仅需要耗费大量的人力成本而且识别效率较低。

技术实现思路

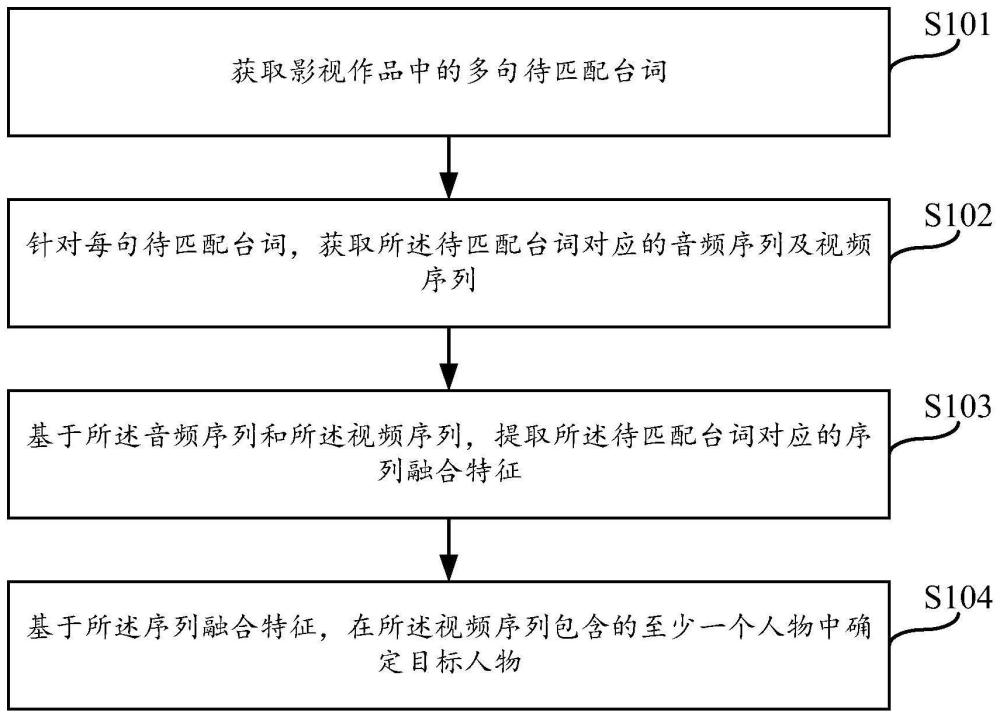

1、本技术实施例的目的在于提供一种说话人定位方法、装置、电子设备及存储介质,以解决通过人工方式识别视频影视作品中各句台词所属的角色识别效率较低的问题。具体技术方案如下:

2、第一方面,本技术提供了一种说话人定位方法,包括:

3、获取影视作品中的多句待匹配台词;

4、针对每句待匹配台词,获取所述待匹配台词对应的音频序列及视频序列,其中,所述视频序列中包含至少一条人脸序列,每条人脸序列中仅包含一个人物的人脸;

5、基于所述音频序列和所述视频序列,提取所述待匹配台词对应的序列融合特征;

6、基于所述序列融合特征,在所述视频序列包含的至少一个人物中确定目标人物,其中,所述目标人物为所述待匹配台词对应的说话人。

7、在一个可能的实施方式中,所述基于所述音频序列和所述视频序列,提取所述待匹配台词对应的序列融合特征,包括:

8、提取所述音频序列的音频特征,以及,提取所述视频序列的视频特征;

9、基于所述视频特征对所述音频特征进行特征增强处理,得到目标音频特征,以及,基于所述音频特征对所述视频特征进行特征增强处理,得到目标视频特征;

10、对所述目标音频特征和所述目标视频特征进行融合处理,得到所述待匹配台词对应的序列融合特征。

11、在一个可能的实施方式中,所述对所述目标音频特征和所述目标视频特征进行融合处理,得到所述待匹配台词对应的序列融合特征,包括:

12、对所述目标音频特征和所述目标视频特征进行拼接处理,得到对应的拼接特征;

13、对所述拼接特征进行降维处理,得到对应的降维特征;

14、对所述降维特征进行自注意力机制特征增强处理,得到对应的增强特征;

15、对所述增强特征进行时序特征增强处理,得到所述待匹配台词对应的序列融合特征。

16、在一个可能的实施方式中,所述基于所述序列融合特征,在所述视频序列包含的至少一个人物中确定目标人物,包括:

17、利用归一化指数函数对所述序列融合特征进行计算,得到所述序列融合特征中多个时序维度所对应的概率分布数据,其中,每个时序维度对应所述视频序列包含的一个人物;

18、确定所述概率分布数据中对应概率值最大的时序维度为目标时序维度;

19、将所述目标时序维度对应的人物确定为所述目标人物。

20、在一个可能的实施方式中,所述获取所述待匹配台词对应的音频序列及视频序列,包括:

21、获取所述影视作品对应的音频数据和视频数据;

22、确定所述待匹配台词对应的起始时刻和结束时刻;

23、从所述音频数据中截取所述起始时刻和所述结束时刻之间的部分音频作为所述音频序列;

24、从所述视频数据中截取所述起始时刻和所述结束时刻之间的部分视频作为初始序列;

25、基于所述初始序列中提取所述视频序列。

26、在一个可能的实施方式中,所述基于所述初始序列中提取所述视频序列,包括:

27、从所述初始序列中提取预设数量的关键帧;

28、针对每个关键帧,识别所述关键帧中包含的至少一个人脸;

29、截取每个人脸对应的人脸截图,并将所述人脸截图的尺寸调整为预设尺寸,得到目标人脸截图;

30、按照对应关键帧在所述视频序列中的出现顺序,组合对应同一人脸的所有目标人脸截图,得到每张人脸对应的人脸序列;

31、组合所有的所述人脸序列,得到所述视频序列。

32、在一个可能的实施方式中,所述获取影视作品中的多句待匹配台词,包括:

33、获取所述影视作品对应的台词集合,其中,所述台词集合中包含所述影视作品中的所有台词;

34、在所有台词中确定位于片头的片头台词和位于片尾的片尾台词;

35、从所述台词集合中剔除所述片头台词和所述片尾台词,得到目标台词集合;

36、将所述目标台词集合中的每句台词确定为待匹配台词。

37、第二方面,本技术提供了一种说话人定位装置,包括:

38、第一获取模块,用于获取影视作品中的多句待匹配台词;

39、第二获取模块,用于针对每句待匹配台词,获取所述待匹配台词对应的音频序列及视频序列,其中,所述视频序列中包含至少一条人脸序列,每条人脸序列中仅包含一个人物的人脸;

40、特征提取模块,用于基于所述音频序列和所述视频序列,提取所述待匹配台词对应的序列融合特征;

41、人物确定模块,用于基于所述序列融合特征,在所述视频序列包含的至少一个人物中确定目标人物,其中,所述目标人物为所述待匹配台词对应的说话人。

42、在一个可能的实施方式中,所述特征提取模块,进一步用于:

43、提取所述音频序列的音频特征,以及,提取所述视频序列的视频特征;

44、基于所述视频特征对所述音频特征进行特征增强处理,得到目标音频特征,以及,基于所述音频特征对所述视频特征进行特征增强处理,得到目标视频特征;

45、对所述目标音频特征和所述目标视频特征进行融合处理,得到所述待匹配台词对应的序列融合特征。

46、在一个可能的实施方式中,所述特征提取模块,还用于:

47、对所述目标音频特征和所述目标视频特征进行拼接处理,得到对应的拼接特征;

48、对所述拼接特征进行降维处理,得到对应的降维特征;

49、对所述降维特征进行自注意力机制特征增强处理,得到对应的增强特征;

50、对所述增强特征进行时序特征增强处理,得到所述待匹配台词对应的序列融合特征。

51、在一个可能的实施方式中,所述人物确定模块,进一步用于:

52、利用归一化指数函数对所述序列融合特征进行计算,得到所述序列融合特征中多个时序维度所对应的概率分布数据,其中,每个时序维度对应所述视频序列包含的一个人物;

53、确定所述概率分布数据中对应概率值最大的时序维度为目标时序维度;

54、将所述目标时序维度对应的人物确定为所述目标人物。

55、在一个可能的实施方式中,所述第二获取模块,进一步用于:

56、获取所述影视作品对应的音频数据和视频数据;

57、确定所述待匹配台词对应的起始时刻和结束时刻;

58、从所述音频数据中截取所述起始时刻和所述结束时刻之间的部分音频作为所述音频序列;

59、从所述视频数据中截取所述起始时刻和所述结束时刻之间的部分视频作为初始序列;

60、基于所述初始序列中提取所述视频序列。

61、在一个可能的实施方式中,所述第二获取模块,还用于:

62、从所述初始序列中提取预设数量的关键帧;

63、针对每个关键帧,识别所述关键帧中包含的至少一个人脸;

64、截取每个人脸对应的人脸截图,并将所述人脸截图的尺寸调整为预设尺寸,得到目标人脸截图;

65、按照对应关键帧在所述视频序列中的出现顺序,组合对应同一人脸的所有目标人脸截图,得到每张人脸对应的人脸序列;

66、组合所有的所述人脸序列,得到所述视频序列。

67、在一个可能的实施方式中,所述第一获取模块,进一步用于:

68、获取所述影视作品对应的台词集合,其中,所述台词集合中包含所述影视作品中的所有台词;

69、在所有台词中确定位于片头的片头台词和位于片尾的片尾台词;

70、从所述台词集合中剔除所述片头台词和所述片尾台词,得到目标台词集合;

71、将所述目标台词集合中的每句台词确定为待匹配台词。

72、第三方面,提供了一种电子设备,包括处理器、通信接口、存储器和通信总线,其中,处理器,通信接口,存储器通过通信总线完成相互间的通信;

73、存储器,用于存放计算机程序;

74、处理器,用于执行存储器上所存放的程序时,实现第一方面任一所述的方法步骤。

75、第四方面,提供了一种计算机可读存储介质,其特征在于,所述计算机可读存储介质内存储有计算机程序,所述计算机程序被处理器执行时实现第一方面任一所述的方法步骤。

76、第五方面,提供了一种包含指令的计算机程序产品,当其在计算机上运行时,使得计算机执行上述任一所述的说话人定位方法。

77、本技术实施例有益效果:

78、本技术实施例提供了一种说话人定位方法、装置、电子设备及存储介质,本技术实施例中,首先,获取影视作品中的多句待匹配台词,然后,针对每句待匹配台词,获取该待匹配台词对应的音频序列及视频序列,进而,基于音频序列和视频序列,提取该待匹配台词对应的序列融合特征,最后,基于序列融合特征,在视频序列包含的至少一个人物中确定目标人物,其中,目标人物为该待匹配台词对应的说话人。通过本方案,可以基于待匹配台词对应的音频序列及视频序列,确定该待匹配台词对应的说话人,由此实现智能对影视作品中台词和说话人的匹配,从而提高说话人定位效率。

79、当然,实施本技术的任一产品或方法并不一定需要同时达到以上所述的所有优点。

本文地址:https://www.jishuxx.com/zhuanli/20240618/22787.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表