音频的生成方法、计算机可读存储介质和音频生成系统与流程

- 国知局

- 2024-06-21 11:44:55

本申请涉及音频处理,具体而言,涉及一种音频的生成方法、装置、计算机可读存储介质和音频生成系统。

背景技术:

1、在当前多媒体生成领域,人工智能技术的不断进步为图像和声音的合成提供了更为先进和创新的方法。然而,现有技术在基于人脸图像生成相符合的人声音频方面仍存在一些挑战和局限。目前主流的人脸到人声映射方法主要基于训练数据集的限制,使得生成的声音受到数据集的限制,难以生成超出数据集范围的多样化声音。因此,目前的人脸生成的声音不够丰富,难以得到个性化的声音。

技术实现思路

1、本申请的主要目的在于提供一种音频的生成方法、装置、计算机可读存储介质和音频生成系统,以至少解决现有技术中目前的人脸生成的声音不够丰富,难以得到个性化的声音的问题。

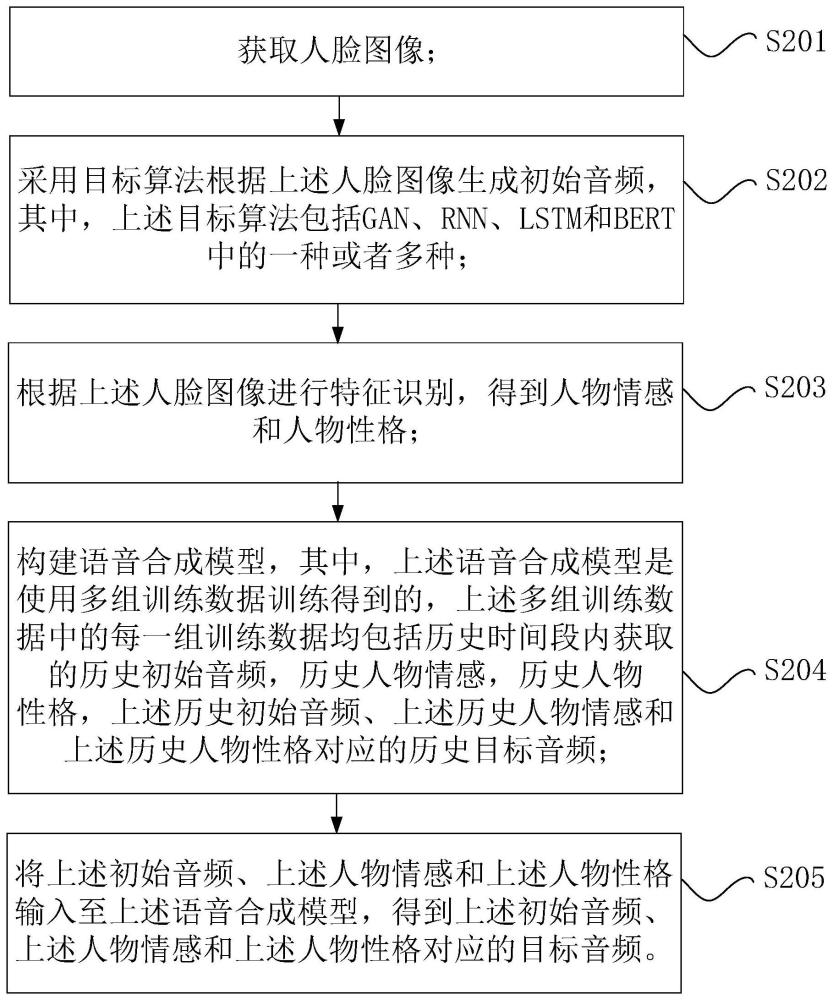

2、为了实现上述目的,根据本申请的一个方面,提供了一种音频的生成方法,包括:获取人脸图像;采用目标算法根据所述人脸图像生成初始音频,其中,所述目标算法包括gan、rnn、lstm和bert中的一种或者多种;根据所述人脸图像进行特征识别,得到人物情感和人物性格;构建语音合成模型,其中,所述语音合成模型是使用多组训练数据训练得到的,所述多组训练数据中的每一组训练数据均包括历史时间段内获取的历史初始音频,历史人物情感,历史人物性格,所述历史初始音频、所述历史人物情感和所述历史人物性格对应的历史目标音频;将所述初始音频、所述人物情感和所述人物性格输入至所述语音合成模型,得到所述初始音频、所述人物情感和所述人物性格对应的目标音频。

3、可选地,采用目标算法根据所述人脸图像生成初始音频,包括:采用第一算法生成第一初始音频,其中,所述第一算法至少包括gan,所述第一初始音频是根据所述人脸图像直接生成的音频;采用第二算法生成第二初始音频,其中,所述第二算法为rnn、lstm和bert中的一种或者多种,所述第二初始音频是根据所述人脸图像生成描述文本,再通过所述描述文本生成具有音色特点的音频。

4、可选地,采用第一算法生成第一初始音频,包括:构建人脸生成声音模型,其中,所述人脸生成声音模型是使用多组训练数据来通过gan算法训练得到的,所述多组训练数据中的每一组训练数据均包括历史时间段内获取的历史人脸图像、所述历史人脸图像对应的历史第一初始音频;将所述人脸图像输入至所述人脸生成声音模型,得到所述人脸图像对应的所述第一初始音频。

5、可选地,采用第二算法生成第二初始音频,包括:构建人脸生成文本描述模型,其中,所述人脸生成文本描述模型是使用多组训练数据来通过所述第二算法训练得到的,所述多组训练数据中的每一组训练数据均包括历史时间段内获取的历史人脸图像、所述历史人脸图像对应的历史描述文本;将所述人脸图像输入至所述人脸生成文本描述模型,得到所述人脸图像对应的所述描述文本;构建文本生成音色模型,其中,所述文本生成音色模型是使用多组训练数据训练得到的,所述多组训练数据中的每一组训练数据均包括历史时间段内获取的所述历史描述文本、所述历史描述文本对应的历史第二初始音频,其中,所述历史第二初始音频的音色和所述历史描述文本中的历史音色特点相对应;将所述描述文本输入至所述文本生成音色模型,得到所述描述文本对应的所述第二初始音频,其中,所述第二初始音频的音色和所述描述文本中的所述音色特点相对应。

6、可选地,在获取人脸图像之后,所述方法还包括:获取音频数据库,其中,所述音频数据库中包括多个人物的音频;根据所述人脸图像的面部特征,在所述音频数据库中查找到第三初始音频,其中,所述人脸图像的人物的面部特征与所述第三初始音频的人物的面部特征的相似度大于或者等于相似度阈值。

7、可选地,根据所述人脸图像进行特征识别,得到人物情感和人物性格,包括:构建人脸情感识别模型,其中,所述人脸情感识别模型是使用多组训练数据训练得到的,所述多组训练数据中的每一组训练数据均包括历史时间段内获取的历史人脸图像、所述历史人脸图像对应的历史人物情感;将所述人脸图像输入至所述人脸情感识别模型,得到所述人脸图像对应的所述人物情感;构建人脸性格特征分析模型,其中,所述人脸性格特征分析模型是使用多组训练数据训练得到的,所述多组训练数据中的每一组训练数据均包括历史时间段内获取的历史人脸图像、所述历史人脸图像对应的历史人物性格;将所述人脸图像输入至所述人脸性格特征分析模型,得到所述人脸图像对应的所述人物性格。

8、可选地,在根据所述人脸图像进行特征识别,得到人物情感和人物性格之后,所述方法还包括:获取测试性格,其中,所述测试性格是基于性格测试试题生成的,所述性格测试试题包括mbti、disc、pdp中的一种或者多种;计算所述人物性格和所述测试性格的加权平均值,得到目标性格。

9、根据本申请的另一方面,提供了一种音频的生成装置,包括:第一获取单元,用于获取人脸图像;生成单元,用于采用目标算法根据所述人脸图像生成初始音频,其中,所述目标算法包括gan、rnn、lstm和bert中的一种或者多种;识别单元,用于根据所述人脸图像进行特征识别,得到人物情感和人物性格;构建单元,用于构建语音合成模型,其中,所述语音合成模型是使用多组训练数据训练得到的,所述多组训练数据中的每一组训练数据均包括历史时间段内获取的历史初始音频,历史人物情感,历史人物性格,所述历史初始音频、所述历史人物情感和所述历史人物性格对应的历史目标音频;第一处理单元,用于将所述初始音频、所述人物情感和所述人物性格输入至所述语音合成模型,得到所述初始音频、所述人物情感和所述人物性格对应的目标音频。

10、根据本申请的再一方面,提供了一种计算机可读存储介质,所述计算机可读存储介质包括存储的程序,其中,在所述程序运行时控制所述计算机可读存储介质所在设备执行任意一种所述音频的生成方法。

11、根据本申请的又一方面,提供了一种音频生成系统,包括:一个或多个处理器,存储器,以及一个或多个程序,其中,所述一个或多个程序被存储在所述存储器中,并且被配置为由所述一个或多个处理器执行,所述一个或多个程序包括用于执行任意一种所述的音频的生成方法。

12、应用本申请的技术方案,基于多模态来生成声音,多模态参数不仅仅包括人脸生成的声音,还包括人物情感和人物性格,弥补了单一参数的不足,使得生成的目标音频还具备情感维度和性格维度的信息,从而使得生成的目音频的丰富度大大提升,更加贴个人物形象,从而保证本方案可以得到个性化的声音。

技术特征:1.一种音频的生成方法,其特征在于,包括:

2.根据权利要求1所述的方法,其特征在于,采用目标算法根据所述人脸图像生成初始音频,包括:

3.根据权利要求2所述的方法,其特征在于,采用第一算法生成第一初始音频,包括:

4.根据权利要求2所述的方法,其特征在于,采用第二算法生成第二初始音频,包括:

5.根据权利要求1所述的方法,其特征在于,在获取人脸图像之后,所述方法还包括:

6.根据权利要求1所述的方法,其特征在于,根据所述人脸图像进行特征识别,得到人物情感和人物性格,包括:

7.根据权利要求1所述的方法,其特征在于,在根据所述人脸图像进行特征识别,得到人物情感和人物性格之后,所述方法还包括:

8.一种音频的生成装置,其特征在于,包括:

9.一种计算机可读存储介质,其特征在于,所述计算机可读存储介质包括存储的程序,其中,在所述程序运行时控制所述计算机可读存储介质所在设备执行权利要求1至7中任意一项所述音频的生成方法。

10.一种音频生成系统,其特征在于,包括:一个或多个处理器,存储器,以及一个或多个程序,其中,所述一个或多个程序被存储在所述存储器中,并且被配置为由所述一个或多个处理器执行,所述一个或多个程序包括用于执行权利要求1至7中任意一项所述的音频的生成方法。

技术总结本申请提供了一种音频的生成方法、计算机可读存储介质和音频生成系统。该方法包括:获取人脸图像;采用目标算法根据人脸图像生成初始音频;根据人脸图像进行特征识别,得到人物情感和人物性格;构建语音合成模型,其中,语音合成模型是使用多组训练数据训练得到的,多组训练数据中的每一组训练数据均包括历史时间段内获取的历史初始音频,历史人物情感,历史人物性格,历史初始音频、历史人物情感和历史人物性格对应的历史目标音频;将初始音频、人物情感和人物性格输入至语音合成模型,得到初始音频、人物情感和人物性格对应的目标音频。该方法解决了现有技术中目前的人脸生成的声音不够丰富,难以得到个性化的声音的问题。技术研发人员:周科霖,李健,陈明,武卫东受保护的技术使用者:北京捷通华声科技股份有限公司技术研发日:技术公布日:2024/4/17本文地址:https://www.jishuxx.com/zhuanli/20240618/23334.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表