一种多模态情绪识别方法

- 国知局

- 2024-07-31 22:56:13

本发明涉及生物识别,具体涉及一种多模态情绪识别方法。

背景技术:

1、目前的情绪识别系统大多是基于视觉的情绪识别,比如基于图像特征的情绪识别方法、基于直方图或颜色等特征相结合的迭代算法等。这些基于单模态视觉的情绪识别方法的识别准确度易受外界因素的影响,比如在用户戴了眼镜、出现光照变化、或者出现遮挡物等情况下均会严重影响识别结果,因此目前的情绪识别方法稳定性差,导致识别的准确度不够高,效果不佳。

技术实现思路

1、针对现有技术的不足,本发明提供了一种多模态情绪识别方法,通过基于transformer的深度神经网络,对捕捉到的多模态信息进行特征提取,实现情绪识别目标。

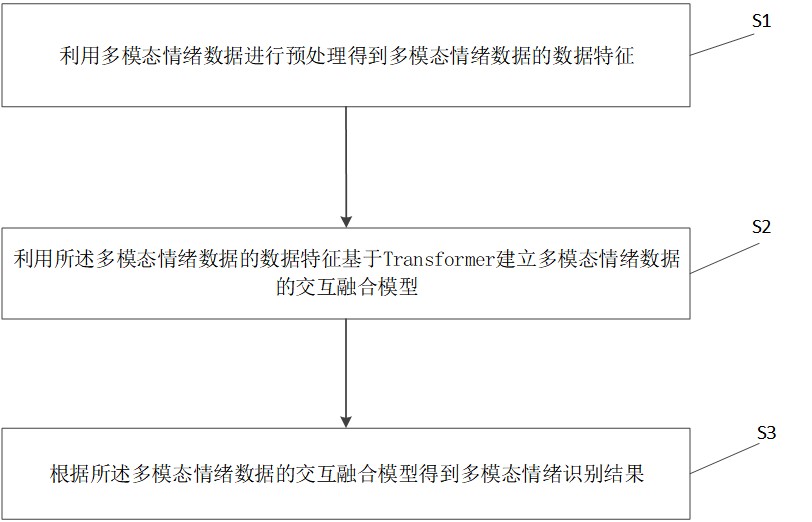

2、为实现上述目的,本发明提供了一种多模态情绪识别方法,包括:

3、s1、利用多模态情绪数据进行预处理得到多模态情绪数据的数据特征;

4、s2、利用所述多模态情绪数据的数据特征基于transformer建立多模态情绪数据的交互融合模型;

5、s3、根据所述多模态情绪数据的交互融合模型得到多模态情绪识别结果。

6、所述利用多模态情绪数据进行预处理得到多模态情绪数据的数据特征包括:

7、利用所述多模态情绪数据进行预处理得到多模态情绪预处理数据;

8、利用所述多模态情绪预处理数据得到多模态情绪数据的数据特征。

9、进一步的,利用所述多模态情绪数据进行预处理得到多模态情绪预处理数据包括:

10、获取基础多模态情绪数据;

11、利用所述基础多模态情绪数据依次进行去噪声、标准化与数据增强处理得到多模态情绪预处理数据;

12、其中,所述基础多模态情绪数据包括文本、音频与视觉信息。

13、进一步的,利用所述多模态情绪预处理数据得到多模态情绪数据的数据特征包括:

14、利用所述多模态情绪预处理数据的文本信息根据bert编码器获取多模态情绪预处理数据的文本特征;

15、利用所述多模态情绪预处理数据的音频信息根据hubert语音编码器获取多模态情绪预处理数据的音频特征;

16、利用所述多模态情绪预处理数据的视觉信息根据mae图像编码器获取多模态情绪预处理数据的视觉特征;

17、利用所述多模态情绪预处理数据的文本特征、音频特征与视觉特征作为多模态情绪数据的数据特征。

18、进一步的,利用所述多模态情绪数据的数据特征基于transformer建立多模态情绪数据的交互融合模型包括:

19、s2-1、利用所述多模态情绪数据的数据特征分别划分训练集与测试集;

20、s2-2、基于transformer建立交互融合模型;

21、s2-3、利用所述训练集与交互融合模型进行训练得到初始交互融合模型;

22、s2-4、利用所述测试集代入初始交互融合模型获取初始交互融合模型的模型性能;

23、s2-5、判断所述初始交互融合模型的模型性能是否满足输出标准,若是,则输出当前初始交互融合模型作为多模态情绪数据的交互融合模型,否则,返回s2-3;

24、其中,所述初始交互融合模型的模型性能包括模型的准确率、召回率与f1分数,所述输出标准为模型有效性。

25、进一步的,根据所述多模态情绪数据的交互融合模型得到多模态情绪识别结果包括:

26、利用所述多模态情绪数据输入多模态情绪数据的交互融合模型得到多模态情绪识别结果。

27、与最接近的现有技术相比,本发明具有的有益效果:

28、基于transformer深度神经网络实现了多模态情绪识别,由于transformer的有效性和多模态信息的互补性,情绪识别不易受外界模态信息因素的影响,所以该种情绪识别方法稳定性较优,进而情绪识别的准确度和鲁棒性也得到了保证,效果较佳。

技术特征:1.一种多模态情绪识别方法,其特征在于,包括:

2.如权利要求1所述的一种多模态情绪识别方法,其特征在于,所述利用多模态情绪数据进行预处理得到多模态情绪数据的数据特征包括:

3.如权利要求2所述的一种多模态情绪识别方法,其特征在于,利用所述多模态情绪数据进行预处理得到多模态情绪预处理数据包括:

4.如权利要求3所述的一种多模态情绪识别方法,其特征在于,利用所述多模态情绪预处理数据得到多模态情绪数据的数据特征包括:

5.如权利要求2所述的一种多模态情绪识别方法,其特征在于,利用所述多模态情绪数据的数据特征基于transformer建立多模态情绪数据的交互融合模型包括:

6.如权利要求3所述的一种多模态情绪识别方法,其特征在于,根据所述多模态情绪数据的交互融合模型得到多模态情绪识别结果包括:

技术总结本发明涉及生物识别技术领域,尤其涉及一种多模态情绪识别方法,包括:S1、利用多模态情绪数据进行预处理得到多模态情绪数据的数据特征;S2、利用所述多模态情绪数据的数据特征基于Transformer建立多模态情绪数据的交互融合模型;S3、根据所述多模态情绪数据的交互融合模型得到多模态情绪识别结果,基于Transformer深度神经网络实现了多模态情绪识别,由于Transformer的有效性和多模态信息的互补性,情绪识别不易受外界模态信息因素的影响,所以该种情绪识别方法稳定性较优,进而情绪识别的准确度和鲁棒性也得到了保证,效果较佳。技术研发人员:石大明,王炎中受保护的技术使用者:深圳大学技术研发日:技术公布日:2024/7/29本文地址:https://www.jishuxx.com/zhuanli/20240730/195402.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表