一种基于多尺度注意力机制的可见光与红外图像融合方法与流程

- 国知局

- 2024-07-31 23:03:55

本发明涉及图像处理,特别涉及一种基于多尺度注意力机制的可见光与红外图像融合方法。

背景技术:

1、图像融合技术是图像处理中一个备受关注的领域。可见光图像与红外图像能够捕捉目标在不同光学波段下的信息及光学特性,两种模态间的信息表达存在一定差异,通过将两种模态图像进行充分融合,能够提供单一模态下难以观察到的图像信息,可为军事、医疗、安防等领域提供更加全面且可靠的信息来源,提升目标检测、识别、分割等下游任务的效果。

2、近年来,随着深度学习技术的迅猛发展,图像融合算法已经逐渐从传统的人工设计融合规则转变为基于深度特征的多模态图像自动智能融合。基于深度学习的图像融合算法降低了人工融合过程中对设计者经验的依赖,已经成为图像融合技术主流的发展方向。

3、基于深度学习的图像融合算法可分为三大类:基于编解码结构的图像融合、基于卷积神经网络的图像融合、基于对抗-生成的图像融合。基于编解码结构的融合算法率先起步,如densefuse算法,在编解码结构中使用密集连接结构和稠密融合块,对不同模态图像的融合权重进行充分学习,有利于去除图像融合过程中产生的伪影。随后提出的nestfuse模型在densefuse模型的基础上使用的空间注意力与通道注意力模块,提升图像融合结果对图像细节的表达能力。

4、基于对抗生成模式的fusiongan模型,使用多个损失函数来引导训练,以确保生成的图像在视觉上与真实图像具有更加一致的特征表达。针对红外图像分辨率普遍低于可见光图像分辨率的问题,ddcgan算法使用上采样计算恢复红外图像分辨率,构建双鉴别器网络对不同分辨率图像进行融合。为保留图像融合后更多的纹理细节和对比度信息,基于检测网络设计的detfusion模型,提升了图像融合中纹理、像素强度的指标。将稀疏语义感知中提取的语义特征与融合网络结合,能够重建源图像的完整信息,降低目标显著区域的信息损失,在可见光与红外图像融合算法中取得了较好效果。

5、已有的图像融合算法,往往通过对融合中某个指标或者可见光图像及红外光图像存在的缺点对融合算法进行优化,对不同模态间图像特征内在联系关注不足,模态差异引起的特征分布差异会对融合结果造成影响。

技术实现思路

1、本公开提供一种基于多尺度融合注意力机制的可见光图像与红外图像融合方法,通过设计一种多尺度注意力模块,并以即插即用的方式与已有的图像融合框架结合,可实现对可见光与红外图像的精准融合,降低模态差异引起的特征分布差异对融合结果的影响,提升可见光与红外图像的融合效果,为目标检测、识别、分割等下游任务提供更丰富图像信息。

2、本公开提供的可见光图像与红外图像融合方法,包括以下步骤:

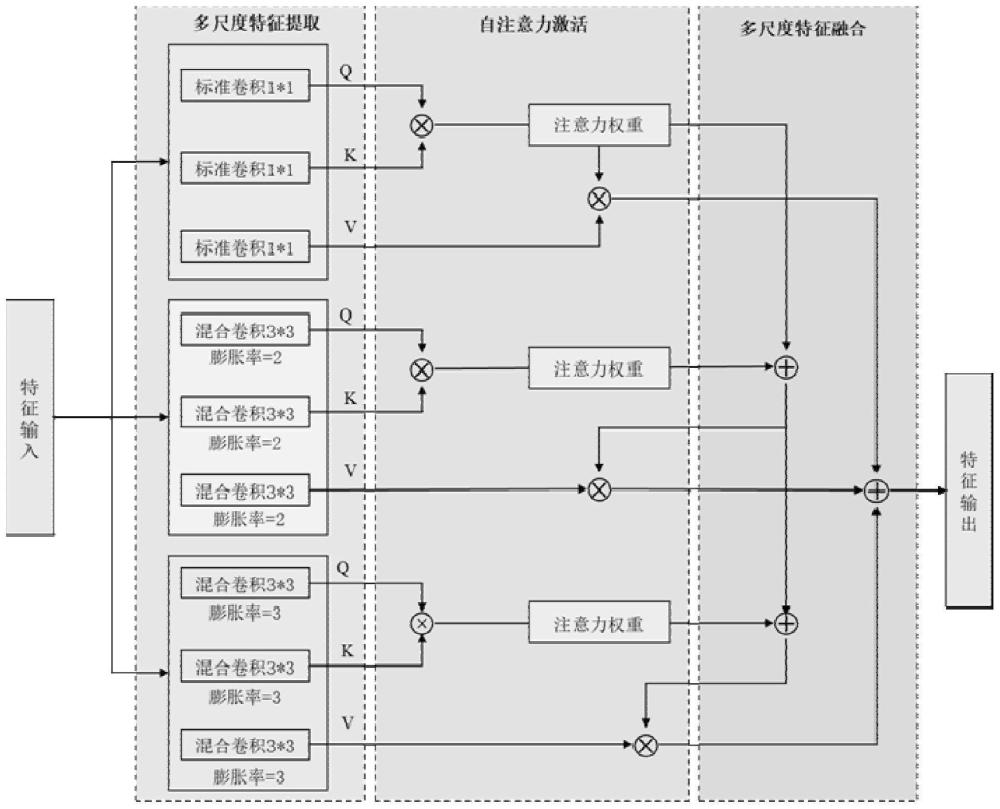

3、s1,构建若干组不同感知域的卷积计算单元,分别从输入特征中各自提取不同尺度注意力机制中的q、k、v响应值;

4、s2,根据每组卷积计算单元得到的q、k响应值,计算不同尺度注意力机制的权重并融合;

5、s3,将每组卷积计算单元得到的v响应值分别与融合后的不同尺度注意力机制的权重进行张量乘法计算,并将计算结果进行融合;

6、s4,将步骤s3的计算结果与基于已有图像融合方法的计算结果进行进一步融合。

7、进一步的,所述步骤s1具体方法包括:

8、使用并列的3组卷积计算,分别对输入特征各自提取注意力机制中的q、k、v响应值,用于后续计算注意力权重,其中:

9、第一组卷积的卷积核为1x1的标准卷积模块,在不改变感知域的同时对输入特征进一步抽象化;

10、第二组与第三组卷积采用不同膨胀率的空洞卷积,实现对网络感知域的扩增。

11、进一步的,所述步骤s1中,第二组与第三组卷积的膨胀率分别设置为2和3。

12、进一步的,所述步骤s2具体包括:

13、设三组卷积得到的三种尺度注意力机制的q、k、v响应值分别为qi,ki,vi,i=1,2,3;则其权重分别为:

14、ai=softmax(qi*ki);

15、融合后得到:

16、aout1=a1+a2

17、aout2=a1+a2+a3。

18、进一步的,所述步骤s3具体包括:

19、out_1=bmm(v1,a1);

20、out_2=bmm(v2,aout1);

21、out_3=bmm(v3,aout2);

22、最终的特征融合结果:out=out_1+out_2+out_3。

23、进一步的,所述步骤s4具体包括:将应用步骤s1-s3所述方法的多尺度注意力特征提取模块,以模块化的方式接入现有的多模态图像融合网络中进行特征融合,得到最终的融合结果。

24、应用上述方法的多尺度注意力特征提取模块,主要包括:

25、多尺度注意力特征提取部分,包括若干组不同感知域的卷积计算单元,分别用于从输入特征中各自提取注意力机制中的q、k、v响应值;

26、注意力机制权重融合部分,用于根据每组卷积计算单元得到的q和k响应值,分别计算不同尺度下的注意力权重,并将各尺度的权重进行融合;

27、特征图融合部分,用于将每组卷积计算单元得到的v响应值分别与融合后的注意力权重进行张量乘法计算,并将计算结果进行融合。

28、与现有技术相比,本公开的有益效果是:(1)设计了多尺度融合的注意力模块,该模块能够在不同尺度特征图上提取特征的注意力权重矩阵,使多模态图像特征的上下文关联在特征提取过程中充分表达;(2)在注意力模块中引入空洞卷积,以降低图像融合过程中的局部信息损失,以解决大感受野下图像细节特征消失的问题;(3)将提出的注意力模块应用于现有的图像融合算法,通过对不同模态图像进行更加充分的特征表达,实现模态间特征互补,进而提升图像融合效果;(4)可在军事、医疗和消防等领域中广泛应用,为相关行业提供更为高效和准确的图像融合技术。

技术特征:1.一种基于多尺度注意力机制的可见光与红外图像融合方法,包括以下步骤:

2.根据权利要求1所述的方法,其特征在于,所述步骤s1具体方法包括:

3.根据权利要求2所述的方法,其特征在于,所述步骤s1中,第二组与第三组卷积的膨胀率分别设置为2和3。

4.根据权利要求3所述的方法,其特征在于,所述步骤s2具体包括:

5.根据权利要求4所述的方法,其特征在于,所述步骤s3具体包括:

6.根据权利要求1-5中任一所述的方法,其特征在于,所述步骤s4具体包括:将应用步骤s1-s3所述方法的多尺度注意力特征提取模块,以模块化的方式接入现有的多模态图像融合网络中进行特征融合,得到最终的融合结果。

7.一种应用权利要求1-5中任一所述方法的多尺度注意力特征提取模块,其特征在于,包括:

技术总结一种基于多尺度融合注意力机制的可见光图像与红外图像融合方法,在不同尺度特征图上提取特征的注意力权重矩阵,使多模态图像特征的上下文关联在特征提取过程中充分表达;在注意力模块中引入空洞卷积以降低图像融合过程中的局部信息损失,以解决大感受野下图像细节特征消失的问题。将采用该方法的注意力模块应用于现有的图像融合算法,能够对不同模态图像进行更加充分的特征表达,实现模态间特征互补,进而提升图像融合效果。技术研发人员:周悦,姜雨彤,杨忠琳,李兴鑫,朱梦琪,孙伟琛,王莹,解芳,孙晓霞,岳文斌,沈丽丽,韩震,张欣然受保护的技术使用者:中国北方车辆研究所技术研发日:技术公布日:2024/7/29本文地址:https://www.jishuxx.com/zhuanli/20240730/195869.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表