一种针对旋转双棱镜仿人眼系统成像畸变及色散的协同校正方法

- 国知局

- 2024-07-31 23:08:52

本发明属于成像系统与图像处理,具体涉及一种针对旋转双棱镜仿人眼系统成像畸变及色散的协同校正方法。

背景技术:

1、人眼是人类获取外界信息的主要媒介,其成像特点在于随着视网膜中感光细胞与视网膜中心的距离增大,而感光细胞的排布密度减小,这种特点使得视觉信息的获取具有非均匀特性,即人眼视网膜的中央凹区域分辨高,而外围区域分辨率低。因此仿人眼成像能够对感兴趣区域实现高分辨率成像,而对周边区域进行粗略表达,从而压缩周边区域的冗余数据。基于该特性,仿人眼成像适用于同时对视场、分辨率有较高要求的场合,故而在目标识别与跟踪、智能监控、生物医疗等领域具有广泛的应用前景。

2、目前有多种实现仿人眼成像的器件,例如基于传感器加工技术的单元离散分布的仿人眼传感器,基于曲面透镜阵列的仿人眼传感器等。但上述器件结构较为复杂,受限于制造工艺水平,其实际应用仍有困难。而基于旋转双棱镜成像系统的仿人眼成像方法,其在视场扩展、局部高分辨以及高分区域灵活调整的能力已经得到验证。但由于棱镜对不同波段光束的非均匀折射,使得旋转双棱镜成像系统产生了严重的成像畸变和成像色散。为了校正旋转双棱镜成像系统的成像畸变,已有大量相关研究开展并取得了较好的效果。例如基于一阶近轴近似进行光线追迹并利用单应性变换进行校正,又例如基于矢量折射定律的逆光线追迹畸变校正方法。另外,目前消除旋转双棱镜成像系统的成像色散的方法主要基于光学系统设计,例如根据感兴趣的光谱范围和预期应用的不同与其他不同材料组合设计胶合棱镜或在棱镜上蚀刻光栅,但基于光学系统设计消除色散的方案有着结构笨重、设计难度高、造价昂贵等缺陷。此外,虽然有许多消除色散的图像处理方法。例如利用颜色通道之间的像素相关性实现跨通道信息恢复,从而实现色散消除等。但该类算法主要针对相机本身造成的色散,而不是为旋转双棱镜成像系统设计的,无法解决与色散同时存在的成像畸变问题。

3、在先技术(wang p and huang d,“high-efficiency simplification methodofirregular fov for accelerating the imaging process in the risley-prismsystem,”opt.express,2022,30(21):37364-37378.)提出的一种基于旋转双棱镜成像系统加速图像处理的简化视场方法,通过对完整视场进行简化,加速了获得简化视场内部所有整数点的过程,进而实现高效的成像畸变校正。

4、在先技术(y.zhou,s.fan,g.liu,y.chen,andd.fan,“image distortionscausedby rotational double prisms andtheir correction,”acta opt.sin.35(9),143–150(2015).)提出的利用颜色通道之间的像素相关性来解决色散问题,将问题简化为单通道去模糊,并证明了该方法可以消除色散,恢复高质量的彩色图像。上述两种方法虽然各自解决了图像的畸变问题或色散问题,但却无法同时解决旋转双棱镜造成的畸变及色散问题,且针对相机本身的成像色散设计的算法直接应用于旋转双棱镜成像系统的退化图像上效果不佳。

技术实现思路

1、本发明的目的在于克服上述现有技术存在缺陷,提供一种针对旋转双棱镜仿人眼系统成像畸变及色散的协同校正方法。

2、本发明的原理如下:由于棱镜对不同波长光线的非均匀折射同时造成了成像畸变及色散问题,为了实现退化图像校正,以r通道的偏转视场为参考视场,基于该视场,利用不同通道的折射率对r、g、b通道进行反向映射及双线性插值处理,再重新组合三通道图像,即可同时实现畸变及色散校正。

3、为实现上述目的,本发明的技术方案是:一种针对旋转双棱镜仿人眼系统成像畸变及色散的协同校正方法,利用旋转双棱镜仿人眼系统,获得畸变及色散图像的r通道为参考通道,对r、g、b通道进行畸变校正再合成为rgb图像,实现成像畸变及色散的同时校正。

4、在本发明一实施例中,所述旋转双棱镜仿人眼系统,包括同轴设置的单个rgb相机和两块参数完全相同的楔形棱镜。两块楔形棱镜间隔预定距离共轴放置,能够在步进电机的带动下分别独立旋转。

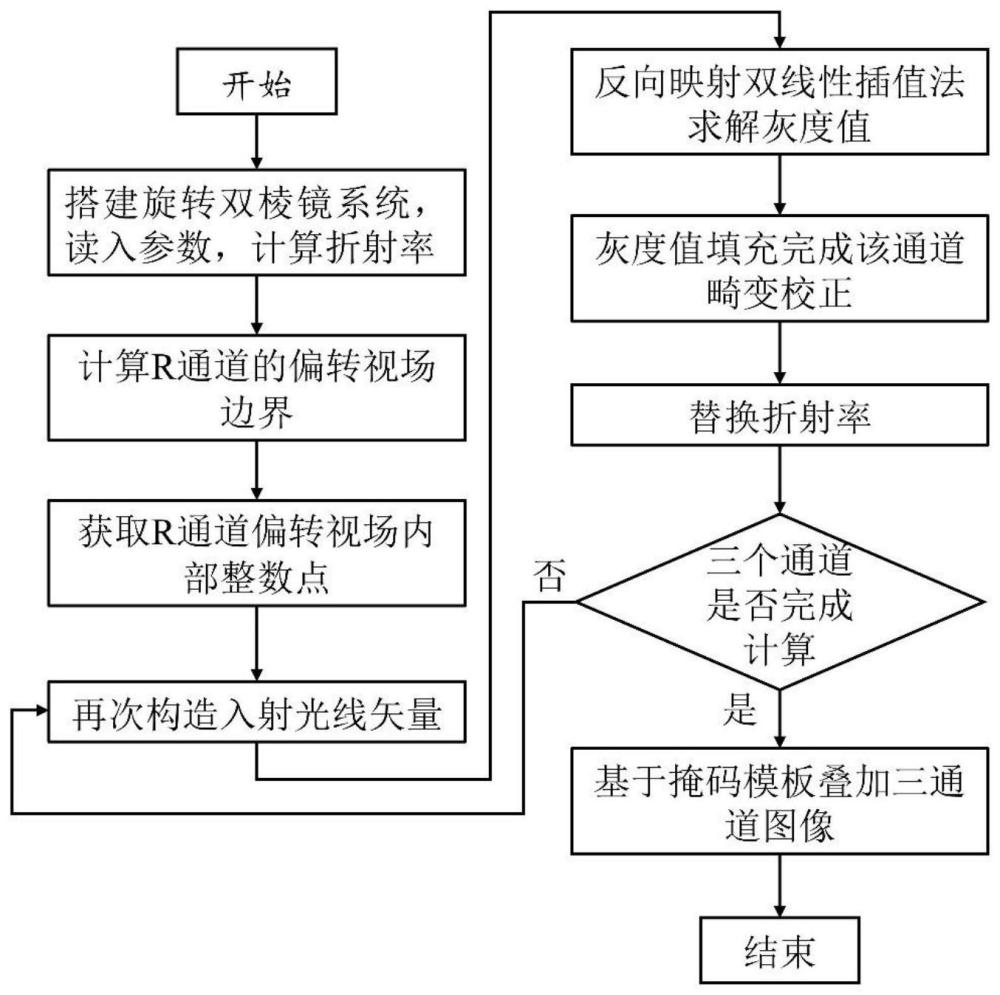

5、在本发明一实施例中,一种针对旋转双棱镜仿人眼系统成像畸变及色散的协同校正方法具体实现步骤如下:

6、步骤s1、搭建旋转双棱镜仿人眼系统,获取畸变及色散图像,计算折射率nr、ng、nb;

7、步骤s2、基于原始视场r通道的矩形边界,读入旋转双棱镜仿人眼系统的双棱镜旋转角,构造双棱镜各面的法向量,根据折射率nr,通过逆光线追迹法求出r通道偏转视场边界在无畸变网格中的位置;

8、步骤s3、获取r通道偏转视场内整数点坐标;

9、步骤s4、基于无畸变网格内的整数点再次构造入射光线矢量;根据折射率nr,利用基于逆光线追迹法的反向映射双线性插值技术得到无畸变网格中整数点在畸变图像网格中的位置及灰度值,最后将灰度值逐一填充至对应的无退化图像网格中,实现相应通道的旋转双棱镜成像畸变的校正;

10、步骤s5、分别对g、b两通道进行畸变校正,利用步骤s3中求出的r通道偏转视场内整数点坐标,将步骤s4中的折射率替换成ng、nb,重复步骤s4;

11、步骤s6、基于掩码矩阵将r、g、b三个通道的畸变校正图像叠加为一幅无彩色边界的rgb图像,最终完成畸变及色散校正。

12、在本发明一实施例中,所述步骤s1中,根据schott公式计算出折射率nr、ng、nb,schott公式为:

13、n2=a0+a1λ2+a2λ-2+a3λ-4+a4λ-6+a5λ-8

14、其中λ为不同波段折射率对应的波长,n为代表r、g、b通道的折射率,a0-a5为由棱镜材质决定的系数。

15、在本发明一实施例中,所述步骤s2具体为:

16、步骤s21、根据旋转双棱镜仿人眼系统中rgb相机像素阵列大小和等效焦距,建立像素阵列边缘发出的光线到棱镜的入射矢量并转换为单位矢量。其中,表示像平面上像素阵列中像素点的坐标,单位为像素(pixel),f表示等效焦距,c∈{r,g,b};

17、步骤s22、根据矢量折射定律计算边缘光线经旋转双棱镜偏转后的边界,公式为:

18、

19、式中,i∈[1,4]为光束通过棱镜表面的次数,n0=n2=n4=1,代表空气中的折射率,n1=n3,表示通过棱镜的红光、绿光和蓝光的折射率nr、ng、nb;和vic分别表示折射前后光束的方向矢量,ni表示折射面的法向量。

20、在本发明一实施例中,所述步骤s4具体为:

21、步骤s41、根据整数点坐标集合a,构造从物平面到像平面的反向入射光线矢量并转换为单位矢量。其中,表示r通道偏转视场内整数点坐标,即无畸变网格中的整数点,f表示等效焦距;

22、步骤s42、利用步骤s41中计算得到的v0c',根据下式,将无畸变网格中的整数点反向映射到畸变网格上得到非整数点在该步骤中,c=r;

23、

24、步骤s43、基于双线性插值公式,利用畸变网格整数点上的灰度信息得到非整数点的灰度信息g;

25、

26、式中,ic、jc分别为非整数点坐标的整数部分;mc、nc分别为非整数点坐标的小数部分,g(ic,jc),g(ic,jc+1),g(ic+1,jc),g(ic+1,jc+1)代表在畸变网格中与非整数点最邻近的四个整数点的灰度信息。

27、在本发明一实施例中,所述步骤s5具体为:

28、步骤s51、利用步骤s3中求出的r通道的整数点坐标,重复步骤s4,步骤s42中的折射率替换成ng,完成g通道的畸变校正;

29、步骤s52、利用步骤s3中求出的r通道的整数点坐标,重复步骤s4,步骤s42中的折射率替换成nb,完成b通道的畸变校正。

30、在本发明一实施例中,所述步骤s6具体为:

31、步骤s61、将步骤s52获得的畸变网格中非整数点的灰度信息g逐一赋给无畸变网格中的整数点得到不同通道校正图像的矩阵r、g、b;

32、步骤s62、根据校正图像的像素位置,为每个通道构造相应的掩码矩阵rmask,gmask,bmask,三个掩模矩阵的对应位置的值被点乘以获得表示三个矩阵的非零区域的交集的最终掩模矩阵cmask;

33、步骤s63、cmask分别与矩阵r、g、b点相乘,产生不同通道新的校正图像,组合起来形成rgb图像,即实现畸变及色散校正,且消除边界彩色条纹。

34、本发明还提供了一种针对旋转双棱镜仿人眼系统成像畸变及色散的协同校正系统,包括存储器、处理器以及存储于存储器上并能够被处理器运行的计算机程序指令,当处理器运行该计算机程序指令时,能够实现如上述所述的方法步骤。

35、本发明还提供了一种计算机可读存储介质,其上存储有能够被处理器运行的计算机程序指令,当处理器运行该计算机程序指令时,能够实现如上述所述的方法步骤。

36、相较于现有技术,本发明具有以下有益效果:

37、1、本发明提出了一种图像畸变和色散的协同校正方法,该方法基于r通道的偏转视场校正rgb通道,实现了高质量成像。该方法可以在不增加旋转双棱镜成像光路复杂度的情况下实现彩色成像,打破了现有仿人眼旋转双棱镜成像系统对波段的限制,在成像侦察、目标跟踪、智能识别等领域显示出巨大的应用潜力。

38、2、本发明基于一种图像畸变和色散的协同校正方法,有效解决了畸变及色散问题,并进一步解决了视场的边界问题,为后续基于校正图像的图像拼接,多光谱重建等任务提供了高质量的成像效果。

本文地址:https://www.jishuxx.com/zhuanli/20240730/196082.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表