一种在学习陪护中检测用户学习状态的方法、装置和介质与流程

- 国知局

- 2024-07-31 23:14:13

本发明涉及图像处理,尤其涉及一种在学习陪护中检测用户学习状态的方法、装置和介质。

背景技术:

1、随着远程学习模式的普及和互联网技术的飞速发展,学习陪护的方式也迎来了新的变革。传统的面对面学习陪护模式受到地理距离的限制,无法满足广大学习者以及陪护者的需求。在这样的背景下,远程学习陪护打破了地域限制,让学习陪护变得更加灵活和便捷。

2、cn106779614a提供了一种用于可穿戴设备的学习监测方法、装置及可穿戴设备,该方法包括:采集佩戴可穿戴设备的学生的手部运动数据;根据手部运动数据识别出学生写作业的动作;根据写作业的动作确定学生的学习状态。该方法需要学生主动佩戴设备,可能会对学生造成一定的不便或干扰,且仅能获取手部运动数据,无法直接获取学习场景中的相关信息,对学习状态的判断准确性尚有待提高。

3、因此,需要一种在学习陪护中检测用户学习状态的方法、装置和介质,在用户不佩戴特殊设备的情况下更准确地实现学习状态检测。

技术实现思路

1、有鉴于此,为了解决佩戴可穿戴设备会对学生造成一定的不便或干扰、对学习状态的判断不准确的问题,本发明实施例提供了一种在学习陪护中检测用户学习状态的方法、装置和介质,不依赖于佩戴其它设备,且能够较为准确地反映学生的学习状态。

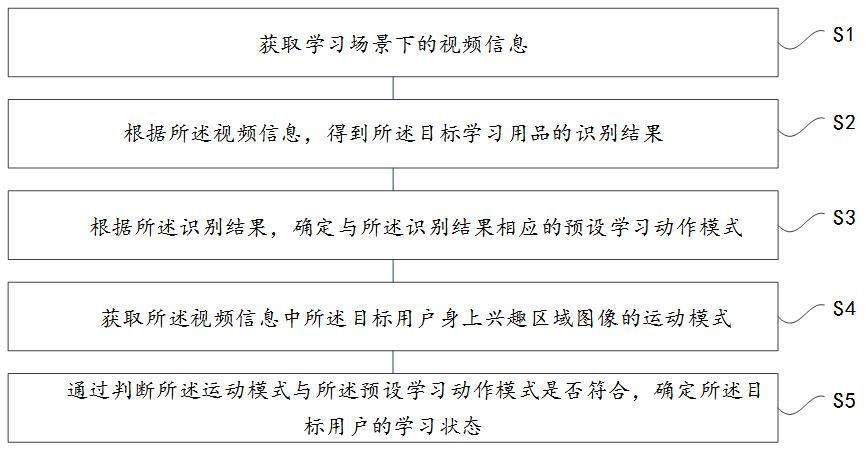

2、第一方面,本发明实施例提供了一种在学习陪护中检测用户学习状态的方法,该方法包括:获取学习场景下的视频信息,所述学习场景中至少包括目标用户和目标学习用品;根据所述视频信息,得到所述目标学习用品的识别结果;根据所述识别结果,确定与所述识别结果相应的预设学习动作模式;获取所述视频信息中所述目标用户身上兴趣区域图像的运动模式;通过判断所述运动模式与所述预设学习动作模式是否符合,确定所述目标用户的学习状态。

3、优选的,所述目标学习用品是所述目标用户在所述学习场景下使用的学习用品,包括笔、书册、橡皮擦、尺子、剪刀中至少一种;所述根据视频信息,得到目标学习用品的识别结果包括:根据所述视频信息,获取所述目标用户的手部区域图像;获取所述手部区域图像中所述目标学习用品的所述识别结果。

4、优选的,所述获取所述手部区域图像中所述目标学习用品的所述识别结果包括:对所述手部区域图像中的学习用品元素进行提取,所述学习用品元素是所述目标学习用品的组成部分和/或特征;根据提取到的所述学习用品元素,按照预设规则,识别所述目标学习用品的类型。

5、优选的,所述获取所述视频信息中目标用户身上兴趣区域图像的运动模式包括:获取所述视频信息中的多个视频帧;确定相邻的所述视频帧之间所述兴趣区域图像的运动向量;根据所述多个视频帧中相邻的所述视频帧之间所述兴趣区域图像的运动向量,得到所述多个视频帧中所述兴趣区域图像的运动趋势;根据所述多个视频帧中所述兴趣区域图像的运动趋势,确定所述兴趣区域图像的所述运动模式。

6、优选的,所述确定相邻的所述视频帧之间所述兴趣区域图像的运动向量包括:确定所述兴趣区域图像在一个所述视频帧中相对于前一视频帧中在x方向上的第一运动向量和在y方向上的第二运动向量;所述根据所述多个视频帧中相邻的所述视频帧之间所述兴趣区域图像的运动向量,得到所述多个视频帧中所述兴趣区域图像的运动趋势包括:将获取的所述多个视频帧按照预设时间间隔分组,得到多组视频帧;将每一组中的若干视频帧对应的第一运动向量求和,得到第一叠加向量;根据多个组的第一叠加向量,得到第一向量集合;将每一组中的若干视频帧对应的第二运动向量求和,得到第二叠加向量;根据多个组的第二叠加向量,得到第二向量集合;根据所述第一向量集合与所述第二向量集合,得到所述兴趣区域图像的运动趋势。

7、优选的,所述兴趣区域图像包括手部区域图像;所述预设学习动作模式包括用笔书写模式、翻阅书册模式;所述判断所述运动模式与所述预设学习动作模式是否符合包括:如果所述手部区域图像包括笔,则判断所述第一向量集合内的所述第一叠加向量是否呈现由小变大、由大变小交替出现的变化趋势,且所述第二向量集合内的第二叠加向量是否呈现由小变大的变化趋势,若是,则所述运动模式与所述用笔书写模式相符合;如果所述手部区域图像包括书册,则从目标用户的两只手分别对应的手部区域图像中,确定运动幅度较大的所述手部区域图像;针对所述运动幅度较大的所述手部区域图像,判断所述第一向量集合内的所述第一叠加向量是否呈现由小变大、由大变小交替出现的变化趋势,且所述第二向量集合内的第二叠加向量是否呈现由小变大的变化趋势,若是,则所述运动模式与所述翻阅书册模式相符合。

8、优选的,在所述根据所述视频信息,得到目标学习用品的识别结果之前,所述方法还包括:根据所述视频信息,通过深度学习算法,确定所述学习场景中用户是否为儿童;根据所述视频信息,识别所述学习场景中所述用户的位置;当所述用户为儿童时,将所述位置符合预设位置范围的所述用户确定为所述目标用户。

9、优选的,所述方法还包括对所述视频信息进行预处理,所述预处理包括:将所述视频信息中至少一个视频帧转换为灰度图;计算所述灰度图的平均灰度值;若所述平均灰度值超出预设阈值,则对所述视频帧的三通道图像分别做直方图均衡化处理。

10、另一方面,提供了一种在学习陪护中检测用户学习状态的装置,所述装置包括:视频获取模块,用于获取学习场景下的视频信息;识别模块,用于根据所述视频信息,得到目标学习用品的识别结果;确定模块,用于根据所述识别结果,确定与所述识别结果相应的预设学习动作模式;运动获取模块,用于获取所述视频信息中目标用户身上兴趣区域图像的运动模式;判断模块,用于通过判断所述运动模式与所述预设学习动作模式是否符合,确定所述目标用户的学习状态。

11、另一方面,提供了一种存储介质,其上存储有计算机程序指令,当所述计算机程序指令被处理器执行时实现如上述任一项所述的方法。

12、综上所述,本发明的有益效果如下:通过获取学习场景下的视频信息来检测学习状态,不依赖于佩戴其它设备,学生在进行学习活动时不会受到设备产生的干扰或阻碍,能够保持自然的学习状态,基于实时视频信息的检测方法,能够实时捕获学生的学习状态,有利于为陪护者提供即时的反馈;根据视频信息,识别目标学习用品,能够提取视频中的关键信息,如学生在学习时使用的学习用品等,为学习状态的判断提供了丰富的数据基础;根据识别结果,确定与识别结果相应的预设学习动作模式,获取视频信息中目标用户身上兴趣区域图像的运动模式;通过判断运动模式与预设学习动作模式是否符合,确定所述目标用户的学习状态,其中,预设学习动作模式是根据目标学习用品的常规使用方式而设置的,这种针对性的设计使得判断更加符合实际学习情境,从而本发明这种基于模式匹配的判断方法具有较高的准确性,能够较为准确地反映学生的学习状态。

技术特征:1.一种在学习陪护中检测用户学习状态的方法,其特征在于,所述方法包括:

2.根据权利要求1所述的方法,其特征在于,所述根据所述视频信息,得到所述目标学习用品的识别结果包括:

3.根据权利要求2所述的方法,其特征在于,所述获取所述手部区域图像中所述目标学习用品的所述识别结果包括:

4.根据权利要求1所述的方法,其特征在于,所述获取所述视频信息中目标用户身上兴趣区域图像的运动模式包括:

5.根据权利要求4所述的方法,其特征在于,

6.根据权利要求5所述的方法,其特征在于,所述兴趣区域图像包括手部区域图像;所述预设学习动作模式包括用笔书写模式、翻阅书册模式;

7.根据权利要求1至6任一项所述的方法,其特征在于,在所述根据所述视频信息,得到目标学习用品的识别结果之前,所述方法还包括:

8.根据权利要求1至6任一项所述的方法,其特征在于,所述方法还包括对所述视频信息进行预处理,

9.一种在学习陪护中检测用户学习状态的装置,其特征在于,所述装置包括:

10.一种存储介质,其上存储有计算机程序指令,其特征在于,当所述计算机程序指令被处理器执行时实现如权利要求1-8中任一项所述的方法。

技术总结本发明涉及图像处理技术领域,尤其涉及一种在学习陪护中检测用户学习状态的方法、装置和介质,解决现有技术中佩戴设备产生不便或判断不准确的问题。该方法包括:获取学习场景下的视频信息,所述学习场景中至少包括目标用户和目标学习用品;根据视频信息,得到目标学习用品的识别结果;根据识别结果,确定与识别结果相应的预设学习动作模式;获取视频信息中目标用户身上兴趣区域图像的运动模式;通过判断运动模式与预设学习动作模式是否符合,确定目标用户的学习状态。本发明不依赖于佩戴其它设备,且能够较为准确地反映学生的学习状态。技术研发人员:张智,陈辉,杜沛力,张青军,胡光辉受保护的技术使用者:宁波星巡智能科技有限公司技术研发日:技术公布日:2024/7/29本文地址:https://www.jishuxx.com/zhuanli/20240730/196578.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。