一种基于多头融合的步态情绪识别方法及系统与流程

- 国知局

- 2024-07-31 23:17:54

本发明涉及人工智能,尤其涉及一种基于多头融合的步态情绪识别方法及系统。

背景技术:

1、感知人的情绪是智能交互和情感计算的重要部分,它涉及心理学、计算机科学和认知行为学等多个领域。情感识别可用于人机交互,使智能系统能够更好地理解人的情感,从而与人更好地合作。比如,智能机器人通过向孤独症儿童展示不同步态及表达的情感,帮助孤独症儿童更好地理解情绪、安全监控的摄像头可以通过行人的步态识别情绪,为愤怒情绪下故意伤人事故的发生做预警,有利于减少人员伤亡,为公共安全助力。

2、在不该情绪识别的方法中,相比较于传统机器学习的方法,基于深度学习的方法识别效果显著提升。randhavane等人提出了一个包含四类情绪标签(快乐,悲伤,愤怒或中性)emotion-gait数据集,并采用lstm的方法进行情绪识别。venkatraman等人提出了proxemo一种新颖的端到端情感预测算法,应用于具有社交意识的机器人导航,通过步行步态预测行人的感知情绪。在会议aaai-2020上bhattacharya等人在step中应用空间时时图卷积网络(st-gcn)体系结构并通过变分自动编码器(cvae)生成的带注释的合成步态进行数据增强。在会议eccv-2020中bhattacharya等人在taew中提出了一种基于自动编码器的半监督方法,先用无情绪标签数据集训练基于gru的自编码器进行无监督学习,然后再用有情绪标签数据集进行监督学习,在emotion-gait基准数据集上的平均精度为84%。

3、但是现有的情绪识别方法中,使用相机坐标系下的步态数据作为输入,忽略了个体在不同的环境下行走时,相对于相机的行走位置和姿态可能会发生变化,数据特征无法保持一致。而且只关注了步态数据本身,忽略了个体的姿态特征和运动特征对情绪识别的重要影响,这样会导致模型无法充分捕捉个体在不同情绪状态下的细微变化。另外使用单一输出头进行情绪分类,可能会引入模型偏差,无法充分利用多样化的信息和特征,限制了模型的表征能力和分类准确率。

技术实现思路

1、基于背景技术存在的技术问题,本发明提出了一种基于多头融合的步态情绪识别方法及系统,提高了步态情绪识别的准确率。

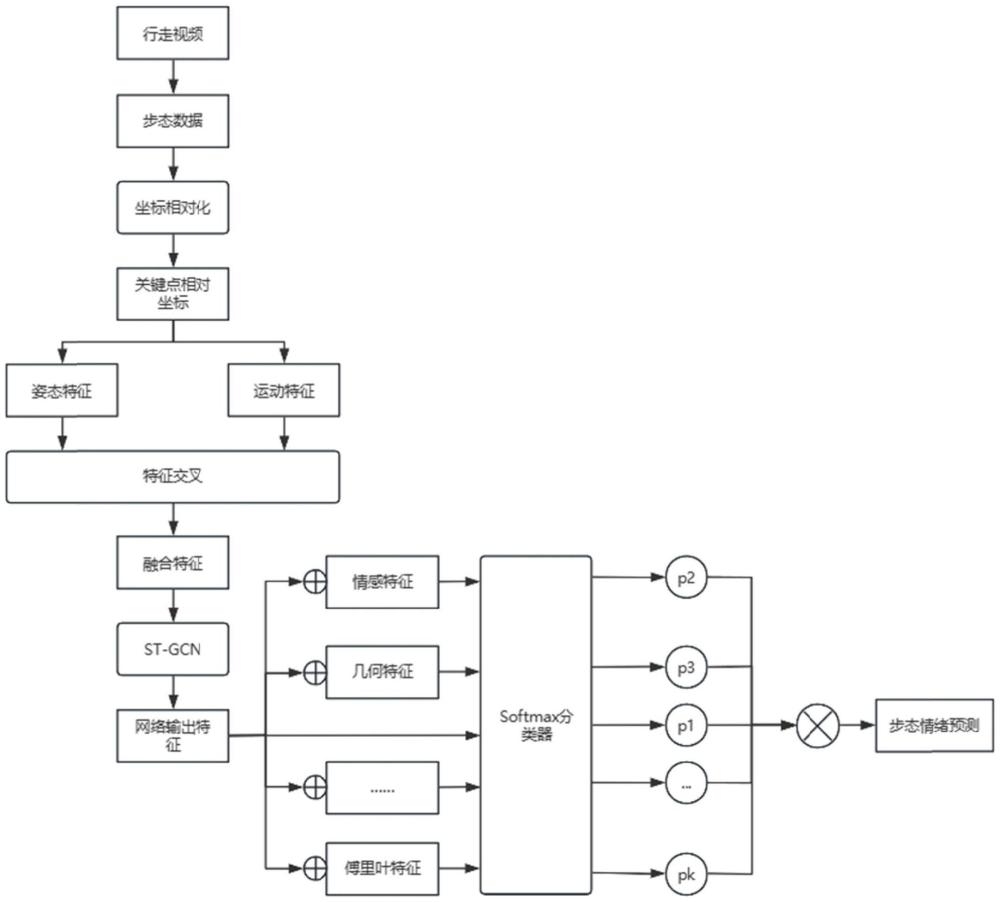

2、本发明提出的一种基于多头融合的步态情绪识别方法,包括如下步骤:

3、获取待预测视频,对待预测视频进行预处理得到融合特征;

4、将融合特征输入到情感预测模型中,以输出步态情绪预测结果;

5、所述情感融合模型的训练过程如下:

6、s1、获取多个步行周期的人物行走视频,并基于3d人体姿态估计模型提取每个步行周期的人物行走视频的步态关节点在相机坐标系下的绝对坐标g,记为(s,t,k),s为样本数量,t为时间步数,k为关节点坐标;

7、s2、利用坐标相对化,将绝对坐标g转化为相对于根关节gr的坐标系下的相对坐标gt;

8、s3、将相对坐标gt输入到特征交叉模块中,得到融合特征f,基于每个步行周期的人物行走视频对应的融合特征构建训练集;

9、s4、将训练集输入到st-gcn网络中,以输出特征向量fst;

10、s5、采用多头的分类输出头对特征向量fst进行处理,以输出步态情绪预测结果,基于步态情绪预测结果对情感融合模型进行训练调整。

11、进一步地,在步骤s2中,相对坐标gt的生成公式如下:

12、gt=crxt+t

13、x(i,j)={g(i,j)-gr(i,j)}i∈[0,t]∩i∈z,j∈[0,k]∩j∈z

14、r,c,t=gettrans(x(i,0),gr)

15、其中,c表示缩放因子,r表示旋转矩阵,t表示平移向量,x(i,j)表示样本中第i个时间步第j个关节点的绝对坐标,xt表示关节点绝对坐标,g(i,j)表示样本中第i个时间步第j个关节点的相对坐标,gr(i,j)表示样本中第i个时间步第j个关节点所在坐标系的根关节点的相对坐标,z表示整数,gettrans(·)表示计算x(i,0)与gr(0,0)两个坐标之间的旋转矩阵、缩放因子和平移向量的函数。

16、进一步地,融合特征f生成过程如下:

17、将相对坐标gt作为步态数据输入到特征交叉模块中,得到每一时刻步态数据对应的姿态特征fp以及运动特征fm,其中根节点gr采用绝对坐标送入特征交叉模块中;

18、对相对坐标gt、姿态特征fp以及运动特征fm融合,得到融合特征f。

19、进一步地,在st-gcn网络以st-gcn为主体结构,在st-gcn的平均池化部分增加两个平均池化层,以保证计算量不变并减少过拟合。

20、进一步地,在步骤s5中,步态情绪预测的生成过程如下:

21、第一个分类输出头将特征向量fst送入softmax分类器中,得到步态情绪概率p1;

22、另一个分类输出头将设定的步态特征附加到特征向量fst上,生成混合特征向量fstas,将混合特征向量fstas通过完全连接层送入soffmax分类器中,得到步态情绪概率ps;

23、将概率p1和概率ps加权平均,得到最终的分类预测概率p(ω),基于分类预测概率p(ω)输出步态情绪预测结果。

24、进一步地,在另一个分类输出头将设定的步态特征附加到特征向量fst上,生成混合特征向量fstas,将混合特征向量fstas通过完全连接层送入softmax分类器中,得到步态情绪概率ps中,包括:

25、第二个分类输出头将情感特征aff附加到特征向量fst上,生成混合特征向量fsta2,将混合特征向量fsta2通过完全连接层送入softmax分类器中,得到步态情绪概率p2;

26、或者/同时

27、第三个分类输出头将几何特征bff附加到特征向量fst上,生成混合特征向量fsta3,将混合特征向量fsta3通过完全连接层送入softmax分类器中,得到步态情绪概率p3;

28、或者/同时

29、第四个分类输出头将傅里叶特征cff附加到特征向量fst上,生成混合特征向量fsta4,将混合特征向量fsta4通过完全连接层送入softmax分类器中,得到步态情绪概率p4。

30、进一步地,情感融合模型的损失函数loss如下:

31、

32、ωk=argminlk(ω)

33、

34、其中,l(·)表示损失函数,ω表示表示可训练的权重,g表示步态情绪的真实标签值,k表示分类输出头的头数,k表示第k个分类输出头,ωk表示第k个分类输出头对应的可训练的权重,pk表示第k个分类输出头对应的步态情绪概率,argmin表示使lk(ω)取最小值时所对应的ω,lk表示第k个分类输出的损失函数。

35、一种基于多头融合的步态情绪识别系统,包括预处理模块和融合输出模块;

36、预处理模块用于获取待预测视频,对待预测视频进行预处理得到融合特征;

37、融合输出模块用于将融合特征输入到情感预测模型中,以输出步态情绪预测结果;

38、所述情感融合模型的训练过程如下:

39、s1、获取多个步行周期的人物行走视频,并基于3d人体姿态估计模型提取每个步行周期的人物行走视频的步态关节点在相机坐标系下的绝对坐标g,记为(s,t,k),s为样本数量,t为时间步数,k为关节点坐标;

40、s2、利用坐标相对化,将绝对坐标g(s,t,k)转化为相对于根关节gr的坐标系下的相对坐标gt;

41、s3、将相对坐标gt输入到特征交叉模块中,得到融合特征f,基于每个步行周期的人物行走视频对应的融合特征构建训练集;

42、s4、将训练集输入到st-gcn网络中,以输出特征向量fst;

43、s5、采用多头的分类输出头对特征向量fst进行处理,以输出步态情绪预测结果,基于步态情绪预测结果对情感融合模型进行训练调整。

44、一种计算机可读储存介质,所述计算机可读储存介质上存储有若干分类程序,所述若干分类程序用于被处理器调用并执行如上所述的步态情绪识别方法。

45、本发明提供的一种基于多头融合的步态情绪识别方法及系统的优点在于:本发明结构中提供的一种基于多头融合的步态情绪识别方法及系统,将多种情感特征与数据交叉融合,通过多头集成的方法,提高了步态情绪识别的准确率,可以更帮助计算机视觉系统更全面地捕捉和理解个体的情感状态。而且情感融合模型预测时充分利用了多头的分类输出头的输出结果,使用不同的权重来平衡不同输出头的损失,提高了情感融合模型的泛化能力,提高情感融合模型的稳定性。

本文地址:https://www.jishuxx.com/zhuanli/20240730/196878.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表