一种基于聚合令牌感知特征的单目标跟踪方法

- 国知局

- 2025-01-10 13:35:57

本发明主要涉及视觉与图像处理,具体是一种基于聚合令牌感知特征的单目标跟踪方法。

背景技术:

1、单目标跟踪是计算机视觉领域的一项重要任务,它广泛应用于视频监控、自动驾驶、智能交通等领域,研究高效的单目标跟踪网络对于推进社会生产和日常生活具有重要的理论和实践意义,跟踪的性能受到很多因素的影响,如光照、遮挡、尺寸变化和复杂的背景干扰等等,传统方法使用卷积神经网络进行特征的提取和匹配,但存在全局和局部特征不能很好融合的问题,导致细微的特征被弱化,vision transformer因其在捕捉远距离依赖和自我注意机制方面的优势,逐渐成为单目标跟踪任务的主流热点,然而这种模型通常包含大量的参数和计算开销,而对其进行简单的剪枝又会造成性能损失,这对实时性要求高的单目标跟踪任务提出了挑战,因此,轻量级单目标跟踪网络的研究已经成为一个重要的方向。

2、目前,轻量化的单目标跟踪网络在性能上仍然存在一些问题,主要有以下两点:

3、(1)轻量化网络在精度与速度的平衡:在轻量化的单目标跟踪网络中,精度与速度的平衡存在着一些不足之处。这是因为在努力设计轻量级模型的过程中,往往需要在模型运行速度和跟踪准确性之间做出权衡。一些轻量化模型可能在追求更快的速度时,牺牲了一定的准确性,导致跟踪目标时的精度下降。

4、(2)复杂场景下的鲁棒性:在轻量化的单目标跟踪网络中,面对复杂场景下的挑战,如光照变化剧烈、背景复杂多变等情况下,其鲁棒性存在明显缺陷。这种不足可能导致跟踪网络在应对复杂环境时表现不稳定甚至失败的情况。

5、综上所述,本发明提供了一种基于聚合令牌感知特征的单目标跟踪方法。

技术实现思路

1、为了解决现有技术的问题,本发明提供了一种基于聚合令牌感知特征的单目标跟踪方法。

2、本发明为实现上述目的,通过以下技术方案实现:

3、一种基于聚合令牌感知特征的单目标跟踪方法,其特征在于,所述方法包括如下步骤:

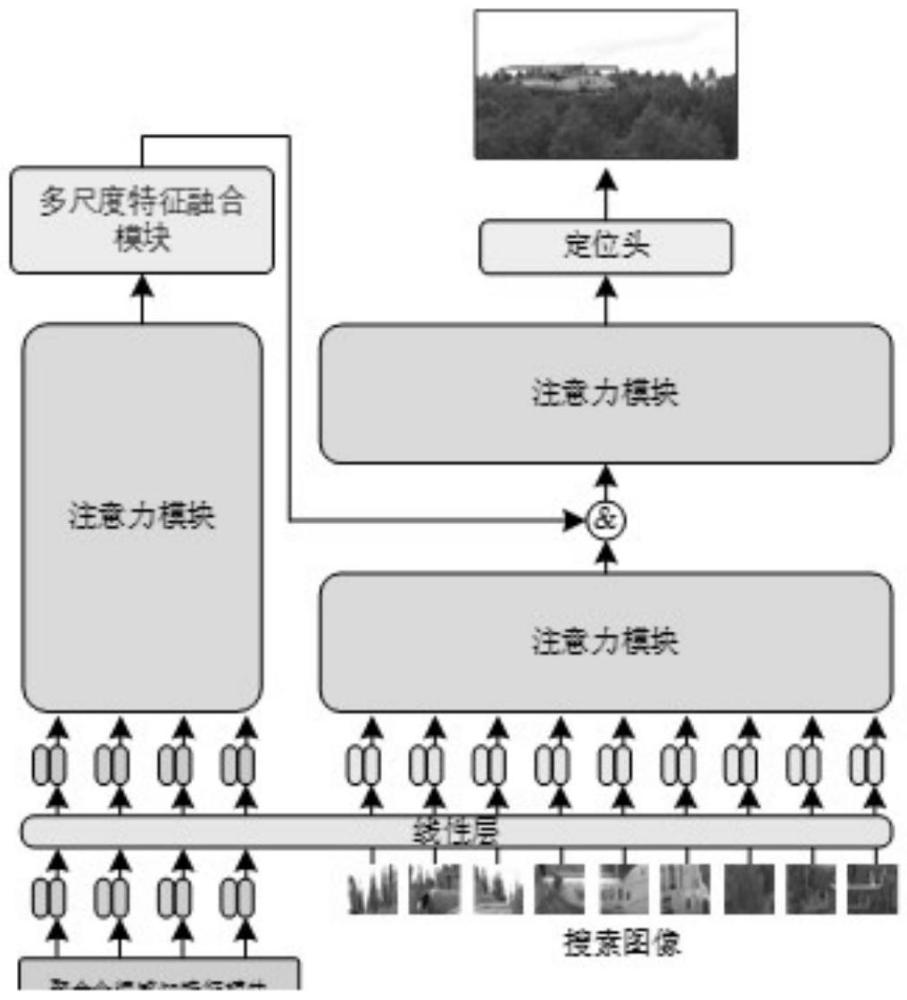

4、步骤1:基于聚合令牌感知特征的单目标跟踪下,构建得到由vit-b主干网络、聚合令牌感知特征模块、多尺度特征融合模块和定位头组成的整体模型。

5、步骤2:初始化:给定数据集x包含n个视频序列,选定第一帧图像和目标的初始边界框位置,使用预训练vit-b主干网络的目标检测模型或手工标注的边界框来初始化跟踪模型。

6、步骤3:特征提取与增强过程,通过聚合令牌感知特征模块获得模版重点信息,利用深度神经网络精确提取当前帧图像和目标区域的特征表示,将裁剪好的目标区域输入到特征提取网络中,网络会依次经过多个注意力层,提取从底层的纹理特征到高层的语义特征,最终输出一个固定长度的特征向量,作为目标的特征表示。

7、步骤4:目标定位与跟踪:将当前帧特征和初始目标特征输入到跟踪网络中,重复上述特征提取步骤,在后续帧图像中持续通过训练好的模型处理视频序列跟踪目标,最终输出带有目标位置标注的视频序列。

8、步骤5:模型训练和性能评估:模型的训练需要训练数据集和测试数据集,而评估模型性能的好坏需要多个评估指标。

9、在步骤3中,聚合令牌感知特征模块能够有效聚合图像的原始表征信息用于感知特征,其中聚合图像的过程可以归纳为如下:

10、rowavg=avg(z11,z12,z13...z1n)

11、column_avg=avg(z11,z21,z31...zn1)

12、z′=z-row_avg+z-column_avg

13、其中zij表示原始图像二维特征图第i行第j列的值,row_avg代表二维特征图对每一行的平均值,column_avg代表二维特征图每一列的平均值,avg(·)表示取平均值,z′表示经过上述操作后最终输入到vit中的值,即

14、

15、通过上述这种减去模版特征图平均值的操作,能够对特征图中的信息进行聚合并加权,使模型更加关注目标区域。

16、在步骤1中,多尺度特征融合模块用于弥补特征提取不足以及捕捉小目标或图像细微变化的缺点,多尺度的特征融合模块具有四个不同的层,每一层中又包含着不同数量和大小的卷积,以此来获得更加丰富的感受野和和更深层次的语义信息,将输出的特征传入多尺度特征融合模块中,通过不同层、不同大小的卷积,将每一层的输出进行融合;

17、以上过程可以表述为:

18、d0=zoutput

19、

20、

21、

22、

23、其中zoutput表示模板图像经过vit之后的输出,di表示模块中第i层的输出,cat表示拼接操作。

24、经过上述操作后的模板特征具有更深层次的语义信息,为了保留这些信息,最终我们将每一层得到的结果与原始特征d0进行残差连接,做逐元素相加的操作,得到最后的结果doutput:

25、doutput=d0+d1+d2+d3+d4

26、整个网络模型的在进行注意力计算时,对模板图像z进行特征提取保持方式不变;

27、而对于搜索图像x进行注意力计算时,我们延续异步特征提取的方式,对于前5层对搜索图像x进行单独的特征提取,公式如下:

28、

29、

30、其中,q、k和v分别为查询矩阵、键矩阵和值矩阵。下标z和x分别表示属于模板和搜索区域的矩阵项。z’表示模板图像z经过聚合令牌感知模块后的输出。

31、在后续的几层上做与模版图像特征经过多尺度的特征融合模块后的输出doutput进行拼接再进行注意力的计算,公示如下:

32、

33、其中q、k和v分别是查询矩阵、键矩阵和值矩阵。下标x和d表示属于搜索区域的矩阵项和模板图像通过多尺度特征融合模块后的输出。

34、在所述步骤3中,目标跟踪中的角点定位和中心头定位是两种常见的预测方式,用于确定目标在图像或视频中的位置和姿态,由于角点定位存在边界框远大于目标的情况而产生过多的冗余和错误信息,因此我们在这里采用中心头的方式进行预测,即采用三个卷积分支分别代表中心分类、偏移量回归和大小回归,然后使用相应的回归坐标来计算边界框,将目标位置确定为最终的预测结果。

35、对于损失函数部分,采用加权焦点损失进行分类,并对l1损失和普通的giou损失进行组合进行训练,最终的总损失函数表示如下:

36、

37、其中,λg=2和是权衡权重。

38、在所述步骤5中,训练数据集:got-10k,一个包含10000个视频剪辑,涵盖超过560类移动对象和87种运动模式中的大多数训练和测试类别之间没有重叠,trackingnet:一个大规模的目标跟踪数据集,训练集数据包括30132个序列,每个序列平均471.4帧,lasot:一个大规模,长序列的目标跟踪数据集,包含1140个训练序列,280个测试序列,1400个序列,总计超过350万帧,平均视频长度为2500帧,所有序列都是长期的,coco:数据集有32.8万张图片,包含有250万个标注实例,通过使用先进的类别检测、实例标注、实例分割等用户界面创建;

39、训练模型时,对于got-10k数据集的基准测试,遵照一次性协议,只使用got-10k分割好的训练集作为模型的训练集,并对模型训练了100epoch,对于其他基准,使用trackingnet,lasot,got-10k以及coco训练分割对模型训练了300epoch。

40、优化器是adamw优化器,权重衰减为1e-4,编码器和解码器的初始学习速率分别为4e-5和4e-4,batch size设为32。

41、使用pytorch2.2在python3.11中在一张内存为48g nvidiaa40的显卡上实现,每个epoch训练时长为5分钟左右。

42、评估指标曲线下面积(auc)用于衡量跟踪算法在不同重叠阈值下的整体性能,计算公式如下:

43、

44、其中,sr是不同重叠阈值下的成功率,α是重叠阈值(iou)。更高的auc值表示算法在各种条件下表现更好。

45、精确度(p)衡量预测位置与真实目标位置的平均偏差,特别是中心位置的偏差。计算公式如下:

46、

47、其中,n是帧的总数,ci是第i帧预测框的中心位置,是第i帧真实框的中心位置,是两个中心点之间的欧式距离,i是指示函数,当距离小于等于阈值δ时取1,否则为0。高精度表示跟踪目标中心位置的预测准确。

48、归一化精度(pnorm)用于衡量不同尺度下的跟踪精度,标准化处理消除不同视频间的尺度差异影响;

49、

50、其中,diag(gi)是第i帧真实框的对角线长度;

51、平均重叠度(ao)衡量预测框和真实框的平均重叠度,反映跟踪结果与真实目标的匹配程度;

52、

53、其中,bi是第i帧预测边界框,gi是第i帧真实边界框,iou(bi,gi)是预测框和真实框的交并比。

54、sr0.5和sr0.75分别表示在0.5和0.75的iou阈值下的成功率,用于评估跟踪算法在不同严格程度下的表现;

55、

56、其中,α是iou阈值(0.5或者0.75),i是指示函数,当iou大于等于阈值时取1,否则为0。

57、fps衡量跟踪算法的处理速度,尤其在实时应用中至关重要;

58、

59、高fps值表示算法能够实时处理更多帧。

60、对比现有技术,本发明的有益效果是:

61、本发明提出了提出一种基于聚合令牌感知特征的单目标跟踪方法,在不增加网络负担的情况下,通过聚合令牌突出显示图像中的信息,通过计算模版图像的重点信息,得到聚合令牌代替原模版令牌,从而增强模版的重点信息,多尺度特征融合模块,融合了深层和浅层语义信息,弥补了剪枝操作带来的损失,丰富了图像信息。

62、在三个数据集上进行了大量实验,结果证明了基于聚合令牌感知特征的单目标跟踪方法的有效性和鲁棒性,在各类场景下的优势,本发明方法在目标遮挡、目标外观形态变化等情况下依然可以实现快速准确的跟踪,本发明提供的单目标跟踪方法通过其创新的聚合令牌感知特征方法和网络结构,为目标跟踪领域带来了一种既高效又轻量的解决方案,具有广泛的应用前景,特别是在需要实时处理大量数据的现代应用中表现尤为突出。

本文地址:https://www.jishuxx.com/zhuanli/20250110/354132.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。