1.本技术涉及自动驾驶技术领域,具体涉及一种车道线图的构建方法、装置、电子设备及可读存储介质。

背景技术:

2.人们对车辆辅助驾驶及无人驾驶的需求越来越大,自动驾驶车辆运行过程中需要传感器感知环境信息,同时也需要地图来提供详细的道路信息及高精度定位来对感知系统做出补充与增强。

3.目前主流的高精地图构建方法是通过配备了rtk-gps、imu、相机、激光雷达、雷达、车轮里程表等地图采集车来完成的,rtk-gps进行厘米级的定位,雷达\激光雷达进行周围环境的点云扫描,然后生成高精地图。

4.这种方法需要消耗大量的人力,并且无法保证及时更新地图。

技术实现要素:

5.针对上述问题,本技术实施例提供了一种车道线图的构建方法、装置、电子设备及可读存储介质,提供了一种轻量级的可实时的建图方法,以克服或部分克服现有技术的不足之处。

6.第一方面,本技术实施例提供了一种车道线图的构建方法,包括:

7.获取相机视频数据和rtk数据,并根据所述rtk数据对所述相机视频数据进行匹配处理,得到多帧建图图像数据;其中,所述相机视频数据为车载单目相机拍摄得到;

8.基于深度学习模型,识别各帧建图图像数据中的车道线信息,所述车道线信息包括车道线预测位置;

9.将所述车道线预测位置转换到世界坐标系,得到车道线实际位置;

10.融合所述车道线实际位置和历史车道线信息,得到所述车道线图。

11.第二方面,本技术实施例还提供了一种车道线图的构建装置,包括:

12.预处理单元,用于获取相机视频数据和rtk数据,并根据所述rtk数据对所述相机视频数据进行匹配处理,得到多帧建图图像数据;其中,所述相机视频数据为车载单目相机拍摄得到;

13.识别单元,用于基于深度学习模型,识别各帧建图图像数据中的车道线信息,所述车道线信息包括车道线预测位置;

14.转换单元,用于将所述车道线预测位置转换到世界坐标系,得到车道线实际位置;

15.融合单元,用于融合所述车道线实际位置和历史车道线信息,得到所述车道线图。

16.第三方面,本技术实施例还提供了一种电子设备,包括:处理器;以及被安排成存储计算机可执行指令的存储器,所述可执行指令在被执行时使所述处理器执行上述任一的方法。

17.第四方面,本技术实施例还提供了一种计算机可读存储介质,所述计算机可读存

储介质存储一个或多个程序,所述一个或多个程序当被包括多个应用程序的电子设备执行时,使得所述电子设备执行上述任一的方法。

18.本技术实施例采用的上述至少一个技术方案能够达到以下有益效果:

19.本技术通过利用车载单目相机实时拍摄道路视频以及gps获取的rtk数据,结合深度学习模型,识别各帧建图图像数据中的车道线信息,并将预测得到的车道线预测位置转换到世界坐标系,得到车道线实际位置,将本次得到的车道线实际位置和历史时间内,车辆经过相同道路的历史车道线信息融合,得到所述车道线图。本技术仅采用单目相机与rtk-gps的组合来进行车道线图的构建,采集成本低,运行效率高,可以实现实时建图;采集精度较高,可以满足轻量自动驾驶需求;且设备部署成本低,可以高频率的进行地图的更新维护;计算量小、适用场景广泛、实用性强。

附图说明

20.此处所说明的附图用来提供对本技术的进一步理解,构成本技术的一部分,本技术的示意性实施例及其说明用于解释本技术,并不构成对本技术的不当限定。在附图中:

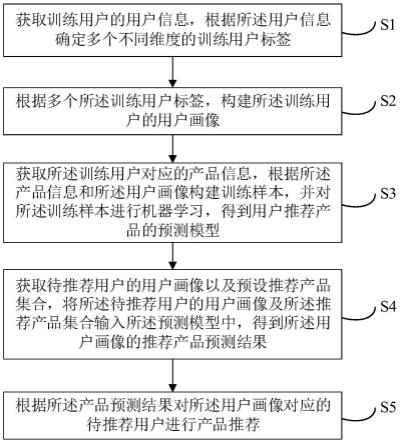

21.图1示出了根据本技术的一个实施例的车道线图的构建方法的流程示意图;

22.图2示出了根据本技术的一些实施例的mmclassification训练分类网络的结构示意图;

23.图3示出了根据本技术的一个实施例的地图构建方法的校正前端界面的示意图;

24.图4示出了根据本技术的一个实施例的位置估算图像中标注基线和交点的示意图;

25.图5示出了根据本技术的另一个实施例的车道线图的构建方法的流程示意图;

26.图6示出了根据本技术的一个实施例的车道线图的构建装置的结构示意图;

27.图7为本技术实施例中一种电子设备的结构示意图。

具体实施方式

28.为使本技术的目的、技术方案和优点更加清楚,下面将结合本技术具体实施例及相应的附图对本技术技术方案进行清楚、完整地描述。显然,所描述的实施例仅是本技术一部分实施例,而不是全部的实施例。基于本技术中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本技术保护的范围。

29.以下结合附图,详细说明本技术各实施例提供的技术方案。

30.近年来,人们对车辆辅助驾驶及无人驾驶的需求越来越大,高精地图的车道线最基本的信息,并可满足大多数自动驾驶应用场景。目前主流的高精地图构建方法是通过配备了rtk-gps、imu、相机、激光雷达、雷达、车轮里程表等地图采集车来完成的,rtk-gps进行厘米级的定位,雷达\激光雷达进行周围环境的点云扫描,然后生成高精地图。这种方法消耗大小的人力、经济和时间成本,且实时性很差。

31.对此,本技术提供了一种轻量级的实时性强的车道线图的构建方法,本技术的构思在于,仅依靠单目相机采集的道路视频数据,以及gps采集的rtk数据,并将深度学习模型引入其中,利用深度学习模型识别道路视频数据中的车道线,然后将预测出的车道线映射到世界坐标系中,得到车道线实际位置,并进一步的将,车道线实际位置与历史时间内车辆

经过该道路得到的历史结果融合,得到最终的车道线图。

32.图1示出了根据本技术的一个实施例的车道线图的构建方法的流程示意图,从图1可以看出,本技术至少包括步骤s110~步骤s140:

33.步骤s110:获取相机视频数据和rtk数据,并根据所述rtk数据对所述相机视频数据进行匹配处理,得到多帧建图图像数据;其中,所述相机视频数据为车载单目相机拍摄得到。

34.本技术提出了一种基于rtk数据(也可称为rtk-gps数据)与单目相机数据的轻量低成本自动化构建车道线地图的方法。

35.可将单目装载在目标车辆上,目标车辆在道路上行驶,即可采集到道路影像,称为相机视频数据,视频为多个连续图像组成的,每个图像称为视频的一帧。目标车辆装载有gps装置,可同时获取rtk数据。

36.获取相机视频数据和rtk数据,对这两项数据进行处理,具体的,包括但不限于:对齐所述相机视频数据与所述rtk数据的时间戳;按照时间戳以及所述rtk数据的位置信息,将所述相机视频数据中的各帧与所述rtk数据的各帧一一对应;对于一个时刻,选取所述相机数据中该时刻对应的一帧,作为建图图像数据,循环执行该步骤,得到各时刻的建图图像数据。

37.将相机视频数据分帧,以及将相机视频数据和rtk数据的时间戳对齐。如果采集设备已经完成了相机视频数据和rtk数据的时间戳的同步,则可省略时间戳的同步的步骤;否则可通过将视频数据截取成单帧图片,即分帧,然后通过程序脚本完成时间戳的近似同步。

38.rtk数据包含位置信息,将相机视频数据中的各帧与rtk数据的各帧一一对应并融合,使得相机视频数据中包含了位置信息,对于一个时刻,选取所述相机数据中该时刻对应的一帧,作为建图图像数据,选取时可以选取图片质量比较好的图像。循环执行该步骤,得到各时刻的建图图像数据。

39.处理后得到多帧建图图像数据,每一张建图图像数据融合了各个时刻的相机视频数据中对应的图像数据,以及该时刻下,rtk数据,rtk数据包含目标车辆的位置信息等。

40.步骤s120:基于深度学习模型,识别各帧建图图像数据中的车道线信息,所述车道线信息包括车道线预测位置。

41.利用训练好的深度学习模型,对每帧建图图像数据进行车道吸纳识别,通过识别可以得到图像中的车道线位置信息,在另一些实施例中,还可以得到rtk位数据、帧时间数据等等。

42.其中,深度学习模型可以为现有技术中的任以图像处理模型,尤其是专用于车道识别的网络模型,经过大量的训练之后,深度学习模型能够从建图图像数据有效的分离出车道线信息。

43.需要说明的是,经过深度学习模型得到的车道位置不是绝对的车道位置,只是在当前像素坐标系下的相对位置信息。

44.步骤s130:将所述车道线预测位置转换到世界坐标系,得到车道线实际位置。

45.然后将预测得到的车道线转化到世界坐标系中,就得到了车道线的实际位置信息,根据该实际位置信息即可建立车道线图。

46.需要说明的是,这里所说的车道线实际位置不是丝毫不差的,其值处于本领域可

接受的误差范围之内。

47.在本技术的一些实施例中,对于车道线预测位置向车道线实际位置的转换可以借助相机的内参数和外参数。其中,相机的内参数是与相机自身特性相关的参数,比如相机的焦距、像素大小等;相机的外参数是在世界坐标系中的参数,比如相机的位置、旋转方向等,有了相机的内参数和外参数可以直接采用下述式(1)将车道线预测位置转换到世界坐标系:

[0048][0049]

其中,u,v表示车道线预测位置坐标,zc表示相机景深,k表示相机内参,r,t表示相机外参,xw,yw,zw表示车道线实际位置坐标。

[0050]

在智能汽车中,通常具有相机的标定装置,对于相机的内参和外参可以通过到指定存储区域读取获得。

[0051]

通过上述变换,就可以得到车道线在世界坐标系的坐标信息。

[0052]

步骤s140:融合所述车道线实际位置和历史车道线信息,得到所述车道线图。

[0053]

最后,为了提高精度,可以将本次产生的车道线实际位置与历史车道线信息进行融合。其中历史车道线信息可以为目标车辆也可以为其他车辆经过同一道路的同一路段时产生的车道线图,融合后得到最终车道线图。

[0054]

具体的融合过程,可以包括车道线实际位置所在坐标系为基准,通过转换矩阵,将历史车道线信息转换到车道线实际位置所在坐标系中,并进行点对点融合,对融合结果进行修正等步骤。融合后得到最终车道线图。

[0055]

需要说明的是,在车辆第一次采集一段路线时,若没有历史车道线信息,可以不予融合。

[0056]

由图1所示,本技术通过利用车载单目相机实时拍摄道路视频以及gps获取的rtk数据,结合深度学习模型,识别各帧建图图像数据中的车道线信息,并将预测得到的车道线预测位置转换到世界坐标系,得到车道线实际位置,将本次得到的车道线实际位置和历史时间内,车辆经过相同道路的历史车道线信息融合,得到所述车道线图。本技术仅采用单目相机与rtk-gps的组合来进行车道线图的构建,采集成本低,运行效率高,可以实现实时建图;采集精度较高,可以满足轻量自动驾驶需求;且设备部署成本低,可以高频率的进行地图的更新维护;计算量小、适用场景广泛、实用性强。

[0057]

在本技术的一些实施例中,在上述方法中,所述基于深度学习模型,识别所述建图图像数据中的车道线信息,包括:将所述建图图像数据输入所述深度学习模型中进行识别,得到车道线信息,其中,所述深度学习模型为mmclassification训练分类网络,所述mmclassification训练分类网络包括依次连接的backbone网络和classification head网络,且所述mmclassification训练分类网络是基于tusimple数据集和culane数据集训练得到的;将识别得到的所述车道线信息中的车道线预测位置、rtk位数据、帧时间数据对应存储。

[0058]

图2示出了根据本技术的一些实施例的mmclassification训练分类网络的结构示意图,从图2可以看出,mmclassification训练分类网络200包括依次连接的backbone网络210、颈部网络220、和classification head网络230,其中backbone网络210作为深度学习模型200的输入端,classification head网络230作为mmclassification训练分类网络200的输出端,backbone网络210包括多层结构,classification head网络230也包括多层网络。

[0059]

其中,backbone网络,可以称为主干网络,用来做特征提取的网络,可以为整体深度学习模型网络的一部分,可以用于提取图片信息,生成特征图(feature map),供后面连接的网络使用。通常可以采用vggnet网络或者resnet网络,因为这些backbone特征提取能力是很强,并且可以加载已有的在大型数据集上训练好的模型参数,然后接自己的网络,进行微调(fine-tune)即可。

[0060]

颈部网络220用于相当于池化层,主要用于全局平均池化。

[0061]

classification head网络220,可以成为分类头,主要用于根据backbone网络提取的特征,确定图像的类别。

[0062]

在本技术中,采用tusimple数据集和culane数据集对mmclassification训练分类网络进行训练,得到车道线识别的深度学习模型。其中,tusimple数据集和culane数据集是公开的用于车道线识别的大小训练集。以culane数据集为例,culane是用于行车道检测学术研究的大规模具有挑战性的数据集。它由安装在六辆由北京不同驾驶员驾驶的不同车辆上的摄像机收集。收集了超过55小时的视频,并提取了133,235帧。将数据集分为88880个训练集,9675个验证集和34680个测试集。测试集分为正常和8个挑战性类别,分别对应于9个示例。对于每帧,用三次样条曲线手动注释行车道。对于车道标记被车辆遮挡或看不见的情况,仍会根据上下文注释车道。此外,算法能够区分道路上的障碍。

[0063]

训练的过程是不断迭代的过程,一个轮次的训练过程结束后,根据该轮次的训练过程得到的结果,对模型的参数进行调整,然后将更新后的模型参数用于下一轮次的训练,直到达到预设的训练要求,如预设的训练要求为迭代20000次,则当达到这个迭代次数后,整个训练过程结束,即得到用于车道线识别的深度学习模型。

[0064]

将深度学习模型对建图图像数据进行识别获得的车道线识别结果中的车道线位置,记为车道线预测位置,此外,深度学习模型还能够识别图像数据中包含的rtk位数据、帧时间数据,可以将识别得到的所述车道线信息中的车道线预测位置、rtk位数据、帧时间数据一一对应存储,这些数据可以用于车道线图的生成。

[0065]

有时候路况比较复杂,或者天气不是很好,光线较弱,车载单目相机拍摄出来的视频数据并不是每一帧都比较好,造成深度学习模型在对车道线进行识别时,可能出现部分车道线未识别出的帧甚至车道线完全未识别出的帧,在识别过程中,车道线通常由离散的点组成,在本技术中,所述建图图像数据中的车道线预测位置包含未识别点,且所述未识别点的数量小于预设阈值的图像,定义为部分未识别帧,将建图图像数据中的车道线预测位置包含未识别点,且所述未识别点的数量大于等于预设阈值的图像,定义为未识别帧。对于对于部未识别帧可以依据车道线的约束条件进行补充,而对于未识别帧则需要人工的校对。

[0066]

将深度学习模型处理建图图像数据中所有帧过程中出现的未能完全识别的车道

线的时刻(帧时间数据)都记录下来,然后利用车道线的连续性等约束条件,设计逻辑推理程序,排除部分未识别帧,对于部分未识别帧可以通过车道线的连续性等约束条件,自动补全,无需人工校对。

[0067]

对于未识别帧,在本技术的一些实施例中,可以作如下处理:根据车道线约束条件,确定出至少一帧未识别帧;接收未识别帧的车道线补全参数,确定各未识别帧的补全车道线信息;所述融合所述车道线实际位置和历史车道线信息,得到所述车道线图,包括:融合所述车道线实际位置、所述历史车道线信息和所述补全车道线信息,得到所述车道线图。

[0068]

也就是说,对于确定出的未识别帧中无法判定的点,需要进行人工标注,并再次对其推理判别,得到补全的车道结果。其中,接收未识别帧的车道线补全参数,确定各所述未识别帧的补全车道线信息,包括:通过前端界面,接收各未识别帧的车道线补全参数,并分别根据各未识别帧的建图图像数据、车道线补全参数以及时间戳,确定各所述未识别帧的补全车道线信息。

[0069]

图3示出了根据本技术的一个实施例的地图构建方法的校正前端界面的示意图,从图3可以看出,图3中的未识别帧的右下侧,由于地面的车道线已经磨损且光线不好,深度学习模型很难识别其中的车道线,对于这种无法识别的点,可以进行人工的标注,将人工标注过程中未判定的点的参数,包括但不限于时间、位置坐标等,记为未识别帧的车道线补全参数,确定各未识别帧的补全车道线。在所述融合所述车道线实际位置和历史车道线信息,得到所述车道线图的步骤中,将得到的补全车道线也融合到其中,即融合所述车道线实际位置、所述历史车道线信息和所述补全车道线信息,得到所述车道线图。

[0070]

在本技术的一些实施例中,在上述方法中,所述将所述车道线原始位置转换到世界坐标系,得到车道线实际位置,还包括:若读取不到所述车载单目相机的内参数和外参数,则从建图图像数据中选取位置估算图像,所述位置估算图像中包含至少三条车道线,且单目相机安装在车辆中心;确定所述位置估算图像中的多条基线与多条车道线的多个交点坐标,其中,所述多条基线与所述多条车道线分别垂直;根据确定的多个交点坐标以及所述位置估算图像的中心车道的指定初始宽度,确定所述位置估算图像的逆透视变换矩阵;根据所述逆透视变换矩阵,确定所述位置估算图像中各车道的宽度;将所述中心车道的第一中心与所述位置估算图像的第二中心,根据所述逆透视变换矩阵进行变换,得到所述车辆实际偏离所述第二中心的比例值;根据所述比例值、所述各车道的宽度,确定车道线实际位置。

[0071]

如果没有读取到单目相机的内参数与外参数,可以按照以下步骤处理,具体的,假设单目相机处于采集车(目标车辆)的车窗中间位置、镜头朝向为车辆行驶方向,车道宽度为指定值,如指定为3m(应急车道除外)。

[0072]

首先选取则从建图图像数据中选取位置估算图像,所述位置估算图像中包含至少三条车道线,选取至少一张车道识别情况良好的建图图像数据作为位置估算图像,其中,位置估算图像至少包含两条常规车道(3条车道线),如图4所示。在图4示出的位置估算图像中,标注出各条车道线与平行于图片底边的一组(两条)平行线(基线)的交点(图中的多个圆点),并记录其像素坐标。在本技术的一些实施例中,基线应尽量靠近位置估算图像的中心选取,因为在中心区域的图像畸变最小。

[0073]

然后确定位置估算图像的逆透视变换矩阵,按照先验条件,两条车道的宽度应该

是相同的,并且车道线平行,图像中心车道的像素宽度设置为初始车道宽度值,如3m(标准车道线的宽度为3m),根据确定的多个交点的坐标,通过逆透视变换循环计算,知道满足车道平行与等距约束,得到位置估算图像的逆透视变换矩阵。

[0074]

根据所述逆透视变换矩阵,确定所述位置估算图像中各车道的宽度,具体的,应用计算得到逆透视变换矩阵,将所有车道线投影为鸟瞰图形式,得到所有车道的宽度比例关系,参考初始车道宽度值为3m,可以按照比例关系得到其他车道的宽度。将所述指定车道的第一中心与所述位置估算图像的第二中心,根据所述逆透视变换矩阵进行变换,得到所述车辆实际偏离所述图像中心的比例值,具体的依据假设,单目相机在车辆中心安装,因此位置估算图像中的中心车道的中心与图像中心的偏差,即为车辆中心在中心车道中的偏移距离,将位置估算图像中标注的多个交点的坐标,利用逆透视变换矩阵映射,变换后的距离之差就是目标车辆实际偏离位置估算图像中心的比例值,最后,根据目标车辆实际偏离位置估算图像中心的比例值、各车道的宽度,确定车道线实际位置。

[0075]

图5示出了根据本技术的另一个实施例的车道线图的构建方法的流程示意图,从图5可以看出,本实施例包括:

[0076]

获取车载单目相机的拍摄的相机视频数据和gps采集的rtk数据,对相机视频数据进行预处理,且根据rtk数据对相机视频数据进行匹配处理,得到多帧建图图像数据。

[0077]

训练用于车道线检测的深度学习模型,利用深度学习模型对多帧建图图像数据中的车道线进行识别,得到车道线预测位置。

[0078]

判断是否能读取到相机的内参数和外参数,若能,则利用相机的内参数和外参数将车道线预测位置转化到世界坐标系,得到车道线实际位置;若否,则用计算的方法估计车道线实际位置。

[0079]

确定出部分识别帧和未识别帧,对未识别帧,通过人工校正前端界面,获取校正参数,并生成补全车道线信息;对部分识别帧,根据车道约束条件作补全处理。

[0080]

获取车辆经过相同路程时生成的历史车道线,融合车道线实际位置、历史车道线和补全车道线,得到目标车道线图。

[0081]

图6示出了根据本技术的一个实施例的车道线图的构建装置的结构示意图,从图6可以看出,所述装置600包括:

[0082]

预处理单元610,用于获取相机视频数据和rtk数据,并根据所述rtk数据对所述相机视频数据进行匹配处理,得到多帧建图图像数据;其中,所述相机视频数据为车载单目相机拍摄得到;

[0083]

识别单元620,用于基于深度学习模型,识别各帧建图图像数据中的车道线信息,所述车道线信息包括车道线预测位置;

[0084]

转换单元630,用于将所述车道线预测位置转换到世界坐标系,得到车道线实际位置;

[0085]

融合单元640,用于融合所述车道线实际位置和历史车道线信息,得到所述车道线图。

[0086]

在本技术的一些实施例中,上述装置还包括:补全单元,用于在所述将所述车道线预测位置转换到世界坐标系,得到车道线实际位置的步骤之前,确定至少一帧部分未识别帧,其中,所述部分未识别帧为所述建图图像数据中的车道线预测位置包含未识别点,且所

述未识别点的数量小于预设阈值的图像;根据车道线约束条件,对各所述部分未识别帧中的多个未识别点进行补全处理。

[0087]

在本技术的一些实施例中,在上述装置中,补全单元,还用于确定至少一帧未识别帧,其中,所述未识别帧为所述建图图像数据中的车道线预测位置包含未识别点,且所述未识别点的数量大于等于预设阈值的图像;接收所述未识别帧的车道线补全参数,确定所述未识别帧的补全车道线信息;融合单元640,用于融合所述车道线实际位置、所述历史车道线信息和所述补全车道线信息,得到所述车道线图。

[0088]

在本技术的一些实施例中,在上述装置中,预处理单元610,用于对齐所述相机视频数据与所述rtk数据的时间戳;按照时间戳以及所述rtk数据的位置信息,将所述相机视频数据中的各帧与所述rtk数据的各帧一一对应;对于一个时刻,选取所述相机数据中该时刻对应的一帧,作为该时刻的建图图像数据。

[0089]

在本技术的一些实施例中,在上述装置中,所述深度学习模型为mmclassification训练分类模型;识别单元620,用于将所述建图图像数据输入所述深度学习模型中进行识别,得到车道线信息,其中,所述mmclassification训练分类模型包括依次连接的backbone网络、颈部网络和classification head网络,且所述mmclassification训练分类模型是基于tusimple数据集和culane数据集训练得到的;将识别得到的所述车道线信息中的车道线预测位置、rtk位数据、帧时间数据对应存储。

[0090]

在本技术的一些实施例中,在上述装置中,转换单元630,用于读取所述车载单目相机的内参数和外参数;按照下式将所述车道线预测位置转换到世界坐标系,得到车道线实际位置:

[0091][0092]

其中,u,v表示车道线预测位置坐标,zc表示相机景深,k表示相机内参,r,t表示相机外参,xw,yw,zw表示车道线实际位置坐标。

[0093]

在本技术的一些实施例中,在上述装置中,转换单元630,还用于若读取不到所述车载单目相机的内参数和外参数,则从建图图像数据中选取位置估算图像,所述位置估算图像中包含至少三条车道线,且单目相机安装在车辆中心;确定所述位置估算图像中的多条基线与多条车道线的多个交点坐标,其中,所述多条基线与所述多条车道线分别垂直;根据确定的多个交点坐标以及所述位置估算图像的中心车道的指定初始宽度,确定所述位置估算图像的逆透视变换矩阵;根据所述逆透视变换矩阵,确定所述位置估算图像中各车道的宽度;将所述中心车道的第一中心与所述位置估算图像的第二中心,根据所述逆透视变换矩阵进行变换,得到所述车辆实际偏离所述第二中心的比例值;根据所述比例值、所述各车道的宽度,确定车道线实际位置。

[0094]

能够理解,上述车道线图的构建装置,能够实现前述实施例中提供的车道线图的构建方法的各个步骤,关于车道线图的构建方法的相关阐释均适用于车道线图的构建装置,此处不再赘述。

[0095]

图7是本技术的一个实施例电子设备的结构示意图。请参考图7,在硬件层面,该电子设备包括处理器,可选地还包括内部总线、网络接口、存储器。其中,存储器可能包含内存,例如高速随机存取存储器(random-access memory,ram),也可能还包括非易失性存储器(non-volatile memory),例如至少1个磁盘存储器等。当然,该电子设备还可能包括其他业务所需要的硬件。

[0096]

处理器、网络接口和存储器可以通过内部总线相互连接,该内部总线可以是isa(industry standard architecture,工业标准体系结构)总线、pci(peripheral component interconnect,外设部件互连标准)总线或eisa(extended industry standard architecture,扩展工业标准结构)总线等。所述总线可以分为地址总线、数据总线、控制总线等。为便于表示,图7中仅用一个双向箭头表示,但并不表示仅有一根总线或一种类型的总线。

[0097]

存储器,用于存放程序。具体地,程序可以包括程序代码,所述程序代码包括计算机操作指令。存储器可以包括内存和非易失性存储器,并向处理器提供指令和数据。

[0098]

处理器从非易失性存储器中读取对应的计算机程序到内存中然后运行,在逻辑层面上形成车道线图的构建装置。处理器,执行存储器所存放的程序,并具体用于执行以下操作:

[0099]

获取原始数据,其中,所述原始数据包括高分影像和dem数据;

[0100]

将所述原始数据转化为图结构数据,其中,所述图结构数据包括图节点矩阵和连接矩阵;

[0101]

构建并初始化图神经网络模型;

[0102]

将所述图结构数据输入至所述图神经网络模型中进行训练,得到滑坡体识别模型。

[0103]

上述如本技术图6所示实施例揭示的车道线图的构建装置执行的方法可以应用于处理器中,或者由处理器实现。处理器可能是一种集成电路芯片,具有信号的处理能力。在实现过程中,上述方法的各步骤可以通过处理器中的硬件的集成逻辑电路或者软件形式的指令完成。上述的处理器可以是通用处理器,包括中央处理器(central processing unit,cpu)、网络处理器(network processor,np)等;还可以是数字信号处理器(digital signal processor,dsp)、专用集成电路(application specific integrated circuit,asic)、现场可编程门阵列(field-programmable gate array,fpga)或者其他可编程逻辑器件、分立门或者晶体管逻辑器件、分立硬件组件。可以实现或者执行本技术实施例中的公开的各方法、步骤及逻辑框图。通用处理器可以是微处理器或者该处理器也可以是任何常规的处理器等。结合本技术实施例所公开的方法的步骤可以直接体现为硬件译码处理器执行完成,或者用译码处理器中的硬件及软件模块组合执行完成。软件模块可以位于随机存储器,闪存、只读存储器,可编程只读存储器或者电可擦写可编程存储器、寄存器等本领域成熟的存储介质中。该存储介质位于存储器,处理器读取存储器中的信息,结合其硬件完成上述方法的步骤。

[0104]

该电子设备还可执行图6中车道线图的构建装置执行的方法,并实现车道线图的构建装置在图6所示实施例的功能,本技术实施例在此不再赘述。

[0105]

本技术实施例还提出了一种计算机可读存储介质,该计算机可读存储介质存储一

个或多个程序,该一个或多个程序包括指令,该指令当被包括多个应用程序的电子设备执行时,能够使该电子设备执行图6所示实施例中车道线图的构建装置执行的方法,并具体用于执行:

[0106]

获取原始数据,其中,所述原始数据包括高分影像和dem数据;

[0107]

将所述原始数据转化为图结构数据,其中,所述图结构数据包括图节点矩阵和连接矩阵;

[0108]

构建并初始化图神经网络模型;

[0109]

将所述图结构数据输入至所述图神经网络模型中进行训练,得到滑坡体识别模型。

[0110]

本领域内的技术人员应明白,本技术的实施例可提供为方法、系统、或计算机程序产品。因此,本技术可采用完全硬件实施例、完全软件实施例、或结合软件和硬件方面的实施例的形式。而且,本技术可采用在一个或多个其中包含有计算机可用程序代码的计算机可用存储介质(包括但不限于磁盘存储器、cd-rom、光学存储器等)上实施的计算机程序产品的形式。

[0111]

本技术是参照根据本技术实施例的方法、设备(系统)、和计算机程序产品的流程图和/或方框图来描述的。应理解可由计算机程序指令实现流程图和/或方框图中的每一流程和/或方框、以及流程图和/或方框图中的流程和/或方框的结合。可提供这些计算机程序指令到通用计算机、专用计算机、嵌入式处理机或其他可编程数据处理设备的处理器以产生一个机器,使得通过计算机或其他可编程数据处理设备的处理器执行的指令产生用于实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能的装置。

[0112]

这些计算机程序指令也可存储在能引导计算机或其他可编程数据处理设备以特定方式工作的计算机可读存储器中,使得存储在该计算机可读存储器中的指令产生包括指令装置的制造品,该指令装置实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能。

[0113]

这些计算机程序指令也可装载到计算机或其他可编程数据处理设备上,使得在计算机或其他可编程设备上执行一系列操作步骤以产生计算机实现的处理,从而在计算机或其他可编程设备上执行的指令提供用于实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能的步骤。

[0114]

在一个典型的配置中,计算设备包括一个或多个处理器(cpu)、输入/输出接口、网络接口和内存。

[0115]

内存可能包括计算机可读介质中的非永久性存储器,随机存取存储器(ram)和/或非易失性内存等形式,如只读存储器(rom)或闪存(flash ram)。内存是计算机可读介质的示例。

[0116]

计算机可读介质包括永久性和非永久性、可移动和非可移动媒体可以由任何方法或技术来实现信息存储。信息可以是计算机可读指令、数据结构、程序的模块或其他数据。计算机的存储介质的例子包括,但不限于相变内存(pram)、静态随机存取存储器(sram)、动态随机存取存储器(dram)、其他类型的随机存取存储器(ram)、只读存储器(rom)、电可擦除可编程只读存储器(eeprom)、快闪记忆体或其他内存技术、只读光盘只读存储器(cd-rom)、数字多功能光盘(dvd)或其他光学存储、磁盒式磁带,磁带磁磁盘存储或其他磁性存储设备

或任何其他非传输介质,可用于存储可以被计算设备访问的信息。按照本文中的界定,计算机可读介质不包括暂存电脑可读媒体(transitory media),如调制的数据信号和载波。

[0117]

还需要说明的是,术语“包括”、“包含”或者其任何其他变体意在涵盖非排他性的包含,从而使得包括一系列要素的过程、方法、商品或者设备不仅包括那些要素,而且还包括没有明确列出的其他要素,或者是还包括为这种过程、方法、商品或者设备所固有的要素。在没有更多限制的情况下,由语句“包括一个

……”

限定的要素,并不排除在包括所述要素的过程、方法、商品或者设备中还存在另外的相同要素。

[0118]

本领域技术人员应明白,本技术的实施例可提供为方法、系统或计算机程序产品。因此,本技术可采用完全硬件实施例、完全软件实施例或结合软件和硬件方面的实施例的形式。而且,本技术可采用在一个或多个其中包含有计算机可用程序代码的计算机可用存储介质(包括但不限于磁盘存储器、cd-rom、光学存储器等)上实施的计算机程序产品的形式。

[0119]

以上所述仅为本技术的实施例而已,并不用于限制本技术。对于本领域技术人员来说,本技术可以有各种更改和变化。凡在本技术的精神和原理之内所作的任何修改、等同替换、改进等,均应包含在本技术的权利要求范围之内。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。