一种实时高保真语音驱动数字人系统

- 国知局

- 2024-06-21 11:38:33

本发明涉及语音驱动数字人,尤其涉及一种实时高保真语音驱动数字人系统。

背景技术:

1、语音驱动数字人是一个重要而具有挑战性的问题,它有多种应用,如数字人、虚拟化身、电影制作和视频会议等。语音驱动数字人的目标是通过输入任意语音音频和指定头部姿态、表情等来生成高质量的指定人物形象的说话视频。传统语音驱动数字人的方法制作流程复杂,生成效果较差,制作出高质量的数字人需要耗费大量时间和金钱,因此严重阻碍了语音驱动数字人生成的实际场景应用,目前相关技术存在的主要问题有:

2、1)当前相关技术需要数十小时的训练资料,但是单人的高清长时间视频难以收集,因此难以生成多样的人物形象。

3、2)大多数技术需要在高性能gpu上进行数十小时的训练,训练代价昂贵。

4、3)数字人视频生成往往需要数十秒才能生成一帧图像,无法做到实时的驱动效果,影响了数字人的应用场景。

5、4)数字人生成的质量不够清晰,人物不够逼真,同时容易出现音视频不同步的现象,严重影响使用者的体验。

6、因此,本领域的技术人员致力于开发一种实时高保真语音驱动数字人系统。解决以上问题,一个训练代价小,生成实时性高,画面质量好的语音驱动数字人训练,生成方案是必要的。

技术实现思路

1、有鉴于现有技术的上述缺陷,本发明所要解决的技术问题是减少语音驱动数字人训练代价,生成实时性高,画面质量好。

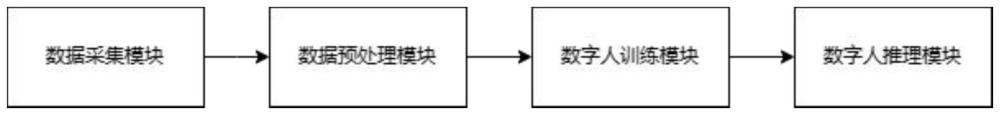

2、为实现上述目的,本发明提供了一种实时高保真语音驱动数字人系统,包括数据采集模块、数据预处理模块、数字人训练模块、数字人推理模块;

3、所述数据采集模块,收集数字人模型训练所需要的训练资料;

4、所述数据预处理模块,将收集到的视频音频转换成数字人训练所需的格式;

5、所述数字人训练模块,训练数字人模型,数字人模型基于3d gaussiansplatting;

6、所述数字人推理模块,给定任意语音音频和相机参数,渲染合成指定人物形象的说话视频。

7、进一步地,所述数字人训练模块设计以语音为驱动条件的变形场,通过变形场模拟3d gaussian点的运动和变形,实现数字人的运动。

8、进一步地,所述数字人模型基于三维场景重建。

9、进一步地,所述数据预处理模块获得语音的deepspeech特征,视频的每一帧图片,只包含每一帧头部部分的图片,只包含每一帧上半身部分的图片,人各个部分的mask,人脸关键点数据,相机的内外参数。

10、进一步地,所述数字人训练模块以语音为条件的变形场来预测3d gaussian的坐标和形变。

11、进一步地,所述数字人训练模块训练过程分为两个阶段,第一个阶段用于静态3dgaussian点初始化,第二阶段联合优化语音驱动变形场和3d gaussian点。

12、进一步地,所述第一阶段将随机初始化的3d gaussian点在无语音条件下初步优化得到数字人形象的初步静态场景表达。

13、进一步地,所述第二阶段优化以语音为驱动的变形场,预测每个3d gaussian点在不同语音条件下产生的位置和形状的改变,实现随语音变化的动态效果。

14、进一步地,所述数字人训练模块引入landmark特征来作为眨眼动作的监督。

15、进一步地,所述数字人训练模块融合了两类损失作为最终损失函数,第一个损失用于直接比较合成图片和真实图片每一个像素值的绝对值之差,第二个损失用于比较合成图片和真实图片分别送入预训练的深度神经网络后在不同层次下的特征之间的差值。

16、在本发明的较佳实施方式中,考虑到现有技术训练一个数字人模型需要非常昂贵的训练代价,同时生成视频效率低,缺乏实时性。本发明基于目前高效的3d gaussiansplatting的场景重建方法取代了传统的低效场景表征。3d gaussian splatting是目前最高效的三维重建的方法之一,它能极大减小计算消耗。

17、现有技术难以生成高质量的视频画面,同时音视频不同步明显。本发明设计了以语音为驱动条件的变形场,通过变形场预测3d gaussian点的运动和变形,从而实现数字人的运动。以语音为驱动条件的变形场能很好的估计3d gaussian的位置和属性变化,高质量生成视频的同时还能准确模拟嘴型和音频的同步。

18、现有技术需要长时间的个人高清视频作为训练资料,训练资料难以收集。本发明基于三维场景重建的数字人模型而不是用二维图像翻译的方法,需要训练资料少。三维重建只需要数分钟的视频作为训练资料,利用3d gaussian存储场的信息,结合图形学的渲染方法,能高效表征场景的同时实现照片级的渲染。

19、本发明与现有技术相比较,具有如下显而易见的实质性特点和显著优点:

20、1.本发明将一个数字人的训练时间由数十小时减少到一小时内,同时数字人视频生成达到每秒80帧以上的实时性能,极大的减小了数字人的训练代价,极大丰富了数字人的应用场景。

21、2.本发明生成照片级别真实的数字人说话视频,实现更好的语音嘴型的同步。

22、3.本发明使用者只需要数分钟的视频资料即可进行训练,极大丰富了数字人的适用范围。

23、以下将结合附图对本发明的构思、具体结构及产生的技术效果作进一步说明,以充分地了解本发明的目的、特征和效果。

技术特征:1.一种实时高保真语音驱动数字人系统,其特征在于,包括数据采集模块、数据预处理模块、数字人训练模块、数字人推理模块;

2.如权利要求1所述的实时高保真语音驱动数字人系统,其特征在于,所述数字人训练模块设计以语音为驱动条件的变形场,通过变形场模拟3d gaussian点的运动和变形,实现数字人的运动。

3.如权利要求1所述的实时高保真语音驱动数字人系统,其特征在于,所述数字人模型基于三维场景重建。

4.如权利要求1所述的实时高保真语音驱动数字人系统,其特征在于,所述数据预处理模块获得语音的deepspeech特征,视频的每一帧图片,只包含每一帧头部部分的图片,只包含每一帧上半身部分的图片,人各个部分的mask,人脸关键点数据,相机的内外参数。

5.如权利要求1所述的实时高保真语音驱动数字人系统,其特征在于,所述数字人训练模块以语音为条件的变形场来预测3d gaussian的坐标和形变。

6.如权利要求1所述的实时高保真语音驱动数字人系统,其特征在于,所述数字人训练模块训练过程分为两个阶段,第一个阶段用于静态3d gaussian点初始化,第二阶段联合优化语音驱动变形场和3d gaussian点。

7.如权利要求6所述的实时高保真语音驱动数字人系统,其特征在于,所述第一阶段将随机初始化的3d gaussian点在无语音条件下初步优化得到数字人形象的初步静态场景表达。

8.如权利要求6所述的实时高保真语音驱动数字人系统,其特征在于,所述第二阶段优化以语音为驱动的变形场,预测每个3d gaussian点在不同语音条件下产生的位置和形状的改变,实现随语音变化的动态效果。

9.如权利要求1所述的实时高保真语音驱动数字人系统,其特征在于,所述数字人训练模块引入landmark特征来作为眨眼动作的监督。

10.如权利要求1所述的实时高保真语音驱动数字人系统,其特征在于,所述数字人训练模块融合了两类损失作为最终损失函数,第一个损失用于直接比较合成图片和真实图片每一个像素值的绝对值之差,第二个损失用于比较合成图片和真实图片分别送入预训练的深度神经网络后在不同层次下的特征之间的差值。

技术总结本发明公开了一种实时高保真语音驱动数字人系统,涉及语音驱动数字人技术领域。包括数据采集模块、数据预处理模块、数字人训练模块、数字人推理模块;数据采集模块收集数字人模型训练所需要的训练资料;数据预处理模块将收集到的视频音频转换成数字人训练所需的格式;数字人训练模块训练数字人模型,数字人模型基于3D Gaussian Splatting;数字人推理模块给定任意语音音频和相机参数,渲染合成指定人物形象的说话视频。本发明语音驱动数字人,生成实时性高,画面质量好,极大的减小了数字人的训练代价,丰富了数字人的应用场景。技术研发人员:陈博,陈谐,钱彦旻受保护的技术使用者:上海交通大学技术研发日:技术公布日:2024/3/24本文地址:https://www.jishuxx.com/zhuanli/20240618/22620.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。