一种服务器、终端及语音识别方法与流程

- 国知局

- 2024-06-21 11:41:19

本申请涉及显示设备,尤其涉及一种服务器、终端及语音识别方法。

背景技术:

1、语音识别技术,也被称作自动语音识别(automatic speech recognition,asr)。它的目标是将包含在语音信号中的内容转换为计算机可读的输入,例如文本序列等。业界主流的语音识别的方法包括基于混合模型(hybird)的方法以及基于端到端模型(end-to-end)的方法。基于混合模型的方法是将声学模型和语言模型作为两个单独的模块来实现。声学模型主要负责将语音信号转换为文本,而语言模型负责对生成的文本进行修正和完善。基于端到端模型的方法是从语音信号的输入到文本的输出由一个神经网络完成。

2、混合模型的语音识别系统通常由声学模型和语言模型共同构成。智能电视场景使用的语言模型通常是由各种电视相关指令,比如“换一个频道”,“播放西游记”等用户对着电视发出的指令文本训练得到。针对不同的电视用户来说,这个语言模型都是一样的。如果用户的输入的语音指令跟一个更常见的语音指令冲突(发音相同或者接近),用户输入的语音指令将被更常见的语音指令所代替,无法正确识别出用户的意图。例如用户说“我要看嘻游记”会与“我要看西游记”冲突,“我要看嘻游记”很难被正确识别,导致语音识别的准确率有所降低。

技术实现思路

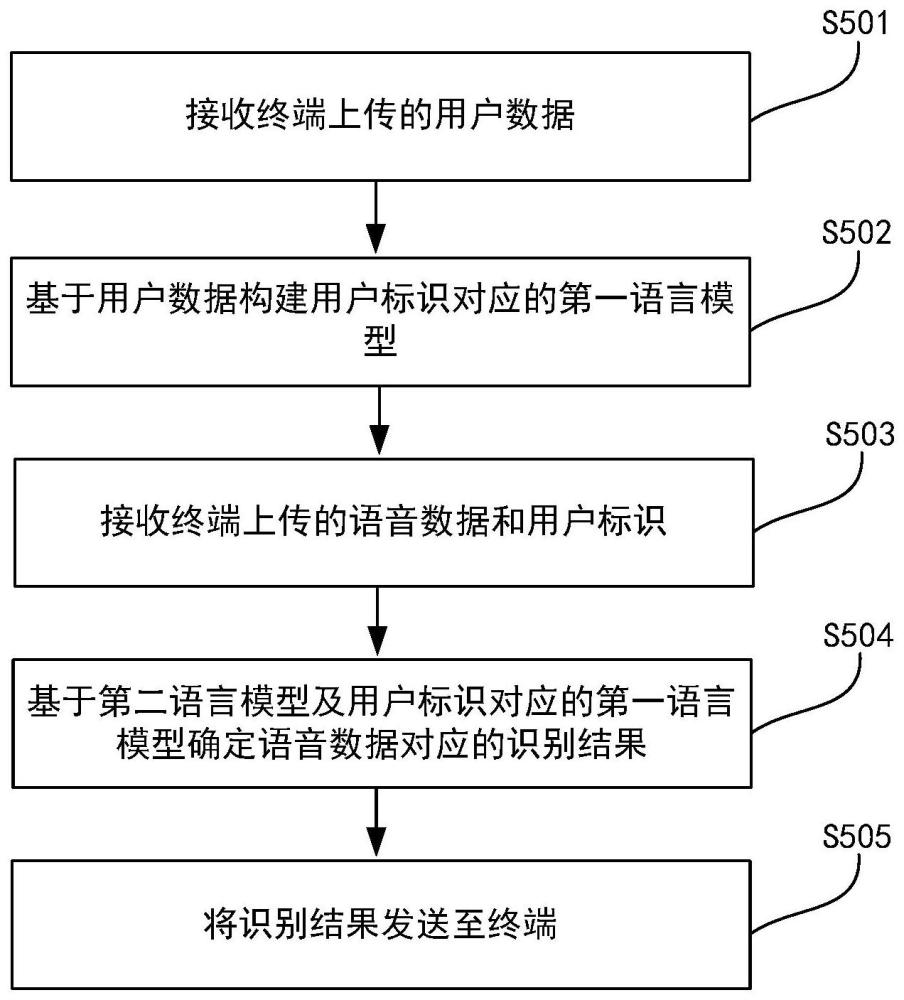

1、本申请一些实施例提供了一种服务器、终端及语音识别方法,通过接收终端上传的用户历史数据构建针对用户的个性化语言模型,在接收到用户输入的语音数据后,基于个性化语言模型和通用语言模型共同确定语音数据对应的识别结果,从而提高语音识别的准确率。

2、第一方面,本申请一些实施例中提供一种服务器,被配置为:

3、在接收到终端上传的用户数据后,基于所述用户数据构建用户标识对应的第一语言模型,所述用户数据包括用户标识及用户历史数据;

4、在接收到终端上传的语音数据和用户标识后,基于第二语言模型及所述用户标识对应的第一语言模型确定所述语音数据对应的识别结果,所述第二语言模型为通用语言模型;

5、将所述识别结果发送至所述终端。

6、在一些实施例中,所述服务器,被配置为:

7、在接收到终端上传的用户界面数据后,基于所述用户界面数据构建第三语言模型。

8、在一些实施例中,所述服务器执行基于第二语言模型及所述用户标识对应的第一语言模型确定所述语音数据对应的识别结果,被进一步配置为:

9、基于第二语言模型、所述第三语言模型以及所述用户标识对应的第一语言模型,确定所述语音数据对应的识别结果。

10、在一些实施例中,所述服务器,被配置为:

11、在检测到实体数据库存在更新数据后,基于所述更新数据更新所述第二语言模型。

12、在一些实施例中,所述更新数据包括实体数据及所述实体数据对应的数据类型标识,所述服务器执行基于所述更新数据更新所述第二语言模型,被进一步配置为:

13、将所述实体数据传入所述数据类型标识对应的实体列表,以更新所述第二语言模型,所述实体列表中的实体数据用于填充所述数据类型标识对应的槽位。

14、在一些实施例中,所述服务器,被配置为:

15、在接收到终端上传的场景标识后,基于场景标识对应的数据创建所述场景标识对应的第四语言模型;

16、基于第二语言模型及所述场景标识对应的第四语言模型确定所述语音数据对应的识别结果。

17、在一些实施例中,所述服务器执行基于第二语言模型及所述用户标识对应的第一语言模型确定所述语音数据对应的识别结果,被进一步配置为:

18、基于第一语言模型和声学模型确定至少一个第一候选文本的综合分,所述第一候选文本的综合分为第一候选文本的语言分与声学分之和;

19、基于第二语言模型和声学模型确定至少一个第二候选文本的综合分,所述第二候选文本的综合分为第二候选文本的语言分与声学分之和;

20、确定所述第二候选文本和所述第一候选文本中综合分最高的候选文本为识别结果。

21、第二方面,本申请一些实施例中提供一种终端,包括:

22、控制器,被配置为:

23、接收用户输入的语音数据;

24、将所述语音数据及用户标识发送至服务器,以使所述服务器基于第二语言模型和所述用户标识对应的第一语言模型确定所述语音数据对应的识别结果,所述第一语言模型是基于终端上传的用户数据创建的,所述用户数据包括用户标识及用户历史数据,所述第二语言模型为通用语言模型;

25、接收所述服务器下发的识别结果。

26、第三方面,本申请一些实施例中提供一种语音识别方法,应用于服务器,包括:

27、在接收到终端上传的用户数据后,基于所述用户数据构建用户标识对应的第一语言模型,所述用户数据包括用户标识及用户历史数据;

28、在接收到终端上传的语音数据和用户标识后,基于第二语言模型及所述用户标识对应的第一语言模型确定所述语音数据对应的识别结果,所述第二语言模型为通用语言模型;

29、将所述识别结果发送至所述终端。

30、第四方面,本申请一些实施例中提供一种语音识别方法,应用于终端,包括:

31、接收用户输入的语音数据;

32、将所述语音数据及用户标识发送至服务器,以使所述服务器基于第二语言模型和所述用户标识对应的第一语言模型确定所述语音数据对应的识别结果,所述第一语言模型是基于终端上传的用户数据创建的,所述用户数据包括用户标识及用户历史数据,所述第二语言模型为通用语言模型;

33、接收所述服务器下发的识别结果。

34、本申请的一些实施例提供一种服务器、终端及语音识别方法。服务器在接收到终端上传的用户数据后,基于所述用户数据构建用户标识对应的第一语言模型。其中,用户数据包括用户标识及用户历史数据。在接收到终端上传的语音数据和用户标识后,基于第二语言模型及用户标识对应的第一语言模型确定语音数据对应的识别结果。其中,第二语言模型为通用语言模型。将识别结果发送至终端。本申请实施例通过接收终端上传的用户历史数据构建针对用户的个性化语言模型,在接收到用户输入的语音数据后,基于个性化语言模型和通用语言模型共同确定语音数据对应的识别结果,从而提高语音识别的准确率。

技术特征:1.一种服务器,其特征在于,被配置为:

2.根据权利要求1所述的服务器,其特征在于,所述服务器,被配置为:

3.根据权利要求2所述的服务器,其特征在于,所述服务器执行基于第二语言模型及所述用户标识对应的第一语言模型确定所述语音数据对应的识别结果,被进一步配置为:

4.根据权利要求1所述的服务器,其特征在于,所述服务器,被配置为:

5.根据权利要求4所述的服务器,其特征在于,所述更新数据包括实体数据及所述实体数据对应的数据类型标识,所述服务器执行基于所述更新数据更新所述第二语言模型,被进一步配置为:

6.根据权利要求1所述的服务器,其特征在于,所述服务器,被配置为:

7.根据权利要求1所述的服务器,其特征在于,所述服务器执行基于第二语言模型及所述用户标识对应的第一语言模型确定所述语音数据对应的识别结果,被进一步配置为:

8.一种终端,其特征在于,包括:

9.一种语音识别方法,应用于服务器,其特征在于,包括:

10.一种语音识别方法,应用于终端,其特征在于,包括:

技术总结本申请一些实施例示出一种服务器、终端及语音识别方法,所述方法包括:在接收到终端上传的用户数据后,基于所述用户数据构建用户标识对应的第一语言模型,所述用户数据包括用户标识及用户历史数据;在接收到终端上传的语音数据和用户标识后,基于第二语言模型及所述用户标识对应的第一语言模型确定所述语音数据对应的识别结果,所述第二语言模型为通用语言模型;将所述识别结果发送至所述终端。本申请实施例通过接收终端上传的用户历史数据构建针对用户的个性化语言模型,在接收到用户输入的语音数据后,基于个性化语言模型和通用语言模型共同确定语音数据对应的识别结果,从而提高语音识别的准确率。技术研发人员:张晓明,张宝军受保护的技术使用者:海信电子科技(武汉)有限公司技术研发日:技术公布日:2024/4/7本文地址:https://www.jishuxx.com/zhuanli/20240618/22930.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表