一种盾构隧道衬砌渗漏水智能检测方法

- 国知局

- 2024-07-30 10:54:16

本发明涉及城市地下轨道交通隧道运维领域,尤其涉及一种盾构隧道衬砌渗漏水智能检测装置及检测方法。

背景技术:

1、随着科学计算设备算力的增加以及体积的小型化,基于隧道衬砌的图像信息对渗漏水进行实时识别是一种取代人工检测的可行方法。基于像素值的传统图像处理算法以及基于深度神经网络的目标检测方法被尝试应用于隧道渗漏水目标检测中。传统图像处理算法通过人工设置滤波器、像素阈值及像素分组值等对衬砌图像像素进行分类,并挑选出可能为渗漏水区域的像素。深度神经网络方法基于现有的图像大数据,学习其中渗漏水目标的特征,并在处理新图像时,根据先验知识判断图像中渗漏水的位置。然而,隧道中光照条件复杂,不同图像的拍摄参数相差较大,增加了传统算法中人工设置参数的难度。深度神经网络能够自动学习不同参数下渗漏水目标的特征,相比于传统方法具有更好的泛化性能,更适合于在隧道环境中进行目标检测任务。然而,深度神经网络仅能实现像素层面的目标识别,不能将像素尺寸与实际空间尺寸进行对应,并计算量化指标。

2、因此提供一种盾构隧道衬砌渗漏水智能检测装置及检测方法,来解决上述问题。

技术实现思路

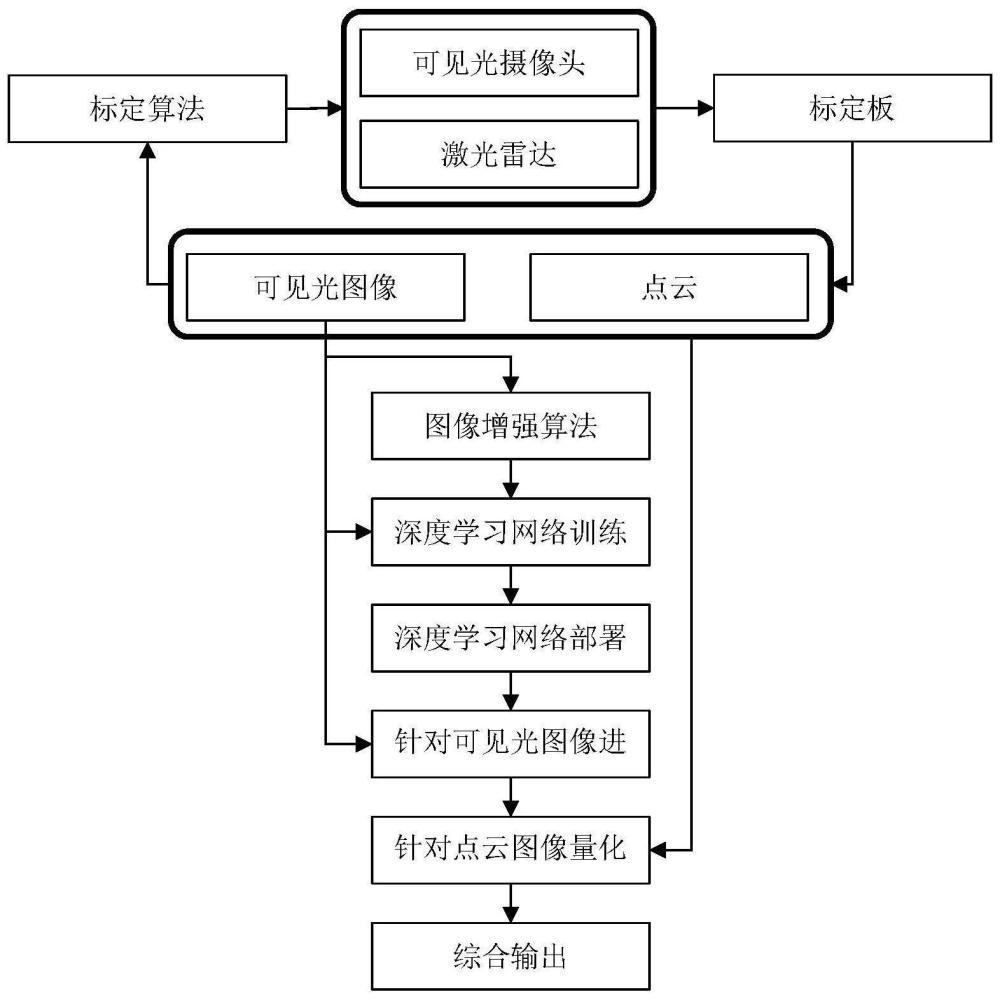

1、本发明提供一种盾构隧道衬砌渗漏水智能装置及检测方法,设计了针对隧道使用场景的联合标定方案,基于高精度标定板,输出精确的相机内外参矩阵。

2、为实现上述目的,本发明提供了一种盾构隧道衬砌渗漏水智能检测装置,包括衬砌渗漏水多模态信息采集设备,衬砌渗漏水多模态信息采集设备包括激光雷达、可见光摄像头和手持底座,激光雷达和可见光摄像头通过云台、转接板和螺栓同轴固定在手持底座上;

3、手持底座上还设置有电源、边缘计算设备和显示设备。

4、一种盾构隧道衬砌渗漏水智能检测装置的检测方法,具体包括以下步骤:

5、s1:建立一种点云-可见光图像联合标定方法,激光雷达和可见光摄像头通过联合标定方法进行外参标定,使激光雷达拍摄的点云数据和可见光摄像头拍摄的可见光图像之间的数据具有空间对应关系;

6、s2:标定完成后,获得激光雷达和相机的外参标定矩阵;

7、s3:通过标定矩阵和插值方法,基于点云的空间三维坐标,对应计算可见光图像中每一个像素的空间位置;

8、s4:采用基于yolov8的图像语义分割方法,对可见光图像进行语义分割并输出渗漏水目标掩膜;

9、s5:基于渗漏水目标掩膜,提取渗漏水目标对应的点云数据量化信息;

10、s6:采用二维曲面拟合方法,基于提取的渗漏水目标对应的点云图像量化信息,拟合得到渗漏水目标的空间形状,对应计算量化参数,并输出。

11、优选的,在步骤s1中,激光雷达采用雷达坐标系,坐标轴通过(xl,yl,zl)表示,坐标原点为激光雷达的物理成像中心;

12、可见光相机采用相机坐标系,其坐标轴通过(xc,yc,zc)表示,坐标原点为可见光相机的物理成像中心;

13、可见光图像采用图像坐标系,坐标轴通过(x,y)表示,坐标原点为光轴与图像相交的点;

14、可见光图像中的像素采用像素坐标,其坐标表示为(u,v),坐标原点为可见光图像的左上角;

15、采用棋盘格标定板对激光雷达和摄像头进行联合标定,棋盘格标定板中标定板的材质设置为航空铝,尺寸设置为:1米×1米,平整度为±0.03毫米;棋盘格标定板中棋盘格的尺寸设置为10厘米×10厘米,棋盘格精度为±0.001毫米。

16、优选的,对雷达坐标系和相机坐标系进行线性变换或旋转标定矩阵加平移标定矩阵实现标定;

17、对于坐标系旋转,原坐标轴(x,y,z)分别旋转(j,a,q)得到旋转后的坐标轴(x’,y’,z’),旋转后的坐标与原坐标的关系表示为:

18、

19、

20、

21、三个坐标轴的旋转矩阵分别表示为rx,ry和rz,坐标轴的整体旋转矩阵r表示为:r=rx ry rz;

22、雷达坐标系转换到相机坐标系的过程表示为如下:

23、

24、形式变换后,得到:

25、

26、其中,r表示尺寸为(3×3)的旋转标定矩阵,t表示尺寸为(3×1)的平移标定矩阵。

27、优选的,可见光相机拍摄过程中,三维的空间坐标被投影到二维的平面坐标中;相机坐标系的原点为oc,坐标轴xc,yc与图像坐标系的坐标轴x,y分别平行,相机坐标系的坐标轴zc垂直于xy平面,并指向xy平面外;图像坐标系的原点o落在相机坐标系的坐标轴zc上,且在相机坐标系中对应的坐标为(0,0,f),其中f为相机焦距;

28、在相机坐标系中点pc(xc,yc,zc)投影至图像坐标系中,投影点为p(x,y),根据透视关系得到如下等式:

29、

30、根据上述坐标关系得到对应坐标轴关系为:

31、

32、转换成矩阵形式:

33、

34、经过上述转换将将空间坐标转换为图像坐标系平面坐标,将转换之后的图像坐标系与像素坐标系进行转换,得到像素点位置与空间实际长度之间的关系;

35、实际成像时,像素坐标轴uv呈夹角η,非相互垂直,进行图像坐标系与像素坐标系之间的转换时,转换矩阵基于平面平移以及角度变换,具体如下:

36、

37、

38、其中,u和v为转换后的像素坐标,dx和dy分别为每一像素代表的图像坐标系长度,u0和v0为图像坐标系原点o投影至像素坐标系后的坐标;

39、转换成矩阵形式:

40、

41、将激光雷达的雷达坐标系转换为图像的像素坐标系,整体转换关系表达为:

42、

43、其中,在雷达坐标系坐标前面的两个矩阵分别称为相机的内参矩阵与相机的外参矩阵。

44、优选的,步骤s2的在标定场景中,设置标定距离为4米、7米或10米;

45、在标定距离上,调整标定板在摄像头视野中的位置和角度,分别将标定板置于可见光摄像头的左上、上、右上、左中、中、右中、左下、下以及右下位置处,拍摄多组可见光图像或点云数据对,并通过标定算法对可见光图像和点云数据对进行标定,输出标定后的外参矩阵;

46、外参矩阵进行标定前,通过如下畸变校正公式对镜头畸变进行校正:

47、径向畸变:

48、式中,(x,y)是原始像素坐标;(xrev,yrev)是图像畸变恢复后像素坐标;r是像素坐标与图像几何中心的距离;k1、k2和k3是径向畸变系数,在相机校准过程中获取;

49、切向畸变:

50、式中,p1和p2是切向畸变系数;通过求解得到,r2=x2+y2;

51、标定外参矩阵为:

52、

53、其中,zc为相机坐标系z轴;(u,v)为图像中像素位置;u0和v0为图像坐标系原点o投影至像素坐标系后的坐标;fx和fy为使用像素来描述x、y轴方向焦距的长度;γ为坐标轴倾斜参数;r表示尺寸为(3×3)的旋转矩阵,t表示尺寸为(3×1)的平移矩阵;xl,yl,zl表示激光雷达坐标系中的坐标轴。

54、优选的,在步骤s4中,具体包括以下步骤:

55、s41:针对多个盾构隧道工程采集渗漏水可见光图像,构建图像数据集;

56、s42:采用数据增强算法对图像数据集中的训练图像进行增强,增强方法包括添加噪声、明暗变换、随机缩放及旋转;

57、s43:增强后的渗漏水图像数据集,训练yolov8网络,并输出训练完成后的网络参数文件;

58、s44:基于网络参数文件,在边缘计算设备上的c++环境中进行部署;

59、s45:边缘计算设备上运行语义分割方法,语义分割方法包含前处理模块、预测网络模块和后处理模块。

60、优选的,在步骤s43中,采用python语言编写yolo v8语义分割神经网络训练程序,训练程序包括:数据加载模块、模型训练模块和模型后处理模块;

61、数据加载模块随机选取数据集中的图像,以letterbox方式进行缩放,具体为:将原图像长边缩放至目标尺寸,将原图像短边不足目标尺寸的部分填充为灰色;

62、模型训练模块在数据集图像输入至网络后,计算预测结果与真实值的损失函数值,通过误差反向传播的方式更新网络的神经元连接权重,直至网络在训练数据集上的预测误差小于规定阈值;

63、模型训练模块中,模型输出结果为预测类别和预测边界框坐标,预测类别的误差通过bce损失进行计算,bce损失值计算公式如下:

64、lbce=wn[yn·logxn+(1-yn)·log(1-xn)]

65、其中,w为权重值,y为某类目标的真实类别,x为某类目标的预测概率值;bce损失值为训练数据集中多张图像经过网络预测后的平均值;

66、预测目标边界框的误差通过dfl损失和ciou损失进行计算,dfl损失的计算公式如下:

67、dfl=-(yi+1-y)log(si)+(y-yilog)log(si+1)

68、其中,y为所需计算的边界框角点坐标,yi+1和yi为固定参考值;

69、ciou损失的计算公式如下:

70、

71、

72、

73、

74、其中,b和bgt分别为预测框和真实框的中心点坐标,c为预测框和真实框最小外界矩形框的对角线距离,w、h、wgt、hgt分别为预测框和真实框的长度、宽度值;

75、编写的yolo v8程序采用的损失函数为上述两种损失函数之和,表达式为:

76、

77、模型处理后模块将模型训练过程中的参数进行量化并以数据图形式输出,模块输出的参数有:lall以及miou;其中,miou表示了模型在整个训练图像数据集上的综合性能,计算公式为:

78、

79、其中,ioun代表了数据集中每张图像中,预测目标与真实目标的iou值。

80、优选的,在步骤s44中,模型训练完成后,通过python的pytorch库将python格式转换为.onnx模式,包括以下步骤:

81、s441:将训练过程中综合性能最好,具有最小的lall以及最大的miou的一组模型参数值进行导出,并存储为基于pytorch的.pt格式文件;

82、s442:采用pytorch库的torch.onnx.export函数,将.pt文件保存为.onnx格式文件;

83、s443:将.onnx格式文件转换为engine,并部署到边缘计算设备中;

84、s444:在边缘计算设备中,基于c++环境对转换得到的模型进行推理,具体包括以下步骤:

85、s4441:边缘计算设备读取可见光摄像头拍摄的视频流,并划分为图像帧;

86、s4442:划分完成的图像帧输入至c++环境中的推理模型中,由推理模型输出对图像帧的预测结果,预测结果包括图像帧中的渗漏水目标轮廓及类型;

87、s4443:边缘计算设备同步读取激光雷达扫描得到的点云数据,并基于联合标定矩阵,按照可见光摄像头的光轴方向,对点云进行空间投影;

88、s4444:基于渗漏水目标的平面像素轮廓,在点云投影数据中,选取处于渗漏水轮廓内的点进行输出,输出数据为渗漏水目标在真实空间中包含的位置坐标,形式为若干组三维空间坐标组成的数组,表示为:

89、cloud=[(x1,y1,z1),(x1,y1,z1),...,(xn,yn,zn)]

90、其中,x,y,z分别为空间中点的三维坐标,采用二维插值方法对这些坐标值进行拟合,量化地得到渗漏水目标在三维空间中的形状,采用积分方法量化地求得渗漏水形状曲面的面积。

91、优选的,在步骤s45中,前处理模块对可见光图像进行预处理,统一的大小和通道,并输入网络中;预测网络模块预测得到渗漏水目标信息;后处理模块基于点云数据输出渗漏水目标的量化参数;

92、后处理模块将可见光图像、渗漏水目标掩膜和渗漏水量化参数叠加输出至显示设备,实现对隧道衬砌渗漏水目标的实时检测。

93、因此,本发明采用上述一种盾构隧道衬砌渗漏水智能检测方法,具备以下有益效果:

94、(1)本发明研发了衬砌渗漏水多模态信息采集设备,基于激光雷达及可见光相机,采集盾构隧道衬砌渗漏水区域的点云以及可见光图像。

95、(2)本发明提出了一种点云-可见光图像联合标定方法,基于上述信息采集设备,通过拍摄标定板多方向、多角度的图像与点云,校正可见光相机的畸变,并标定激光雷达和可见光相机的外参,使可见光图像中的像素点能够与点云进行空间对应。

96、(3)本发明建立了一种渗漏水图像快速分割-特征量化框架,基于语义分割方法对可见光图像中的渗漏水进行分割,得到渗漏水目标掩膜。然后,基于目标掩膜对渗漏水区域的点云进行提取,并采用曲面拟合算法对渗漏水区域进行曲面拟合。最后,通过特征量化算法快速准确地计算拟合曲面的周长、面积、最大轴线长度等量化参数。

97、(4)本发明将可见光图像、渗漏水目标掩膜及渗漏水量化参数叠加显示,方便工程人员实时查看盾构隧道衬砌渗漏水检测结果。

98、下面通过附图和实施例,对本发明的技术方案做进一步的详细描述。

本文地址:https://www.jishuxx.com/zhuanli/20240730/154841.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表