用于田地环境的杂草自主识别方法及系统

- 国知局

- 2024-07-31 22:48:23

本发明涉及目标识别,具体地涉及一种用于田地环境的杂草自主识别方法及一种用于田地环境的杂草自主识别系统。

背景技术:

1、草业是随着社会进步和经济发展从传统农业中独立出来的新兴产业,它在农业现代化和生态文明建设中起着关键作用。杂草对牧草的生长构成了严重威胁。它们的快速生长不仅会占据牧草的生长空间、减少作物的光照,还会滋生害虫,对牧草产量造成直接影响,甚至可能导致无收成。因此,及时防治田间杂草至关重要。目前,常见的除杂草方法包括人工除杂草和化学除杂草[2]。人工除杂草虽然精准度高,劳动强度大、效率低且成本高。化学除杂草虽然效率高且经济实惠,但大量使用可能会导致药物浪费和对同类牧草的伤害。随着农业机械化水平的提升,机械除杂草方法应运而生,其优点是效率高且人力消耗少,但大型机械的适应性差且可能伤害农作物。

2、利用高新技术实行智能除杂草可以实现无污染、效率高的方式清除田间杂草,因此,研究智能除杂草机器人是提升农业水平的重要途径。现有的基于机器视觉的颜色分类识别作物和杂草的机器人,机器人能够对阔叶植物和禾本科植物进行分类,虽然识别准确率很高。但是此机器人需求算力较高,成本较高,无法大规模推广。而其他识别效率高的机器人又存在识别精度不够的问题,针对现有杂草识别方案存在的无法兼顾识别效率和识别精度的问题,需要提出一种新的杂草自主识别方案。

技术实现思路

1、本发明实施方式的目的是提供一种用于田地环境的杂草自主识别方法及系统,以至少解决现有杂草识别方案存在的无法兼顾识别效率和识别精度的问题。

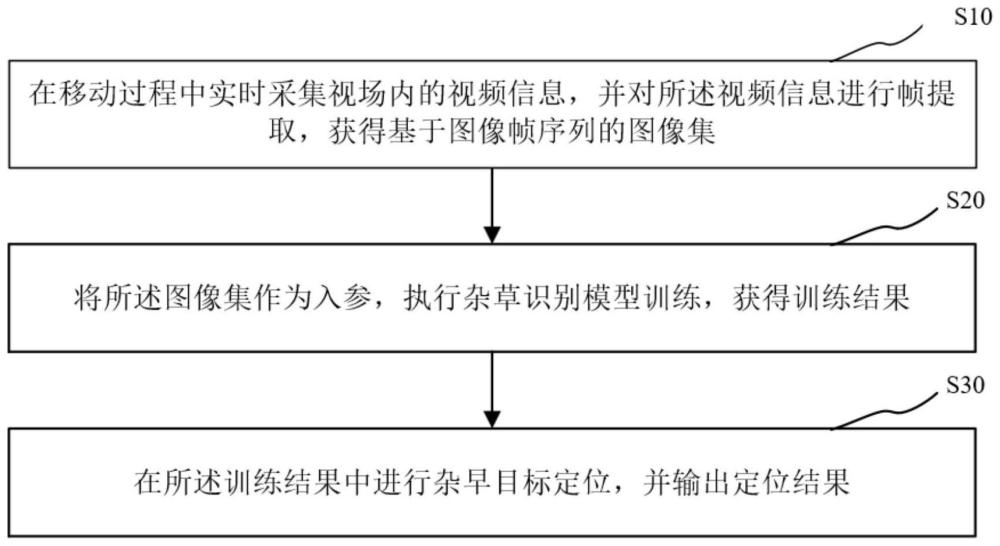

2、为了实现上述目的,本发明第一方面提供一种用于田地环境的杂草自主识别方法,应用于除草机器人在田地环境中的杂草识别,所述方法包括:在移动过程中实时采集视场内的视频信息,并对所述视频信息进行帧提取,获得基于图像帧序列的图像集;将所述图像集作为入参,执行杂草识别模型训练,获得训练结果;其中,所述融合模型基于融合有注意力层和替换ghostnet为骨干网络的yolov5模型训练获得;在所述训练结果中进行杂早目标定位,并输出定位结果。

3、可选的,所述对所述视频信息进行帧提取,获得基于图像帧序列的图像集,包括:基于除草机器人的移动步进信息,确定视频信息的帧截取时间间隔信息;基于所述帧截取时间间隔信息,在一个采样周期内,执行对应采集的视频信息帧提取,获得多个帧图像;基于各帧图像的采样时间进行排序,获得对应的图像集。

4、可选的,所述注意力层为cbam层;所述cbam层包括channel attention模块和spatial attention模块;将cbam层融合到第一个卷积中;在cbam层中依次设置通道注意力模块和空间注意力模块。

5、可选的,yolov5模型的骨干网络替换规则为:将所述yolov5模型的骨干网络替换为ghostnet骨干网络;将所述yolov5模型的特征金字塔替换为bifpn金字塔;将所述yolov5模型的目标定位指标替换为giou指标。

6、可选的,所述方法还包括:进行杂草识别模型训练,包括:进行田地环境图像采集,获得图像集,对所述图像集中的各图像进行梯度值分析,基于分析结果构建训练样本集;基于所述训练样本集,在融合有注意力层和替换ghostnet为骨干网络的yolov5模型中对预训练模型进行二次模型训练,获得训练模型,作为杂草识别模型。

7、可选的,所述图像集中的各图像进行梯度值分析,基于分析结果构建训练样本集,包括:从所述预训练模型的输出层开始,基于链式法则计算网络结构相对于每一图像对应的梯度值;基于各图像对应的梯度值进行各图像排序,梯度值越大,图像排序越靠前;基于各图像的排序结果,对各图像在训练样本集中的占比进行赋权,基于赋权后的图像构建训练样本集。

8、可选的,在杂草识别模型训练完成后,所述方法还包括:基于在所述训练样本集预留的图像构建验证样本集;将所述验证样本集推送到用户端,并回收用户的标注结果,基于标注结果真实边界框;基于训练获得杂草识别模型进行验证样本训练,获得各验证样本中图像的预测边界框;基于所述真实边界框和所述预测边界框进行giou指标计算,基于计算结果对训练获得的杂草识别模型进行校正,获得校正后的杂草识别模型。

9、可选的,所述基于所述真实边界框和所述预测边界框进行giou指标计算的计算规则为:

10、

11、其中,glou(a,b)为giou指标计算值;a为真实边界框;b为预测边界框;c为真实边界框a和预测边界框b合并后组成的最小边框。

12、本发明第二方面提供一种用于田地环境的杂草自主识别系统,应用于除草机器人在田地环境中的杂草识别,所述系统包括:采集单元,用于在移动过程中实时采集视场内的视频信息,并对所述视频信息进行帧提取,获得基于图像帧序列的图像集;训练单元,用于将所述图像集作为入参,执行杂草识别模型训练,获得训练结果;其中,所述融合模型基于融合有注意力层和替换ghostnet为骨干网络的yolov5模型训练获得;定位单元,用于在所述训练结果中进行杂早目标定位,并输出定位结果。

13、另一方面,本发明提供一种计算机可读储存介质,该计算机可读存储介质上储存有指令,其在计算机上运行时使得计算机执行上述的用于田地环境的杂草自主识别方法。

14、通过上述技术方案,本发明方案具有如下优势:

15、1)实时采集和处理:在移动过程中实时采集视场内的视频信息,并对视频信息进行帧提取,实现实时处理和识别,提高效率。

16、2)基于图像帧序列的识别:通过获得基于图像帧序列的图像集作为输入参数,可以综合考虑多帧图像信息,提高识别准确性。

17、3)融合模型训练:采用融合有注意力层和替换ghostnet为骨干网络的yolov5模型进行训练,结合注意力机制和先进的网络结构,提升模型性能。

18、4)杂草目标定位:在训练结果中进行杂草目标定位,精确定位杂草目标位置,有助于有效除草。

19、5)自主识别:方法实现了杂草自主识别,减轻人工干预,提高自动化水平,适用于田地环境中的杂草识别任务。

20、综上所述,这种方法在实时性、准确性、模型性能和自主识别方面具有优势,为除草机器人在田地环境中的杂草识别提供了有效的解决方案。

21、本发明实施方式的其它特征和优点将在随后的具体实施方式部分予以详细说明。

技术特征:1.一种用于田地环境的杂草自主识别方法,应用于除草机器人在田地环境中的杂草识别,其特征在于,所述方法包括:

2.根据权利要求1所述的方法,其特征在于,所述对所述视频信息进行帧提取,获得基于图像帧序列的图像集,包括:

3.根据权利要求1所述的方法,其特征在于,所述注意力层为cbam层;

4.根据权利要求3所述的方法,其特征在于,yolov5模型的骨干网络替换规则为:

5.根据权利要求1所述的方法,其特征在于,所述方法还包括:

6.根据权利要求5所述的方法,其特征在于,所述图像集中的各图像进行梯度值分析,基于分析结果构建训练样本集,包括:

7.根据权利要求5所述的方法,其特征在于,在杂草识别模型训练完成后,所述方法还包括:

8.根据权利要求7所述的方法,其特征在于,所述基于所述真实边界框和所述预测边界框进行giou指标计算的计算规则为:

9.一种用于田地环境的杂草自主识别系统,应用于除草机器人在田地环境中的杂草识别,其特征在于,所述系统包括:

10.一种计算机可读存储介质,其特征在于,该计算机可读存储介质上储存有指令,其在计算机上运行时使得计算机执行权利要求1-8中任一项权利要求所述的用于田地环境的杂草自主识别方法。

技术总结本发明实施例提供一种用于田地环境的杂草自主识别方法及系统,应用于除草机器人在田地环境中的杂草识别,所述方法包括:在移动过程中实时采集视场内的视频信息,并对所述视频信息进行帧提取,获得基于图像帧序列的图像集;将所述图像集作为入参,执行杂草识别模型训练,获得训练结果;其中,所述融合模型基于融合有注意力层和替换GhostNet为骨干网络的YOLOV5模型训练获得;在所述训练结果中进行杂早目标定位,并输出定位结果。本发明方案解决了现有杂草识别方案存在的无法兼顾识别效率和识别精度的问题。技术研发人员:房建东,马彪,赵于东受保护的技术使用者:内蒙古工业大学技术研发日:技术公布日:2024/7/29本文地址:https://www.jishuxx.com/zhuanli/20240730/194712.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表