多客户端数据处理方法、系统、设备、介质及产品与流程

- 国知局

- 2024-07-31 22:50:48

本发明涉及通信,特别是涉及一种多客户端数据处理方法、系统、设备、介质及产品。

背景技术:

1、随着智能终端设备的快速普及,大量的个人信息数据被各种网络平台所采集。传统的机器学习需要将客户端的信息数据都收集到中心服务器,易导致客户端的隐私数据遭到泄露。联邦学习作为一种分布式的机器学习模式,它不需要让数据离开本地客户端,进而对数据的隐私起到保护作用。在联邦学习中,由于数据来源于各种各样的终端设备,会很自然地产生数据异质性问题,也就是说这些数据是非独立同分布的(nones independentidentically distribution,non-iid)。在推荐系统和个性化广告投放等应用中,利用数据异质性尤为关键。

2、在相关技术方案中,所有客户端的数据都直接带入同一个全局模型中训练,训练完成之后,所有客户端也都使用同一个模型进行预测。这种做法将non-iid的数据作为独立同分布的数据直接进行处理,忽略了多客户端数据之间的差异,从而不能产生一些个性化的预测,并且随机梯度下降法是针对独立同分布的数据进行设计的,在处理non-iid数据时会存在效率过低的问题。

技术实现思路

1、本发明的目的是提供一种多客户端数据处理方法、系统、设备、介质及产品,可以使用瓦瑟斯坦距离结合马氏距离直接量化了多客户端数据分布之间的相似性,数据处理效率高。

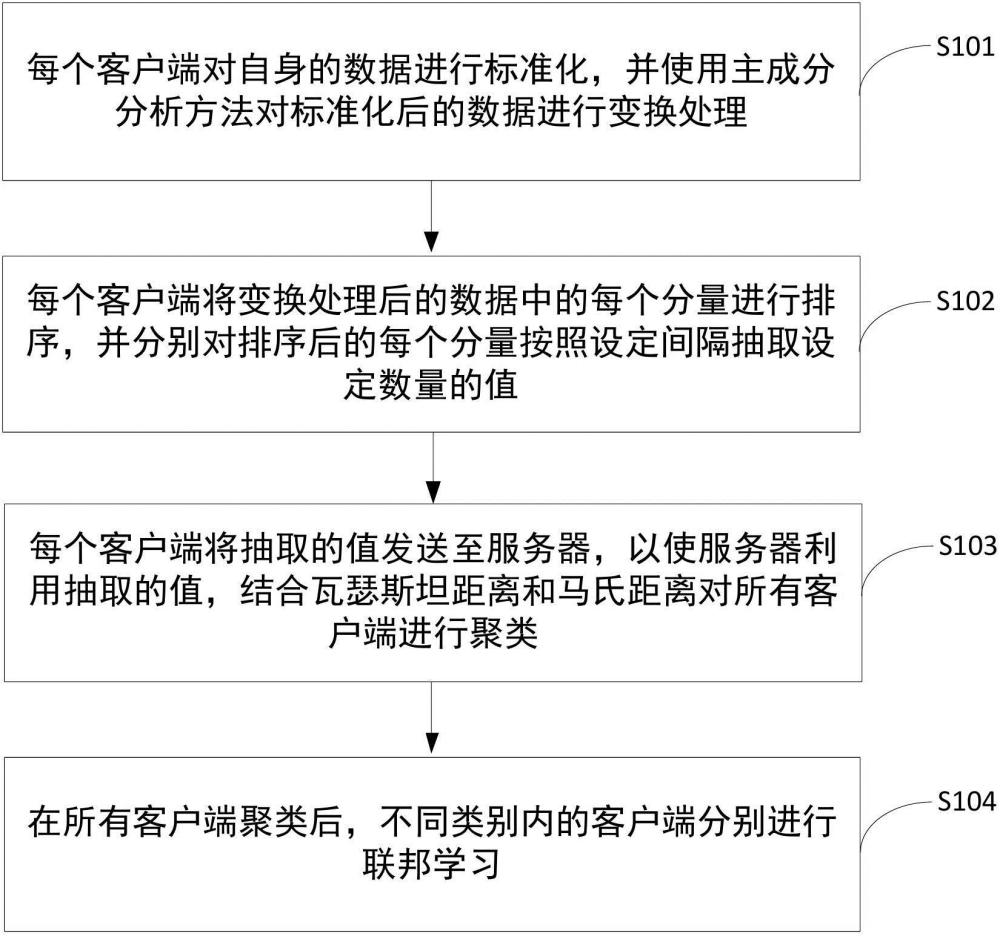

2、为了解决上述技术问题,本发明提供一种多客户端数据处理方法,所述方法包括:

3、每个客户端对自身的数据进行标准化,并使用主成分分析方法对标准化后的数据进行变换处理;

4、每个客户端将变换处理后的数据中的每个分量进行排序,并分别对排序后的每个分量按照设定间隔抽取设定数量的值;

5、每个客户端将抽取的值发送至服务器,以使服务器利用抽取的值,结合瓦瑟斯坦距离和马氏距离对所有客户端进行聚类;

6、在所有客户端聚类后,不同类别内的客户端分别进行联邦学习。

7、第一方面,在本发明提供的上述多客户端数据处理方法中,每个客户端对自身的数据进行标准化,包括:

8、每个客户端获取自身所有数据的和值;

9、每个客户端将获取的自身所有数据的和值以及自身的数据个数发送至服务器,以使服务器计算得到所有客户端的数据平均值,并将所述数据平均值发送至每个客户端;

10、每个客户端根据所述数据平均值计算本地部分方差并发送至服务器,以使服务器计算得到数据标准差并发送至每个客户端;

11、每个客户端根据所述数据标准差对自身的数据进行标准化。

12、另一方面,在本发明提供的上述多客户端数据处理方法中,每个客户端采用下述公式获取自身所有数据的和值:

13、;

14、其中,为第个客户端的所有数据的和值,的形式表示向量,的形式表示第个客户端的数据的第行转化为列向量的形式,表示第个客户端的数据的第行第1列的值,表示第个客户端的数据的第行第列的值,,为第个客户端的数据个数,为所有数据的维数,表示求和符号,表示转置。

15、另一方面,在本发明提供的上述多客户端数据处理方法中,采用下述公式计算得到所有客户端的数据平均值:

16、;

17、;

18、;

19、其中,表示所有客户端的数据总和,,为客户端的总个数,为第1个客户端的数据个数,为第个客户端的数据个数,为所有客户端的数据总个数,为所有客户端的数据平均值。

20、另一方面,在本发明提供的上述多客户端数据处理方法中,每个客户端采用下述公式计算本地部分方差:

21、;

22、;

23、其中,为第个客户端的本地部分方差,为第个客户端的本地部分方差的第个分量,,为第个客户端的数据在第1行第列的值,为第个客户端的数据在第行第列的值,为数据平均值的第个分量。

24、另一方面,在本发明提供的上述多客户端数据处理方法中,采用下述公式计算得到所述数据标准差:

25、;

26、;

27、其中,为所述数据标准差,为将所有客户端的本地部分方差相加得到的数据方差,为数据方差的第个分量。

28、另一方面,在本发明提供的上述多客户端数据处理方法中,每个客户端根据所述数据标准差采用下述公式对自身的数据进行标准化:

29、;

30、;

31、;

32、其中,为第个客户端的数据在第行第列的值经标准化后得到的数据,为第个客户端的数据在第行第列的值,为所述数据标准差的第个分量,为第个客户端标准化后的第条数据,为第个客户端标准化后的数据。

33、另一方面,在本发明提供的上述多客户端数据处理方法中,使用主成分分析方法对标准化后的数据进行变换处理,包括:

34、接收服务器发送的数据总个数;

35、根据所述数据总个数和标准化后的数据,计算本地协方差矩阵并发送至服务器,以使服务器计算得到总体协方差矩阵,对所述总体协方差矩阵进行奇异值分解,选取若干个最大的特征值对应的特征向量发送至每个客户端;

36、每个客户端根据选取的特征向量对标准化后的数据进行变换处理。

37、另一方面,在本发明提供的上述多客户端数据处理方法中,采用下述公式计算本地协方差矩阵:

38、;

39、其中,为所述本地协方差矩阵,为所有客户端的数据总个数,为第个客户端标准化后的第条数据,,为第个客户端的数据个数,为第个客户端标准化后的数据,表示转置。

40、另一方面,在本发明提供的上述多客户端数据处理方法中,服务器计算得到总体协方差矩阵,对所述总体协方差矩阵进行奇异值分解,选取若干个最大的特征值对应的特征向量发送至每个客户端,包括:

41、服务器计算得到总体协方差矩阵;

42、对所述总体协方差矩阵进行奇异值分解,得到,其中是对角矩阵,满足,是正交矩阵;

43、选取的前行发送至每个客户端。

44、另一方面,在本发明提供的上述多客户端数据处理方法中,每个客户端根据选取的特征向量采用下述公式对标准化后的数据进行变换处理:

45、;

46、;

47、其中,为第个客户端对标准化后的第条数据进行变换处理后得到的数据,为第个客户端对标准化后的数据进行变换处理后得到的数据。

48、另一方面,在本发明提供的上述多客户端数据处理方法中,每个客户端将变换处理后的数据中的每个分量进行排序,并分别对排序后的每个分量按照设定间隔抽取设定数量的值,包括:

49、第个客户端将变换处理后的数据中的第个分量进行排序;

50、分别抽取第个值,其中,,为所述设定数量;

51、若抽取后的值为,第个客户端抽取的所有值为:

52、;

53、其中,为第个客户端抽取的所有值,为抽取的所有值的维数,,,为所有数据的维数。

54、另一方面,在本发明提供的上述多客户端数据处理方法中,利用抽取的值,结合瓦瑟斯坦距离和马氏距离对所有客户端进行聚类,包括:

55、选取多个客户端的数据作为聚类中心;

56、计算每个客户端数据与每个聚类中心之间的由瓦瑟斯坦距离结合马氏距离而得到的目标距离;

57、将每个客户端归到与所述目标距离最近的聚类中心所在的类;

58、更新聚类中心点;

59、重复执行计算目标距离,更新聚类中心点的步骤,直至聚类中心点不再发生变化。

60、另一方面,在本发明提供的上述多客户端数据处理方法中,选取多个客户端的数据作为聚类中心,包括:

61、选取个客户端的数据作为聚类中心;

62、将个聚类中心的数据分别记为:

63、;

64、其中,,为所述设定数量,,为抽取的所有值的维数,,,为所有数据的维数,是聚类中心点数据的元素,表示转置。

65、另一方面,在本发明提供的上述多客户端数据处理方法中,采用下述公式计算每个客户端数据与每个聚类中心之间的由瓦瑟斯坦距离结合马氏距离而得到的目标距离:

66、;

67、其中,为第个客户端数据与第个聚类中心之间的目标距离,是客户端数据的元素,是对角矩阵第个对角元素。

68、另一方面,在本发明提供的上述多客户端数据处理方法中,更新聚类中心点,包括:

69、获取属于每一类的客户端数据的平均值;

70、将属于每一类的客户端数据的平均值作为新的聚类中心点。

71、另一方面,在本发明提供的上述多客户端数据处理方法中,采用下述公式获取属于每一类的客户端数据的平均值:

72、;

73、其中,为属于第类的客户端数据,为属于第类的客户端索引的集合,表示集合元素的个数,为第类的客户端数据的平均值。

74、另一方面,在本发明提供的上述多客户端数据处理方法中,不同类别内的客户端分别进行联邦学习,包括:

75、每个客户端接收服务器建立的相应类别的全局模型;每个类别内的所有客户端接收的全局模型相同;

76、每个客户端训练自身的全局模型,并将权重和梯度参数上传至服务器,以使服务器对相应类别内的模型参数进行聚合,得到相应类别的新的全局模型;

77、直至相应类别的损失函数收敛或迭代次数达到设定次数,输出训练好的相应类别的全局模型;

78、利用训练好的相应类别的全局模型进行待处理任务的分类或检测。

79、为了解决上述技术问题,本发明还提供一种多客户端数据处理系统,所述系统包括多个客户端和至少一个服务器;

80、各客户端,用于对自身的数据进行标准化,并使用主成分分析方法对标准化后的数据进行变换处理;还用于将变换处理后的数据中的每个分量进行排序,并分别对排序后的每个分量按照设定间隔抽取设定数量的值,将抽取的值发送至服务器;

81、服务器,用于利用抽取的值,结合瓦瑟斯坦距离和马氏距离对所有客户端进行聚类;

82、不同类别内的客户端,用于分别进行联邦学习。

83、为了解决上述技术问题,本发明还提供一种多客户端数据处理设备,所述设备包括:

84、存储器,用于存储计算机程序;

85、处理器,用于执行所述计算机程序时实现上述多客户端数据处理方法的步骤。

86、为了解决上述技术问题,本发明还提供一种非易失性存储介质,所述非易失性存储介质上存储有计算机程序,所述计算机程序被处理器执行时实现上述多客户端数据处理方法的步骤。

87、为了解决上述技术问题,本发明还提供一种计算机程序产品,包括计算机程序/指令,所述计算机程序/指令被处理器执行时实现上述多客户端数据处理方法的步骤。

88、从上述技术方案可以看出,本发明所提供的一种多客户端数据处理方法,该方法包括:每个客户端对自身的数据进行标准化,并使用主成分分析方法对标准化后的数据进行变换处理;每个客户端将变换处理后的数据中的每个分量进行排序,并分别对排序后的每个分量按照设定间隔抽取设定数量的值;每个客户端将抽取的值发送至服务器,以使服务器利用抽取的值,结合瓦瑟斯坦距离和马氏距离对所有客户端进行聚类;在所有客户端聚类后,不同类别内的客户端分别进行联邦学习。

89、本发明的有益效果在于,本发明提供的上述多客户端数据处理方法,先对客户端自身的数据进行标准化,可以减少计算误差,然后使用主成分分析方法对标准化后的数据进行变换处理,这样只使用主成分便于后续计算,对数据起到降维作用,且避免原始数据的泄露,之后对排序抽取的值结合瓦瑟斯坦距离和马氏距离对所有客户端进行聚类,这样提供了数据分布相似性的判断标准,使用瓦瑟斯坦距离结合马氏距离判断多客户端数据分布之间的关系,直接量化了多客户端数据分布之间的相似性,进而在所有客户端聚类完成之后,每个类别内的客户端的数据可以认为是独立同分布的,因而在每个类别中直接进行联邦学习会更加高效,并且该联邦学习能够进行一些个性化的预测,整个多客户端数据处理过程提高了非独立同分布的数据的处理效率。

90、此外,本发明还针对多客户端数据处理方法提供了相应的多客户端数据处理系统、多客户端数据处理设备、非易失性存储介质及产品,与上述提到的多客户端数据处理方法具有相同或相对应的技术特征,效果同上。

本文地址:https://www.jishuxx.com/zhuanli/20240730/194973.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。