一种基于隐空间扩散模型的保真虚拟换装方法

- 国知局

- 2024-07-31 22:58:11

本发明属于图像生成,具体涉及一种保真虚拟换装方法。

背景技术:

1、基于图像的虚拟试穿(virtual try-on,vton)旨在将一件店内平整的衣服转移到一个人的身上,同时保留人和衣服的细节,如款式、图案和文字。在过去的十年中,vton引起了广泛的关注[1],[2],[3],[4],[5],[6],[7],随着生成式人工智能的快速发展,它在改善用户购物体验方面具有巨大的潜力,为用户和在线购物之间架起了一座桥梁。

2、先前的vton方法高度依赖生成式对抗网络(generative adversarial networks,gans)来合成试穿图像。通常,它们首先使用基于薄板样条(thin plate spline,tps)的[1],[6]或基于外观流(apperance flow)[6]的算法将扁平衣服仿射到人的身体上,然后使用gan进一步完善之前生成的试穿图像。然而,由于模式崩溃问题[11],基于gan的方法无法合成照片般逼真的试穿图像,也无法准确捕捉错综复杂的服装细节,往往导致生成的结果存在明显缺陷。

3、最近,扩散模型在图像绘制、图像编辑、甚至分割等各种任务中都表现出了卓越的生成能力[9],[10],[11],[12],[13]。与gan相比,扩散模型提供了更稳定的训练和直接的似然估计。然而,由于计算资源有限,将扩散模型直接应用于高分辨率vton是不可行的。因此,目前基于扩散的vton方法[6],[7]都是建立在隐空间扩散模型(latent diffusionmodel,ldm)[14],[15]上的,该模型在隐空间中执行扩散过程。虽然这些模型在生成逼真的试穿图像方面显示出了有效性,但与原始的平面服装相比,它们往往会产生不真实的服装细节。

4、经分析发现,ldm的随机性和隐空间监督是影响衣服保真度的关键限制因素。一方面,正如采样过程中引入的初始高斯噪声和每个时间步的附加高斯噪声所表明的那样,扩散随机性在保留服装细节方面提出了挑战。另一方面,隐空间监督无法为精细服装细节提供图像级监督。因此,使用扩散模型生成高度保真于原始平面服装的服装细节仍然是一项重大挑战。

技术实现思路

1、本发明的目的在于提出一种基于隐空间扩散模型的保真虚拟换装方法,以缓解ldm生成过程中的随机性和隐空间监督,提高虚拟换装任务的衣服保真效果。

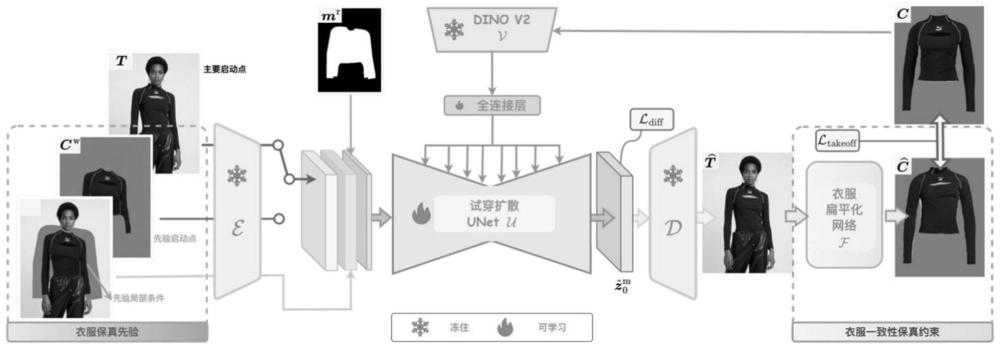

2、本发明提供的基于隐空间扩散模型的保真虚拟换装方法,称为fldm-vton。为了实现保真的试穿生成,本发明从两个主要方面对传统的隐空间扩散模型训练加以改进:(i)通过利用仿射的衣服作为起点和局部条件,为模型提供保真的衣服先验,以分别减轻初始和过程中增加的随机性;(ii)通过新颖的衣服扁平化网络提供衣服一致性的保真监督,从原始扁平衣服中带来额外的图像级约束,提高虚拟换装的保真性。除了训练方面的改进,本发明还对设计衣服后置采样改进了推理过程,进一步提高模型的性能,超过了传统的与衣服无关的高斯采样。

3、问题的归结:给定一个人物图像和一个表示试穿区域的遮罩m∈{0,1}h×w,通过元素相乘得到一个与衣服无关的人物图像pa,其上标a表示与衣服无关(agnostic)。本发明的目标是将一件平整的衣服移植到pa上,从而得到一个具有保真服装细节的照片般真实的试穿图像其尖角符号表示网络预估的结果。目前最先进的(sota)基于ldm的vton方法首先使用tps或基于流的仿射方法来从平面衣服c生成初步仿射的衣服cw,然后使用ldm进行现实细化。通过预先训练的编码器ε和解码器ldm在隐空间中训练一个扩散模型,包括正向和反向过程。在正向过程中,从高斯分布中采样得到的噪声被以任意时间步长t添加到所得到的隐空间特征中,其中t是真实的试穿图像下标0表示初始时刻。在反向过程中,使用扩散unet来估计添加的噪声ε。

4、本发明提出了一种新的保真隐空间扩散模型,以解决扩散随机性和隐空间监督造成的不保真问题。本发明将初步仿射过的衣服作为起点和局部条件,为模型提供保真的衣服先验。本发明引入一个新颖的衣服扁平化网络来约束生成的试穿图像,从而提供与衣服一致的保真监督。本发明方法为保真推理设计了衣服后验采样,与传统衣服无关的高斯采样相比,进一步提高了模型性能。在viton-hd和dress code数据集上的大量实验结果表明,本发明方法优于最先进的基线方法,能够生成具有保真服装细节的逼真试穿图像,在定性和定量方面都证明了它的优越性能。

5、本发明提供的基于隐空间扩散的保真虚拟换装方法,具体步骤如下:

6、(1)首先,分析到传统的基于ldm的vton方法虽然能获得逼真的效果,但缺乏对原始服装细节的保真性。本发明认为扩散随机性是关键的限制因素,主要体现在两个方面:(a)在采样过程中引入的初始高斯噪声,和(b)在每个时间步添加的高斯噪声。为了缓解这些问题,本发明方法为模型提供保真衣服先验,利用初步仿射过的衣服(a)作为起点来解决初始随机性,并(b)作为局部条件来缓解过程中增加的随机性。

7、与传统的基于ldm的vton方法相比以ε(t)为起点的前向过程不同,本方法的前向过程既可以以ε(t)为起点,也可以以仿射衣服的特征ε(cw)为起点,其中仿射衣服的特征在一开始就提供了衣服先验;上标w表示仿射(warp)。为了区分这两个起点,用上标m和p分别表示主要(main)和先验(prior)的含义,从而将称为扩散主起点,将称为扩散先验起点。此外,还利用预先试穿衣服图像特征作为所有时间步的先验局部条件,其中

8、针对对应的扩散前向过程。以任意的时间步长t在主要的和先验的起始隐空间特征和上逐渐添加高斯噪声得到对应t时间步数下对应的隐空间特征如下:

9、

10、其中,下标t表示第t扩散时刻,并且βs是预先定义的方差调整值[19]。

11、针对对应的扩散逆向过程,将缩小的掩码mr∈{0,1}h×w作为去噪条件,并将预先试穿衣服图像特征ε(tw)作为先验局部条件。本发明方法将第t时刻的隐空间特征、先验局部条件和去噪条件沿通道维度串联起来,作为扩散u型架构网络(u-shape network,unet)[1]的输入:

12、

13、其中,[·;·]表示拼接操作。

14、给定一对图像,会得到两个不同的输入:主去噪输入和先验去噪输入这些输入分别通过相同的尝试扩散unet进行处理,以预测主要的起始隐空间特征此外,还通过dino-v2[20](一种目前功能强大的自监督视觉编码器)对扁平衣服c进行编码,并通过交叉注意将其作为全局控制器注入每个unet层。因此,单个样本和一个时间步长t的扩散训练损失函数定义如下:

15、

16、其中,训练路径有助于保持现有扩散模型所建立的照片逼真度,而训练路径有助于提高所生成服装的保真度。

17、(2)虽然衣服先验可以帮助提高输入的保真度,但要保留图案和文字等精细细节仍然具有挑战性,因为训练只受到真实试穿隐空间特征的监督。为了进一步提高对精细细节的保真度,引入衣服一致性保真监督,其灵感来源于这样一个事实,即您试穿的衣服一旦脱下并压平,就应该与平整的衣服完全相同。为此,本发明引入了一个衣服扁平化网络它可以从生成的试穿图像中脱掉衣服,并将其平铺成原来的平面图像。

18、所述衣服扁平化网络分为两步:(i)脱衣步骤和(ii)扁平化步骤。脱衣步骤可以通过使用预先解析的衣服遮罩mc遮挡生成的试穿图像来轻松完成。扁平化步骤是一个反仿射过程,通过训练一个全新的衣服扁平化网络来预测平整流来完成。更具体地说,本发明的衣服扁平化网络亦采用u型结构[1],利用特征金字塔网络(fpn)[21]对衣服解析特征进行多尺度编码,然后采用全新设计的级联式流量估计块(flow estating block,feb),用缩小的扁平化衣服位置掩码预测扁平化流。请注意,本发明在实验中使用了五种不同的多尺度特征,其中只显示了三个如附图2所示作为简化。

19、按照sota外观流训练策略[5],本发明使用混合损失函数来训练衣服扁平化网络,包括图像层面[22]的损失和感知损失[2],以及流层面[4]的二阶平滑损失和总方差损失其对应损失的定义为:

20、

21、其中,是用于调整不同损失成分权重的超参数,下标*分别对应和的下标;

22、一旦训练好衣服平整化网络后,就可以使用固定模型权重的衣服扁平化网络来处理生成的试穿图像从而得到预计的扁平化衣服度量预计的扁平化衣服和原始的扁平化衣服c之间的差异,可以进一步为试穿扩散训练提供衣服一致性保真监督,其定义为:

23、

24、(3)接下来,将回顾总结本技术实现要素:所提出虚拟换装方法的整体训练及测试流程内容,具体过程如附图1所示。

25、在训练阶段,本发明通过将第t个时刻的隐空间特征与先验的局部条件和去噪条件进行拼接,得出每个样本的主要和先验去噪输入,即和然后,在全局控制器dino-v2的引导下,本发明内容的试穿扩散unetu对这两种输入进行单独处理,用扩散损失来估计尝试性隐空间特征。此外,本发明还加入了衣服扁平化网络,利用衣服一致性损失在公式(5)中提供衣服一致性保真监督。试穿扩散网络的总体训练损失定义如下:

26、

27、其中,是一个权衡超参数。请注意,在训练阶段,只训练试穿扩散unet以及dino v2模型后的全连接层(fully-connected layer)[3],具体如附图1所示。

28、在测试阶段,传统的扩散模型通过从标准高斯分布中采样的与衣服无关的噪声进行初始化。然而,这引入了大量的初始随机性,对生成的服装细节的保真性产生了不利影响。为了解决这个问题,本发明设计一种服装先验采样来进一步提高模型性能。

29、鉴于之前所提出的先验去噪输入的训练,能从基于仿射衣服的高斯噪声中进行采样初始化,而对应采样的高斯噪声条件受限于经过仿射的衣服特征ε(cw);具体来说,基于仿射衣服的高斯噪声是经过t步扩散的先验隐空间特征即使用公式(1)进行t步向前扩散时间步后的仿射的衣服特征ε(cw)。通过这种方法,推理阶段中采样过程的初始随机性大大降低,从而确保了生成的服装细节的保真性。

30、本发明利用强大的生成式人工智能算法,提出基于隐空间扩散模型的保真虚拟换装算法,通过引入保真衣服先验和衣服一致性保真监督,可以显著缓解隐空间扩散模型中由于扩散随机性和隐空间监督所导致的不保真生成的问题。在两个流行的虚拟换装基准数据集上的广泛实验结果验证了本发明方法的优越性能,适用于上半身、下半身及裙子不同部位的换装任务,能生成具有保真服装细节同时具有逼真试穿效果的图像。

本文地址:https://www.jishuxx.com/zhuanli/20240730/195532.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。