一种基于Transformer的时间多尺度目标跟踪方法与流程

- 国知局

- 2024-07-31 22:59:43

本发明属于人工智能领域,尤其涉及一种基于transformer的时间多尺度目标跟踪方法。

背景技术:

1、计算机视觉是人工智能中的一个重要研究方向,它是一门可以使机器获得“看”的能力的科学,具体来讲,计算机视觉即用摄影机等视觉设备和电脑运算代替人眼和人脑对目标进行识别、跟踪和测量等视觉理解,并根据算法进行进一步的处理,使电脑可以代替人类处理视觉信息。在计算机视觉领域中,目标跟踪是一个非常重要的研究方向,它是视频理解的基础,其任务为通过第一帧给出的目标信息,在后续视频帧中实时计算出目标的位置。如今目标跟踪技术在很多领域中已有了广泛的应用,例如:智能视频监控、智能人机交互、医学诊断与医药研究和国防装备等领域。

2、经过多年的研究,如今的目标跟踪算法在准确性和鲁棒性上已取得了很大的进展,但在如目标尺度变化、背景干扰、目标形变、快速运动、遮挡、光照变化、运动模糊和目标旋转等复杂的目标跟踪场景中,现有的目标跟踪算法如siamfc、siamrpn++、siamban和siamcar等,这类算法在跟踪过程中,使用第一帧裁剪出的模板与当前帧中的搜索区域匹配,将目标跟踪任务看作为模板与搜索图之间的相似度匹配问题,这些算法在许多常规跟踪场景中运行时具有出色的性能和实时跟踪速度。然而,在上述的复杂场景中这些算法的表现仍难以令人满意。为了解决这一问题,研究人员在跟踪算法中加入了复杂的模板更新机制,通过模板更新的方式来提升跟踪算法的鲁棒性。例如,dsiam算法就是一种具有快速转换学习模型的动态孪生网络,通过这种方式来实现模板更新并抑制背景的干扰;dasiamrpn算法中设计了一个干扰感知模块,在离线训练中学习干扰感知特征,并在跟踪推理过程中抑制干扰。gradnet算法则将反向梯度集成到初始模板中以增强模板的判别能力。然而,这些在模板更新的过程中消耗了更多的计算资源,严重影响了跟踪算法的实时性;此外,这些定制的更新策略引入了需要巧妙设计的超参数,能否设计合理的超参数在很大程度上影响了算法的性能;并且这类算法只关注了目标的变化,而忽略了目标在动过程中丰富的时空信息。

技术实现思路

1、本发明所要解决的技术问题是针对背景技术的不足提供了一种基于transformer的时间多尺度目标跟踪方法。

2、本发明为解决上述技术问题采用以下技术方案:

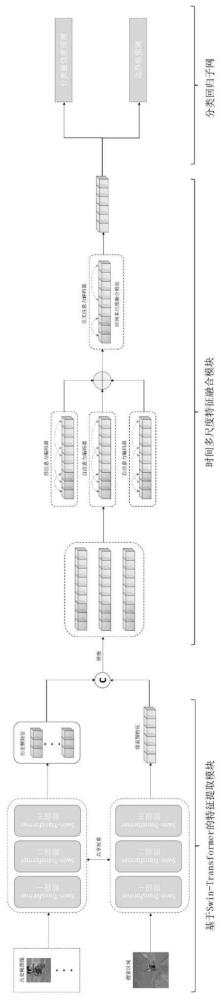

3、一种基于transformer的时间多尺度目标跟踪方法,具体包含以下三个步骤;

4、步骤1,基于swin-transformer的时间多尺度特征提取模块:由历史帧特征提取分支和搜索图特征提取分支两部分组成;在历史帧特征提取分支中,通过骨干网络提取每个历史模版的特征,并按不同时间尺度将提取后的特征进行拼接并降维,得到不同时间尺度下的融合模版特征;搜索图特征提取分支中,将待进行目标跟踪的搜索图作为输入并提取特征;

5、步骤2,用于时间多尺度特征融合的编码-解码模块:编码器中包含若干个transformer块,其中每个transformer块由带有前馈神经网络ffn的多头自注意力msa块所组成;在得到不同时间尺度下的多个编码器输出后,将多个时间尺度输出经过编码的特征进行融合,得到时间多尺度特征,并与搜索区域特征作为解码器的输入;

6、步骤3,用于定位目标的分类回归网络:将目标跟踪任务分解为两个个子任务,一个用于预测前景背景分类的分类分支和一个用于直接回归目标边界框的回归分支。

7、作为本发明一种基于transformer的时间多尺度目标跟踪方法的进一步优选方案,在步骤1中,swin-transformer采用基于注意力机制的分层窗口架构;具体方案描述为:

8、步骤1.1,通过将窗口进行非重叠式的划分方法,将自注意力的计算限制在局部窗口内,来降,低计算的复杂度,并在此基础之上通过错位窗口的方法,增加了跨窗口的连接;

9、步骤1.2,在网络由浅层到深层的层级结构中,通过逐渐合并上一层的邻域窗口来构建下一层的征图,以此形成特征金子塔。

10、作为本发明一种基于transformer的时间多尺度目标跟踪方法的进一步优选方案,所述基于swin-transformer的特征提取模块选择swin-transformer用于模型中特征提取的骨干网络。

11、作为本发明一种基于transformer的时间多尺度目标跟踪方法的进一步优选方案,解码器由一个多头交叉注意模块mca和前馈神经网络fnn组成。

12、作为本发明一种基于transformer的时间多尺度目标跟踪方法的进一步优选方案,在输入编码器前将历史帧特征与模版特征沿着空间维度进行串联,并在多头自注意力块中计算自注意力,带有前馈神经网络ffn对多头自注意力生成的特征进行提炼,编码器输出的时候,对特征执行分解操作,恢复出历史帧特征与搜索区域各自的特征表示。

13、作为本发明一种基于transformer的时间多尺度目标跟踪方法的进一步优选方案,在编码器中,每一个编码块用公式表示为:

14、

15、其中,s为串联后的融合特征。

16、作为本发明一种基于transformer的时间多尺度目标跟踪方法的进一步优选方案,在解码器中,解码过程用公式表示为:

17、

18、其中,s为串联后的融合特征,t为时间多尺度融合特征,x为搜索图特征,通过计算交叉注意力后得到最后用于分类回归的特征图。

19、作为本发明一种基于transformer的时间多尺度目标跟踪方法的进一步优选方案,每个分支都为一个三层感知机,其中分类分支采用iou-aware classification score来计算预测边界框与真实值之间的重叠度,从而帮助模型生成更精确的边界框;

20、在损失函数的选择上,选取基于focal loss的不对称地赋予正负样本权重的损失函数varifocal loss,用公式表示为:

21、

22、在分类分支中,p为预测的iacs,q为真实边界框与预测边界框的iou得分;iou-aware classification score是一种基于focal loss,非对称的赋予正负样本权重的一种损失函数。

23、作为本发明一种基于transformer的时间多尺度目标跟踪方法的进一步优选方案,在用于回归边界框的回归分支中,选用giou loss作为损失函数预测边界框与真实边框直接的距离。

24、作为本发明一种基于transformer的时间多尺度目标跟踪方法的进一步优选方案,用公式表示为:

25、

26、giou loss通过加权,更为强调高得分的分类样本,同时忽略负样本的干扰。

27、本发明采用以上技术方案与现有技术相比,具有以下技术效果:

28、1、本发明通过融合不同时间尺度下不同的目标运动信息,从不同的时间尺度下学习目标的运动过程,从而提高在目标形状变化、目标被遮挡以及相似物干扰等复杂场景的跟踪成功率和准确率;

29、2、本发明在架构中没有使用传统的cnn,在特征提取与特征融合中都只使用了transformer,为transformer在视觉领域的发展提供了新的方向;

30、3、本发明在当前的计算机视觉研究中,很少有算法融合不同时间尺度的信息,因此除了目标跟踪领域,视频插帧等领域也可以探索使用时间多尺度的方法。

本文地址:https://www.jishuxx.com/zhuanli/20240730/195629.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表