基于大语言模型的交互式视频检索方法和系统

- 国知局

- 2024-07-31 23:19:11

本发明属于计算机视觉领域,涉及计算机视觉领域的视频理解问题,尤其涉及一种基于大语言模型的交互式的视频检索方法和系统。

背景技术:

1、随着多媒体技术的高速发展与互联网的普及,视频数据规模迅速增长,面对形式各样、数量庞大的视频数据,人工浏览手动查找视频内容的效率低下,因此通过机器高效寻找符合期望的视频,即视频检索,成为了当下迫切的问题。

2、近年来,深度学习技术在视频检索领域得到广泛应用,针对单一模态以及单一语义,如人物、行为、场景等,视频检索性能取得了长足进展。随着用户需求的不断提升,用户的查询内容趋于细致,因此在检索中,需要精准获取用户的检索意图,以帮助用户快速获得符合需求的图像和视频。当前的视频检索技术难以直接满足获取用户检索意图的视频检索的需要。主要原因是目前的交互式视频检索主要是根据用户对检索结果的简单反馈来进行迭代式检索,直至用户找到符合需求的检索结果。这种方法由于没有理解用户的检索意图,使得迭代检索的过程耗时长,以致用户往往无法快速的获取符合需求的结果。

技术实现思路

1、针对以上问题本发明提出了一种基于大语言模型的交互式检索方法:利用blip-2模型来提取视频特征,并在用户完成对检索结果的反馈后,我们将提前设计好的提示词传递给大语言模型,引导它生成关于用户检索意图的问题,并交由用户回答,用户回答完毕后,大语言模型在我们的引导下总结出一个更加精确的查询词,并进入下一轮检索。本方法旨在引入大语言模型来帮助交互式检索来更好地执行检索任务。

2、本发明的目的在于通过在经典的交互式检索方法中引入大语言模型来深入理解用户的检索意图,来尽可能提高检索结果的准确率和检索过程的高效性。

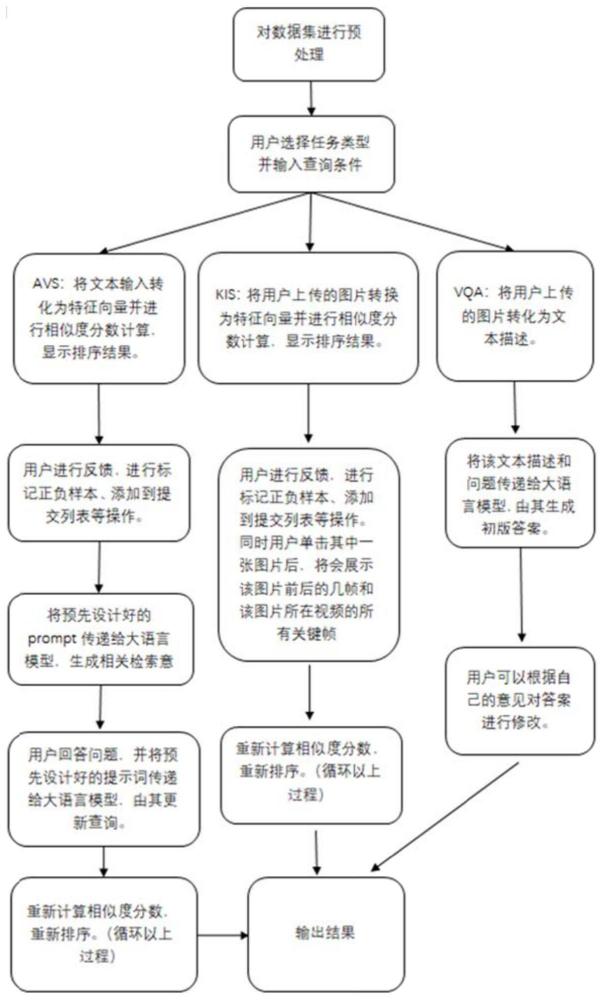

3、基于大语言模型的交互式检索方法,包含以下步骤:

4、步骤1,数据准备,首先基于现有的数据集,对所有视频进行切割分帧,并获得每个视频的所有关键帧;

5、步骤2,提取视频关键帧的文本特征向量和视觉特征向量,并将它们保存在特征向量数据库中;

6、步骤3,结合用户输入的信息,利用大语言模型在数据库中检索相关视频或生产相关问题,并对检索结果进行排序,具体包括如下子步骤:

7、步骤3.1,根据用户输入的文本在数据集中检索符合描述的关键帧;

8、步骤3.2,根据用户输入的图像检索该图像与数据集中最相似的视频帧;

9、步骤3.3,根据用户输入的图像和问题,利用大语言模型生成相关问题引导用户进行反馈回答。

10、进一步的,步骤2中使用blip-2模型提取视频关键帧的文本特征向量和视觉特征向量。

11、进一步的,步骤3.1的具体实现方式如下;

12、步骤3.1.1,用户在前端的检索框中输入文本描述,将文本描述转化为文本特征向量,然后进行第一轮的待评估视频片段和用户输入的查询词之间的相似度分数计算,并进行排序,同时将前n个结果传递到前端,展示第一轮检索结果;

13、步骤3.1.2,用户对第一轮检索结果进行反馈,即进行标记正负样本、跳过、添加到提交列表操作;

14、步骤3.1.3,用户结束反馈后,将用户的反馈插入预先设计好的提示词并传递给大语言模型,生成针对用户检索意图的问题以供用户回答;

15、步骤3.1.4,用户结束回答后,将用户的回答情况和用户的反馈情况插入到预先设计好的提示词中并传递给大语言模型,生成一个更加准确的查询词来进行下一轮的相似度分数计算和结果重新排序;

16、步骤3.1.5,循环执行步骤3.1..1-3.1.4,直至用户结束检索过程。

17、进一步的,应用余弦向量公式第一轮的待评估视频片段和用户输入的查询词之间的相似度分数计算。

18、进一步的,步骤3.1.4中下一轮的相似度分数的计算公式如下:

19、

20、

21、其中,veva指预先提取的下一轮待评估视频片段的特征向量,λ是自定义的一个小于1的常数,cosine(·)指余弦相似度,vqry指用户输入文本的特征向量,表示第i个正样本的特征向量,表示第j个负样本的特征向量,p和n分别代表正样本和负样本的数量;表示大预言模型生成的查询词的特征向量,κ是自定义的一个小于1的常数;score(veva)指更新完查询词前待评估视频片段的相似度分数,scorenew(veva)指更新完查询词后进行的新一轮排序中待评估视频片段的相似度分数。

22、进一步的,步骤3.2的具体实现方式如下;

23、步骤3.2.1,用户在前端的任务栏中上传图像,将图像传入bliip-2模型进行提取特征,得到特征向量,并与特征向量库中的特征向量进行相似度分数计算,并进行分数排序,将前n个结果传入前端并展示;

24、步骤3.2.2,用户对第一轮检索结果进行反馈,即进行标记正负样本、跳过、添加到提交列表,同时用户单击其中一张图像后,将会展示该图像前后的几帧和该图像所在视频的所有关键帧;

25、步骤3.2.3,用户对展示的帧进行反馈,并在反馈后利用上述的score(veva)公式重新计算相似度分数并获得新的排序结果,如果用户已经找到了目标视频,则可以在该图像前后的几帧,以及视频内所有关键帧中选择符合要求的帧;否则循环进行以上的反馈和重排过程,直至用户找到目标视频。

26、进一步的,步骤3.3的具体实现方式如下;

27、步骤3.3.1,用户在前端的任务栏中上传图像和输入问题,之后使用blip-2模型对图像进行视觉提取特征,并将其转化为文本描述;

28、步骤3.2.2,将文本描述和问题插入预先设计好的提示词中并传给大语言模型,生成针对用户检索意图的问题以供用户回答;

29、步骤3.1.3,用户根据需求对问题进行修改和提交操作。

30、本发明还提供基于大语言模型的交互式检索系统,包含以下模块:

31、数据准备模块,用于数据准备,首先基于现有的数据集,对所有视频进行切割分帧,并获得每个视频的所有关键帧;

32、特征向量提取模块,用于提取视频关键帧的文本特征向量和视觉特征向量,并将它们保存在特征向量数据库中;

33、检索模块,用于结合用户输入的信息,利用大语言模型在数据库中检索相关视频或生产相关问题,并对检索结果进行排序,具体包括如下子模块:

34、关键帧搜索子模块,用于根据用户输入的文本在数据集中检索符合描述的关键帧;

35、图像检索子模块,用于根据用户输入的图像检索该图像与数据集中最相似的视频帧;

36、答问子模块,用于根据用户输入的图像和问题,利用大语言模型生成相关问题引导用户进行反馈回答。

37、进一步的,关键帧搜索子模块的具体实现方式如下;

38、步骤3.1.1,用户在前端的检索框中输入文本描述,将文本描述转化为文本特征向量,然后应用余弦向量公式进行第一轮的待评估视频片段和用户输入的查询词之间的相似度分数计算,并进行排序,同时将前n个结果传递到前端,展示第一轮检索结果;

39、步骤3.1.2,用户对第一轮检索结果进行反馈,即进行标记正负样本、跳过、添加到提交列表操作;

40、步骤3.1.3,用户结束反馈后,将用户的反馈插入预先设计好的提示词并传递给大语言模型,生成针对用户检索意图的问题以供用户回答;

41、步骤3.1.4,用户结束回答后,将用户的回答情况和用户的反馈情况插入到预先设计好的提示词中并传递给大语言模型,生成一个更加准确的查询词来进行下一轮的相似度分数计算和结果重新排序;

42、步骤3.1.5,循环执行步骤3.1..1-3.1.4,直至用户结束检索过程。

43、进一步的,步骤3.1.4中下一轮的相似度分数的计算公式如下:

44、

45、

46、其中,veva指预先提取的下一轮待评估视频片段的特征向量,λ是自定义的一个小于1的常数,cosine(·)指余弦相似度,vqry指用户输入文本的特征向量,表示第i个正样本的特征向量,表示第j个负样本的特征向量,p和n分别代表正样本和负样本的数量;表示大预言模型生成的查询词的特征向量,κ是自定义的一个小于1的常数;score(veva)指更新完查询词前待评估视频片段的相似度分数,scorenew(veva)指更新完查询词后进行的新一轮排序中待评估视频片段的相似度分数。

47、本发明是一种基于大语言模型的交互式视频检索方法和系统,旨在提高对检索视频的准确性和高效性。该方法具有以下特点:1.大语言模型辅助:该方法利用大语言模型的强大语义理解能力来辅助视频检索。通过对大语言模型生成问题来深入理解用户的检索意图并更新查询来进一步改善检索结果。2.交互式检索:该方法支持交互式检索,用户可以通过自然语言提出查询或指令,系统会根据用户的输入和上下文提供相关的视频片段或推荐。用户可以与系统进行互动,即对结果进行反馈,进一步细化和调整检索结果,以满足其具体需求。3.多模态数据处理:该方法综合利用文本和视觉特征进行视频分析。除了文字内容,系统还会利用用户反馈的视频中的视觉信息。通过综合多模态数据,该方法能够更全面地理解用户的检索意图,提供更精准的检索结果。

本文地址:https://www.jishuxx.com/zhuanli/20240730/196985.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表