一种针对远距离高俯角下的安全帽佩戴检测方法

- 国知局

- 2024-07-31 23:21:54

本发明涉及深度神经网络的目标检测领域,具体涉及一种针对远距离高俯角下的安全帽佩戴检测方法。

背景技术:

1、在建筑工地的作业场景中,确保施工人员的安全已经成为至关重要的举措。为了履行这一安全义务,规定了施工人员在工作过程中必须佩戴安全帽,以保护他们免受潜在的危险。这一规定的背后是对工人在高处坠落或被掉落物体伤害的担忧,因为统计显示,脑外伤事故在建筑工地生产中属于相当常见的事故类型。佩戴安全帽的实施不仅仅是出于法规要求,更是为了有效地减少头部受伤的可能性。

2、目前的主流安全帽检测方法是通过深度学习模型训练后进行安全帽佩戴检测,现阶段,大多专家学者及企业基于先进的通用目标检测算法上进行改进设计,比如fasterr-cnn(fasterregion-basedconvolutionalneuralnetwork)、ssd(singleshotmultiboxdetector)、yolo(youonlylookonce)和无锚框centernet检测算法等。目前室外大多数建筑工地的云台摄像头是安装在制高点位置,因而采集到的是远距离高俯角场景下的安全帽佩戴情况的视频,这样做的目的是在减少云台摄像头数量而控制成本情况下,进行大范围的监管安全帽佩戴情况。在大范围拍摄的场景下图像中安全帽所占的像素少,属于小目标范畴,存在特征难以识别的问题,并且在室外拍摄到的图片容易受环境因素和拍摄设备自身因素影响产生安全帽小目标遮挡、与目标信息相似的背景噪声干扰和安全帽形变的问题。然而大部分技术改进都是通过开源数据集shwd(safetyhelmetwearingdataset)下进行训练,开源数据集shwd中数据图片并不是远距离高俯角下的实际建筑工地的图片,导致检测模型在实际远距离高俯角的建筑工地场景下仍存在检测精度低的问题。

3、发明专利申请公布号cn115131724a公开了一种适用于远距离高俯角的安全帽佩戴检测方法。其中安全帽佩戴检测网络主要由特征提取模块和特征映射模块组成,特征提取模块负责将输送到网络的安全帽图片进行特征提取,特征映射模块通过不断的叠加卷积层和上采样层,并与特征提取模块的csp层输出进行维度拼接,最后将预测框和类别映射到原图上。上述的方法有两个不足:特征提取模块中的第一个卷积层简单直接地将原始图像的尺寸进行压缩,维度进行提升,并没有在特征提取模块前期充分提取到安全帽小目标的关键信息,导致安全帽目标的漏检和误检,平均精度低;特征映射模块中采用特征融合时,特征提取模块中经过4次尺寸缩减的40×40特征图与特征映射模块中上采样之后的40×40特征图进行维度拼接,对于部分遮挡的安全帽小目标,4次尺寸缩减的高下采样倍数导致网络难以分辨目标的边缘,从而降低模型的平均检测精度。本发明中针对第一个不足设计stiem模块,采用1×1卷积核和不同分支的提取方式结合,有效解决安全帽小目标前期关键信息提取不充分的问题,有效提高平均检测精度;针对第二个不足设计ffm模块,在融合时采取含有更多遮挡目标的边缘信息的较低下采样的特征图,有效提高平均检测精度。

技术实现思路

1、本发明的目的在于克服现有远距离高俯角下的安全帽佩戴检测技术的不足,提供一种针对远距离高俯角下的安全帽佩戴检测方法,从而提高远距离高俯角下安全帽佩戴检测的检测精度,针对与目标信息相似的背景噪声干扰问题,在主干网络中n2、n3和n4特征层后引入cs模块,使主干网络更加关注安全帽目标关键位置信息和通道特征信息,减小背景噪声的关注度;针对主干网络前期安全帽小目标关键信息提取不充分问题,在主干网络中设计了stiem模块,采用小的卷积核和多分支的不同处理方式使主干网络充分提取安全帽小目标关键信息;针对安全帽小目标的遮挡问题,在上采样网络中设计ffm模块,采取含有更多遮挡目标的边缘信息的较低下采样的特征图有效缓解安全帽小目标的遮挡问题;针对安全帽形变问题,设计mdcm模块,有效利用周围环境信息定位和识别目标,减少模型对安全帽形状的依赖;针对回归的预测框不准确的问题,通过修改训练时的损失函数,引入包含预测框和真实目标框的最小框和突显位置中心权重,在反向传播中加快预测框向真实目标框的收敛速度以及使模型预测时预测框中心点的更拟合与真实目标框中心。

2、为实现上述目的,本发明的技术方案是:一种针对远距离高俯角下的安全帽佩戴检测方法,包括如下步骤:

3、步骤s1、构建实际工地的远距离高俯角下的安全帽数据集,并预处理;

4、步骤s2、构建改进的centernet安全帽佩戴检测网络模型;

5、步骤s3、将步骤s1得到的预处理过的安全帽数据集中训练总集作为真实结果输入步骤s2中构建的改进的centernet安全帽佩戴检测网络模型,依次通过改进的centernet安全帽佩戴检测网络模型中主干网络、上采样网络和预测网络,前向传播获得安全帽佩戴图像的预测结果,通过改进的centernet安全帽佩戴检测网络模型中修改后的损失函数计算预测结果和实际结果之间的损失值,并通过反向传播算法不断优化改进的centernet安全帽佩戴检测网络模型的参数;

6、步骤s4、用步骤s1得到的预处理过的安全帽数据集中测试集进行改进的centernet安全帽佩戴检测网络模型指标评估,采用准确率、召回率和平均精度进行效果评价;

7、步骤s5、利用步骤s4中平均精度最佳的改进的centernet安全帽佩戴检测网络模型,用处于制高点位置的云台摄像头的视频数据流作为改进的centernet安全帽佩戴检测网络模型输入进行远距离高俯角下的安全帽佩戴检测并生成安全帽佩戴与否的检测框,若佩戴安全帽的头部的检测框标记hat,未佩戴安全帽的头部的检测框标记为person。

8、在本发明一实施例中,步骤s1中,构建实际工地的远距离高俯角下的安全帽数据集,并预处理,具体为:用实际工地场景中处于制高点位置的云台摄像头进行大范围拍摄安全帽佩戴图像得到安全帽数据集,通过左右随机翻转、亮度调节、平移和裁剪的方式对安全帽数据集进行数据增强,之后将安全帽数据集按照比例9:1分为训练总集和测试集,再将训练总集按照比例9:1分为训练集和验证集,比例分配通过随机种子进行随机分配。

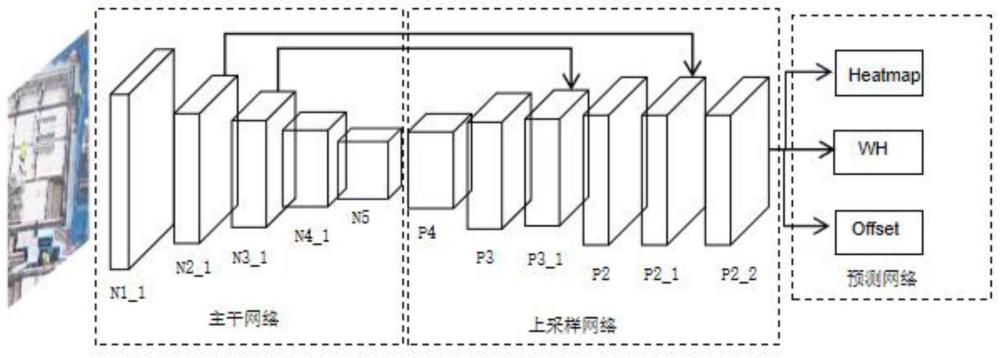

9、在本发明一实施例中,步骤s2中,所述改进的centernet安全帽佩戴检测网络模型是以centernet网络结构为核心加以改进所得,改进的centernet安全帽佩戴检测网络模型是在resnet-50主干网络中的n2、n3和n4层后引入cs模块,用stiem模块替换resnet-50主干网络中的n1层,在上采样网络中引入ffm模块,在上采样网络和预测网络之间插入mdcm模块,修改训练时的损失函数。

10、在本发明一实施例中,所述cs模块是利用ca空间注意力机制模块和se通道注意力机制模块串联组成,resnet-50主干网络中的n2、n3和n4特征层后引入cs模块后的输出特征层分别对应为n2_1、n3_1和n3_1特征层。

11、在本发明一实施例中,所述stiem模块先采用1×1卷积核卷积改变输入图片的特征层通道数,接着通过三条分支特征处理,第一条分支由依次连接的1×1卷积核卷积与bn层组成,第二条分支由依次连接的3×3卷积核卷积与bn层组成,第三条分支是通过bn层,将通过三条分支处理的特征层直接叠加后通过relu激活函数;然后采用3×3卷积核卷积进行特征层下采样;最后特征层通过cs模块处理后输出特征层为n1_1。

12、在本发明一实施例中,ffm模块是将主干网络中ni_1特征层和上采样网络中pi特征层作为输入特征层,其中i分别取2和3,通过1×1卷积核的cbr模块改变ni_1特征层的通道数等于pi特征层的通道数,将等同的两个特征层进行concat拼接,接着拼接的特征层通过1×1卷积核的cbr模块将其特征层通道数降为一半,最后特征层通过cs模块特征处理输出特征层分别为p2_1和p3_1特征层。

13、在本发明一实施例中,所述mdcm模块将p2_1为其输入特征层,接着通过四条分支特征处理,第一条分支是1×1卷积核卷积,第二条分支是3×3卷积核及空洞卷积率为2n的空洞卷积,第三条分支是3×3卷积核及空洞卷积率为5n的空洞卷积,第四条分支是3×3卷积核及空洞卷积率为10n的空洞卷积,将通过三条分支处理的特征层concat拼接后的特征层通过1×1卷积核的cbr模块将其特征层通道数降为四分之一,然后cbr模块输出的特征层与p2_1输入特征层进行残差相加,最后特征层通过cs模块处理后输出特征层为p2_2。

14、在本发明一实施例中,所述cbr模块是由conv2d卷积、bn层和relu激活函数组成。

15、在本发明一实施例中,所述损失函数分为三个部分:

16、

17、

18、

19、l=lk+λ1loff+λ2leiou公式四;

20、其中公式一表示关键点分类损失函数,用于解决训练样本不平衡问题,真实目标关键点通过高斯函数分布到热力图yxyc∈[0,1],其大小为表示预测目标关键点的热力图,n表示图像中目标的个数,α和β为超参数;公式二表示目标中心点损失函数,表示预测结果的偏移量,p表示目标在原图的真实坐标位置,r表示下采样倍数,表示p经过下采样r倍后取整的值;公式三表示真实目标框损失函数,iou表示真实目标框与预测框的交并比,ρ为欧几里得距离,b表示预测框的中心点;bgt表示真实目标框的中心点;w表示预测框的宽度;wgt是表示真实目标框的宽度;h表示预测框的高度;hgt表示真实目标框的高度;c表示覆盖预测框和真实目标框的最小外接框的对角线长度;cw表示覆盖预测框和真实目标框的最小外接框的宽度;ch表示覆盖预测框和真实目标框的最小外接框的高度;公式四表示的总的损失函数的组成,其中λ1和λ2为超参数。

21、上述损失函数针对回归的预测框不准确的问题,传统centernet模型损失函数只是单一地收敛预测框的中心、长和宽,没有考虑收敛回归的趋势方向,修改后的损失函数引入包含预测框和真实目标框的最小框和突显位置中心权重,在反向传播中加快预测框向真实目标框的收敛速度以及使模型预测时预测框中心点的更拟合与真实目标框中心,提高改进的centernet安全帽佩戴检测网络模型在远距离高俯角下的安全帽佩戴检测精度。

22、本发明还提供了一种针对远距离高俯角下的安全帽佩戴检测系统,包括存储器、处理器以及存储于存储器上并能够被处理器运行的计算机程序指令,当处理器运行该计算机程序指令时,能够实现如上述所述的方法步骤。

23、相较于现有技术,本发明具有以下有益效果:本发明针对远距离高俯角下的安全帽佩戴检测存在的问题,提出了不同的模块解决及缓解问题,提高改进的centernet安全帽佩戴检测网络模型在远距离高俯角下的安全帽佩戴检测精度;构建适用于实际工地的远距离高俯角下的安全帽图像数据集,使改进的centernet模型倾向于拟合该类数据集,解决目前远距离高俯角的安全帽数据集需求。

本文地址:https://www.jishuxx.com/zhuanli/20240730/197209.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

上一篇

基于神经网络的村庄分类法

下一篇

返回列表