视频生成方法、装置、存储介质和计算设备与流程

- 国知局

- 2024-08-02 14:17:57

本公开的实施方式涉及计算机,更具体地,本公开的实施方式涉及一种视频生成方法、装置、存储介质和计算设备。

背景技术:

1、本部分旨在为本公开的实施方式提供背景或上下文。此处的描述不因为包括在本部分中就承认是现有技术。

2、随着互联网的不断普及,人们通过网络就可以将要分享的音频分享给大家。为了吸引更多的人收听和了解音频,越来越多的采用视频形式来分享音频;例如,将音乐的音频制作成mv(music video)。

3、虽然采用视频形式分享音频能够取得较好的效果,但也存在相当的技术门槛。例如,为了能呈现吸引受众兴趣的视频,不仅需要花费大量的时间和精力搜集和筛选视频素材,而且还需要具备专业的视频编辑技能,从而能够对视频素材进行合理地编辑或者修改,实现生成的视频与音频相匹配。

技术实现思路

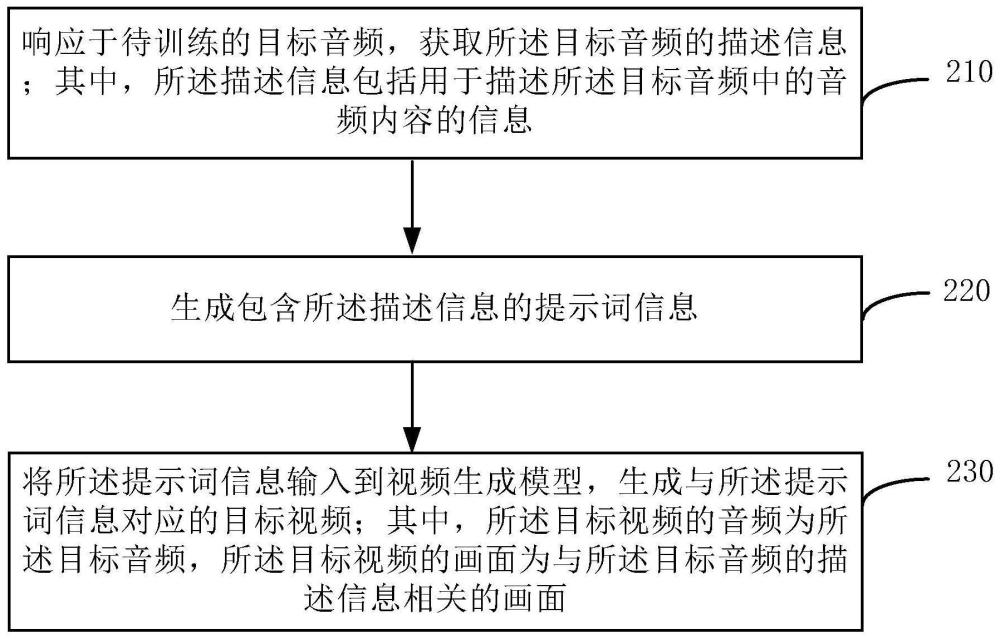

1、在本公开实施方式的第一方面中,提供了一种视频生成方法。所述方法包括:

2、响应于待训练的目标音频,获取所述目标音频的描述信息;其中,所述描述信息包括用于描述所述目标音频中的音频内容的信息;

3、生成包含所述描述信息的提示词信息;

4、将所述提示词信息输入到视频生成模型,生成与所述提示词信息对应的目标视频;其中,所述目标视频的音频为所述目标音频,所述目标视频的画面为与所述目标音频的描述信息相关的画面。

5、可选的,所述描述信息包括以下至少一种:

6、描述音频段落的第一信息;所述第一信息用于划分待生成的目标视频的视频分段;

7、描述音频情感的第二信息;所述第二信息用于确定待生成的目标视频中符合所述音频情感的视频元素;

8、描述音频曲风的第三信息;所述第三信息用于确定待生成的目标视频中符合所述音频曲风的视频元素;

9、描述音频节奏的第四信息;所述第四信息用于同步待生成的目标视频与目标音频的节奏。

10、可选的,针对所述描述音频段落的第一信息,所述获取所述目标音频的描述信息,包括:

11、基于注意力机制的神经网络模型从所述目标音频中提取音频段落,以及所述音频段落中使用的音乐元素;

12、将所述音乐元素输入到预设大语言模型,生成包含所述音乐元素且语义完整的第一信息。

13、可选的,针对所述描述音频情感的第二信息,所述获取所述目标音频的描述信息,包括:

14、采用预设算法从所述目标音频中提取表达音频情感的关键词;

15、将所述关键词输入到预设大语言模型,在所述关键词基础上生成描述音频情感的第二信息。

16、可选的,针对所述描述音频曲风的第三信息,所述获取所述目标音频的描述信息,包括:

17、基于注意力机制的神经网络模型从所述目标音频中提取音频特征;

18、将所述音频特征与预设曲风标签进行匹配,将匹配成功的预设曲风标签确定为描述音频曲风的第三信息。

19、可选的,针对所述描述音频节奏的第四信息,所述获取所述目标音频的描述信息,包括:

20、基于注意力机制的神经网络模型从所述目标音频中提取节拍点,统计所述节拍点的数量;

21、基于所述节拍点的数量和所述目标音频的时长,计算所述目标音频的单位节拍数,并将所述单位节拍数确定为描述音频节奏的第四信息。

22、可选的,所述视频生成模型通过以下方式训练得到:

23、获取用于训练的样本音频以及对应的样本视频;

24、获取所述样本音频的样本描述信息,以及生成包含所述样本描述信息的样本提示词信息;

25、将所述样本音频的样本提示词信息以及所述样本音频对应的样本视频输入到视频生成模型进行有监督训练,确定视频生成过程中前后两帧视频画面之间的第一损失函数和生成的视频与样本视频之间的第二损失函数。

26、可选的,还包括:

27、对生成的所述目标视频进行异常检测,确定所述目标视频中是否存在异常内容;

28、响应于所述目标视频中存在的异常内容,基于所述异常内容的异常描述信息调整所述提示词信息;

29、将调整后的提示词信息输入到所述视频生成模型,修正所述目标视频中存在的异常内容。

30、可选的,所述对生成的所述目标视频进行异常检测,包括:

31、采用检测模型对生成的所述目标视频进行异常检测;

32、其中,所述检测模型通过以下方式训练得到:

33、获取用于训练的存在异常内容的样本视频;其中,所述异常内容的样本视频标注有异常内容的异常描述信息;

34、将所述存在异常内容的样本视频输入到所述检测模型中进行有监督训练,确定所述检测模型输出的检测结果与标注的异常描述信息之间的损失函数。

35、可选的,所述检测模型输出的检测结果与标注的异常描述信息之间的损失函数包括交叉熵损失函数。

36、在本公开实施方式的第二方面中,提供了一种视频生成装置,所述装置包括:

37、获取单元,响应于待训练的目标音频,获取所述目标音频的描述信息;其中,所述描述信息包括用于描述所述目标音频中的音频内容的信息;

38、第一生成单元,生成包含所述描述信息的提示词信息;

39、第二生成单元,将所述提示词信息输入到视频生成模型,生成与所述提示词信息对应的目标视频;其中,所述目标视频的音频为所述目标音频,所述目标视频的画面为与所述目标音频的描述信息相关的画面。

40、可选的,所述描述信息包括以下至少一种:

41、描述音频段落的第一信息;所述第一信息用于划分待生成的目标视频的视频分段;

42、描述音频情感的第二信息;所述第二信息用于确定待生成的目标视频中符合所述音频情感的视频元素;

43、描述音频曲风的第三信息;所述第三信息用于确定待生成的目标视频中符合所述音频曲风的视频元素;

44、描述音频节奏的第四信息;所述第四信息用于同步待生成的目标视频与目标音频的节奏。

45、可选的,针对所述描述音频段落的第一信息,所述获取单元,包括:

46、第一获取子单元,基于注意力机制的神经网络模型从所述目标音频中提取音频段落,以及所述音频段落中使用的音乐元素;将所述音乐元素输入到预设大语言模型,生成包含所述音乐元素且语义完整的第一信息。

47、可选的,针对所述描述音频情感的第二信息,所述获取单元,包括:

48、第二获取子单元,采用预设算法从所述目标音频中提取表达音频情感的关键词;将所述关键词输入到预设大语言模型,在所述关键词基础上生成描述音频情感的第二信息。

49、可选的,针对所述描述音频曲风的第三信息,所述获取单元,包括:

50、第三获取子单元,基于注意力机制的神经网络模型从所述目标音频中提取音频特征;将所述音频特征与预设曲风标签进行匹配,将匹配成功的预设曲风标签确定为描述音频曲风的第三信息。

51、可选的,针对所述描述音频节奏的第四信息,所述获取单元,包括:

52、第四获取子单元,基于注意力机制的神经网络模型从所述目标音频中提取节拍点,统计所述节拍点的数量;基于所述节拍点的数量和所述目标音频的时长,计算所述目标音频的单位节拍数,并将所述单位节拍数确定为描述音频节奏的第四信息。

53、可选的,所述视频生成模型通过第一训练单元训练得到:

54、所述第一训练单元,获取用于训练的样本音频以及对应的样本视频;获取所述样本音频的样本描述信息,以及生成包含所述样本描述信息的样本提示词信息;将所述样本音频的样本提示词信息以及所述样本音频对应的样本视频输入到视频生成模型进行有监督训练,确定视频生成过程中前后两帧视频画面之间的第一损失函数和生成的视频与样本视频之间的第二损失函数。

55、可选的,还包括:

56、异常检测单元,对生成的所述目标视频进行异常检测,确定所述目标视频中是否存在异常内容;

57、异常修正单元,响应于所述目标视频中存在的异常内容,基于所述异常内容的异常描述信息调整所述提示词信息;将调整后的提示词信息输入到所述视频生成模型,修正所述目标视频中存在的异常内容。

58、可选的,所述异常检测单元,包括采用检测模型对生成的所述目标视频进行异常检测;

59、其中,所述检测模型通过第二训练单元训练得到:

60、所述第二训练单元,获取用于训练的存在异常内容的样本视频;其中,所述异常内容的样本视频标注有异常内容的异常描述信息;将所述存在异常内容的样本视频输入到所述检测模型中进行有监督训练,确定所述检测模型输出的检测结果与标注的异常描述信息之间的损失函数。

61、可选的,所述检测模型输出的检测结果与标注的异常描述信息之间的损失函数包括交叉熵损失函数。

62、在本公开实施方式的第三方面中,提供了一种计算机可读存储介质,包括:

63、当所述计算机可读存储介质中的指令由电子设备的处理器执行时,使得电子设备能够执行如前任一项所述的视频生成方法。

64、在本公开实施方式的第四方面中,提供了一种计算设备,包括:

65、处理器;

66、用于存储所述处理器可执行指令的存储器;

67、其中,所述处理器被配置为执行所述可执行指令,以实现如前任一项所述的视频生成方法。

68、根据本公开实施方式提供的视频生成方案,通过提取用于描述待训练的目标音频中的音频内容的描述信息,以该描述信息生成的提示词信息来指导视频生成模型自动生成与目标音频相匹配的目标视频。由于视频生成无需用户介入,即使用户不具备视频编辑能力也可以生成视频生成,因此能够提供无技术门槛的视频生成方案。

本文地址:https://www.jishuxx.com/zhuanli/20240801/242316.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表