基于动作追踪的细粒度视频行为识别方法

- 国知局

- 2024-10-15 10:06:01

本发明属于计算机视觉及图像处理领域,涉及采用深度卷积神经网络对视频进行细粒度的行为识别,具体涉及一种基于动作追踪的细粒度视频行为识别方法。

背景技术:

1、视频行为识别对于广泛的视觉分析应用具有重要意义,如智能监控、社交场景理解和体育视频分析。随着深度学习在各种视频识别任务上取得了巨大的成功,许多时空特征学习行为识别方法(如stm、tsm和i3d)和长期建模方法(如tcn、tdrn和slowfast)被提出用来做视频行为识别。为了提高运动模式感知的网络能力,tea(yan li,bin ji,xintianshi,jianguo zhang,bin kang,and limin wang.tea:temporal excitation andaggregation for action recognition.in ieee cvpr,june,pages 906–915,2020)利用特征水平的时间差异来激活运动敏感通道,形成一个用于行为识别的层次残差结构。tdn(limin wang,zhan tong,bin ji,and gangshan wu.tdn:temporal difference networksfor efficient action recognition.in ieee,cvpr,june,pages 1895–1904,2021)专注于明确地利用短期和长期运动建模之间的时间差异来捕获时间上下文。

2、由于在专业领域的许多人类活动之间只存在着细微的差异,行为识别最近已经发展到了更细粒度的水平。传统的行为识别主要侧重于识别物体和背景的视觉外观线索,如体操和篮球,而细粒度的行为识别则是在子类别水平上区分动作类别。例如,建立在高清体育视频上的现有细粒度数据集的动作对时间相关性比对象和背景更敏感。finegym数据集由各种微妙的方面组成,如姿势、移动范围和戏剧性的肢体变形。也就是说,细粒度的行为识别明显比传统的行为识别更具挑战性。

3、现有的行为识别框架通常集中于易于区分的片段,而忽略了局部动作细节的动态,最近的一些作品已经引起了人们对理解细粒度行为识别的细微差异的挑战的关注。例如,mdcn(baoli sun,xinchen ye,tiantian yan,zhihui wang,haojie li,and zhiyongwang.fine-grained action recognition with robust motion representationdecoupling and concentration.in the 30th acm mm,lisboa,portugal,october,pages4779–4788,2022)被提出通过将运动表征与动作相关的运动表征分离来学习不同的运动表征。dsts(tianjiao li,lin geng foo,qiuhong ke,hossein rahmani,anran wang,jinghua wang,and jun liu.dynamic spatio-temporal specialization learning forfine-grained action recognition.in eccv,october,part iv,volume 13664,pages386–403,2022)被提出通过一个动态时空专业化模块学习区分细粒度差异来区分这些相似的样本。此外,我们还注意到,一个动作视频的每一帧中最突出的信息通常分布在几个随时间演化的小局部区域中。虽然显式地定位和跟踪区分特定动作的局部区域作为辅助任务是一种简单的解决方案,但它通常缺乏区域级注释。因此,我们的目标是隐式地识别和跟踪独特的局部细节沿着时间维度。

技术实现思路

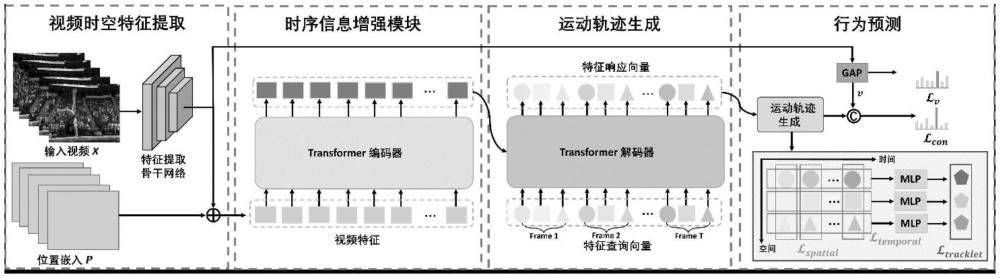

1、本发明旨在克服传统方法技术的不足,提出了一个基于动作追踪的细粒度视频行为识别网络。该网络由时序信息增强模块、空间区域语义激活模块和运动轨迹产生及行为预测模块组成。时序信息增强模块的通过将输入的特征送入到编码器当中,通过多头自注意力机制的计算实现对长时序特征增强,提升模型对长时序信息的能力。特定区域语义激活模块针对传统方法不能够关注到更细粒度的人体动作这一问题,提出挑选每一帧图片判别性区域的处理方案,挑选出视频中更有判别性的动作区域。运动轨迹产生及预测模块将所得到的轨迹特征向量沿时间维度进行拼接,得到最终的细粒度动作分类结果。

2、本发明的技术方案为,一种基于动作追踪的细粒度视频行为识别方法,所述方法包括下列步骤:

3、第一步,准备初始的训练数据:训练数据包括对视频分帧后的彩色图像序列;

4、第二步,时序信息增强模块的构建:时序信息增强模块由transformer编码器组成。transformer编码器利用自注意力机制增强时间上下文,以获得对于视频中长期时间依赖特性的关注;

5、第三步,空间区域语义激活模块的构建:空间区域语义激活模块由一个transformer解码器和一组可学习的特征查询向量组成。所述特征查询向量作为每个视频帧的区域查询,用于查询局部区域的细节,获得空间区域的语义响应;

6、第四步,运动轨迹生成及行为预测模块的构建:在获得所有视频帧的空间区域的语义响应之后,将这些响应重新排列以生成运动轨迹。这些运动轨迹与整个视频的全局表示集成,获得最终的行为预测结果;

7、第五步,构建损失函数并训练网络;

8、损失函数衡量训练数据中由输入视频预测的动作类别标签和真实类别标签的差距;

9、

10、其中,是一个监督学习损失,用于训练网络以提取行为识别相关的特征和建模全局行为表示。用于监督最终的行为识别结果,将运动轨迹与整个视频的全局表示集成,生成视频的最终预测结果。这个损失函数确保了轨迹表示和全局表示在预测时的一致性。表示多级轨迹对比损失,用于在空间、时间和轨迹级别上对区域感知语义响应进行自监督约束。λ是一个超参数,用于平衡多个损失函数之间的权重。网络训练过程即使用训练数据不断优化网络参数,使收敛得到最终的网络模型;

11、第六步,通过训练好的网络进行细粒度视频行为识别。

12、本发明的有益效果是:

13、本发明基于深度神经网络搭建的一个基于动作追踪的细粒度视频行为识别的框架,最终得到细粒度动作的分类结果,具有以下特点:

14、1、系统容易构建,能够识别人体细粒度的动作;

15、2、我们提出了一个动作轨迹网络来发现和跟踪视频帧中局部区域的独特细节,以丰富空间和时间上下文的编码,以便更好地推理细粒度的动作;

16、3、我们设计了一个多层次的轨迹对比损失来指导网络在空间、时间和轨迹水平上以有效的自我监督的方式准确地捕获动作细节;

17、4、实验结果在四个广泛使用的细粒度行为识别数据集中具有先进的优越性。

技术特征:1.基于动作追踪的细粒度视频行为识别方法,其特征在于,包括如下步骤:

2.根据权利要求1所述的基于动作追踪的细粒度视频行为识别方法,其特征在于,第一步中,在对视频分帧得到彩色图片序列后,对分帧后的彩色图片进行固定帧率的采样,再通进行数据增强。

3.根据权利要求1所述的基于动作追踪的细粒度视频行为识别方法,其特征在于,第二步中,时序信息增强模块由一个transformer编码器组成,transformer编码器利用自注意力机制增强时间上下文,以获得对于视频中长期时间依赖特性的关注;包括以下步骤:

4.根据权利要求1所述的基于动作追踪的细粒度视频行为识别方法,其特征在于,第三步具体为:空间区域语义激活模块的目的是从时间增强的区域表示中提取出视频帧中空间区域的语义响应;引入一组可学习的特征查询向量xq作为每个视频帧的区域查询,用于查询局部区域的细节,获得空间区域的语义响应;具体流程为:将时间增强的区域表示和特征查询向量输入到transformer解码器中,通过交叉注意力机制来捕捉区域特定的语义响应;其中交叉注意力操作crossatten(·)表达为:

5.根据权利要求1所述的基于动作追踪的细粒度视频行为识别方法,其特征在于,第四步具体为:运动轨迹生成及行为预测模块:在获得所有视频帧的空间区域的语义响应之后,将中同一顺序但不同帧的响应重新排列以生成运动轨迹,它链接了视频中沿时间维度的不同帧中的空间区域的细节,第m条轨迹trm的定义如下:

6.根据权利要求1所述的基于动作追踪的细粒度视频行为识别方法,其特征在于,第五步中构建损失函数:

技术总结本发明属于计算机视觉及图像处理领域,涉及采用深度卷积神经网络对视频分帧后的图片序列进行细粒度的动作分类,具体涉及一种基于动作追踪的细粒度视频行为识别方法。本发明程序简单,易于实现,能够获得能够识别人体细粒度的动作,对于人体的细粒度动作,可以隐式的通过建模动作的运动轨迹来发现和跟踪视频帧中局部区域的独特细节,以丰富空间和时间上下文的编码,以便更好地推理细粒度的动作。此外,本方法对于不同的层次使用多层次的轨迹对比损失来指导网络在空间、时间和轨迹水平上以有效的自我监督的方式准确地捕获动作细节。技术研发人员:王智慧,孙宝利受保护的技术使用者:大连理工大学技术研发日:技术公布日:2024/10/10本文地址:https://www.jishuxx.com/zhuanli/20241015/316423.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表