一种基于潜在域和类别多样性的图像分类方法及系统

- 国知局

- 2025-01-10 13:46:26

本发明涉及图像分类,尤其是涉及一种基于潜在域和类别多样性的图像分类方法及系统。

背景技术:

1、随着深度神经网络在图像分类、视频分析和图像语义分割等计算机视觉任务中的成功应用,如何在没有标注数据的目标域中实现高效模型迁移成为了亟待解决的问题。传统的有监督学习方法依赖于大规模带标签数据进行训练,当模型应用于与训练集分布不一致的目标域时,性能往往大幅下降。为此,无监督域自适应(uda)应运而生,其目的是通过源域带标签数据训练的模型在无标签的目标域上保持高泛化性。然而,由于源域与目标域分布差异显著,如何提取有效的跨域不变特征是uda领域的主要挑战之一。

2、目前,主流的uda方法主要包括基于对抗网络的域混淆方法和基于度量的域对齐方法。然而,这些方法要么无法提升特征的区分度,要么无法有效地捕捉类别级别的跨域差异。此外,已有研究还探索了通过生成对抗网络(gan)生成中间图像来作为源域和目标域的桥梁,但此类方法往往忽略了域间特征的结构性信息,从而影响了对齐效果。尽管已有方法引入了中间域来缓解源域和目标域的分布差异,但往往忽略了类别多样性和特征结构的连贯性,从而影响跨域识别效果。

3、在图像分类任务中,类别多样性最大化是实现模型泛化的重要策略。通过促进模型生成具有丰富类别分布的预测,能够显著提升模型对不同类别样本的区分能力。为此,亟需提出一种基于潜在域和类别多样性的图像分类方法,通过构建潜在域逐步对齐源域和目标域的分布,同时最大化类别多样性,进一步提升模型的跨域分类性能,提高图像分类精确度。

技术实现思路

1、为了解决上述提到的问题,本发明提供一种基于潜在域和类别多样性的图像分类方法及系统。通过生成结构一致的潜在域来缩小源域和目标域之间的分布差异,最大化类别多样性,实现精确的跨域对齐。

2、第一方面,本发明提供的一种基于潜在域和类别多样性的图像分类方法,采用如下的技术方案:

3、一种基于潜在域和类别多样性的图像分类方法,包括:

4、获取图像数据,包括获取源域和目标域的图像数据;

5、对源域和目标域的图像数据进行预处理;

6、构建域自适应图像分类模型;

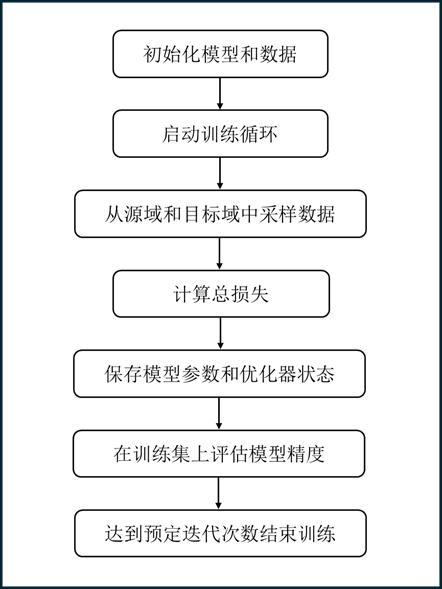

7、对构建的域自适应图像分类模型进行模型训练;

8、利用训练好的域自适应图像分类模型进行图像分类。

9、进一步地,所述获取源域和目标域的图像数据,包括获取带标签的图像数据集作为源域数据,用于训练模型;获取无标签的图像数据集作为目标域数据,用于测试模型的泛化能力,其中,源域数据存放在目录结构下,每个子目录代表一个类别,每个类别下有多张图像,目标域数据只包含输入图像。

10、进一步地,所述对源域和目标域的图像数据进行预处理,包括调整图像数据的大小,并对图像进行数据增强,以及对增强后的图像进行图像,裁剪和图像缩放,最后通过归一化使图像中的像素值分布符合标准正态分布。

11、进一步地,所述构建域自适应图像分类模型,包括构建一个潜在域,以连接源域和目标域,利用最大均值差异mmd来计算潜在域和目标域的全局分布差异,从而得到域级对齐损失,同时通过最大化预测分布的熵来鼓励类别平衡,最后通过小批次的方式进行类一致的伪标签生成,以增强类别一致性。

12、进一步地,所述构建域自适应图像分类模型,还包括使用监督学习和熵损失来优化源域和目标域的模型参数,其中,对于源域的数据,采用监督学习方法来训练分类器,对于目标域的数据,采用熵损失来最大化模型预测的不确定性,即熵。

13、进一步地,所述对构建的模型进行训练,包括利用源域的图像数据对模型进行初始训练,通过最小化源域分类损失,使模型获得对源域特征的分类能力;再引入潜在域生成、类级别对齐、域级别对齐和类别多样性最大化策略,对模型进行联合优化。

14、进一步地,所述利用训练好的模型进行图像分类,包括使用经过训练的模型对目标域的图像样本进行推理,其中,将目标域样本图像的特征首先映射至模型的分类头,通过分类头的多层网络结构输出类别概率分布,根据最大概率值确定样本的类别标签,由于标域没有类别标签,在对目标域进行图像分类时使用伪标签,其中伪标签生成基于目标域数据的预测概率分布。

15、第二方面,一种基于潜在域和类别多样性的图像分类系统,包括:

16、数据获取模块,被配置为,获取图像数据,包括获取源域和目标域的图像数据;

17、预处理模块,被配置为,对源域和目标域的图像数据进行预处理;

18、模型构建模块,被配置为,构建域自适应图像分类模型;

19、模型训练模块,被配置为,对构建的域自适应图像分类模型进行模型训练;

20、图像分类模块,被配置为,利用训练好的域自适应图像分类模型进行图像分类。

21、第三方面,本发明提供一种计算机可读存储介质,其中存储有多条指令,所述指令适于由终端设备的处理器加载并执行所述的一种基于潜在域和类别多样性的图像分类方法。

22、第四方面,本发明提供一种终端设备,包括处理器和计算机可读存储介质,处理器用于实现各指令;计算机可读存储介质用于存储多条指令,所述指令适于由处理器加载并执行所述的一种基于潜在域和类别多样性的图像分类方法。

23、综上所述,本发明具有如下的有益技术效果:

24、本发明通过生成潜在域来逐步对齐源域和目标域的分布差异,采用类级别和域级别的多层次对齐策略,使源域、潜在域和目标域在特征分布上实现一致性,显著提高了模型在跨域分类任务中的精度。同时,本发明引入基于熵的类别多样性损失项,防止目标域类别分布不均衡问题,增强了模型的类别区分能力和泛化能力。此外,类别驱动的小批次域翻译模块(cdbdt)在小批次级别生成类一致的伪标签,确保潜在域实例的类别一致性,从而提升了模型对类别结构的识别能力和跨域适应性。采用无监督领域适应技术,目标域无需人工标注,大幅降低了数据标注成本,使得该方法适用于多种无标注场景。通过整合源域分类损失、类级和域级对齐损失及类别多样性损失的联合训练策略,本发明显著提升了模型的训练效率和稳定性。综上所述,本发明在无监督领域适应的图像分类任务中表现出色,具备较强的泛化能力、精度和应用价值。

技术特征:1.一种基于潜在域和类别多样性的图像分类方法,其特征在于,包括:

2.根据权利要求1所述的一种基于潜在域和类别多样性的图像分类方法,其特征在于,所述获取源域和目标域的图像数据,包括获取带标签的图像数据集作为源域数据,用于训练模型;获取无标签的图像数据集作为目标域数据,用于测试模型的泛化能力,其中,源域数据存放在目录结构下,每个子目录代表一个类别,每个类别下有多张图像,目标域数据只包含输入图像。

3.根据权利要求2所述的一种基于潜在域和类别多样性的图像分类方法,其特征在于,所述对源域和目标域的图像数据进行预处理,包括调整图像数据的大小,并对图像进行数据增强,以及对增强后的图像进行图像,裁剪和图像缩放,最后通过归一化使图像中的像素值分布符合标准正态分布。

4.根据权利要求3所述的一种基于潜在域和类别多样性的图像分类方法,其特征在于,所述构建域自适应图像分类模型,包括构建一个潜在域,以连接源域和目标域,利用最大均值差异mmd来计算潜在域和目标域的全局分布差异,从而得到域级对齐损失,同时通过最大化预测分布的熵来鼓励类别平衡,最后通过小批次的方式进行类一致的伪标签生成,以增强类别一致性。

5.根据权利要求4所述的一种基于潜在域和类别多样性的图像分类方法,其特征在于,所述构建域自适应图像分类模型,还包括使用监督学习和熵损失来优化源域和目标域的模型参数,其中,对于源域的数据,采用监督学习方法来训练分类器,对于目标域的数据,采用熵损失来最大化模型预测的不确定性,即熵。

6.根据权利要求5所述的一种基于潜在域和类别多样性的图像分类方法,其特征在于,所述对构建的模型进行训练,包括利用源域的图像数据对模型进行初始训练,通过最小化源域分类损失,使模型获得对源域特征的分类能力;再引入潜在域生成、类级别对齐、域级别对齐和类别多样性最大化策略,对模型进行联合优化。

7.根据权利要求6所述的一种基于潜在域和类别多样性的图像分类方法,其特征在于,所述利用训练好的模型进行图像分类,包括使用经过训练的模型对目标域的图像样本进行推理,其中,将目标域样本图像的特征首先映射至模型的分类头,通过分类头的多层网络结构输出类别概率分布,根据最大概率值确定样本的类别标签,由于标域没有类别标签,在对目标域进行图像分类时使用伪标签,其中伪标签生成基于目标域数据的预测概率分布。

8.一种基于潜在域和类别多样性的图像分类系统,其特征在于,包括:

9.一种计算机可读存储介质,其中存储有多条指令,其特征在于,所述指令适于由终端设备的处理器加载并执行如权利要求1所述的方法。

10.一种终端设备,包括处理器和计算机可读存储介质,处理器用于实现各指令;计算机可读存储介质用于存储多条指令,其特征在于,所述指令适于由处理器加载并执行如权利要求1所述的方法。

技术总结本发明涉及图像分类技术领域,尤其是涉及一种基于潜在域和类别多样性的图像分类方法及系统。方法,包括获取图像数据,包括获取源域和目标域的图像数据;对源域和目标域的图像数据进行预处理;构建域自适应图像分类模型;对构建的域自适应图像分类模型进行模型训练;利用训练好的域自适应图像分类模型进行图像分类。本发明通过生成潜在域来逐步对齐源域和目标域的分布差异,采用类级别和域级别的多层次对齐策略,使源域、潜在域和目标域在特征分布上实现一致性,显著提高了模型在跨域分类任务中的精度。技术研发人员:王梦如,刘惊雷受保护的技术使用者:烟台大学技术研发日:技术公布日:2025/1/6本文地址:https://www.jishuxx.com/zhuanli/20250110/355159.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表