声纹识别方法、声纹模型训练方法、装置、设备及介质与流程

- 国知局

- 2024-06-21 10:40:59

本发明涉及声纹识别,尤其涉及一种声纹识别方法、声纹模型训练方法、装置、电子设备及计算机可读存储介质。

背景技术:

1、随着科学技术的发展,以及深度学习的广泛应用,传统的声纹识别算法也被神经网络所替代,其目的就是为了提取更有效的声纹特征,更多的关注到与说话人有关的信息,减少与说话人无关的信息,提升声纹识别的性能。声纹识别技术以其独特的方便性、经济性和准确性等优势受到世人瞩目,并日益成为人们日常生活和工作中重要且普及的安全验证方式。比如应用于安全非常敏感的场景,安防领域等,对抗样本攻击可能会造成很大的安全隐患。因此,声纹识别对抗样本防御是非常有必要的。

2、现实场景下声纹模型性能一般较差,尤其是面对对抗样本时,声纹模型容易误判,导致系统安全性遭到破坏。目前采用的对抗样本比较单一,声纹模型能针对单一样本做到较好的防御。但是相关技术中,对抗样本具有多种多样的形式,系统很难应付所有样本的攻击。因此,如何提升声纹模型的准确性和安全性,使声纹模型能够对对抗样本具有很好的鲁棒性,从而对系统的安全性得到加固是一个值得探索的问题。

技术实现思路

1、本发明提供一种声纹识别方法、声纹模型训练方法、装置、设备及介质,以至少解决相关技术中由于声纹模型很难对抗多种多样的对抗样本的攻击,导致系统准确性和安全性降低的技术问题。本发明的技术方案如下:

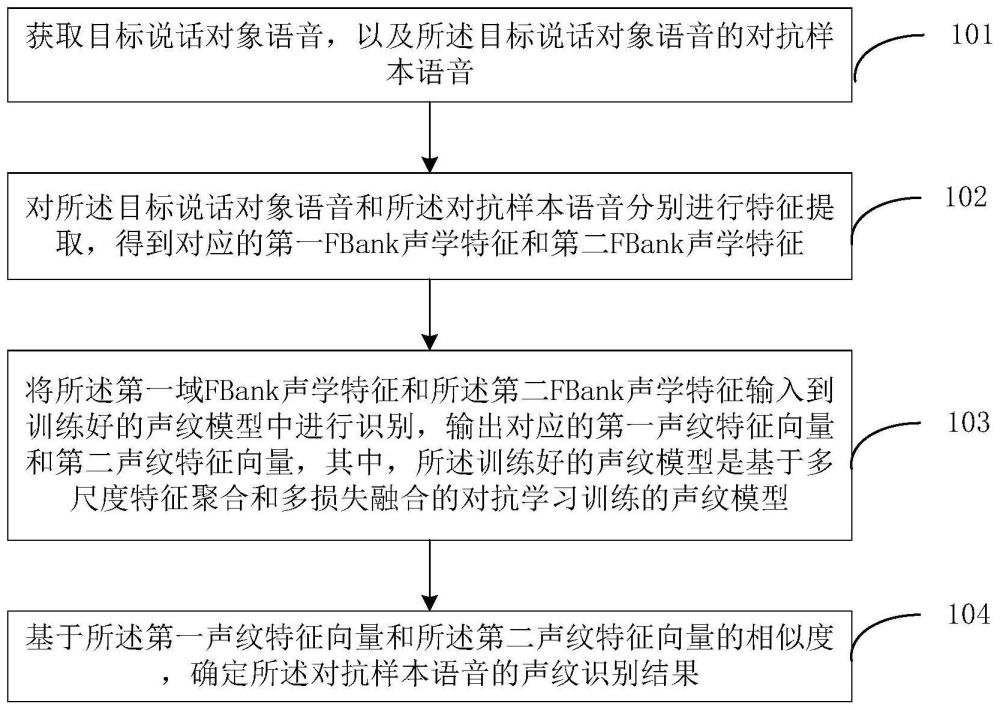

2、根据本发明实施例的第一方面,提供一种声纹识别方法,包括:

3、获取目标说话对象语音,以及所述目标说话对象语音的对抗样本语音;

4、对所述目标说话对象语音和所述对抗样本语音分别进行特征提取,得到对应的第一fbank声学特征和第二fbank声学特征;

5、将所述第一fbank声学特征和所述第二fbank声学特征输入到训练好的声纹模型中进行识别,输出对应的第一声纹特征向量和第二声纹特征向量,其中,所述训练好的声纹模型是基于多尺度特征聚合和多损失融合的对抗学习训练的声纹模型;

6、基于所述第一声纹特征向量和所述第二声纹特征向量的相似度,确定所述对抗样本语音的声纹识别结果。

7、可选的,所述基于所述第一声纹特征向量和第二声纹特征向量的相似度,确定所述对抗样本语音的声纹识别结果,包括:

8、确定所述第一声纹特征向量和第二声纹特征向量的余弦距离;

9、根据所述余弦距离确定所述第一声纹特征向量与所述第二声纹特征向量的相似度;

10、在所述相似度大于设定阈值时,确定所述对抗样本语音来源于所述目标说话对象语音的目标说话对象。

11、可选的,在对所述目标说话对象语音和所述对抗样本语音进行特征提取之前,所述方法还包括:

12、对所述目标说话对象语音和所述对抗样本语音分别进行语音活动检测,得到对应的有效目标说话对象语音和有效对抗样本语音;

13、对所述有效目标说话对象语音和所述有效对抗样本语音进行预处理;

14、所述对所述目标说话对象语音和所述对抗样本语音进行特征提取包括:对所述预处理后的有效目标说话对象语音和有效对抗样本语音进行特征提取,得到对应的第一fbank声学特征和第二fbank声学特征。

15、可选的,所述方法还包括:预先基于多尺度特征聚合和多损失融合对声纹模型进行训练,得到训练好的声纹模型,包括:

16、获取模型训练数据集,所述模型训练数据集包括:由语音数据集,所述语音数据集的增强数据集,所述语音数据集的第一对抗样本数据集和所述语音数据集的第二对抗样本数据集中的至少两种所组成的训练数据;

17、对所述模型训练数据集中的每种训练数据的fbank声学特征进行区域特征增强处理;

18、对区域特征增强处理后的所述fbank声学特征进行多尺度特征聚合,得到1536维的说话对象特征向量;

19、对所述1536维的说话对象特征向量分别进行多损失融合,并将多损失融合结果的均值作为训练损失值;

20、基于所述训练损失值进行迭代训练,直达迭代训练得到训练损失值小于训练预设值时停止训练,得到训练好的声纹模型。

21、根据本发明实施例的第二方面,提供一种声纹模型训练方法,包括:

22、获取声纹模型训练数据集,所述声纹模型训练数据集包括:由语音数据集,所述语音数据集的增强数据集,所述语音数据集的第一对抗样本数据集和所述语音数据集的第二对抗样本数据集中的至少两种所组成的训练数据;

23、对所述模型训练数据集中的每种训练数据的fbank声学特征进行区域特征增强处理;

24、对区域特征增强处理后的所述fbank声学特征进行多尺度特征聚合,得到1536维的说话对象特征向量;

25、对所述1536维的说话对象特征向量分别进行多损失融合,并将多损失融合结果的均值作为训练损失值;

26、基于所述训练损失值进行迭代训练,直达迭代训练得到训练损失值小于训练预设值时停止训练,得到训练好的声纹模型。

27、可选的,所述对所述声纹模型训练数据集中的每种训练数据的fbank声学特征进行区域特征增强处理,包括:

28、对所述声纹模型训练数据集中的每种训练数据的fbank声学特征通过下采样进行降维处理;

29、利用选择性核注意力特征增强方式对降维处理后的所述每种训练数据的fbank声学特征进行区域特征增强处理。

30、可选的,所述利用选择性核注意力特征增强方式对降维处理后的所述每种训练数据的fbank声学特征进行区域特征增强处理,包括:

31、利用选择性核注意力特征增强机制中的分离、融合和聚合对降维处理后的所述每种训练数据的fbank声学特征进行区域特征增强处理。

32、可选的,所述对区域特征增强处理后的所述fbank声学特征进行多尺度特征聚合,得到1536维的说话对象特征向量,包括:

33、将区域特征增强处理后的所述fbank声学特征依次通过多个conformer块进行卷积处理,得到卷积处理后的特征;

34、将所述多个conformer块中每个conformer块输出的特征,所述卷积处理后的特征,以及区域特征增强处理后的所述fbank声学特征进行聚合,得到不同隐藏层的特征;

35、利用注意力统计池化层对聚合后得到不同隐藏层的特征分配不同的权重值;

36、通过批量标准化bn层,对不同隐藏层的特征及对应权重值的乘积结果进行多尺度特征聚合,得到1536维的说话对象特征向量。

37、可选的,所述对所述1536维的说话对象特征向量分别进行多损失融合,并将多损失融合结果的均值作为训练损失值,包括:

38、将所述1536维的说话对象特征向量依次通过第一全连接层和第二全连接层处理;

39、将所述第二全连接层的处理结果进行分类损失计算,得到分类损失结果;

40、将所述第一全连接层的处理结果进行度量损失计算,得到度量损失结果;

41、计算所述分类损失结果和度量损失结果的调和平均值,并将所述调和平均值作为整个模型的训练损失值。

42、可选的,在获取声纹模型训练数据集之前,所述方法还包括:

43、获取语音数据集;

44、对所述语音数据集进行语音活动检测处理和预处理,得到预处理后的语音数据集;

45、对所述预处理后的语音数据集进行数据增强处理,得到所述语音数据集的增强数据集;

46、对所述增强数据集进行特征提取,并对特征提取后的增强数据集增加噪声处理,得到第一对抗样本数据集;

47、对所述预处理后的语音数据集进行特征提取,并对特征提取后的增强数据集增加噪声处理,得到第二对抗样本数据集;

48、将所述语音数据集,所述增强数据集,所述第一对抗样本数据集和所述第二对抗样本数据集存储到训练数据库中。

49、根据本发明实施例的第三方面,提供一种声纹识别装置,包括:

50、第一获取模块,用于获取目标说话对象语音,以及所述目标说话对象语音的对抗样本语音;

51、提取模块,用于对所述目标说话对象语音和所述对抗样本语音分别进行特征提取,得到对应的第一fbank声学特征和第二fbank声学特征;

52、识别模块,用于将所述第一fbank声学特征和所述第二fbank声学特征输入到训练好的声纹模型中进行识别,输出对应的第一声纹特征向量和第二声纹特征向量,其中,所述训练好的声纹模型是基于多尺度特征聚合和多损失融合的对抗学习训练的声纹模型;

53、确定模块,用于基于所述第一声纹特征向量和所述第二声纹特征向量的相似度,确定所述对抗样本语音的声纹识别结果。

54、可选的,所述确定模块包括:

55、距离确定模块,用于确定所述第一声纹特征向量和第二声纹特征向量的余弦距离;

56、相似度确定模块,用于根据所述余弦距离确定所述第一声纹特征向量与所述第二声纹特征向量的相似度;

57、对象确定模块,用于在所述相似度确定模块确定的相似度大于设定阈值时,确定所述对抗样本语音来源于所述目标说话对象语音的目标说话对象。

58、可选的,所述装置还包括:

59、检测模块,用于在所述提取模块在对所述目标说话对象语音和所述对抗样本语音进行特征提取之前,对所述目标说话对象语音和所述对抗样本语音分别进行语音活动检测,得到对应的有效目标说话对象语音和有效对抗样本语音;

60、预处理模块,用于对所述有效目标说话对象语音和所述有效对抗样本语音进行预处理;

61、所述提取模块,具体用于对所述预处理后的有效目标说话对象语音和有效对抗样本语音进行特征提取,得到对应的第一fbank声学特征和第二fbank声学特征。

62、可选的,所述装置还包括训练模块,所述训练模块包括:

63、第二获取模块,用于获取模型训练数据集,所述模型训练数据集包括:由语音数据集,所述语音数据集的增强数据集,所述语音数据集的第一对抗样本数据集和所述语音数据集的第二对抗样本数据集中的至少两种所组成的训练数据;

64、增强模块,用于提取所述模型训练数据集中的每种训练数据的fbank声学特征,并对每种训练数据的fbank声学特征进行区域特征增强处理;

65、聚合模块,用于对区域特征增强处理后的所述fbank声学特征进行多尺度特征聚合,得到1536维的说话对象特征向量;

66、融合模块,用于对所述1536维的说话对象特征向量分别进行多损失融合,并将多损失融合结果的均值作为训练损失值;

67、迭代训练模块,用于基于所述训练损失值进行迭代训练,直达迭代训练得到训练损失值小于训练预设值时停止训练,得到训练好的声纹模型。

68、根据本发明实施例的第四方面,提供一种声纹模型训练装置,包括:

69、第一获取模块,用于获取声纹模型训练数据集,所述声纹模型训练数据集包括:由语音数据集,所述语音数据集的增强数据集,所述语音数据集的第一对抗样本数据集和所述语音数据集的第二对抗样本数据集中的至少两种所组成的训练数据;

70、增强模块,用于所述模型训练数据集中的每种训练数据的fbank声学特征进行区域特征增强处理;

71、聚合模块,用于对区域特征增强处理后的所述fbank声学特征进行多尺度特征聚合,得到1536维的说话对象特征向量;

72、融合模块,用于对所述1536维的说话对象特征向量分别进行多损失融合,并将多损失融合结果的均值作为训练损失值;

73、迭代训练模块,用于基于所述训练损失值进行迭代训练,直达迭代训练得到训练损失值小于训练预设值时停止训练,得到训练好的声纹模型。

74、可选的,所述增强模块包括:

75、下采样模块,用于对所述声纹模型训练数据集中的每种训练数据的fbank声学特征通过下采样进行降维处理;

76、特征增强模块,用于利用选择性核注意力特征增强方式对降维处理后的所述每种训练数据的fbank声学特征进行区域特征增强处理。

77、可选的,所述特征增强模块,具体用于利用选择性核注意力特征增强机制中的分离、融合和聚合对降维处理后的所述每种训练数据的fbank声学特征进行区域特征增强处理。

78、可选的,所述聚合模块包括:

79、卷积处理模块,用于将区域特征增强处理后的所述fbank声学特征依次通过多个conformer块进行卷积处理,得到卷积处理后的特征;

80、第一特征聚合模块,用于将所述多个conformer块中每个conformer块输出的特征,所述卷积处理后的特征,以及区域特征增强处理后的所述fbank声学特征进行聚合,得到不同隐藏层的特征;

81、权值分配模块,用于利用注意力统计池化层对聚合后得到不同隐藏层的特征分配不同的权重值;

82、第二特征聚合模块,用于通过bn层,对不同隐藏层的特征及对应权重值的卷积进行多尺度特征聚合,得到1536维的说话对象特征向量。

83、可选的,所述融合模块包括:

84、全连接处理模块,用于将所述1536维的说话对象特征向量依次通过第一全连接层和第二全连接层处理;

85、分类损失计算模块,用于将所述第二全连接层的处理结果进行分类损失计算,得到分类损失结果;

86、度量损失计算模块,用于将所述第一全连接层的处理结果进行度量损失计算,得到度量损失结果;

87、损失融合模块,用于计算所述分类损失结果和度量损失结果的调和平均值,并将所述调和平均值作为整个模型的训练损失值。

88、可选的,所述装置还包括:

89、第二获取模块,用于在所述第一获取模块获取声纹模型训练数据集之前,获取语音数据集;

90、预处理模块,用于对所述语音数据集进行语音活动检测处理和预处理,得到预处理后的语音数据集;

91、增强模块,用于对所述预处理后的语音数据集进行数据增强处理,得到所述语音数据集的增强数据集;

92、第一特征处理模块,用于对所述增强数据集进行特征提取,并对特征提取后的增强数据集增加噪声处理,得到第一对抗样本数据集;

93、第二特征处理模块,用于对所述预处理后的语音数据集进行特征提取,并对特征提取后的增强数据集增加噪声处理,得到第二对抗样本数据集;

94、存储模块,用于将所述语音数据集,所述增强数据集,所述第一对抗样本数据集和所述第二对抗样本数据集存储到训练数据库中。

95、根据本发明实施例的第五方面,提供一种电子设备,包括:

96、处理器;

97、用于存储所述处理器可执行指令的存储器;

98、其中,所述处理器被配置为执行所述指令,以实现如上所述的声纹识别方法或如上所述的声纹模型训练方法。

99、根据本发明实施例的第六方面,提供一种计算机可读存储介质,其特征在于,当所述计算机可读存储介质中的指令由电子设备的处理器执行时,使得电子设备能够执行如如上所述的声纹识别方法或如如上所述的声纹模型训练方法。

100、根据本发明实施例的第七方面,提供一种计算机程序产品,包括计算机程序或指令,所述计算机程序或指令被电子设备的处理器执行时实现如上所述的声纹识别方法或如上所述的声纹模型训练方法。

101、本发明的实施例提供的技术方案至少带来以下有益效果:

102、本发明实施例中,获取目标说话对象的语音和语音的对抗样本后,对语音和对抗样本进行特征提取,得到第一fbank声学特征和第二fbank声学特征;将第一fbank声学特征和第二fbank声学特征输入到训练好的声纹模型中进行识别,输出第一声纹特征向量和第二声纹特征向量,所述训练好的声纹模型是基于多尺度特征聚合和多损失融合的对抗学习训练的声纹模型;基于第一声纹特征向量和第二声纹特征向量的相似度,确定对抗样本的识别结果。通过本发明提供的方法,可以快速准确的确定语音和对抗样本是否属于同一个说话对象,从而提高了声纹识别的准确率。

103、应当理解的是,以上的一般描述和后文的细节描述仅是示例性和解释性的,并不能限制本发明。

本文地址:https://www.jishuxx.com/zhuanli/20240618/21178.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表