流式语音识别及模型训练方法、装置、计算机设备与流程

- 国知局

- 2024-06-21 10:42:28

本发明涉及语音识别,具体而言,涉及一种流式语音识别及模型训练方法、装置、计算机设备。

背景技术:

1、在实时消音系统中,系统需要在话者说话的同时进行实时识别。这就要求系统能够实时且准确地识别内容,正确地定位需要消音的违规部分。但是,如果识别结果不准确,可能会带来两个问题:一是误消音,这会影响用户的观看体验;二是未消音,直接曝光违规内容。同时,识别速度也是一个重要环节。如果识别延迟过大,可能来不及对违规内容进行实时消音处理,直接将违规内容暴露出来,从而产生内容安全隐患。

2、因此,对于实时消音系统来说,采用的流式语音识别技术需要同时满足两个关键条件:一是识别延迟需要足够低,能够实现实时识别;二是识别准确率需要较高,减少误操作的可能性。只有兼顾这两个方面,系统才能真正实现实时自动消音,实现内容安全监管的目的。如果识别效果不能即时和准确,很可能会导致用户体验差或内容安全事件的发生,对系统和用户都不利。

3、目前的实时消音系统通常会采用一种端到端的深度学习语音识别模型,比如wenet流式语音识别模型。然而wenet流式语音识别模型的常规训练方法使得模型仍然存在较高的字错误率和输出延迟,导致实时消音系统中的语音识别的准确性和实时性无法满足要求。

技术实现思路

1、本发明的目的之一在于提供了一种流式语音识别及模型训练方法、装置、计算机设备,用于提升流式语音识别的识别准确率且降低输出延迟。本发明的实施例可以这样实现:

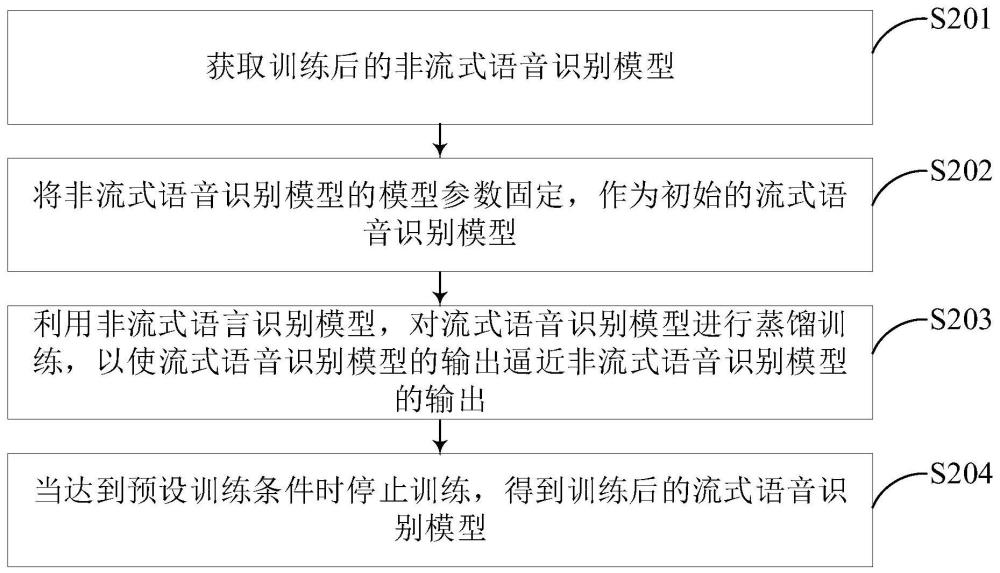

2、第一方面,本发明提供一种流式语音识别模型训练方法,所述方法包括:获取训练后的非流式语音识别模型;所述非流式语音识别模型的识别准确度和输出延迟均满足预设指标;将所述非流式语音识别模型的模型参数固定,作为初始的流式语音识别模型;利用所述非流式语音识别模型,对所述流式语音识别模型进行蒸馏训练,以使所述流式语音识别模型的输出逼近所述非流式语音识别模型的输出;当达到预设训练条件时停止训练,得到训练后的所述流式语音识别模型。

3、在可选的实施方式中,所述流式语音识别模型包括第一ctc解码器和第一attention解码器;所述非流式语音识别模型包括第二ctc解码器和第二attention解码器;利用所述非流式语音识别模型,对所述流式语音识别模型进行蒸馏训练,以使所述流式语音识别模型的输出逼近所述非流式语音识别模型的输出,包括:在训练过程中,确定所述第一ctc解码器和所述第二ctc解码器各自的输出之间的第一知识蒸馏损失、所述第一attention解码器和所述第二attention解码器各自的输出之间的第二知识蒸馏损失以及所述第一ctc解码器和所述第一attention解码器之间的融合损失;联合所述第一知识蒸馏损失、所述第二知识蒸馏损失以及所述融合损失调整所述流式语音识别模型的模型参数,以使所述流式语音识别模型的输出逼近所述非流式语音识别模型的输出。

4、在可选的实施方式中,确定所述第一ctc解码器和所述第二ctc解码器各自的输出之间的第一知识蒸馏损失,包括:确定所述第一ctc解码器和所述第二ctc解码器之间的输出延迟偏移量;针对每个训练音频样本,根据所述输出延迟偏移量以及所述第一ctc解码器和所述第二ctc解码器各自输出的每个字符的概率,确定所述第一知识蒸馏损失。

5、在可选的实施方式中,确定所述第一ctc解码器和所述第二ctc解码器之间的输出延迟偏移量,包括:针对每个训练音频样本,计算所述第一ctc解码器和所述第二ctc解码器在不同偏移量预设值下输出的字符重合比例,并将最大字符重合比例对应的所述偏移量预设值作为所述输出延迟偏移量。

6、在可选的实施方式中,确定所述第一attention解码器和所述第二attention解码器各自的输出之间的第二知识蒸馏损失,包括:针对每个训练音频样本,根据所述第一attention解码器和所述第二attention解码器各自的每个输出中包含的每个字符的概率,计算所述第二知识蒸馏损失。

7、在可选的实施方式中,确定所述第一ctc解码器和所述第一attention解码器之间的融合损失,包括:根据预设的平衡因子将所述第一ctc解码器的ctc损失和所述第一attention解码器的attention encoder-decoder损失进行融合,得到所述融合损失。

8、第二方面,本发明提供一种流式语音识别方法,包括:获取待识别音频;将所述待识别音频输入训练后的流式语音识别模型中进行语音识别,得到所述待识别音频对应的识别文本;其中,所述流式语音识别模型是通过如前述实施方式任一项所述的流式语音识别模型训练方法得到的;所述识别文本的识别准确度和输出延迟满足预设指标。

9、第三方面,本发明提供一种流式语音识别模型训练装置,包括:获取模块,用于获取训练后的非流式语音识别模型;所述非流式语音识别模型的识别准确度和输出延迟均满足预设的语音识别指标;确定模块,用于将所述非流式语音识别模型的模型参数固定,作为初始的流式语音识别模型;训练模块,用于对所述流式语音识别模型进行蒸馏训练,以使所述流式语音识别模型的输出逼近所述非流式语音识别模型的输出;所述训练模块,还用于当达到预设训练条件时停止训练,得到训练后的所述流式语音识别模型。

10、第四方面,本发明提供一种流式语音识别装置,包括:获取模块,用于获取待识别音频;识别模块,用于将所述待识别音频输入训练后的流式语音识别模型中进行语音识别,得到所述待识别音频对应的识别文本;其中,所述流式语音识别模型是通过如前述实施方式任一项所述的流式语音识别模型训练方法得到的;所述识别文本的识别准确度和输出延迟满足预设指标。

11、第五方面,本发明提供一种计算机设备,所述设备包括处理器和存储器,所述存储器中存储有至少一条指令或至少一段程序,所述至少一条指令或所述至少一段程序由所述处理器加载并执行以实现如前述第一方面和第二方面所述的方法。

12、本发明提供的流式语音识别及模型训练方法、装置、计算机设备,首先获取训练好的非流式语音识别模型。由于该模型的识别准确率和输出延迟在训练之后已经满足要求,它可以作为流式语音识别模型蒸馏训练的教师模型。然后,利用该非流式语音识别模型对流式语音识别模型进行蒸馏训练。在训练过程中,通过最小化流式语音识别模型与非流式语音识别模型输出的差异来进行优化,使流式语音识别模型的识别结果越来越接近非流式高质量模型。一旦达到预设训练条件之后,结束此次蒸馏训练过程,从而得到一个识别准确度高且输出延迟低的流式语音识别模型。本发明利用已有的高质量非流式语音识别模型,通过知识蒸馏的方法来提升流式语音识别模型的效果,相比直接从零开始训练,在保证流式语音识别模型实时性的同时也可以很大程度上提升其识别性能。以此方式训练得到的流式语音识别模型,既可以实现低延时的流式识别,又保证了识别质量。

技术特征:1.一种流式语音识别模型训练方法,其特征在于,所述方法包括:

2.根据权利要求1所述的流式语音识别模型训练方法,其特征在于,所述流式语音识别模型包括第一ctc解码器和第一attention解码器;所述非流式语音识别模型包括第二ctc解码器和第二attention解码器;

3.根据权利要求2所述的流式语音识别模型训练方法,其特征在于,确定所述第一ctc解码器和所述第二ctc解码器各自的输出之间的第一知识蒸馏损失,包括:

4.根据权利要求3所述的流式语音识别模型训练方法,其特征在于,确定所述第一ctc解码器和所述第二ctc解码器之间的输出延迟偏移量,包括:

5.根据权利要求2所述的流式语音识别模型训练方法,其特征在于,确定所述第一attention解码器和所述第二attention解码器各自的输出之间的第二知识蒸馏损失,包括:

6.根据权利要求2所述的流式语音识别模型训练方法,其特征在于,确定所述第一ctc解码器和所述第一attention解码器之间的融合损失,包括:

7.一种流式语音识别方法,其特征在于,包括:

8.一种流式语音识别模型训练装置,其特征在于,包括:

9.一种流式语音识别装置,其特征在于,包括:

10.一种计算机设备,其特征在于,所述设备包括处理器和存储器,所述存储器中存储有至少一条指令或至少一段程序,所述至少一条指令或所述至少一段程序由所述处理器加载并执行以实现如权利要求1至7中任一项所述的方法。

技术总结本发明提供的流式语音识别及模型训练方法、装置、计算机设备,获取训练后的非流式语音识别模型;非流式语音识别模型的识别准确度和输出延迟均满足预设指标;将非流式语音识别模型的模型参数固定,作为初始的流式语音识别模型;利用非流式语音识别模型,对流式语音识别模型进行蒸馏训练,以使流式语音识别模型的输出逼近非流式语音识别模型的输出;当达到预设训练条件时停止训练,得到训练后的流式语音识别模型。本发明利用已有的高质量非流式语音识别模型,通过知识蒸馏的方法来提升流式语音识别模型的效果,相比直接从零开始训练,本发明训练得到的流式语音识别模型,既可以实现低延时的流式识别,又保证了识别质量。技术研发人员:陈凯斌受保护的技术使用者:广州虎牙科技有限公司技术研发日:技术公布日:2024/2/1本文地址:https://www.jishuxx.com/zhuanli/20240618/21368.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

上一篇

一种降噪装置的制作方法

下一篇

返回列表