基于电话信道的多人声纹识别方法及装置与流程

- 国知局

- 2024-06-21 10:42:23

本发明涉及语音识别,尤其涉及一种基于电话信道的多人声纹识别方法及装置。

背景技术:

1、声纹是对语音中所蕴含的、能唯一表征和标识说话人身份的语音特征参数及基于这些特征参数所建立的语音模型的总称。声纹是人的生物个性特征,很难找到两个声纹完全一样的人。

2、然而目前,移动金融发布了有关声纹识别的安全应用技术规范,但是该规范却并不涉及固定电话方面的语音,这是由于固定电话的语音信号采样率不高,一般为8khz的采样率,同时电话语音中不仅存在着环境噪声的干扰,还经常存在着双方同时说话的情况,这给声纹识别在固定电话上的应用带来了极大的困难。

3、如果想要准确识别固定电话中通话人的身份信息,需要在8khz采样率的情况下,实现对这种语音质量不高、语音特征不明显的通话语音的声纹识别。为了解决这些难点,现时本发明提供了一种基于电话信道的多人声纹识别方法及装置,以解决在多人通话的语音质量不高的情况下,对通话人员声纹识别的难度高、以及效率与准确率不高的技术问题。

技术实现思路

1、本发明所要解决的技术问题在于,提供一种基于电话信道的多人声纹识别的方法及装置,能够有利于降低对人员声纹识别的难度、以及提高对通话人员声纹识别效率与准确率。

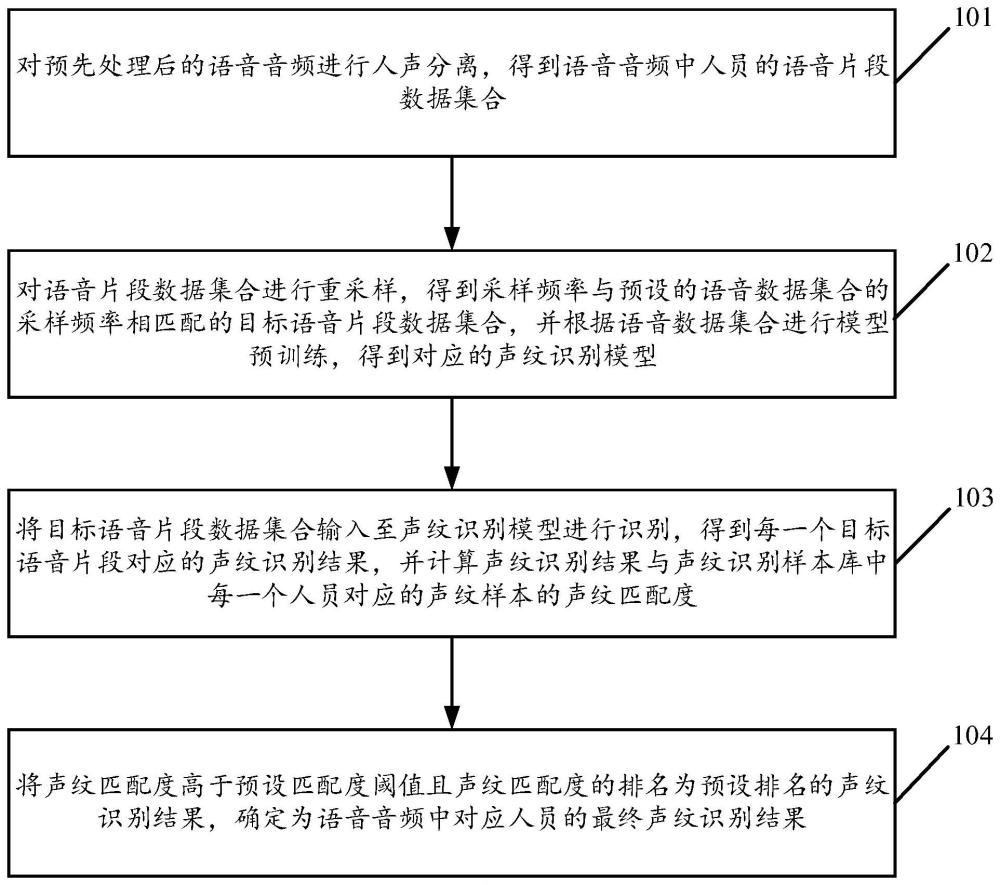

2、为了解决上述技术问题,本发明第一方面公开了一种基于电话信道的多人声纹识别方法,所述方法包括:

3、对预先处理后的语音音频进行人声分离,得到所述语音音频中人员的语音片段数据集合,所述语音音频中包括多个人员的语音音频;

4、对所述语音片段数据集合进行重采样,得到采样频率与预设的语音数据集合的采样频率相匹配的目标语音片段数据集合,并根据所述语音数据集合进行模型预训练,得到对应的声纹识别模型;

5、将所述目标语音片段数据集合输入至所述声纹识别模型进行识别,得到每一个目标语音片段对应的声纹识别结果;

6、计算所述声纹识别结果与声纹识别样本库中每一个人员对应的声纹样本的声纹匹配度,并将所述声纹匹配度高于预设匹配度阈值且所述声纹匹配度的排名为预设排名的声纹识别结果,确定为所述语音音频中对应人员的最终声纹识别结果。

7、作为一种可选的实施方式,在本发明第一方面中,在所述对预先处理后的语音音频进行人声分离之前,所述方法还包括:

8、采集通话语音信号,并将所述通话语音信号转化为预设格式的语音文件;

9、对所述语音文件进行预处理操作,得到处理后的语音音频;

10、所述预设格式为无损音频格式,所述预设格式包括:wav格式、flac格式、ape格式、alac格式中的其中一种;

11、其中,所述对所述语音文件进行预处理操作,得到处理后的语音音频,包括:

12、采集预设的通话语音中的环境噪声信号,并根据预设的算法计算出所述环境噪声信号的平均信号值;

13、根据所述环境噪声信号的平均信号值并通过谱减算法对所述语音文件进行去噪计算,得到去噪后的语音音频;

14、其中,所述预设的算法的公式表示为:

15、

16、所述表示为所述环境噪声信号n的平均信号值,所述nm(t)表示为第m个环境噪声时域信号,所述t表示为环境噪声信号n所经过的时间;

17、所述谱减算法的公式表示为:

18、

19、其中,所述x(ω)表示为所述去噪后的语音音频经过傅里叶变换的频域表达,n(ω)是所述经过傅里叶变换后的频域表达,所述y(ω)是输入待预处理的所述语音文件的频域表达,所述表示所述语音文件的频域相位;

20、所述去噪后的语音音频表示为:

21、

22、其中,所述x(ω)的绝对值表示为所述去噪后的语音音频。

23、作为一种可选的实施方式,在本发明第一方面中,所述对预先处理后的语音音频进行人声分离,得到所述语音音频中人员的语音片段数据集合,包括:

24、按照预设的时间间隔对所述语音音频进行分帧,得到多个音频帧;

25、遍历每一个音频帧并计算每一个音频帧的能量,并判断是否存在至少一个音频帧的能量少于预设的能量阈值;

26、当判断到存在至少一个音频帧的能量少于所述能量阈值时,确定所述至少一个音频帧为静默时间帧,并对所有静默时间帧中连续的静默时间帧合并为静默时间片段,根据所述静默时间片段对所述语音音频进行切分,得到所述语音音频中人员的语音片段数据集合;

27、当判断到未存在至少一个音频帧的能量少于所述能量阈值时,按照固定时间切分的方式对所述语音音频进行切分,得到所述语音音频中固定时间间隔内人员的语音片段数据集合。

28、作为一种可选的实施方式,在本发明第一方面中,所述对所述语音片段数据集合进行重采样,得到采样频率与预设的语音数据集合的采样频率相匹配的目标语音片段数据集合,包括:

29、根据线性插值算法对所述语音片段数据集合进行重采样,得到采样频率与预设的语音数据集合的采样频率相匹配的目标语音片段数据集合。

30、作为一种可选的实施方式,在本发明第一方面中,所述根据所述语音数据集合进行模型预训练,得到对应的声纹识别模型,包括:

31、根据voxceleb中的语音数据集合进行模型预训练,得到所述语音数据集合对应的预训练模型;

32、根据预先采集的通话语音信号对所述预训练模型进行调试,得到对应的声纹识别模型;

33、其中,所述根据预先采集的通话语音信号对所述预训练模型进行调试,得到对应的声纹识别模型,包括:

34、对预先采集的通话语音信号进行重采样,得到重采样后的通话语音信号集合;

35、通过fir高通数字滤波器对所述重采样后的通话语音信号集合进行预加重,得到预加重后的通话语音信号集合;

36、对所述预加重后的通话语音信号集合进行分帧处理,得到多个通话语音信号帧,并对每一个通话语音信号帧进行加窗处理与离散傅里叶变换处理,得到每一个通话语音信号帧的频域表达;

37、根据所述每一个通话语音信号帧的频域表达生成所述通话语音信号集合对应的频谱;

38、通过梅尔滤波器组对所述通话语音信号集合的频谱进行除冗余处理与平滑处理,得到所述频谱中对应的频域信号;

39、对每一个频域信号进行倒谱分析,得到所述频谱中每一个频域信号的梅尔倒谱系数,所述梅尔倒谱系数用于表示为所述通话语音信号中人员语音的声纹特征;

40、通过ecapa-tdnn模型对所述通话语音信号中人员语音的声纹特征转换为声纹特征向量,并根据所述声纹特征向量作为调试参数调试所述预训练模型,得到所述通话语音信号对应的声纹识别模型;

41、其中,所述声纹特征向量用于对所述语音音频中人员的语音片段数据集合进行声纹相似度的匹配识别,所述ecapa-tdnn模型包括:至少两个时延神经网络层、至少两个res2net残差神经网络层、至少两个压缩激励网络层,以及一个注意力层。

42、作为一种可选的实施方式,在本发明第一方面中,所述将所述目标语音片段数据集合输入至所述声纹识别模型进行识别,得到每一个目标语音片段对应的声纹识别结果,计算所述声纹识别结果与声纹识别样本库中每一个人员对应的声纹样本的声纹匹配度,包括:

43、将所述目标语音片段数据集合输入至所述声纹识别模型进行识别,得到每一个目标语音片段对应的声纹特征向量,所述声纹特征向量包括所述目标语音片段中对应人员的声纹特征;

44、通过每一个目标语音片段对应的声纹特征向量计算所述目标语音片段与声纹识别样本库中每一个人员对应的声纹样本的声纹匹配度;

45、所述将所述声纹匹配度高于预设匹配度阈值且所述声纹匹配度的排名为预设排名的声纹识别结果,确定为所述语音音频中对应人员的最终声纹识别结果,包括:

46、判断每一个声纹匹配度是否高于预设的匹配度阈值;

47、当判断到某一个声纹匹配度高于所述匹配度阈值时,确定所述声纹匹配度为目标声纹匹配度;

48、将所有目标声纹匹配度按照降序排列,将排列次序为前2的声纹识别结果,确定为所述语音音频中对应人员的最终声纹识别结果。

49、作为一种可选的实施方式,在本发明第一方面中,所述方法还包括:

50、当确定出的目标声纹匹配度的数量大于等于3时,计算每一个目标声纹匹配度对应的音频时长与所有目标语音片段的总时长的时长占比值;

51、判断每一个目标声纹匹配度对应的时长占比值是否小于预设的时长占比阈值;

52、当判断到某一个目标声纹匹配度对应的时长占比值小于所述时长占比阈值时,将与所述目标声纹匹配度对应的人员识别结果剔除。

53、本发明第二方面公开了一种基于电话信道的多人声纹识别装置,所述装置包括:

54、分离模块,用于对预先处理后的语音音频进行人声分离,得到所述语音音频中人员的语音片段数据集合,所述语音音频中包括多个人员的语音音频;

55、采样模块,用于对分离模块分离出的语音片段数据集合进行重采样,得到采样频率与预设的语音数据集合的采样频率相匹配的目标语音片段数据集合;

56、训练模块,用于根据所述语音数据集合进行模型预训练,得到对应的声纹识别模型;

57、识别模块,用于将所述采样模块采样得到的所述目标语音片段数据集合输入至所述训练模块训练得到的所述声纹识别模型进行识别,得到每一个目标语音片段对应的声纹识别结果;

58、计算模块,用于计算所述识别模块识别出的所述声纹识别结果与声纹识别样本库中每一个人员对应的声纹样本的声纹匹配度;

59、确定模块,用于将所述计算模块计算出的所述声纹匹配度高于预设匹配度阈值且所述声纹匹配度的排名为预设排名的声纹识别结果,确定为所述语音音频中对应人员的最终声纹识别结果。

60、作为一种可选的实施方式,在本发明第二方面中,在所述分离模块对预先处理后的语音音频进行人声分离之前,所述装置还包括:

61、采集模块,用于采集通话语音信号,并将所述通话语音信号转化为预设格式的语音文件;

62、预处理模块,用于对所述采集模块采集到的所述语音文件进行预处理操作,得到处理后的语音音频;

63、所述预设格式为无损音频格式,所述预设格式包括:wav格式、flac格式、ape格式、alac格式中的其中一种;

64、其中,所述预处理模块对所述语音文件进行预处理操作,得到处理后的语音音频的具体方式为:

65、采集预设的通话语音中的环境噪声信号,并根据预设的算法计算出所述环境噪声信号的平均信号值;

66、根据所述环境噪声信号的平均信号值并通过谱减算法对所述语音文件进行去噪计算,得到去噪后的语音音频;

67、其中,所述预设的算法的公式表示为:

68、

69、所述表示为所述环境噪声信号n的平均信号值,所述nm(t)表示为第m个环境噪声时域信号,所述t表示为环境噪声信号n所经过的时间;

70、所述谱减算法的公式表示为:

71、

72、其中,所述x(ω)表示为所述去噪后的语音音频经过傅里叶变换的频域表达,n(ω)是所述经过傅里叶变换后的频域表达,所述y(ω)是输入待预处理的所述语音文件的频域表达,所述表示所述语音文件的频域相位;

73、所述去噪后的语音音频表示为:

74、

75、其中,所述x(ω)的绝对值表示为所述去噪后的语音音频。

76、作为一种可选的实施方式,在本发明第二方面中,所述预处理模块对预先处理后的语音音频进行人声分离,得到所述语音音频中人员的语音片段数据集合的具体方式为:

77、按照预设的时间间隔对所述语音音频进行分帧,得到多个音频帧;

78、遍历每一个音频帧并计算每一个音频帧的能量,并判断是否存在至少一个音频帧的能量少于预设的能量阈值;

79、当判断到存在至少一个音频帧的能量少于所述能量阈值时,确定所述至少一个音频帧为静默时间帧,并对所有静默时间帧中连续的静默时间帧合并为静默时间片段,根据所述静默时间片段对所述语音音频进行切分,得到所述语音音频中人员的语音片段数据集合;

80、当判断到未存在至少一个音频帧的能量少于所述能量阈值时,按照固定时间切分的方式对所述语音音频进行切分,得到所述语音音频中固定时间间隔内人员的语音片段数据集合。

81、作为一种可选的实施方式,在本发明第二方面中,所述采样模块对所述语音片段数据集合进行重采样,得到采样频率与预设的语音数据集合的采样频率相匹配的目标语音片段数据集合的具体方式为:

82、根据线性插值算法对所述语音片段数据集合进行重采样,得到采样频率与预设的语音数据集合的采样频率相匹配的目标语音片段数据集合。

83、作为一种可选的实施方式,在本发明第二方面中,所述训练模块根据所述语音数据集合进行模型预训练,得到对应的声纹识别模型的具体方式为:

84、根据voxceleb中的语音数据集合进行模型预训练,得到所述语音数据集合对应的预训练模型;

85、根据预先采集的通话语音信号对所述预训练模型进行调试,得到对应的声纹识别模型;

86、其中,所述根据预先采集的通话语音信号对所述预训练模型进行调试,得到对应的声纹识别模型,包括:

87、对预先采集的通话语音信号进行重采样,得到重采样后的通话语音信号集合;

88、通过fir高通数字滤波器对所述重采样后的通话语音信号集合进行预加重,得到预加重后的通话语音信号集合;

89、对所述预加重后的通话语音信号集合进行分帧处理,得到多个通话语音信号帧,并对每一个通话语音信号帧进行加窗处理与离散傅里叶变换处理,得到每一个通话语音信号帧的频域表达;

90、根据所述每一个通话语音信号帧的频域表达生成所述通话语音信号集合对应的频谱;

91、通过梅尔滤波器组对所述通话语音信号集合的频谱进行除冗余处理与平滑处理,得到所述频谱中对应的频域信号;

92、对每一个频域信号进行倒谱分析,得到所述频谱中每一个频域信号的梅尔倒谱系数,所述梅尔倒谱系数用于表示为所述通话语音信号中人员语音的声纹特征;

93、通过ecapa-tdnn模型对所述通话语音信号中人员语音的声纹特征转换为声纹特征向量,并根据所述声纹特征向量作为调试参数调试所述预训练模型,得到所述通话语音信号对应的声纹识别模型;

94、其中,所述声纹特征向量用于对所述语音音频中人员的语音片段数据集合进行声纹相似度的匹配识别,所述ecapa-tdnn模型包括:至少两个时延神经网络层、至少两个res2net残差神经网络层、至少两个压缩激励网络层,以及一个注意力层。

95、作为一种可选的实施方式,在本发明第二方面中,所述识别模块将所述目标语音片段数据集合输入至所述声纹识别模型进行识别,得到每一个目标语音片段对应的声纹识别结果的具体方式为:

96、将所述目标语音片段数据集合输入至所述声纹识别模型进行识别,得到每一个目标语音片段对应的声纹特征向量,所述声纹特征向量包括所述目标语音片段中对应人员的声纹特征;

97、所述计算模块计算所述声纹识别结果与声纹识别样本库中每一个人员对应的声纹样本的声纹匹配度的具体方式为:

98、通过每一个目标语音片段对应的声纹特征向量计算所述目标语音片段与声纹识别样本库中每一个人员对应的声纹样本的声纹匹配度;

99、所述确定模块将所述声纹匹配度高于预设匹配度阈值且所述声纹匹配度的排名为预设排名的声纹识别结果,确定为所述语音音频中对应人员的最终声纹识别结果的具体方式为:

100、判断每一个声纹匹配度是否高于预设的匹配度阈值;

101、当判断到某一个声纹匹配度高于所述匹配度阈值时,确定所述声纹匹配度为目标声纹匹配度;

102、将所有目标声纹匹配度按照降序排列,将排列次序为前2的声纹识别结果,确定为所述语音音频中对应人员的最终声纹识别结果。

103、作为一种可选的实施方式,在本发明第二方面中,所述装置还包括:

104、所述计算模块,还用于当所述确定模块确定出的目标声纹匹配度的数量大于等于3时,计算每一个目标声纹匹配度对应的音频时长与所有目标语音片段的总时长的时长占比值;

105、判断模块,用于判断所述计算模块计算出的每一个目标声纹匹配度对应的时长占比值是否小于预设的时长占比阈值;

106、剔除模块,用于当所述判断模块判断到某一个目标声纹匹配度对应的时长占比值小于所述时长占比阈值时,将与所述目标声纹匹配度对应的人员识别结果剔除。

107、本发明第三方面公开了另一种基于电话信道的多人声纹识别装置,所述装置包括:

108、存储有可执行程序代码的存储器;

109、与所述存储器耦合的处理器;

110、所述处理器调用所述存储器中存储的所述可执行程序代码,执行本发明第一方面公开的基于电话信道的多人声纹识别方法。

111、本发明第四方面公开了一种计算机存储介质,所述计算机存储介质存储有计算机指令,所述计算机指令被调用时,用于执行本发明第一方面公开的基于电话信道的多人声纹识别方法。

112、与现有技术相比,本发明实施例具有以下有益效果:

113、本发明实施例中,提供了一种基于电话信道的多人声纹识别方法及装置,该方法包括:对预先处理后的语音音频进行人声分离,得到语音音频中人员的语音片段数据集合,并对语音片段数据集合进行重采样,得到采样频率与预设的语音数据集合的采样频率相匹配的目标语音片段数据集合,将目标语音片段数据集合输入至预先训练好的声纹识别模型进行识别,得到对应的声纹识别结果,计算声纹识别结果与声纹识别样本库中每一个人员对应的声纹样本的声纹匹配度,并将声纹匹配度高于预设匹配度阈值且声纹匹配度的排名为预设排名的声纹识别结果,确定为语音音频中对应人员的最终声纹识别结果。可见,实施本发明能够对预先处理后的语音音频进行人声分离,减少了语音音频中不必要的语音段落,从而提高了对固话通话人员的声纹识别的效率与准确率;对语音片段数据集合进行重采样,以便得到采样频率与预设的语音数据集合的采样频率相匹配的目标语音片段数据集合,避免了采样频率不一致对模型识别准确度造成的影响,有利于提高对固话通话人员的声纹识别准确率;根据声纹识别模型识别出的声纹识别结果计算与声纹识别样本库中每一个人员对应的声纹样本的声纹匹配度,可以准确有效地识别对应通话人员的声纹结果,从而有利于提高对固话通话人员的声纹识别准确率。

本文地址:https://www.jishuxx.com/zhuanli/20240618/21359.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。