一种基于空间线索的双麦克风语音增强方法

- 国知局

- 2024-06-21 10:41:51

本发明属于语音信号处理领域,尤其涉及一种基于空间线索的双麦克风语音增强方法。

背景技术:

1、语音通信是人类最重要、最有效的通信方式之一,它以语音信号的形式传播语音消息中所携带的信息。在使用蓝牙耳机进行通话时,由于人所处环境的多变性、传输设备的自噪声、信道传输干扰等因素,使得人嘴巴发出的纯净语音受到噪声污染形成了带噪语音,从而影响听者的听觉感知质量。

2、大多的蓝牙耳机往往在每一侧设备中设置多个麦克风用于接收语音信号,导致设备体积及功耗增大,对于硬件要求高。随着无线蓝牙技术的发展,语音信号在间距较大设备间进行同步传输得以实现。因此,可以在每一侧蓝牙耳机放置单一麦克风拾取语音信号,在实现双侧设备同步传输的前提下,利用它们拾取到的语音信号之间联系与差异滤除噪声,获得纯净语音。

3、该应用场景下,现有的语音增强方法主要包括以下几类:基于统计的方法、二值时频遮蔽法、基于空间信息的多通道维纳滤波法和基于波束形成的方法。但是,现有算法都存在各自的局限性和缺点。基于统计的方法需要大量数据才能实现好的语音增强效果,实时性不佳,无法应用于实时语音通话;二值时频遮蔽法根据双麦克风信号之间特征差异将时频点分为噪声占优和语音占优的时频点,在低信噪比情况下语音损失大,并且会产生音乐噪声;基于空间信息的维纳滤波法利用空间信息进行噪声功率谱或目标语音功率谱估计,只对方向性噪声有效,且残留噪声较多;基于波束形成的方法假设两个通道采集到的噪声信号不相干,在相干噪声的情况下残留噪声较多、语音失真较大。

技术实现思路

1、发明目的:为了解决现有技术的不足,本发明提供了一种基于空间线索的双麦克风语音增强方法。这种方法将可能存在的方向性噪声和散射噪声分阶段处理,在滤除两种噪声的同时达到听感舒适、人声失真小、可懂度高的目的。

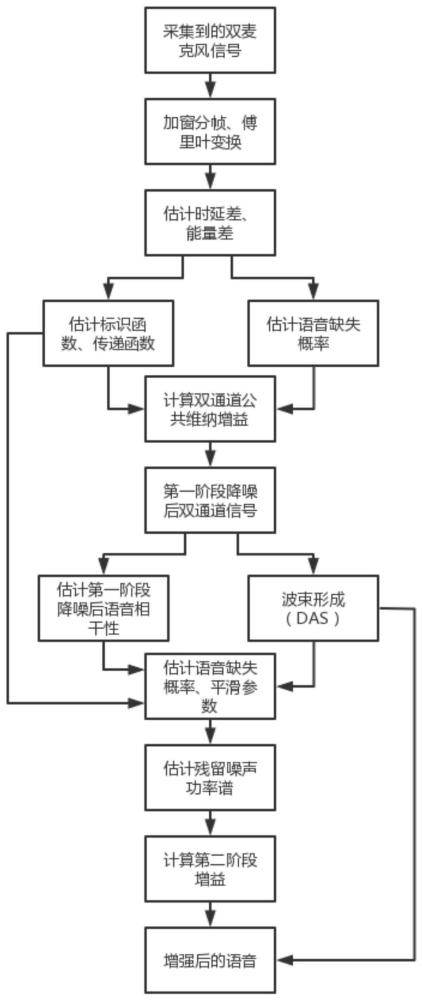

2、技术方案:本发明的一种基于空间线索的双麦克风语音增强方法,包括如下步骤:

3、步骤s1、在双麦克风接收到语音信号后,对两路信号分别加窗分帧,做傅里叶变换,将时域信号转化为频域信号,根据空间混叠频率门限划分高频和低频区域;

4、步骤s2、计算两路信号比值、两路信号功率谱及其比值,根据两路信号比值计算时间差和能量差;

5、步骤s3、将s2中所得时间差和能量差用于计算第一阶段标识函数和语音缺失概率,低频部分使用时间差和能量差联合计算语音缺失概率,高频部分采用能量差计算语音缺失概率,并利用第一阶段标识函数统计信息修正第一阶段标识函数,得到当前帧及前一帧第一阶段标识函数;

6、步骤s4、根据s3中所得当前帧及前一帧第一阶段标识函数,利用s2中所得两路信号功率计算噪声传递函数;

7、步骤s5、利用s2中所得两路信号功率谱比值和s4中噪声传递函数计算维纳增益,并将其作用于双麦克风信号获得第一阶段降噪后双麦克风语音;

8、步骤s6、计算第一阶段降噪后双麦克风信号的相干性,并通过波束形成算法将双通道信号转化为单通道信号;

9、步骤s7、利用融合s6中所得相干性和s3中所得第一阶段标识函数的改进的最小值控制递归平均(imcra)噪声功率谱估计算法计算第二阶段标识函数、语音存在概率、语音缺失概率及残留噪声功率谱;

10、步骤s8、将s7中得到的第二阶段标识函数、语音存在概率、语音缺失概率及残留噪声功率谱与最优对数幅度谱估计(omlsa)增益函数相结合,并将其作用于s6中波束形成所得单通道带噪语音获得最终增强后的语音信号。

11、进一步的,步骤s2中,时间差和能量差的计算方式为:

12、

13、

14、其中,x12(n,k)为两路语音频域信号的比值,n和k分别为帧和频带编号。

15、进一步的,步骤s3具体包括如下步骤:

16、s3.1、在低频区域,若|ild(n,k)|<amin且|itd(n,k)|<tmin,标识函数i1(n,k)=1;若|ild(n,k)|>amax或|itd(n,k)|>tmax,标识函数i1(n,k)=0;其他情况下,标识函数i1(n,k)=0.5;在高频区域,若|ild(n,k)|<amin,标识函数i1(n,k)=1;若|ild(n,k)|>amax,标识函数i1(n,k)=0;其他情况下,标识函数i1(n,k)=0.5;amin的取值范围是0.4到1,amax的取值范围是2到4;tmin的取值范围是1到2,tmax的取值范围是3到5;其中,标识函数为0表示该时频点主要是噪声;标识函数为0.5表示该时频点是语音和噪声混叠区域;标识函数为1表示该时频点主要是目标人声;

17、s3.2、低频区域和高频区域标识函数等于0.5时,语音缺失概率计算公式分别为:

18、

19、qh(n,k)=qa(n,k)

20、其中:

21、qa(n,k)=(|ild(n,k)|-amin)/amax

22、qt(n,k)=(|itd(n,k)|-tmin)/tmax;

23、s3.3、第一阶段标识函数的统计公式为:

24、

25、其中,i和j分别表示用于统计的频率下限和上限,若超过连续n1帧的vad值小于nmin,那么语音信号进入噪声段,将当前帧的标识函数全部修正为0,直到vad值大于nmin,停止修正第一阶段标识函数。

26、进一步的,步骤s4具体包括如下步骤:根据当前帧及前一帧标识函数的不同,分类计算噪声传递函数:

27、s4.1、如果i1(n,k)=1,当前时频点为目标语音时频点,噪声传递函数不更新,即:

28、|h(n,k)|2=|h(n-1,k)|2

29、其中,h(n-1,k)为前一帧噪声传递函数;

30、s4.2、如果i1(n,k)=0,当前时频点为噪声时频点,噪声传递函数的更新方式为:

31、

32、其中,p1(n,k)为左侧麦克风功率谱,p2(n,k)为右侧麦克风的功率谱,β1为平滑因子,取值范围为0.7到0.9;

33、s4.3、如果i1(n,k)=0.5,当前时频点为噪声和目标语音混叠的时频点;

34、如果i1(n-1,k)=0,噪声传递函数功率谱的更新方式为:

35、

36、如果i1(n-1,k)=1,噪声传递函数功率谱的更新方式为:

37、

38、如果i1(n-1,k)=0.5,噪声传递函数功率谱的更新方式为:

39、

40、进一步的,步骤s5具体包括如下步骤:根据标识函数的不同,分类计算第一阶段增益:

41、s5.1、如果标识函数i1(n,k)=0:

42、

43、s5.2、如果标识函数i1(n,k)=0.5:

44、

45、其中,q为语音缺失概率,高频部分为qh,低频部分为ql;

46、s5.3、如果标识函数i1(n,k)=1:

47、

48、其中,gmin1的取值范围是0.05到0.2,p1/2(n,k)是两个麦克风接收到的语音信号功率谱的比值,将所得增益函数分别作用于双麦克风语音,得到第一阶段处理后的双麦克风语音信号。

49、进一步的,步骤s6具体为:衡量相干性的计算公式为:

50、

51、其中,pw12(n,k)为第一阶段降噪后所得双通道语音的互功率谱,pw11(n,k)和pw22(n,k)分别为第一阶段降噪后所得双通道语音的自功率谱,所用波束形成算法为延迟求和,计算公式为:

52、xw(n,k)=0.5(xw1(n,k)+xw2(n,k))

53、其中,xw1(n,k)和xw2(n,k)分别为第一阶段降噪后语音频域信号。

54、进一步的,步骤s7包括如下步骤:

55、s7.1、第二阶段的标识函数计算方式为:如果满足γmin(n,k)>γ0,η(n,k)>η0,i1(n,k)≠0,则i2(n,k)=0,否则的话i2(n,k)=1;

56、s7.2、第二阶段语音不存在概率的计算方法为:

57、如果且或coh(n,k)<coh0:

58、

59、如果且且coh(n,k)≥coh0:

60、

61、其他情况下:

62、

63、s7.3、在最小值控制递归平均噪声功率谱估计算法中用于计算平滑噪声功率谱的变平滑参数的计算公式为:

64、

65、进一步的,步骤s8包括如下步骤:

66、s8.1、最优对数幅度谱估计增益函数表示为:

67、

68、其中,p(n,k)为s7中所得语音存在概率,gmin2为最小增益,取值范围是0.05到0.2;

69、s8.2、的计算公式为:

70、

71、其中,积分下限的表达式为:

72、

73、其中,γ(n,k)为后验信噪比,计算公式为:

74、

75、其中,ξ(n,k)为先验信噪比,可利用dd准则进行估计,计算公式为:

76、

77、s8.3、将所得g2(n,k)作用于xw(n,k)就能获得最终的纯净语音频谱:

78、xout(n,k)=g2(n,k)xw(n,k)

79、有益效果:与现有技术相比,本发明具有如下显著优点:首先,将可能存在的方向性噪声和散射噪声分阶段处理,对于两种噪声都具备抑制效果;其次,在第一阶段利用采集到的双麦克风语音信号时延和能量差异将时频点分为语音时频点、噪声时频点以及语音和噪声混叠时频点,并对语音和噪声混叠时频点根据前一帧的标识函数进一步分类,充分利用了当前帧和前一帧的空间信息,在复杂声学场景下具有更好的适应能力;第三,通过简化信号模型以及等式推导等方式建立了维纳增益和语音功率谱密度、噪声传递函数之间的关系,避免了传统维纳增益中求解先验信噪比带来的误差;最后,在第二阶段利用第一阶段标识函数以及改进的相干性衡量公式优化了imcra噪声估计算法,降低了语音存在的时频点噪声过估计的可能性,并最终达到听感舒适、人声失真小、可懂度高的目的。

本文地址:https://www.jishuxx.com/zhuanli/20240618/21281.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表