一种智慧型卡拉OK系统的制作方法

- 国知局

- 2024-06-21 10:44:27

本发明涉及卡拉ok系统,尤其涉及一种智慧型卡拉ok系统。

背景技术:

1、卡拉ok系统一种供用户以卡拉ok形式进行歌曲演唱和娱乐的设备或软件系统,通常包括一个播放器或软件,带有一大批预先录制的歌曲伴奏,用户可以通过其麦克风进行歌曲演唱,同时显示歌词和提供视觉效果。用户可以选择歌曲、调整音量、控制播放和录音等操作。

2、在传统类型的卡拉ok系统中,存在一些局限性。首先,这些系统通常使用基于2d的用户界面,限制了用户在学习过程中的沉浸感和交互体验。用户只能简单地观看歌词和曲谱,无法真实地感受音乐的氛围和表演的乐趣。其次,现有的卡拉ok系统缺乏实时的体感识别和反馈功能。这意味着用户在学习和表演过程中无法获得关于他们身体动作和姿势的指导。这对于提高音乐协调性和舞台表现力是一个限制因素。此外,卡拉ok系统中的伴奏和声音质量可能不够出色。有些系统的伴奏往往听起来机械,缺乏个性化和生动性。声音合成技术也可能无法提供自然逼真的音乐伴奏和虚拟演唱导师的声音。最后,现有的卡拉ok系统在提供个性化指导方面存在限制。虽然一些系统可以提供一般性的唱音反馈,但缺乏个性化的指导和专业化的技术支持,无法精确地针对每个用户的具体问题和水平提供指导和帮助。综上所述,传统类型的卡拉ok系统在用户体验、体感识别、伴奏质量以及个性化指导方面存在一些不足。

技术实现思路

1、本发明的目的是解决现有技术中存在的缺点,而提出的一种智慧型卡拉ok系统。

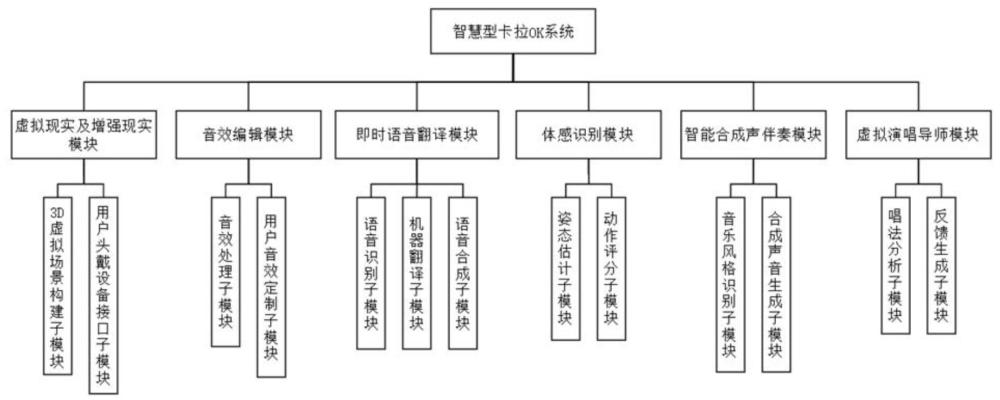

2、为了实现上述目的,本发明采用了如下技术方案:一种智慧型卡拉ok系统是由虚拟现实及增强现实模块、音效编辑模块、即时语音翻译模块、体感识别模块、智能合成声伴奏模块、虚拟演唱导师模块组成;

3、所述虚拟现实及增强现实模块包括3d虚拟场景构建子模块、用户头戴设备接口子模块;

4、所述音效编辑模块包括音效处理子模块、用户音效定制子模块;

5、所述即时语音翻译模块包括语音识别子模块、机器翻译子模块、语音合成子模块;

6、所述体感识别模块包括姿态估计子模块、动作评分子模块;

7、所述智能合成声伴奏模块包括音乐风格识别子模块、合成声音生成子模块;

8、所述虚拟演唱导师模块包括唱法分析子模块、反馈生成子模块。

9、作为本发明的进一步方案:所述3d虚拟场景构建子模块所采用技术包括几何建模和细化、纹理映射和贴图、光照和阴影模拟、物理引擎、虚拟摄影机控制;

10、所述几何建模和细化具体为,使用包括nurbs非均匀有理b样条、bézier曲线和曲面的三维建模软件和技术,创建舞台和观众的几何形状;

11、所述纹理映射和贴图具体为,通过将纹理贴图应用到舞台和观众的几何模型上;

12、所述光照和阴影模拟具体为,使用包括全局光照(global illumination)和环境光遮挡(ambient occlusion)的光照算法和渲染技术,为虚拟场景提供光照效果,在渲染过程中模拟和计算阴影;

13、所述物理引擎采用包括刚体动力学和碰撞检测的物理引擎算法;

14、所述虚拟摄影机控制通过交互技术控制虚拟摄像机的位置、角度和运动。

15、作为本发明的进一步方案:所述用户头戴设备接口子模块包括vr/ar设备接口、头部追踪、视线追踪、手势识别、环境感知;

16、所述vr/ar设备接口连接卡拉ok系统与用户使用的vr/ar设备,所述vr/ar设备接口采用openvr接口;

17、所述头部追踪通过使用包括陀螺仪、加速度计的内置传感器,实时跟踪用户头部的姿态和位置,调整虚拟场景中的视角和相机位置;

18、所述视线追踪利用眼动追踪技术,识别用户当前的视线方向和注视点;

19、所述手势识别通过计算机视觉算法,识别用户手部的姿态和手势,并添加自然的手势进行交互,包括手势导航、手势选择;

20、所述环境感知通过深度摄像头,感知用户所处的物理空间,并将虚拟内容与实际环境进行交互。

21、作为本发明的进一步方案:所述音效处理子模块使用数字信号处理算法(dsp)对原始声音信号进行效果处理,增强音频效果和创造特定的音效,所述音效处理子模块采用包括混响、和声、回声、声相、等化器的音效处理算法;

22、所述用户音效定制子模块包括调整参数、预设效果、实时预览、保存和导入设置。

23、作为本发明的进一步方案:所述语音识别子模块包括序列到序列模型、声学模型、语言模型;

24、所述序列到序列模型采用端到端的自编码器、循环神经网络、转录器模型,在语音和文本之间建立映射关系,实现语音到文本的转换;

25、所述声学模型使用卷积循环神经网络(crnn)结构,提取语音信号的频谱特征,并将其转化为文本;

26、所述语言模型使用文本数据建模语言的概率分布,通过上下文信息进行词语推断和纠错,改善识别结果;

27、所述机器翻译子模块包括神经机器翻译(nmt)、注意力机制;

28、所述神经机器翻译(nmt)使用编码器-解码器结构,其中编码器将源语言句子编码成一个语义表示,解码器将该语义表示解码成目标语言句子;

29、所述注意力机制在解码过程中对输入句子中的不同部分进行加权关注,提高翻译的准确性和连贯性;

30、所述语音合成子模块包括tacotron模型、音素合成、参数转换;

31、所述tacotron模型基于长短时记忆网络(lstm)和注意力机制,将文本转为声音波形,生成高质量语音输出;

32、所述音素合成采用语音合成引擎和音素转音频信号的算法;

33、所述参数转换具体为,根据目标语言的语音特征,调整模型生成语音的参数。

34、作为本发明的进一步方案:所述姿态估计子模块的执行步骤具体为:

35、根据关键节点的位置、速度和关系信息,设置阈值和触发条件;

36、通过逻辑判断来推断用户的姿势和动作;

37、利用二值化、腐蚀、膨胀形态学运算,处理关键节点的图像;

38、提取形状和特征,从而进行姿态估计和动作识别。

39、作为本发明的进一步方案:所述动作评分子模块的执行步骤具体为:

40、定义基于规则和经验的评分规则;

41、根据动作的准确性、连贯性、时间等方面,赋予不同的评分等级;

42、利用惯性传感器,获取包括加速度和角速度的传感器数据;

43、通过计算传感器数据的统计特征、变化速度和关系,进行动作判别和评分。

44、作为本发明的进一步方案:所述音乐风格识别子模块包括风格特征提取、数据集构建、音乐风格分类模型、模型训练与优化;

45、所述风格特征提取利用频谱分析、时频特征提取方法,将音频数据转换为音频特征表示;

46、所述数据集构建收集包含不同音乐风格的标记音频数据集;

47、所述音乐风格分类模型采用深度学习方法cnn,设计和训练音乐风格分类模型,将音频数据映射到相应的风格类别;

48、所述模型训练与优化使用标记的音乐风格数据对模型进行训练,并应用包括正则化、dropout、批归一化的优化技术,提高模型的分类性能。

49、作为本发明的进一步方案:所述合成声音生成子模块包括音频数据表示、gan模型训练、特征融合、音质优化、实时性能优化;

50、所述音频数据表示将音频数据转换为合成模型可接受的表示形式,包括mel频谱图、时频图;

51、所述gan模型训练具体为wavegan,采用数据生成器和鉴别器,生成和评估合成音频的质量和真实性;

52、所述特征融合,基于风格类别的音频数据,将识别的音乐风格与声音生成模型结合,选定合成参数和控制策略,生成对应音乐风格的伴奏声音;

53、所述音质优化应用包括去噪、音量均衡、混响的声音信号处理和音质优化技术;

54、所述实时性能优化通过模型量化、硬件加速方法,提升模型推理速度,降低合成声音的延迟。

55、作为本发明的进一步方案:所述唱法分析子模块包括唱法特征提取、唱法分类模型;

56、所述唱法特征提取使用mfcc、deepspectrum技术,将用户的声音信号转化为特征向量表示;

57、所述唱法分类模型基于深度学习方法rnn,设计和训练唱法分类模型,对提取的特征与预定义的唱法类别进行匹配和分类,以判断用户的唱法类型;

58、所述反馈生成子模块包括反馈规则和模板、唱法改进指导、自然语言生成(nlg)、数据驱动反馈;

59、所述反馈规则和模板基于唱法分析结果和具体的问题点,生成相应的口头或文本反馈;

60、所述唱法改进指导根据唱法类别和问题点,生成针对性的指导建议,所述指导建议包括但不限于改进音准、节奏、气息控制;

61、所述自然语言生成(nlg)应用自然语言处理和生成技术,根据分析结果和反馈规则,自动生成个性化的反馈文本;

62、所述数据驱动反馈利用预先定义的唱法规则和标记的训练数据集,通过机器学习方法构建模型,自动产生基于数据驱动的反馈。

63、与现有技术相比,本发明的优点和积极效果在于:

64、本发明中,通过引入虚拟现实及增强现实技术,用户可以在全方位的环境中进行演唱,并获得身临其境的感觉,提升娱乐体验。虚拟现实场景的创建子模块利用几何建模和细化、纹理映射和贴图、光照和阴影模拟、物理引擎等技术,创造出逼真的舞台和观众效果。体感识别模块通过姿态估计和动作评分子模块,能够实时监测用户的体感动作,并给予准确的反馈和评分。这对训练用户的音乐协调性和舞台表现力非常有帮助,提升用户的歌唱技巧和表演能力。通过智能合成声伴奏模块的音乐风格识别子模块和虚拟演唱导师模块的唱法分析子模块,系统能够识别用户的音乐风格和唱法类型,并提供个性化的声音伴奏和专业的唱音反馈和指导。这样,用户可以获得更生动、个性化的音乐伴奏,并得到专业水平的唱歌指导,帮助他们提高唱歌的质量和技巧。

本文地址:https://www.jishuxx.com/zhuanli/20240618/21472.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。