语音合成方法、装置、设备及计算机可读介质与流程

- 国知局

- 2024-06-21 10:45:51

本发明的实施方式涉及语音合成,更具体地,本发明的实施方式涉及一种语音合成方法、装置、设备及计算机可读介质。

背景技术:

1、本部分旨在为权利要求书中陈述的本发明的实施方式提供背景或上下文。此处的描述不因为包括在本部分中就承认是现有技术。

2、语音合成是指将用户输入的文本合成为指定音色的语音的技术。这个过程通常涉及到文本分析、声学模型以及声码器三个模块。语音合成技术现广泛应用于车载语音助手播报、短视频播报、词典笔播报等领域,大大节省了人工播报的投入。

3、在现有技术中,多音字识别、文本正则识别以及韵律停顿预测等是语音合成中不同的研究方向,在技术实现上需要通过不同的模型来实现对应的功能,因此要完整实现语音合成,所需文本分析前端非常繁琐。并且,即便通过不同的模型来实现对应的功能,现有方案在多音字识别、文本正则识别以及韵律停顿预测也存在准确率较低的问题,不满足用户需求。

技术实现思路

1、在本上下文中,本发明的实施方式期望提供一种语音合成方法、装置、设备及计算机可读介质,以解决语音合成流程繁琐,预测准确率较低的技术问题。

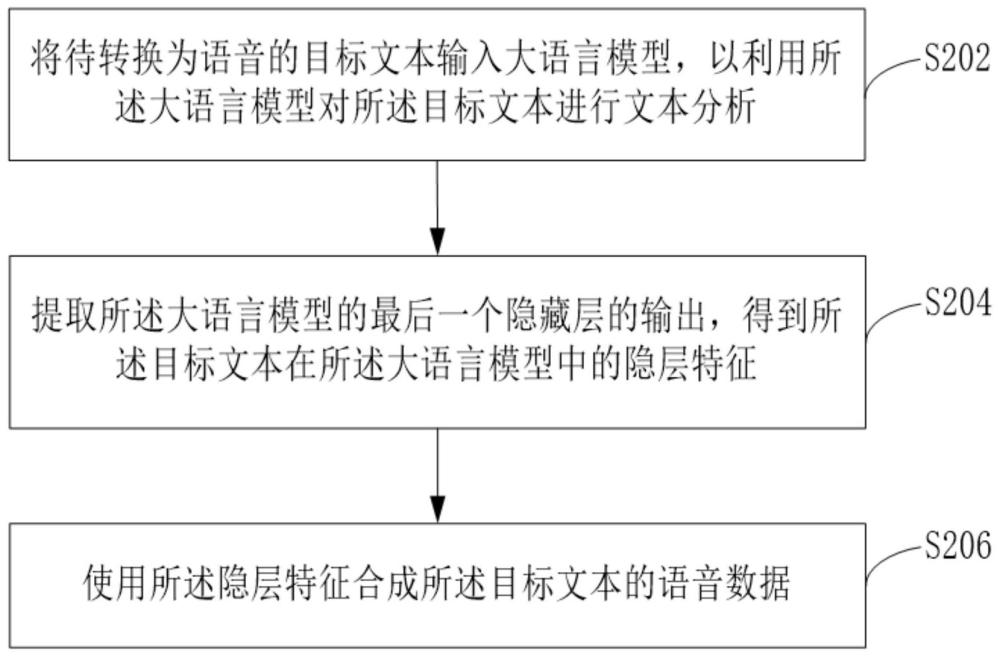

2、在本发明实施方式的第一方面中,提供了一种语音合成方法,包括:将待转换为语音的目标文本输入大语言模型,以利用所述大语言模型对所述目标文本进行文本分析;提取所述大语言模型的最后一个隐藏层的输出,得到所述目标文本在所述大语言模型中的隐层特征;使用所述隐层特征合成所述目标文本的语音数据。

3、在本发明的一个实施例中,所述使用所述隐层特征合成所述目标文本的语音数据包括:将所述隐层特征输入第一声学模型,以利用所述第一声学模型对所述隐层特征进行特征编码,其中,所述第一声学模型是基于训练文本的隐层特征和所述训练文本对应的语音样本训练得到的,所述训练文本的隐层特征是通过所述大语言模型得到的;获取所述第一声学模型对所述隐层特征进行特征编码后输出的梅尔频谱,并将所述梅尔频谱输入第一声码器,其中,所述第一声码器是基于所述训练文本对应的语音样本和所述语音样本的梅尔频谱训练得到的,所述语音样本的梅尔频谱是通过所述第一声学模型得到的;获取所述第一声码器的输出,得到所述目标文本的语音数据。

4、在本发明的另一实施例中,所述将所述隐层特征输入第一声学模型之前,所述方法还包括按照如下方式训练得到所述第一声学模型:获取所述训练文本和对应的语音样本;提取所述语音样本的梅尔频谱,并将所述训练文本输入所述大语言模型;提取所述大语言模型的最后一个隐藏层的输出,得到所述训练文本的隐层特征;将所述训练文本的隐层特征输入第二声学模型,以利用所述训练文本的隐层特征对所述第二声学模型进行特征编码训练;利用所述语音样本的梅尔频谱对所述第二声学模型的训练结果进行验证;在所述第二声学模型的验证损失降低到第一目标阈值的情况下,将所述第二声学模型确定为所述第一声学模型。

5、在本发明的又一个实施例中,在所述第二声学模型的验证损失未降低到所述第一目标阈值的情况下,所述方法还包括:继续使用所述训练文本的隐层特征对所述第二声学模型进行迭代训练,并在每一轮迭代训练中调整所述第二声学模型内各网络层中的参数的数值,直至所述第二声学模型的验证损失降低到所述第一目标阈值。

6、在本发明的再一个实施例中,所述在每一轮迭代训练中调整所述第二声学模型内各网络层中的参数的数值包括:利用目标损失函数确定损失值,其中,所述损失值用于表示所述第二声学模型对所述训练文本的隐层特征的编码结果与所述语音样本的梅尔频谱之间的准确度的差异;利用所述损失值调整所述第二声学模型中至少两个transformer编码器和时长模型的参数,直至所述第二声学模型的验证损失降低到所述第一目标阈值,其中,所述第二声学模型包括所述至少两个transformer编码器和所述时长模型。

7、在本发明的再一个实施例中,所述将所述梅尔频谱输入第一声码器之前,所述方法还包括按照如下方式训练得到所述第一声码器:获取所述训练文本的隐层特征和所述训练文本对应的语音样本;将所述训练文本的隐层特征输入所述第一声学模型,以利用所述第一声学模型获取所述语音样本的梅尔频谱;将所述语音样本的梅尔频谱输入第二声码器,以利用所述语音样本的梅尔频谱对所述第二声码器进行音频预测训练;利用所述语音样本对所述第二声码器的训练结果进行验证;在所述第二声码器的验证损失降低到第二目标阈值的情况下,将所述第二声码器确定为所述第一声码器。

8、在本发明的再一个实施例中,在所述第二声码器的验证损失未降低到所述第二目标阈值的情况下,所述方法还包括:继续使用所述语音样本的梅尔频谱对所述第二声码器进行迭代训练,并在每一轮迭代训练中调整所述第二声码器内各网络层中的参数的数值,直至所述第二声码器的验证损失降低到所述第二目标阈值。

9、在本发明实施方式的第二方面中,提供了一种语音合成装置,包括:文本分析模块,用于将待转换为语音的目标文本输入大语言模型,以利用所述大语言模型对所述目标文本进行文本分析;隐层特征模块,用于提取所述大语言模型的最后一个隐藏层的输出,得到所述目标文本在所述大语言模型中的隐层特征;语音合成模块,用于使用所述隐层特征合成所述目标文本的语音数据。

10、在本发明实施方式的第三方面中,提供了一种电子设备,包括存储器、处理器、通信接口及通信总线,存储器中存储有可在处理器上运行的计算机程序,存储器、处理器通过通信总线和通信接口进行通信,处理器执行计算机程序时实现上述方法的步骤,

11、在本发明实施方式的第四方面中,提供了一种具有处理器可执行的非易失的程序代码的计算机可读介质,程序代码使处理器执行上述的方法。

12、本发明提供了一种语音合成方法,包括:将待转换为语音的目标文本输入大语言模型,以利用所述大语言模型对所述目标文本进行文本分析;提取所述大语言模型的最后一个隐藏层的输出,得到所述目标文本在所述大语言模型中的隐层特征;使用所述隐层特征合成所述目标文本的语音数据。本申请利用大语言模型在文本分析方面的强大解析能力,只需使用大语言模型便可完成多项文本分析任务,无需通过多个文本分析模块进行逐个处理,极大简化了语音合成的流程,并且基于大语言模型强大的理解能力,大大提高了语音合成的准确率,因此解决了语音合成文本分析前端繁琐,预测准确率较低的技术问题。

技术特征:1.一种语音合成方法,其特征在于,包括:

2.根据权利要求1所述的方法,其特征在于,所述使用所述隐层特征合成所述目标文本的语音数据包括:

3.根据权利要求2所述的方法,其特征在于,所述将所述隐层特征输入第一声学模型之前,所述方法还包括按照如下方式训练得到所述第一声学模型:

4.根据权利要求3所述的方法,其特征在于,在所述第二声学模型的验证损失未降低到所述第一目标阈值的情况下,所述方法还包括:

5.根据权利要求4所述的方法,其特征在于,所述在每一轮迭代训练中调整所述第二声学模型内各网络层中的参数的数值包括:

6.根据权利要求2所述的方法,其特征在于,所述将所述梅尔频谱输入第一声码器之前,所述方法还包括按照如下方式训练得到所述第一声码器:

7.根据权利要求6所述的方法,其特征在于,在所述第二声码器的验证损失未降低到所述第二目标阈值的情况下,所述方法还包括:

8.一种语音合成装置,其特征在于,包括:

9.一种电子设备,包括存储器、处理器、通信接口及通信总线,所述存储器中存储有可在所述处理器上运行的计算机程序,所述存储器、所述处理器通过所述通信总线和所述通信接口进行通信,其特征在于,所述处理器执行所述计算机程序时实现上述权利要求1至7任一项所述的方法的步骤。

10.一种具有处理器可执行的非易失的程序代码的计算机可读介质,其特征在于,所述程序代码使所述处理器执行所述权利要求1至7任一所述方法。

技术总结本发明的实施方式提供了一种语音合成方法、装置、设备及计算机可读介质。该方法包括:将待转换为语音的目标文本输入大语言模型,以利用所述大语言模型对所述目标文本进行文本分析;提取所述大语言模型的最后一个隐藏层的输出,得到所述目标文本在所述大语言模型中的隐层特征;使用所述隐层特征合成所述目标文本的语音数据。本申请利用大语言模型在文本分析方面的强大解析能力,只需使用大语言模型便可完成多项文本分析任务,无需通过多个文本分析模块进行逐个处理,极大简化了语音合成的流程,并且基于大语言模型强大的理解能力,大大提高了语音合成的准确率,因此解决了语音合成流程繁琐,预测准确率较低的技术问题。技术研发人员:高强受保护的技术使用者:网易有道信息技术(北京)有限公司技术研发日:技术公布日:2024/2/6本文地址:https://www.jishuxx.com/zhuanli/20240618/21481.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表