音频处理方法及系统与流程

- 国知局

- 2024-06-21 11:27:05

本发明涉及音频处理,尤其涉及一种音频处理方法及系统。

背景技术:

1、音频处理在现代通信、娱乐和广播领域中具有广泛的应用。然而传统的音频处理技术仅停留着音频听觉效果上,无法准确的分析音频所呈现的场景效果,存在着场景效果复现差,延迟较大的问题。

技术实现思路

1、基于此,有必要提供音频处理方法及系统,以解决至少一个上述技术问题。

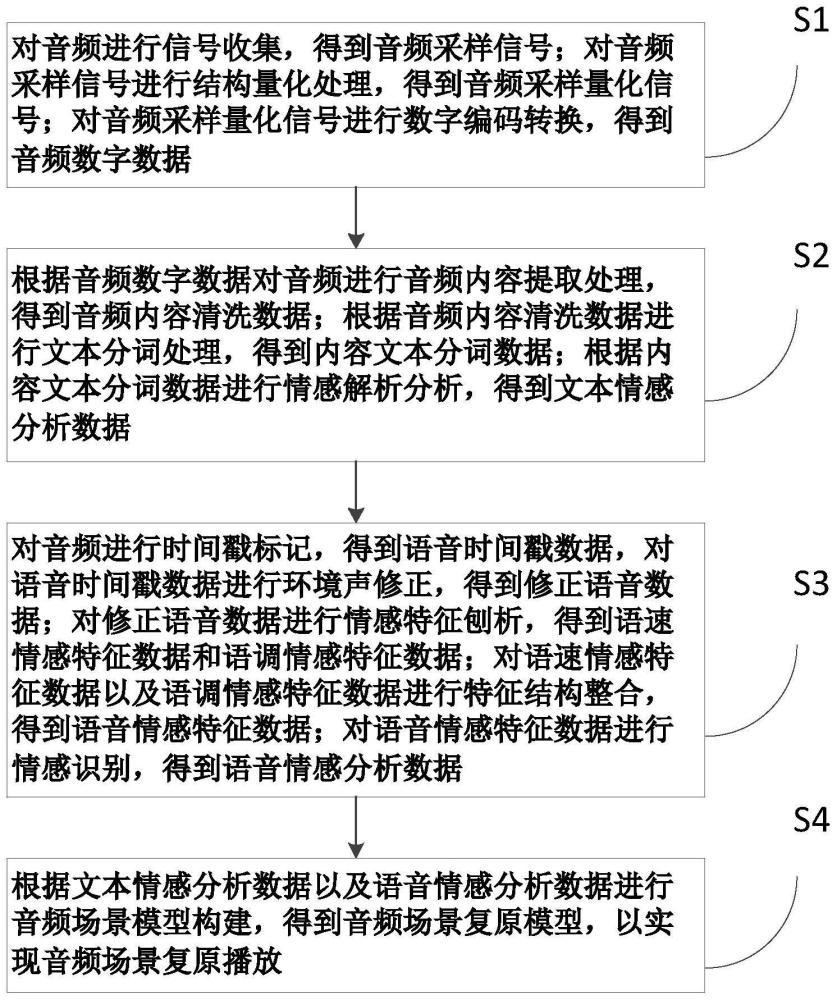

2、为实现上述目的,一种音频处理方法及系统,所述方法包括以下步骤:

3、步骤s1:对音频进行信号收集,得到音频采样信号;对音频采样信号进行结构量化处理,得到音频采样量化信号;对音频采样量化信号进行数字编码转换,得到音频数字数据;

4、步骤s2:根据音频数字数据对音频进行音频内容提取处理,得到音频内容清洗数据;根据音频内容清洗数据进行文本分词处理,得到内容文本分词数据;根据内容文本分词数据进行情感解析分析,得到文本情感分析数据;

5、步骤s3:对音频进行时间戳标记,得到语音时间戳数据,对语音时间戳数据进行环境声修正,得到修正语音数据;对修正语音数据进行情感特征刨析,得到语速情感特征数据和语调情感特征数据;对语速情感特征数据以及语调情感特征数据进行特征结构整合,得到语音情感特征数据;对语音情感特征数据进行情感识别,得到语音情感分析数据;

6、步骤s4:根据文本情感分析数据以及语音情感分析数据进行音频场景模型构建,得到音频场景复原模型,以实现音频场景复原播放。

7、本发明通过对音频进行信号收集,可以获取音频的原始采样信号,这有助于捕捉音频的细节和特征,提供后续处理所需的基础数据,对音频采样信号进行结构量化处理,可以将连续的模拟信号转换为离散的数字信号,这有助于数字化音频数据,使其能够被计算机处理和存储,通过对量化后的音频信号进行数字编码转换,可以将其表示为数字数据,这有助于将音频信号转换为计算机能够理解和处理的形式,为后续的分析和处理提供基础;通过对音频数字数据进行音频内容提取处理,可以从音频中提取出有用的信息和内容,这有助于理解音频中所包含的语音、对话、音乐内容,为后续的分析和处理提供基础数据,根据音频内容清洗数据进行文本分词处理,将提取出的内容转化为有意义的词语,这有助于对音频中的语义和含义进行分析和理解,将长篇的文本划分为更小的单元,方便进一步的处理和分析,根据内容文本分词数据进行情感解析分析,可以推断出文本表达的情感倾向,通过分析文本中的词汇、语义以及句子结构信息,可以判断文本的情感状态,例如积极、消极或中性,这有助于深入了解音频中所表达的情感内容;通过对音频进行时间戳标记,可以将语音数据与特定时间点对应起来,这有助于在后续的分析和处理中准确地定位和引用音频的不同部分,方便进行精细的分析和处理,对语音时间戳数据进行环境声修正,可以去除环境噪音和杂音,提高语音数据的质量和清晰度,这有助于减少噪音对情感分析的干扰,使得情感特征的提取更加准确和可靠,对修正后的语音数据进行情感特征刨析,可以提取出语速和语调特征,语速情感特征数据反映语音的快慢程度,而语调情感特征数据反映语音的音高变化,这些特征可以帮助深入了解语音中所表达的情感信息,对语速情感特征数据和语调情感特征数据进行特征结构整合,将不同特征融合在一起,得到更全面、综合的语音情感特征数据,这有助于捕捉语音中丰富的情感表达,提供更准确和全面的情感分析结果,基于语音情感特征数据进行情感识别,可以判断语音所表达的情感状态,例如喜悦、悲伤、愤怒,这有助于理解语音中所蕴含的情感信息,为情感分析和情感导向的应用提供支持;通过结合文本情感分析数据和语音情感分析数据,可以构建一个音频场景模型,这个模型能够将情感信息与音频特征相结合,并学习到不同情感状态下的音频特征模式,这有助于建立情感与音频场景之间的关联性,为后续的音频场景复原提供基础;基于构建的音频场景模型,可以对音频进行场景复原,通过分析和处理音频特征,模型可以推断出音频所对应的情感状态和场景环境,这有助于还原音频中的情感氛围、背景环境和语境信息,使得音频的感受和体验更加丰富和真实。因此本发明音频处理方法及系统是对传统音频处理方法做出的优化,解决了传统音频处理方法存在的无法准确的分析音频所呈现的场景效果,存在着场景效果复现差,延迟较大的问题,能够准确的分析音频所呈现的场景效果,提高了场景效果复现的能力,降低了延迟。

8、优选地,步骤s1包括以下步骤:

9、步骤s11:对音频进行信号收集,得到音频信号;

10、步骤s12:对音频信号进行声音信号采样处理,得到音频采样信号;

11、步骤s13:对音频采样信号进行结构量化处理,得到音频采样量化信号;

12、步骤s14:对音频采样量化信号进行数字编码转换,得到音频数字数据。

13、本发明通过对音频进行信号收集,可以获取到原始的音频信号,这有助于从音频源头获取音频数据,为后续的处理和分析提供基础;对音频信号进行声音信号采样处理,将连续的模拟音频信号转换为离散的音频采样信号,通过采样处理,音频信号被离散化成一系列采样点,使得音频信号能够在数字系统中进行处理和表示;对音频采样信号进行结构量化处理,将连续的采样值映射为离散的量化值,这有助于减少音频数据的存储空间和传输带宽,同时保持音频的可感知质量;对音频采样量化信号进行数字编码转换,将量化值表示为数字形式的音频数据,通过数字编码,音频信号被转换为计算机能够处理和存储的二进制数据。

14、优选地,步骤s13包括以下步骤:

15、步骤s131:利用预设的振幅结构划分手册对音频采样信号进行采样信号结构划分,得到音频结构信号集;

16、步骤s132:对音频结构信号集进行相邻振幅差计算,得到音频振幅信号集;

17、步骤s133:对音频振幅信号集进行过零率计算,得到过零率信号集;

18、步骤s134:对音频振幅信号集进行交叠部分提取,得到音频振幅交叠信号;

19、步骤s135:根据音频振幅交叠信号以及过零率信号集对音频采样信号进行非线性量化处理,得到音频采样量化信号。

20、本发明利用预设的振幅结构划分手册对音频采样信号进行划分,将音频信号划分为不同的结构,这有助于将音频信号分解为更小的部分,使得后续的分析和处理更加精细和准确;对音频结构信号集进行相邻振幅差计算,得到音频振幅信号集,相邻振幅差反映了音频信号的振幅变化情况,这有助于提取振幅特征,用于后续的分析和处理;对音频振幅信号集进行过零率计算,得到过零率信号集,过零率表示音频信号通过零点的频率,反映了音频信号的快速变化情况,过零率计算可以提取音频的瞬时特征,用于后续的分析和处理;对音频振幅信号集进行交叠部分提取,得到音频振幅交叠信号,交叠部分提取可以识别音频中存在的交叠现象,即多个音频信号的重叠部分,这有助于分离和处理交叠信号,提高音频数据的质量和清晰度;根据音频振幅交叠信号和过零率信号集,对音频采样信号进行非线性量化处理,得到音频采样量化信号,非线性量化处理可以调整音频信号的动态范围和幅度分布,使得音频数据更适合于存储和传输。

21、优选地,步骤s2包括以下步骤:

22、步骤s21:根据音频数字数据对音频进行音频内容提取处理,得到音频内容文本数据;

23、步骤s22:对音频内容文本数据进行数据清洗,得到音频内容清洗数据;

24、步骤s23:根据音频内容清洗数据对音频内容文本数据进行文本分词处理,得到内容文本分词数据;

25、步骤s24:对内容文本分词数据进行语义分析,得到内容文本语义数据;

26、步骤s25:对内容文本语义数据进行关联实体标注,得到内容文本关联数据;

27、步骤s26:根据内容文本关联数据对内容文本语义数据进行情感解析分析,得到文本情感分析数据。

28、本发明根据音频数字数据,进行音频内容提取处理,将音频中的语音信息转换为文本数据,这有助于将音频中的信息提取出来,使得后续的文本处理和分析成为可能;对音频内容文本数据进行数据清洗,去除噪音、无关信息和错误数据,得到干净的音频内容数据,数据清洗可以提高数据的质量和准确性,为后续的处理和分析提供可靠的基础;对音频内容清洗数据进行文本分词处理,将文本拆分成有意义的词语或短语,文本分词可以将复杂的文本数据转化为更易于处理和分析的形式,为后续的语义分析和实体标注提供基础;对内容文本分词数据进行语义分析,理解文本数据的语义和含义,语义分析可以识别文本中的实体、关系和语境,帮助理解文本的内容,并为后续的关联实体标注和情感解析提供基础;根据内容文本清洗数据,对内容文本分词数据进行关联实体标注,识别文本中的实体,并给予相应的标注,关联实体标注可以识别文本中的重要实体和关键词,为后续的分析和应用提供更准确的信息;根据内容文本关联数据,对内容文本语义数据进行情感解析分析,识别文本中的情感倾向和情绪状态,情感解析分析可以帮助理解文本的情感含义,提取情感信息,为情感分析和应用提供基础。

29、优选地,步骤s26包括以下步骤:

30、步骤s261:对内容文本关联数据进行情感词性筛选,得到关键情感词性列表;

31、步骤s262:根据关键情感词性列表进行词汇组合转换分析,得到组合词性情感列表;

32、步骤s263:根据关键情感词性列表以及组合词性情感列表进行情感词典建立,得到关键情感词典;

33、步骤s264:对内容文本语义数据进行句法刨析,得到文本句法结构数据;

34、步骤s265:根据关键情感词典对文本句法结构数据进行情感解析分析,得到文本情感分析数据。

35、本发明对内容文本关联数据进行情感词性筛选,提取其中的关键情感词性,通过筛选出特定的词性,可以聚焦于表达情感的关键词汇,减少冗余信息,提高情感分析的准确性和效果;基于关键情感词性列表,对文本进行词汇组合转换分析,这意味着将关键情感词性按照一定规则进行组合,形成新的组合词性,这种分析可以捕捉到更复杂的情感表达方式,提供更全面和丰富的情感信息;根据关键情感词性列表和组合词性情感列表,建立情感词典,情感词典中包含了与关键情感词性相关的情感词汇和其对应的情感倾向,情感词典的建立可以为后续的情感分析提供参考,帮助判断文本中的情感情绪;对内容文本语义数据进行句法分析,分析文本中各个词汇之间的语法关系和句法结构,句法分析有助于理解文本的语法结构,捕捉到情感表达的上下文关系,从而更准确地解读文本的情感含义;根据关键情感词典和文本句法结构数据,进行情感解析分析,识别文本中的情感倾向和情绪状态,情感解析分析可以基于情感词典和句法结构,将情感信息与上下文关联起来,为情感分析提供更深入和准确的结果。

36、优选地,步骤s3包括以下步骤:

37、步骤s31:对音频进行角色语音数据收集,得到角色语音数据;

38、步骤s32:对角色语音数据进行时间戳标记,得到语音时间戳数据;

39、步骤s33:利用环境声修正算法对语音时间戳数据进行环境声修正,得到修正语音数据;

40、步骤s34:对修正语音数据进行语速音素特征提取以及语调音素特征提取,得到语速音素特征数据和语调音素特征数据;

41、步骤s35:对语速音素特征数据和语调音素特征数据进行情感特征刨析,得到语速情感特征数据和语调情感特征数据;

42、步骤s36:根据文本情感分析数据对语速情感特征数据进行语速情感评估,得到语速情感评估数据;

43、步骤s37:根据语速情感评估数据对语调情感特征数据进行情感适配评估,得到语调情感评估数据;

44、步骤s38:对语速情感评估数据以及语调情感评估数据进行特征结构整合,得到语音情感特征数据;

45、步骤s39:通过语音分析情感识别器对语音情感特征数据进行情感识别,得到语音情感分析数据。

46、本发明对音频进行角色语音数据收集,获取特定角色的语音数据,这有助于将音频与特定的角色或说话人相关联,为后续的分析和处理提供角色上下文;对角色语音数据进行时间戳标记,即为语音数据中的每个片段或单词添加时间标记,时间戳标记可以帮助在后续的处理中准确识别和定位语音数据的不同部分;利用环境声修正算法对语音时间戳数据进行环境声修正,即根据环境噪声对语音数据进行修正和调整,以提高语音数据的质量和可理解性;对修正语音数据进行语速音素特征提取,提取语音数据中的语速相关特征,这可以帮助捕捉到语音的快慢节奏和节拍,为后续的情感分析提供基础;对修正语音数据进行语调音素特征提取,提取语音数据中的语调相关特征,这可以帮助分析语音的音高、音调和声调变化,为后续的情感分析提供基础;对语速音素特征数据和语调音素特征数据进行情感特征刨析,即从语速和语调特征中提取与情感相关的信息,这可以帮助理解语速和语调与情感之间的关联,为后续的情感评估提供基础;根据文本情感分析数据对语速情感特征数据进行语速情感评估,评估语速特征与情感之间的关系,这可以帮助判断语速对情感表达的影响程度,提供语速相关的情感分析结果;根据语速情感评估数据对语调情感特征数据进行情感适配评估,评估语调特征与情感之间的关系,这可以帮助判断语调对情感表达的适配程度,提供语调相关的情感分析结果;对语速情感评估数据以及语调情感评估数据进行特征结构整合,将两者的评估结果综合起来,得到一体化的语音情感特征数据,这可以综合考虑语速和语调对情感的影响,提供更全面和准确的语音情感分析结果;通过语音分析情感识别器对语音情感特征数据进行情感识别,即将语音数据与情感进行关联和分类,得到语音情感分析数据,这可以帮助识别语音中所表达的情感,提供关于情感状态的信息。

47、优选地,步骤s33中的环境声修正算法如下所示:

48、

49、式中,f表示修正后的语音数据,x表示输入的语音时间戳数据,λ表示声波的传播速度值,μ表示环境嘈杂系数,α表示空气阻尼系数,β表示声波振幅系数,γ表示载波频率值,t表示语音时长值,r表示环境声修正算法的偏差修正值。

50、本发明构建了一个环境声修正算法,该算法中的各参数对于修正后语音数据的质量和适应性具有重要的影响,合理地调节这些参数可以改善语音数据的可理解性、清晰度和自然度,使其更好地适应不同的环境噪声和声学条件。该算法充分考虑了输入的语音时间戳数据x,这是待修正的原始语音数据,经过时间戳标记后的结果,它提供了语音数据的时间信息,用于计算修正后的语音数据;声波的传播速度值λ,声波的传播速度是环境中声音传递的速度,在环境声修正中,通过调整传播速度值可以对语音数据进行时间上的调整,以适应不同的传播环境;环境嘈杂系数μ,该系数表示环境中的噪声水平,增大环境嘈杂系数可以增强对环境噪声的修正效果,减小环境噪声对语音数据的影响,提高语音的清晰度和可懂度;空气阻尼系数α,空气阻尼系数用于调节声波在空气中传播时的衰减效果,适当的空气阻尼系数可以减小由于传播距离增加而导致的声音衰减,改善语音的音质和可听性;声波振幅系数β,声波振幅系数表示声波的振幅大小,通过调节振幅系数,可以增强声音的强度,使修正后的语音数据更加清晰和明确;载波频率值γ,载波频率值用于调节修正算法中的频率特征,适当的载波频率值可以使修正后的语音数据在频域上更加平衡,减小频率偏移的影响,提高语音的准确性和自然度;语音时长值t,表示语音数据的时间点或时间段,在环境声修正中,语言时间值用于计算修正后的语音数据的时间位置,以确保数据在时间上的一致性和准确性;环境声修正算法的偏差修正值r,该值表示对修正结果进行偏差修正,以进一步优化修正后的语音数据,通过对偏差修正值的调整,可以更好地适应不同的环境条件,提高修正算法的准确性和鲁棒性;该算法的目的是为了对语音进行修正,该目的也可以通过常规语音处理技术进行修正,但效果往往没有该算法好。

51、优选地,步骤s35包括以下步骤:

52、步骤s351:对语速音素特征数据和语调音素特征数据进行三维热力图绘制,分别得到语速音素特征图和语调音素特征图;

53、步骤s352:对语速音素特征图以及语调音素特征图进行中心热力区域标记,得到语速热力区域数据以及语调热力区域数据;

54、步骤s353:根据语速音素特征图对语速热力区域数据进行分布密度计算,得到语速热力密度数据;

55、步骤s354:根据语调音素特征图对语调热力区域数据进行起伏变化计算,得到语调起伏变化数据;

56、步骤s355:将语速热力密度数据进行区域密度随机抽取,得到语速随机密度数据;将语调起伏变化数据进行起伏变化随机抽取,得到语调随机起伏数据;

57、步骤s356:分别对语速随机密度数据和语调随机起伏数据进行蒙特卡罗模拟,分别得到语速模拟输出数据以及语调模拟输出数据;

58、步骤s357:根据语速模拟输出数据以及语调模拟输出数据进行情感特征刨析,得到语速情感特征数据和语调情感特征数据。

59、本发明通过绘制语速音素特征数据和语调音素特征数据的三维热力图,可以直观地展示语速和语调在不同音素上的分布情况,这有助于理解语速和语调的整体特征,并发现其中的规律和趋势;通过对语速音素特征图和语调音素特征图进行中心热力区域标记,可以确定语速和语调的热力区域,即在特定范围内具有较高或较低值的区域,这有助于聚焦于语速和语调的关键特征区域,提取相关的信息;根据语速音素特征图对语速热力区域数据进行分布密度计算,可以得到语速热力密度数据,这样做可以量化语速的分布特征,了解语速在不同区域的密度分布情况,为后续的分析提供基础;根据语调音素特征图对语调热力区域数据进行起伏变化计算,可以得到语调起伏变化数据,这可以反映语调在不同区域的起伏程度,即语调的变化幅度。这有助于理解语调的动态性和表达特征;将语速热力密度数据进行区域密度随机抽取,得到语速随机密度数据;将语调起伏变化数据进行起伏变化随机抽取,得到语调随机起伏数据,这些随机抽取的数据可以用于模拟语速和语调的随机变化情况,进一步丰富数据样本,增加分析的多样性;对语速随机密度数据和语调随机起伏数据进行蒙特卡罗模拟,可以生成模拟输出数据,这些模拟输出数据可以帮助评估语速和语调的变化对情感特征的影响,提供评估和预测的依据;根据语速模拟输出数据和语调模拟输出数据进行情感特征刨析,可以得到语速情感特征数据和语调情感特征数据,这些数据反映了语速和语调与情感之间的关系,有助于了解语速和语调在情感表达中的作用,并为情感识别和情感生成等应用提供参考。

本文地址:https://www.jishuxx.com/zhuanli/20240618/21604.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表