基于韵律情感迁移的语音合成系统及方法与流程

- 国知局

- 2024-06-21 11:32:27

本技术属于语音合成,具体涉及一种基于韵律情感迁移的语音合成系统及方法。

背景技术:

1、文本到语音(tts, text-to-speech,文本转语音)合成的目标是从文本生成类似人类的语音。目前的tts模型已经扩展到更复杂的场景,包括多个说话人、情感和风格,以实现表达丰富和多样化的语音生成。越来越多的应用程序,如语音助手服务和长篇阅读,已经开发并部署到实际的语音平台中。

2、tts模型通常由编码器-解码器的神经网络组成,该网络经过训练可将给定的文本序列成功映射到语音帧序列。并且,该模型可以有效地建模和控制语音风格(例如发言人的身份、说话风格、情感和韵律等信息)。传统tts系统通常在有限的数据集上进行训练,这限制了它们产生多样化和可泛化结果的能力。

3、然而当前许多个性化tts应用场景,如有声读物旁白、新闻广播、会话助手等,增加了对tts模型建模能力的要求,特别是在未知风格迁移合成方面提出了更高的需求。比如,一个合成发言人可以同时以快乐、悲伤、害怕等多种情感来说话,并且能够支持不同风格(比如新闻播报、有声小说朗读、客服问答等等)的随意切换。 然而,单发言人多风格的语音数据采集难度较大,因此在多风格语音合成方面的相应表现不足。

4、与通常可控的语音合成不同,用于跨领域文本到语音的风格转移旨在从一种声学参考音频(即自定义语音)中生成具有未见过风格(如音色、情感和韵律)的高质量语音样本,但面临两个方面的困难:1)风格建模和转移:情感语音中的高动态范围难以控制和转移。许多tts模型只学习输入数据上的平均分布,并缺乏对语音样本中风格的细粒度控制能力;2)模型泛化:当自定义语音中的风格属性分布与训练数据不同时,合成语音的质量和相似性往往会因分布差异而下降。尽管当前的tts模型已经考虑了提高模型对语音风格建模的能力,但它们未能完全解决上述问题。

5、目前大多数tts的解决方案是采用语音风格建模和迁移的方法,采用语音风格建模和迁移的方法,在捕捉差异化的风格特征方面相当有限,无法同时准确反映说话人身份、情感和韵律范围;另外,这些方法往往得到的风格编码向量包含太多的纠缠信息,导致风格迁移后降低了整体合成语音的稳定性。而为了提升模型建模能力并改善模型泛化问题,多采用数据驱动的方式,而数据驱动解决泛化问题成本高昂而且有的情况下可行性低;风格自适应方案是基于一个假设,即目标语音可以用于模型自适应过程,但是,这种假设在实际生产环节中并不总是成立。

6、因此,目前的方法利用该采集数据制作出的语音合成系统,难以合成未在数据集内出现的语言风格语音,这限制了语音合成系统的泛化能力,在长句合成的时候,韵律合成能力严重下降,另外,语音合成模型在表达性声音中高度动态的风格特征方面,难以进行建模和风格迁移,整句话往往采用一种韵律风格,而缺少音素级别的韵律信息建模能力。

技术实现思路

1、针对上述现有情感语音合成存在的缺陷,本技术的目的在于提供一种能够改善模型泛化能力和韵律合成效果的基于韵律情感迁移的语音合成方法及系统。

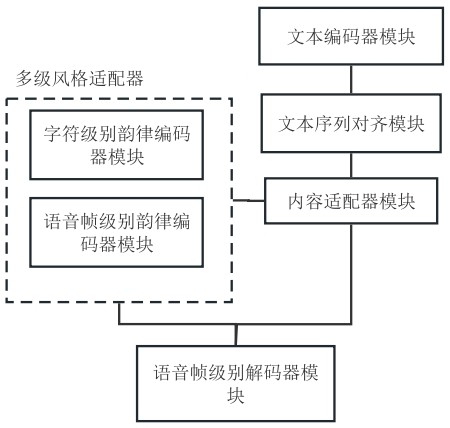

2、根据上述目的,本技术的第一方面,提供了一种基于韵律情感迁移的语音合成系统,所述系统包括:文本编码器模块、序列对齐模块、多级风格适配器、内容适配器模块、解码器模块,其中,

3、所述文本编码器模块,用于将音素级别的文本序列和声调序列通过神经网络模型编码成文本序列级别的编码向量,并输出给所述序列对齐模块;

4、所述序列对齐模块,用于将所述文本序列级别的编码向量由音素长度拓展变化到语音帧长度,获得文本和语音对齐后的帧级别的编码向量,并输出给所述内容适配器模块;

5、所述内容适配器模块,用于对所述帧级别的编码向量中混合的风格信息进行消除处理,以获得标准化后的文本向量,并输出给所述解码器模块;

6、所述多级风格适配器,用于对参考音频从多个尺度进行韵律特征的提取,以捕捉语句中的局部信息和全局信息,得到多尺度下的风格编码向量,并输出给所述解码器模块;

7、所述解码器模块,用于对所述风格编码向量和所述标准化后的文本向量进行解码,解码成具有梅尔声谱特征的语音帧数据。

8、进一步地,捕捉全局信息通过开源的软件语音包来提取说话人编码向量和和情感编码向量,且将它们共同用于所述序列对齐模块中,捕捉局部信息通过字符级别的字符韵律风格提取模块和帧级别的帧韵律风格提取模块来实现,其中,所述字符韵律风格提取模块的输入数据包括提取的语音帧数据,以及语音帧和文本音素的对齐信息,所述帧韵律风格提取模块的输入数据为语音帧数据;其中,通过所述字符韵律风格提取模块和帧韵律风格提取模块提取的向量信息,还与所述内容适配器获得的内容文本向量的长度进行对齐后再输出。

9、进一步地,所述字符韵律风格提取模块和帧韵律风格提取模块共享一个通用的神经网络模型架构,输入数据通过卷积层精细处理后,进入到池化层操作,实现不同尺度下的风格话,池化后的数据输入到离散化向量层,以消除非韵律信息,其中,对帧级别的帧韵律风格提取模块的编码向量去除了池化层的使用,在分别得到字符级别的风格编码向量和帧级别的风格编码向量后,将二者相加,得到所述多尺度下的风格编码向量。

10、进一步地,所述将音素级别的文本序列通过神经网络模型编码成文本序列级别的编码向量,包括:

11、将音素级别的文本序列及音素级别的声调信息分别通过字符嵌入层和声调信息嵌入层的处理,得到各自编码的高维序列向量,并将两种高维序列向量对应相加;

12、通过高维序列向量的长度构建位置信息向量;

13、将相加后形成的文本序列向量和位置信息向量在对应位置相加,相加后的结果送入transformer的编码器模块中,转变为固定长度的所述文本序列级别的编码向量。

14、进一步地,所述序列对齐模块包括:时长预测器和帧级别扩展模块,其中,

15、将所述文本序列级别的编码向量加入说话人编码向量和情感编码向量,然后将三者相加后的编码向量输入到所述时长预测器,预测每个文本音素的持续时长;

16、所述帧级别扩展模块,根据预测的时长,将文本序列级别的编码向量长度按照预测值,拓展到语音帧级别的长度,得到对齐后的所述帧级别的编码向量。

17、进一步地,对所述帧级别的编码向量中混合的风格信息进行消除处理包括:

18、通过全连接层预测对齐后的所述帧级别的编码向量的平均值和标准差;然后通过随机重采样过程,进行编码向量的随机打乱以及重采样,重新构造文本向量,形成标准化后的文本向量。

19、进一步地,所述解码器模块采用了由1维卷积层和全连接层组成的多层结构作为语音帧解码器,还在所述语音帧解码器之后还接入了用于增强语音帧质量的后处理模块。

20、本发明的第二方面,提供了一种基于韵律情感迁移的语音合成方法,所述方法包括:

21、将音素文本序列和声调信息序列输入文本编码器模块,得到文本编码向量;

22、利用第三方提取模块从文本对应的语音帧数据中提取说话人编码向量以及情感编码向量;

23、将所述文本编码向量、说话人编码向量和情感编码向量对应相加,依次进行文本语音序列对齐以及内容适配器模块的处理,获得标准化后的文本编码向量;

24、将文本对应的语音帧信息数据,作为多级风格适配器的输入,并与所述内容适配器模块获得的文本编码向量的长度进行对齐后再输出,获得多尺度下的风格编码向量;

25、将所述风格编码向量与标准化后的文本编码向量相加,作为梅尔声谱解码器的输入,最终获得梅尔声谱特征;

26、将该梅尔声谱特征经过声码器进行转换,变换成语音波形。

27、本技术实施例所公开的一种基于韵律情感迁移的语音合成方法及系统,达到了如下技术效果:

28、针对风格迁移和细粒度韵律建模问题,本技术的系统加入了两个组件,将语音变化分解为与风格无关和风格特定的部分,分别是多级风格适配器和内容适配器模块,多级风格适配器能够有效地建模大范围的风格条件,包括全局说话人和情感特征,以及局部(语句、音素和词级)精细的韵律表示,这种多级风格表示,将自定义语句拆分成了几种属性:语句级别、字符级别、帧级别,不仅能够对韵律进行细粒度建模,而且解决了长句依赖中局部和全局信息的获取问题。本技术在传统tts系统的文本编码器层加入了一种混合风格归一化层,也即内容适配器,内容适配器用于消除语言内容表示中的风格信息,并且预测风格无关的变化,从而提高模型的泛化能力。

本文地址:https://www.jishuxx.com/zhuanli/20240618/22104.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。