基频生成方法、计算机设备和计算机可读存储介质与流程

- 国知局

- 2024-06-21 11:33:35

本技术涉及音频,特别是涉及一种基频生成方法、计算机设备和计算机可读存储介质。

背景技术:

1、随着计算机技术的发展,歌声合成技术逐渐得到广泛应用,为生成逼真的歌曲音频,可以将基频作为歌声合成过程中输入的一个声学特征。

2、在相关技术中,在合成目标歌曲的歌曲音频时,可以获取由其他用户演唱的音频作为参考音频,并通过基频提取工具从参考音频中提取出基频;或者,也可以获取目标歌曲的曲谱,通过曲谱中每个字对应的音高,进行基频预测。

3、然而,上述方式提取得到的基频普遍存在缺少细节信息的情况,例如缺少真实基频所特有的抖动或抑扬顿挫等细节信息,获取的基频准确性较差。

技术实现思路

1、基于此,有必要针对上述技术问题,提供一种能够提升基频提取准确性的基频生成方法、计算机设备和计算机可读存储介质。

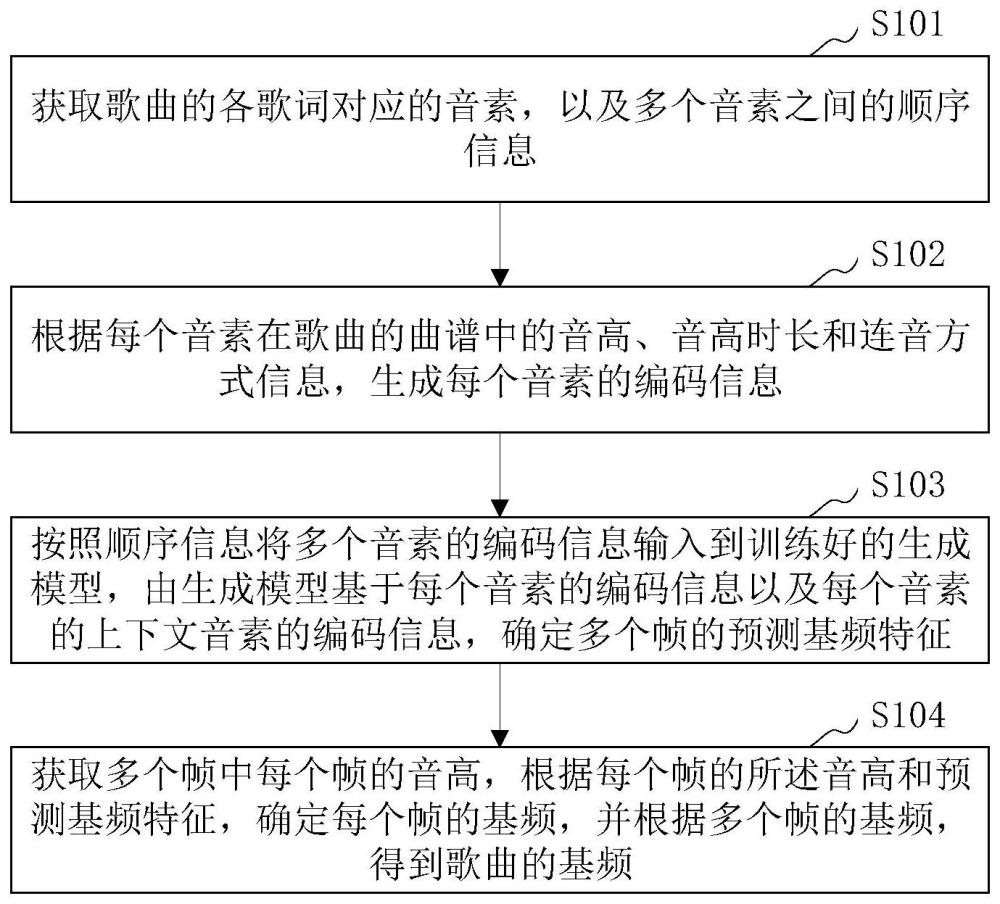

2、第一方面,本技术提供了一种基频生成方法。所述方法包括:

3、获取歌曲的各歌词对应的音素,以及多个音素之间的顺序信息;

4、根据每个音素在所述歌曲的曲谱中的音高、音高时长和连音方式信息,生成所述每个音素的编码信息;

5、按照所述顺序信息将所述多个音素的编码信息输入到训练好的生成模型,由所述生成模型基于每个音素的编码信息以及所述每个音素的上下文音素的编码信息,确定多个帧的预测基频特征;所述每个音素的上下文音素基于所述多个音素之间的顺序信息确定,所述多个帧的总时长与所述歌曲的时长对应;

6、获取所述多个帧中每个帧的音高,根据所述每个帧的所述音高和所述预测基频特征,确定所述每个帧的基频,并根据所述多个帧的基频,得到所述歌曲的基频。

7、在其中一个实施例中,所述由所述生成模型基于每个音素的编码信息以及所述每个音素的上下文音素的编码信息,确定多个帧的预测基频特征,包括:

8、由所述生成模型基于每个音素的编码信息以及所述每个音素的上下文音素的编码信息,确定所述每个音素的音素级别基频特征;

9、获取目标用户的音色特征,并将每个音素的音素级别基频特征与所述目标用户的音色特征进行融合,得到所述每个音素的融合后的音素级别基频特征;

10、基于所述每个音素的音素时长,将所述每个音素的融合后的音素级别基频特征映射为多个帧级别的基频特征;

11、基于多个音素对应的帧级别的基频特征,获取多个帧的预测基频特征。

12、在其中一个实施例中,所述生成模型包括多个自注意力模块,所述多个自注意力模块用于对所述多个音素的编码信息进行不同维度的特征提取;

13、所述由所述生成模型基于每个音素的编码信息以及所述每个音素的上下文音素的编码信息,确定所述每个音素的音素级别基频特征,包括:

14、由所述生成模型对输入到每个自注意力模块的每个音素的编码信息,以及所述每个音素的上下文音素的编码信息,进行自注意力计算,得到每个自注意力模块在对应维度下的特征提取结果;

15、根据各个自注意力模块的特征提取结果,确定所述每个音素对应的音素级别基频特征。

16、在其中一个实施例中,所述基于所述每个音素的音素时长,将所述每个音素的融合后的音素级别基频特征映射为多个帧级别的基频特征,包括:

17、基于预设帧时长和所述每个音素的音素时长,确定所述每个音素的帧数量;

18、根据所述每个音素的帧数量,对所述每个音素的融合后的音素级别基频特征进行复制,得到所述每个音素对应的多个帧级别的基频特征。

19、在其中一个实施例中,所述生成模型还包括时长规整网络以及连接在所述时长规整网络之后的残差网络,所述每个音素的融合后的音素级别基频特征通过所述时长规整网络映射为多个帧级别的基频特征;

20、所述基于多个音素对应的帧级别的基频特征,获取多个帧的预测基频特征,包括:

21、将所述时长规整网络输出的所述多个音素对应的帧级别的基频特征输入到所述残差网络,依次由所述残差网络对每个音素对应的帧级别的基频特征进行从首个残差块到最后一个残差块的特征传递,得到多个帧的预测基频特征。

22、在其中一个实施例中,所述获取所述多个帧中每个帧的音高,包括:

23、根据所述歌曲的曲谱获取所述歌曲的每个音符的音高,以及每个音符的音高时长;

24、基于所述每个音符的音高时长,将所述每个音符的音高映射为多个帧的音高。

25、在其中一个实施例中,所述根据所述每个帧的所述音高和所述预测基频特征,确定所述每个帧的基频,包括:

26、根据所述每个帧的音高确定所述每个帧的初始基频;

27、根据所述每个帧的预测基频特征对所述每个帧的初始基频进行调整,得到所述每个帧的基频。

28、在其中一个实施例中,所述生成模型通过如下步骤训练得到:

29、获取样本歌曲的各歌词对应的样本音素;

30、根据每个样本音素在所述样本歌曲的曲谱中的音高、音高时长和连音方式信息,生成所述每个样本音素的编码信息;

31、获取待训练的生成器和判别器,并按照多个样本音素之间的顺序信息将所述多个样本音素的编码信息输入到所述生成器,由所述生成器基于每个样本音素的编码信息以及所述每个样本音素的上下文样本音素的编码信息,确定多个帧的样本预测基频特征;所述每个样本音素的上下文样本音素基于所述多个样本音素之间的顺序信息确定,所述多个帧的总时长与所述歌曲样本的时长对应;

32、获取所述多个帧中每个帧对应于所述样本歌曲的音高,根据所述每个帧对应于所述样本歌曲的音高和所述样本预测基频特征,确定所述每个帧的基频,并根据所述多个帧的基频,得到所述样本歌曲的预测基频;

33、根据所述预测基频和所述样本歌曲的基频标签,对所述生成器和判别器进行对抗训练,并在满足训练结束条件时,将所述生成器确定为所述生成模型。

34、在其中一个实施例中,所述根据所述预测基频和所述样本歌曲的基频标签,对所述生成器和判别器进行对抗训练,包括:

35、将所述样本歌曲的预测基频输入到当前判别器,由所述当前判别器获取所述预测基频为真实基频的预测概率;

36、基于所述预测概率对所述当前判别器进行调整;以及,

37、基于所述预测概率、所述预测基频和所述基频标签,确定当前生成器的损失值,并根据所述损失值对所述当前生成器的模型参数进行调整。

38、在其中一个实施例中,所述将所述样本歌曲的预测基频输入到当前判别器,由所述当前判别器获取所述预测基频为真实基频的预测概率,包括:

39、将所述样本歌曲的预测基频输入到当前判别器,由所述当前判别器从所述预测基频中随机截取预设长度的目标基频,并将所述目标基频变换为多种不同结构的二维矩阵;

40、将每种二维矩阵分别输入到对应的子判别器,由所述子判别器获取所述预测基频为真实基频的子概率;

41、根据各个子判别器输出的子概率,获取所述样本歌曲的预测基频为真实基频的预测概率。

42、第二方面,本技术还提供了一种计算机设备。所述计算机设备包括存储器和处理器,所述存储器存储有计算机程序,所述处理器执行所述计算机程序时实现以下步骤:

43、获取歌曲的各歌词对应的音素,以及多个音素之间的顺序信息;

44、根据每个音素在所述歌曲的曲谱中的音高、音高时长和连音方式信息,生成所述每个音素的编码信息;

45、按照所述顺序信息将所述多个音素的编码信息输入到训练好的生成模型,由所述生成模型基于每个音素的编码信息以及所述每个音素的上下文音素的编码信息,确定多个帧的预测基频特征;所述每个音素的上下文音素基于所述多个音素之间的顺序信息确定,所述多个帧的总时长与所述歌曲的时长对应;

46、获取所述多个帧中每个帧的音高,根据所述每个帧的所述音高和所述预测基频特征,确定所述每个帧的基频,并根据所述多个帧的基频,得到所述歌曲的基频。

47、第三方面,本技术还提供了一种计算机可读存储介质。所述计算机可读存储介质,其上存储有计算机程序,所述计算机程序被处理器执行时实现以下步骤:

48、获取歌曲的各歌词对应的音素,以及多个音素之间的顺序信息;

49、根据每个音素在所述歌曲的曲谱中的音高、音高时长和连音方式信息,生成所述每个音素的编码信息;

50、按照所述顺序信息将所述多个音素的编码信息输入到训练好的生成模型,由所述生成模型基于每个音素的编码信息以及所述每个音素的上下文音素的编码信息,确定多个帧的预测基频特征;所述每个音素的上下文音素基于所述多个音素之间的顺序信息确定,所述多个帧的总时长与所述歌曲的时长对应;

51、获取所述多个帧中每个帧的音高,根据所述每个帧的所述音高和所述预测基频特征,确定所述每个帧的基频,并根据所述多个帧的基频,得到所述歌曲的基频。

52、第四方面,本技术还提供了一种计算机程序产品。所述计算机程序产品,包括计算机程序,该计算机程序被处理器执行时实现以下步骤:

53、获取歌曲的各歌词对应的音素,以及多个音素之间的顺序信息;

54、根据每个音素在所述歌曲的曲谱中的音高、音高时长和连音方式信息,生成所述每个音素的编码信息;

55、按照所述顺序信息将所述多个音素的编码信息输入到训练好的生成模型,由所述生成模型基于每个音素的编码信息以及所述每个音素的上下文音素的编码信息,确定多个帧的预测基频特征;所述每个音素的上下文音素基于所述多个音素之间的顺序信息确定,所述多个帧的总时长与所述歌曲的时长对应;

56、获取所述多个帧中每个帧的音高,根据所述每个帧的所述音高和所述预测基频特征,确定所述每个帧的基频,并根据所述多个帧的基频,得到所述歌曲的基频。

57、上述基频生成方法、计算机设备和计算机可读存储介质,可以获取歌曲的各歌词对应的音素,以及多个音素之间的顺序信息,并根据每个音素在歌曲的曲谱中的音高、音高时长和连音方式信息,生成每个音素的编码信息;进而,可以按照顺序信息将多个音素的编码信息输入到训练好的生成模型,由生成模型基于每个音素的编码信息以及每个音素的上下文音素的编码信息,确定多个帧的预测基频特征,其中,每个音素的上下文音素基于多个音素之间的顺序信息确定,多个帧的总时长与歌曲的时长对应;且可以获取多个帧中每个帧的音高,然后根据每个帧的音高和预测基频特征,确定每个帧的基频,并根据多个帧的基频,得到歌曲的基频。在本技术中,一方面,基于音素以及音素上下文的编码信息生成预测基频特征,使得预测基频特征可以受到上下文音素的影响,增加了预测基频特征与上下文音素之间的关联性,避免孤立地分析每个音素的基频,有效获取到基频准确的细节信息,另一方面,通过获取多个帧的预测基频特征并结合多个帧中每个帧的音高确定每帧的基频,细化了基频的分析粒度,能够为歌曲整体的基频补充更多细节信息,从而提升了基频提取结果的准确性,使最终预测得到的基频更加贴近歌曲被演唱时真实的基频曲线。

本文地址:https://www.jishuxx.com/zhuanli/20240618/22241.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表