基于矢量预测与融合技术的端到端语音编码方法和系统与流程

- 国知局

- 2024-06-21 11:33:31

本发明属于语音处理领域,具体涉及一种基于矢量预测与融合技术的端到端语音编码方法和系统

背景技术:

1、语音通信中,输入语音经过编码端从中提取出语音信号的特征参数,然后利用量化器对提取的特征参数进行量化,达到压缩数据量的目的。解码端对特征参数进行解量化并重建语音信号。随着编码码率的降低,量化比特数减少,导致量化误差增大,进而影响重建语音的质量。尤其是在编码码率低至1.2kbps及以下时,传统语音编码方法的重建语音质量受损更为严重,通常表现为重建语音自然度低并伴随着机械音,严重影响通信质量。

2、近年来,深度学习方法被应用于语音编码领域,端到端语音编码在编码质量方面超越了传统语音编码方法。现有的端到端语音编码方法在编码端从输入语音信号中提取高维特征矢量,并对其进行矢量量化;在解码端从解量化的高维特征矢量重建语音信号。为了对特征矢量进行高效高质量的量化,现有端到端语音编码方案一般采取残差矢量量化(residual vector quantization,rvq)、分裂矢量量化技术(split vectorquantization,svq)或者上述二者的结合。其中,rvq采用多级码本对特征矢量逐级进行量化,下一级量化的对象是上一级量化的误差矢量,由此逐渐降低量化误差,达到提升量化精度的目的。svq是将高维矢量分裂成若干维度较低的子矢量,再对各个子矢量分别进行矢量量化,由此降低码本存储空间和码本搜索的计算复杂度。但是,由于端到端语音编码所提取的特征矢量具有维度高、数量大的特点,尽管采用了上述量化技术,其量化过程的存储复杂度和计算复杂度仍然很高。

3、本发明解决现有端到端语音编码方案中特征矢量量化所需计算和存储复杂度高的问题,同时保证重建语音质量不降低。

技术实现思路

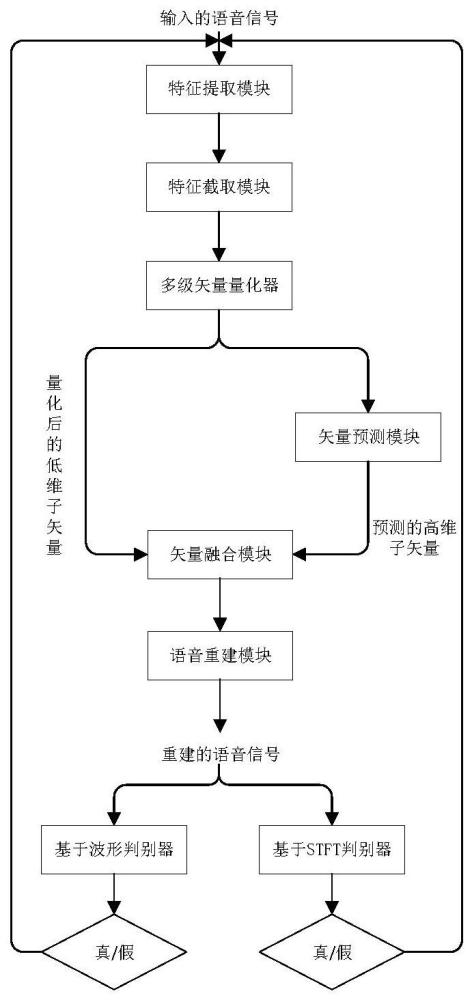

1、本发明提供了一种基于矢量预测与融合技术的端到端语音编码方法,可以减少现有端到端语音编码器中内部特征矢量量化所需的存储复杂度和计算复杂度;同时又能保证重建语音质量。该方法包括以下步骤:

2、步骤1,采用特征提取模块,从输入语音信号提取特征矢量;

3、步骤2,将步骤1所得到的特征矢量分裂为维度相等的两个子矢量,分别为高维子矢量和低维子矢量;

4、步骤3,将步骤2得到的两个子矢量中的一个进行多级残差矢量量化,并对量化值进行编码;

5、步骤4,解码和解量化,得到重建的低维或高维子矢量,将其送入矢量预测模块,预测得到高维或低维子矢量;

6、步骤5,将重建的低维或高维子矢量和预测得到的高维或低维子矢量送入矢量融合模块,得到原始维度的特征矢量;

7、步骤6,将步骤5得到的特征矢量通过语音重建模块还原出语音信号。

8、进一步的,特征提取模块包括若干个一维因果卷积和编码模块,其中一维因果卷积用于学习特征,编码模块由一层一维因果卷积和残差块组成,残差块是由不同膨胀率的残差单元组成,残差单元由一个一维膨胀卷积和一维因果卷积构成。

9、进一步的,矢量预测模块包括多个基于transformer的多头注意力模块。

10、进一步的,步骤5的具体实现方式如下;

11、步骤5.1,将步骤3量化后的子矢量和步骤4得到的预测子矢量拼接后进行基于时间维度的最大池化和平均池化,得到两个大小相等的权值向量,再将这两个权值向量按照时间维度进行拼接,利用一维卷积、leaky relu激活函数,再经过一层一维卷积和sigmoid函数得到融合权值向量;

12、步骤5.2,将步骤3量化后的子矢量和步骤4得到的预测子矢量拼接后进行基于通道维进行平均池化得到权值向量,然后将权值向量通过两层全连接层和sigmoid激活函数,得到最终的权值向量;

13、步骤5.3,将步骤5.1和步骤5.2的权值向量与原始输入进行融合得到经过矢量融合模块的特征矢量。

14、进一步的,语音重建模块由若干个一维因果卷积和解码模块构成,解码模块包含转置因果卷积和残差模块,残差模块包含不同膨胀率的残差单元层,残差单元由一个一维膨胀卷积和一维因果卷积构成,每个解码模块中通道数不相同。

15、进一步的,还包括步骤7,将步骤6生成的语音信号和原始的语音信号一起输入至基于波形和基于stft的判别器,进行真假判别,在训练过程中使得生成器更好地还原语音信号,所述生成器即步骤1-步骤6构成的整体模型。

16、进一步的,基于波形的判别器首先对输入的语音信号进行下采样处理,分别得到不同的下采样语音信号:原始语音信号,2倍下采样语音信号,4倍下采样语音信号,然后对下采样语音信号分别进行如下处理:先经过普通卷积处理,然后是四层下采样层,每层下采样都是一维卷积,下采样后的结果将经过一层卷积得到特征图,再经过一层卷积得到最终预测结果。

17、进一步的,基于stft的判别器是在一个单一的尺度上运行,首先计算stft的窗长为w和窗高h,判别器包含2个二维卷积和一系列残差单元,每个残差单元包含两层二维卷积层,总共有6个残差单元,在最后一个残差单元的输出处、激活的形状为t/(h-23)×f/26,其中t是时域中的样本数,f=w/2是频率维的数目,最后一层通过卷积核为1×f/26的二维卷积将不同频率维的值进行聚合,以在下采样的时域中获得一维信号,表示该波形是重建语音还是真实语音。

18、本发明还提供一种基于矢量预测与融合技术的端到端语音编码系统,包括如下单元:

19、特征提取单元,用于采用特征提取模块,从输入语音信号提取特征矢量;

20、特征矢量分裂单元,用于将得到的特征矢量分裂为维度相等的两个子矢量,分别为高维子矢量和低维子矢量;

21、量化编码单元,用于将得到的两个子矢量中的一个进行多级残差矢量量化,并对量化值进行编码;

22、矢量预测单元,用于解码和解量化,得到重建的低维或高维子矢量,将其送入矢量预测模块,预测得到高维或低维子矢量;

23、矢量融合单元,用于将重建的低维或高维子矢量和预测得到的高维或低维子矢量送入矢量融合模块,得到原始维度的特征矢量;

24、语音重建单元,用于将得到的特征矢量通过语音重建模块还原出语音信号。

25、与现有技术相比,本方法在相同码率、相同音质下,可使特征矢量量化所需存储空间下降一半,同时节省码本计算资源。

技术特征:1.基于矢量预测与融合技术的端到端语音编码方法,其特征在于,包括如下步骤:

2.如权利要求1所述的基于矢量预测与融合技术的端到端语音编码方法,其特征在于:特征提取模块包括若干个一维因果卷积和编码模块,其中一维因果卷积用于学习特征,编码模块由一层一维因果卷积和残差块组成,残差块是由不同膨胀率的残差单元组成,残差单元由一个一维膨胀卷积和一维因果卷积构成。

3.如权利要求1所述的基于矢量预测与融合技术的端到端语音编码方法,其特征在于:矢量预测模块包括多个基于transformer的多头注意力模块。

4.如权利要求1所述的基于矢量预测与融合技术的端到端语音编码方法,其特征在于:步骤5的具体实现方式如下;

5.如权利要求1所述的基于矢量预测与融合技术的端到端语音编码方法,其特征在于:语音重建模块由若干个一维因果卷积和解码模块构成,解码模块包含转置因果卷积和残差模块,残差模块包含不同膨胀率的残差单元层,残差单元由一个一维膨胀卷积和一维因果卷积构成,每个解码模块中通道数不相同。

6.如权利要求1所述的基于矢量预测与融合技术的端到端语音编码方法,其特征在于:还包括步骤7,将步骤6生成的语音信号和原始的语音信号一起输入至基于波形和基于stft的判别器,进行真假判别,在训练过程中使得生成器更好地还原语音信号,所述生成器即步骤1-步骤6构成的整体模型。

7.如权利要求6所述的基于矢量预测与融合技术的端到端语音编码方法,其特征在于:基于波形的判别器首先对输入的语音信号进行下采样处理,分别得到不同的下采样语音信号:原始语音信号,2倍下采样语音信号,4倍下采样语音信号,然后对下采样语音信号分别进行如下处理:先经过普通卷积处理,然后是四层下采样层,每层下采样都是一维卷积,下采样后的结果将经过一层卷积得到特征图,再经过一层卷积得到最终预测结果。

8.如权利要求6所述的基于矢量预测与融合技术的端到端语音编码方法,其特征在于:基于stft的判别器是在一个单一的尺度上运行,首先计算stft的窗长为w和窗高h,判别器包含2个二维卷积和一系列残差单元,每个残差单元包含两层二维卷积层,总共有6个残差单元,在最后一个残差单元的输出处、激活的形状为t/(h-23)×f/26,其中t是时域中的样本数,f=w/2是频率维的数目,最后一层通过卷积核为1×f/26的二维卷积将不同频率维的值进行聚合,以在下采样的时域中获得一维信号,表示该波形是重建语音还是真实语音。

9.基于矢量预测与融合技术的端到端语音编码系统,其特征在于,包括如下单元:

技术总结本发明提供一种基于矢量预测与融合技术的端到端语音编码方法和系统,包括:采用特征提取模块,从输入语音信号提取特征矢量;将得到的特征矢量分裂为维度相等的两个子矢量,分别为高维子矢量和低维子矢量;将得到的两个子矢量中的一个进行多级残差矢量量化,并对量化值进行编码;解码和解量化,得到重建的低维或高维子矢量,将其送入矢量预测模块,预测得到高维或低维子矢量;将重建的低维或高维子矢量和预测得到的高维或低维子矢量送入矢量融合模块,得到原始维度的特征矢量;将得到的特征矢量通过语音重建模块还原出语音信号。与现有技术相比,本方法在相同码率、相同音质下,可使特征矢量量化所需存储空间下降一半,同时节省码本计算资源。技术研发人员:涂卫平,郑友强,肖立受保护的技术使用者:湖北珞珈实验室技术研发日:技术公布日:2024/3/11本文地址:https://www.jishuxx.com/zhuanli/20240618/22231.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。