一种语音合成方法、装置、电子设备及存储介质与流程

- 国知局

- 2024-06-21 11:36:48

本公开涉及计算机,尤其涉及一种语音合成方法、装置、电子设备及存储介质。

背景技术:

1、语音合成(text-to-speech,tts)是智能语音交互的核心技术之一。通过将接收到的文字序列转换为自然逼真的语音波形,反馈传递给用户。语音合成技术直接影响着人机交互的实际使用效果。

2、随着深度学习的发展,现有的语音合成方法已经取得了较好的效果。传统的语音合成方法通常使用旋律谱图作为中间表示。神经声码器的最新进展促使tts方法将音频波形转换为离散编码作为中间表示法。这些tts系统可大致分为自回归框架和非自回归框架两类。这两者都以语音合成为目标。例如,vall-e是第一个基于语言模型的大规模tts框架,它具有上下文学习能力,可实现零镜头语音合成。naturalspeech2是一个基于潜在扩散模型的非自回归tts框架。

3、然而,这些方法均为有监督任务方法,依赖于大量标记的文本-语音对。在样本量较少的情况下,这些方法的语音合成效果则不尽如人意。

技术实现思路

1、本公开提供一种语音合成方法、装置、电子设备及存储介质,解决了现有语音合成方法在依赖大量标记的文本-语音对的问题。

2、本公开第一方面提供一种语音合成方法,包括:

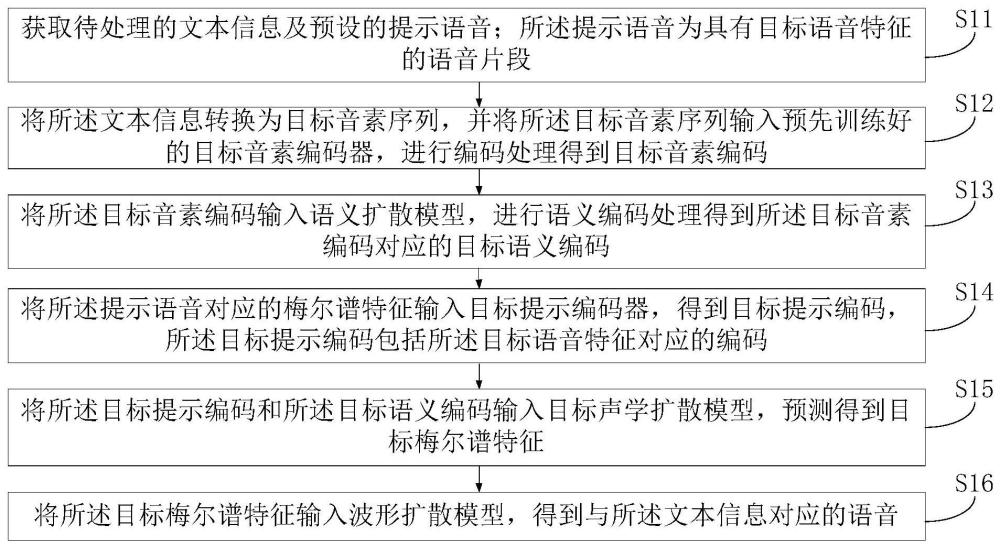

3、获取待处理的文本信息及预设的提示语音;所述提示语音为具有目标语音特征的语音片段;

4、将所述文本信息转换为目标音素序列,并将所述目标音素序列输入预先训练好的目标音素编码器,进行编码处理得到目标音素编码;

5、将所述目标音素编码输入语义扩散模型,进行语义编码处理得到所述目标音素编码对应的目标语义编码;

6、将所述提示语音对应的梅尔谱特征输入目标提示编码器,得到目标提示编码,所述目标提示编码包括所述目标语音特征对应的编码;

7、将所述目标提示编码和所述目标语义编码输入目标声学扩散模型,预测得到目标梅尔谱特征;

8、将所述目标梅尔谱特征输入波形扩散模型,得到与所述文本信息对应的语音,所述语音具有所述目标语音特征。

9、可选地,所述将所述文本信息转换为目标音素序列,包括:

10、将所述文本信息转换为对应的初始音素序列;

11、将所述初始音素序列输入时长扩散模型,预测得到所述初始音素序列的第一总发音时长,并根据所述第一总发音时长预测所述初始音素序列中各个音素的发音时间段,得到目标音素序列。

12、可选地,所述目标音素编码器通过以下方法训练得到:

13、获取由文本样本和与所述文本样本匹配的语音样本组成的样本对;

14、将基于所述文本样本得到的样本音素序列输入预设的初始音素编码器进行编码处理,得到样本音素编码;

15、将所述语音样本对应的梅尔谱特征输入预设的初始语音编码器进行编码处理,得到样本语音编码;

16、将所述样本音素编码和所述样本语音编码进行对比学习,得到对比损失;

17、截取所述语音样本中的任意一个语音片段,并将所述语音片段的梅尔谱特征输入初始提示编码器,得到样本提示编码;

18、将所述样本音素编码、所述样本语音编码和所述样本提示编码输入联合解码器,分别预测得到所述样本音素编码的预测音素梅尔谱特征、所述样本语音编码的预测语音梅尔谱特征;

19、确定所述预测音素梅尔谱和预设的真实音素梅尔谱之间的损失值,所述预测语音梅尔谱和预设的真实语音梅尔谱之间的损失值,分别得到音素损失和语音损失;

20、基于所述对比损失、所述音素损失和所述语音损失,训练所述初始音素编码器,得到目标音素编码器。

21、可选地,所述将基于所述文本样本得到的音素序列输入初始音素编码器,进行编码处理得到所述文本样本的样本音素编码,包括:

22、将所述文本样本转换为对应的音素序列,得到预样本音素序列;

23、获取所述语音样本的时长,并根据所述语音样本的时长调整所述预样本音素序列中各个音素的音素时间段,得到样本音素序列;

24、将所述样本音素序列输入初始音素编码器,进行编码处理得到所述文本样本的样本音素编码。

25、可选地,所述样本音素编码的时长与所述样本语音编码的长度相同,所述将所述样本音素编码和所述样本语音编码进行对比学习,得到对比损失,包括:

26、将所述样本音素编码和所述样本语音编码分别重置为二维矩阵,得到二维音素编码矩阵和二维语音编码矩阵;

27、将所述二维语音编码矩阵中各个位置的语音编码输入所述初始音素编码器,得到多个预测音素编码,并将所述二维音素编码矩阵中各个位置的音素编码输入初始语音编码器,得到多个预测语音编码;

28、将所述二维音素编码矩阵和所述二维语音编码矩阵中,相同位置处的音素编码和语音编码作为正样本对,根据所述正样本对,获取各个所述预测音素编码对应的真实音素编码、各个所述预测语音编码对应的真实语音编码;

29、确定所述预测音素编码和所述真实音素编码之间的第一差值、所述预测语音编码和所述真实语音编码之间的第二差值,并将所述第一差值作为训练所述初始音素编码器的对比损失,将所述第二差值作为训练所述初始语音编码器的对比损失。

30、可选地,所述将所述文本信息转换为目标音素序列,包括:

31、将所述文本信息转换为对应的初始音素序列;

32、将所述初始音素序列和多个随机噪声输入时长扩散模型,预测得到所述初始音素序列对应的多个总发音时长;

33、分别根据各个所述总发音时长预测所述初始音素序列中各个音素的发音时间段,得到多个目标音素序列。

34、可选地,所述目标声学扩散模型通过以下方法训练得到:

35、获取提示编码样本和语义编码样本,设置用于扩散训练的时间步长;

36、设置用于在每个时间步提取随机噪声的目标高斯分布;所述目标高斯分布的波形与标签梅尔谱的波形一致,所述标签梅尔谱为所述提示编码样本和语义编码样本对应的真实梅尔谱;

37、将所述提示编码样本、所述语义编码样本、所述目标高斯分布和所述时间步长输入初始声学扩散模型,预测得到当前时间步对应的当前预测噪声;

38、确定所述当前预测噪声和所述当前时间步提取的随机噪声之间的差值;

39、将所述差值作为损失值,利用所述损失值训练所述声学扩散模型,得到目标声学扩散模型。

40、本公开第二方面提供一种语音合成装置,包括:

41、获取模块,被配置为执行获取待处理的文本信息及预设的提示语音;所述提示语音为具有目标语音特征的语音片段;

42、音素编码生成模块,被配置为执行将所述文本信息转换为目标音素序列,并将所述目标音素序列输入预先训练好的目标音素编码器,进行编码处理得到目标音素编码;

43、语义编码生成模块,被配置为执行将所述目标音素编码输入语义扩散模型,进行语义编码处理得到所述目标音素编码对应的目标语义编码;

44、提示编码生成模块,被配置为执行将所述提示语音对应的梅尔谱特征输入目标提示编码器,得到目标提示编码,所述目标提示编码包括所述目标语音特征对应的编码;

45、预测模块,被配置为执行将所述目标提示编码和所述目标语义编码输入目标声学扩散模型,预测得到目标梅尔谱特征;

46、语音生成模块,被配置为执行将所述目标梅尔谱特征输入波形扩散模型,得到与所述文本信息对应的语音,所述语音具有所述目标语音特征。

47、可选地,所述音素编码生成模块具体被配置为执行:

48、将所述文本信息转换为对应的初始音素序列;

49、将所述初始音素序列输入时长扩散模型,预测得到所述初始音素序列的第一总发音时长,并根据所述第一总发音时长预测所述初始音素序列中各个音素的发音时间段,得到目标音素序列。

50、可选地,所述装置还包括目标音素编码器训练模块,所述目标音素编码器训练模块被配置为执行:

51、获取由文本样本和与所述文本样本匹配的语音样本组成的样本对;

52、将基于所述文本样本得到的样本音素序列输入预设的初始音素编码器进行编码处理,得到样本音素编码;

53、将所述语音样本对应的梅尔谱特征输入预设的初始语音编码器进行编码处理,得到样本语音编码;

54、将所述样本音素编码和所述样本语音编码进行对比学习,得到对比损失;

55、截取所述语音样本中的任意一个语音片段,并将所述语音片段的梅尔谱特征输入初始提示编码器,得到样本提示编码;

56、将所述样本音素编码、所述样本语音编码和所述样本提示编码输入联合解码器,分别预测得到所述样本音素编码的预测音素梅尔谱特征、所述样本语音编码的预测语音梅尔谱特征;

57、确定所述预测音素梅尔谱和预设的真实音素梅尔谱之间的损失值,所述预测语音梅尔谱和预设的真实语音梅尔谱之间的损失值,分别得到音素损失和语音损失;

58、基于所述对比损失、所述音素损失和所述语音损失,训练所述初始音素编码器,得到目标音素编码器。

59、可选地,所述目标音素编码器训练模块具体被配置为执行:

60、将所述文本样本转换为对应的音素序列,得到预样本音素序列;

61、获取所述语音样本的时长,并根据所述语音样本的时长调整所述预样本音素序列中各个音素的音素时间段,得到样本音素序列;

62、将所述样本音素序列输入初始音素编码器,进行编码处理得到所述文本样本的样本音素编码。

63、可选地,所述目标音素编码器训练模块具体被配置为执行:

64、将所述样本音素编码和所述样本语音编码分别重置为二维矩阵,得到二维音素编码矩阵和二维语音编码矩阵;

65、将所述二维语音编码矩阵中各个位置的语音编码输入所述初始音素编码器,得到多个预测音素编码,并将所述二维音素编码矩阵中各个位置的音素编码输入初始语音编码器,得到多个预测语音编码;

66、将所述二维音素编码矩阵和所述二维语音编码矩阵中,相同位置处的音素编码和语音编码作为正样本对,根据所述正样本对,获取各个所述预测音素编码对应的真实音素编码、各个所述预测语音编码对应的真实语音编码;

67、确定所述预测音素编码和所述真实音素编码之间的第一差值、所述预测语音编码和所述真实语音编码之间的第二差值,并将所述第一差值作为训练所述初始音素编码器的对比损失,将所述第二差值作为训练所述初始语音编码器的对比损失。

68、可选地,所述音素编码生成模块具体被配置为执行:

69、将所述文本信息转换为对应的初始音素序列;

70、将所述初始音素序列和多个随机噪声输入时长扩散模型,预测得到所述初始音素序列对应的多个总发音时长;

71、分别根据各个所述总发音时长预测所述初始音素序列中各个音素的发音时间段,得到多个目标音素序列。

72、可选地,所述装置还包括目标声学扩散模型训练模块,所述目标声学扩散模型训练模块被配置为执行:

73、获取提示编码样本和语义编码样本,设置用于扩散训练的时间步长;

74、设置用于在每个时间步提取随机噪声的目标高斯分布;所述目标高斯分布的波形与标签梅尔谱的波形一致,所述标签梅尔谱为所述提示编码样本和语义编码样本对应的真实梅尔谱;

75、将所述提示编码样本、所述语义编码样本、所述目标高斯分布和所述时间步长输入初始声学扩散模型,预测得到当前时间步对应的当前预测噪声;

76、确定所述当前预测噪声和所述当前时间步提取的随机噪声之间的差值;

77、将所述差值作为损失值,利用所述损失值训练所述声学扩散模型,得到目标声学扩散模型。

78、根据本公开的第三方面,提供一种电子设备,电子设备包括:

79、处理器;

80、用于存储处理器可执行指令的存储器;其中,处理器被配置为执行指令,以实现上述第一方面中任一种语音合成方法。

81、根据本公开的第四方面,提供一种计算机可读存储介质,计算机可读存储介质上存储有指令,当计算机可读存储介质中的指令由电子设备的处理器执行时,使得电子设备能够执行上述第一方面中任一种可选地语音合成方法。

82、根据本公开的第五方面,提供一种计算机程序产品,包含指令,当其在电子设备上运行时,使得电子设备执行如第一方面中任一种语音合成方法。

83、本公开提供的技术方案至少带来以下有益效果:

84、在本公开实施例中,获取待处理的文本信息及预设的提示语音;所述提示语音为具有目标语音特征的语音片段;将所述文本信息转换为目标音素序列,并将所述目标音素序列输入预先训练好的目标音素编码器,进行编码处理得到目标音素编码;将所述目标音素编码输入语义扩散模型,进行语义编码处理得到所述目标音素编码对应的目标语义编码;将所述提示语音对应的梅尔谱特征输入目标提示编码器,得到目标提示编码,所述目标提示编码包括所述目标语音特征对应的编码;将所述目标提示编码和所述目标语义编码输入目标声学扩散模型,预测得到目标梅尔谱特征;将所述目标梅尔谱特征输入波形扩散模型,得到与所述文本信息对应的语音,所述语音具有所述目标语音特征。本方案先将文本信息转换为目标音素序列,再将目标音素编码转换为目标语义编码,从而将传统的tts从文本到语音的直接预测,拆分成了先从文本预测到语义编码预测,再从语义编码预测到语音预测的过程。从文本预测到语义编码预测是有监督过程,从语义编码预测到语音预测是无监督过程。这样的架构下可以使用大量的无标注的纯音频数据,去训练从语义编码预测到语音预测的过程,而使用少量的有监督的文本数据去训练从文本预测到语义编码预测,进而实现了少监督的tts,降低了对样本量的依赖度,在少样本的情况下,仍然能够达到很好的语音合成效果。

85、应当理解的是,以上的一般描述和后文的细节描述仅是示例性和解释性的,并不能限制本公开。

本文地址:https://www.jishuxx.com/zhuanli/20240618/22414.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表