一种基于大模型的语音合成方法、系统、设备及存储介质与流程

- 国知局

- 2024-06-21 11:44:40

本发明涉及人工智能,具体提供一种基于大模型的语音合成方法、系统、设备及存储介质。

背景技术:

1、在直播带货,ai助手等数字人人机交互应用场景中,语言大模型需要首先生成文字,然后由语音合成tts引擎系统合成文字对应的语音。

2、目前主流的语音合成模组是使用一套粒度低,单元之间相关性低的声学单元模组来强化语音合成模型的学习效果,比如中文的声韵母或者粒度更细的国际音标建模(ipa)。然而在实际使用时,仅靠声学单元的建模方法无法充分处理语义、情感、多音字方面上对于合成语音的影响。

3、此外,用户或者语言大模型输入的均为文本信息,基于声学单元建模的传统语音合成tts系统需要额外内置文本前端模型,比如文本正则、韵律分析、文本转发音等模块将文本映射到发音单元上才能将输入的文本转换成发音单元进而合成对应的语音。每一个单独的文本前端模型因使用不同的算法结构和训练数据,不仅维护成本高,而且串联时带来的累积误差依旧会生成出发音不标准,韵律不自然的语音。这一点在与语言大模型交互时影响更为严重:一旦文本内容中包含生僻字,或尚未被处理的文本正则规则的文本,语音合成模型就会合成不自然的读法、错误的发音、多字或少字的音频,这些错误会严重影响用户对语音内容的理解。

4、同时,采用声学单元建模的语音系统虽然在输入正确发音时发音拟人,但该训练范式严重依赖高质量的、录制风格多样的、标注精细的语音数据。这些数据不仅收集困难,成本高,在实际算法落地的过程中包含了真实应用场景的全量范围,进而消极影响语音合成模型的鲁棒性。

5、因此,如何解决传统语音合成系统的文本前端对于发音、韵律单独建模所造成的语音合成准确度低的技术问题。

技术实现思路

1、为了克服上述缺陷,提出了本发明,以提供解决或至少部分地解决传统语音合成系统的文本前端对于发音、韵律单独建模所造成的语音合成准确度低的技术问题。

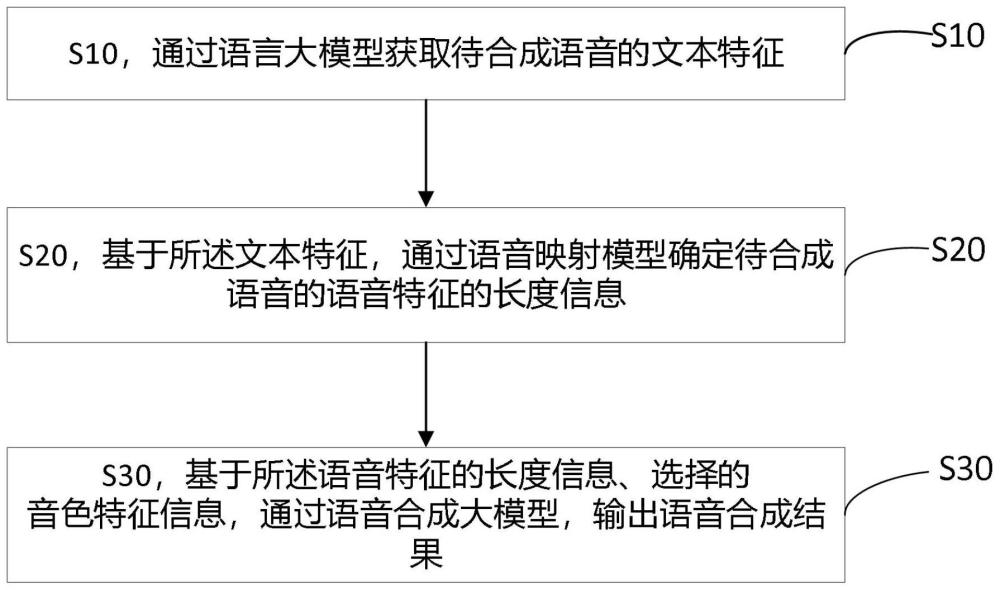

2、在第一方面,本发明提供了一种基于大模型的语音合成方法,包括:

3、通过语言大模型获取待合成语音的文本特征;

4、基于所述文本特征,通过语音映射模型确定待合成语音的语音特征的长度信息;

5、基于所述语音特征的长度信息、选择的音色特征信息,通过语音合成大模型,输出语音合成结果。

6、在一个实施例中,所述语音特征的长度信息包括以下信息至少之一:语音特征长度、文本中字符帧与待合成语音的语音帧之间的对应关系。

7、在一个实施例中,通过调整文本中字符帧与待合成语音的语音帧之间的对应关系,确定语音合成的语速。

8、在一个实施例中,1个字符帧对应1个或多个语音帧。

9、在一个实施例中,所述语音映射模型的训练过程为:

10、获取文本样本及与所述文本样本对应的语音样本;

11、通过所述语言大模型对所述文本样本进行处理,获取文本特征,并将所述文本特征输入所述语音映射模型,获得预测的语音特征的长度信息;

12、确定所述预测的语音特征的长度信息、语音样本对应的语音特征的长度信息之间的偏差结果,并根据所述偏差结果,调整所述语音映射模型的训练参数,直至满足收敛条件。

13、在一个实施例中,预测的语音特征的长度信息中包括以下信息至少之一:预测的语音特征长度、文本中字符帧与语音帧的对应关系。

14、在一个实施例中,通过语音模型对所述语音样本的处理,获得对应的语音特征及语音特征的长度信息。

15、在一个实施例中,所述语音模型是指通过大量语音数据训练的深度学习模型;其中,训练方法包括以下至少之一:有监督、自监督、半监督;

16、所述语言大模型是指通过大量文本数据训练的深度学习模型;其中,训练方法包括以下至少之一:有监督、自监督、半监督。

17、在一个实施例中,所述文本特征包括以下信息至少之一:文本向量特征信息、文本语义表征信息、文本发音表征信息、文本情感表征信息。

18、在一个实施例中,所述语音特征包括以下至少之一:音频特征、音调特征、音量特征、音色特征。

19、在一个实施例中,基于所述语音特征的长度信息、选择的音色特征信息,通过语音合成大模型的声码器,输出语音合成结果。

20、在一个实施例中,通过语音合成大模型中的鉴别器,比对所述语音合成结果与语音样本,获取比对结果,并基于比对结果,对所述语音合成大模进行训练,直至满足收敛条件。

21、在一个实施例中,通过所述语言大模型对所述文本样本进行处理,获取文本特征之前,还包括:对文本样本进行预处理,所述预处理包括以下至少之一:将文本样本中的字符转换为数字标识、删除文本样本中的目标字符、删除文本样本中的目标标点符号、压缩文本样本。

22、在一个实施例中,通过语音模型对所述语音样本的处理,获得对应的语音特征之前,还包括:对语音样本进行预处理,所述预处理包括以下至少之一:降采样、增强语音音质、单音轨转换。

23、在一个实施例中,文本样本及与所述文本样本对应的语音样本是指文本标注的语音数据,所述文本标注的语音数据包括以下至少之一:语音识别数据、带有字幕的语音数据。

24、在第二方面,本发明提供一种基于大模型的语音合成系统,包括:

25、文本特征获取模块,用于通过语言大模型获取待合成语音的文本特征;

26、语音长度获取模块,用于基于所述文本特征,通过语音映射模型确定待合成语音的语音特征的长度信息;

27、语音合成模块,用于基于所述语音特征的长度信息、选择的音色特征信息,通过语音合成大模型,输出语音合成结果。

28、在第三方面,提供一种计算机设备,包括处理器和存储装置,其中所述存储器中存储有程序,所述处理器执行所述程序时实现上述方法的技术方案中任一项技术方案所述的基于大模型的语音合成方法。

29、在第四方面,提供一种计算机可读存储介质,存储有程序,所述程序被执行时实现上述方法的技术方案中任一项技术方案所述的基于大模型的语音合成方法。

30、本发明上述一个或多个技术方案,至少具有如下一种或多种有益效果:

31、在实施本发明的技术方案中:

32、进一步地,通过语言大模型获取待合成语音的文本特征;基于所述文本特征,通过语音映射模型确定待合成语音的语音特征的长度信息;基于所述语音特征的长度信息、音色特征信息,通过语音合成大模型,输出语音合成结果。通过语言大模型获取文本特征以及结合语音特征的长度信息,输出语音合成结果,提高了语音合成准确度。

33、进一步地,通过大量的无标注文本训练,语言大模型有更强的语义理解能力,相对于传统语音合成模型的前端模块的分析,语言大模型有着更精准的发音、情感等表示信息,解决了多音字、情感、文本韵律模型学习低效的问题。而在这些问题有了充分的解决方案后,语音合成时,便消除了对内置的文本前端模组的依赖性,可以直接削减掉前端模组来优化训练流程,减少瓶颈模块,进而优化合成效果和简化出错时检查成本。

34、进一步地,本发明仅需使用带有文本标注的语音数据(例如:语音识别数据、带有字幕的对话数据),便可以进行语音合成训练,拓宽训练数据范围,减少了对高质量、精细标注的语音数据依赖,使得语音合成效果自然、流畅,提升语音合成的风格表现力和语音合成系统鲁棒性。

35、进一步地,本发明提供了一套高效泛用的语音映射模型,实现通过文本特征映射出语音特征的长度信息,进而使其他声学任务也能利用语言大模型的语义理解能力生成更真实的结果。

本文地址:https://www.jishuxx.com/zhuanli/20240618/23297.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。