一种数字人实时交互方法及装置、电子设备、存储介质与流程

- 国知局

- 2024-06-21 11:44:37

本技术涉及人机交互,特别涉及一种数字人实时交互方法及装置、电子设备、存储介质。

背景技术:

1、为了能提高人机交互体验,当前许多人工交互场景都通过构建的虚拟数字人与用户进行交互。并且,为更加趋近于真实的交流场景,还会根据向用户播放的语音,利用当前播放的语音对应的嘴部数据,对虚拟数字人进行渲染。

2、当前为了实现虚拟数字人的口型与语音一致,主要的方式是在人机交互时,获取终端回复用户的内容,并抽取该内容的音素,例如内容的声韵母或者音标。然后基于抽取的音素确定出对应的口型动画,并利用其对虚拟数字人进行渲染。或是提取该内容的特征,并基于该内容的特征,通过神经网络模型生成该内容对应的口型动画,用于对虚拟数字人进行渲染。

3、但是由于音素的种类本身有限,并且从音频中能抽取的音素也有限,所以基于这些比较少量的信息生成的口型动画较为单一,存在不连贯的问题,所以渲染出的效果较差,与播放的语音存在不协调的问题。而第二种方式,由于受限模型较大,所以其处理效率较慢,所以会存在明显的停顿过程,降低了实时交互的时效性体验。

技术实现思路

1、基于上述现有技术的不足,本技术提供了一种数字人实时交互方法及装置、电子设备、存储介质,以解决现有技术存在不协调以及时效性较差的问题。

2、为了实现上述目的,本技术提供了以下技术方案:

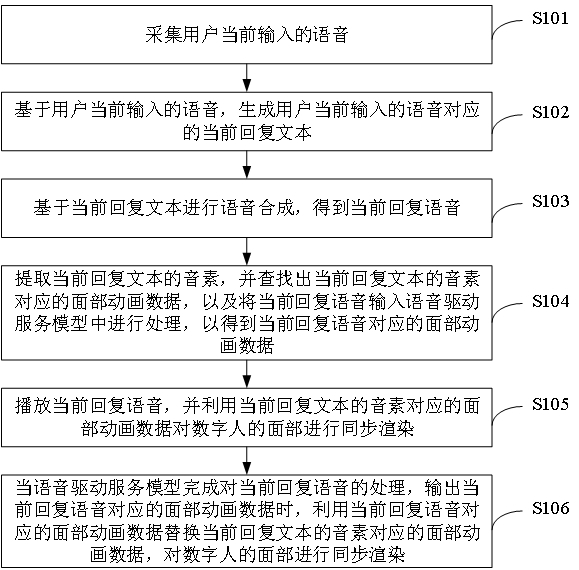

3、本技术第一方面提供了一种数字人实时交互方法,包括:

4、采集用户当前输入的语音;

5、基于所述用户当前输入的语音,生成所述用户当前输入的语音对应的当前回复文本;

6、基于所述当前回复文本进行语音合成,得到当前回复语音;

7、提取所述当前回复文本的音素,并查找出所述当前回复文本的音素对应的面部动画数据,以及将所述当前回复语音输入语音驱动服务模型中进行处理,以得到所述当前回复语音对应的面部动画数据;

8、播放所述当前回复语音,并利用所述当前回复文本的音素对应的面部动画数据对数字人的面部进行同步渲染;

9、当所述语音驱动服务模型完成对所述当前回复语音的处理,输出所述当前回复语音对应的面部动画数据时,利用所述当前回复语音对应的面部动画数据替换所述当前回复文本的音素对应的面部动画数据,对所述数字人的面部进行同步渲染。

10、可选地,在上述的数字人实时交互方法中,所述基于所述用户当前输入的语音,生成所述用户当前输入的语音对应的当前回复文本,包括:

11、对所述用户当前输入的语音进行语音识别,得到当前输入文本;

12、利用智能对话系统对所述当前输入文本进行处理,得到当前回复语音。

13、可选地,在上述的数字人实时交互方法中,所述提取所述当前回复文本的音素,并查找出所述当前回复文本的音素对应的面部动画数据,包括:

14、提取所述当前回复文本的音素,并将所述当前回复文本的音素发送至终端;

15、从内置在所述终端的音素文本与面部动画的映射关系表中,查找出所述当前回复文本的音素对应的面部动画数据。

16、可选地,在上述的数字人实时交互方法中,所述将所述当前回复语音输入语音驱动服务模型中进行处理,以得到所述当前回复语音对应的面部动画数据,包括:

17、将所述当前回复语音输入部署中服务端的语音驱动服务模型中,通过所述语音驱动服务模型对所述当前回复语音进行处理,输出所述当前回复语音对应的各个面部区域数据;

18、基于各个所述当前回复语音对应的各个面部区域数据,生成所述当前回复语音对应的面部动画数据。

19、可选地,在上述的数字人实时交互方法中,所述利用所述当前回复语音对应的面部动画数据替换所述当前回复文本的音素对应的面部动画数据,对所述数字人的面部进行同步渲染,包括:

20、获取所述当前回复文本的当前播放时间点,并剔除所述当前回复文本的音素对应的面部动画数据;

21、利用所述当前回复语音对应的面部动画数据中从所述当前播放时间点起的面部动画数据,实时按照所述当前回复语音的播放进度对所述数字人的面部进行同步渲染。

22、可选地,在上述的数字人实时交互方法中,还包括:

23、对所述当前回复文本进行分词,得到所述当前回复文本对应的多个分词;

24、通过词性标注模型对所述当前回复文本对应的各个分词进行词性分析,得到所述当前回复文本对应的各个分词的词性;

25、从所述当前回复文本对应的各个分词中,确定出多个当前关键词;

26、分别从各个所述当前关键词的词性对应的适配动作类别的动作数据集中,随机选取出一个动作数据,作为当前动作数据;

27、在播放所述当前回复语音,利用所述当前动作数据对所述数字人的躯体进行同步渲染。

28、本技术第二方面提供了一种数字人实时交互装置,包括:

29、语音采集单元,用于采集用户当前输入的语音;

30、回复文本生成单元,用于基于所述用户当前输入的语音,生成所述用户当前输入的语音对应的当前回复文本;

31、语音合成单元,用于基于所述当前回复文本进行语音合成,得到当前回复语音;

32、音素面部驱动单元,用于提取所述当前回复文本的音素,并查找出所述当前回复文本的音素对应的面部动画数据;

33、语音面部驱动单元,用于将所述当前回复语音输入语音驱动服务模型中进行处理,以得到所述当前回复语音对应的面部动画数据;

34、第一渲染播放单元,用于播放所述当前回复语音,并利用所述当前回复文本的音素对应的面部动画数据对数字人的面部进行同步渲染;

35、第二渲染播放单元,用于当所述语音驱动服务模型完成对所述当前回复语音的处理,输出所述当前回复语音对应的面部动画数据时,利用所述当前回复语音对应的面部动画数据替换所述当前回复文本的音素对应的面部动画数据,对所述数字人的面部进行同步渲染。

36、可选地,在上述的数字人实时交互装置中,所述回复文本生成,包括:

37、语音识别单元,用于对所述用户当前输入的语音进行语音识别,得到当前输入文本;

38、智能对话系统单元,用于对所述当前输入文本进行处理,得到当前回复语音。

39、可选地,在上述的数字人实时交互装置中,所述音素面部驱动单元,包括:

40、提取单元,用于提取所述当前回复文本的音素,并将所述当前回复文本的音素发送至终端;

41、查找单元,用于从内置在所述终端的音素文本与面部动画的映射关系表中,查找出所述当前回复文本的音素对应的面部动画数据。

42、可选地,在上述的数字人实时交互装置中,所述语音面部驱动单元,包括:

43、输出单元,用于将所述当前回复语音输入部署中服务端的语音驱动服务模型中,通过所述语音驱动服务模型对所述当前回复语音进行处理,输出所述当前回复语音对应的各个面部区域数据;

44、动画生成单元,用于基于各个所述当前回复语音对应的各个面部区域数据,生成所述当前回复语音对应的面部动画数据。

45、可选地,在上述的数字人实时交互装置中,所述第二渲染播放单元,包括:

46、时间获取单元,用于获取所述当前回复文本的当前播放时间点;

47、剔除单元,用于剔除所述当前回复文本的音素对应的面部动画数据;

48、渲染子单元,用于利用所述当前回复语音对应的面部动画数据中从所述当前播放时间点起的面部动画数据,实时按照所述当前回复语音的播放进度对所述数字人的面部进行同步渲染。

49、可选地,在上述的数字人实时交互装置中,还包括:

50、分词单元,用于对所述当前回复文本进行分词,得到所述当前回复文本对应的多个分词;

51、词性分析单元,用于通过词性标注模型对所述当前回复文本对应的各个分词进行词性分析,得到所述当前回复文本对应的各个分词的词性;

52、筛选单元,用于从所述当前回复文本对应的各个分词中,确定出多个当前关键词;

53、选取单元,用于分别从各个所述当前关键词的词性对应的适配动作类别的动作数据集中,随机选取出一个动作数据,作为当前动作数据;

54、动作渲染单元,用于在播放所述当前回复语音,利用所述当前动作数据对所述数字人的躯体进行同步渲染。

55、本技术第三方面提供了一种电子设备,包括:

56、存储器和处理器;

57、其中,所述存储器用于存储程序;

58、所述处理器用于执行所述程序,所述程序被执行时,具体用于实现如上述任意一项所述的数字人实时交互方法。

59、本技术第四方面提供了一种计算机存储介质,用于存储计算机程序,所述计算机程序被执行时,用于实现如上述任意一项所述的数字人实时交互方法。

60、本技术实施例提供了一种数字人实时交互方法,采集用户当前输入的语音。基于用户当前输入的语音,生成用户当前输入的语音对应的当前回复文本。基于当前回复文本进行语音合成,得到当前回复语音。提取当前回复文本的音素,并查找出当前回复文本的音素对应的面部动画数据,以及将当前回复语音输入语音驱动服务模型中进行处理,以得到当前回复语音对应的面部动画数据,从而同时通过两种方式生成面部动画数据。由于基于音素生成面部动画数据较快,所以在当前回复文本的音素对应的面部动画数据生成后,则可以播放当前回复语音,并利用当前回复文本的音素对应的面部动画数据对数字人的面部进行同步渲染,从而可以有效地保证实时交互的时效性。而基于音频通过模型生成的面部动画数据的生成速度较慢,但是其渲染效果较佳,所以当语音驱动服务模型完成对当前回复语音的处理,输出当前回复语音对应的面部动画数据时,利用当前回复语音对应的面部动画数据替换当前回复文本的音素对应的面部动画数据,对数字人的面部进行同步渲染,从而可以有效保证渲染面部表情和口型与语音播放更加协调,进而即保证了实时交互的时效性,又保证了渲染效果。

本文地址:https://www.jishuxx.com/zhuanli/20240618/23289.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表