混响装置的训练方法、混响方法和混响装置的训练装置与流程

- 国知局

- 2024-06-21 11:56:10

本公开总体说来涉及音频处理领域,更具体地讲,涉及一种混响装置的训练方法、混响方法和混响装置的训练装置。

背景技术:

1、目前,在除音乐厅、剧院等专业场地之外的场所演奏乐器时,如在录音室、家庭等场地演奏音乐时,乐器的声音效果会受到场地的声学特性影响,导致声音缺乏厚度,音色缺少变化,从而影响音乐的整体表现力和听众的沉浸体验。现有技术主要通过两种方式来改善这一问题:物理环境改造和数字混响处理。物理环境改造包括使用吸声材料、扩散器和隔音板等声学设备来调整室内的声音反射、吸收和扩散,从而改善声音的厚度和音色变化。这种方法能够提供自然的混响效果,但缺点在于成本高昂,且在临时或租赁的场地中不便于实施,其原因在于需要大规模的施工和专业的声学设计。数字混响处理通过算法模拟不同的室内环境,为用户提供更加灵活和经济的解决方案。这种方法可以在录音或实时演奏中通过软件添加混响效果,无需对物理环境进行改造。然而,现有技术的数字混响处理也存在若干缺点,如可能引入延迟,影响演奏者的实时反馈,且在没有专业音频设备的情况下,混响效果不尽如人意,无法完全复制自然混响的复杂性和丰富性。

技术实现思路

1、本公开的实施例提供一种混响装置的训练方法、混响方法和混响装置的训练装置,能够即时生成混响参数,为用户提供实时的音频反馈,改善现场表演的体验。

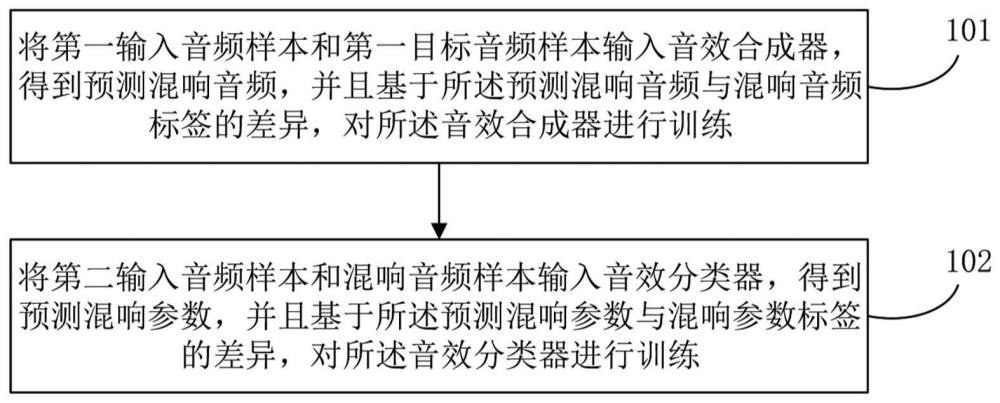

2、根据本公开的实施例的第一方面,提供一种混响装置的训练方法,所述训练方法包括:将第一输入音频样本和第一目标音频样本输入音效合成器,得到预测混响音频,并且基于所述预测混响音频与混响音频标签的差异,对所述音效合成器进行训练;将第二输入音频样本和混响音频样本输入音效分类器,得到预测混响参数,并且基于所述预测混响参数与混响参数标签的差异,对所述音效分类器进行训练,其中,所述混响装置包括依次连接的所述音效合成器、所述音效分类器以及混响生成器,所述混响生成器基于所述音效分类器输出的混响参数生成并输出用于输入所述混响装置的音频信号的混响补偿。

3、可选地,所述训练方法还包括:基于第一音频参数和第一混响配置从预先构建的音效数据库生成所述第一输入音频样本;基于第二音频参数和第二混响配置从所述音效数据库生成所述第一目标音频样本;基于第一音频参数和第二混响配置从所述音效数据库生成所述混响音频标签;随机设置环境配置信息;其中,对所述音效合成器进行训练的步骤包括:基于所述第一输入音频样本、所述第一目标音频样本以及所述环境配置信息,得到所述预测混响音频;基于反映所述预测混响音频与所述混响音频标签的差异的第一损失函数,对所述音效合成器进行训练。

4、可选地,所述音效合成器包括基于卷积神经网络的第一编码器、基于全连接神经网络的第二编码器、特征融合层以及基于卷积神经网络的解码器;其中,对所述音效合成器进行训练的步骤包括:通过第一编码器,从所述第一输入音频样本提取第一混响特征,并从所述第一目标音频样本提取第二混响特征;通过第二编码器从所述环境配置提取编码特征;通过特征融合层将所述第一混响特征、所述第二混响特征以及所述编码特征融合,得到融合特征;通过解码器,从所述融合特征生成所述预测混响音频;通过最小化反映所述预测混响音频与混响音频标签的差异的第一损失函数,对所述音效合成器进行训练。

5、可选地,所述训练方法还包括:从预先构建的音效数据库中选择所述第二输入音频样本;基于随机选择的混响参数对所述第二输入音频样本添加混响效果,得到所述混响音频样本,并将所述随机选择的混响参数作为所述混响参数标签;其中,对所述音效分类器进行训练的步骤包括:基于所述第二输入音频样本和所述混响音频样本,得到所述预测混响参数,并且基于反映所述预测混响参数与所述混响参数标签的差异的第二损失函数,对所述音效分类器进行训练。

6、可选地,所述音效分类器包括骨干神经网络和全连接神经网络;其中,对所述音效分类器进行训练的步骤包括:通过骨干神经网络层将所述第二输入音频样本和所述混响音频样本融合,得到所述第二输入音频样本和所述混响音频样本之间的混响差异;通过全连接神经网络,基于所述混响差异生成所述预测混响参数;通过最小化反映所述预测混响参数与所述混响参数标签的差异的第二损失函数,对所述音效分类器进行训练。

7、根据本公开的实施例的第二方面,提供一种混响方法,所述混响方法包括:通过音效合成器,接收第一组输入音频信号,并且基于第一组输入音频信号与预设目标音频信号生成第一组混响音频信号;通过音效分类器,基于第一组输入音频信号与第一组混响音频信号生成第一混响参数;通过混响生成器,基于第一混响参数生成第一混响补偿信号;通过所述混响生成器,响应于第二组输入音频信号中的每个音频信号,与第二组输入音频信号中的每个音频信号同步地播放第一混响补偿信号,其中,所述音效合成器和所述音效分类器是通过如上所述的训练方法得到的。

8、可选地,所述混响方法还包括:通过所述音效合成器,接收第i组输入音频信号与第i-1混响补偿信号,并且基于第i-1混响补偿信号、第i组输入音频信号以及预设目标音频信号生成第i组混响音频信号;通过所述音效分类器,基于第i组输入音频信号与第i组混响音频信号生成第i混响参数;通过所述混响生成器,基于第i-1混响参数和第i混响参数生成第i混响补偿信号;通过所述混响生成器,响应于第i+1组输入音频信号中的每个音频信号,与第i+1组输入音频信号中的每个音频信号同步地播放第i混响补偿信号,其中,i为大于1的整数。

9、可选地,所述音效合成器包括基于卷积神经网络的第一编码器、基于全连接神经网络的第二编码器、特征融合层以及基于卷积神经网络的解码器,其中,接收第一组输入音频信号,并且基于第一组输入音频信号与预设目标音频信号生成第一组混响音频信号的步骤包括:针对第一组输入音频信号中的每个输入音频信号,执行以下处理:通过第一编码器,从相应的输入音频信号提取第一混响特征,并从预设目标音频信号提取第二混响特征;通过第二编码器,接收环境配置信息,并从所述环境配置提取编码特征;通过特征融合层,将第一混响特征、所述第二混响特征以及所述编码特征融合,得到融合特征;通过解码器,从融合特征生成混响音频信号,其中,第一组混响音频信号包括针对第一组输入音频信号中的每个输入音频信号生成的每个混响音频信号。

10、可选地,所述音效分类器包括骨干神经网络和全连接神经网络,基于第一组输入音频信号与第一组混响音频信号生成第一混响参数的步骤包括:针对第一组输入音频信号中的每个输入音频信号以及第一组混响音频信号中的每个混响音频信号,执行以下处理:通过骨干神经网络层,将相应的输入音频信号和相应的混响音频信号融合,得到相应的输入音频信号和混响音频信号之间的混响差异;通过全连接神经网络,基于所述混响差异生成相应的混响参数;计算各个混响参数的平均值,作为第一混响参数。

11、可选地,生成第i组混响音频信号的步骤包括:将第i组输入音频信号中的每个输入音频信号与第i-1混响补偿信号叠加,以生成更新后的第i组输入音频信号;基于更新后的第i组输入音频信号与预设目标音频信号生成第i组混响音频信号。

12、可选地,基于第i组输入音频信号与第i组混响音频信号生成第i混响参数的步骤包括:基于更新后的第i组输入音频信号与第i组混响音频信号生成第i混响参数。

13、可选地,基于第i-1混响参数和第i混响参数生成第i混响补偿信号的步骤包括:通过对第i-1混响参数和第i混响参数进行加权平均,得到更新后的第i混响参数;基于更新后的第i混响参数生成第i混响补偿信号。

14、根据本公开的实施例的第三方面,提供一种混响装置的训练装置,所述训练装置包括:音效合成器训练单元,被配置为将第一输入音频样本和第一目标音频样本输入音效合成器,得到预测混响音频,并且基于所述预测混响音频与混响音频标签的差异,对所述音效合成器进行训练;音效分类器训练单元,被配置为将第二输入音频样本和混响音频样本输入音效分类器,得到预测混响参数,并且基于所述预测混响参数与混响参数标签的差异,对所述音效分类器进行训练,其中,所述混响装置包括依次连接的所述音效合成器、所述音效分类器以及混响生成器,所述混响生成器基于所述音效分类器输出的混响参数生成并输出用于输入所述混响装置的音频信号的混响补偿。

15、可选地,所述音效合成器包括基于卷积神经网络的第一编码器、基于全连接神经网络的第二编码器、特征融合层以及基于卷积神经网络的解码器;其中,所述音效合成器训练单元,还被配置为:通过第一编码器,从所述第一输入音频样本提取第一混响特征,并从所述第一目标音频样本提取第二混响特征;通过第二编码器从所述环境配置提取编码特征;通过特征融合层将所述第一混响特征、所述第二混响特征以及所述编码特征融合,得到融合特征;通过解码器,从所述融合特征生成所述预测混响音频;通过最小化反映所述预测混响音频与混响音频标签的差异的第一损失函数,对所述音效合成器进行训练。

16、可选地,所述音效分类器训练单元还包括:第二数据生成单元,被配置为从预先构建的音效数据库中选择所述第二输入音频样本;基于随机选择的混响参数对所述第二输入音频样本添加混响效果,得到所述混响音频样本,并将所述随机选择的混响参数作为所述混响参数标签;其中,所述音效分类器训练单元,还被配置为:基于所述第二输入音频样本和所述混响音频样本,得到所述预测混响参数,并且基于反映所述预测混响参数与所述混响参数标签的差异的第二损失函数,对所述音效分类器进行训练。

17、可选地,所述音效分类器包括骨干神经网络和全连接神经网络;其中,所述音效分类器训练单元,还被配置为:通过骨干神经网络层将所述第二输入音频样本和所述混响音频样本融合,得到所述第二输入音频样本和所述混响音频样本之间的混响差异;通过全连接神经网络,基于所述混响差异生成所述预测混响参数;通过最小化反映所述预测混响参数与所述混响参数标签的差异的第二损失函数,对所述音效分类器进行训练。

18、根据本公开的实施例的第四方面,提供一种混响装置,所述混响装置包括:音效合成器,被配置为接收第一组输入音频信号,并且基于第一组输入音频信号与预设目标音频信号生成第一组混响音频信号;音效分类器,被配置为基于第一组输入音频信号与第一组混响音频信号生成第一混响参数;混响生成器,被配置为基于第一混响参数生成第一混响补偿信号,并且响应于第二组输入音频信号中的每个音频信号,与第二组输入音频信号中的每个音频信号同步地播放第一混响补偿信号,其中,所述音效合成器和所述音效分类器是通过如上所述的训练方法得到的。

19、可选地,所述音效合成器还被配置为接收第i组输入音频信号与第i-1混响补偿信号,并且基于第i-1混响补偿信号、第i组输入音频信号以及预设目标音频信号生成第i组混响音频信号;所述音效分类器还被配置为基于第i组输入音频信号与第i组混响音频信号生成第i混响参数;所述混响生成器还被配置为基于第i-1混响参数和第i混响参数生成第i混响补偿信号,并且响应于第i+1组输入音频信号中的每个音频信号,与第i+1组输入音频信号中的每个音频信号同步地播放第i混响补偿信号,其中,i为大于1的整数。

20、可选地,所述音效合成器包括基于卷积神经网络的第一编码器、基于全连接神经网络的第二编码器、特征融合层以及基于卷积神经网络的解码器,其中,所述音效合成器还被配置为:针对第一组输入音频信号中的每个输入音频信号,执行以下处理:通过第一编码器,从相应的输入音频信号提取第一混响特征,并从预设目标音频信号提取第二混响特征;通过第二编码器,接收环境配置信息,并从所述环境配置提取编码特征;通过特征融合层,将第一混响特征、所述第二混响特征以及所述编码特征融合,得到融合特征;通过解码器,从融合特征生成混响音频信号,其中,第一组混响音频信号包括针对第一组输入音频信号中的每个输入音频信号生成的每个混响音频信号。

21、可选地,所述音效分类器包括骨干神经网络和全连接神经网络,其中,所述音效分类器还被配置为:针对第一组输入音频信号中的每个输入音频信号以及第一组混响音频信号中的每个混响音频信号,执行以下处理:通过骨干神经网络层,将相应的输入音频信号和相应的混响音频信号融合,得到相应的输入音频信号和混响音频信号之间的混响差异;通过全连接神经网络,基于所述混响差异生成相应的混响参数;计算各个混响参数的平均值,作为第一混响参数。

22、可选地,所述音效合成器还被配置为:将第i组输入音频信号中的每个输入音频信号与第i-1混响补偿信号叠加,以生成更新后的第i组输入音频信号;基于更新后的第i组输入音频信号与预设目标音频信号生成第i组混响音频信号。

23、可选地,所述音效合成器还被配置为:基于更新后的第i组输入音频信号与第i组混响音频信号生成第i混响参数。

24、可选地,所述混响生成器被配置为:通过对第i-1混响参数和第i混响参数进行加权平均,得到更新后的第i混响参数;基于更新后的第i混响参数生成第i混响补偿信号。

25、根据本公开的实施例的第五方面,提供一种电子设备,包括:至少一个处理器;至少一个存储计算机可执行指令的存储器,其中,所述计算机可执行指令在被所述至少一个处理器运行时,促使所述至少一个处理器执行如上所述的混响装置的训练方法,或如上所述的混响方法。

26、根据本公开的实施例的第六方面,提供一种存储有指令的计算机可读存储介质,当所述指令被处理器执行时,实现如上所述的混响装置的训练方法,或上述的混响方法。

27、据本公开的实施例的第七方面,提供一种计算机程序产品,所述计算机程序产品包括指令,当所述指令被处理器执行时,实现如上所述的混响装置的训练方法,或如上所述的混响方法。

28、本公开提供了混响装置的训练方法、混响方法和混响装置的训练装置,其中,音效合成器基于输入音频样本和目标音频样本生成对应的混响音频样本,音效分类器基于输入音频样本和混响音频样本得到对应的混响参数,根据混响参数生成对应的混响补偿,这一过程能够即时生成混响参数,为用户提供实时的音频反馈,改善现场表演的体验。另一方面,混响生成器根据混响参数生成室内环境中缺失的混响部分,可以改善室内音效。此外,用户可以将室内音效和目标音效相比较,反复调节混响参数,得到满意的效果,提高现场表演的体验。

本文地址:https://www.jishuxx.com/zhuanli/20240618/24572.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表