一种相机与激光雷达的外参快速标定及目标级融合方法

- 国知局

- 2024-07-31 22:41:11

本发明涉及多模态传感器外参标定及目标级融合,具体为一种相机与激光雷达的外参快速标定及目标级融合方法。

背景技术:

1、相机与激光雷达是常用的传感器,它们各自具有不同的优势和局限性。相机可以提供高分辨率的彩色图像,但是受光照条件、遮挡等因素的影响,难以获取准确的深度信息。激光雷达可以提供稠密的三维点云,但是缺乏颜色和纹理信息,且受噪声和运动畸变的影响。因此,将相机与激光雷达进行信息融合,可以实现对场景的更全面和准确的感知,提高无人驾驶、机器人导航、三维重建等应用场景的性能。

2、在无人驾驶的多模态传感器融合应用中,常基于目标级融合方法对相机与激光雷达各自独立处理生成的目标数据进行融合。例如,将激光雷达在三维坐标系中检测到的目标投影到相机图像平面上,与相机在二维坐标系中检测到的目标进行关联匹配,融合得到最终的目标位置、类别等信息。

3、目标级融合的优点是可以融合相机和激光雷达的多模态信息,得到具有纹理信息和深度信息的目标检测结果,并减少处理终端的计算量,提高系统的实时性和可靠性。但融合的准确性取决于相机与激光雷达之间的外参矩阵精度,而外参矩阵的获取方式又需要一定的便捷性与实时性。

4、目前,相机与激光雷达的外参标定大多采用传统的黑白棋盘格标定板进行标定,需要人工选择对应的图像像素和激光雷达点云来进行外参矩阵的求解,这种方法需要花费较多时间且标定精度低,无法适用于相机与激光雷达因经常拆卸导致其相对位置经常改变的工况。

5、因此,有必要开发一种耗时短、易于操作且精度高的相机与激光雷达外参标定方法来解决上述问题。

技术实现思路

1、针对现有技术中存在的问题,本发明的目的是:提供一种相机与激光雷达的外参快速标定及目标级融合方法,能够在多模态传感器标定及目标级融合领域中,解决相机与激光雷达之间外参标定耗时长、不准确和难操作的问题,并提高目标级融合的准确性,可用于相机与激光雷达因经常拆卸导致其相对位置经常改变的工况。

2、为了达到上述目的,本发明采用如下技术方案:

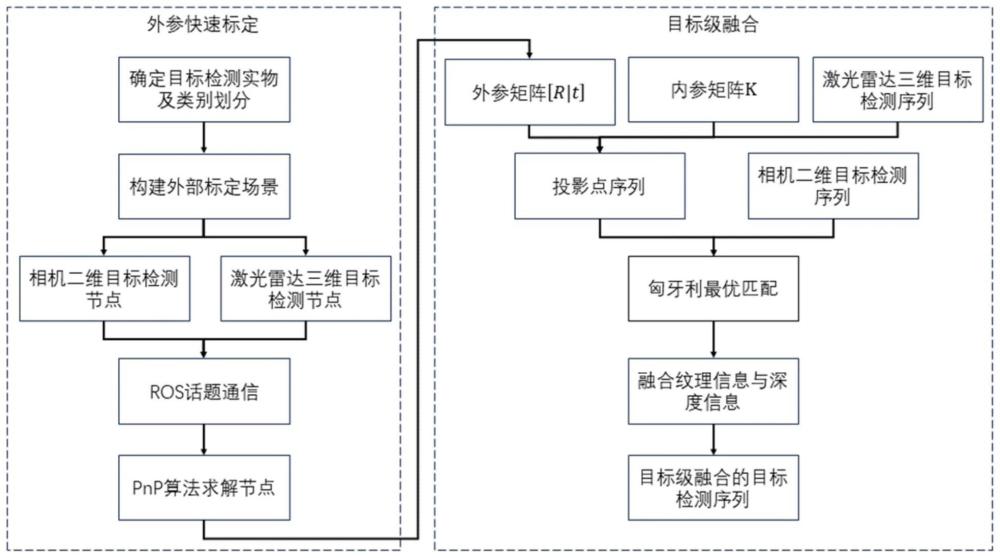

3、一种相机与激光雷达的外参快速标定方法,包括以下步骤,

4、确定在相机与激光雷达目标级融合任务中的单一类型目标检测实物及类别划分;

5、构建外部标定场景,包括固定相机与激光雷达的相对位置和将单个类别的目标检测实物按一定规则摆放;

6、相机和激光雷达分别通过目标检测算法对目标检测实物进行目标检测,分别得到相机二维目标检测序列和激光雷达三维目标检测序列

7、相机和激光雷达通过ros系统进行节点间数据通信,将获得的相机二维目标检测序列和激光雷达三维目标检测序列传入pnp算法求解节点,基于pnp算法求解得到激光雷达到相机的外参矩阵[r|t]。

8、进一步,固定相机与激光雷达的相对位置,包括:固定相机与激光雷达的相对位置关系并静置于世界空间中,确保相机的曝光视野和激光雷达的扫描视野最大程度上重合。

9、进一步,单个类别的目标检测实物按一定规则摆放,包括:选取n(n≥4)个单个类别的目标检测实物,并静置在相机视野和激光雷达视野中,并确保所有的目标检测实物在相机的像素坐标系opixel中成像时不发生外形遮挡与重叠,以及确保所有的目标检测实物在激光雷达坐标系olidar中相对坐标系原点具有由近及远的相对位置关系。

10、进一步,相机和激光雷达通过ros系统进行节点间数据通信,包括:相机节点与激光雷达节点分别以话题通信的方式,将相机二维目标检测序列和激光雷达三维目标检测序列以自定义话题消息的形式进行发布,相机二维目标检测序列和激光雷达三维目标检测序列在序列顺序上与目标检测实物一一对应。

11、进一步,将获得的相机二维目标检测序列和激光雷达三维目标检测序列传入pnp算法求解节点,包括:

12、pnp算法求解节点,订阅相机节点和激光雷达节点的话题;

13、当相机节点和激光雷达节点发布话题时,pnp算法求解节点接收得到相机二维目标检测序列和激光雷达三维目标检测序列的话题消息数据。

14、进一步,基于pnp算法求解的方式为,输入:n个点在世界坐标系中的坐标p1、p2、p3、…、pn,对应的在像素坐标系中的坐标p1、p2、p3、…、pn,相机的内参矩阵k;输出:激光雷达坐标系到相机坐标系的相对变换关系,即外参矩阵[r|t]。

15、进一步,相机的内参矩阵k为3×3矩阵:

16、

17、其中,fx和fy为像素坐标系相对于成像平面坐标系的相机焦距缩放系数;cx和cy为成像平面坐标系相对于像素坐标系的平移量;

18、激光雷达到相机的外参矩阵[r|t]包括旋转矩阵r和平移矩阵t,

19、r为3×3的旋转矩阵:

20、

21、t为3×1的平移矩阵:

22、

23、进一步,pnp算法包括:当目标检测实物在世界空间的同一平面上运动时,采用ippe算法;当目标检测实物不在世界空间的同一平面上运动时,采用epnp算法。

24、一种相机与激光雷达的目标级融合方法,包括以下步骤,

25、利用相机与激光雷达的外参快速标定方法进行标定,获得激光雷达到相机的外参矩阵[r|t];

26、基于激光雷达到相机的外参矩阵[r|t]和相机的内参矩阵,将激光雷达的三维目标检测序列投影到像素坐标系上得到投影点序列;

27、基于匈牙利算法通过最小化关联矩阵实现投影点序列代价关联,并将相机与激光雷达采集的信息进行融合,得到目标级融合的目标检测序列。

28、进一步,基于匈牙利算法通过最小化关联矩阵实现投影点序列代价关联包括,

29、匈牙利算法通过构建大小为n×m的矩阵对投影点序列和相机二维目标检测序列进行代价关联,其中,n为相机二维目标检测的个数,m为投影点的个数;

30、计算投影点序列和相机二维目标检测序列每两个坐标点之间的欧式距离d作为关联矩阵中的代价值,欧式距离d的计算公式为:

31、

32、最小化关联矩阵的目标函数为:

33、

34、最小化关联矩阵的约束条件为:

35、

36、其中,wij表示相机二维目标检测i和投影点j是否匹配,dij表示相机二维目标检测i和投影点j之间的代价值。

37、总的说来,本发明具有如下优点:

38、本申请基于所构建的标定场景及外参求解方法,可以快速并自动化的获取激光雷达和相机之间的外参矩阵,并实现在目标级融合任务中相机与激光雷达目标检测序列的准确匹配与信息关联,在相机与激光雷达因经常拆卸导致其相对位置经常改变的工况下具有优异的效果。

技术特征:1.一种相机与激光雷达的外参快速标定方法,其特征在于:包括以下步骤,

2.根据权利要求1所述的一种相机与激光雷达的外参快速标定方法,其特征在于:固定相机与激光雷达的相对位置,包括:固定相机与激光雷达的相对位置关系并静置于世界空间中,确保相机的曝光视野和激光雷达的扫描视野最大程度上重合。

3.根据权利要求1所述的一种相机与激光雷达的外参快速标定方法,其特征在于:单个类别的目标检测实物按一定规则摆放,包括:选取n(n≥4)个单个类别的目标检测实物,并静置在相机视野和激光雷达视野中,并确保所有的目标检测实物在相机的像素坐标系opixel中成像时不发生外形遮挡与重叠,以及确保所有的目标检测实物在激光雷达坐标系olidar中相对坐标系原点具有由近及远的相对位置关系。

4.根据权利要求1所述的一种相机与激光雷达的外参快速标定方法,其特征在于:相机和激光雷达通过ros系统进行节点间数据通信,包括:相机节点与激光雷达节点分别以话题通信的方式,将相机二维目标检测序列和激光雷达三维目标检测序列以自定义话题消息的形式进行发布,相机二维目标检测序列和激光雷达三维目标检测序列在序列顺序上与目标检测实物一一对应。

5.根据权利要求1所述的一种相机与激光雷达的外参快速标定方法,其特征在于:将获得的相机二维目标检测序列和激光雷达三维目标检测序列传入pnp算法求解节点,包括:

6.根据权利要求1所述的一种相机与激光雷达的外参快速标定方法,其特征在于:基于pnp算法求解的方式为,输入:n个点在世界坐标系中的坐标p1、p2、p3、…、pn,对应的在像素坐标系中的坐标p1、p2、p3、…、pn,相机的内参矩阵k;输出:激光雷达坐标系到相机坐标系的相对变换关系,即外参矩阵[r|t]。

7.根据权利要求6所述的一种相机与激光雷达的外参快速标定方法,其特征在于:相机的内参矩阵k为3×3矩阵:

8.根据权利要求1所述的一种相机与激光雷达的外参快速标定方法,其特征在于:pnp算法包括:当目标检测实物在世界空间的同一平面上运动时,采用ippe算法;当目标检测实物不在世界空间的同一平面上运动时,采用epnp算法。

9.一种相机与激光雷达的目标级融合方法,其特征在于:包括以下步骤,

10.根据权利要求9所述的一种相机与激光雷达的目标级融合方法,其特征在于:基于匈牙利算法通过最小化关联矩阵实现投影点序列代价关联包括,

技术总结本发明涉及一种相机与激光雷达的外参快速标定及目标级融合方法,包括构建外部标定场景,相机及激光雷达通过目标检测算法对目标检测实物进行目标检测,获得相机二维目标检测序列和激光雷达三维目标检测序列;相机和激光雷达进行数据通信,相机二维目标检测序列和激光雷达三维目标检测序列通过PnP算法求解激光雷达到相机的外参矩阵;基于外参矩阵和相机的内参矩阵,将激光雷达三维目标检测序列投影到相机图像上得到投影点序列;对投影点序列和相机二维目标检测序列进行最优匹配;将相机的纹理信息与激光雷达的深度信息进行融合,得到目标级融合的目标检测序列,在相机与激光雷达因经常拆卸导致其相对位置经常改变的工况下具有优异的效果。技术研发人员:韦智琛,李巍华,梁泽林受保护的技术使用者:华南理工大学技术研发日:技术公布日:2024/7/29本文地址:https://www.jishuxx.com/zhuanli/20240730/194120.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表