一种基于改进的YOLOV5的服装分类方法与应用

- 国知局

- 2024-07-31 23:20:47

本发明属于目标检测,尤其涉及一种基于改进的yolov5的服装分类方法与应用。

背景技术:

1、近年来,随着全球经济不断蓬勃发展,人们的生活水平和消费能力逐渐提高,服装消费也逐步升级。同时,人们对于服装品质和时尚性的追求也日益高涨,这为时尚领域带来了巨大的商业潜力。电子商务和移动互联网的快速崛起,更加推动了服装消费向线上转移。现在,图像已经成为人们获取服装信息的重要渠道之一。消费者不再满足于追求价格实惠的服装,而是追求时尚性和品质。社交媒体的广泛普及,进一步让消费者接触到更多的时尚信息和潮流趋势,导致服装图像数据量快速膨胀。随着计算机图像处理技术的不断革新,海量的服装图像可以高效地分析处理,将服装行业推向智能化、一体化发展。早在20世纪80年代初,计算机技术已经被广泛应用于服装行业的各个环节,服装分类在电子商务、时尚行业和智能社交媒体等领域具有广泛的应用前景。如何通过目标检测技术准确判断图像中每种服装的类别,为顾客检索、推荐出相似的商品,提升购买体验,成为当前目标检测技术在服装领域的研究热点之一。帮助用户更方便地选择适合的服装,提升购物体验和用户满意度。

技术实现思路

1、本发明公开一种基于改进的yolov5的服装分类方法与应用。通过目标检测技术准确判断图像中每种服装的类别,为顾客检索、推荐出相似的商品,帮助用户更方便地选择适合的服装,提升购物体验和用户满意度。

2、为了实现上述目的,本发明所采用的技术方案为:

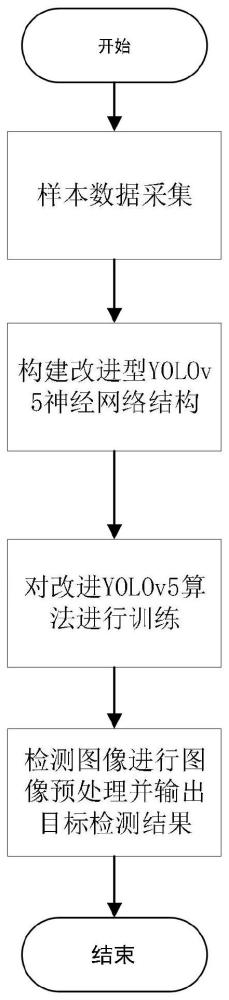

3、一种基于改进的yolov5的服装分类方法与应用,包括如下内容:

4、s1:获取服装待处理数据,对数据进行预处理,并在训练阶段对数据进行数据增强;

5、进一步的,所述s1的具体步骤为:

6、s1.1:整理获取的服装检测数据;

7、s1.2:在训练阶段随机读取其中的四张图片将获取的四张图片进行翻转(对原始图片进行左右翻转)、缩放(对原始图片进行大小的缩放)、色域的变换(对原始图片的明亮度、饱和度、色调进行改变)、随机裁剪操作;

8、s1.3:将处理后的照片按照第一张图片摆放在左上,第二张图片摆放到左下,第三张图片摆放在右下,第四张图片摆放在右上,利用矩阵的方式将四张图片固定的区域截取下来,将他们拼接成一张含有一系列边界框、标签信息的新图片。

9、s1.4将预处理好的数据集给定比例划分为训练集、验证集、测试集,训练集、验证集以及测试集的比例为7:2:1。

10、s2:采用cbam模块改进模型的骨干网络对数据进行特征提取,提高对目标的注意力能力;采用改进的特征融合网络afpn加强多尺度特征融合过程、在保持参数成本的同时提高特征的表达能力;采用eiou优化损失函数;

11、进一步的,所述s2的具体步骤为:

12、s2.1:将数据输入到改进的骨干网络中,依次通过conv模块、conv模块、c3cbam模块、conv模块、c3cbam模块、conv模块、c3cbam模块、conv模块、c3cbam模块、sppf模块进行特征提取。给定一个中间特征图f∈rc×h×w作为输入,首先对输入按通道进行全局最大池化和均值池化,将池化后的两个一维向量送入全连接层运算后相加,生成一维通道注意力mc∈rc×1×1,再将通道注意力与输入元素相乘,获得通道注意力调整后的特征图f’,其次将f’按空间进行全局最大池化和均值池化,将池化生成的两个二维向量拼接后进行卷积操作,最终生成二维空间注意力ms∈r1×h×w,再将空间注意力与f’按元素相乘;cbam生成注意力过程描述为:

13、

14、

15、其中,表示逐元素相乘,f″是最终的细化输出。

16、s2.2为了避免特征金字塔在多级传输中的信息丢失和退化,afpn在第一阶段组合两个不同分辨率的浅层特征来启动融合过程,随着模型进入后期阶段,逐渐将深层特征纳入融合过程。所述步骤s2.2的具体步骤为:

17、s2.2.1:afpn从骨干网络的每个特征层提取最后一个特征,产生一组不同尺度的特征{c3,c4,c5};

18、s2.2.2:双线性插值方法进行上采样和使用卷积进行下采样对不同分辨率进行处理;

19、s2.2.3:采用asff为不同层次的特征分配不同的空间权重,将浅层次特征c2和c3输入到特征金字塔网络后将深层次特征c5融合中得到一组多尺度特征{p3,p4,p5},具体公式如下:

20、

21、表示从level n到level l的位置(i,j)出的特征向量,表示结果特征向量,和表示3个不同level的特征在level l的空间权重,受的约束。

22、s2.2.4:将多尺度特征{p3,p4,p5}输入到检测头进行预测。

23、s2.3:使用eiou回归损失函数来解决ciou存在的问题,在ciou的惩罚项基础上将候选框和实际目标区域长宽比值的影响因子拆分开,分别计算候选框和实际目标区域的长宽数值,eiou回归损失函数的表达式如公式(2)所示:

24、

25、

26、

27、

28、其中,cω和ch是闭合候选框和实际区域最小外接矩形框的长度和宽度,式中包含3部分:候选框和实际区域的重叠损失liou,候选框和实际区域的中心距离损失ldis,候选框和实际区域的长宽损失lasp,lou是锚框损失函数,其结果是由预测框和真实框两个区域重叠的部分除以两个区域的集合部分得出;b,bgt分别是预测框和真实框的中心点;ρ2(b,bgt)是预测框和真实框的中心点的欧式距离;c是能够同时包含预测框和真实框的最小闭包区域的对角线距离;α是一个平衡参数,不参与梯度计算;υ是用来衡量长宽比一致性的参数;w,h分别是预测框的宽和高;wgt,hgt分别是真实框的宽和高;eiou损失函数将目标框的长度和宽度分开计算,可以解决giou损失函数在水平和垂直方向上误差较大的问题,并且能够提高收敛的速度和回归的精度。

29、s3、对改进yolov5算法进行训练;进一步的,所述s3的具体步骤为:

30、将训练集和验证集的路径、初始训练权重文件路径输入网络模型训练所需参数中

31、进行训练,获得训练完成改进的yolov5模型。

32、s4.检测图像进行图像预处理并输出目标检测结果。

33、进一步的,所述s4的具体步骤为:

34、为了验证方法的有效性,在pc机、嵌入式设备上进行检测实验,使用python语言编写,先在pc机上用pycharm验证了代码的正确性;后接入摄像头进行图像分析。输出目标识别结果,结果有13种,包括短袖上衣,长袖上衣,短袖外套,长袖外套,背心,吊带,短裤,长裤,裙子,短袖连衣裙,长袖连衣裙,背心裙,吊带裙。

35、与现有技术相比,本发明具有以下有益效果:

36、在yolov5网络的主干网络中的sppf层前添加注意力机制模块cbam,带来稳定的性能提升。引入afpn防止特征信息在传输和交互过程中的丢失或退化。eiou损失函数将目标框的长度和宽度分开计算,可以解决giou损失函数在水平和垂直方向上误差较大的问题,并且能够提高收敛的速度和回归的精度。本发明能准确判断图像中每种服装的类别,并定位出服装的具体位置,为顾客检索、推荐出相似的商品,帮助用户更方便地选择适合的服装,提升购物体验和用户满意度。

本文地址:https://www.jishuxx.com/zhuanli/20240730/197109.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。